基于SIFT的高分二號全色與多光譜影像配準算法

王森

摘要:傳統的SIFT算法在配準高分二號全色與多光譜影像時配準效率較低,本文使用一種新的配準策略:首先對圖像進行區域劃分并計算每個區域的信息熵,只針對信息熵較大的部分采用改進的Harris算法提取特征點,然后使用SIFT算法描述特征點并進行粗匹配,再用PROSAC進行特征點的提純,實現精匹配,最后完成圖像配準。

關鍵詞:高分二號;圖像配準;信息熵;SIFT;PROSAC

中圖分類號:TP391.4 文獻標識碼:A 文章編號:1007-9416(2020)01-0104-02

0 引言

在遙感圖像處理中,圖像配準是很重要的處理環節。配準精度的高低直接會影響到后續的圖像處理質量,因此對遙感圖像配準進行深入的研究具有很重要的現實意義。近年來Harris算子和SIFT算子在圖像配準領域應用較為廣泛,這兩種方法在處理普通圖像時能夠取得較好的配準效果,但是對于遙感圖像配準而言往往配準精度較低。因此本文基于這兩種算法對高分二號衛星圖像的配準方法進行研究,從而充分利用這兩種算法的優點。

Harris[1]角點檢測算法是通過微分算子計算像素點在任意方向上的灰度變化,并根據角點響應函數的值來判斷目標像素點是否為角點。該算法運算量較小,且提取的角點分布較為均勻。尺度不變特征變換(SIFT)[2]算法是圖像配準領域較為經典的一種算法,SIFT特征對圖像的尺度、旋轉、平移等具有不變性,該算法的主要步驟包括:尺度空間構造、極值點檢測、特征點主方向分配、特征描述子生成。SIFT算法在普通圖像中的配準效果較好,但是對于大幅面的遙感圖像往往具有配準速度慢、精度低等特點。配準速度慢主要體現在檢測到的特征點數量多,從而在特征描述階段會有較多的時間消耗,因此本文在特征檢測部分使用改進的Harris算法代替SIFT算法進行特征檢測。

1 基于Harris-SIFT的圖像配準算法

1.1 特征點檢測

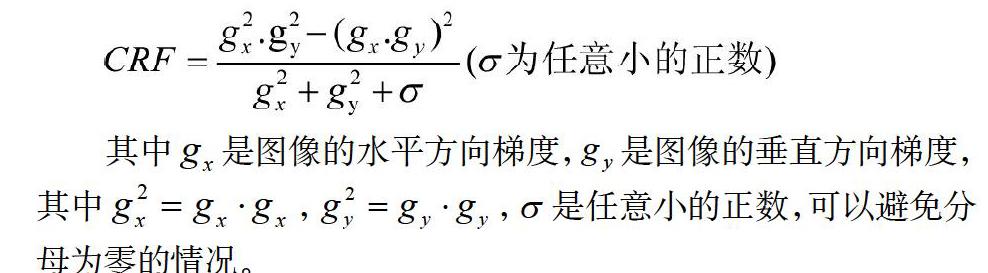

經典的Harris算子檢測出的角點不具有尺度不變性,因此本文使用Harris-Laplace[3]算法進行角點檢測,使其具有尺度不變性。Harris算子是通過角點響應函數CRF(corner response function)的值來判斷該點是否為角點,當CRF的值超過所設定的閾值時,則認為該點為需要的角點。但是CRF值的計算會受到經驗常數k的影響,進而會影響到后續的配準效果,因此為了避免k值的選取,本文使用改進的角點響應函數[4],計算式為:

其中是圖像的水平方向梯度,是圖像的垂直方向梯度,其中,,是任意小的正數,可以避免分母為零的情況。

針對該改進的Harris算法依然存在無效的角點的問題,本文參考王崴等[5]提出的在當前的目標像素點8鄰域的范圍內統計與之相似的像素點個數,以此來剔除無效的角點。由于高分二號圖像的特殊性,且波段間灰度存在較大的差異,這樣容易使角點的定位存在偏差。故需要對用上述方法檢測到的角點進行精定位,本文參考經典的Forstner[6]算子對角點進行精定位。

1.2 特征描述子生成

由于本文不直接對整幅圖像進行特征檢測,而僅對信息熵較大的區域使用改進的Harris算子檢測角點特征,這樣大大的降低了算法的運算量,所以不必再為了進一步提高運算速度而降低特征描述符的維數,因為在降維的同時可能會使配準精度降低。因此,為了確保配準精度,本文使用傳統的SIFT算法進行特征描述,生成128維特征向量,具體可參考文獻[2]中的方法。

1.3 針對高分二號衛星影像的配準方法

由于高分二號圖像的數據量較大,因此傳統的配準策略在此已不能滿足實時性的要求。本文方法為:首先對整幅圖像進行區域劃分[7]并計算各區域信息熵,然后針對信息熵較大的區域使用改進的Harris算法進行特征提取,從而縮短特征檢測的時間,而且能夠使特征點在整幅圖像中分布均勻。之后使用SIFT算法對特征點進行描述并且進行粗匹配,然后使用PROSAC[8]算法進一步提純特征點并估算出變換模型參數,從而實現最終的圖像配準。

2 實驗分析

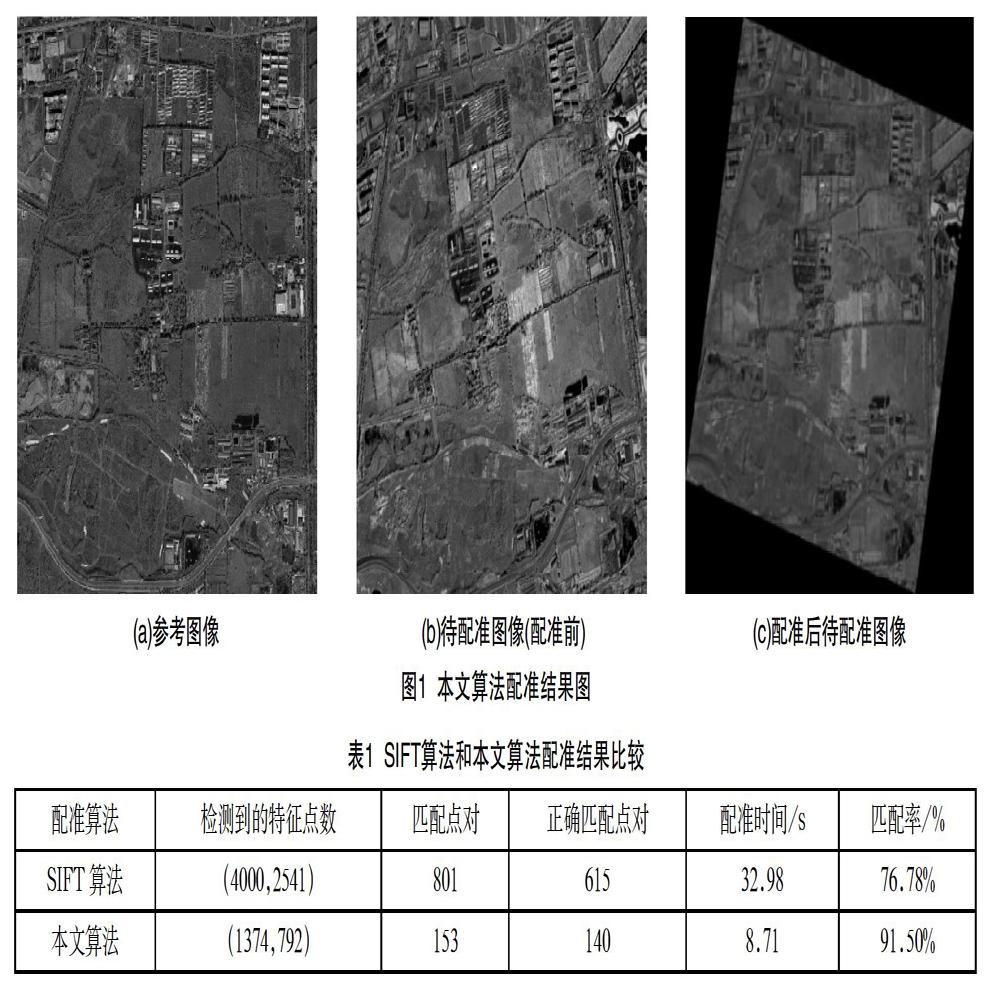

本文選取全色影像為基準圖像,由于多光譜影像中的近紅外波段和全色影像存在較大的灰度差異,故以近紅外波段為例作為待配準圖像進行實驗更能驗證配準算法的有效性,全色影像大小為2286×2225,近紅外波段影像大小為746×749。本文使用VS2013結合GDAL庫編程。使用傳統的SIFT算法作為對比實驗,本文算法實驗結果如圖1所示,兩種算法配準效果比較如表1所示。實驗結果表明,本文算法明顯比SIFT算法檢測到的特征點少、配準速度快,在提高配準速度的同時,配準精度也較SIFT算法高。

3 結語

本文針對高分二號遙感圖像提出了一種在區域劃分的基礎上,使用改進的Harris算子和SIFT算子相結合的圖像配準方法。實驗證明,該算法提取的特征點較SIFT算法更少且更均勻,配準速度和配準精度都較SIFT算法有顯著的提高。

參考文獻

[1] Harris C,Stephens M.A combined corner and edge detector[C].Proceedings of the Alvey Vision Conference,Manchester,UK,1988:147-151.

[2] Lowe D G.Distinctive image features from scale-invariant keypoints[J].International Journal of Computer Vision,2004,60(2):91-110.

[3] Mikolajczyk K,Schmid C.Scale & affine invariant interest point detectors[J].International Journal of Computer Vision,2004,60(1):63-86.

[4] 毛晨,錢惟賢,顧國華,等.基于雙邊濾波的Harris角點檢測[J].紅外技術,2014,36(10):812-815+819.

[5] 王崴,唐一平,任娟莉,等.一種改進的Harris角點提取算法[J].光學精密工程,2008(10):1995-2001.

[6] 張艷,張志成.混合Forstner算法和SIFT灰度圖像特征點提取[J].科技通報,2012(10):64-70.

[7] 李玉峰,王竹筠.基于Harris-SIFT特征匹配的圖像自動配準算法研究[J].電視技術,2015,39(23):26-30.

[8] CHUM O,MATAS J.Matching with PROSAC-progressive sample consensus[C].IEEE Computer Society Conference on Computer Vision & Pattern Recognition(ICCV),Beijing:IEEE,2005:220-226.