基于紅外可見光融合圖像的車輛定位方法

周云飛,王晨霖

基于紅外可見光融合圖像的車輛定位方法

周云飛,王晨霖

(武漢理工大學(xué) 汽車工程學(xué)院,湖北 武漢 430070)

隨著無人駕駛的發(fā)展,對車輛定位技術(shù)提出了更高的要求。基于視覺的車輛定位方法以其低成本、可擴(kuò)展性,在近些年來發(fā)展迅速。僅僅依靠可見光圖像很容易在光線惡劣的環(huán)境下產(chǎn)生較大誤差,基于紅外可見光融合圖像的車輛定位方法則可以很好地解決這個問題,獲得更準(zhǔn)確的結(jié)果。

車輛;定位方法;視覺;融合圖像

1 引言

視覺定位技術(shù)僅使用圖像作為輸入即可確定系統(tǒng)位置,不需要相關(guān)環(huán)境的任何先驗知識。GPS、北斗等衛(wèi)星定位技術(shù)容易被城市高樓眾多的環(huán)境影響,導(dǎo)致定位誤差很大,而基于視覺的車輛定位技術(shù)能夠有效解決這些問題,可以實現(xiàn)自主定位,非常適合車輛這種移動平臺使用,因此,視覺定位技術(shù)已成為當(dāng)下移動車輛定位方法的研究熱點,是計算機(jī)視覺的一個重要分支。傳統(tǒng)的基于可見光圖像的定位方法很容易在光照條件很差的地區(qū)失效,無法滿足無人駕駛的全天候定位的需要。紅外相機(jī)可以很好彌補這一點。本文擬實現(xiàn)一種基于紅外可見光融合圖像的車輛定位方法,以滿足無人駕駛車輛定位的需要。

2 相關(guān)工作

在文獻(xiàn)[1]中,作者利用紅外和可見光的融合圖像實現(xiàn)了車輛的定位。分別使用了兩種圖像融合方法,一種是基于離散小波變換的圖像融合,另一種是基于單色閾值的圖像融合方法。

2.1 基于離散小波變換的圖像融合

基于離散小波變換的圖像融合方法過程為:利用離散小波變換的方法分別將紅外圖像和可見光分解成高頻子帶和低頻子帶;對高頻的紅外子帶和可見光子帶使用取小原則,去除低頻的紅外子帶和可見光子帶;運用離散小波變換的反轉(zhuǎn)換,從融合的高頻子帶中生成融合圖像。

2.2 基于單色閾值的圖像融合

基于單色閾值的圖像融合方法可以在可見光圖像中高亮顯示紅外圖像中的發(fā)熱物體,具體步驟如下。

將RGB圖像轉(zhuǎn)換為HSV圖像。HSV是一種根據(jù)顏色的直觀屬性建立的顏色分類體系。

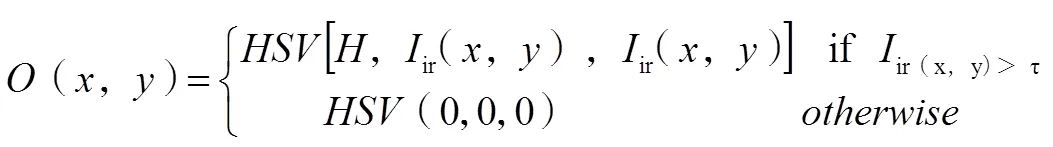

生成一個重疊圖像(,):

式(1)中:為溫度閾值。

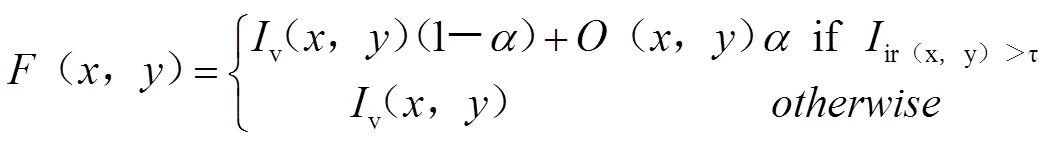

根據(jù)可見光圖像v(,)和重疊圖像(,)生成最終的融合圖像(,):

式(2)中:為不透明度值,它決定了融合圖像中保存的可見光圖像信息的大小。

在融合圖像的基礎(chǔ)上,筆者使用了開源的視覺定位算法LibVISO2,獲取較為準(zhǔn)確的相機(jī)的位置信息。但是,由于筆者使用的圖像融合方法和視覺定位算法存在許多問題,比如LibVISO2是一個僅僅使用可見光圖像的定位算法,不加任何修改就直接用于紅外可見光融合圖像,所以,無法滿足車輛定位的需要。

3 本文方法介紹

總體結(jié)構(gòu)如圖1所示。

圖1 總體結(jié)構(gòu)

如圖1所示,本文提出的方法的總體結(jié)構(gòu)為:輸入紅外圖像和可見光圖像,然后對圖像進(jìn)行融合,最后基于融合圖像實現(xiàn)車輛定位,得到車輛的位置信息。

3.1 圖像融合方法

使用ZHANG等人[2]提出的圖像融合方法,對紅外和可見光圖像進(jìn)行融合。相比于基于離散小波變換和單色閾值的圖像融合算法,它可以更好地融合紅外和可見光圖像中的有效信息,并且非常適合光照強(qiáng)度低的環(huán)境,具體步驟如下:取四叉樹分解和貝塞爾插值的方法,重新構(gòu)建紅外圖像的背景。從紅外圖像中減去上一步得到的重建背景,以減少冗余的背景信息,并提取出紅外圖像中的明亮特征,這些明亮特征對于車輛的定位是十分有用的;將提取出的紅外圖像中的明亮特征添加到可見光圖像上,獲得最終的融合圖像。

通過這種方式,融合圖像不僅可以通過融合紅外亮特征來揭示不可見但重要的紅外物體,而且還可以保存大量原始視覺信息,保持良好的視覺質(zhì)量,很好地滿足了車輛定位的要求。

3.2 視覺定位方法

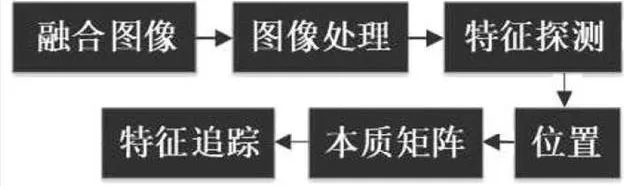

基于融合圖像的車輛定位方法如圖2所示。

圖2 基于融合圖像的車輛定位方法

如圖2所示,首先使用限制對比度自適應(yīng)直方圖均衡化算法對融合圖像進(jìn)行處理,它能夠有效地改善圖像的對比度,限制噪聲放大,還能顯示更多的圖像細(xì)節(jié)信息。由于融合圖像不可避免地帶來了噪聲,很有可能會影響定位的效果。使用FAST特征探測器進(jìn)行特征檢測,使用KLT光流法對檢測到的特征點進(jìn)行追蹤。再使用Nister′s 5-point算法計算本質(zhì)矩陣。在這個過程中,使用隨機(jī)抽樣一致算法去除誤匹配點,以使計算的本質(zhì)矩陣更準(zhǔn)確。計算位置信息,本質(zhì)矩陣的性質(zhì):

=[]x(3)

式(3)中:為旋轉(zhuǎn)矩陣;[]x為與平移矩陣進(jìn)行叉乘。

對本質(zhì)矩陣使用SVD分解,得到每兩幀圖像之間的旋轉(zhuǎn)矩陣和平移矩陣。再根據(jù)旋轉(zhuǎn)矩陣和平移矩陣,算出每幀圖像中相機(jī)的位置,即相對應(yīng)的車輛的位置,實現(xiàn)車輛的定位要求。

4 實驗

本文使用韓國科學(xué)技術(shù)院提高的公開數(shù)據(jù)集——《全天視覺位置識別數(shù)據(jù)集》進(jìn)行測試,采用了其中的“EastAM02”圖像序列。該數(shù)據(jù)集包含了韓國科學(xué)技術(shù)院校園內(nèi)不同時間段拍攝的紅外和可見光圖像。其中,可見光圖像的分辨率為1 280×960,紅外圖像的分辨率為320×256。紅外圖像進(jìn)行了線性插值放大處理,分辨率變?yōu)榱? 280×960。定位數(shù)據(jù)由GPS和慣性導(dǎo)航單元給出。

實驗結(jié)果如表1所示。

表1 實驗結(jié)果

圖像類別可見光圖像融合圖像 總距離/m218.31 總誤差/m22.0917.46

表1表明,相比于可見光圖像,融合圖像可以獲得更準(zhǔn)確的結(jié)果。

5 總結(jié)

本文提出了一個基于紅外可見光圖像融合的視覺定位方法,實驗結(jié)果表明,僅僅使用可見光圖像的效果差于使用紅外和可見光融合圖像的效果。未來,還會提出更加先進(jìn)的方法,并和其他的傳感器進(jìn)行融合,以滿足無人駕駛車輛的定位需要。

[1]POUJOL J,AGUILERA C A,DANOS E,et al.A visible-thermal fusion based monocular visual odometry[J].Proc Spie,2015(3):22.

[2]ZHANG Y,ZHANG L,BAI X,et al.Infrared and visual image fusion through infrared feature extraction and visual information preservation[J].Infrared Physics & Technology,2017(83):227-237.

U495

A

10.15913/j.cnki.kjycx.2020.09.041

2095-6835(2020)09-0102-02

周云飛(1999—),男,本科。

〔編輯:張思楠〕