特征重校準融合密集神經網絡的遙感場景分類

陳德海,潘韋馳,馬 原,黃艷國

(江西理工大學 電氣工程及自動化學院,江西 贛州 341000)

0 引 言

遙感影像技術在現代得到快速發展,其所包含的空間信息越來越豐富,從而使得影像中復雜的語義信息難以提取。目前有許多學者研究針對遙感影像分類提出許多方法[1-4],如何有效提取遙感影像場景的高層語義特征是當前極具挑戰的研究內容。

近幾年,深度學習因其強大的學習能力被應用到諸多領域[5-7],同時也被不少研究者應用于遙感影像場景分類[8-13]中,取得了不錯的效果。文獻[14]利用卷積神經網絡進行場景分類,訓練出的特征可以進行遙感圖像中建筑物的二分類。文獻[15]針對遙感場景分類,分析了3種卷積神經網絡策略用以提高分類精度,降低訓練參數。文獻[16]通過聯合顯著性采樣和卷積神經網絡進行遙感場景分類,但對于類內差異性和類間相似性等問題,顯著性算法無法識別。

為解決遙感場景影像中空間信息復雜,遙感場景影像樣本不足導致分類精度無法提高等問題。本文通過構建SE block提高通道之間的依賴性,進而提高遙感場景特征響應能力;然后利用密集神經網絡的特征重用以及高效的信息流傳遞特點,將SE block嵌入DenseNet-121中并引入多尺度SE block,學習不同尺度下的遙感場景影像特征并校準特征通道權重,提高遙感場景影像特征的穩健表示;最后,利用縮聚-激發機制獲取遙感場景影像有效特征并抑制干擾特征,通過數據增強擴充數據集提高模型泛化能力以及魯棒性。實驗結果表明,該方法能有效提升網絡針對遙感影像的分類精度以及泛化能力。

1 相關理論

1.1 squeeze and excitation block

文獻[17]通過研究網絡結構中通道之間的關系,提出一種新的結構單元,縮聚與激發模塊(squeeze and excitation block)。其目標是通過卷積特征的通道之間的相互依賴性來提高網絡生成的特征圖的質量,允許網絡執行特征重新校準,通過該機制,它可以學習使用全局信息來選擇性地強調有效的信息特征并抑制干擾特征。SE block分為3個步驟,首先通過縮聚操作通過使用全局平均池化(GAP)將輸入的特征圖進行統計求和,獲取全局信息。具體公式如下

(1)

其中,Z∈RC,H、W表示特征圖的高度和寬度。Zc表示為經過全局平均池化后特征圖的集合。

其次,使用激發操作捕獲通道之間的依賴性,對縮聚操作中的特征圖進行處理。具體公式如下

s=σ(W2δ(W1z))

(2)

最后,進行對特征的重校準操作,公式如下

yc=Fscale(uc,sc)=sc·uc

(3)

其中,yc表示經過重校準后的二維矩陣,通過將特征圖uc與權重sc相乘,得到第c個通道的輸出矩陣yc。

1.2 密集神經網絡

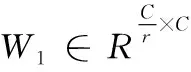

密集神經網絡(DenseNet)[18]由康奈爾大學、清華大學等提出。該網絡對殘差神經網絡[7]進行改進,通過密集連接的方式加強層與層之間的信息流傳遞,更有效地利用了特征提高網絡潛力,降低網絡參數,網絡結構如圖1所示。密集神經網絡將之前所有層的特征輸出作為當前層的輸入,即x0,x1,…,xl-1,通過復合函數Hl得到輸出xl,具體公式如下

xl=Hl([x0,x1,···,xl-1])

(4)

其中,Hl為經過批處理化(batch normalization)、ReLU激活函數和3×3卷積計算3種連續操作的復合函數,這種結構被稱為Dense block。

圖1 密集神經網絡

2 網絡結構設計

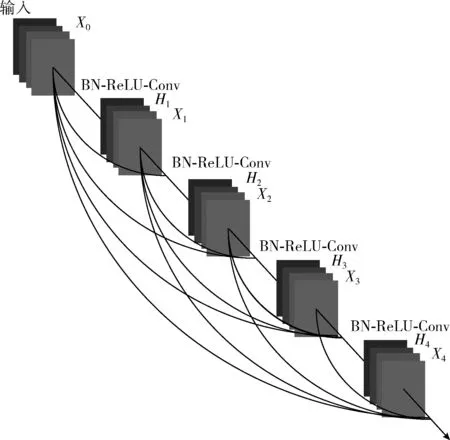

由于遙感場景影像具有地理特征復雜,空間信息豐富特點,增加了場景分類的難度,而僅通過單一的堆疊卷積層,無法有效提取遙感影像的特征,從而導致分類不精確。受到SE block與DenseNet啟發,通過將多尺度SE block嵌入到DenseNet中,利用DenseNet特征重用和高效信息流的特點,提高SE block提取有效遙感場景影像特征抑制場景中干擾特征的效果,提高分類的準確度。網絡結構設計如圖2所示。

圖2 本文網絡結構

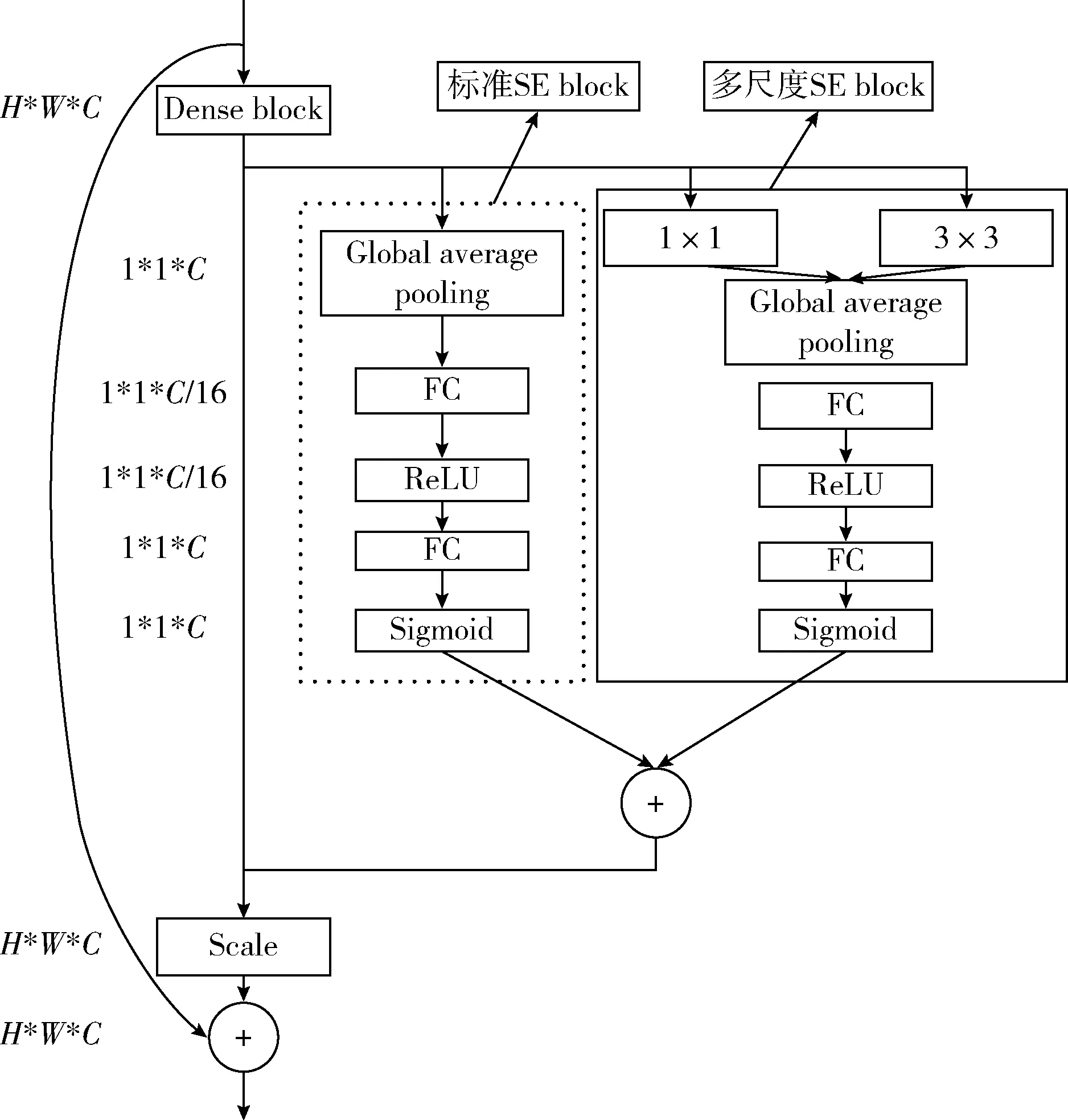

如圖2所示,網絡結構設計步驟為:①在每個Dense block的卷積變換之后嵌入SE block,對每個遙感場景特征通道的信息進行權重自動分配;②在嵌入SE block旁引入多尺度SE block分支,即在全局池化層前加入1×1與3×3的卷積層,用以解決不同尺度下遙感影像場景特征圖之間的空間聯系;③將兩種分支權重通過Scale操作加權到最初的遙感場景特征圖中,以增強整個神經網絡的泛化能力。該模型通過“特征重校準”策略,高效利用多維特征信息,并且由于多尺度SE block分支的引入,有效的將不同尺度下的遙感場景影像特征進行融合,保證遙感場景影像有效特征穩定保留,增強整體網絡的學習和表達能力,進一步提升網絡性能與泛化能力。本文的網絡模型由4個Dense block構成,每一個Dense block后嵌入SE block并引入多尺度SE block分支。DenseNet的參數配置見表1。

表1 DenseNet參數配置

通過這種融合結構,模型既可以提高遙感場景影像的信息流傳遞,又可以學習場景影像的全局信息,獲得遙感場景特征的健壯性表示并且增強有效特征權重,抑制干擾特征權重,進而起到特征自適應校準的作用,使遙感影像場景的分類精度得到提升。

3 實驗結果與分析

3.1 實驗數據集

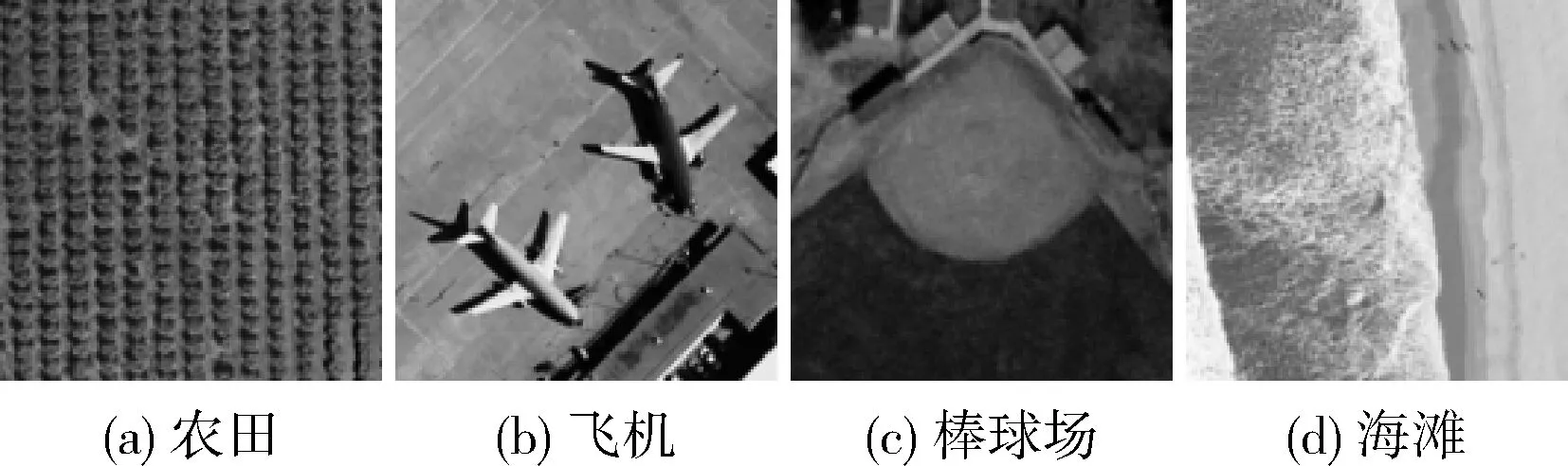

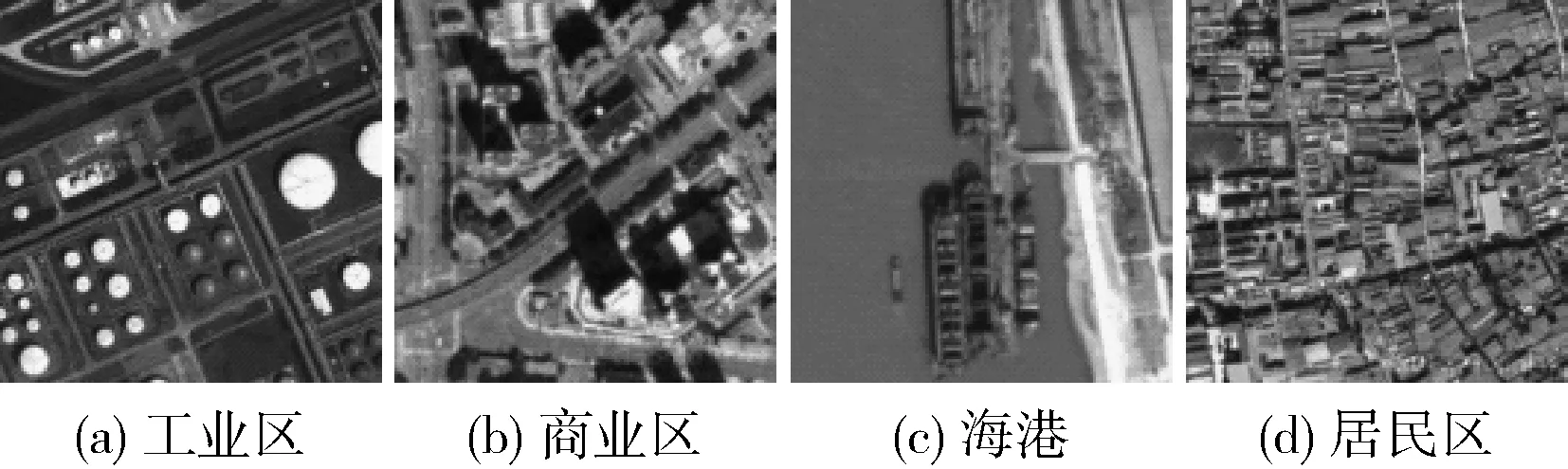

實驗數據集1為UCMerced_LandUse,選自美國地質勘探局國家城市地圖航空遙感影像,其中包含立交橋、森林等21類遙感場景影像,每類遙感影像的樣本數量為100,尺寸均為256×256,空間分辨率為0.3 m,各類遙感影像的部分示例如圖3所示。

圖3 UCMerced_LandUse數據集部分示例

實驗數據集2為SIRI-WHU,選自Google Earth遙感影像數據集,該數據集包含12類遙感影像場景,每類遙感影像的樣本數量為200,尺寸均為200×200,空間分辨率為2 m,各類遙感影像的部分示例如圖4所示。

圖4 SIRI-WHU數據集部分示例

兩種數據集均通過數據增強的方式將每張圖片進行隨機縮放、反轉等操作,將每張圖片擴充為10張,擴充后數據集1有21 000幅圖像,數據集2有24 000幅圖像,并將所有圖像統一為224×224尺寸。實驗中,將每類場景隨機選取80%的遙感影像作為訓練樣本,剩余的遙感影像作為測試樣本。

本文的實驗環境為:Windows 10操作系統,Tensorflow框架,CPU:intel-7700K、16 G內存和NVDIA圖像處理單元GTX 1060。初始學習率為0.01,batch size為64,采用的優化器為Adam算法,訓練的次數為50(epoch)。

3.2 實驗結果分析

3.2.1 UCM_LandUse數據集結果分析

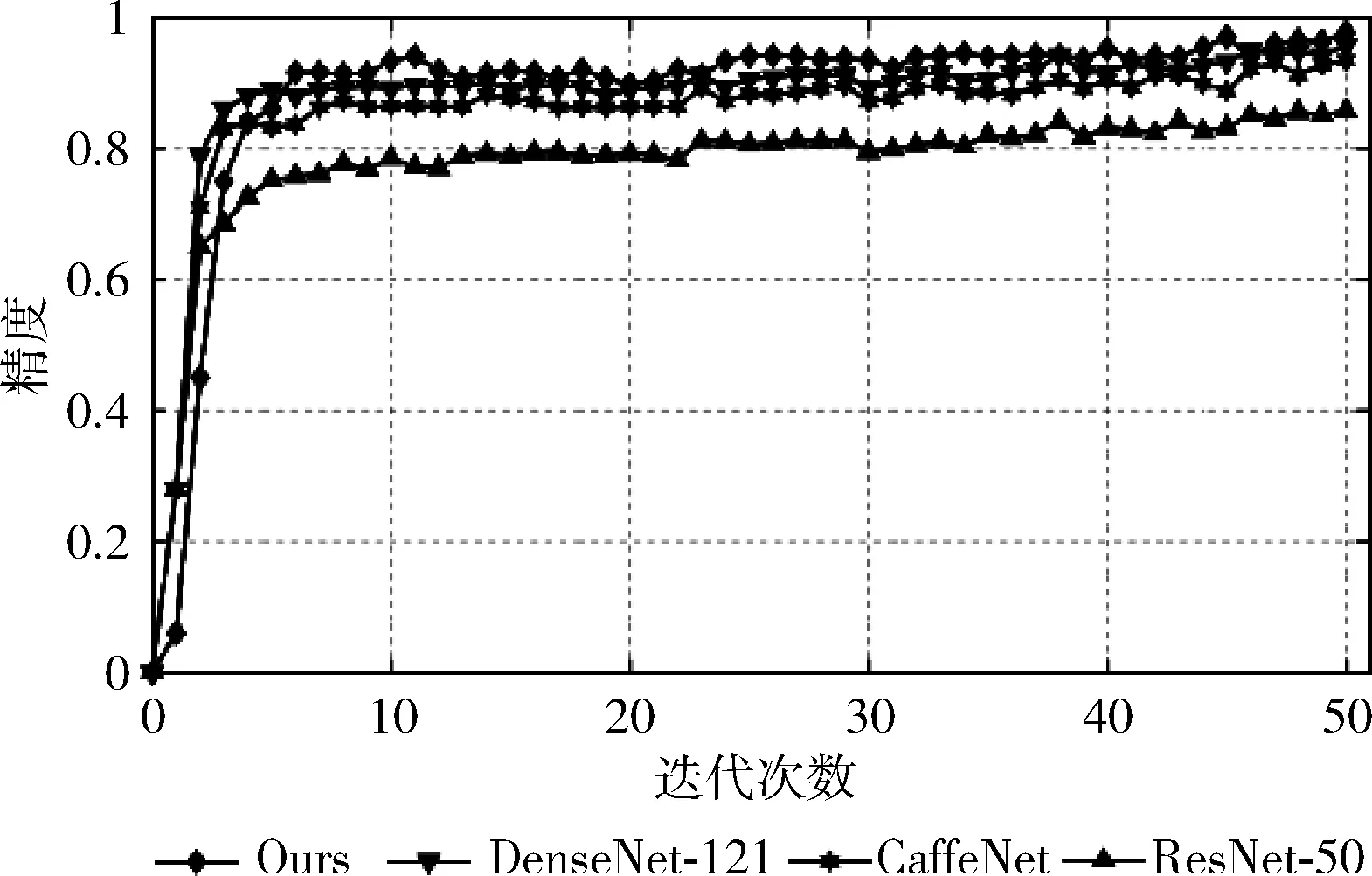

為了評估本文模型的性能,在相同實驗環境下,將本文方法與CaffeNet[19]、ResNet-50、DenseNet-121進行遙感影像場景分類實驗,實驗結果如圖5所示。

圖5 本文方法與其它模型準確率對比

由圖5可以看出,在EPOCH10之前,DenseNet-121的準確率增長速度要快于其它模型,由于本文模型嵌入了SE block使得在一定程度上,增加了基準模型的復雜度。而隨著迭代次數的增加,分類的準確率逐漸處于穩定的狀態,最后本文方法的準確率要高于另外3種模型,準確率為97.7%,高于DenseNet-121的準確率2%,高于CaffeNet的準確率4.28%,高于ResNet-50的準確率11.99%。實驗結果表明,通過嵌入SE block和引入多尺度SE block,可以有效提高模型的性能。21類分類結果如圖6所示。

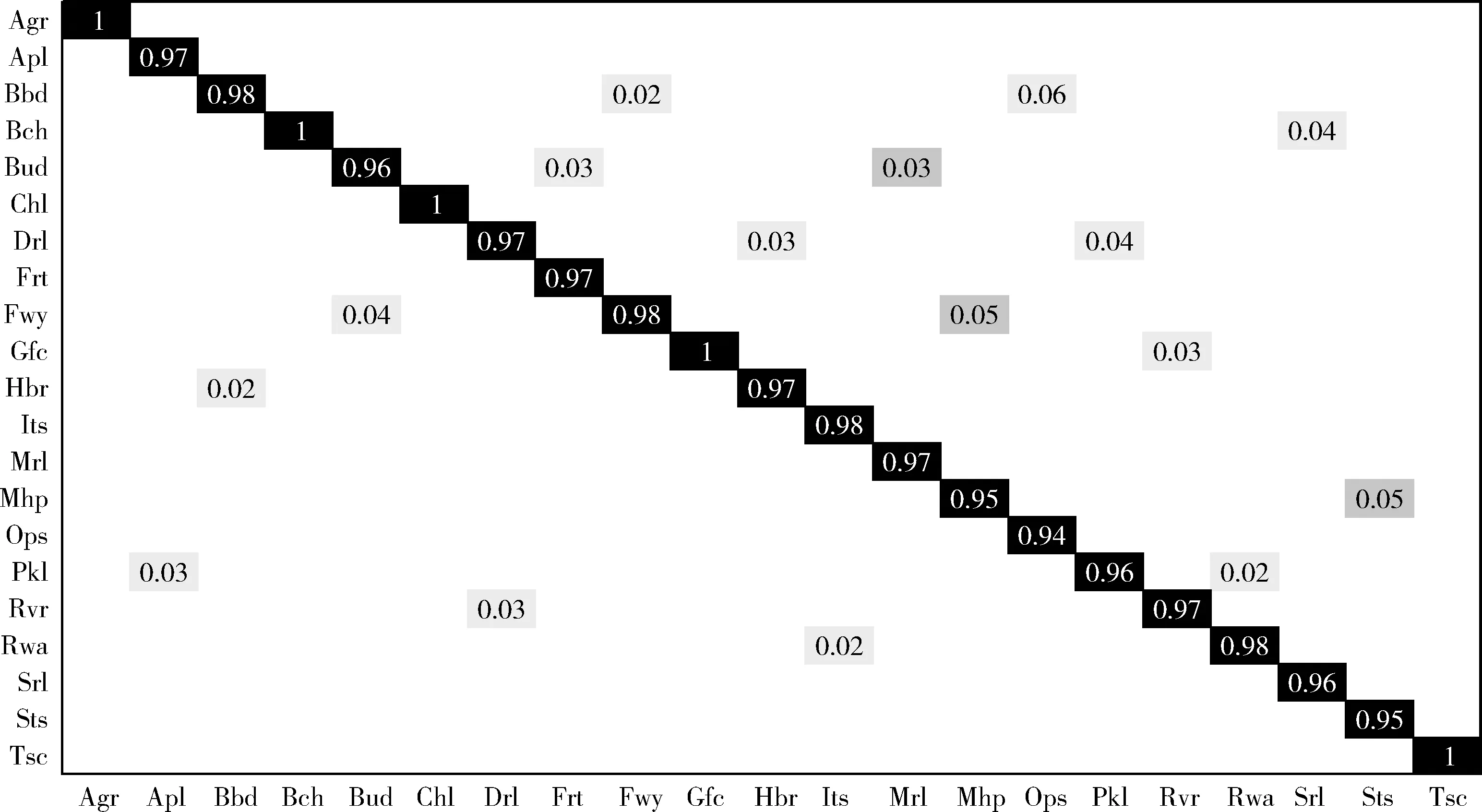

圖6 UCM_LandUse數據集的分類混淆矩陣

由圖6可以看出,21類的分類準確率均保持在90%以上,其中紋理差異性較小的遙感影像場景分類準確率較高,如農田、沙灘等5種類型的場景準確率為100%。為進一步評估本文方法的有效性,結合目前針對UCMerced_LandUse數據集的現有方法進行對比,各方法分類精度見表2。

由表2可知,相比于傳統的低中層提取特征方法(SVM-LDA等),基于卷積神經網絡的方法分類精度更高(CaffeNet等)。其原因在于卷積神經網絡可以通過訓練學習到遙感影像場景高層次特征,對于場景影像中的細微特征具有更高的區分性。而本文提出的結合SE block和DenseNet的模型能有效提升卷積神經網絡對于遙感影像場景的識別能力,分類效果要優于其它方法。

3.2.2 SIRI-WHU數據集結果分析

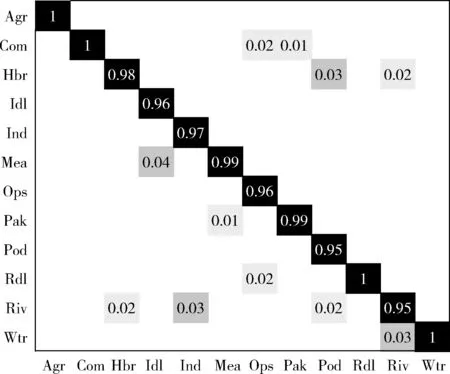

為了驗證本文模型的泛化能力,在SIRI-WHU數據集進行實驗,12類分類結果如圖7所示。

圖7 SIRI-WHU數據集的分類混淆矩陣

有圖7可以看出,本文方法對SIRI-WHU數據集的12個分類精度均高于95%。其中農田、商業區等分類精度能達到100%,表明本文方法對于特征復雜度小的場景具有較好的分類性能。同時,實驗結果表明,池塘以及河流場景中分類精度下降為95%,其中池塘的部分場景被分為海港和河流,河流的部分場景被分為海港和水,說明本文方法對于極易相似的場景分類能力仍需要進一步提升,但總體上能進行空間信息豐富的不同場景區分。將本文方法與現有方法進行對比,對比結果見表3。

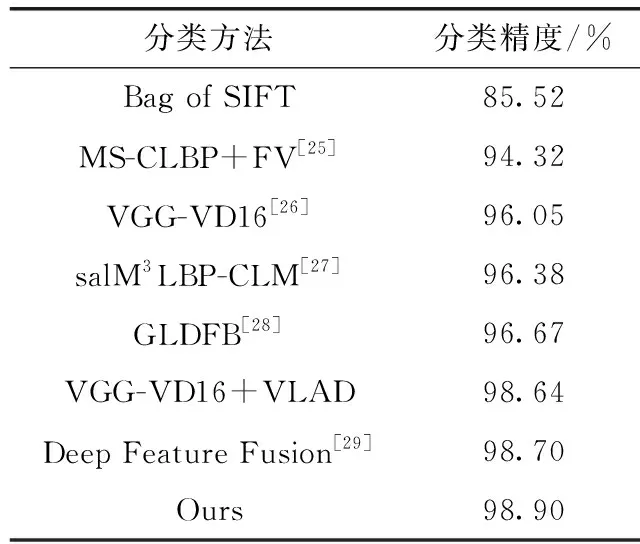

表3 SIRI-WHU數據集分類結果對比

表3對比了在SIRI-WHU數據集中,本文方法與其它幾種方法的分類準確率。通過Bag of SIFT僅可獲得85.52%的準確率,本文將分類SIRI-WHU數據集的準確率提升至98.9%,相比于采用VGG模型的卷積神經網絡方法,高于其準確率2.85%和0.26%。進一步驗證了本文方法可以有效提取出遙感場景影像特征并抑制干擾特征,得到表達能力更強的深度影像場景特征。

4 結束語

針對遙感影像場景包含空間信息復雜等問題,提出一種特征重校準融合DenseNet-121的場景影像分類方法。該方法通過將SE block嵌入DenseNet-121中,并引入多尺度SE block分支來獲取并提高特征重校準能力,用以學習場景影像特征通道之間的相關性,能夠充分提取出遙感場景影像特征并抑制干擾特征。在兩個公開數據集UCMerced_LandUseSIRI-WHU的實驗結果表明,本文方法可以有效提高遙感影像場景的分類精度并具有較好的泛化能力。在未來的工作中,將研究多種模型結構的融合,用以獲取影像場景中區分度更高以及表達能力更強的深層特征。