基于BERT的常見作物病害問答系統問句分類

楊國峰,楊 勇*

(1.中國農業科學院農業信息研究所,北京 100081;2.農業農村部農業大數據重點實驗室,北京 100081)

(?通信作者電子郵箱wheatblue@163.com)

0 引言

農業科技是現在和未來中國農業增長的第一驅動力,農業技術推廣是實現科技進步及農業和農村現代化的重要措施[1]。中國擁有國際上最大的農業技術推廣人員隊伍,然而研究[2]表明,中國農業技術推廣體系未能為農民提供有效的技術服務。當前,一大批農業技術服務平臺都在不斷地用人工的方式解決農業生產者在作物種植過程中所遇到的病害問題,而依賴人工解決問題將消耗大量的人力、物力,并且很難及時地解決農業生產者的問題。隨著人工智能技術的迅猛發展,構建專業領域的智能問答系統將能夠為人們提供準確的診斷結果和個性化的信息服務[3]。因此,構建并應用作物病害智能問答系統將為解決以上問題提供解決方案,同時為中國作物病害識別的智能化研究與應用提供重要支撐。問答系統主要包括問題分析(問句分類)、信息檢索和答案抽取三個部分,其中問句分類作為問答系統的關鍵模塊,也是制約問答系統檢索效率的關鍵性因素[4]。

關于問答系統中問句分類的研究,從傳統的支持向量機、集成學習等[5]到基于詞嵌入[6-8],再到神經網絡[9-11]分類算法,均在文本分類任務的各項性能評價指標上獲得了極大提升,而預訓練的神經網絡語言模型ELMo(Embeddings from Language Models)、OpenAI GPT(Generative Pre-trained Transformer)、BERT(Bidirectional Encoder Representations from Transformers)取得了顯著進展[12]。由于農業領域一直缺乏大規模可用的語料數據庫,因此關于農業問答系統問句分類的研究還較少。針對特定農業領域,少數研究者開展了語言模型在農業問答系統應用的相關研究,但仍處于起步階段。段青玲等[13]重點研究了基于支持向量機的文本分類,實現了92.5%的資訊分類準確率。為了對飲食文本信息進行二分類,趙明等[14]建立了一種基于word2vec 和長短期記憶(Long Short-Term Memory,LSTM)網絡的分類模型,其分類準確率為98.08%。趙明等[15]還構建了基于word2vec 和雙向門控循環單元(Bi-Directional Gated Recurrent Unit,BIGRU)神經網絡的番茄病蟲害問句分類模型,對2 000條番茄病蟲害用戶問句進行病害和蟲害的二分類,結果表明,基于BIGRU 的問句分類模型優于卷積神經網絡和K最近鄰等分類算法。針對傳統的句子相似度算法準確率較低的問題,梁敬東等[16]通過構建基于word2vec 和LSTM 的神經網絡計算問句相似度,并在水稻常問問題集中的問句上進行驗證,測試集準確率為93.1%。為解決互聯網農技推廣社區問答數據增長過快的問題,張明岳等[17]構建了一種基于卷積神經網絡的農業問答情感極性特征抽取分析模型,針對測試集的語性特征抽取準確率僅為82.7%。

上述研究為神經網絡應用于常見作物病害問答系統問句分類提供了參考和依據,但是以上研究主要存在以下兩個方面的問題:1)基于word2vec 等詞嵌入的文本編碼方式的文本表征模型還存在局限,無法準確編碼同一詞在不同語境下的詞義;2)盡管構建的LSTM、GRU 等神經網絡語言模型以及在其基礎上改進的雙向長短期記憶(Bidirectional-Long Short Term Memory,Bi-LSTM)網絡、Transformer 等模型能夠利用語境信息進行訓練,但是相對于自然語言處理任務使用的大型語料,以上研究用來學習的監督數據相對較少,難以學到復雜的語境表示。當前,關于基于語境化的詞嵌入[18]利用海量的無監督數據學習神經網絡語言模型,即神經網絡語言模型的預訓練,如ELMo、OpenAI GPT、BERT 等模型相繼出現,其中BERT 以及基于BERT 的改進預訓練語言模型在多種自然語言任務上取得了最佳結果。

針對常見作物病害問答系統的特點與上述問題,本文研究構建基于word2vec 的雙向長短期記憶自注意力(Bi-LSTM Self-Attention,Bi-LSTM Self-Attention)網絡分類模型、Transformer 分類模型和基于BERT 的微調分類模型,分別進行常見作物病害問句分類實驗,選取能夠高效地對常見作物病害問句進行準確分類的問句分類模型作為問答系統最終采用模型。

1 材料與方法

1.1 實驗數據與預處理

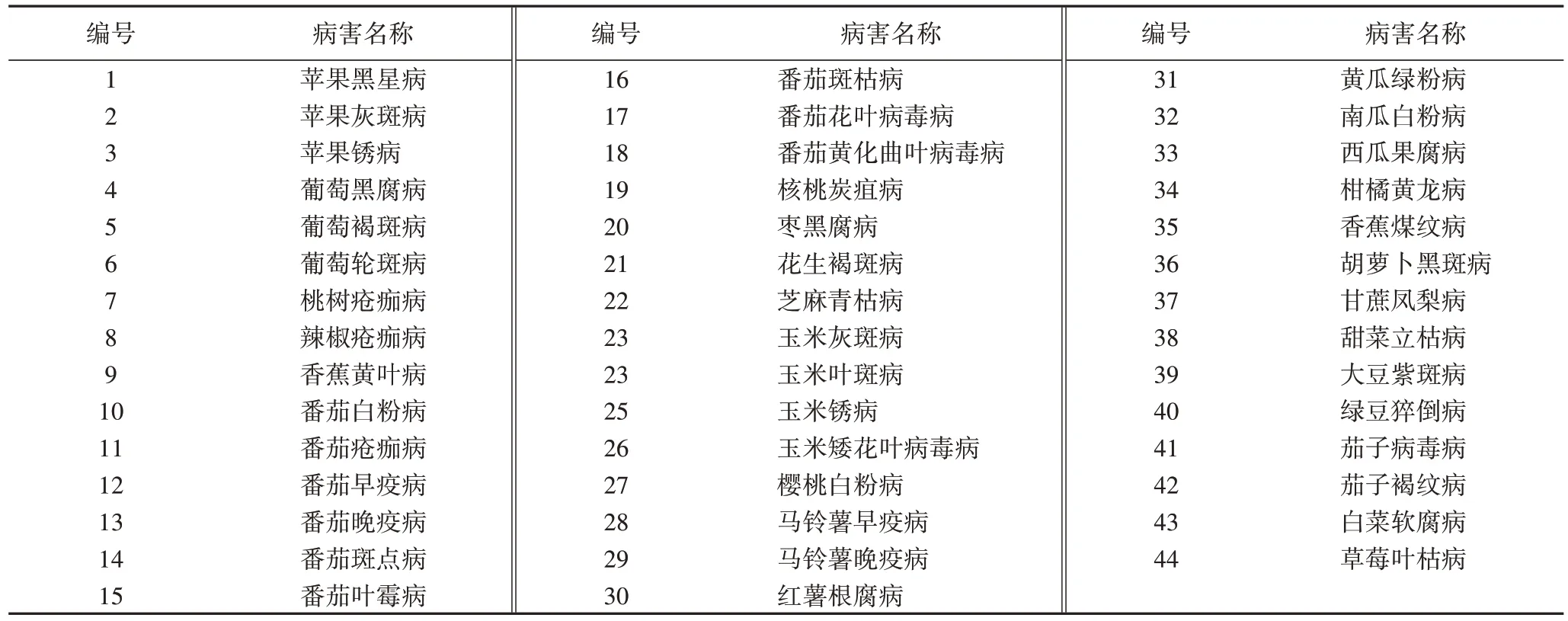

本研究使用Scrapy 爬蟲框架,在多個百科類與農業類網站爬取44種常見作物病害相關的農業生產用戶的問句,44種常見作物病害如表1所示。

表1 四十四種常見作物病害Tab.1 Forty-four common crop diseases

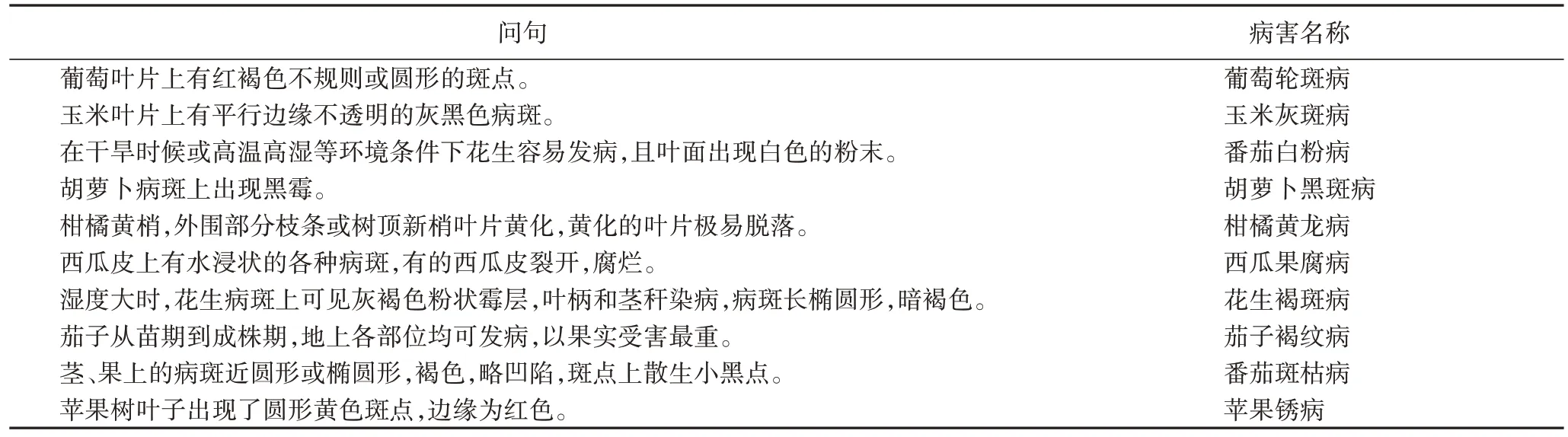

參考文獻[19]中對作物病害的描述信息,對收集的語料進行預處理(去除重復數據,問句轉換為陳述句等),從而構建常見作物病害問句數據集(Common Crop Disease Question Dataset,CCDQD)。預處理后部分樣本如表2所示。

表2 部分預處理作物病害問句樣本Tab.2 Some preprocessed samples of crop disease question

1.2 雙向長短期記憶自注意力網絡分類模型

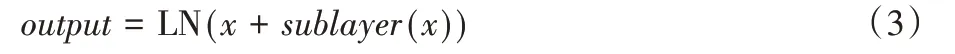

本文使用自注意力技術來生成句子詞嵌入分類模型[20],由Bi-LSTM 和一層全連接Softmax 層構成,如圖1 所示。在Bi-LSTM 的基礎上,模型將通過自注意力機制得到句子的表示輸出到隱藏層,然后通過全連接層進行分類。

如圖1所示,向模型輸入一個含有n個詞的句子進行詞嵌入,得到S=(w1,w2,…,wn),wi表示序列中第i個標記(Token)對應的詞嵌入。h1,h2,…,hn為隱藏層的對應輸出,Bi-LSTM將句子嵌入為M,(m1,m2,…,mr)表示聚焦句子不同的部分,其中注意力權重為Ai1,Ai2,…,Ain。

圖1 雙向長短期記憶自注意力網絡分類模型Fig.1 Bi-LSTM self-attention network classification model

給定訓練集{(S(i),yi)|i=1,2,…,N},其中類別標簽y(i)∈{1,2,…,K}(K為可能的類別數目)。為了削弱末級分類器的復雜度,強迫模型學習到更有效的表示,有助于下游問句分類任務,把從文本S(i)生成的矩陣級別表示M(i)輸入Softmax層便得到離散類別標簽的預測概率分布為:

其中:WS為M(i)相應的權重;bS是偏差。

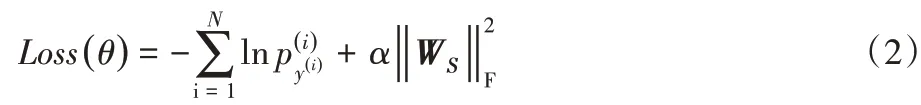

本文將Cross Entropy Loss 損失函數加上Softmax 層權值矩陣的Frobenius范數約束作為訓練整個網絡的損失函數:

其中:θ表示網絡中所有參數為p(i)的第y(i)個分量;α 是懲罰系數,用來調節懲罰項的比重,下標F 表示Frobenius范數。

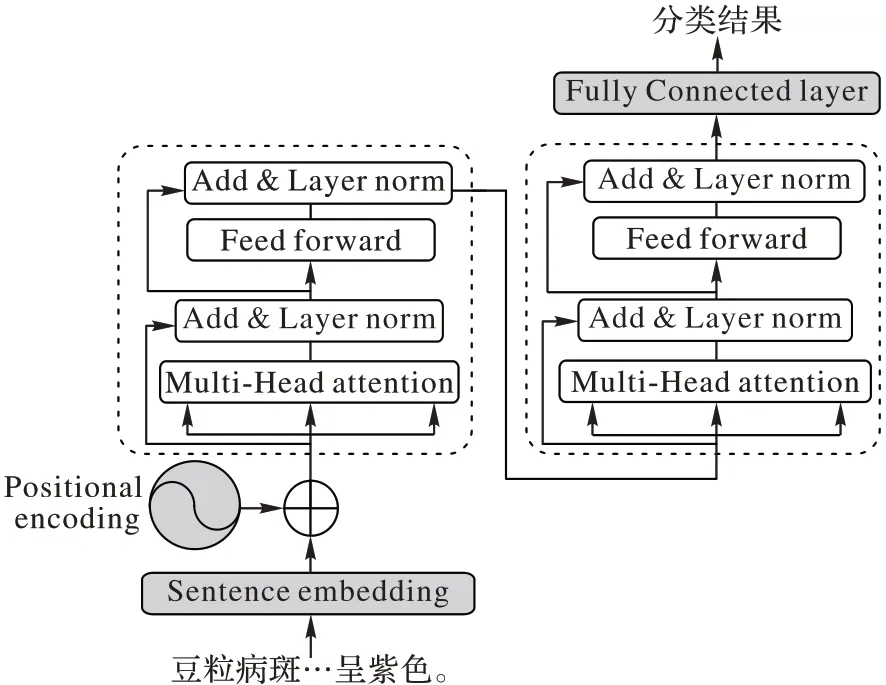

1.3 Transformer分類模型

本文構建的Transformer 分類模型基于編碼器(Encoder)結構[21],由于Transformer模型訓練參數較多且模型較為復雜,因此僅使用了兩個編碼器,每個編碼器包含一個多頭注意力子層和一個前饋網絡子層。模型中的所有子層以及嵌入層的輸出尺寸為200。圖2為兩個編碼器的Transformer分類模型。

句子的詞嵌入(Sentence Embedding)與對應位置詞嵌入(Position Embedding)相加后作為輸入,編碼器第一個子層是多頭自注意力(Multi-head Attention),輸出表示為sublayer(x),經過殘差連接和層規范(Add&Layer Norm,LN)輸出為:

編碼器第二個子層是逐項前饋網絡(Feed Forward Network,FFN),由兩個線性變換組成,其中每一層的參數都不同,輸入和輸出的維度為200,內部層的維度為2 400。

其中,W1、W2和b1、b2分別為output相應線性變換的權重和偏差。

圖2 Transformer分類模型Fig.2 Transformer classification model

線性變換之后再經過殘差連接和層規范,將最后一個編碼器第二子層的最終輸出傳遞進全連接層并輸出分類結果。訓練過程使用Cross Entropy Loss損失函數。

1.4 基于BERT的微調分類模型

借助語言模型來輔助自然語言處理任務已經得到了學術界較為廣泛的探討[22],通常有兩種方式:1)基于特征,指利用語言模型的中間結果(語言模型詞嵌入),將其作為額外的特征,引入到原任務的模型中,如ELMo 模型[23];2)基于微調,指利用大量語料訓練語言模型,并在語言模型基礎上增加少量神經網絡層來完成具體任務,采用有標記的語料來有監督地訓練新模型,這個過程中語言模型的參數并不固定,如OpenAI GPT[24]。上述模型的輸入為從左向右輸入一個文本序列,或將從左向右輸入和從右向左輸入的訓練結合起來。然而,BERT 是一種新的預訓練語言模型,即雙向編碼表征Transformer 的模型。相關研究[12]表明:雙向訓練的語言模型對語境的理解會比單向的語言模型更深刻,提取語料特征更高效。

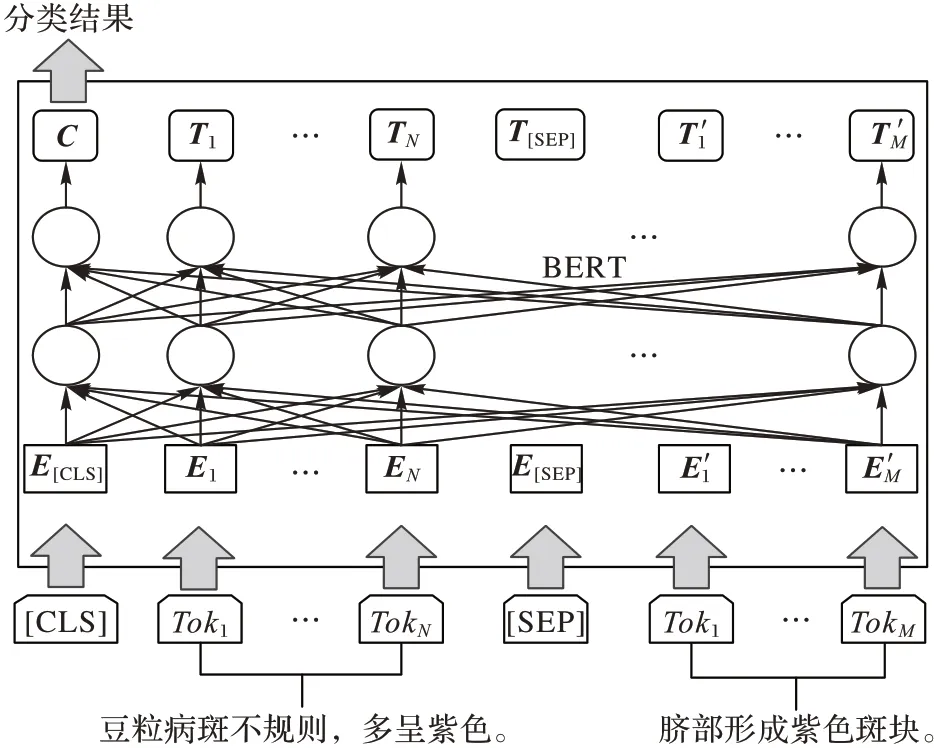

由于BERT 可以用于各種自然語言處理的任務(如分類任務、問答任務),且僅需在核心模型的基礎上進行簡單修改,因此本文將構建基于BERT的微調分類模型,如圖3所示。

圖3 基于BERT的微調分類模型Fig.3 BERT-based fine-tuning classification model

對于問答系統的問句分類任務,基于BERT 的微調分類模型在預訓練BERT 模型的輸出結果后增加一個分類層(全連接層)進行微調。

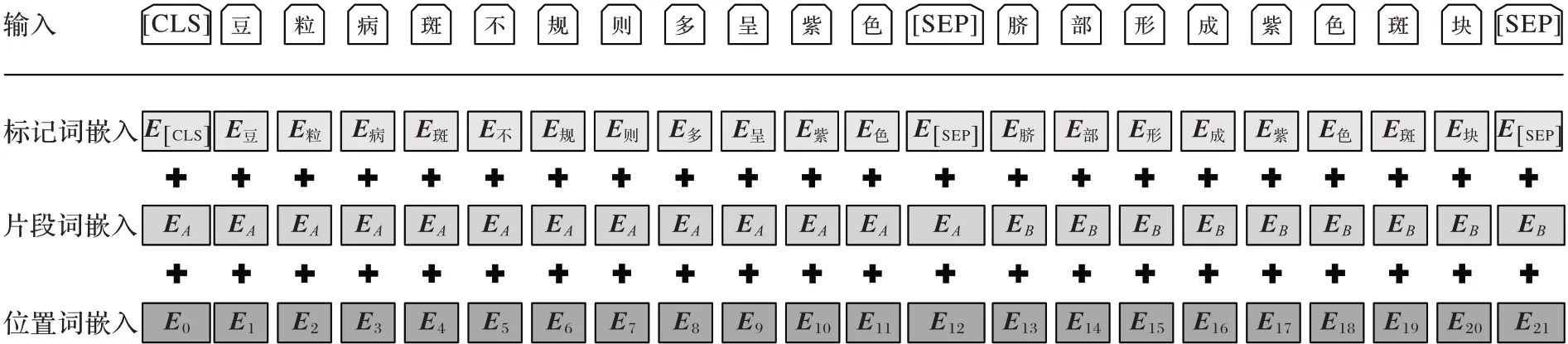

把作物病害問句輸入模型后,將被傳遞到詞嵌入層,包括進行標記詞嵌入、句子詞嵌入和位置詞嵌入。在圖3 和圖4中:Toki表示第i個Token,隨機遮擋部分字符;Ei表示第i個Token的嵌入向量;Ti表示第i個Token在經過BERT處理之后得到的特征向量。

BERT 和可學習的權值矩陣(W)所有參數都經過微調,以最大化正確分類的概率。BERT 根據[CLS]標志生成一組特征向量C,并將其與W相乘,再經過Softmax 預測各個類別的概率,其中概率最大的類別為最后輸出的分類類別。

利用預訓練語言模型的參數權重對模型初始化,使用Cross Entropy Loss 損失函數對基于BERT 的微調分類模型進行有監督的訓練。

圖4 BERT的輸入表示Fig.4 Input representation of BERT

2 問句分類實驗

2.1 實驗設計

本研究收集44 種常見作物病害的問句,為防止數據集類別不平衡的影響,使每種作物病害樣本數相近(60~80 條),同時將每條病害問句標注為對應所屬類別,共得到有3 300條樣本。利用常用的優化學習Adam 梯度下降算法[25]訓練優化雙向長短期記憶自注意力網絡分類模型、Transformer 分類模型和基于BERT 的微調分類模型,再根據損失函數動態調整每個參數的學習率。

將超參數初始化并調優,最終設置如下:訓練批量(batch)大小為16,問句詞嵌入長度為200,多注意力頭數(multi-head)為12,初始學習率為0.001,最小學習率為0.000 01,迭代次數(epochs)為100。為減輕三種模型在訓練過程中過度參數化、過擬合,以及避免偶然出現的不良局部最小值現象,設置Dropout 參數[26]為0.1。同時,為得到可靠穩定的模型,采用十折交叉驗證(10-fold cross-validation)的方法[27]進行訓練。

本文研究采用準確率、精確率和召回率以及綜合指標F1值作為問句分類模型的測評指標[28]。其中:準確率是指分類正確的問句數除以整個數據集的問句總數;精確率是指分類器正確判斷為該類的問句數與分類器判斷屬于該類的問句總數之比;召回率是指分類器正確判斷為該類的問句數與屬于該類的問句總數之比。F1值是精確率和召回率的調和平均值,最大值為1,最小值為0:

其中:P為精確率;R為召回率。

2.2 分類實驗結果及分析

對構建的雙向長短期記憶自注意力(Bi-LSTM Self-Attention)網絡分類模型、Transformer 分類模型和基于BERT的微調分類模型分別使用預處理后的同一數據集進行分類實驗。

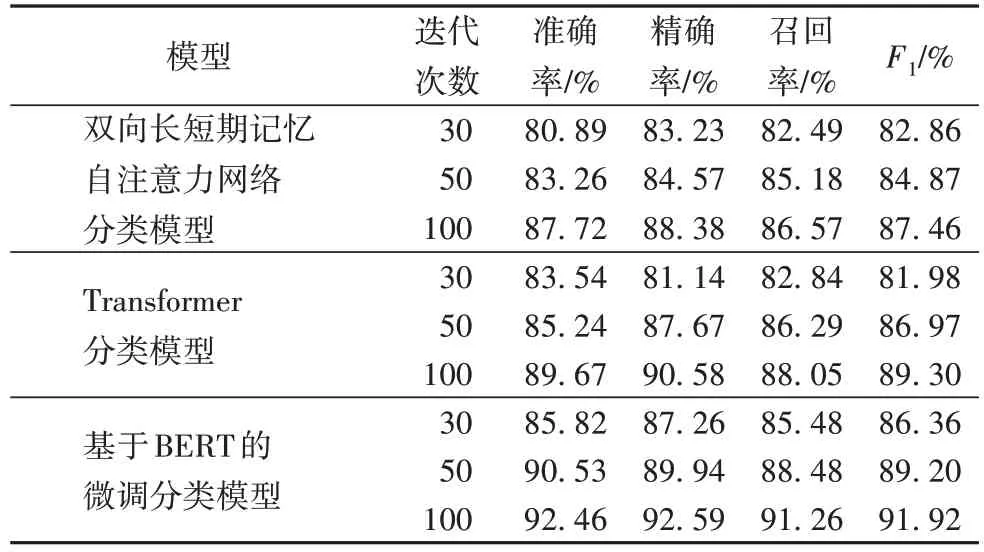

由表3 可知,對于不同的迭代次數,基于BERT 的微調分類模型與另外兩個模型相比,其準確率、精確率和召回率均高幾個百分點。當三個模型同時訓練100 迭代次數時,對于F1值指標,基于BERT 的微調分類模型F1值為91.92%,比Transformer 分類模型高2.62 個百分點,比利用雙向長短期記憶自注意力網絡分類模型高4.46個百分點,表明:基于BERT的微調分類模型的問句分類效果最優,Transformer 分類模型居中,雙向長短期記憶自注意力網絡分類模型結果稍差。

本實驗也證實了雙向長短期記憶自注意力網絡分類模型提取問句語言特征的能力弱于Transformer,盡管雙向長短期記憶自注意力網絡分類模型增加了自注意力機制,但是Transformer 分類模型的準確率、精確率和召回率以及F1值均超過了雙向長短期記憶自注意力網絡分類模型。相較于雙向長短期記憶自注意力網絡分類模型和Transformer 分類模型,雖然基于BERT 的微調分類模型與Transformer 分類模型的網絡結構有相似的結構,但基于BERT 的微調分類模型在預訓練階段通過無監督的方法學習具有上下文語義的詞嵌入特征,能更好地表達語義,在微調階段再用監督的方法訓練BERT 模型和全連接層的參數。基于BERT 的微調模型的優勢在于充分利用了具有上下文語義的信息,可基于少量監督學習樣本,針對不同下游任務改造模型實現目標。實驗結果表明,基于BERT 的微調分類模型具有結構簡單、訓練參數少、訓練速度快等特點,同時能夠高效地對常見作物病害問句準確分類,可以作為問答系統問句分類模型。

表3 問句分類模型的分類結果Tab.3 Classification results of question classification models

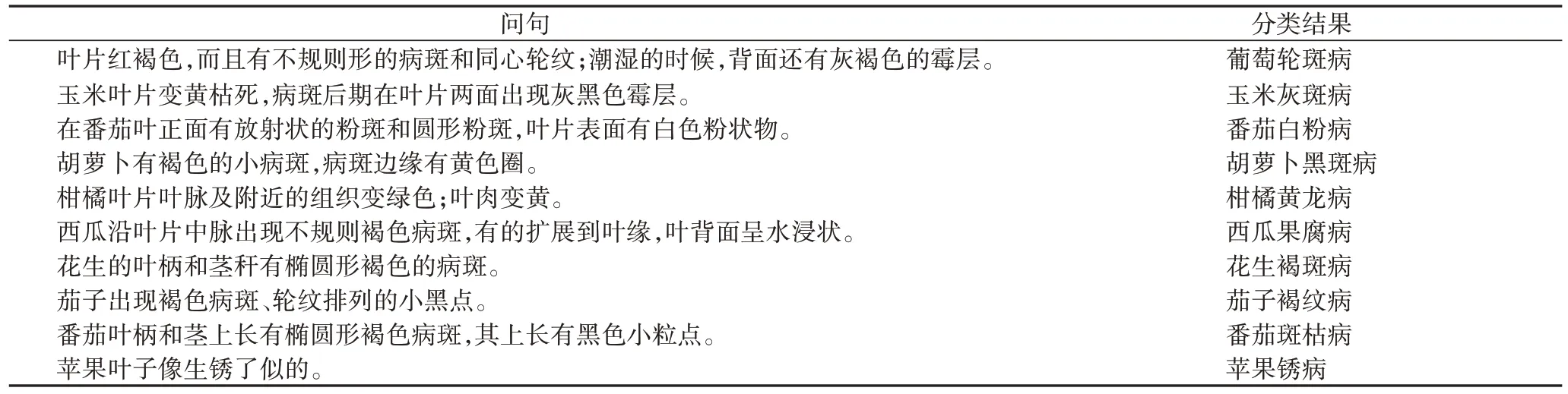

使用基于BERT 的微調分類模型進行作物病害問句分類,正確分類的部分實例與對應的分類結果如表4所示。

表4 問句分類結果的部分實例Tab.4 Some examples of question classification results

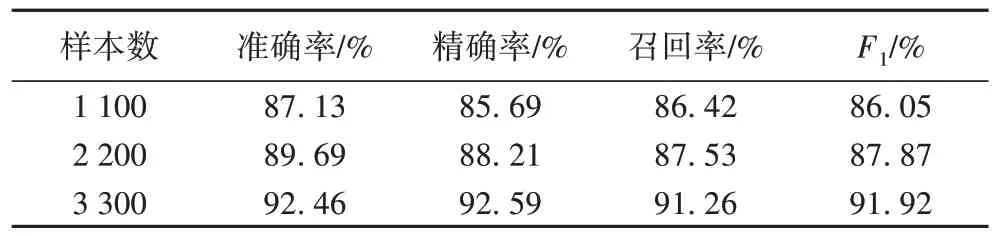

基于上述實驗,選擇作物病害問答系統問句分類效果最優的基于BERT 的微調分類模型,對影響問句分類效果的樣本數量(訓練數據集規模)進行研究。在保持模型結構和初始超參數不變的情況下,改變數據集規模(1 100、2 200、3 300)進行實驗,迭代次數均設置為100次,測試結果如表5所示。

表5 不同樣本數量的模型分類結果Tab.5 Model classification results under different sample sizes

由表5可得,訓練數據集的規模對基于BERT的微調分類模型的分類效果有較大影響。鑒于真實場景下作物病害識別分類對準確率有較高的需求,因此在對基于BERT 的微調分類模型進行訓練時,大量高質量的訓練數據集可以提高整個作物病害問答系統類別分類的準確率。

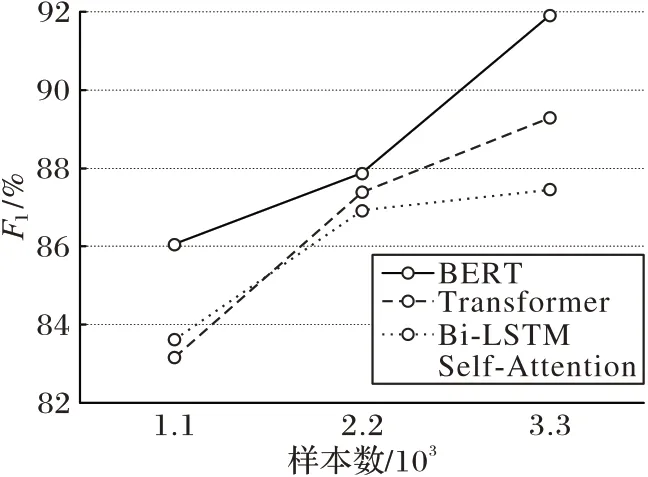

探究基于BERT 的微調分類模型作為作物病害問答系統問句模型的有效性,并進行相關實驗。在不同樣本數量的數據集下,三種模型的有效性(F1值)如圖5所示。

由圖5可知:BERT模型的F1值在不同數量的數據集上均保持最高;而當數據集較小時,雙向長短期記憶自注意力網絡分類模型F1值比Transformer分類模型的F1值高;隨著數據集的增大,Transformer 分類模型的F1值反超雙向長短期記憶自注意力網絡分類模型F1值。BERT 模型的預訓練是一個耗時的過程,通過使用預訓練好的模型進行分類任務微調仍然能夠實現很好的分類效果,驗證了基于BERT 的微調分類模型作為作物病害問答系統問句模型的有效性。

圖5 不同模型的有效性結果對比Fig.5 Validity comparison of different models

3 結語

本文針對農業問答系統用戶問句語義信息復雜、差異大的問題,構建了基于BERT 用于問句分類任務的作物病害問答系統的問句分類模型,證實了兩階段模型(超大規模預訓練與具體任務微調)較強的表征學習能力對問句分類的影響。通過與雙向長短期記憶自注意力網絡分類模型和Transformer分類模型進行對比,由實驗結果可知,基于BERT 的微調分類模型的準確率、精確率和召回率以及F1值均高于另外兩種問句分類模型2~5 個百分點,表明基于BERT 的微調常見作物病害問句分類模型可以高效地提取問句文字的特征,用于后續的分類實驗。對三種模型使用不同數量的數據集進行實驗,結果表明,隨著數據集規模的增加,基于BERT 的微調分類模型與另外兩種模型相比F1值明顯上升,表明了問句分類模型的選擇和訓練數據集的規模對常見作物病害問答系統問句分類效果具有較大影響。接下來將進一步擴大作物病害問句類別的覆蓋范圍,滿足更多用戶對作物病害類別識別的需求。