融合閾值尋優(yōu)的卷積神經(jīng)網(wǎng)絡在圖像標注中的應用

曹建芳,趙愛迪,張自邦

(1.太原科技大學計算機科學與技術學院,太原 030024;2.忻州師范學院計算機系,山西忻州 034000)

(?通信作者電子郵箱kcxdj122@126.com)

0 引言

隨著網(wǎng)絡技術的發(fā)展以及多媒體設備的日益普及,網(wǎng)絡上的圖像數(shù)據(jù)正以指數(shù)級增長。面對大量的無標簽圖像的產(chǎn)生,如何檢索、管理和組織這些圖像成為一個亟待解決的問題[1]。很多專家學者提出了對圖像進行添加標簽,即圖像標注,進而可以合理有效地管理這些圖像數(shù)據(jù)。

目前圖像自動標注的方法有兩類:一是基于傳統(tǒng)機器學習的方法,如:吳偉等[2]提出的基于改進的支持向量機(Support Vector Machine,SVM)的方法,通過建立多個分類器,形成以距離大小為判別依據(jù)的支持向量機多分類模型,此外還為每個分類器引入了權重系數(shù)。臧淼等[3]提出的基于距離約束稀疏/組稀疏編碼的兩種特征選擇算法,利用學習到的特征權值尋找K最近鄰圖像實現(xiàn)圖像標注。楊曉玲等[4]提出的基于多標簽判別字典學習的圖像自動標注,在字典學習中加入多標簽學習,將兩者融合在一起進行圖像的多標簽標注。張華忠等[5]對決策樹C4.5 進行改進,提出了修正矩陣(Correction Matrix-C4.5,CMC4.5),并將其應用在圖像標注領域。二是基于深度學習[6-7]的方法,如:Hinton[8]提出了利用深度神經(jīng)網(wǎng)絡,從訓練集中有效地訓練特征。柯逍等[9]提出了融合深度特征和語義鄰域的自動圖像標注,利用卷積神經(jīng)網(wǎng)絡(Convolutional Neural Network,CNN)提取特征,構建視覺和語義均相近的近鄰圖像集,通過計算距離給標簽排序進而進行標注。周銘柯等[10]針對圖像標注數(shù)據(jù)不平衡的問題,提出了基于數(shù)據(jù)均衡的增進式深度自動圖像標注,利用堆疊自編碼器(Stacked Auto-Encoder,SAE)的自動圖像標注算法,加強訓練中低頻標簽的編碼器,同時加強了該模型的魯棒性,提升了模型的穩(wěn)定性。張蕾等[11]提出了一種融合卷積神經(jīng)網(wǎng)絡與主題模型的圖像標注,首先改進了卷積神經(jīng)網(wǎng)絡的損失函數(shù),其次利用狄利克雷模型對訓練集的標簽數(shù)據(jù)進行建模,通過圖像的高層視覺特征和圖像的標簽數(shù)據(jù)的對應關系構建多分類器。黃冬梅等[12]提出了一種融合多特征的深度學習圖像自動標注方法,賦予每個圖像視覺特征不同的權重并將它們組合成詞包,根據(jù)輸入輸出變量優(yōu)化深度信念網(wǎng)絡。黎健成等[1]提出了基于卷積神經(jīng)網(wǎng)絡的多標簽圖像自動標注,利用了多標簽損失排名函數(shù),完成了多標簽數(shù)據(jù)的訓練與測試。

傳統(tǒng)的方法在取得一些進展的同時也存在著一些問題:在圖像特征提取的過程中,人工提取圖像特征就會不可避免地出現(xiàn)人為主觀錯誤,導致圖像信息提取錯誤,實驗精確度差。而深度神經(jīng)網(wǎng)絡模型在圖像標簽領域取得了一定的成績,但是也存在一些不足[13]:首先,深度神經(jīng)網(wǎng)絡是包含多層非線性操作的模型,它具有很強大的表示能力,可以學習很多復雜結構,越復雜的結構越容易導致過擬合[13]。其次,上述深度學習標注模型都是對模型本身進行改進,這些模型在標注過程中只給出預測概率,通過排名確定標注標簽,在不知道該圖片標簽數(shù)量的情況下就會出現(xiàn)多標或少標的問題。因此,需要充分考慮每類標簽的概率情況,為每一類標簽尋找到一個最佳閾值,從而提升標注的準確率。

為了解決上述問題,首先提出在激活層之前添加批標準化層(Batch Normalization,BN),不僅在一定程度上可以防止過擬合,還極大地提升了訓練速度,收斂過程也大大加快。其次,提出融合閾值尋優(yōu)的卷積神經(jīng)網(wǎng)絡的方法。通過搭建一個卷積神經(jīng)網(wǎng)絡學習圖像特征,利用反向傳播算法訓練模型得到模型參數(shù)[13];模型再對測試集進行預測得到概率矩陣,通過對概率矩陣進行閾值尋優(yōu),為每類標簽找到一個最佳閾值。

1 卷積神經(jīng)網(wǎng)絡

卷積神經(jīng)網(wǎng)絡(CNN)[14]是一種前饋神經(jīng)網(wǎng)絡,其本質(zhì)是一個多層感知機。20 世紀60 年代,Hubel 等[15]通過對貓腦皮層中用于局部敏感和方向選擇的神經(jīng)元的研究而提出了感受野這個概念。1980 年,日本科學家Fukushima[16]提出了一個包含卷積層和池化層的神經(jīng)網(wǎng)絡。在現(xiàn)有研究的基礎上,1998 年LeCun 等[17]提出了LeNet-5,將反向傳播(Back Propagation,BP)算法應用在了神經(jīng)網(wǎng)絡的訓練上,初步形成了當代卷積神經(jīng)網(wǎng)絡。而卷積神經(jīng)網(wǎng)絡得到較大的發(fā)展是在Krizhevsky等[14]提出的AlexNet在ImageNet圖像識別大賽中將錯誤率從25%降低到了15%。從此,卷積神經(jīng)網(wǎng)絡得到了學者的廣泛關注,結構越來越復雜,表達能力越來越強。CNN采用的局部連接和權值共享的方式:一方面丟棄了部分神經(jīng)元,減少了過擬合的風險;另一方面不同神經(jīng)元之間的參數(shù)共享減少了權值的數(shù)量,使得網(wǎng)絡更加易于優(yōu)化。卷積神經(jīng)網(wǎng)絡的主要結構包括輸入層、卷積層、池化層、全連接層以及最后的輸出層,通過疊加卷積層和池化層來加深網(wǎng)絡層數(shù)。卷積神經(jīng)網(wǎng)絡通過卷積層的卷積運算自動提取圖像的特征,減小了傳統(tǒng)方法中人工提取特征導致信息丟失的錯誤率,在計算機視覺領域取得了很大的成功。基于卷積神經(jīng)網(wǎng)絡的優(yōu)點,本文提出融合閾值尋優(yōu)的卷積神經(jīng)網(wǎng)絡模型。卷積層是卷積神經(jīng)網(wǎng)絡的核心部分,是對卷積神經(jīng)網(wǎng)絡中上一層的輸出進行特征提取,該過程會使用多個卷積核進行卷積運算,最終得到多個特征圖(feature map)。卷積運算公式[18]如式(1):

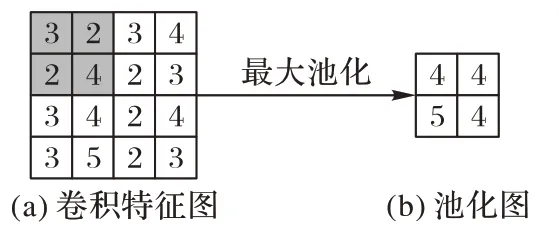

其中:表示為第i層第j個卷積核輸出的特征圖;Mj表示為第i-1 層的所有特征圖;表示為第i層的一個卷積核;表示為第i層中的特征對應的偏置;f()表示函數(shù)運算;“*”表示卷積操作。為了盡可能多地獲得特征,在卷積的過程中會使用多個卷積核,該過程不可避免地會導致信息冗余。為了降低特征維度,在卷積之后會采取池化操作,目前常用的池化操作有最大值池化、平均池化等。經(jīng)過池化過程之后,特征圖的維度就會降低,池化過程如圖1所示。

圖1 池化窗口為2×2的池化過程Fig.1 Pooling process with 2×2 pooling window

該過程中,可以看到最大值池化就是在每一個池化窗口中選擇一個最大值的輸出,圖1(b)就是經(jīng)過最大池化輸出的池化層的特征圖。本文采用的是最大值池化,可以很好地保留圖像的紋理信息。

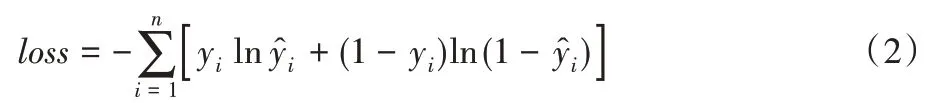

損失函數(shù)是衡量輸出的預測值和真實值之間的差距程度。對于二分類問題,通常在輸出層采用Sigmoid激活函數(shù)計算預測標簽的值,由于Sigmoid函數(shù)的特殊性在訓練的過程中會導致梯度越來越小,于是使用交叉熵損失函數(shù)(cross entropy loss function)替代均方差(Mean Square Error,MSE)損失函數(shù)。而對于本文的多標簽標注問題,轉(zhuǎn)化為了在每個標簽上的二分類問題,輸出層同樣采用Sigmoid 函數(shù)計算預測值,每一個標簽都是獨立分布的,互不影響于是本文使用了二分類交叉熵損失函數(shù)(binary_cross entropy loss function)也叫作二元交叉熵損失函數(shù),如式(2)所示:

其中:n是標簽數(shù)量;yi是i類標簽的真實值;是i類標簽的預測值;loss是單個樣本的損失函數(shù)。

2 融合閾值尋優(yōu)的卷積神經(jīng)網(wǎng)絡模型

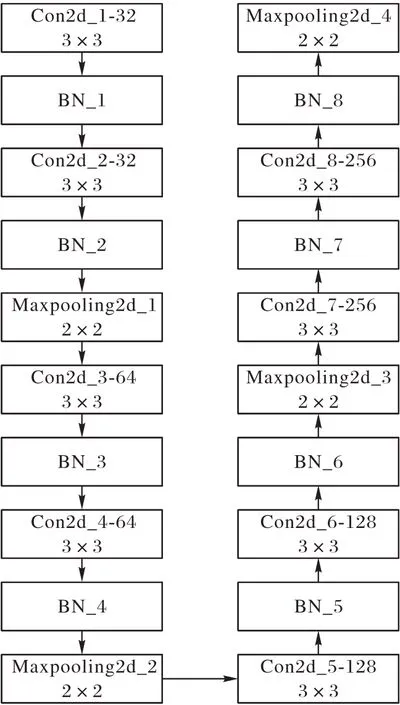

本文采用的卷積神經(jīng)網(wǎng)絡結構如圖2 所示,輸入層是同樣規(guī)格大小的圖像,大小都是100×100×3,3 代表著R、G、B 三個通道。中間的處理層包括8層卷積,4層池化以及在每個激活函數(shù)之前都增加了BN 層加快了收斂速度,其中8層卷積操作采用的卷積核都是經(jīng)典的3×3 的大小,卷積核的個數(shù)分別為32、32、64、64、128、128、256、256;池化層采用的均是最大池化,池化窗口均是2×2 大小的;為防止過擬合進行了Dropout 操作,概率設置為0.5;之后進行了Flatten 操作,把數(shù)據(jù)壓扁平準備全連接。最后輸出層中,兩個全連接層,使用的節(jié)點分別是512 個和5 個。整個網(wǎng)絡結構中只有最后輸出層的激活函數(shù)采用的是Sigmoid激活函數(shù),其余激活函數(shù)均采用線性整流函數(shù)(Rectified Linear Unit,ReLU)。優(yōu)化器采用的是隨機梯度下降(Stochastic Gradient Descent,SGD),學習率的初始值為0.01,學習率自動更新下降。

圖2 本文使用的卷積神經(jīng)網(wǎng)絡結構Fig.2 Structure of used CNN

2.1 基于BN操作的收斂速度的加快

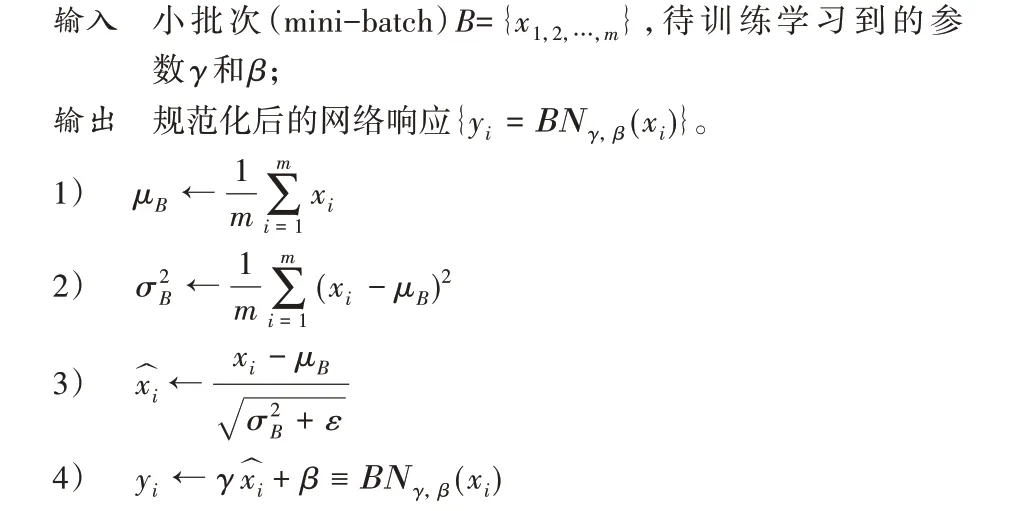

深度神經(jīng)網(wǎng)絡在訓練的過程中因為隱層神經(jīng)元的輸入分布不穩(wěn)定,導致網(wǎng)絡不能學習穩(wěn)定的規(guī)律,同時隨著網(wǎng)絡層數(shù)的加深,激活輸入值的分布逐漸偏移,越來越靠近非線性函數(shù)的極限飽和區(qū),導致反向傳播時梯度越來越小直至消失。在進行新的批次數(shù)據(jù)訓練時,網(wǎng)絡就要重新學習這批數(shù)據(jù)的特征,這就導致隨著網(wǎng)絡層數(shù)加深,梯度越來越小,訓練越來越困難,收斂越來越慢。于是,提出了BN[19]這個概念,把每一個隱層神經(jīng)元的激活分布固定下來,把上一層神經(jīng)元的輸出都標準化(正態(tài)分布),通過這一步可以把激活輸入值拉回到非線性區(qū)域的線性區(qū)域,加大了導數(shù)值,增強了梯度,同時為了提高網(wǎng)絡的表達能力,再進行一次變換,之后再輸入到下一層神經(jīng)元中。這樣就可以避免因網(wǎng)絡層數(shù)的加深,導致訓練數(shù)據(jù)越來越偏的問題。同時固定了網(wǎng)絡的各層輸入數(shù)據(jù)的分布,使得激活輸入值都落在對輸入比較敏感的區(qū)域,這樣一點小的變化就會導致?lián)p失函數(shù)較大的變化,加大了梯度,能大幅提高收斂速度,解決了在反向傳播的過程中底層網(wǎng)絡梯度消失的問題。BN[19]的具體操作如下所示:

其中:x是某個隱層神經(jīng)元沒有經(jīng)過變換之前的激活值;m是批處理中的實例數(shù);γ和β是網(wǎng)絡訓練過程中不斷迭代學習到的參數(shù),類似于權重和偏置;μB是批處理訓練中m個實例的均值;是批處理訓練中m個實例的方差;是某個神經(jīng)元對應的原始激活x減去批處理中m個實例的均值再除以方差進行的變換;ε是誤差;yi是規(guī)范化后的網(wǎng)絡響應。

經(jīng)過上述步驟1)~3)可以把某個神經(jīng)元的激活x形成一個正態(tài)分布,向非線性區(qū)域的線性區(qū)域靠近,增大了導數(shù)值和反向傳播的流動性,加快了收斂速度。但是由于把激活值拉到了線性區(qū)域,導致網(wǎng)絡的表達能力下降,于是通過訓練學習到的兩個參數(shù)γ和β,再一次對變換后的激活進行反變換也就是步驟4),提高了網(wǎng)絡的表達能力。

2.2 融合閾值尋優(yōu)設置最佳閾值

通過卷積神經(jīng)網(wǎng)絡模型對測試集中的圖片進行測試,得到一個概率數(shù)組,數(shù)組元素是每張圖片的每類標簽的預測概率,是否分配這個標簽給這張圖片,對此需要為每類標簽設置一個最佳閾值。閾值尋優(yōu)的過程如下:

步驟1 將模型預測的測試集標簽概率放入數(shù)組out。

步驟2 定義一個數(shù)組a。

步驟3 為閾值threshold設置范圍[0.1,0.8],步長為0.1。

步驟4 初始化最佳閾值best_threshold[0 0 0 0 0]。

步驟5 讀出out中的第i列元素(i從1 開始),代表的是測試集中所有圖片的第i個標簽,記為y_prob。

步驟6 取出threshold中的第j個值(j從1 開始),與y_ prob中的元素依次進行比較,如果大于等于j就設置為1,否則為0,記為y_pred。

步驟7 把預測標簽y_ pred與真實標簽y_test[:,i]進行馬斯修運算,把運算結果賦給a。

步驟8 重復步驟6~7,直到把j遍歷完。

步驟9 把a中最大數(shù)所在位置的索引賦給index。

步驟10 在threshold中取出index這個索引位置所對應的閾值賦給best_threshold[i],作為第i類標簽的閾值。

步驟11 重復步驟5~10,直到把所有標簽遍歷完。

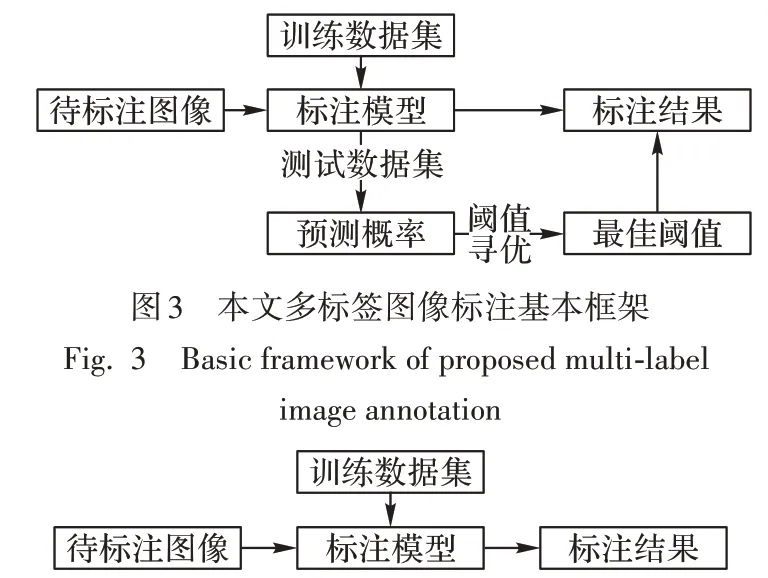

2.3 多標簽圖像標注框架

首先,訓練數(shù)據(jù)集對卷積神經(jīng)網(wǎng)絡進行訓練得到標注模型,其次,模型再對測試數(shù)據(jù)集進行預測得到預測概率,對預測概率進行上述的閾值尋優(yōu)過程得到最佳閾值,最后,把待標注圖像載入到標注模型和最佳閾值中完成標注過程。其基本框架如圖3所示。

圖4 是傳統(tǒng)的圖像自動標注框架,通過圖3 和圖4 的對比,可以看到本文的方法增加了閾值尋優(yōu)的過程,通過閾值尋優(yōu)設置最佳閾值可以解決固定標簽數(shù)目帶來的多標或少標的問題。

圖4 傳統(tǒng)圖像自動標注框架Fig.4 Traditional image automatic annotation framework

3 實驗與結果分析

3.1 實驗設計

3.1.1 實驗環(huán)境

代碼的實現(xiàn)基于Intel Xeon W-2102 CPU @2.9 GHz 的處理器、NVIDIA GeForce RTX 2080Ti 的顯卡以及16 GB 的內(nèi)存的硬件環(huán)境,使用Windows 10 操作系統(tǒng)和Keras 庫搭建軟件環(huán)境,實驗平臺是PyCharm,語言是Python。Keras庫是一個公開的深度學習庫,可以作為TensorFlow 和Theano 的應用程序接口,是對TensorFlow 和Theano的封裝,不必過多地關注底層結構,由于其高度模塊化可以快速搭建網(wǎng)絡結構,大幅提升開發(fā)效率,比TensorFlow更加容易使用。

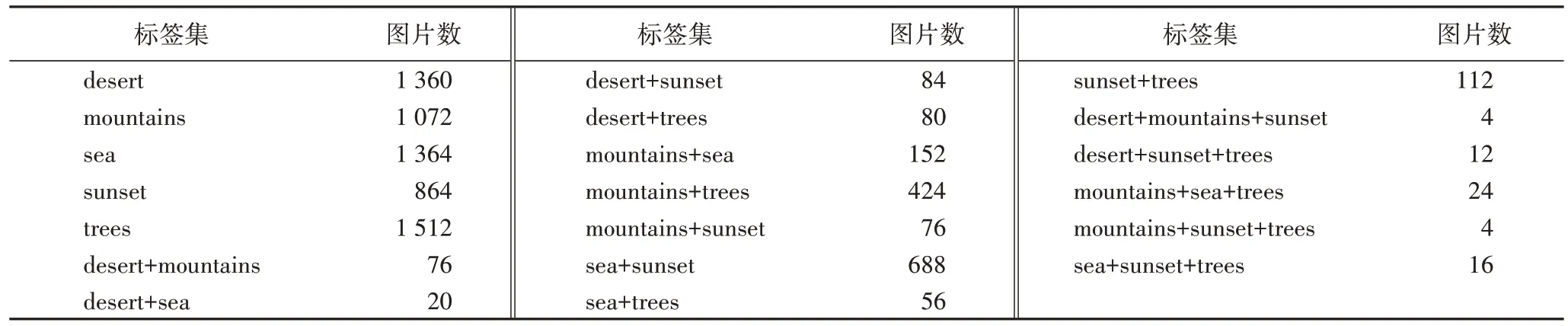

3.1.2 數(shù)據(jù)集

本文使用的數(shù)據(jù)集是來自于南京大學機器學習與數(shù)據(jù)挖掘研究所提供的關于自然場景的圖像庫,共有2 000 張圖片,由于數(shù)據(jù)集過小,通過數(shù)據(jù)增強把數(shù)據(jù)集增加到8 000張。圖片大小不一致,經(jīng)resize()函數(shù)操作之后,縮放為100×100 大小的,其中訓練集包含有6 400 張圖片,測試集有1 600 張圖片,這些圖片共有5 類標注詞,分別是desert、mountains、sea、sunset、trees,數(shù)據(jù)集的詳細信息[20]如表1所示。

3.2 評價指標

本文采用多種評價指標,如平均查準率P、平均召回率R以及F1,為了能夠更加準確地說明標注的效果,增加了一個新的評價指標完全匹配度(Complete Matching Degree,CMD)。完全匹配度在這里是新提出的一個概念,是指在測試每一張圖片時,測試的標注詞結果和圖片的真實標注詞完全一致,既沒有遺漏也沒有多余標注詞,實現(xiàn)了精準標注。作為實驗結果的評價標準,平均查準率P、平均召回率R以及平均F1值計算式如下:

其中:n表示的是標簽類別數(shù),本文中等于5,代表5 個標簽即5 個標注詞;Pi表示的是i類標簽的查準率;Ri表示的是i類標簽的召回率;F1i表示的是i類標簽的F1值。

表1 數(shù)據(jù)集相關信息Tab.1 Information related to datasets

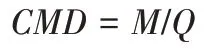

完全匹配度為:

其中:M表示預測標簽和真實標簽完全一致的圖片個數(shù);Q表示測試集大小。

3.3 結果分析

3.3.1 對BN操作的實驗驗證

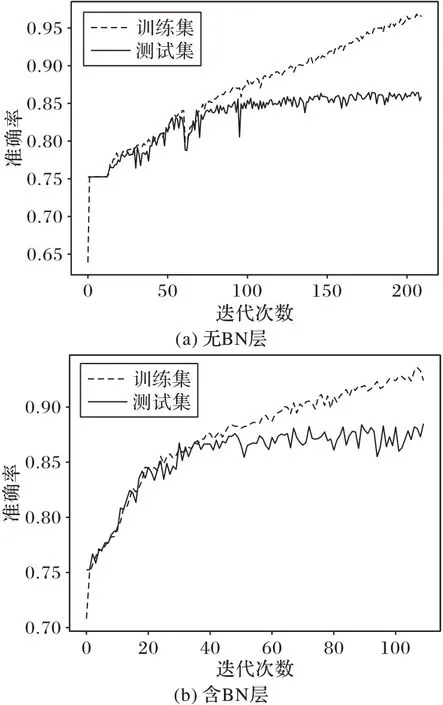

為了驗證添加BN 層可以加快收斂速度,本文對添加BN層的網(wǎng)絡結構和不添加BN層的網(wǎng)絡結構進行訓練,隨著迭代次數(shù)的增加,準確率(Accuracy)的變化情況如圖5所示。

由于訓練時長關系,對不添加BN 層的迭代200 次和添加BN 層的迭代100 次進行實驗以說明BN 層的作用。圖5 中的(a)、(b)兩圖的橫坐標均是迭代次數(shù)(Epoch),縱坐標均是準確率(Accuracy)。如圖5(a)所示,在不添加BN 層的情況下準確率達到80%需要迭代大約50 次,在迭代20 次的情況下準確率僅達到了75%。如圖5(b)所示,在添加BN 層的情況下準確率達到80%大約僅需要迭代15次,達到75%的準確率大約需要迭代5次,表明BN層可以很好地加快收斂速度。

3.3.2 對最佳閾值的實驗驗證

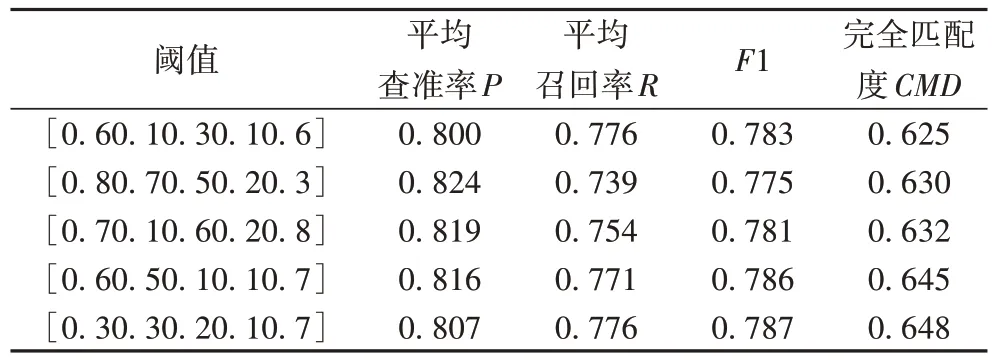

為了尋找到最佳閾值,對各組閾值進行了對比實驗,表2中的各組閾值是迭代相同次數(shù)(Epoch=500)的模型所對應的最佳閾值,通過把各個模型所對應的最佳閾值載入到最優(yōu)模型中,找出最佳閾值。

從表2 可以看出,新增加的一個評價指標CMD使得實驗結果的評價更為嚴謹和苛刻。首先,整體分析各組閾值的實驗結果,發(fā)現(xiàn)差距不大,說明訓練得到的最優(yōu)模型效果不錯。因此,基本認為這個卷積神經(jīng)網(wǎng)絡模型在本數(shù)據(jù)集上的多標簽圖像自動標注問題上沒有太大的問題。其次,雖然各組閾值的結果差距不大,但綜合考慮到完全匹配度是最高的,因此選擇[0.3 0.3 0.2 0.1 0.7]作為最佳閾值,其中CMD在這個實驗中達到了64.75%,這再次驗證了最佳閾值的有效性。

圖5 迭代準確率變化Fig.5 Accuracy variation with iteration

表2 各閾值實驗結果Tab.2 Experimental results of various thresholds

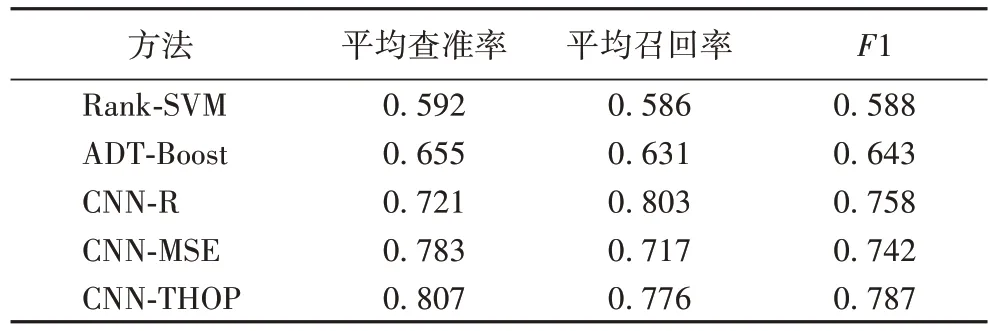

3.3.3 與其他圖像標注方法對比

為了驗證本文提出的融合閾值尋優(yōu)的卷積神經(jīng)網(wǎng)絡(CNN with THreshold OPtimization,CNN-THOP)模型在圖像自動標注上的有效性,將與傳統(tǒng)方法基于排名的支持向量機(Ranking Support Vector Machine,Rank-SVM)法[21]和ADTBoost.MH (Multiclass,multi-label version of boostingalternating decision trees based on Hamming loss)[22]以及近些年來常用的深度學習方法卷積神經(jīng)網(wǎng)絡回歸(CNN Regression,CNN-R)[23]和采用MSE 誤差函數(shù)的CNN(CNN using Mean Square Error function,CNN-MSE)[18]進行比較,實驗結果如表3所示。

表3 各圖像標注方法的實驗結果Tab.3 Experimental results of different image annotation methods

從表3 中可以看出,本文提出的方法融合閾值尋優(yōu)的卷積神經(jīng)網(wǎng)絡(CNN-THOP)模型和傳統(tǒng)方法Rank-SVM 相比,平均查準率上提升了約20 個百分點,平均召回率較ADT-Boost提升了約14 個百分點,表明卷積神經(jīng)網(wǎng)絡在特征提取方面要優(yōu)于傳統(tǒng)方法。通過和卷積神經(jīng)網(wǎng)絡相比,平均查準率較CNN-R 提高了約8 個百分點,平均召回率較CNN-MSE 將近提升6 個百分點,表明最佳閾值的設置可以更靈活地標注標簽,解決了固定標簽數(shù)目帶來的問題,這再次驗證了本文方法的有效性。

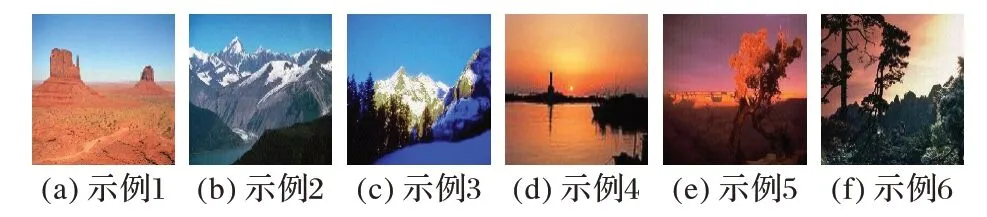

3.4 模型實際標注效果

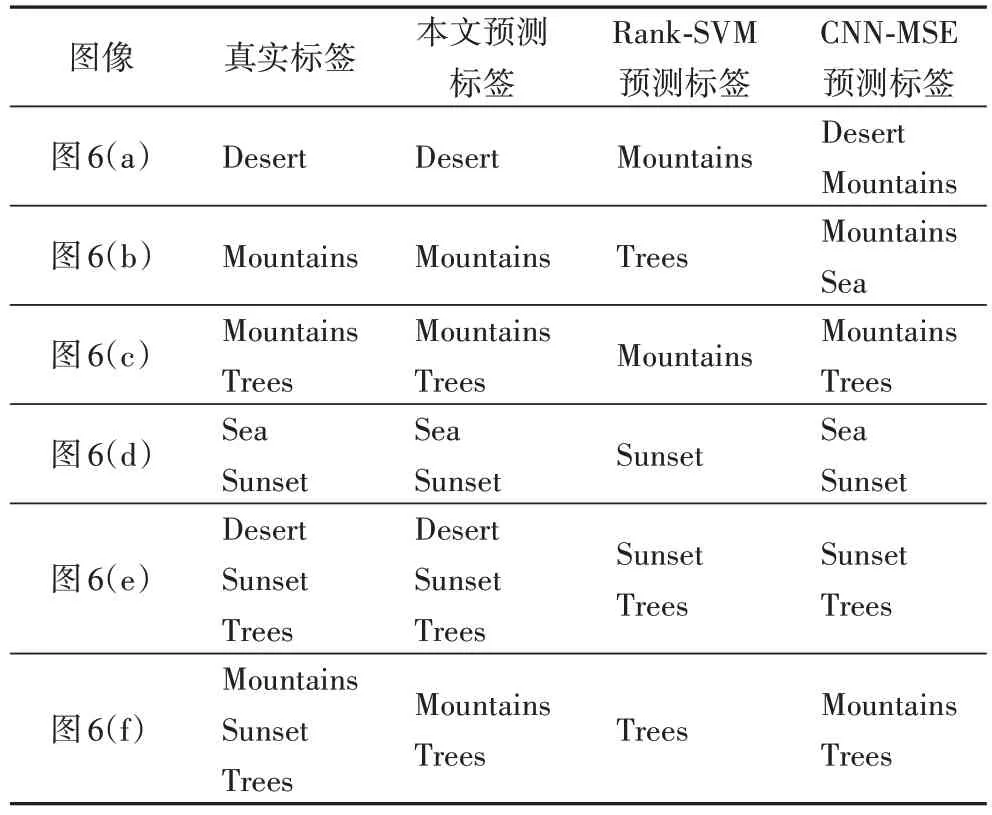

圖6中列出測試圖片,表4中給出各實驗方法自動標注的實際效果,其中選取傳統(tǒng)方法Rank-SVM 和深度學習方法CNN-MSE與本文方法預測標簽進行對比。

從表4 中可以看出,本文方法比其他方法在圖像自動標注方面更加有效,對于大多數(shù)圖像都可以完全正確地標注標簽,不會出現(xiàn)多標或少標的問題,解決了其他方法因固定標簽數(shù)目所帶來的問題。最后一幅圖像的標注雖然比真實標注少了一個,原因可能是因為該類圖像太少,模型沒有很好地學習到這個特征。對于CNN-MSE的標注結果,可以看出因固定標簽數(shù)目所帶來的多標或少標的問題比較多。總體來看,本文方法在圖像自動標注方面是有效的。

圖6 測試圖片F(xiàn)ig.6 Test images

表4 各實驗方法圖像標注結果對比Tab.4 Comparison of image annotation results of different methods

4 結語

針對多標簽圖像標注過程中固定標注數(shù)量、根據(jù)排名函數(shù)標注標簽的問題,本文增加了閾值尋優(yōu)的過程,最佳閾值的設置使得標注更加合理有效。融合閾值尋優(yōu)的卷積神經(jīng)網(wǎng)絡模型在測試過程中平均查準率、平均召回率和F1值都有了很大的提高,完全匹配度上也有較好的表現(xiàn),達到了64.75%。而BN層的添加更好地加快了收斂,表明本文方法能夠有效地標注圖像。

本文的不足之處:采用的數(shù)據(jù)集使用的人比較少,在對比方面存在著一定的局限性。下一步工作準備在兩個方面進行展開:1)融合多個數(shù)據(jù)集使得訓練的模型更加具有普適性;2)在特征提取方面把人工提取特征和卷積操作結合在一起,更加完善特征提取以免遺漏。