基于XGBoost的固態白酒發酵產量預測?

余天陽

(江南大學物聯網工程學院 無錫 214122)

1 引言

白酒發酵過程中的酒醅溫度影響酵母菌的生長繁殖,進而影響白酒的產量[1~2]。同時,入窖水分、入窖酸度和入窖淀粉濃度也會影響白酒的產量[3~5]。如何準確有效地預測白酒產量、保證白酒質量成為固態白酒發酵亟待解決的問題。常規優質固態白酒發酵溫度曲線應符合“前緩、中挺、后緩落”的規律[6],是一系列復雜生化反應的宏觀體現,其中蘊含重要的演化信息,故期望從中找出演化規律,利用已知的檢測數據預測白酒產量,為下一輪的入窖工藝優化提供依據。

目前關于預測的方法主要有時間序列法、小波分析法、人工神經網絡等。1989年Baldi P通過研究發現,在處理非線性數據上,神經網絡的預測能力要優于傳統模型[7]。但是L.Kaastra在1995年發現神經網絡存在過擬合、難收斂和模型訓練困難等問題[8],與此同時Vapink在神經網絡的基礎上首次提出了以結構風險最小化為原則的SVM(Support Vecor Machine,SVM)算法[9],該方法較好地解決小樣本、非線性等實際問題,并且在很多領域已經開始得到應用,如兩相流行識別[10]、故障診斷[11]、模式識別[12]等領域。但SVM的訓練需要求解二次規劃問題,影響計算速度。為此,Suykens等[13]提出了最小二乘支持向量機(Least Squares Support Vector Machine,LSSVM)方法。最小二乘支持向量機(LSSVM)是標準支持向量機的一種擴展,通過求解線性方程,有效簡化計算過程,提高運算速度。但是,在LSSVM建模過程中模型的懲罰參數γ和核參數σ對模型的擬合精度和泛化能力有著較大影響。傳統的取值方法是依據經驗通過試湊法進行調試,沒有統一的規則。粒子群(Particle Swarm Optimization,PSO)算法[14]是基于種群的并行全局搜索策略,概念簡單、易于實現,且沒有許多參數需要調整,具有更快的收斂速度,對處理高維數據具有一定的優勢,常應用于支持向量機的參數優化。從已有的研究成果來看,基于機器學習方法進行預測已經越來越常見,但所采用的的方法多為常規方法,如SVM、神經網絡、LSSVM等經典方法,Chen(2016)[15]提出了一種新的 XGBoost的機器學習算法,該方法是大規模并行boosted tree的工具,是目前最好的開源boosted tree工具包,比常見方法快數倍以上,已經逐漸應用于數據的分析預測中。

本文在XGBoost建模方法的基礎上,通過分析樣本間的馬氏距離[16~17],剔除原始樣本中相關性較小的樣本點,并將該方法應用于固態白酒發酵的產量預測當中,測試結果表明該方法符合預測精度,能夠應用于實際工程應用。

2 數據的采集與處理

2.1 數據采集

本文預測模型所需要的訓練樣本和測試樣本來自于2018年2月江蘇某酒廠生產區域內1168口窖池。該廠采用物聯網無線測溫技術對生產區域內全部窖池的糟醅溫度進行實時在線監控。其中,物聯網無線溫度傳感器統一安插位置為每口窖池中心點往下1.5m處(離窖底0.5m),采用PT100溫度傳感器每隔1h自動采集1次糟醅發酵溫度,并發送到各自的無線路由器上,再由無線路由器將搜集到的溫度數據傳送到工控機中進行數據交換和數據處理。此次共采集樣本522份,數據特征為522*1440。

2.2 相關性樣本剔除算法

相關性樣本剔除是將樣本空間中相關性較小的樣本采用一定的辦法去除,再利用剩余樣本進行建模。這種方法可以簡化模型結構,提高在線計算的速度與精度。歐氏距離和馬氏距離常被用來度量樣本間的相似度。歐氏距離法表達的是數據在特征維度空間中的真實距離;馬氏距離法表達了數據的協方差距離,即標準化數據與中心化數據之差,以此來考量樣本間的相似程度。

2.3 相關性樣本剔除實驗

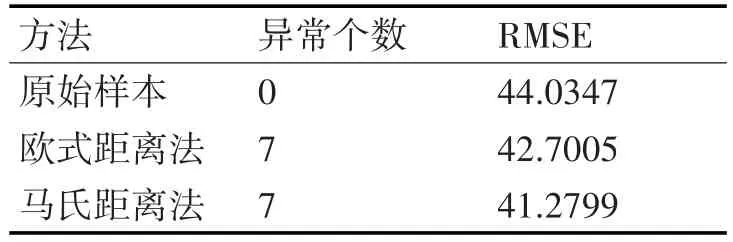

本文原始樣本共有522個發酵數據,采用馬氏距離法和歐氏距離法作為樣本相似的判別依據。在保證模型精度的情況下,通過經驗法選取ε1=0.01,剔除相關性較小的樣本序號如表1所示。

表1 剔除樣本對比

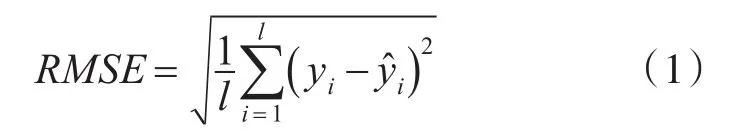

為了更好地評價相關性樣本剔除算法的優劣,采用均方根誤差RMSE指標對其進行檢驗:

其中l是測試樣本的個數,yi為測試樣本的原始值,y?i為測試樣本的預測值。如表2所示,剔除相關性較小的樣本后,模型的精度明顯增加,而采用馬氏距離法精度最高。

表2 剔除算法比較

3 基于XGBoost預測方法

3.1 XGBoost基本原理

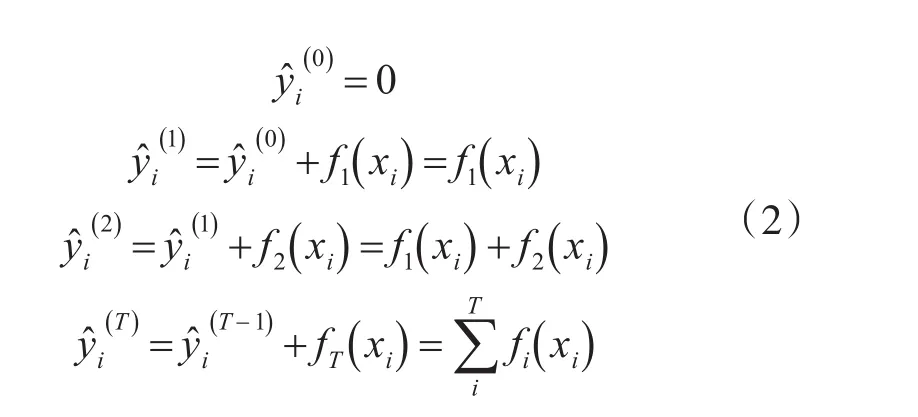

XGBoost[10]的 全 稱 是 eXtreme Gradient Boost?ing,即極端梯度提升樹,是梯度提升機器算法(Gra?dient Boosting Machine)的擴展。Boosting分類器屬于集成學習模型,其基本思想是把成百上千個分類準確率較低的樹模型組合成一個準確率較高的模型。該模型不斷迭代,每次迭代生成一棵新的樹,通過不斷加入子樹使模型不斷逼近樣本分布,過程如下:

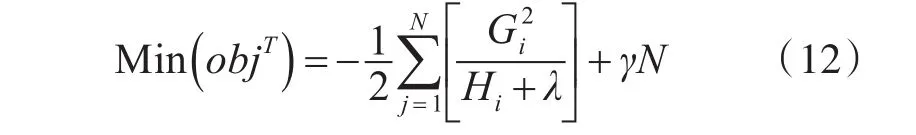

結合上述兩式的最小殘差值為(結構分數):

一次迭代要增加一棵樹擬合樣本集,暴力的方法就是枚舉所有的樹,然后選擇結構分數最小的。

3.2 XGBoost模型參數

XGBoost模型有3種類型的參數:通用參數、輔助參數和任務參數。通用參數確定上升過程中上升模型類型,常用樹或線性模型;輔助參數取決于所選的上升模型;任務參數定義學習任務和相應的學習目標。

XGBoost模型中,常用的參數說明如下:

1)booster:設置需要使用的上升模型。可選gbtree(樹)或gblinear(線性函數),默認為gbtree。

2)nthread:XGBoost運行時的并行線程數,默認為當前系統可以獲得的最大可用線程。

3)eta:收縮步長,即學習速率,取值范圍是[0 , 1],默認為0.3。在更新葉子節點的時候,權重乘以eta,以避免在更新過程中出現過擬合的現象。

4)max_depth:每棵樹的最大深度,取值范圍為[1 , ∞] ,默認為6。樹越深,越容易過擬合。

5)subsample:訓練的實例樣本占總體實例樣本的比例,取值范圍為[ ]0,1 ,默認為1,值為0.5時意味著XGBoost隨機抽取一半的數據實例來生成樹模型,這樣能防止過擬合。

6)objective:默認為reg:linear。

seed:隨機數種子,為確保數據的可重現性,默認為0。

3.3 K折交叉驗證方法

論文采用K折交叉驗證的方法。將原始數據分為K個子集,每個子集分別驗證一次,剩余的K-1組子集作為訓練數據,這樣可以得到K組訓練集和測試集,以最終的回歸平均精度作為性能指標。在實際應用中K值一般大于等于2,需要建立K個模型來進行K折交叉驗證的實驗,并計算K次測試集的平均回歸精度。

K折交叉驗證的結果能較好的說明模型效果,有效的避免了過擬合和欠擬合問題。在XGboost中,通過使用xgb.cv函數來做交叉驗證。

4 應用實例

固態白酒發酵是一系列復雜生化反應的過程。白酒發酵過程中酒醅溫度變化是導致白酒產量變化的直接原因。此外,白酒產量還受到入窖酸度、入窖水分、入窖淀粉等因素的影響[16]。因此,建立能夠反映這些因素的確定性固態白酒發酵產量預測模型比較困難。

目前我國的固態白酒發酵產量監控還是以經驗為主,通過監控發酵過程中的酒醅溫度曲線來大致推測窖池的發酵情況,從而針對性地做好下一輪入窖配料的調整工作。傳統方法認為只要酒醅溫度曲線保持“前緩、中挺、后緩落”的規律便意味著白酒發酵的正常。但是在這種模式下,酒醅溫度的監控信息反饋具有滯后性,不能有效分析窖池內的發酵信息,從而直接影響下一輪的白酒發酵的產量。因此,根據完整的歷史監測數據建立預測模型,對優化入窖配料方案、保障白酒發酵的高質高產具有重要意義。

4.1 樣本集劃分

有效地劃分樣本集可以提高模型的泛化能力,本文通過馬氏距離進行異常樣本剔除后共得到515組樣本數據,再加上各自窖池發酵的入窖水分、入窖酸度、入窖淀粉和產量組成新的數據樣本,數據特征為515*1444。按照校正集和驗證集大約9:1的比例,將515個樣本劃分465個作為訓練樣本,50個作為測試樣本,檢驗預測結果的真實性。

4.2 模型評估參數

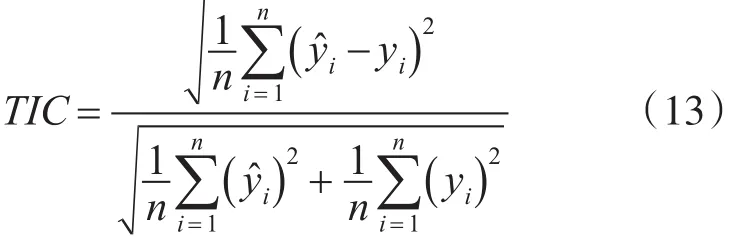

采用預測均方根誤差RMSEP和希爾不等系數TIC對模型性能進行評估。RMSE表示預測值與真實值之間的標準差,越小代表準確性越高;希爾不等系數是評價預測結果相對真實結果擬合誤差的指標,值介于[0,1],越接近0,擬合誤差越小。然而單一的RMSE并不能表明模型的實用價值,因此根據上述評價指標,對模型進行綜合評價,其公式如下:

4.3 模型參數選取及預測結果對比

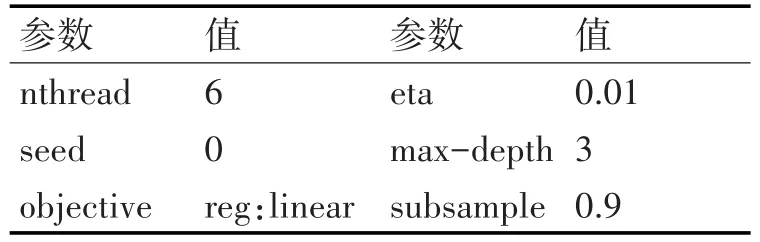

在預處理數據的基礎上,采用XGBoost模型進行訓練,具體參數如表3所示。

表3 單XGBoost模型參數

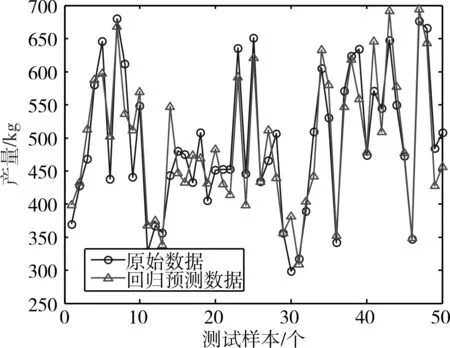

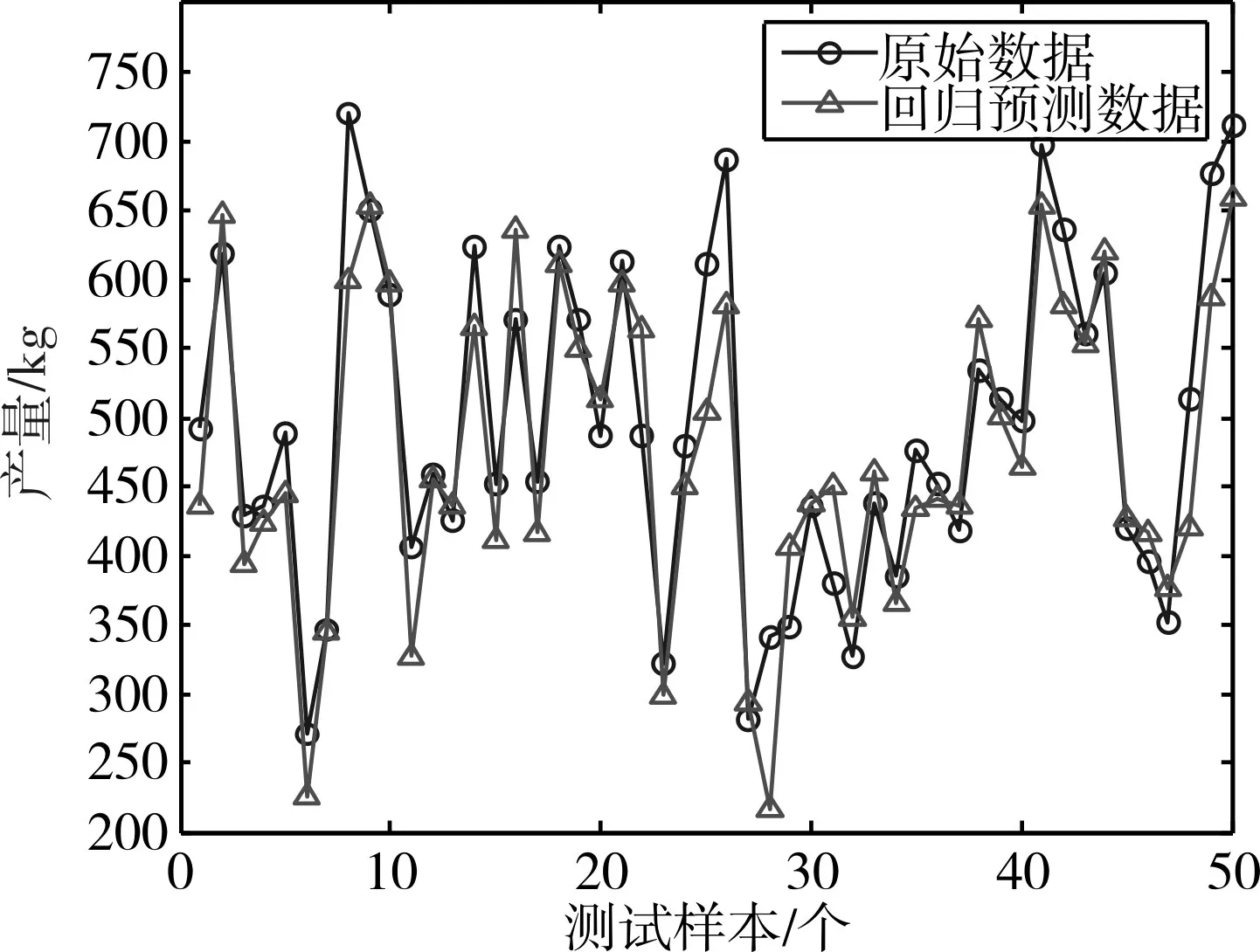

采用訓練好的XGBoost模型對固態白酒發酵產量進行產量預測,具體結果如圖1所示。為了更科學地評價預測方法的準確性,本文將XGBoost模型預測結果與BP、SVM、LSSVM、PSO-LSSVM模型預測結果進行比較。

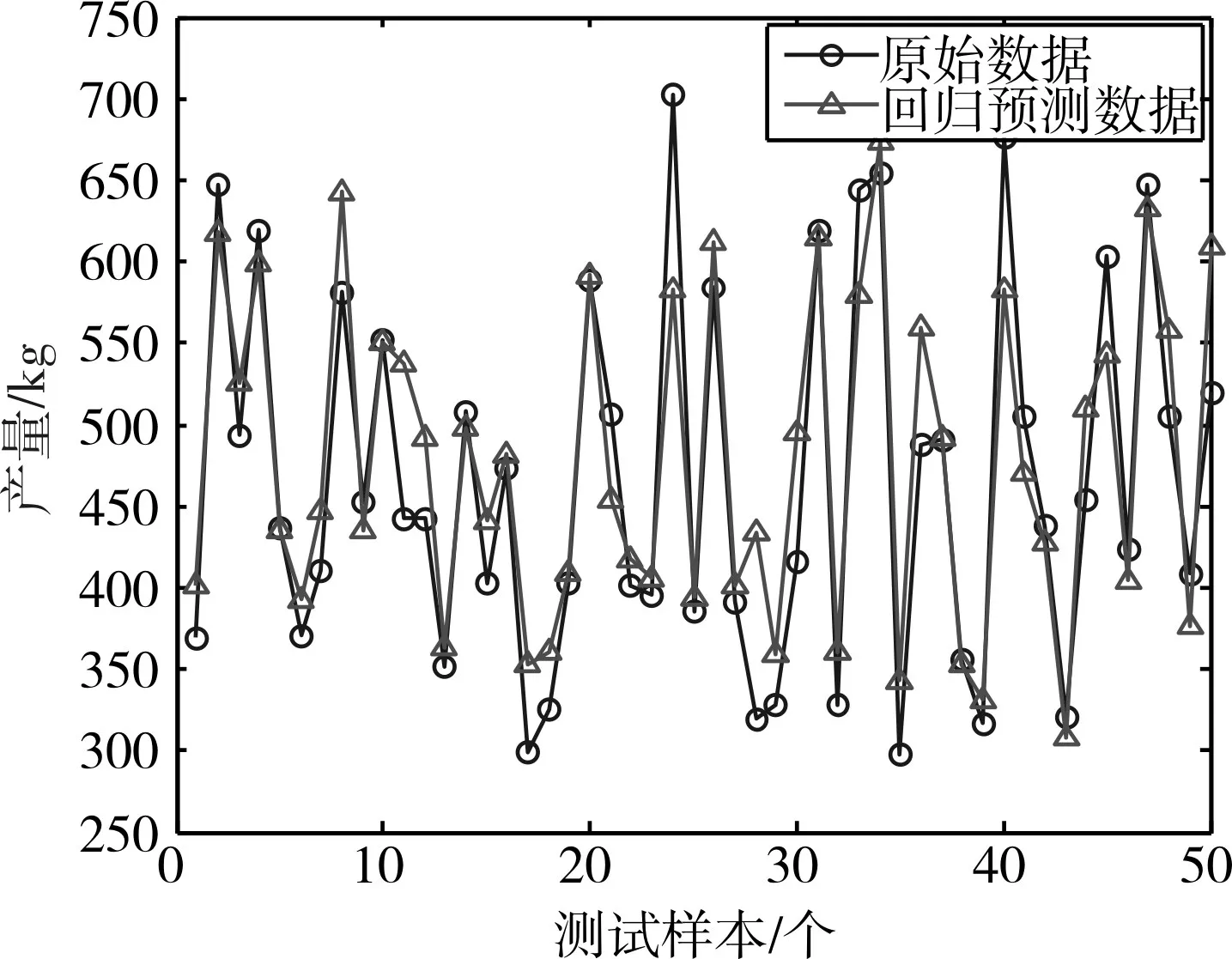

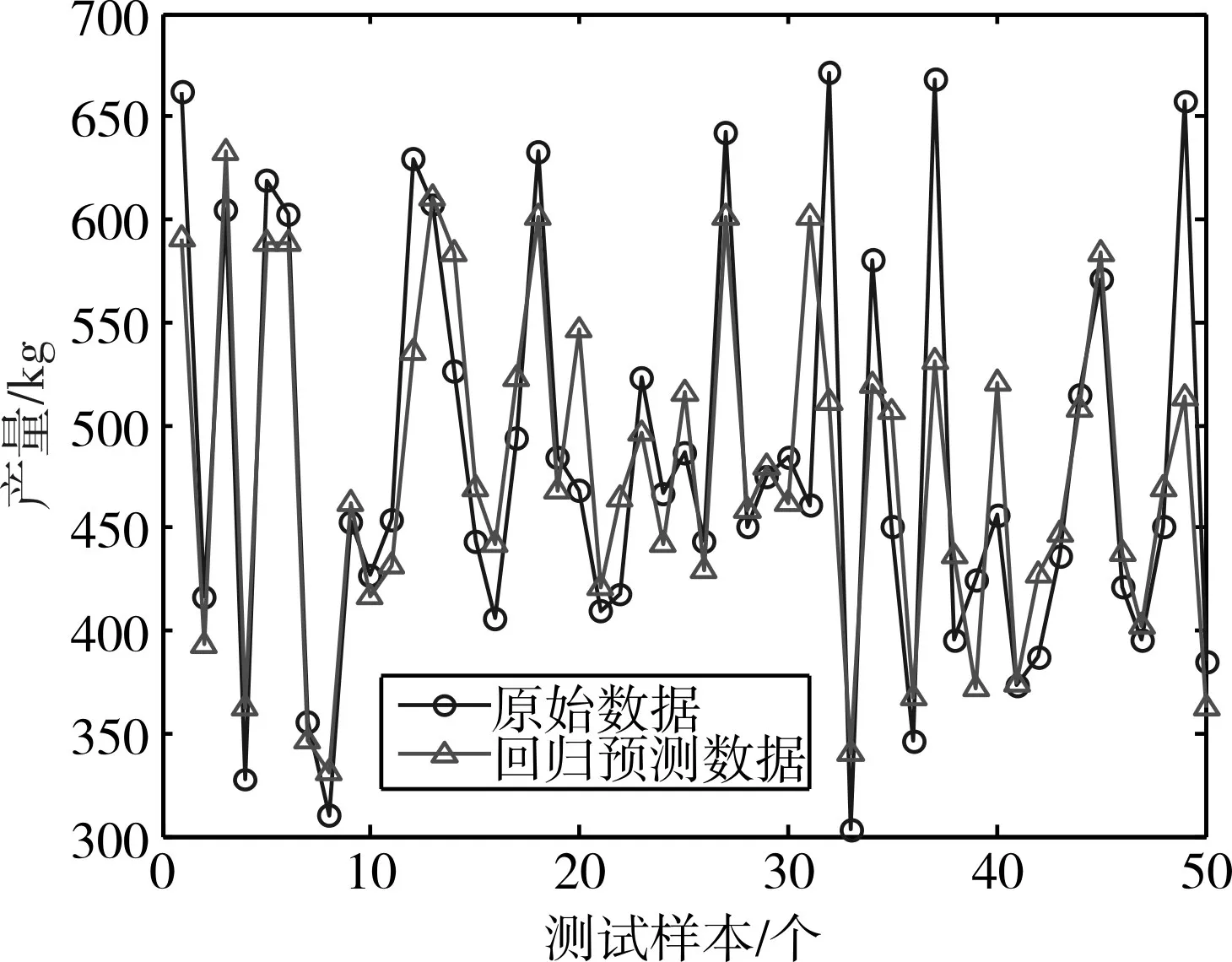

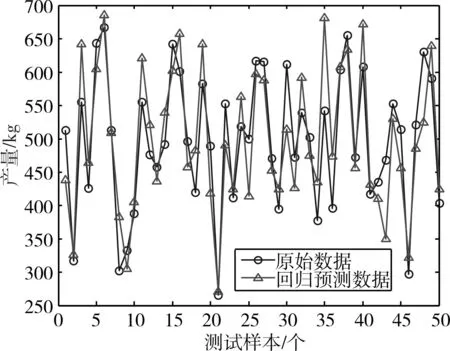

PSO-LSSVM、LSSVM、SVM、BP預測的結果圖分別如圖2、圖3、圖4和圖5所示。其中所有的測試數據與預測數據均已歸一化處理。

圖1 XGBoost模型白酒產量預測

圖2 PSO-LSSVM模型白酒產量預測

圖3 LSSVM模型白酒產量預測

圖4 SVM模型白酒產量預測

圖5 BP模型白酒產量預測

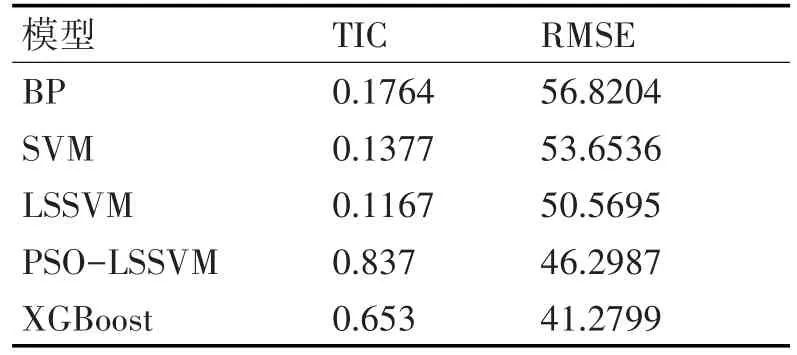

為了更好地閱讀各個算法的差別,本文使用均方根誤差RMSE和希爾不等系數TIC兩個參數對產量預測結果進行量化分析。兩種評價指標從不同方面揭示了模型預測精度和擬合誤差的程度。表4給出了五種算法在產量預測方面的對比。其中,XGBoost模型的均方根誤差為41.2799,分別比PSO-LSSVM、LSSVM、SVM和BP低10.8%、18.3%、23%和27.3%。因此,XGBoost模型無論是在預測精度還是在擬合誤差上都高于其他模型,表明XG?Boost模型預測的結果更加理想,在工程應用中更具優勢。

表4 四種模型與預測結果對比

5 結語

本文將神經網絡、支持向量機、最小二乘支持向量機、粒子群優化的最小二乘支持向量機以及XGBoost應用到固態白酒發酵的產量預測中,并且系統地比較了幾種機器學習的有效性,并得出以下結論:

1)從數據本身來看,發酵過程中的酒醅溫度時序數據、入窖淀粉、入窖酸度和入窖水分能夠較好地反映固態白酒發酵的產量情況,利用其作為機器學習的輸入特征可以較好地預測白酒產量,證明了機器學習在固態白酒發酵產量預測領域的有效性。

2)從預測結果和擬合誤差來看,XGBoost模型的預測精度相對于其他模型而言,在擬合誤差指數、均方根誤差指數方面都有不同程度的提高,證明了XGBoost的預測能力的優越性。

3)從本文的實驗結果來看,XGBoost方法在損失函數尋優過程中用到了一階和二階導數,并且加入了正則項來控制過擬合現象,提升了模型的預測精度。XGBoost預測能力要優于傳統的機器學習算法,但由于該方法在白酒產量預測方面的研究較為匱乏,如何將XGBoost方法應用到實際生產過程中去將是本文后續的研究方向。