基于深度學習的行人再識別技術研究綜述

魏文鈺,楊文忠*,馬國祥,黃 梅

(1.新疆大學信息科學與工程學院,烏魯木齊 830046;2.新疆大學軟件學院,烏魯木齊 830046)

0 引言

隨著“平安城市”建設的大力推進,人們在社會治安管理方面投入了大量的人力、物力,以預防、控制、打擊破壞社會穩定的違法犯罪行為的發生。其中,智能監控系統作為社會治安管理系統中不可缺少的一部分,為維護社會的安全穩定發揮了巨大作用。“平安城市”的建設要求城市具備強大可靠的智能監控系統,這需要先進科學技術的支撐,以確保在追蹤不法犯罪分子的過程中能提供明確可靠的線索。

一般來講,一個完備的視頻監控系統應該具備3 個部分[1]:行人檢測、行人追蹤、行人檢索,其中,行人檢索即為行人再識別(person Re-identification,Re-id)。如圖1 所示,行人再識別[1]是一種利用計算機相關技術來進行跨攝像機視圖中特定行人身份匹配的技術,其中淺灰色框匹配圖片為同一身份的正確匹配,深灰色框匹配圖片為不同身份的錯誤匹配。行人再識別屬于圖像檢索的子問題,但其與圖像檢索不同的是,行人再識別檢索的目標是特定行人,它是為了在社會治安管理方面搜索、追蹤特定行人而興起的一項圖像檢索技術。

對于跨攝像機的行人檢索技術來說,其存在著許多與其他計算機視覺技術不同的難點與挑戰(如圖2 所示),包括:1)低分辨率:受攝像機等成像設備的限制,實際場景中得到的行人圖像大多是分辨率較低的模糊圖像;2)跨攝像機問題:由于復雜多變的攝像機環境,不同的攝像機提供的行人圖像會存在巨大差異,這些差異包括光照不同、行人姿態不同、背景不同、成像風格不同等;3)遮擋問題:在實際視頻監控中,目標行人難免會受到車輛、欄桿、其他行人等遮擋物的遮擋,導致目標行人圖像不完整;4)檢測不準確:經過目標檢測方法處理過后得到的行人再識別數據集中的行人圖像,會存在行人檢測不準確而導致的行人圖像部分缺失、錯位等問題;5)標注困難:在實際待檢索的目標域上難以獲取有標注的數據進行模型訓練。針對這些挑戰與困難,研究者們將行人再識別技術從傳統的手工設計的方法,發展到現在的卷積神經網絡、生成對抗網絡等深度學習方法,已經較為成熟了,且目前的算法在常用的公開數據集[2-3]上的首位準確率(Rank-1)已經達到90%以上。但為了達到更高的再識別準確率,使行人再識別技術可以更好地運用在實際的復雜場景中,對于該技術的發展還有待進一步研究。

圖1 行人再識別任務示意圖Fig.1 Schematic diagram of person re-identification task

圖2 行人再識別任務中的挑戰Fig.2 Challenges in person re-identification task

根據數據源的不同,本文將現有的行人再識別方法分為圖像行人再識別、視頻行人再識別、跨模態行人再識別,并基于這3 類基于深度學習的行人再識別技術進行詳細介紹,大致描繪一個該技術從發展初期到現今的發展歷程,介紹各類方法的主要思想并進行簡單總結。此外,本文進行了相關數據集介紹和一些優秀方法的性能比較,最后概覽全文得出總結與展望。

1 圖像行人再識別

以卷積神經網絡(Convolutional Neural Network,CNN)為代表的深度學習方法在計算機視覺研究領域大放異彩,包括人臉識別[4-5]、物體檢測[6-7]、目標跟蹤[8-9]等方面,都取得了不錯的效果。在2014 年之后,大量文獻采用深度學習的方法來解決行人再識別問題,不僅實現了同一行人不變特征的魯棒表示,還實現了端到端的行人再識別系統,這些方法不再使用復雜的度量算法,僅僅使用簡單的歐氏距離或余弦距離就可以得到較高的匹配準確率。這些深度學習方法的性能在很大程度上超過了早期基于手工特征的行人再識別方法,很快占領了該研究領域的半壁江山,此后的研究將繼續在該技術上進一步進行研究探索。

基于深度學習的行人再識別技術自發展以來,對用于圖像方法的研究要多于用于視頻的方法,同時一些用于圖像的方法也可以擴展到視頻行人再識別數據集,以完成視頻序列的行人再識別任務。本文將圖像行人再識別方法根據數據源是否有標簽分為有監督方法和無監督方法兩大類,下面將就此兩大類展開詳細介紹。

1.1 有監督方法

在機器學習中,有監督方法通常被認為是使用有標簽的訓練數據對模型進行監督訓練,該類方法在行人再識別研究領域即為使用有ID 標簽的行人圖片來訓練行人再識別模型;隨后用訓練好的模型從行人圖片中提取出行人不變特征,再對這些特征進行距離度量計算,從而判斷出哪些行人圖片屬于同一身份,哪些行人圖片屬于不同身份。現有的有監督圖像行人再識別方法可以分為基于特征學習的方法和基于度量學習的方法。基于特征學習的方法著重學習行人的不變特征表示,基于度量學習的方法著重利用度量損失函數學習行人之間的相似度,但是這些方法都共有一個目的,即對不同攝像機下的同一行人進行正確的同類匹配。

1.1.1 基于特征學習的方法

行人圖像中既包含全局信息也包含局部信息,若從抽取的特征類型進行分類,特征學習可以分為全局特征學習和局部特征學習。以往的特征學習方法[10-13]只考慮從行人圖像的全局信息中抽取行人不變特征,但這對姿態變化、視角變化、行人檢測不準確等問題較為敏感,從而影響檢索精度。現在大多數性能好的行人再識別方法[14-18]以抽取行人局部特征并結合行人全局特征的方法來獲取行人判別信息,以克服各種跨攝像機檢索的困難。根據局部特征區域的生成方式,可以將局部特征學習方法分為以下三類[16]:1)根據先驗知識[19-21]如姿態估計、關鍵點定位等來定位局部區域;2)使用注意力機制的方法[14,22-24]提取感興趣的局部區域;3)將深度特征映射分割為預定義條狀[16-19,25-26]。這三類局部特征學習的方法將幫助模型提取出有效魯棒的行人特征表示。

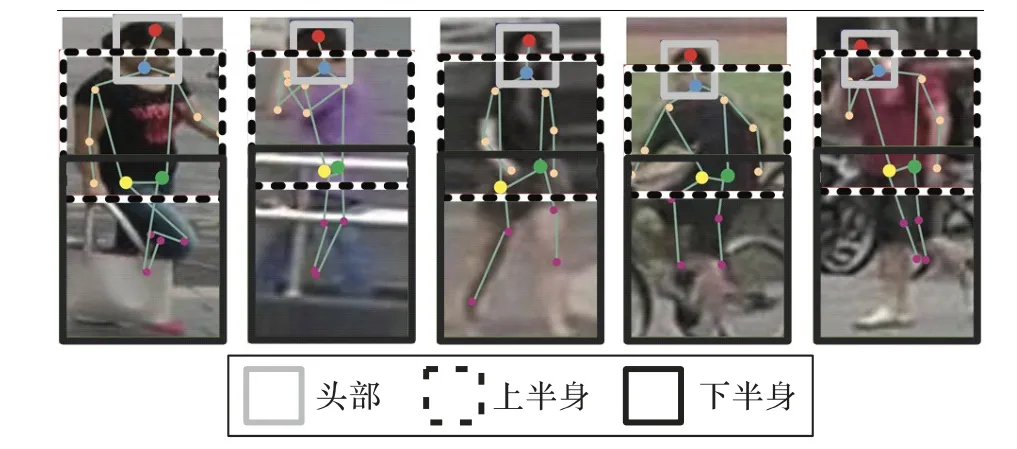

文獻[19]提出一種基于姿態的深度卷積模型(Pose-driven Deep Convolutional model,PDC)結構,其由兩部分組成:特征嵌入子網(Feature Embedding sub-Net,FEN)和特征加權子網(Feature Weighting sub-Net,FWN)。FEN 通過姿態估計算法[27]得到14個人體關鍵點進而得到人體6個身體局部區域,然后使用FWN 對不同局部區域加權融合得到全局與局部特征。文獻[20]將人體結構信息融入到CNN 框架中,使用文獻[28]的算法來定位人體關鍵點,得到7 個人體局部區域,最后使用特征融合方法合并不同區域的特征向量。文獻[21]為了獲得更加精確的人體局部特征,利用Deeper Cut方法[29]來估計定位對姿態變化、攝像機視角變化具有魯棒性的14個人體關鍵點,然后根據這些關鍵點得到3個人體局部區域(如圖3所示),在訓練階段,將這3個部分區域和全局圖像輸入網絡中,提取出4個特征描述符,并將它們串聯起來,最后得到全局-局部對齊描述符(Global-Local-Alignment Descriptor,GLAD)。總的來說,利用先驗知識來定位人體局部區域雖然可以學習到具有語義信息的局部特征,但是會引入額外的誤差,影響提取到的局部特征的質量,從而影響行人檢索算法的性能。

圖3 關鍵點定位示意圖[21]Fig.3 Schematic diagram of located keypoints[21]

注意力機制模型在一些具有挑戰性的序列數據識別和建模任務上表現出了優異的性能,包括標題生成[30]、隱式情感分析[31]和動作識別[32]等。簡而言之,它與人類處理視覺信息的方式類似,基于注意力機制的算法傾向于選擇性地集中于一部分信息,同時忽略其他感知信息,因此該方法在行人再識別中可用于自適應地定位行人圖像的辨別性局部區域。文獻[22]提出了一個端到端的比較性注意力網絡(Comparative Attention Network,CAN),該網絡以長短時記憶(Long Short Term Memory,LSTM)網絡為基本架構,融入了時間信息,可以通過多次“觀察”比較行人外觀后,學習圖像中哪些局部區域與待識別的行人相關,并自動集成不同局部區域的信息,以確定一對圖像是否屬于同一個人。針對細粒度的行人分析任務,文獻[23]提出了一種基于多方向注意力模塊的網絡架構HP-Net(HydraPlus-Net),該網絡能夠從低層到語義層捕獲多個注意力特征,并加入了注意力特征的多尺度選擇,以此豐富了行人圖像的最終特征表示。深度學習模型由于有大量的參數而導致算法效率不高,文獻[24]提出了輕量級(參數少)的注意力網絡架構HA-CNN(Harmonious Attention CNN),該網絡能同時學習任意行人圖像中的硬區域級注意力和軟像素級注意力,以得到行人不變性特征表示。文獻[14]提出了在卷積神經網絡中將非局部運算與二階統計量相結合的觀點,設計了一種二階非局部注意(Second-Order Non-local Attention,SONA)模型,通過非局部操作對特征映射中的位置相關性進行建模,可以將卷積操作捕獲的局部信息集成到模型中,為行人再識別任務提供了良好的判別特征。注意力機制在很多行人再識別方法中都非常有效,但是使用該方法抽取的局部特征區域缺乏語義信息,不便于理解和解釋。

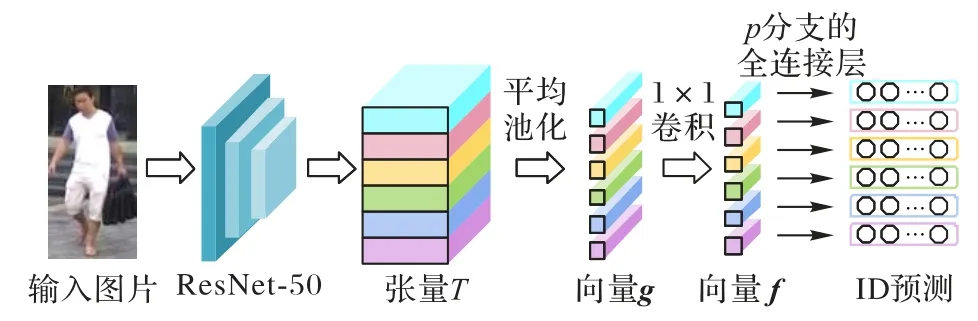

圖像特征分割是基于局部特征學習的行人再識別技術中常用的方法,該方法一般將經過深度網絡的特征映射橫向切分為幾個不重疊的預定義的條狀或塊狀區域,分別進行局部特征學習。文獻[25]提出了一種基于局部特征學習的卷積基線網絡(Part-based Convolutional Baseline,PCB)。如圖4 所示,PCB 以整幅圖像作為基線網絡ResNet-50 輸入,將所得的特征映射在卷積層上均勻劃分為p個部分,經過Softmax 多分類損失函數訓練得到p個分類器。該文獻還提出細化局部分區的池化方法(Refined Part Pooling,RPP),目的是為了重新分配每個局部區域內的離群點,加強每個局部區域內部的一致性。圖像特征分割方法一般假設不同的圖像中行人是對齊的,但這種假設顯然不符合數據集中的實際情況,基于此問題,文獻[26]提出AlignedReID 方法執行局部區域對齊。首先共同學習全局特征和局部特征,然后在學習局部特征的網絡分支中,用動態規劃求最小路徑來對齊局部特征。為了緩解行人圖像錯位而引起的離群值問題,文獻[16]使用空間金字塔池化網絡(Horizontal Pyramid Matching,HPM),在不同金字塔尺度進行全局平均池化和全局最大池化的融合操作,將最后的特征圖劃分為多個水平條,然后獨立地對不同尺度的水平條進行分類操作。還有一些文獻[17-18]也采用類似的金字塔池化方法抽取圖像的局部特征,都取得了不錯的效果。圖像特征分割作為局部特征學習的方法之一,在行人再識別的深度學習方法中取得了很好的行人檢索效果。但是該類方法增加了訓練模型的難度,降低了訓練效率。同時,很多方法沒有考慮到每個局部區域之間的漸進線索[17],從而忽略了空間上下文信息,這將嚴重影響錯位行人圖像的匹配精度。

圖4 PCB模型示意圖[25]Fig.4 Schematic diagram of PCB model[25]

單一的全局特征學習或局部特征學習都會丟失代表行人不變特性的部分信息,因此,作為行人再識別深度學習方法中的主流方法,基于特征學習的方法常以局部特征作為對全局特征的補充,兩者結合共同表示行人判別特征,這在一定程度上大大提升了行人特征的魯棒性。但是,由于行人所在的復雜環境,常使得攝像機得到的行人圖像存在遮擋問題,而這類問題會因為引入過多噪聲,嚴重影響特征學習方法的行人檢索性能。此外,實際場景中不準確的行人檢測算法也會影響特征學習方法所提取特征的魯棒性。因此,特征學習的方法需要考慮更多復雜的實際監控場景,以便提取出更能應對多種復雜環境的、更為魯棒的行人不變特征表示。

1.1.2 基于度量學習的方法

基于深度學習的度量學習方法不同于早期的距離度量方法[33-34]需要設計復雜的度量算法來衡量特征之間的相似性,度量學習以損失函數的形式藏匿于網絡結構中,測試階段中查詢集和候選集之間的相似度度量任務僅僅需要簡單的余弦距離或歐氏距離來完成。度量學習在傳統的度量距離(歐氏距離、余弦距離、馬氏距離等)的基礎上,設計出在深度網絡的可導的度量損失函數,經過大量樣本訓練來減小該損失進而優化其參數,從而達到使同類樣本距離變小、異類樣本距離變大的目的。

常見的度量學習損失函數有對比損失[35]、三元組損失[36-38]、四元組損失[39]、中心損失[40]等,其中,最為常用的是三元組損失。對比損失一般使用在Siamese網絡中,文獻[38]為了解決一些網絡難以區分正樣本和難分負樣本的問題,提出了一種使用匹配門函數的Siamese 網絡來增強局部特征的細節信息,該網絡就是通過對比損失函數進行優化的。文獻[36]第一次將三元組損失函數模型使用在圖像檢索任務中,由于行人再識別是一種特殊的圖像檢索任務,隨后就有一些工作將三元組損失使用在行人再識別任務中。為了提取能克服姿態變化、視角變化的行人特征表示,文獻[38]使用了一種多通道CNN 模型,學習行人的全局特征和局部特征,同時使用改進的三元組損失函數來進一步增強所學特征的辨別能力。由于三元組損失函數在度量學習的應用研究中,產生了很多相關變體[41-43],所以文獻[38]就對這些變體進行性能對比,然后提出自己改進的三元組損失,即難分樣本采樣損失(Triplet Loss with batch Hard mining,TriHard Loss),該方法采用難分正樣本和難分負樣本以及固定樣本組成的三元組進行三元組損失函數的計算。實驗證明,難分樣本采樣損失的性能要優于其他三元組損失的性能。文獻[39]認為,傳統的三元組損失在測試集上泛化性能較差,原因是類內間距依然很大,因此在三元組損失的基礎上提出了四元組損失。該方法以四張圖片作為輸入,引入一種在線邊緣難分樣本挖掘方法,自適應地選擇難分樣本進行網絡訓練。分類模型中單一的Softmax 損失僅僅只會將不同身份的人進行歸類,卻沒有考慮視角變化、空間錯位所引起的類內差異,因此,文獻[40]將多種損失函數結合起來,使用在一個分類模型中,來學習行人的聯合深度特征。這些損失函數包括Softmax 損失、中心損失、類內中心損失,其中,中心損失將同一行人的特征進行集中,旨在減少類內差距;類內中心損失則使不同類間的距離最大化,旨在進一步擴大類間距離。

度量學習的最終目的是縮小類內距離、增大類間距離,并在訓練階段學習行人之間的相似度度量,因此,度量學習的訓練目標與測試方式是一致的。度量學習側重于學習相似度度量,使用的是標簽的弱監督信息;特征學習則側重于學習行人不變特征,使用的是標簽的強監督信息,因此度量學習可用于大規模數據集的模型訓練。此外,度量學習方法需要在網絡訓練前隨機選擇樣本組成多元組,這一過程無疑會增加計算量,降低模型訓練效率。近幾年一些行人再識別深度學習模型已經將兩種方法融合在一起,聯合優化兩種學習任務,以獲取超越單一模型框架的性能。

1.2 無監督方法

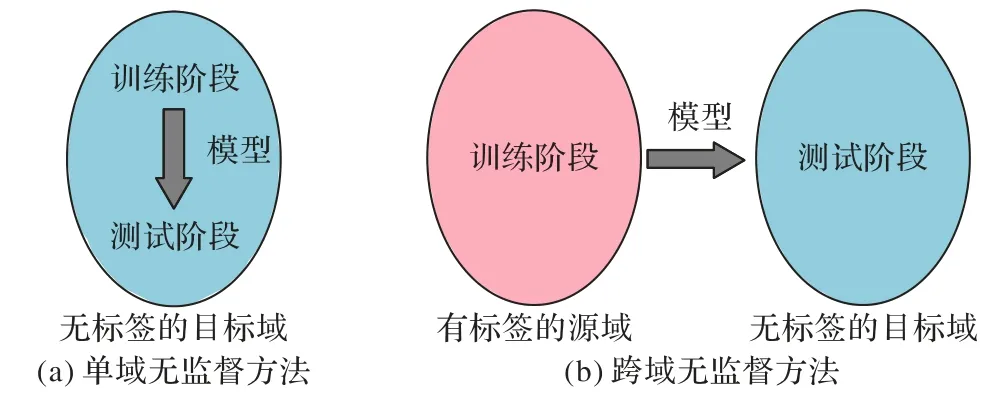

在實際的應用場景中,待檢索的目標域多為無標簽的數據,且標注工作異常困難。但是現有的深度學習行人再識別方法需要大量數據來進行有監督訓練才可以達到更好的效果。因此,為了解決目標域數據集標簽難以獲取的問題,一些無監督的行人再識別方法被提出。現有的無監督行人再識別方法可以根據是否跨域劃分為兩類(如圖5所示):1)單域無監督行人再識別方法:利用聚類[44-45]或行人軌跡片段[46-47]的方法來進行目標域上的無監督模型訓練;2)跨域無監督行人再識別方法:利用有標簽的源域數據來輔助訓練用于目標域的深度模型。這些無監督行人再識別方法由于缺乏真實有效的監督信息,因此在算法性能上和有監督方法還存在一定差距。

圖5 無監督方法示意圖Fig.5 Schematic diagram of unsupervised methods

1.2.1 單域無監督方法

單域無監督行人再識別方法大多不借助源域的輔助信息,僅僅在目標域上利用處理后的無標簽數據來訓練行人再識別模型,基于此,有些工作采用聚類的方法[44-45]進行無標簽數據的處理。文獻[44]提出了無監督的非對稱度量學習方法CAMEL(Clustering-based Asymmetric MEtric Learning),該方法旨在通過聯合學習非對稱度量和最優聚類,來學習每個攝像機圖像的特征,然后將不同攝像機的特征映射到一個共享空間中進行特征對齊,從而可以獲得更好的跨圖像匹配性能。文獻[45]提出了一種自底向上聚類(Bottom-Up Clustering,BUC)的方法將CNN 提取的特征進行聚類,最大化身份的多樣性,同時保持每個身份中的相似性,在此過程中,利用身份多樣性和相似性來學習判別特征。為了減少跨域方法中對源域的依賴,還有一些方法[46-48]利用行人軌跡片段來實現無監督行人再識別。文獻[46-47]提出的TAUDL(Tracklet Association Unsupervised Deep Learning) 和 UTAL(Unsupervised Tracklet Association Learning)可以從行人圖像中自動生成的行人軌跡片段中提取行人判別信息,即用跨攝像機的行人軌跡片段關聯學習,找到最有可能是同一個人的跨攝像機視圖軌跡片段。文獻[48]對之前行人軌跡片段的方法[46-47]進行擴展,提出無監督圖關聯(Unsupervised Graph Association,UGA)框架,其中包括單攝像機特征學習和跨攝像機特征學習。在單攝像機學習中應用多分支分類器來對每個攝像機內圖像各自進行分類,在跨攝像機學習中建立一個跨攝像機圖來關聯行人軌跡片段,從而學習行人的跨視圖不變特性。

由于單域無監督方法的模型訓練和測試在同一數據域中,沒有涉及到其他數據域,因此這類方法的系統實施過程會較為容易;但是,本就缺乏監督信息的無監督方法,在沒有借助其他輔助信息的情況下,將更難達到有監督方法的性能水平。就此而言,如何縮小單域無監督方法和有監督方法的性能差距,將會是研究者們的一個極大挑戰。

1.2.2 跨域無監督方法

目前大多數的無監督行人再識別的研究重點放在跨域無監督行人再識別,此類方法旨在如何以無監督的方式將預先訓練好的模型從源域有效地傳遞到目標域[49]。一般情況下,直接將在源域中訓練的模型應用到目標域,由于兩個域之間存在一定差異,會導致效果不理想,而無監督的跨域方法會減小這種域差異,使得源域的模型也可以有效地用于無標簽的目標域。文獻[50]提出的PUL(Progressive Unsupervised Learning)方法,使用預訓練的模型從未標記的目標域訓練集中提取圖像特征,然后使用K-means 聚類算法對這些特征聚類,再從這些類中選擇可靠的樣本對原始模型進行微調,隨后使用這個新模型來提取特征,并開始另一次迭代訓練。如此迭代學習可以使得模型最終從不可靠的聚類結果中提取出可靠的特征信息。文獻[51]提出的ARN(Adaptation and Reidentification Network)框架利用數據集之間的信息來學習域不變特性,通過域不變特性來進行跨域行人匹配。為了提高CNN 模型在源域上提取判別特征的能力,文獻[52]提出一種聚類和動態采樣(Clustering and Dynamic Sampling,CDS)方法,利用行人屬性來加強源域模型的訓練,然后對目標域樣本進行迭代聚類,動態選擇目標域中的信息樣本對源域模型進行微調(Fine-tuning)。

還有一些工作采用了無監督域適應的方法來處理跨域行人再識別任務。近年來,無監督域適應(Unsupervised Domain Adaptation,UDA)[53-54]是機器學習領域所研究的一個熱點,該類問題的任務是在有標簽的源域數據集上訓練的模型應用在另一個任務相關卻特征分布不同的目標域數據集[53]。然而,現有的無監督域自適應方法大多基于跨域類標簽相同的假設,而不同的Re-id 數據集的人身份是完全不同的。因此,許多無監督域適應方法[53-54]不能直接用于行人再識別任務。一些行人再識別的域適應方法[55-58]采用生成對抗網絡(Generative Adversarial Network,GAN)[59]來對不同數據集之間的樣本進行圖像遷移,即將源域圖像轉換為目標域圖像的樣式風格并保持人物身份不變,然后使用轉換后的圖像來訓練模型。

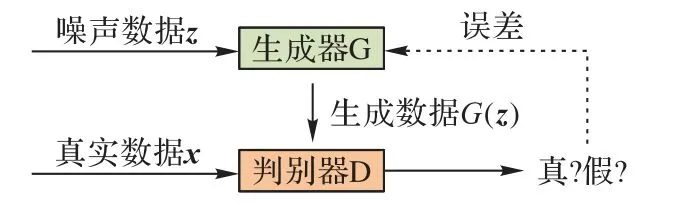

生成對抗網絡[59]是一種強大的生成式模型(如圖6 所示),其中蘊含了博弈思想:生成器以隨機噪聲為輸入生成可以以假亂真的虛假樣本來干擾鑒別器的判斷,判別模型以真實樣本和生成樣本為輸入來判斷該樣本是真是假,這兩者在各自任務的驅使下相互博弈,不斷進行迭代優化,從而達到最優的模型性能,以生成高質量的虛假樣本。文獻[55]提出了數據集之間的行人遷移模型PTGAN(Person Transfer Generative Adversarial Network),使用了與CycleGAN[60]相似的網絡結構,可以有效減小數據集之間的域差異。文獻[55]為了解決領域自適應問題只考慮了域間的攝像機差異,而文獻[56]不僅考慮了域之間的攝像機差異性,還考慮了域內不同攝像機間的差異性,其使用基于CycleGAN[60]所提出的CamStyle(Camera Style)方法來訓練兩兩相機之間的轉換模型,同時采用了標簽平滑正則化(Label Smooth Regularization,LSR),減小有噪聲的生成樣本所帶來的過擬合風險。這些使用CycleGAN[60]的跨域行人再識別方法在遷移過程中確保了相機風格改變、行人身份不變。然而,CamStyle 方法[56]使用多達28 個CycleGAN[60]模型來訓練多個攝像機對之間的樣式轉換,因此該方法復雜度高,訓練模型困難。基于此,文獻[57]提出了基于StarGAN[61]的多攝像機遷移GAN(multi-Camera Transfer GAN,CTGAN),該方法只需要訓練一個GAN 模型,就可以將源數據集中的圖像轉換為目標數據集中每個攝像機的樣式,并使用SCDA(Selective Convolutional Descriptor Aggregation)方法[62]去除背景噪聲,保留有用的深度特征。在以往基于GAN 的跨域方法中,域轉移后得到的圖像一般只具有一種或者幾種預定義的樣式,文獻[58]為了改進這一缺陷,提出了一種實例引導上下文生成圖像的方法,通過設計一個成對的條件GAN 即CRGAN(Context Rendering GAN),實現了用一個源域的行人圖像來生成具有目標域中N中背景的N張圖像,用這種方法得到的新數據集不僅有標簽信息(來自源域的行人ID 標簽),而且具有目標域中豐富的樣式信息,以此可以對無標簽的目標域實現有監督Re-id 模型訓練。GAN 技術在行人再識別領域除了可以用于跨域無監督方法之外,還可以用于單純的數據增強[63]、學習行人不變特性[64]等。

除了使用GAN 方法,文獻[65]提出了一種聯合屬性信息和身份信息的深度學習框架TJ-AIDL(Transferable Joint Attribute-Identity Deep Learning),可以同時學習全局的身份信息與局部的屬性信息,該模型可以被轉移到任何無標簽的目標域中進行行人再識別的無監督域適應任務。文獻[66]也同樣利用屬性信息來豐富行人特征,以促進實現行人再識別的無監督域適應任務。

與單域無監督方法相比,跨域無監督方法的研究涉及廣泛,且由于GAN 技術的興起,越來越多的工作更傾向于研究跨域無監督方法。在兩種無監督方法中,由于跨域方法借助了源域的輔助信息,大多數跨域方法可以取得更好的無監督算法性能,但是跨域方法過于依賴源域和目標域之間的相似性,這降低了跨域無監督模型的魯棒性。

雖然有監督的行人再識別技術在最近的研究中已經逐漸趨向于穩定,但是無監督的行人再識別技術由于缺乏有效的監督信息,其性能遠不如有監督學習的方法。為了減少對標注數據的依賴,使搭建好的行人再識別模型高效地部署在實際應用場景中,無監督技術還有待進一步的研究和發展。

圖6 生成對抗網絡結構示意圖Fig.6 Schematic diagram of generative adversarial network structure

2 視頻行人再識別

近年來,隨著數據量的增加,基于視頻的行人再識別研究越來越多。基于圖像的行人再識別方法只能從單個圖像中獲取有限的信息,并且在解決單個圖像中遮擋、姿態變化和攝像機視角等問題上效果有限。相比之下,基于視頻的行人的再識別比單個圖像包含更多的信息。由于圖像序列通常包含豐富的時間信息,因此更適合在復雜的環境和較大的幾何變化下對行人進行再識別,而且基于視頻序列的方法更符合實際監控系統中的行人再識別任務的需求,這樣會避免一些監控視頻的預處理過程。

早期的基于視頻的行人再識別技術使用一些手工設計特征的方法[67-69],雖然這些方法提取的特征可解釋性強,但卻忽略了行人視頻序列中的大量信息,使得行人檢索精度不高。最近幾年,基于深度學習的視頻行人再識別方法[70-76]被提出。文獻[70]提出了一種用于深度視頻的基本方法RCN(Recurrent Convolutional Network),其利用CNN 從連續的視頻幀中提取特征,然后利用循環神經網絡(Recurrent Neural Network,RNN)將時間序列中的上下文信息合并到每個視頻幀中,并采用最大池化或平均池化操作獲得最終的序列特征表示。文獻[71]提出一種時間注意力機制模型TAM(Temporal Attention Model)來提取表示視頻中特定行人的判別幀。此外,還采用RNN 模型SRM(Spatial Recurrent Model)從六個方向結合上下文信息,增強行人特征映射中每個行人的位置表示。文獻[72]提出了ASTPN(Attentive Spatial-Temporal Pooling Network)架構,其中引入了時間建模中的共享注意力矩陣,實現了幀選擇過程中的查詢集與候選集視頻序列之間的信息交換,在這種情況下,判別幀可以根據其注意力權重來進行行人特征對齊。文獻[73]提出了同時學習視頻內距離和視頻間距離的方法,使視頻的特征表達更加緊湊,并借此區分不同行人的視頻序列。在實際監控視頻中,常有噪聲視頻片段的干擾,導致行人再識別算法性能顯著下降,針對該問題,文獻[74]提出了一種新的基于視頻的自適應加權(Self-Paced Weighting,SPW)身份識別方法,該方法首先使用一種離群點檢測的方法來評估視頻子序列的噪聲程度,然后采用加權距離的方法對兩個不同身份的圖像序列進行距離測量。在最新的工作中,文獻[75]為了解決跨攝像機檢索任務中的視圖偏差問題,提出了一種深度非對稱度量學習(Deep Asymmetric Metric learning,DAM)方法,該方法將所提出的非對稱距離度量學習損失函數嵌入到一個雙流卷積網絡中,用于聯合學習特定視圖和特定特征的轉換,以解決基于視頻的行人再識別中的視圖偏差問題。由于該模型框架中的運動特征依賴于光流,而光流被廣泛應用于運動建模,并且需要考慮計算的成本,因此對于在線視頻處理,該方法仍然不夠有效。為了解決基于視頻的行人再識別任務中標注成本高等問題,文獻[76]首次提出并研究了行人再識別中的弱監督問題,將弱監督的行人再識別問題轉化為一個多實例多標簽(Multi-Instance Multi-Label,MIML)學習問題,開發了一種跨視圖多標簽多實例(Cross-View Multi-Instance Multi-Label,CV-MIML)學習方法,該方法能夠利用視頻片段內的類似實例來進行內部對齊,并且通過將分布原型嵌入到MIML 中來捕獲不同相機視圖之間的潛在匹配實例,最后將該方法嵌入到深度神經網絡中,形成端到端的深度跨視圖多標簽多實例學習模型。

與基于單幀圖像的人像識別方法相比,基于視頻的行人再識別方法具有更多的時空信息、運動信息和更多的外觀線索,可以在某種程度上提高匹配性能,因而受到關注。現有的許多基于圖像的方法也可以擴展到基于視頻的方法中,但由于基于視頻的方法的輸入是行人圖像序列,這將大大增加計算量,影響了計算效率。因此,在此后的行人再識別研究中,在致力于提高檢索精度的同時,也需要考慮計算成本,使一個更快更高效的行人再識別方法能更好地應用在實際視頻監控系統中,以維護社會安全穩定。

3 跨模態行人再識別

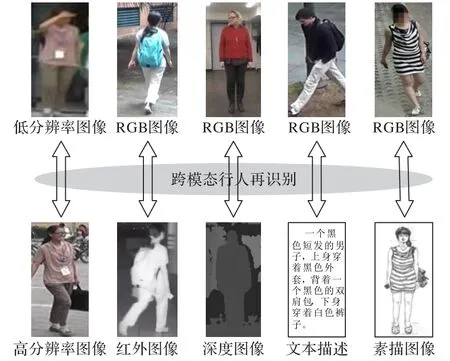

現有的大多數行人再識別方法的處理數據都集中在可見光相機采集的同一類型數據上,并將行人再識別任務作為一個單模態數據匹配問題。然而,在實際生活應用中,僅用可見光相機采集的單模態行人數據會出現畫質模糊、分辨率低、光照變化大等問題,這將影響可見光相機捕捉的行人圖像的質量,導致實際應用中檢索精度不高。為了克服實際情況中復雜多變的環境對行人檢索精度的影響,引入了多模態行人數據(如圖7 所示),包括常見的可見光相機采集的RGB 圖像、低/高分辨率圖像[77-78]、紅外(Infra-Red,IR)圖像[79-80]、深度圖像[81]、文本描述[82]、素描圖像[83]。文獻[77]針對跨分辨率的行人圖像匹配問題提出了SING(Super-resolution and Identity joiNt learninG)方法,通過增強低分辨率圖像中的有效局部信息,從而解決了跨分辨率行人匹配中的信息量差異問題。文獻[78]提出對比中心損失(Contrastive Center Loss,CCL)方法,使深度模型在不受分辨率差異影響的情況下,從不同分辨率的圖像中學習行人特征。針對紅外圖像數據和可見光圖像數據的跨模態行人再識別,文獻[79]提出端到端對齊生成對抗網絡AlignGAN,其可以聯合利用像素對齊和特征對齊,緩解跨模態數據的變化,學習跨模態行人圖像的不變特征。文獻[80]提出一種雙級差異減小方法D2RL(Dual-level Discrepancy Reduction Learning),將不同模態的圖像紅外圖像和RGB 圖像轉換為統一模態以減小模態差異,再通過減小特征差異來處理外觀上的不同。對于行人深度圖像,文獻[81]利用深度圖像和RGB 圖像之間的內在聯系,采用一個深度跨模態網絡將特征表示進行跨模態轉移,以便從兩種模態的數據中提取出相似的行人特征。針對文本描述和行人圖像的匹配的問題,文獻[82]提出一種基于身份感知的兩階段深度學習框架。該框架在第一階段有效地篩選出容易出現的錯誤匹配,作為第二階段網絡訓練的起點,在第二階段使用聯合注意力機制的CNN-LSTM 結構共同優化匹配結果。考慮到在實際情況下,圖像數據并不是隨時都可以獲得,文獻[83]提出了素描行人再識別模型,并創建了素描行人再識別數據集。對于該模型,文獻中提出了一種深度對抗學習架構,用來共同學習行人判別特征和域不變特征。

圖7 跨模態行人再識別Fig.7 Cross-modal person re-identification

行人再識別技術作為當今社會維護公共生命財產安全的重要科技手段之一,應當涉及到監控系統中各種模態數據,并形成一套完善的多模態行人再識別體系,以更好地保障社會的安全穩定。跨模態行人再識別涉及到兩種及兩種以上類型的行人數據,這給行人匹配帶來了一定的難度,但同時也豐富了行人的模態信息,更加貼合實際監控情況。相較于單模態行人再識別,跨模態行人再識別的研究起步較晚,技術發展不夠成熟,因此如何將多模態的行人信息整合起來進行行人匹配,將是以后基于深度學習行人再識別技術的一個研究重點和難點。

4 常用數據集

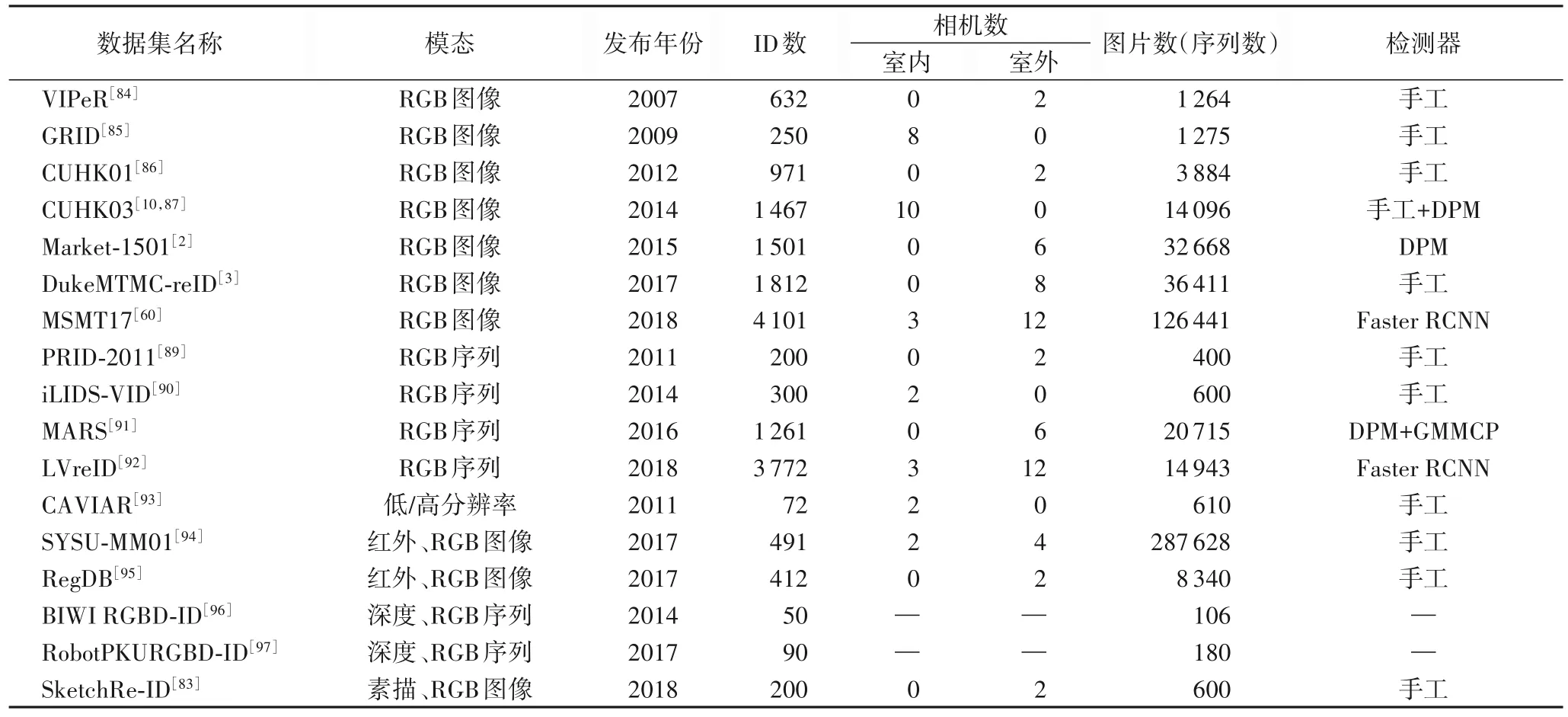

深度學習技術的研究需要依賴大量數據來訓練模型,數據樣本越多、采集環境越貼近實際情況,越有利于開發強魯棒性的行人再識別模型。自從行人再識別任務被提出以來,許多用于該研究領域的數據集也相繼被公布,這些數據集的規模、模態、檢測方法也不盡相同。根據數據類型不同,現有的行人再識別數據集可以分為單幀圖片數據集、視頻序列數據集、多模態數據集。對于這三類中一些常見的數據集,本文做了簡單的對比總結,具體見表1所示。

表1 行人再識別數據集Tab.1 Datasets of person re-identification

現在大部分行人再識別技術都是基于單幀RGB 圖像進行實驗研究的,因此已發布的該類數據集較多,其規模、環境復雜度也相對較大。較早發布的數據集,如:VIPeR[84]、GRID[85]、CUHK01[86]等不僅人物數量少、圖片數少,且大都用手工標注的方法檢測行人。隨著深度學習的發展,小規模數據已經無法滿足深度學習模型的訓練要求,于是提出了CUHK03[10,87]、Market-1501[2]等大規模數據集,且采用了自動檢測提取行人的方法DPM(Deformable Part Model),降低了數據采集的難度。2018年公布的MSMT17[60]數據集采用了更加先進、準確的目標檢測方法Faster RCNN[88]對更多行人進行圖像數據采集,其包含了更豐富的場景信息,更加接近實際情況,因此對行人再識別算法的魯棒性要求也更高。

基于視頻的行人再識別數據集比較常見的有PRID-2011[89]、iLIDS-VID[90]、MARS[91],這些數據集包含的人數分別是200、300、1 261,所有視頻的平均序列長度分別為100幀、73幀、58幀。其中,MARS是包含人數、視頻序列數、相機數最多的數據集,且采用了較為先進的自動檢測方法DPM+GMMCP(Generalized Maximum Multi Clique Problem),但是該數據集平均序列長度短、相機場景單一,不夠接近真實的復雜場景。2018 年發布了現有規模最大的視頻數據集LVreID[92],其包含了3個室內相機和12個室外相機,共有3 772人的14 943個視頻序列,且平均序列長度為200 幀,這意味著可以在長序列視頻片段中捕捉到更豐富的行人信息。LVreID 使用更快、更精確的檢測算法Faster RCNN[88]進行包圍框檢測,生成了更高質量的行人視頻序列數據。

由于對多模態的研究工作較少,因此不同類型的跨模態數據集也相應較少。CAVIAR[93]是2011 年提出的唯一一個用于跨分辨率行人再識別研究的真實數據集,其中所涵蓋的圖像分辨率在17×39~72×144不等。后來對跨分辨率行人再識別的研究[77-78]所使用的數據集都是從VIPeR[84]、CUHK03[87]、Market-1501[2]等現有的數據集中創建的虛擬數據集,其規模大小都與這些現有的數據集相同。SYSU-MM01[94]是2017年發布的可見光-紅外跨模態行人數據集,其包含6個攝像頭拍攝的圖像,包括2個在戶外黑暗環境下工作紅外攝像機和4個白天工作的可見光攝像機,可見光攝像機又包含2個戶內場景和2個戶外場景。另一個同年發布的紅外數據集RegDB[95]含412人,其中每個人有10張來自可見光攝像機的圖像和10張來自紅外攝像機的圖像。深度圖像是表示場景中每個點與攝像機之間的距離的圖像,可以包含行人的外觀、骨架結構等信息。BIWI RGBDID[96]是由RGB-D攝像機采集的可用于行人再識別研究的深度圖像數據集,其包含50個訓練集序列和56個測試集序列,共有50個行人。該數據集包括RGB圖像、行人分割圖、深度圖像和骨架結構信息。RobotPKURGBD-ID[97]是使用Microsoft Kinect SDK 與Kinect 傳感器一起收集的深度圖像行人數據集,包含180個90人的視頻序列。該數據集同樣由RGB圖像、行人分割圖、深度圖像和骨架結構信息組成。SketchRe-ID[83]是2018 年發布的一個行人素描數據集,其包括200個行人,每個行人有一張來自素描畫家的素描圖像和兩張來自不同可見光攝像機的RGB圖像。目前進行素描行人再識別的研究較少,因此這是現有的唯一一個用于素描行人再識別研究的數據集。行人再識別數據集隨著深度學習技術的發展,其規模越來越大,所包含的攝像機數也越來越多,也更能代表實際監控系統的復雜場景,但數據集的發展不能僅僅止步于此。首先,深度學習技術日益更新,模型也日益復雜,所需要的訓練數據量也更加龐大,因此,創建規模更大的數據集來輔助模型的研究和訓練是深度學習技術的發展要求,也是必要條件;其次,實際監控系統的環境千變萬化,數據模態也多種多樣,應用場景也不盡相同,但現有的數據集并不能很好地代表生活中的復雜環境。因此,需要對輔助行人再識別技術發展的數據集有所創新,使之盡可能地包括更多攝像機場景,以便于后續能開發出一套適用于各種實際復雜場景的完備智能監控系統。

5 算法性能比較

由于跨模態方法所涉及的數據集種類較多,而且跨模態方法相對較少,因此本文僅對基于RGB 圖像的行人再識別方法進行了性能比較,其中包括用于單幀圖像數據的方法比較和用于視頻數據的方法比較。

5.1 用于單幀圖像的方法

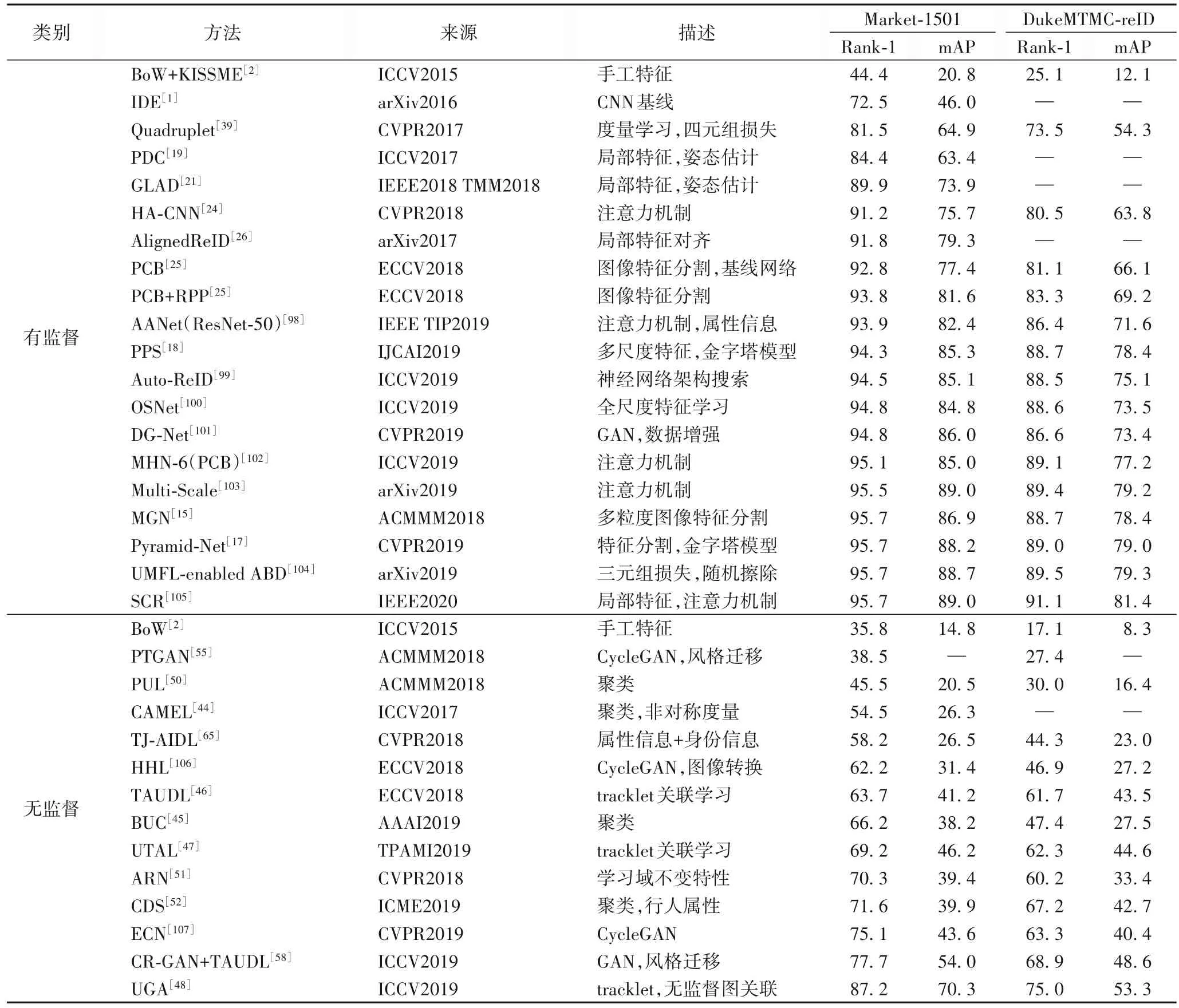

表2 所示為近幾年的一些基于圖像的行人再識別方法比較,所涉及的測試數據集是Market-1501[2]和DukeMTMCreID[3],所使用的準確度評估方法是Rank-1 和mAP(mean Average Precision)。Rank-1 表示所有查詢圖片所匹配的第一張圖像的平均準確率,mAP 表示所有查詢圖片的每個查詢圖片與候選集匹配的平均精度求和再取平均的值。表中前20項數據是有監督的方法性能比較,其中除了前文介紹方法外,還增加了其他文獻中的一些方法來進行性能比較,包括:IDE(ID-disciminative Embedding)[1]、BoW(Bag-of-Words)+KISSME(Keep It Simple and Straightforward MEtric)[2]、Pyramid-Net[17]、PPS (Part Power Set)[18]、AANet (Attribute Attention Network)[98]、Auto-ReID[99]、OSNet(Omni-Scale Network)[100]、DG-Net(Discriminative and Generative Network)[101]、MHN(Mixed High-order attention Network)[102]、Multi-Scale[103]、UMFL(Unified Multifaceted Feature Learning) -enabled ABD(Attentive But Diverse)[104]、SCR(Spatial and Channel partition Representation network)[105]。后15 項數據是無監督的方法性能比較,其中除了前文介紹方法外,也增加了其他文獻中的一些方法,包括:BoW(Bag-of-Words)[2]、HHL(Hetero-Homogeneous Learning)[106]、ECN(E:Exemplar-invariance.C:Camera-invariance.N:Neighborhood-invariance)[107]。

表2 圖像行人再識別方法性能比較 單位:%Tab.2 Performance comparison of image-based person re-identification methods unit:%

在有監督的方法中,2016年以來日漸崛起的深度學習方法使行人再識別方法發展到了一個新的高度,直至2019 年,在Market-1501數據集上的Rank-1最高已達到95.7%,2020年最新的方法[105]在DukeMTMC-reID 數據集上的Rank-1 也已達到90%以上,其中最優秀的幾個方法大都采用局部特征學習的方法來學習跨攝像機行人的不變特性。然而在局部特征學習的方法中,注意力機制和圖像特征分割的方法是近兩年來使用較多效果較好的方法,在這些方法的模型中,也會結合使用驗證損失或分類損失,使模型的復雜度上升,使算法的性能更優。行人局部特征作為全局特征的輔助信息,可以在很大程度上提高行人檢索精度,因此,在以后的行人再識別研究中,如何獲取更魯棒、更具判別能力的行人局部特征將是一個重要的研究思路。

在無監督的方法中,GAN 在近兩年受到極大歡迎,使用該方法可以從目標域到源域進行圖像風格遷移,生成具有目標域相機風格的行人圖片,從而減小不同數據域之間的差距。GAN 技術的發展使得無監督行人再識別技術有了極大的突破。除此之外,行人軌跡片段(tracklet)的方法也推動了無監督行人再識別技術的發展,表2 中所示的最好的方法UGA[48]所使用的就是該類方法,在Market-1501和DukeMTMC-reID的Rank-1 已分別達到87.2%和75.0%,已經可以媲美一些有監督深度學習方法。相較于有監督的行再識別技術,無監督方法的研究難度大,但實用性更強,因此無監督行人再識別技術還有很大的發展空間。

5.2 用于視頻的方法

表3 所示的是近幾年基于視頻序列的方法性能比較,所涉及的視頻數據集是PRID-2011[89]和iLIDS-VID[90],所使用的準確度評估方法是Rank-1 和Rank-5。Rank-1 表示所有查詢序列所匹配的第一段序列的平均準確率,Rank-5 表示所有查詢序列所匹配的前五段序列的平均準確率。表中共有13 項數據,除了前文所提到的一些方法外,也增加了其他文獻中的一些方法,包括:TDL(Top-push Distance Learning)[108]、GAN+Keypoint[109]、QAN(Quality Aware Network)[110]、STMP(Spatial and Temporal Mutual Promotion)[111]、CSA(Competitive Snippetsimilarity Aggregation)[112]、M3D (Multi-scale 3D deep convolutional neural network)[113]、GLTR(Global-Local Temporal Representations)[114]。

表3 視頻行人再識別方法性能比較 單位:%Tab.3 Performance comparison of video-based person re-identification methods unit:%

由表3 可以看出,深度學習的方法遠遠領先于傳統手工特征的方法。神經網絡模型可以同時從視頻序列中提取空間信息和時間信息,并以各種各樣的損失函數作為度量手段,實現了高效的跨攝像機追蹤方法。2019 年出現的M3D[113]和GLTR[114]方法在PRID-2011 和iLIDS-VID 的Rank-5 均達到了100.0%,這些突破令人驚嘆,但同時也提高了技術研究難度,后續的研究將需要在規模更大、場景更復雜、更符合實際情況的數據集中尋找突破,但是更大規模的視頻數據也意味著需要更多的計算量,這將對硬件設備有了更高的要求。此外,如何把視頻行人再識別部署到一個完整的跨攝像機追蹤系統,也將是未來行人再識別研究的一個重要部分。

6 總結與展望

行人再識別任務自提出以來一直是計算機視覺領域的研究熱點,其對于維護社會安全穩定具有重大意義。該技術發展至今,雖然已在現有的數據集上達到了很好的性能,但是行人再識別技術在很多方面還存在一些問題,對于未來在該領域的研究,本文展開以下幾個方面的討論:

1)姿態變化、視角變化。由于行人再識別任務的特殊性,不同攝像機下的行人姿態變換和相機視角變化一直以來都是該任務的研究重點。最近的方法大都采用局部特征學習的方法來解決這一問題,利用局部特征和全局特征的互補性,學習更魯棒的行人不變特征表示。未來研究將需要解決更多相機視角、更為復雜場景下的姿態變化、視角變化,因此如何克服這些變換學習到強大的行人不變性特征將有待進一步研究。

2)行人遮擋。遮擋類問題不僅是行人再識別研究中一大難點,也是其他計算機視覺任務(如:人臉識別、行人檢測等)中的難點。被遮擋的行人由于丟失大量信息而導致提取特征不完整從而影響再識別效果。但是目前對于遮擋行人再識別的研究較少,如果此遮擋問題在行人再識別中有了更進一步的研究,那對整體行人再識別技術的發展都會有一個更大的推動。

3)不準確的行人檢測框。在進行行人再識別之前,需要將行人從監控視頻中檢測出來,這將依賴于行人檢測算法的準確度。但是在復雜的真實場景中,總會出現一些行人檢測偏差,這會嚴重影響后續的行人檢索精度。對于此類問題,文獻[26]提出了局部特征對齊的方法,使相對應的局部特征進行對齊,提高匹配準確率,這種方法也可以解決行人遮擋類問題;但是,若將檢測任務和再識別任務集成到一個統一的框架中,是否也是此類問題的一個解決思路,這將有待研究。

4)規模更大的數據集。深度學習依賴于大量數據進行模型訓練,且一個規模大、周期長、場景多、環境復雜的數據集更符合實際情況。現有的行人再識別數據集還存在一定的局限性,為了將所研究的行人再識別技術更好地應用于實際監控系統中,需要創建規模更大的數據集來輔助行人再識別技術研究。雖然GAN 技術可以對目前的數據集進行一定程度上的擴充,但是由于GAN 生成的圖像質量不高,無法真正代替真實的圖片數據,因此創建規模更大的真實數據集也是一個待解決的任務。

5)無監督方法。數據標注問題是實際研究中難以避免的問題,一般的有監督方法需要依賴標注好的信息來監督深度模型的訓練,但數據標注工作將花費大量財力物力,因此標注工作異常困難。針對此類問題,一些無監督方法被提出,此類方法不需要目標域有標注信息,而是借助聚類、軌跡片段、無監督域適應等方法實現無標注目標域上的行人再識別技術。由于缺乏監督信息,因此無監督方法與有監督方法還存在一定差距,其在現有數據集上的準確率也有待提高。

6)跨模態行人再識別。單一的RGB 模態的圖像數據很容易受到光照等因素的影響,且不同相機采集的圖像分辨率也不同,因此單一模態的行人圖像數據將限制行人再識別精度的進一步提高。跨模態行人再識別技術由于引入多模態數據,更加符合實際生活中智能監控系統的設備多樣性。但是該類技術的研究還不完善,算法性能有待提高。因此,利用深度學習技術來捕捉不同模態數據之間行人不變特征將是一個更具挑戰性的問題。

7)跨攝像機追蹤系統的設計與開發。行人再識別獨立于單攝像機下的行人檢測、行人追蹤等技術,是智能監控系統研究的一個分支。將這三項技術結合起來,才能實現一個完整的跨攝像機追蹤系統。未來的研究需要將這三者有效結合,實現一個完備且高效的視頻監控系統。