基于光譜降維與Hu矩的壁畫顏料層脫落區域提取方法

曹鵬輝,呂書強,汪萬福,高振華,侯妙樂

基于光譜降維與Hu矩的壁畫顏料層脫落區域提取方法

曹鵬輝1,2,呂書強1,2,汪萬福3,高振華1,4,侯妙樂1,2

(1. 北京建筑大學測繪與城市空間信息學院,北京 100044;2. 北京市建筑遺產精細重構與健康監測重點實驗室,北京 100044;3. 敦煌研究院,甘肅 敦煌 736200;4. 山西省考古研究院,山西 太原 030000)

顏料層脫落區域的提取是壁畫現狀調查的重要環節,由于其光譜特征與壁畫白色圖案較為相似,僅利用光譜特征提取的精度較低。因此,提出了一種兼顧光譜特征和Hu矩形狀特征的顏料層脫落區域提取方法。首先,利用壁畫高光譜圖像的光譜信息,經光譜降維,采用支持向量機監督分類法提取顏料層脫落區域與白色圖案。然后,對顏料層脫落區域與白色圖案分類結果分別進行連通,將連通后的圖斑視為最小識別對象,利用Hu矩計算每一個對象的形狀特征,采用支持向量機二分類再次區分對象圖斑,實現顏料層脫落區域的半自動提取。最后,以青海省瞿曇寺壁畫高光譜圖像進行了提取。結果表明,該方法能提高顏料層脫落區域的提取精度,為壁畫的現狀調查提供支撐。

顏料層脫落;病害提取;壁畫;高光譜成像;Hu矩;支持向量機;最小噪聲分離

壁畫是中國傳統的繪畫形式之一,其色彩瑰麗,內容豐富,具有重要的歷史、科學和藝術價值[1]。由于長期受到自然和人為等因素影響,很多壁畫出現了褪色、起甲、顏料層脫落等病害,存世現狀堪憂。顏料層脫落是指壁畫的顏料層脫離其底色層或地仗層的現象,屬于危害較大的病害類別[2]。為了對壁畫進行科學保護、制定合理的永續留存方案,病害提取是必不可少的工作之一。對壁畫病害的自動高效識別與提取是保護修復的基礎,綜合利用現代科學技術進行壁畫病害識別與提取已成為研究熱點。

近年來,許多學者對壁畫病害的提取和識別方法進行了系列研究。李彩艷等[3]提出了一種壁畫泥斑的自動標定算法,通過分析泥斑的空間特征,實現對唐墓室壁畫泥斑病害的識別。曹建芳等[4]提出一種基于壁畫圖像的顏料脫落病害自動標定方法,利用脫落區域的顏色特征和區域生長算法,實現了開化寺壁畫脫落病害的自動標定。劉建明[5]利用小波局部二值模式的紋理提取算子實現壁畫霉菌、皰疹、酥堿等病害的識別。上述方法主要使用數字圖像進行病害識別與提取,依據壁畫表面的顏色、粗糙度、光滑度等色調紋理特征,尚未用到病害光譜特征。隨著高光譜成像的發展,其覆蓋波長寬,光譜分辨率高,光譜連續[6],對文物表面顏料層具有較高的透射性,且檢測手段無損,已逐漸應用于文物表面相關信息的提取與分析[7-9]。如孫美君等[10]針對不同起甲病害程度的壁畫高光譜圖像,分析光譜特征,利用最小二乘回歸實現了壁畫起甲病害的風險評估。周霄等[11]采用平均光譜反射率和特征峰位置作為分類標準,對云崗石窟砂巖的粉狀風化病害進行了評估。LI等[12]利用主成分分析和稀疏自編碼器提取光譜特征,用點排序識別聚類結構(ordering points to identify the clustering structure,OPTICS)密度聚類算法實現光譜特征聚類,實現了對敦煌壁畫起甲病害的評估。上述方法主要利用病害的光譜特征進行分析與提取,忽略了高光譜圖像提供的病害的空間特征,而且專門針對顏料脫落病害提取的研究較少。

顏料層脫落后的底色層與壁畫中白色圖案的主要成分均為鈣化物,兩者的顏色相近、光譜特征相似,很難區分。因此,本文提出一種兼顧壁畫高光譜圖像光譜特征與形狀特征的壁畫脫落區域提取方法,利用高光譜圖像提供的光譜特征,采用支持向量機(support vector machine, SVM)進行監督分類,實現顏料層脫落病害、白色圖案與壁畫其他圖案的區分。然后,基于顏料層脫落區域與白色圖案區域邊緣形狀特征差異較大的特點,提取兩者圖斑的Hu矩形狀特征,再次利用SVM依據形狀特征區分顏料層脫落圖斑與白色圖案圖斑,實現顏料層脫落區域的提取。該方法可以提高壁畫脫落病害分類精度,提高壁畫病害提取的效率,為其他類別壁畫病害多特征計算機提取提供借鑒。

1 研究對象與數據預處理

1.1 研究對象

本文高光譜數據采集自瞿曇寺壁畫,瞿曇寺位于青海省海東市樂都區,始建于明代,壁畫多繪于明清兩代,具有較高的研究價值,寺內原有壁畫廊78間,總面積超過300 m2[13]。目前,由于存世久遠,壁畫存在較嚴重病害。本文選擇瞿曇寺西回廊部分壁畫進行顏料層脫落病害提取,為壁畫的保護修復提供輔助參考。

1.2 數據獲取與預處理

1.2.1 數據獲取

高光譜圖像采用VNIR400H型高光譜成像儀進行數據采集,主要參數見表1。

表1 VNIR400H高光譜成像儀參數

數據于2018年8月28日下午采集,現場采用鹵素燈作為光源。成像儀距壁畫109 cm,光圈4.0,曝光時間80 ms。研究區域壁畫正射影像如圖1所示。選擇圖中紅色矩形所標識高光譜圖像進行顏料層脫落病害提取。

圖1 瞿曇寺西回廊部分壁畫正射影像

1.2.2 預處理

高光譜成像儀獲取目標物的輻射亮度,其中包括目標物本身的輻射信息和噪聲,由于地面高光譜成像儀在測量時距離目標物距離較近,大氣對輻射亮度影響較小,因此在高光譜數據輻射校正時只需對原始數據進行反射率重建[14],即

其中,為重建后的高光譜反射率圖像;為高光譜原始圖像數據,即輻射亮度;為同等條件下的標準反射板圖像數據;為暗電流噪聲數據,本文使用反射率為99%的標準反射板,采集環境與真實數據采集環境相同。在獲取暗電流數據時,關閉人工光源,蓋上鏡頭蓋。

觀察高光譜反射率圖像發現,處于波長兩端的波段數據噪聲較大,為降低噪聲對數據的影響,對高光譜反射率圖像進行了波段選擇,人工選擇了第51-990波段作為研究數據。

2 研究方法

2.1 壁畫不同畫面特征分析

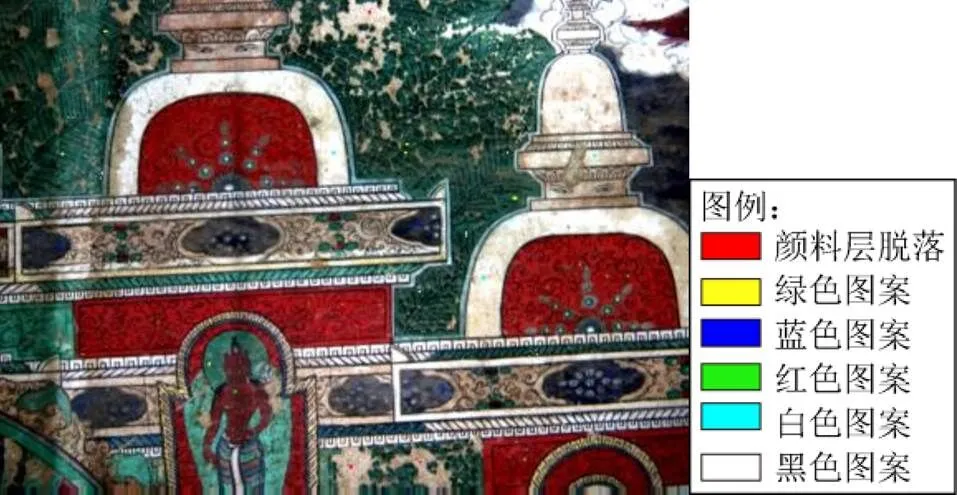

瞿曇寺回廊壁畫繪制于明代,描繪了釋迦牟尼從降生到圓寂的全過程,其色彩豐富,包括綠色、藍色、紅色、白色和黑色等圖案[13]。為了研究不同顏色區域和顏料層脫落區域的差異,提高病害提取的精度,對不同顏色區域和顏料層脫落區域的光譜特征進行分析。首先采用最小噪聲分離(minimum noise fraction, MNF)正逆變換,降低高光譜反射率圖像中的噪聲。然后,在圖2的高光譜圖像中對不同顏色圖案進行取樣,每類顏色圖案分別取多個塊狀區域,對其分別進行平均得到對應顏色圖案的光譜曲線,如圖3所示。

圖2 不同顏色圖案樣本

圖3 不同類別樣本平均反射光譜曲線

由圖3可知,不同顏色區域的反射光譜在可見光波段與其所呈現顏色一致,在近紅外波段也具有較為明顯的差異。而顏料層脫落區域與白色圖案的視覺顏色都為白色,其光譜曲線形狀相似,僅存在整體反射強度上的差異。而顏料層脫落區域與其他顏色圖案的反射光譜則存在明顯差異。為定量分析其光譜的相似度,計算了顏料層脫落區域與其他顏色圖案光譜的相關系數和光譜角余弦。若2條光譜曲線相似,其光譜角余弦值與相關系數的絕對值趨近于1,結果見表2。

表2 顏料層脫落與其他顏色圖案光譜相似度

由表2可知,顏料層脫落區域與白色圖案的光譜角余弦和相關系數的絕對值均接近1,其值明顯高于顏料層脫落區域與其他顏色圖案的相應值。從上述壁畫不同區域光譜特征的分析可知,顏料層脫落區域光譜曲線與白色圖案的光譜曲線相似性高,與其他顏色圖案相似性低。因此,利用400~1 000 nm的光譜特征可以將顏料層脫落區域與壁畫其他顏色進行區分,而較難對顏料層脫落區域和白色圖案區域進行區分。

雖然顏料層脫落區域和白色圖案很難利用光譜特征進行區分,但通過對壁畫白色圖案與顏料層脫落區域比較發現,白色圖案區域為人工繪制,其形狀一般較為規則,邊緣較為光滑。而顏料層脫落區域為自然形成,其形狀一般不規則,邊緣不光滑。兩者形狀特征相差較大,有可能利用形狀特征對其進行區分。

2.2 光譜形狀特征結合的顏料層脫落提取

針對顏料層脫落區域和白色圖案光譜相似,難以區分的問題,本文提出一種兼顧光譜和形狀特征的顏料層脫落區域提取方法,其過程如圖4所示。

(1) 預處理:包括對獲取的高光譜圖像進行反射率校正,對生成的反射率圖像進行MNF變換,選擇信噪比最高的前個成分。

(2) 光譜特征首次分類:利用高光譜反射率圖像合成一景真彩色圖像,人工選擇各顏色圖案和顏料層脫落區域樣本,利用SVM對選擇的前個MNF成分進行分類,其依據的主要是高光譜圖像的光譜信息。然后將顏料層脫落區域和白色圖案之外的其他類別合并成一類,將壁畫光譜圖像分類為顏料層脫落區域、白色圖案和其他類別3種。

(3) 形狀特征再次區分:分別對顏料層脫落區域和白色圖案進行連通區域標記,生成對象圖斑。利用Hu矩提取每個對象圖斑的形狀特征,分別隨機選擇顏料層脫落和白色圖案各10%的對象圖斑作為樣本,人工標定其所屬類別。然后基于對象圖斑的Hu矩形狀特征,采用SVM對所有對象圖斑重新進行二分類,最終生成顏料層脫落病害分布圖。

圖4 光譜與形狀結合的顏料層脫落區域提取過程

2.3 特征提取方法

2.3.1 MNF變換

MNF變換是高光譜圖像常見的降維方法,該方法可以將數據里的噪聲與信息分離[15],減小噪聲對于后續運算的影響。

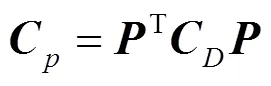

首先,對高光譜圖像進行處理獲得噪聲協方差矩陣并生成其對角化矩陣,即

其中,為噪聲的協方差矩陣;為的特征值按降序排列的對角矩陣;為特征值對應的特征向量組成。對式(2)進行變換可得

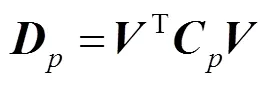

其次,對噪聲數據進行標準的主成分變化,即

其中,為高光譜反射率圖像的協方差矩陣;為經過變換后的矩陣,對進行對角化,可得

其中,為的特征值按降序排列的對角矩陣;為特征值對應的特征向量組成。結合以上變化,根據公式=可得MNF的變換矩陣。

2.3.2 Hu不變矩特征提取

Hu矩是一種可以描述物體形狀的特征[16],目前已應用在圖像識別等領域[17-18]。本文對象圖斑為二值圖像,對于任意對象圖斑(,),其()階原點矩和()階中心矩分別為

由式(8)可知,經過歸一化后的中心矩具有平移和縮放的不變性。為消除旋轉帶來的影響,Hu于1962年利用代數不變矩理論構造出7個不變矩,即

經過證明,Hu構造的7個矩具有平移、縮放、旋轉不變性[19]。本文利用式(9)計算每一個對象圖斑的7個Hu矩,形成一組描述對象圖斑形狀的特征向量,將其作為SVM分類器的輸入,從而對每一個對象圖斑進行識別。

2.4 分類方法

利用SVM分類通過構建最優分類平面,實現對不同樣本的劃分[20],可以有效解決樣本線性不可分和高維問題,尤其適合于解決二分類問題。

當()<0時,該對應的=-1;當()>0時,該對應的=1。

為解決高維空間分類問題,將核函數引入SVM分類器中,得到分類器的最終決策方程為

其中,a,b為常數;(,)為核函數,文中選擇多項式核函數。

3 結果與分析

3.1 光譜特征分類

對高光譜反射率圖像進行MNF變換,將結果按信噪比由高到低排列,其特征值分布如圖5所示。圖中第10成分的特征值已經衰減非常低,因此選擇特征值較高的前10個成分。圖6是利用高光譜反射率圖像合成的彩色圖像,在圖示位置選擇塊狀區域,作為顏料層脫落區域和其他各顏色圖案的監督分類樣本。然后利用SVM分類器對MNF變換后的前10成分數據進行分類,SVM核函數選擇為多項式核函數,其分類結果如圖7所示。

圖5 MNF特征值

圖6 顏料層脫落與各顏色區域樣本

圖7 光譜特征分類結果

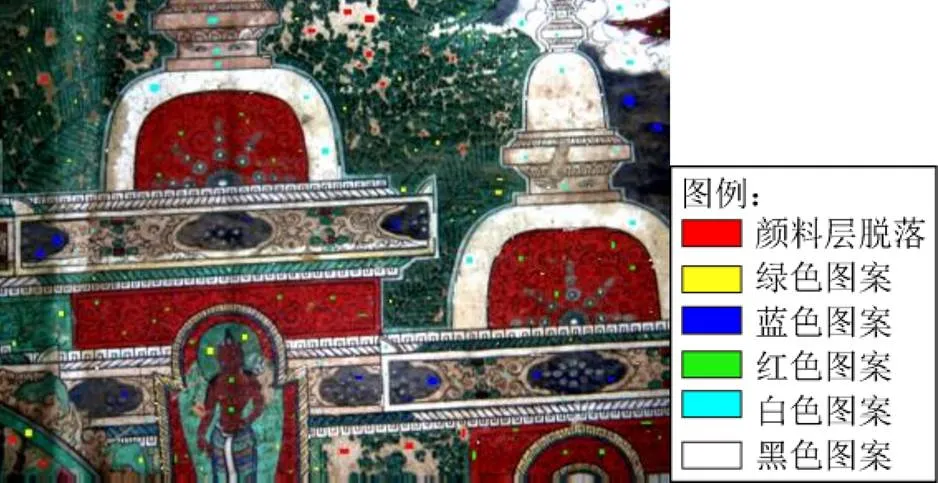

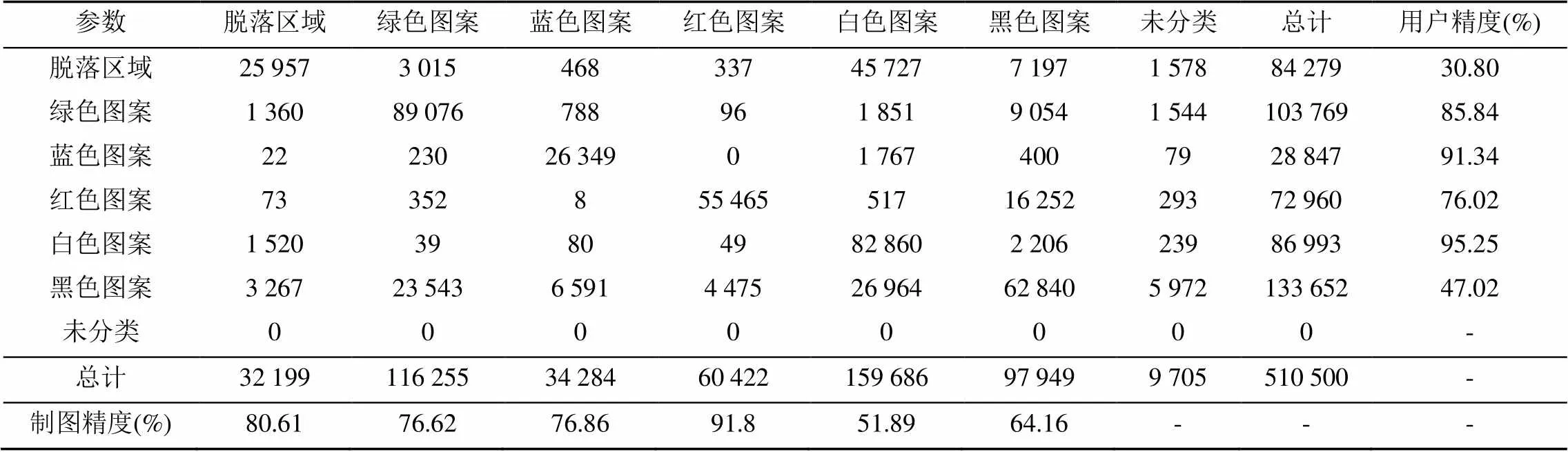

為了檢驗分類的精度,在圖8所示區域選擇了檢驗數據,人工識別類別并進行標識,對一些邊緣部分難以辨認的歸為未分類。利用其對光譜特征分類的結果進行了混淆矩陣計算,其結果見表3。

圖8 各顏色區域和脫落病害區域驗證樣本

混淆矩陣中的總體分類精度、制圖精度、用戶精度和Kappa系數是評價分類結果的常用指標[21]。

總體分類精度是指分類正確的像元占像元總數的比例,即

制圖精度是指本類像元劃分至本類的比例,即

用戶精度是指分類結果中確實屬于本類的像元所占比例,即

Kappa系數描述了分類結果與真值的吻合度,即

其中,pa,ua,分別為總體分類精度、制圖精度、用戶精度和Kappa系數;a為混淆矩陣中對應的行、列的像元個數;為總行(列)數;為像元總數。

根據表3可計算光譜特征SVM分類的總體分類精度為67.10%,Kappa系數為0.60。觀察各顏色區域的用戶精度,發現綠色圖案、藍色圖案、紅色圖案、白色圖案的用戶精度較好,均達到75%以上。由于黑色圖案樣本獲取較為困難,所以導致其用戶精度僅為47.02%。顏料層脫落區域共計提取84 279個像元,其中僅有25 957個像元屬于顏料層脫落區域,導致用戶精度僅為30.80%。主要錯誤集中在白色圖案,顏料層脫落區域提取的像元中有45 727個像元屬于白色圖案,影響了顏料層脫落區域的用戶精度。

表3 光譜特征分類精度

3.2 形狀特征區分

為了提高顏料層脫落區域的提取精度,利用MATLAB中的bwlabel函數按八連通方式分別對顏料層脫落區域和白色圖案進行處理,生成對象圖斑。顏料層脫落圖斑共計生成437個,白色圖案圖斑共計生成280個。根據式(9)計算出每個對象圖斑的7個Hu矩。利用SVM將所有對象圖斑進行二分類。核函數選擇多項式核函數,利用MATLB中的ClassifitionLearner工具箱自動選擇最優參數,采用5折交叉驗證獲取最佳模型,結果如圖9所示。圖中紅色為顏料層脫落區域,綠色為白色圖案。驗證樣本依據圖8進行合并,保留顏料層脫落區域和白色圖案類別,將其他類別進行合并,命名為其他圖案。顏料層脫落區域提取精度見表4。

圖9 顏料層脫落區域提取結果

表4 顏料層脫落區域提取精度

由表4可計算,經提取Hu矩利用SVM進行二次區分后,分類總體精度為86.25%,Kappa系數為0.73。顏料層脫落區域用戶精度為55.55%,制圖精度為65.75%。白色圖案用戶精度為95.25%,制圖精度為72.47%。

保留表3中顏料層脫落區域和白色圖案,其余類別合并為其他圖案,獲得光譜特征顏料層脫落區域提取精度,見表5。

由表5可計算,總體分類精度為80.75%,Kappa系數為0.63。因此,經Hu矩二次區分后,總體分類精度提高了5.50%,Kappa系數提高了0.10。與僅使用光譜特征進行分類結果相比,利用Hu矩二次區分的顏料層脫落區域提取的像元中屬于白色圖案的減少了32 869個,這些像元被正確分為白色圖案類別,因此顏料層脫落區域用戶精度從30.8%提高到了55.55%,白色圖案的制圖精度從51.89%提高到了72.47%。但是,原本分類正確的顏料層脫落區域的像元減少了4 787個,導致顏料層脫落區域的制圖精度由80.61%降低至65.75%,白色圖案的用戶精度由95.25%降低至86.91%。

表5 光譜特征顏料層脫落提取精度

綜上所述,利用光譜與形狀結合的顏料層脫落區域提取精度比僅使用光譜特征進行提取得到了提高。

4 討 論

4.1 不同矩與分類器提取結果

為了比較不同不變矩和分類器對顏料層脫落區域提取結果的影響,本文利用Zernike矩、決策樹 (decision tree, DT)和K近鄰(K-nearest neighbor, KNN)分類器進行對比實驗。本文采用相同的處理流程,其總體分類精度見表6。結果證明Hu矩與SVM分類器相結合方法更適用于顏料層脫落區域提取工作。

表6 不同矩與分類器的總體分類精度(%)

4.2 噪聲對提取精度影響

由于Hu矩對噪聲比較敏感,為比較不同噪聲對實驗結果影響。本文為對象圖斑添加了強度為10 dBW,20 dBW的高斯白噪聲和密度為0.05的椒鹽噪聲,按照文中形狀特征再次提取方法進行實驗,其結果的總體分類精度見表7,說明噪聲對提取精度有一定影響。在后續研究中可以考慮利用濾波等方法,保證對象圖斑不受噪聲影響,從而保證較高的提取精度。

表7 不同噪聲的總體分類精度(%)

4.3 連通區域標記影響

觀察分類后的圖像發現,在部分區域存在明顯的誤分類現象,如圖10所示。其原因是算法沒有考慮當顏料層脫落區域與白色圖案在壁畫上相鄰,在利用光譜特征進行分類后,若兩者被誤分為同一類別,根據算法進行連通形成對象圖斑后將成為一個整體對象,是利用Hu矩形狀特征二次區分的最小單元,不可分割。如圖10所示,僅該圖斑中顏料層脫落區域像元數就為1 757個。若選用更加合理的標記方法,使得顏料層脫落區域與白色圖案分別生成對象圖斑,脫落區域的制圖精度則可以提高至71.20%,用戶精度可提高至57.50%。白色區域用戶精度提高至88.07%。能夠得到明顯的提高。

圖10 顏料層脫落與白色圖案誤分類區域

因此,為了進一步提高顏料層脫落區域提取的精度,可以研究更加合理的連通區域標記方法區分不同對象圖斑,也可以考慮利用長寬比、面積等多種形狀特征指數參與分類。

5 結 論

針對壁畫顏料層脫落區域與白色圖案光譜相近較難區分的問題,提出了利用光譜特征和形狀特征結合的顏料層脫落區域提取方法。利用光譜特征提取壁畫顏料層脫落區域與白色圖案,再利用Hu矩形狀特征來進行二次分類。實驗結果表明,綜合利用光譜和形狀特征可以提高壁畫顏料層脫落區域的提取精度。該方法可以為壁畫的現狀調查提供效率更高的脫落區域提取,有助于壁畫保護修復方案的制定。

[1] 汪萬福, 趙林毅, 裴強強, 等. 館藏壁畫保護理論探索與實踐——以甘肅省博物館藏武威天梯山石窟壁畫的保護修復為例[J]. 文物保護與考古科學, 2015, 27(4): 101-112. WANG W F, ZHAO L Y, PEI Q Q, et al. Exploration and practice of conservation of wall paintings in the museum: the case of conservation of wall paintings collected in the Gansu Museum from Tiantishan Grottoes, Wuwei[J]. Sciences of Conservation and Archaeology,2015, 27(4): 101-112 (in Chinese).

[2] 劉曉琴, 侯妙樂, 董友強, 等. 基于高光譜圖像的瞿曇寺壁畫顏料層脫落病害評估[J]. 地理信息世界, 2019, 26(5): 22-28. LIU X Q, HOU M L, DONG Y Q, et al. Extraction and evaluation of the disease of the mural paint loss[J]. Geomatics World, 2019, 26(5): 22-28 (in Chinese).

[3] 李彩艷, 王慧琴, 吳萌, 等. 唐墓室壁畫泥斑病害自動標定及虛擬修復[J]. 計算機工程與應用, 2016, 52(15): 233-236. LI C Y, WANG H Q, WU M, et al. Automatic recognition and virtual restoration of mud spot disease of Tang Dynasty tomb murals image[J]. Computer Engineering and Applications, 2016, 52(15): 233-236 (in Chinese).

[4] 曹建芳, 李艷飛, 崔紅艷, 等. 改進的區域生長算法在寺觀壁畫脫落病害標定中的應用[J]. 新疆大學學報: 自然科學版, 2018, 35(4): 429-436. CAO J F, LI Y F, CUI H Y, et al. The application of improved region growing algorithm for the automatic calibration of shedding disease on temple murals[J]. Journal of Xinjiang University:Natural Science Edition, 2018, 35(4): 429-436 (in Chinese).

[5] 劉建明. 古代壁畫圖像保護與智能修復技術研究[D]. 杭州: 浙江大學, 2010. LIU J M. Intelligent image processing and inpainting for ancient fresco preservation[D]. Hangzhou: Zhejiang University, 2010 (in Chinese).

[6] 張兵. 高光譜圖像處理與信息提取前沿[J]. 遙感學報, 2016, 20(5): 1062-1090. ZHANG B. Advancement of hyperspectral image processing and information extraction[J]. Journal of Remote Sensing, 2016, 20(5): 1062-1090 (in Chinese).

[7] PENG J Y, YU K, WANG J, et al. Mining painted cultural relic patterns based on principal component images selection and image fusion of hyperspectral images[J]. Journal of Cultural Heritage, 2019(36): 32-39.

[8] WU T X, CHENG Q, WANG J F, et al. The discovery and extraction of Chinese ink characters from the wood surfaces of the Huangchangticou tomb of Western Han Dynasty[J]. Archaeological and Anthropological Sciences, 2019, 11(8): 4147-4155.

[9] ROHANI N, POUYRT E, COSSAIRT O, et al. Nonlinear unmixing of hyperspectral datasets for the study of painted works of art [J]. Angewandte Chemie International Edition, 2018, 57(34): 10910-10914.

[10] 孫美君, 柴勃隆, 張冬, 等. 基于近紅外高光譜技術的敦煌莫高窟壁畫起甲病害風險評估方法[J]. 文物保護與考古科學, 2016, 28(4): 1-8. SUN M J, CHAI B L, ZHANG D, et al. Assessing the degree of flaking of the murals in the Dunhuang Mogao Grottoes using near-infrared hyperspectral imaging[J]. Sciences of Conservation and Archaeology, 2016, 28(4): 1-8 (in Chinese).

[11] 周霄, 高峰, 張愛武, 等. VIS/NIR高光譜成像在中國云岡石窟砂巖風化狀況分布研究中的進展[J]. 光譜學與光譜分析, 2012, 32(3): 790-794. ZHOU X, GAO F, ZHANG A W, et al. Advance in the study of the powdered weathering profile of sandstone on China Yungang Grottoes based on VIS/NIR hyperspectral imaging[J]. Spectroscopy and Spectral Analysis, 2012, 32(3): 790-794 (in Chinese).

[12] LI P, SUN M J, WANG Z, et al. OPTICS-based unsupervised method for flaking degree evaluation on the murals in Mogao Grottoes[J]. Scientific Reports, 2018, 8(1): 1-10.

[13] 王曉珍. 瞿曇寺明清建筑實物及壁畫中的建筑彩畫[J]. 美術, 2019(11): 115-119. WANG X Z. The architectural objects of Ming and Qing Dynasties in Qutan Temple and the architectural colored drawings in mural paintings[J]. Art Magazine, 2019(11): 115-119 (in Chinese).

[14] BURGER J, GELADI P. Hyperspectral NIR image regression part I: calibration and correction[J]. Journal of Chemometrics: A Journal of the Chemometrics Society, 2005, 19(5-7): 355-363.

[15] GREEN A, BERMAN M, SWITZER P, et al. A transformation for ordering multispectral data in terms of image quality with implications for noise removal[J]. IEEE Transactions on Geoscience and Remote Sensing, 1988, 26(1): 65-74.

[16] HU M K. Visual pattern recognition by moment invariants[J]. Information Theory, IRE Transactions on Information theory, 1962, 8(2): 179-187.

[17] 陳躍偉, 彭道剛, 夏飛, 等. 基于區域生長法和BP神經網絡的紅外圖像識別[J]. 激光與紅外, 2018, 48(3): 401-408. CHEN Y W, PENG D G, XIA F, et al. Infrared image recognition based on region growing method and BP neural network[J]. Laser & Infrared, 2018, 48(3): 401-408 (in Chinese).

[18] 成杰, 李新德. 基于Hu矩與改進PNN的飛機姿態識別算法[J]. 航空兵器, 2017(1): 55-61. CHENG J, LI X D. An algorithm of aircraft pose recognition based on Hu moments and IPNN[J]. Aero Weaponry, 2017(1): 55-61 (in Chinese).

[19] 李洪安, 杜卓明, 李占利, 等. 基于雙特征匹配層融合的步態識別方法[J]. 圖學學報, 2019, 40(3): 441-446. LI H A, DU Z M, LI Z L, et al. Research on gait recognition algorithm based on double features using the layer matching fusion method[J]. Journal of Graphics, 2019, 40(3): 441-446 (in Chinese).

[20] CORTES C, VAPNIK V. Support-vector networks[J]. Machine Learning, 1995, 20(3): 273-297.

[21] 徐輝,潘萍, 楊武, 等. 基于多源遙感影像的森林資源分類及精度評價[J]. 江西農業大學學報, 2019, 41(4): 751-760. XU H, PAN P, YANG W, et al. Classification and accuracy evaluation of forest resources based on Multi-source remote sensing images[J]. Acta Agriculturae Universitatis Jiangxiensis, 2019, 41(4): 751-760 (in Chinese).

Extraction of mural paint loss regions based on spectral dimensionality reduction and Hu moment

CAO Peng-hui1,2, LYU Shu-qiang1,2, WANG Wan-fu3, GAO Zhen-hua1,4, HOU Miao-le1,2

(1. School of Geomatics and Urban Spatial Informatics, Beijing University of Civil Engineering and Architecture, Beijing 100044, China; 2. Beijing Key Laboratory for Architectural Heritage Fine Reconstruction & Health Monitoring, Beijing 100044, China; 3. Dunhuang Academy China, Dunhuang Gansu 736200, China; 4. Shanxi Provincial Institute of Archaeology, Taiyuan Shanxi 030000, China)

The extraction of mural paint loss plays an important role in investigating the present situation of murals. Given the similarity of spectral features of paint loss to the white patterns of the mural, the only utilization of spectral features would make it less accurate for the extraction of the mural paint loss. Aiming at improving the extraction performance, a comprehensive method was proposed that integrated spectral features and Hu moment. First, the supervised support vector machine method was employed to classify paint loss and white patterns by the spectral features which the dimension had been reduced. The classified pixels of paint loss and white patterns were then connected to form two types of polygons, which were regarded as the smallest indivisible objects. Subsequently, seven Hu moments for each polygon were calculated as the shape features serving as the feature vectors to distinguish each polygon again based on the support vector machine method. In this way, the semi-automatic extraction of mural paint loss was realized. A case study was conducted to evaluate the performance of our proposed method, using the hyperspectral data of the Qutan Temple mural. The results show that our proposed method is capable of enhancing the extraction accuracy of mural paint loss and supporting the investigation of the present situation of murals.

paint loss; disease extraction; mural; hyperspectral imaging; Hu moment; support vector machine; minimum noise fraction

TP 391

10.11996/JG.j.2095-302X.2020060930

A

2095-302X(2020)06-0930-09

2020-05-14;

2020-07-04

14 May,2020;

4 July,2020

國家自然科學基金項目(41371492);國家重點研發計劃項目(2017YFB1402105);北京市屬高校高水平教師隊伍建設支持計劃長城學者培養計劃項目(CIT&TCD20180322);北京建筑大學研究生創新項目(PG2020070)

National Natural Science Foundation of China (41371492); National Key Research and Development Program (2017YFB1402105); Great Wall Scholars Training Program Project of Beijing Municipality Universities (CIT&TCD20180322); BUCEA Post Graduate Innovation Project (PG2020070)

曹鵬輝(1994-),男,北京人,碩士研究生。主要研究方向為高光譜遙感、壁畫高光譜數字化保護。E-mail:15210481449@163.com

CAO Peng-hui (1994–), male, master student. His main research interests cover hyperspectral remote sensing, hyperspectral digital protection of murals. E-mail:15210481449@163.com

侯妙樂(1974–),女,陜西西安人,教授,博士,博士生導師。主要研究方向為建筑遺產數字化保護與研究工作。 E-mail:houmiaole@bucea.edu.cn

HOU Miao-le (1974–), female, professor, Ph.D. Her main research interests cover digital protection and research of architectural heritage.E-mail:houmiaole@bucea.edu.cn