基于RGB-D視頻的地鐵異物風險檢測方法研究

劉偉銘,李靜寧,杜逍睿

(華南理工大學土木與交通學院,廣州 510640)

1 概述

近年來,我國城市軌道交通發展迅速,地鐵快速發展的同時,也出現了一些安全問題影響乘客安全出行。早晚高峰期,地鐵夾人夾物事件頻發,導致大批乘客延誤逗留甚至人員傷亡,由此引發了地鐵安全的熱議。由于地鐵列車門與屏蔽門間存在一定的隱患,一般采取人員巡邏和車頭司機瞭望來確保列車安全運行[1]。人工的方式有諸多局限,無法滿足自動駕駛的發展需求,因此采用先進技術對地鐵列車門及屏蔽門間風險區域進行異物風險檢測,對地鐵運行可能出現的風險及時提醒,將更好的保證地鐵安全運行,減低乘客乘車風險。

2 異物風險檢測

目前針對地鐵異物風險檢測方法主要有基于激光傳感器檢測、基于紅外光幕檢測以及基于彩色視頻圖像檢測三種方式。蘇建華等[2]提出基于彩色視頻圖像的車門夾人檢測方法,采用顏色直方圖算子分別對車門及車門夾人時圖像進行檢測,通過對比判斷異物。譚飛剛等[3]提出基于地鐵曲線站臺的空隙異物自動檢測預警系統,通過對彩色視頻幀背景建模方法檢測異物目標。施偉等[4]提出改進的霍夫變換算法來檢測地鐵車尾光帶來判斷異物,該方法只適合直線站臺。基于圖像的檢測方法對乘客和列車均無影響,便于安裝,適合于直線和曲線站臺。然而地鐵環境復雜,RGB攝像頭易受到光線、灰塵、異物與背景相似等干擾,魯棒性不高。

隨著深度傳感器技術的提升,深度攝像頭在目標檢測領域的應用日益廣泛。與傳統的攝像頭相比,深度攝像頭不依賴于光源,利用深度信息可以明顯改善目標識別和跟蹤的效果。深度信息可以通過不同的方法實時獲得,如視差估計法的立體攝像頭[5]、基于飛行時間(ToF)的攝像頭[6]或微軟Kinect外設[7]等。本文選擇基于飛行時間的Pico Zense的RGB-D攝像頭來采集RGB-D圖像,該攝像頭在地鐵環境下能夠采集高分辨率穩定的彩色圖像及深度圖像。在此基礎上,設計了一個地鐵風險區域異物風險檢測方法,首先采取RGB-D+ViBe的方法進行異物目標檢測,再通過檢測異物尺寸對異物風險進行判斷,從而充分利用多源信息提高檢測準確度。

3 基于RGB-D異物風險檢測方法

3.1 ViBe目標檢測算法

在復雜環境下檢測出有效的異物目標,對后續監測系統異物風險判斷起著關鍵作用。ViBe(Visual Background Extractor)[8-10]是O.Barnich提出的一種像素級的前景檢測算法,有計算效率高,檢測實時性好的特點。ViBe算法不需要提前對視頻幀進行訓練,能夠快速、有效地檢測出前景,減少鬼影對前景的干擾。在前景檢測算法中,ViBe算法的前景檢測準確率優于高斯混合模型(GMM)[11]、碼本模型[12]、貝葉斯模型[13]等。ViBe目標檢測算法包括3個階段:(1)建立像素模型;(2)像素點分類;(3)模型更新。

(1)建立像素模型:對圖像中某一點像素P(x,y),由于領域像素點空間分布特性相似,隨機選取領域像素點的值作為模型樣本值,利用一幀圖像初始化背景模型。

(1)

(2)像素點分類:將新像素點fi(x,y)和初始背景模型進行比較,如果該點與模型樣本空間距離小于某一值R,則近似樣本數目增加,否則近似樣本數目不變。當近似樣本點數小于閾值λ,則記該點為運動前景。

(2)

(3)

其中,Bi(x,y)表示像素點分類結果;Bi(x,y)=0表示該點為背景點;Bi(x,y)=1表示該點為運動目標點;Ni表示近似樣本點;dis(fi(x,y),vj)表示新像素點與初始背景模型歐式距離;R是距離半徑閾值;λ表示近似樣本閾值。

(3)模型更新原則

時間衰減原則:樣本保留在模型的概率隨時間衰減,而判斷為運動目標的點則不會用來更新模型。

(4)

可變換為

(5)

隨機子采樣原則:當被分類至背景點時,隨機確定該點是否用來更新模型以拓展模型覆蓋的時間窗口。因此引入隨機子采樣因子φ,即背景有1/φ的概率用來更新模型。

空間一致性原則:某像素點觸發模型更新時,隨機選擇鄰域模型用以更新原模型,從而在空間上傳播像素樣本,確保空間一致性。然而,基于RGB圖像的ViBe算法仍存在一些不足:(1)首幀構建的模型里存在運動的目標時,后續檢測會出現鬼影現象;(2)在光照變化較大的黑暗場景中或燈光顏色變化較大的場景,可能會導致大面積的背景被誤認為是前景點;(3)在模型更新階段,僅使用灰度圖像來計算幀像素之間的差異時,容易混淆背景和前景。

3.2 RGB-D+ViBe的異物目標檢測方法

由于ViBe算法的不足,楊丹等[14]提出的基于彩色圖像的ViBeImp算法,檢測過程中運用多種算法相結合計算自適應半徑閾值,可以快速適應環境變化,但是面對光照變化大等問題仍無法解決。而Del-Blanco C等[15]提出的自適應雙碼本DECB算法融合了彩色和深度信息,雖然對光照具有魯棒性,但是不具備實時性。基于RGB-D+ViBe的改進目標檢測方法,融合深度和彩色信息,將顏色、紋理和距離特征充分利用,消除光照影響,保證前景良好的檢測效果。

(1)建立深度模型

一般情況下,目標檢測選取視頻的初始幀作為背景,但是當目標出現在第一幀時,大多數檢測方法僅通過RGB圖像難以快速地將前景與背景分離。然而,利用深度信息可以有效快速將前景與背景從初始幀中分離出。對于深度圖像,靠近相機的點深度值大,而遠離相機的點深度值小。當前景移動時,與其初始位置相對應的像素變小,如果這些像素也被識別為前景,那么就會形成偽前景即鬼影,建立深度模型可以利用深度信息有效抑制鬼影現象。

將第一幀深度值D(x,y)保存為深度模型MD(x,y)

(6)

深度模型有ViBe算法類似的更新策略,當觸發模型更新時,原模型中深度值被替換為當前像素對應的深度值。

(2)彩色和深度圖像融合像素背景模型

本文采用直觀的融合方法,在原有彩色的ViBe算法之外添加深度信息,組合通道f=(fI,d)由RGB空間中的3個顏色通道均值I通道和深度值d構成。彩色圖像符合人類的視覺習慣,并提供顏色和紋理等信息,合理利用彩色圖像關鍵信息,從而提高檢測準確率。由于色彩、光照變化對檢測效果影響較大,為了消除色彩變化影響,首先對彩色圖像R、G、B三通道進行平均得到I通道圖像。深度圖像量化了目標到平面的距離,深度值越高,檢測越可靠。因此,利用深度信息作為檢測置信因子,例如深度圖像中有空洞的地方,深度檢測明顯不可靠,融合的結果將取決于彩色圖像。

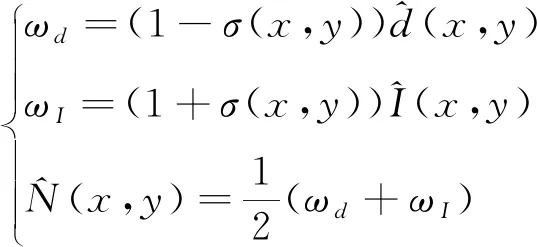

本文取深度值倒數進行歸一化處理作為深度不確定度,將其與深度值和RGB通道均值進行融合,得到融合的歸一化圖像

(7)

(8)

(3)判斷像素點是否為前景

建立深度像素模型MD(x,y)來增加判斷前景時的匹配條件,從而消除鬼影影響,改善算法效果。

首先,將融合后的點ffusion(x,y)和融合模型比較,如果該點與模型空間距離小于某一閾值R,則近似樣本數目增加,否則近似樣本數目不變。

然后,當近似樣本數大于閾值λ,則記該點為背景點,以原更新策略更新融合模型和深度模型;當近似樣本數小于閾值λ,且深度值與深度模型歐式距離超過閾值τ時,則記該點為鬼影點,仍歸類為背景點;若近似樣本數小于閾值λ,且深度值與深度模型歐式距離小于τ時,則認為該點為運動目標點。

(9)

(10)

其中,Bi(x,y)為像素點分類結果,Bi(x,y)=0為該點為背景點,Bi(x,y)=1為該點為運動目標點;Ni為近似樣本點;dis(fi(x,y),vj)為新像素點與初始背景模型歐式距離;R是樣本距離閾值;λ為近似樣本閾值;τ為深度距離閾值。

3.3 異物風險判斷

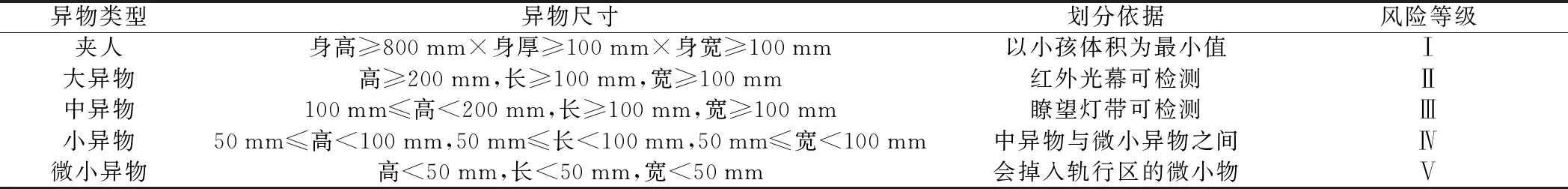

檢測出異物目標后,需要對異物進行風險判斷,文獻[16]提出,將站臺異物劃分為5個風險等級,如表1所示。

表1 文獻[16]中異物風險分類

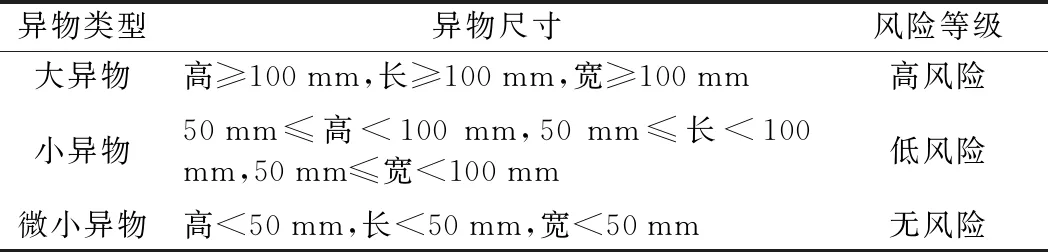

參考表1的分類依據,將異物風險分為三類:高≥100 mm,長≥100 mm,寬≥100 mm為高風險異物;50 mm≤高<100 mm,50 mm≤長<100 mm,50 mm≤寬<100 mm為低風險異物;高<50 mm,長<50 mm,寬<50 mm為無風險異物,如表2所示。

表2 本文異物風險分類

異物的尺寸通過彩色圖像并不能完全檢測出來,因此借助深度信息,可以更精確判斷異物風險。由于異物形狀不確定,因此對目標做近似處理,通過近似的異物尺寸來判斷異物風險。

(1)計算最小外接矩形

根據目標像素點集合的最值確定外接矩形,得到其面積

S=(maxX-minX)×(maxY-minY)

(11)

旋轉目標圖像,求出新目標像素點集合坐標最值確定外接矩形和面積,直到外接矩形面積最小,則為最小外接矩形

x′=xcosb-ysinb

(12)

y′=xcosb+ysinb

(13)

(2)圖像尺寸轉換為實際尺寸

引入轉換系數,將像素長度轉換為實際距離,得到近似異物目標的實際長和寬

L=k×l

(14)

W=k×w

(15)

其中,l,w分別為彩色圖中異物目標最小外接矩形長、寬;L,W分別為實際長、寬;k為像素長度與實際距離的轉換系數。

利用深度信息計算異物高度,取最小外接矩形對應深度最小值和最大值的差,可以得到異物的高

H=dmax-dmin

(16)

(3)根據異物尺寸判斷異物風險

Flag=

(17)

其中,Flag代表風險等級。

3.4 實驗結果與分析

基于Qt5.6.1及opencvSDK2.4.3的環境,實驗采集的視頻幀率為30幀,顏色和深度圖像的大小為640×480。為了驗證所提出的異物檢測方法魯棒性,實驗采集了正常光照時地鐵環境下異物視頻和當光照變化較大時地鐵環境異物視頻。

首先,將本文方法目標檢測的結果與先進的基于RGB-D融合的MOG4D[17-18]算法以及基于彩色圖像的ViBe算法[19]和基于深度的ViBe算法[20]進行比較,為了驗證異物檢測方法的有效性,采用準確率指標進行評價,準確率在計算機視覺中被廣泛用于評估二進制分類器的性能[21]。

(18)

其中,TP代表正確分類為運動目標的真實運動點;TN代表正確分類為背景的真實背景點;FP代表錯誤分類為背景的真實運動目標點;FN代表錯誤分類為運動目標的真實背景點。

本文提出目標檢測方法涉及5個參數的設置,即樣本數目N、樣本距離閾值R、近似樣本閾值λ、更新因子φ和深度距離閾值τ。為了獲得最優的檢測效果,實驗設置N=20,R=20,λ=2,φ=16以及τ=2。圖1代表正常光照時目標檢測結果,圖2為光照變化大時目標檢測結果,表3為不同光照條件下目標檢測準確率。

圖1 正常光照時目標檢測結果(左下為彩色ViBe算法檢測結果,右下為本文方法檢測結果)

圖2 光照變化大時目標檢測結果(左下為彩色ViBe算法檢測結果,右下為本文方法檢測結果)

表3 不同光照條件下準確率對比 %

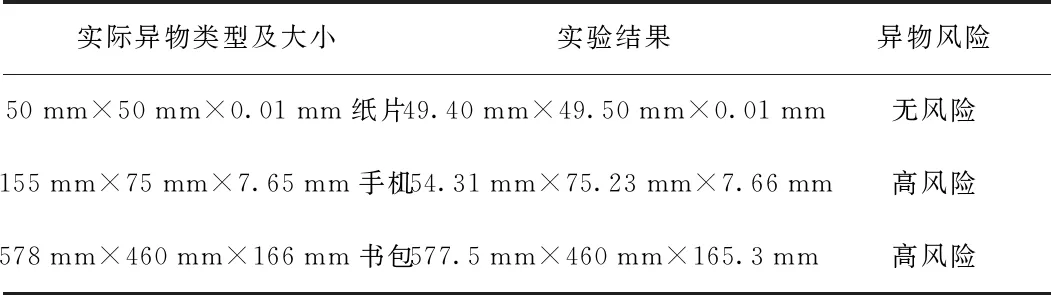

根據實驗結果,本文提出的RGB-D+ViBe算法,結合一個額外的深度模型,可以有效地消除鬼影和黑影。在正常光照下檢測準確率較其他方法有所提升,而當光照變化大特別是燈光閃爍的情況下,其他方法由于鬼影大大降低檢測準確率,而本文方法檢測準確率在光照變化大的情況下也達到90%以上,具有魯棒性。為了驗證異物風險判斷的準確率,針對不同尺寸的異物進行實驗,其中像素距離轉換系數k取4.5。圖3代表異物風險判斷結果,表4為實際異物尺寸風險判斷和實驗對比。

圖3 異物風險判斷結果(左為彩色原圖,右為檢測結果)

表4 實際異物和實驗結果比較

由表4可以看出,與實際異物尺寸相比,本文方法計算出的異物尺寸誤差在1 mm內,能夠有效準確判斷異物風險。

綜上所述,本文提出的RGB-D+ViBe目標檢測方法可以充分利用彩色和深度多源信息,結合深度模型實現鬼影的抑制和對光照具有魯棒性,能夠準確檢測異物,同時提出了異物風險判斷方法,有效警示異物風險。

4 結語

地鐵異物檢測易受到光照、背景等影響,隨著深度傳感器的發展,深度信息為異物檢測提供了新的思路。基于采集的屏蔽門和列車門之間的RGB-D視頻,提出一種融合深度和顏色信息的異物風險檢測算法。實驗結果證明,基于RGB-D+ViBe的方法在不同光照條件下準確率都達到90%以上,基于RGB-D的異物尺寸計算誤差在1 mm以內,方法具有魯棒性和準確性,對地鐵站臺安全監測有很高的使用和推廣價值。