基于雙階段網絡的交互式目標分割算法

張華悅,張順利,張 利

(清華大學電子工程系,北京 100084)

0 概述

近年來,深度學習技術的發展使得目標分割在自動駕駛、圖像分析等領域得到廣泛應用與發展,但以往對分割任務的研究主要集中于自動語義分割[1-3]、實例分割[4-6]和全場景分割[7-8]等方面,而對交互式目標分割算法的研究較少。當人在一張圖中通過某種交互方式標注出自己感興趣的目標時,交互式目標分割可以有針對性地將此目標物體從原圖中分割出,因此,其在現實中應用更加廣泛,如利用交互式分割在深度學習中對圖像數據的實例進行像素級標注、在手機端的圖像娛樂軟件中進行目標摳圖以及將該方法應用于平面圖像設計或醫學圖像領域[9]等。

在交互式分割中,可以將交互方式分為單輪交互和多輪交互2種。文獻[10]中的多輪交互方法通過第一次交互標出目標的邊界框得到初步的分割結果,然后每次交互時通過標出錯分區域來對上一輪分割結果進行修正,直到結果滿意為止。由于多輪交互過程復雜且具有低效性,因此本文主要研究單輪交互方式。在單輪交互中,只通過初始的一次交互直接得到分割結果。文獻[11]中的GrabCut算法和文獻[12]中的水平集算法均基于傳統機器學習算法進行分割,文獻[13]中基于深度學習的DEXTR算法采用四點交互法(標注目標的最上、最下、最左、最右邊界點),在ROI中進行大目標分割。

基于ROI的交互方式可以較好地繼承和利用傳統圖像分割算法并在構造交互數據集時更為便利,但其也存在一定不足,一是當目標物體具有細長支架的結構時,通過外接矩形框獲取的ROI中僅含有占比極少的前景像素,使得網絡難以判別前景信息,二是部分目標的4個邊界點不清晰,一旦邊界點標注錯誤就會造成分割結果截斷。已有交互式分割方法利用FCN[1]和Deeplab系列[14-16]等經典圖像分割方法,將ROI信息僅在輸入端一次性地輸入圖像分割網絡,這種直接的方法難以充分利用交互信息,使得分割結果較為粗糙,尤其是在多個物體之間緊密交叉重疊或目標連通性較差的情況下,其分割結果更加不完整。

本文采用在目標內部隨機涂畫的交互方式,利用骨架隨機性仿真算法模擬大數據下的人機交互情景,構建一種基于雙階段網絡的精目標分割模型ScribNet,以充分利用交互信息并對交互目標進行更精細和完整的分割。

1 交互方式

在四點交互法中,每個目標的4個端點是固定不變的,容易出現誤標而導致誤分的情況。相比而言,本文采用的涂畫式交互允許人們在目標中涂畫任意形狀的曲線,其具有更好的容錯性和魯棒性,也正因如此,訓練數據時對這種交互數據的仿真更為困難。針對該問題,本文提出一種骨架仿真算法以在大數據上實現仿真涂畫式交互。

1.1 涂畫式交互

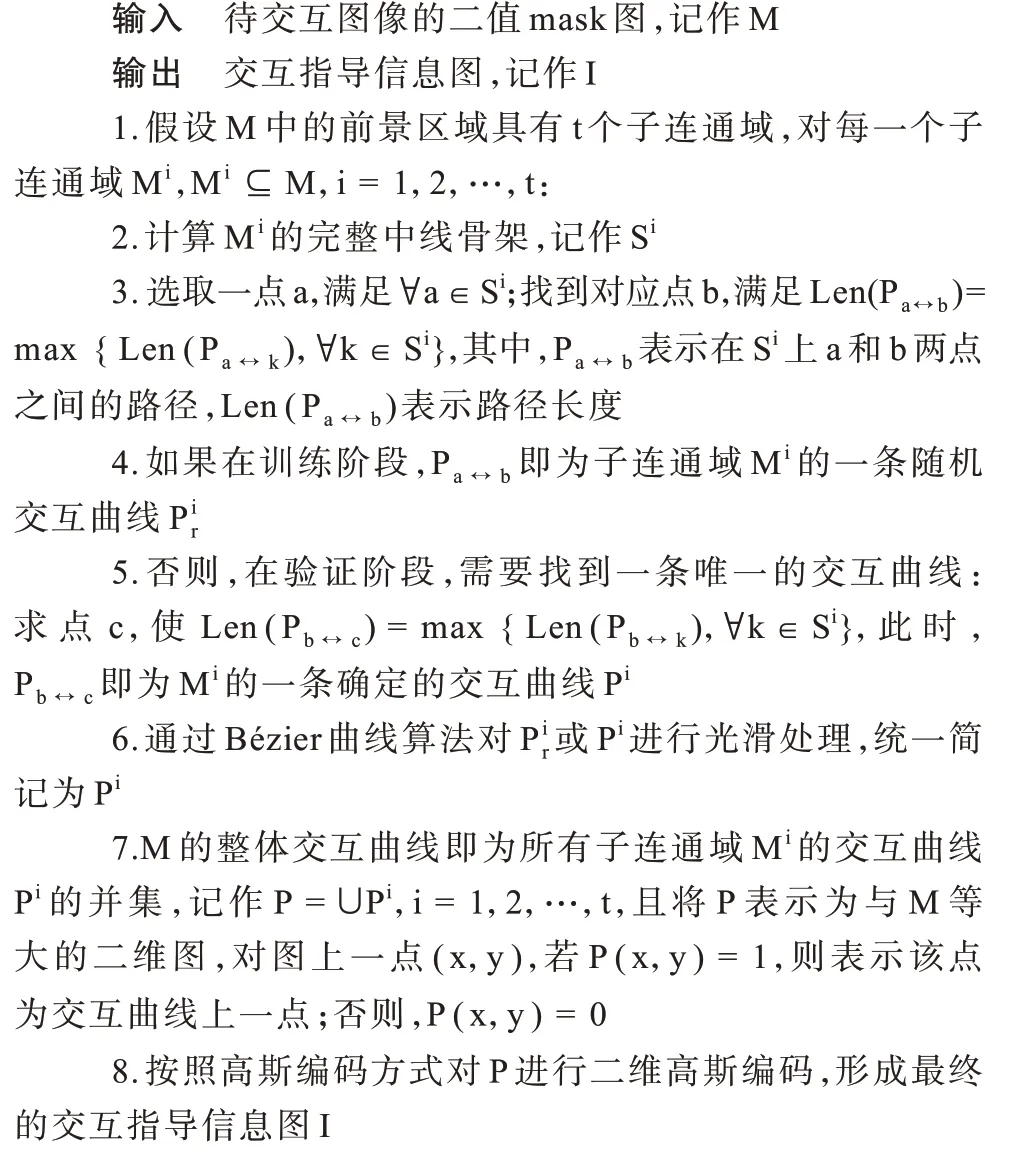

在給定一張圖像后,本文方法允許人在圖像中的興趣目標區域內涂畫任意形狀的曲線,不超出目標區域即可。涂畫的曲線涉及更多的目標區域,將更能提高目標分割的完整性,例如對于圖1所示(圖中曲線表示交互曲線)的嬰兒而言,本文自左到右的交互假設將越來越有益于分割。

圖1 不同的涂畫交互方式假設Fig.1 Hypothesis of different painting interaction modes

在網絡學習階段,交互曲線由骨架隨機性仿真算法計算得到,該算法將在1.2節中進行詳細闡述。在實際應用中,交互曲線則由人為交互涂畫產生。在得到涂畫的交互曲線P后,將曲線通過高斯編碼形成交互指導信息圖以用于后續分割算法。具體步驟為:

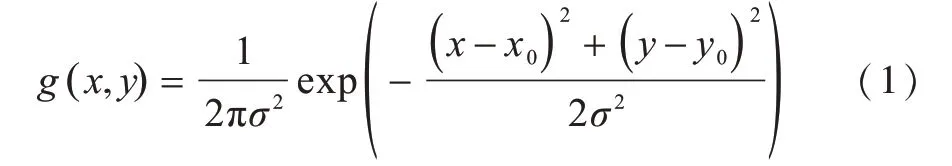

1)以曲線上的每個坐標點(x0,y0)∈P為中心,建立與原圖等大的二維高斯分布圖,每個坐標點處的g(x,y)值表示中心點(x0,y0)對周圍像素(x,y)的影響程度,表達式如下:

其中,方差σ2取經驗值40。

2)針對曲線上所有點形成的高斯分布圖,在每個像素位置取最大影響值,形成最終的交互信息圖,將其記作I。

1.2 骨架隨機性仿真算法

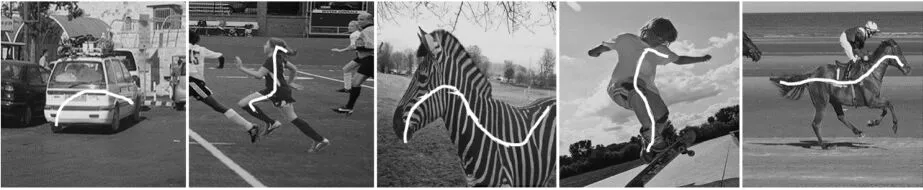

在深度學習的模型訓練及驗證過程中,人為標注的大量交互數據會消耗巨大的人力成本。本文對視頻交互方法[17-18]進行改進,提出提高交互曲線隨機性的骨架隨機性仿真算法,并模擬實際情況中人的隨機涂畫交互行為,以在大數據上進行交互仿真。本文算法除在目標物體的骨架中求取最長路徑外,還通過求取骨架中任意點到其他點最遠距離的方法使得計算出的交互曲線具有多樣性和隨機性,以豐富訓練數據集。骨架仿真算法的具體描述如算法1所示,圖2中的白色曲線即為相應示例圖的仿真結果。

算法1骨架隨機性交互仿真算法

圖2 骨架隨機性仿真算法的仿真交互結果Fig.2 Simulation interaction results of skeleton randomness simulation algorithm

2 雙階段交互式分割網絡

雙階段交互式分割網絡由順序級聯的粗分割(粗預測)和優化(細預測)2個階段組成,在2個階段的輸出端,均有損失函數進行顯式監督,完整的網絡結構如圖3所示。

圖3 雙階段交互式分割網絡框架Fig.3 Two-stage interactive segmentation network framework

2.1 粗分割階段

近年來,性能較優的自動分割網絡大多呈現為編、解碼結構,如SegNet[19]、U-Net[3]和Deeplab v3+[16]等。在該結構中,特征的上、下采樣和跳躍式連接可以增大卷積核的感受野,并利用多尺度信息獲得較好的分割結果。因此,在本文ScribNet模型的粗分割階段,采用編、解碼的網絡結構,如圖3中E(Encoder)和D(Decoder)模塊所示。

在傳統的分割任務中,網絡采用三通道RGB數據作為輸入,并實現自動的全圖場景分割或特定類別實例分割。在以人為交互主體的交互式目標分割任務中,除通過RGB通道獲取全圖信息外,網絡還利用交互指導信息圖獲取交互主體的分割意圖,并將其作為第4個輸入通道。本文采用高斯編碼結果作為交互指導信息圖I,形成網絡的RGBI四通道輸入數據。在輸出端,得到一張像素級預測的目標前景概率圖,通過Sigmoid和二值化操作得到像素級預測結果,如式(2)所示,其中,1表示預測為目標前景,0表示預測為目標背景。該結果為交互分割的粗分割結果,記作C,如圖3中階段1所示。由于輔助損失函數在此處進行了顯式監督,使得粗分割結果可以正確預測大部分像素的類別。

2.2 優化階段

隨著網絡層的加深,在輸入端輸入的RGB信息和交互指導信息被逐漸地削弱,尤其是到了網絡的輸出端(也稱為預測層)。因此,優化階段將對第1階段的粗分割結果進行細化,先將第1階段輸入端的RGB信息和交互信息I通過跳躍式連接的方式與粗分割結果C疊加在一起形成RGBIC五通道數據,輸入優化階段,再經過圖3中的R(Refinement)模塊輸出最終的分割結果,即為優化分割或細預測結果,如圖3中的階段2所示。

ScribNet優化階段對粗分割結果的細化具有有效性主要有以下3個原因:

1)從信息利用角度而言,網絡的2個階段均有RGB和交互信息作為輸入,實現了對輸入信息的充分利用,尤其是對底層信息起到了強化補充的作用。同時,優化階段輸入的第5個粗分割通道,可以看作目標分割的先驗知識,其告知了網絡目標前景、背景的主體大致區域,能夠對交互目標實現更加準確的定位。

2)從網絡學習角度而言,由于目標主體部位像素的分布已經在粗分割階段學習完畢,因此在優化階段中損失函數的構成主要來自錯分的像素,包括被錯分的邊緣處像素和部分主體像素,使得優化階段的網絡可以針對性地對預測細節進行學習,起到對粗分割結果進行“查漏補缺”的作用。

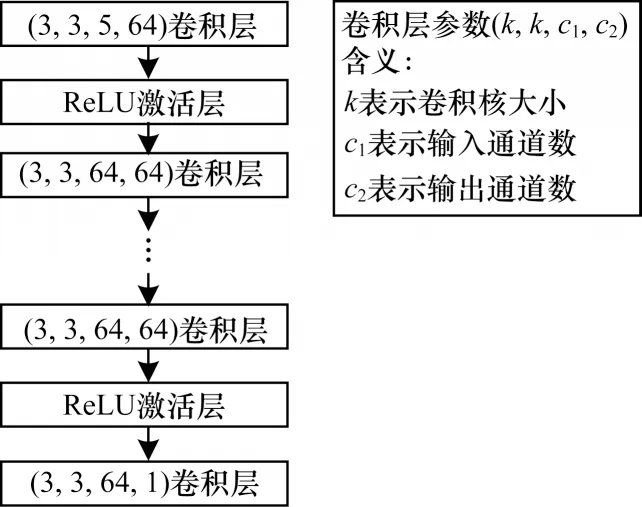

3)從網絡結構角度而言,由于優化僅需學習前一階段的錯分區域,網絡任務明確,因此優化階段的網絡結構可以很簡潔。此外,為了避免由于分辨率的變化造成細節信息丟失的問題,該網絡結構中未采取任何升采樣或降采樣操作,完全由圖像原始分辨率下的若干層卷積和非線性激活操作組成,如圖4所示。

圖4 優化階段的R模塊結構Fig.4 R module structure in optimization stage

2.3 算法性能分析

本文交互式目標分割算法采用骨架仿真算法模擬隨機涂畫式交互,具有標注成本低、交互容錯率高的優勢,同時采用雙階段網絡實現精細化分割,使得分割結果具有更高的準確率和魯棒性。

在對大數據進行交互時,四點式交互極易出現交互錯誤的現象,由于目標的4個端點固定且唯一,一旦交互標注錯誤就會對目標造成截斷。而本文采用的骨架仿真算法在避免大量人力交互成本的同時,通過引入隨機子路徑使得仿真交互數據具有一定的隨機性,即無論是在網絡訓練還是驗證階段,算法均可以對同一張目標圖像仿真出多種不同的交互曲線,從而提高數據集的多樣性以及模型在實際應用中對人為涂畫交互的容錯率。

本文算法采用雙階段網絡結構,在粗分割階段獲得初始預測結果,初始預測中被錯分的像素區域也有機會在優化階段被糾正和優化,使得分割結果更加準確,尤其對于某些較難分割的情況,如圖像彼此之間存在緊密重疊的目標或在交互中未被直接標注的目標區域,雙階段網絡結構具有更高的魯棒性。

3 實驗結果與分析

3.1 實驗數據與評價指標

本文雙階段交互式目標分割算法可以實現任意類別、不同實例的目標前背景分離,因此,分別利用COCO[20]和PASCAL[21](SBD[22]的擴展)數據集,構造本文實驗所用的目標分割數據集。具體步驟為:首先,分別在原數據集的圖像中提取每一個實例;然后,以任意大小、任意位置的矩形剪裁出該實例以形成新的圖像和真值對。由于COCO和PASCAL數據集的一張圖像中平均包含3個~5個實例,因此構造出的新數據集的規模也相應地比原始數據集大3倍~5倍,從而保證了數據的豐富性。需要說明的是,下文提到COCO和PASCAL數據集時,均指本文實驗新構造出的交互式目標分割數據集。同時,為了進一步保證仿真交互的多樣性,即一張圖像可以有多種甚至無數種交互方式,本文實驗沒有提前一次性地為所有訓練數據生成仿真交互圖,而是在訓練過程中實時地進行仿真交互,使得同一張圖重復出現時其對應的交互結果不一樣,符合現實中的交互分割邏輯。

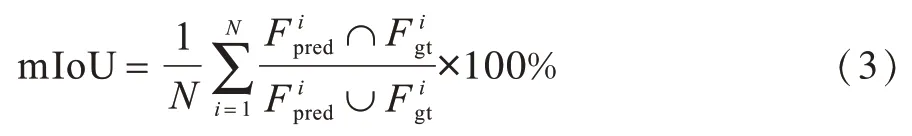

在單類別前背景分割問題中,本文實驗使用目標前景的mIoU(mean Intersection over Union)作為結果衡量指標,其具體計算方式如式(3)所示:

其中,N表示數據規模,F表示前景目標區域。

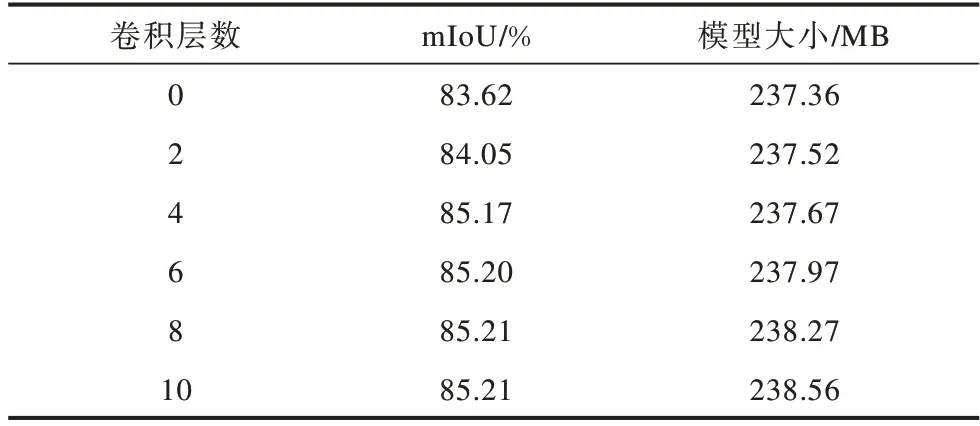

3.2 優化階段的網絡設計

雙階段級聯的網絡框架會因為網絡層的增多而提高運算量。為了保證預測結果的精細化,避免由于特征分辨率的變化造成細節精度降低的問題,優化階段的網絡均由相同原始分辨率下的卷積和非線性激活層構成。為了在預測精度和運算量(優化階段網絡層數目)之間實現折中,本文進行優化階段的網絡設計實驗。

當優化階段的特征通道數為64、取不同數目的卷積激活層時,模型的預測精度和模型大小如表1所示。從表1可以看出:當卷積層數為0即僅有粗分割階段而不添加優化階段時,初始模型大小為237.36 MB;在優化階段中增加少量卷積層,網絡規模小幅增加;當網絡層數為4時,預測精度的提升相對較大,模型規模僅增加0.31 MB,此時的雙階段網絡結構在增加少許運算量的情況下取得了較大幅度的預測精度提升,說明了本文網絡結構的合理性。

表1 優化階段不同卷積層數下的模型大小和mIoU值Table 1 Model sizes and mIoU values under different convolution levels in optimization stage

3.3 雙階段網絡的有效性實驗

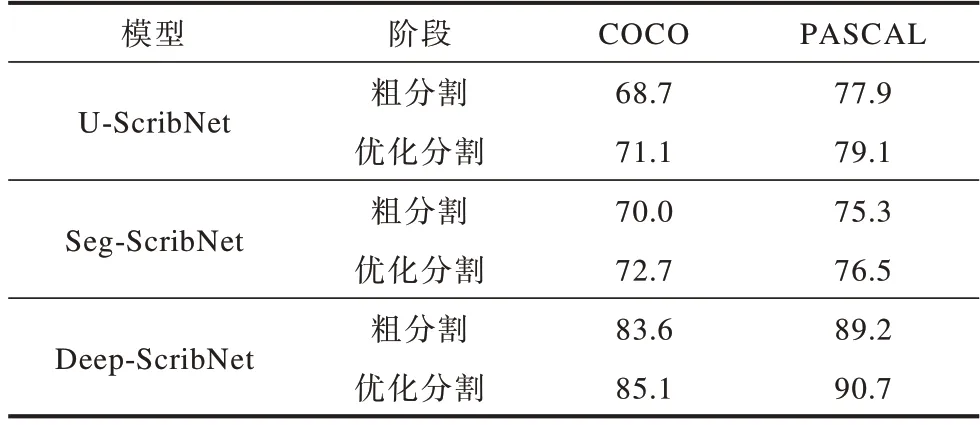

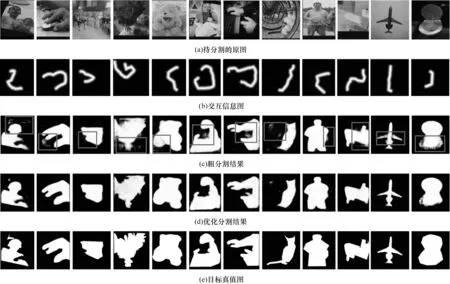

本文雙階段網絡的目的是在交互式目標分割任務中實現更為精細的目標分割,網絡由分割和優化2個階段構成,在2個階段的末端均有結果預測和真值監督。為體現ScribNet中優化階段的有效性,本文分別將U-Net[3]、SegNet[19]和Deeplab[16]3個分割網絡應用于ScribNet的第1個粗分割階段,并分別記作U-ScribNet、Seg-ScribNet和Deep-ScribNet。在COCO和PASCAL數據集上進行預測,統計3個ScribNet模型在各自2個階段中的預測mIoU值,結果如表2所示,同時,為了更直觀地顯示雙階段網絡在提高目標邊緣精度和分割完整性上的優勢,通過圖5呈現表2中Deep-ScribNet模型的部分可視化結果。

表2 ScribNet的粗分割和優化分割結果對比Table 2 Comparison of coarse segmentation and optimized segmentation results of ScribNet %

圖5 不同階段的分割結果對比Fig.5 Comparison of segmentation results in different stages

從表2可以看出,粗分割的預測結果精度較低,優化階段是對初始預測結果的進一步細化,優化階段的添加使得3個模型的預測精度均比粗分割提高了1個~3個百分點。通過圖5中粗、細預測的對比結果可以看出,優化階段的精細化主要體現在目標邊緣的銳化、前景響應值的增強和背景響應值的抑制。在圖中矩形框區域,粗分割會在某些背景處產生較高的響應值,這些錯誤響應在優化階段中被有效抑制和糾正;相反地,在粗分割中響應較弱的目標主體在優化階段也得到了加強,緩解了由于目標交叉造成的預測混淆問題。因此,雙階段網絡的框架設計能夠有效實現對圖像的精細化分割。

3.4 不同方法對比實驗

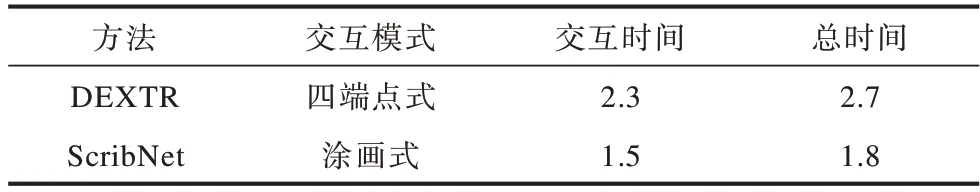

為體現涂畫式交互方法在時間上的高效性,本文將DEXTR[13]與ScribNet進行比較,其中,DEXTR采用四端點式交互,ScribNet采用涂畫式交互。實驗分別從COCO和PASCAL驗證集中隨機抽取500張圖像進行實際人工交互,統計平均交互時間,結果如表3所示。四端點式交互由于需要精準地找到4個頂點,平均每張圖像需要消耗2.3 s的時間,而涂畫式交互平均只消耗1.5 s時間,后者更為高效。2種方法的分割網絡運行時間均只需要300 ms左右,可見,交互操作占據了整個交互式分割過程的大部分時間,交互效率的提高對整個系統的性能提升具有重要意義。

表3 不同交互方式的交互時間對比Table 3 Comparison of interaction time of different interaction modess

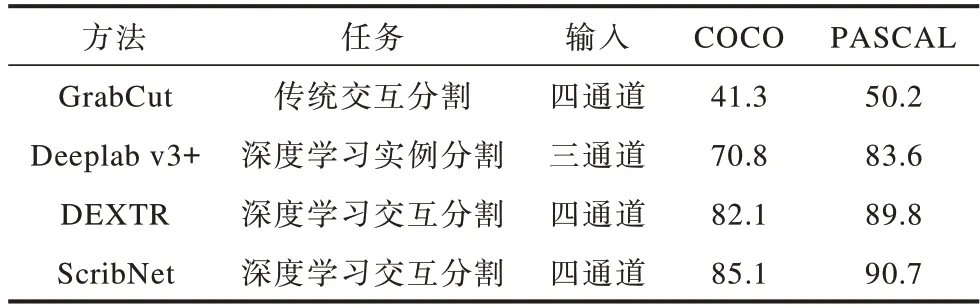

為了驗證ScribNet中交互指導信息圖及雙階段網絡結構的有效性,本文將ScribNet與基于傳統機器學習的交互式分割方法GrabCut[12]、基于深度學習的實例分割方法Deeplab v3+[16]以及DEXTR方法[13]進行比較,表4所示為COCO和PASCAL驗證集上的分割mIoU結果對比。

表4 不同方法的分割精度對比Table 4 Comparison of segmentation accuracy of different methods %

從表4可以看出,Deeplab v3+為三通道輸入的自動圖像分割方法,ScribNet為四通道輸入的交互式圖像分割方法,后者相對前者在COCO和PASCAL數據集上的精度分別提升14.3個和7.1個百分點,輸入的交互信息通道向網絡提供了待分割目標的位置信息,從而大幅提高了預測精度。3種交互式分割方法相比,ScribNet在2個數據集上較GrabCut有顯著的精度提升,在PASCAL和COCO數據集上的精度相比DEXTR分別提升了0.9個和3.0個百分點。

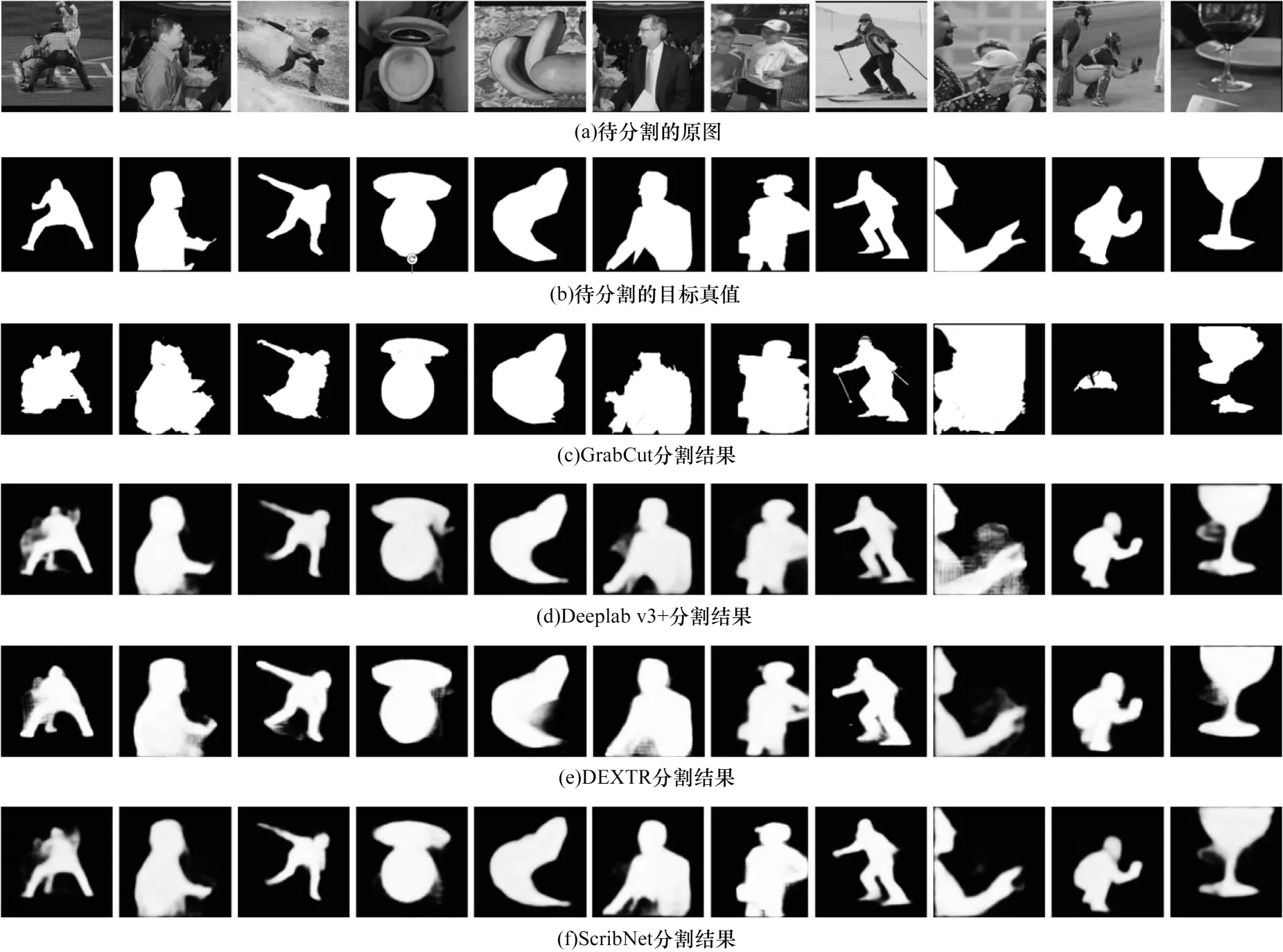

圖6所示為上述算法的一組可視化結果,從圖6可以看出,ScribNet在目標完整度、邊緣精度以及對交叉目標的區分等方面均優于其他方法。

圖6 不同方法的分割結果對比Fig.6 Comparison of segmentation results of different methods

4 結束語

本文針對交互式目標分割任務,提出一種基于雙階段網絡的交互式目標分割方法。采用涂畫式交互方式提高實際交互的魯棒性和容錯率,通過骨架仿真算法節省大數據交互標注的人力成本。將交互信息編碼輸入網絡,實現交互信息的直接利用,添加優化模塊構成雙階段網絡結構,通過多次充分利用輸入信息來提高分割結果的邊緣精度和目標完整度。實驗結果驗證了該方法的高效性。后續將在網絡的不同特征尺度階段,通過多階段監督學習等方式來充分利用交互信息,以進一步提高交互分割的精度。