基于多級注意力跳躍連接網絡的行人屬性識別

王 林,李聰會

(西安理工大學自動化與信息工程學院,西安 710048)

0 概述

行人屬性識別是智能監控領域的研究熱點之一,其主要任務是識別監控圖像或視頻中的行人視覺屬性,如性別、年齡和著裝等語義信息,可應用于安防監控、客群分析和實時廣告精準投放等諸多任務,具有廣闊的市場應用前景。傳統的行人屬性識別方法側重于從手工特征、分類器模型等角度來挖掘更具魯棒性的特征表達,這類研究方法大多為各屬性訓練單獨的二值分類模型,依賴于研究人員的經驗,而忽略了屬性間的語義關系,難以適應場景的復雜性和屬性特征的多樣性。

隨著計算機性能的提升和數據資源的豐富,深度學習在計算機視覺等領域快速發展。近年來,研究人員嘗試使用卷積神經網絡(Convolutional Neural Networks,CNN)作為表征行人屬性特征的工具,并取得了突破性的進展。文獻[1]將行人圖像作為識別模型的輸入,無需考慮人體姿態[2]、圖像塊[3-4]及上下文信息[5]而對所有屬性進行預測,該方法雖然簡單直觀,但缺乏對細粒度屬性特征的考量。文獻[6]將人體劃分為15個可重疊的部分并為每個部分訓練CNN模型,根據空間約束關系選擇對應的模型進行屬性預測。雖然利用部件信息[7-8]可以提高模型的整體性能,但作為一種中間階段的操作,部件定位需要更多的訓練和推理時間,甚至需要人工標注部件位置。文獻[9]提出的基于注意力機制的深度網絡(HydraPlus-Net,HP-Net),通過整合從局部到整體等多級注意力特征來提升模型對細粒度特征的表達能力。文獻[10]從網絡的多個階段提取以弱監督方式學習到的視覺注意力掩碼,并引入注意力損失函數以防訓練失衡。文獻[11]將視圖預測作為行人屬性推斷的關鍵線索,并從網絡的后續層中分離出特定視圖的屬性預測單元。

綜上,結合注意力機制的神經網絡屬性分類方法能使網絡在較小能耗下提取屬性相關位置的關鍵信息,具有較好的映射表達能力,可突破傳統方法的局限,但若將其應用于實際場景中仍存在一些問題,一是對于正樣本尺寸較小的細粒度屬性(如眼鏡、圍巾等)識別準確率較低,二是在實際場景中各屬性類別的類內差異較大(如外觀尺寸多樣性和外觀模糊性),三是不同屬性的收斂速度不同,從而導致各行人屬性在網絡訓練過程中相互影響。

針對上述問題,本文基于殘差網絡(Residual Network,ResNet)[12],提出一種多級注意力跳躍連接(Multi-Level Attention Skip Connection,MLASC-Net)網絡,分別在PETA[13]和RAP[14]經典數據集上聯合訓練所有屬性,以有效傳遞和重用屬性間的信息。在設計的MLASC模塊中,注意力模塊主要用于增強網絡對屬性信息的敏感性,使得特征表示更加緊湊,提高網絡對關鍵特征的提取篩選能力,而多級跳躍連接結構通過嵌套的跨層級連接,既保留了淺層的細粒度信息,又有利于梯度的反向傳播。此外,采用改進的空間金字塔池化方法[15]來替代網絡頂層的池化層,從而更全面地集成不同尺度和抽象層次的屬性信息。在網絡輸出層,利用自適應加權損失層加快模型的收斂速度,以進一步提升行人屬性識別的準確率和效率。

1 改進的行人屬性識別方法

1.1 網絡模型

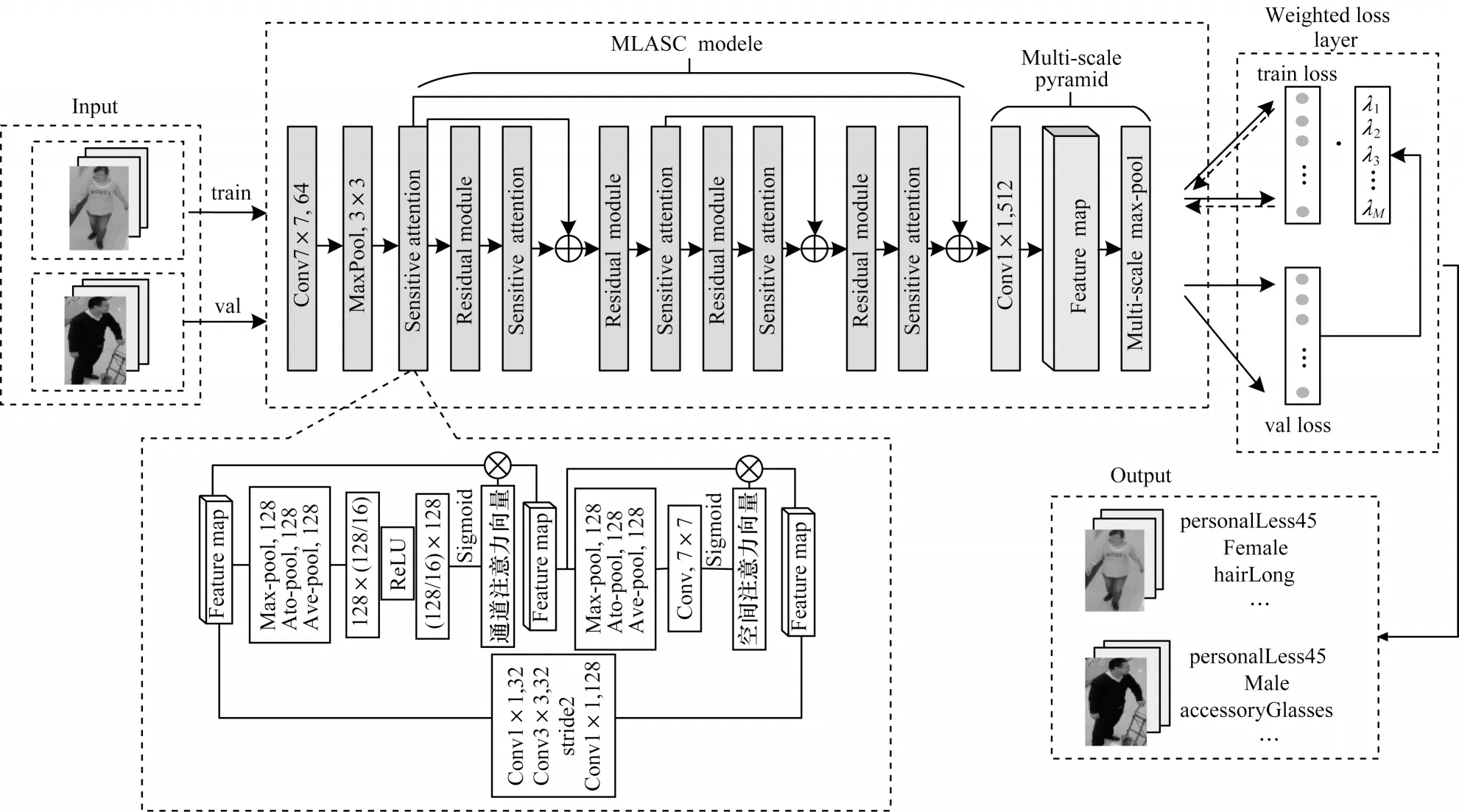

本文所采用的神經網絡主體結構如圖1所示,主要由ResNet50殘差網絡區塊、MLASC模塊、多尺度金字塔及自適應加權損失層四部分組成。首先,借助MLASC模塊對輸入的行人圖像進行淺層及深層特征提取,通過敏感注意力模塊將局部特征與其全局依賴關系相結合,突出目標屬性對應的重點區域及關鍵特征,并將縮放的注意力加權特征進行多級跨越連接,從而將特征傳遞給后續網絡層。在網絡頂層利用改進的金字塔實現多尺度特征表達,同時利用自適應加權損失層來衡量和學習不同屬性任務間的關系,動態調整各屬性任務的權重,最終實現對行人屬性的預測。

圖1 本文行人屬性識別網絡結構Fig.1 Structure of pedestrian attribute recognition network in this paper

1.2 多級注意力跳躍連接MLASC模塊

1.2.1 敏感注意力模塊

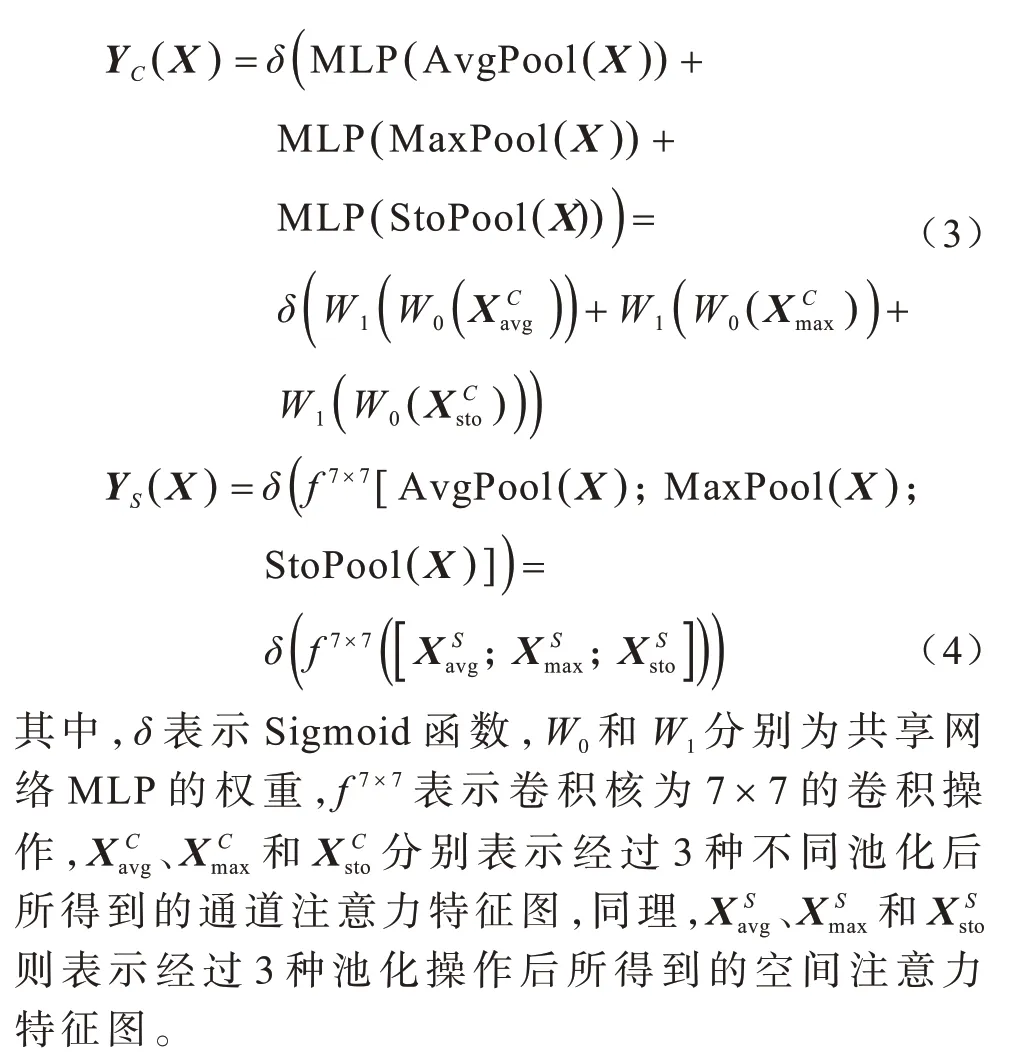

為了增強網絡對不同屬性信息的敏感性,有效促進網絡的信息流動,本文借鑒并改進文獻[16-17]中的注意力機制,先后對通道及空間的特征信息進行篩選,改進的敏感注意力模塊網絡結構如圖2所示。

圖2 敏感注意力模塊Fig.2 Sensitive attention module

改進的敏感注意力模塊主要分為核心分支和輔助分支2個部分,核心分支由通道和空間注意力單元組成,在average-pooling、max-pooling的基礎上設計添加stochastic-pooling操作以完善所提取的特征并減少關鍵信息的損失。此外,為了使網絡達到更好的適應性,本文設計一組殘差塊作為輔助分支,降低2個分支在同一網絡層聚合后的特征差異,從而更易與殘差模塊堆疊形成深度卷積網絡。核心分支對于特征圖Χ的處理過程可表示為:

其中,?表示對應矩陣相乘,Χ′、Χ″分別表示經過通道和空間注意力篩選加權處理后的特征圖。中間特征圖經過核心分支精修后,依次生成一維通道注意力圖YC∈?C×1×1和二維空間注意力圖YS∈?1×H×W,其計算過程分別如式(3)、式(4)所示:

1.2.2 多級跳躍連接

殘差網絡的跳躍連接結構已被證明在解決神經網絡的梯度消失及梯度爆炸問題中具有有效性,不同于此類原始的跳躍連接結構,本文所討論的多級跳躍連接主要針對所采用的敏感注意力模塊,通過在每2個注意力模塊之間增加一個跳躍連接,保留并重用來自淺層的細粒度信息和局部信息,并與下級注意力特征進行逐元素加和,以確保局部特征不會因為特征通道的變化而導致較多的信息損失。此外,對于首尾2個注意力模塊再疊加一組跨度更廣的跳躍連接,一方面有利于維持網絡在反向傳播過程中的梯度流,另一方面將注意力模塊的顯著性特征的補償跨度進一步拉大,實現屬性信息從低級到高級的層級提取。

1.3 多尺度金字塔池化

由于卷積殘差網絡在特征提取的過程中側重于融合不同卷積層的全局特征,忽略了同一卷積層上多尺度局部區域特征的充分融合,缺乏對場景中小目標的預測能力,因此本文對空間金字塔池化方法進行改進:首先采用1×1的卷積將通道數減少到512,然后按照4種不同的尺度進行最大池化,以更好地保留注意力模塊約束或增強后的特征表達。改進后的多尺度金字塔中的滑動窗口和特征圖大小分別為Spool×Spool、Sfmap×Sfmap,兩者的關系可表示為:

令ni=1,2,3,4,將會得到4種不同尺度的滑動窗口,根據不同的滑動窗口來集成不同尺度的特征信息。其中,池化的步長為1,利用填充操作來保證輸出特征圖大小恒定,然后將得到的不同尺度的特征圖進行疊加,最終輸出2 048維的特征向量。

1.4 自適應加權策略

由于多任務學習中的共享策略可能會帶來負遷移問題,即當學習任務不同時,不充分的強制遷移學習可能會影響網絡的學習效率。同時,網絡在針對不同的學習任務時具有不同的學習難度和收斂速率,如行人衣服顏色比性別屬性容易識別。因此,本文去掉原有的損失層,通過計算不同屬性任務在驗證集上的損失變化趨勢及占比率來更新下一輪訓練中各屬性任務的權重,并反向傳播至前層網絡,改進后的網絡結構如圖1所示。通過一種能夠自適應學習不同任務間關系的內部共享機制,并結合驗證損失算法[18]實現各屬性任務權重的動態調整,以兼顧任務間的相關性和模型的復雜性。

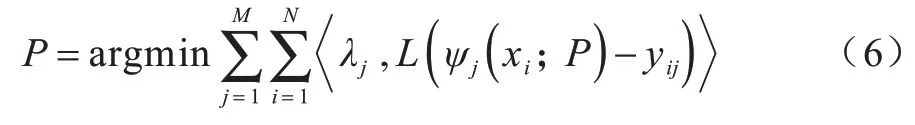

為了避免以相同的權重強制網絡學習不同的屬性任務,本文采取自適應加權策略來建模訓練樣本的預期損失,建模過程如式(6)所示:

其中,P為網絡的優化參數集,M、N分別表示屬性數及樣本數,〈·〉表示內積操作,λj為屬性j的權重,L(·)為損失函數,xi為輸入樣本i,yij為樣本i中屬性j的實際值,ψj為屬性j的預測函數。

1.5 多尺度樣本訓練

在實際場景中,遠處和近處的行人目標尺寸通常存在較大差異,結合相機的成像原理,同一目標處在與相機不同距離的區域時,成像效果也會有所區別。考慮到若采用單一尺度的行人樣本進行訓練,會出現行人屬性的漏檢或錯檢現象,因此,本文在網絡訓練時采用多尺度訓練,利用雙線性插值算法為每個樣本設置3種尺寸,按比例將原圖像縮放0.5倍、1.0倍和1.5倍。對于每個樣本,隨機選擇其中一種尺寸輸入至模型中進行訓練,從而均衡訓練目標的多樣性分布,提高網絡模型對于不同尺寸目標的魯棒性。

2 實驗結果與分析

2.1 實驗數據集

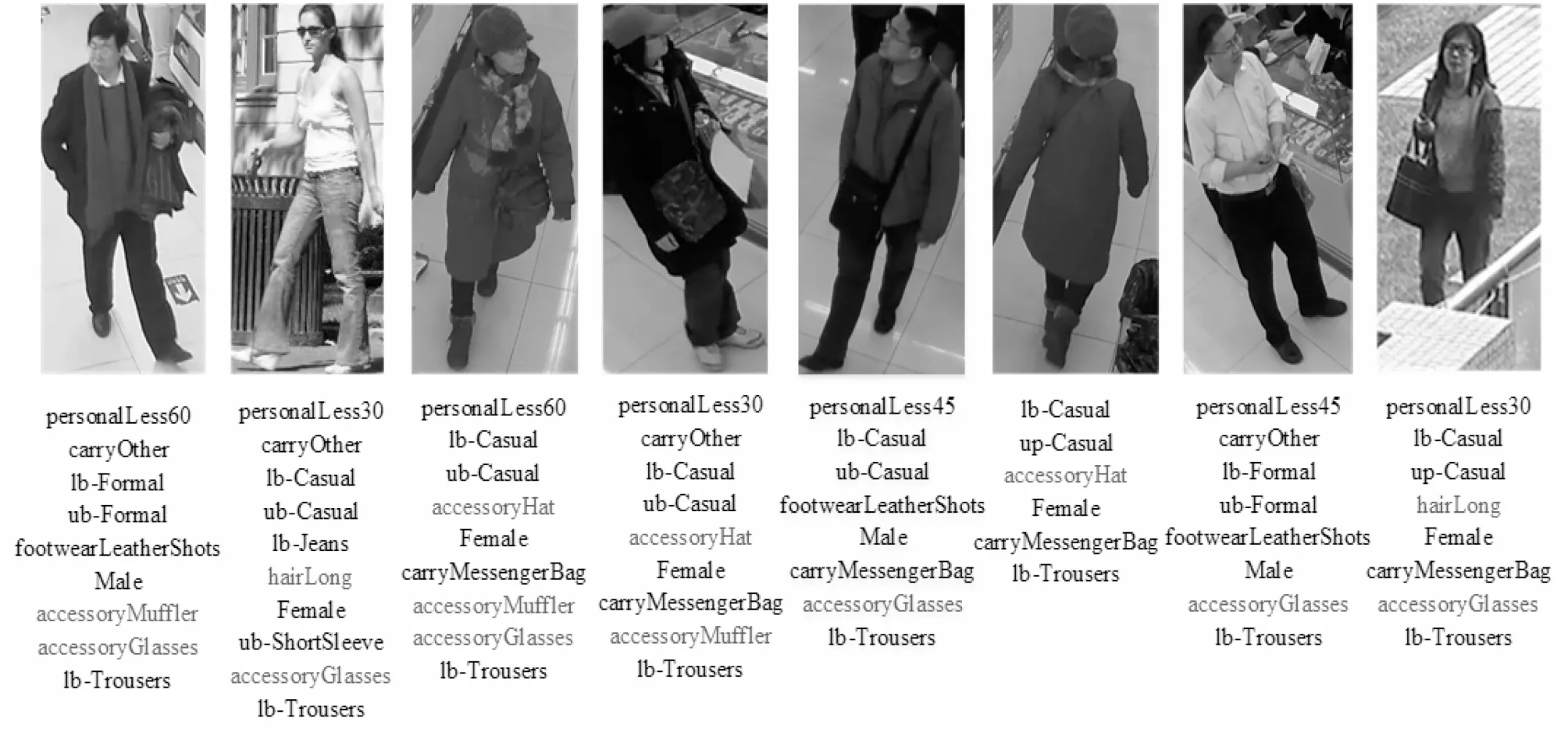

為了驗證本文所提MLASC-Net網絡在行人屬性識別任務中的有效性,采用PETA和RAP數據集進行實驗,其中,PETA數據集包含不同場景和不同條件下的19 000張行人圖像,訓練集包含9 500張行人圖像,驗證集為1 900張,其余7 600張作為測試集。RAP數據集共有41 585個行人樣本,收集于多攝像頭所拍攝的室內場景。為了保證實驗更具可靠性和說服力,本文分別選取PETA和RAP數據集中的通用屬性進行評估,數據集中的部分行人樣本如圖3所示。

圖3 數據集部分樣本Fig.3 Some samples of datasets

2.2 結果分析

為了評估MLASC-Net在解決行人屬性分類問題時的有效性,采用以下2種評價指標來衡量模型性能:

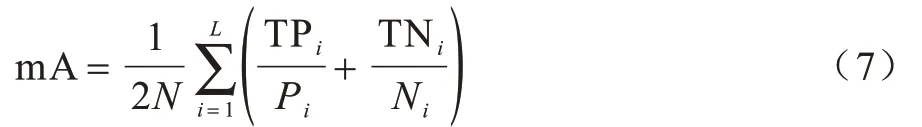

1)基于標簽的評價指標——平均準確率(mA),計算公式如下:

其中,N為樣本數,L為屬性個數,Pi、TPi分別表示屬性i中的正樣本數和被正確預測的正樣本數,Ni、TNi分別表示屬性i中的負樣本數和被正確預測的負樣本數。

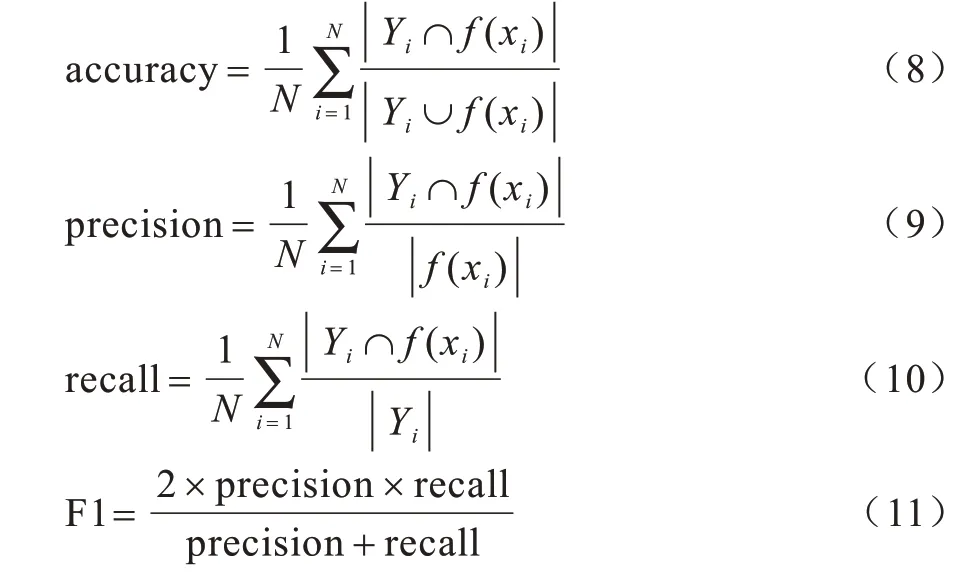

2)基于樣本的評價指標——準確率(accuracy)、精確率(precision)、召回率(recall)、F1值,這種評估方式可以使用多屬性聯合學習模型。4個指標計算公式分別如下:

其中,Yi、(fx)i分別表示第i個樣本真值中的正標簽、第i個樣本預測標簽中的正標簽,|·|為集合基數。

本文算法采用Pytorch框架,在GTX 1080Ti GPU(11 GB顯存)、64位Centos7計算機系統下進行相關實驗,并分析屬性分類結果,實驗主要分為以下4個部分:

實驗1不同屬性識別方法性能對比

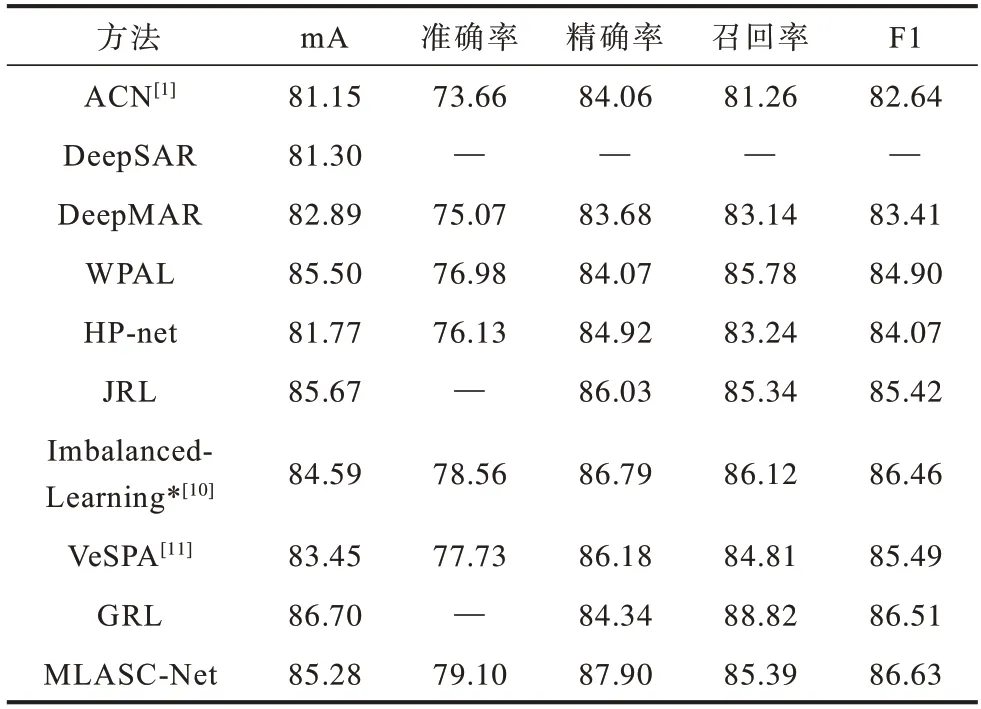

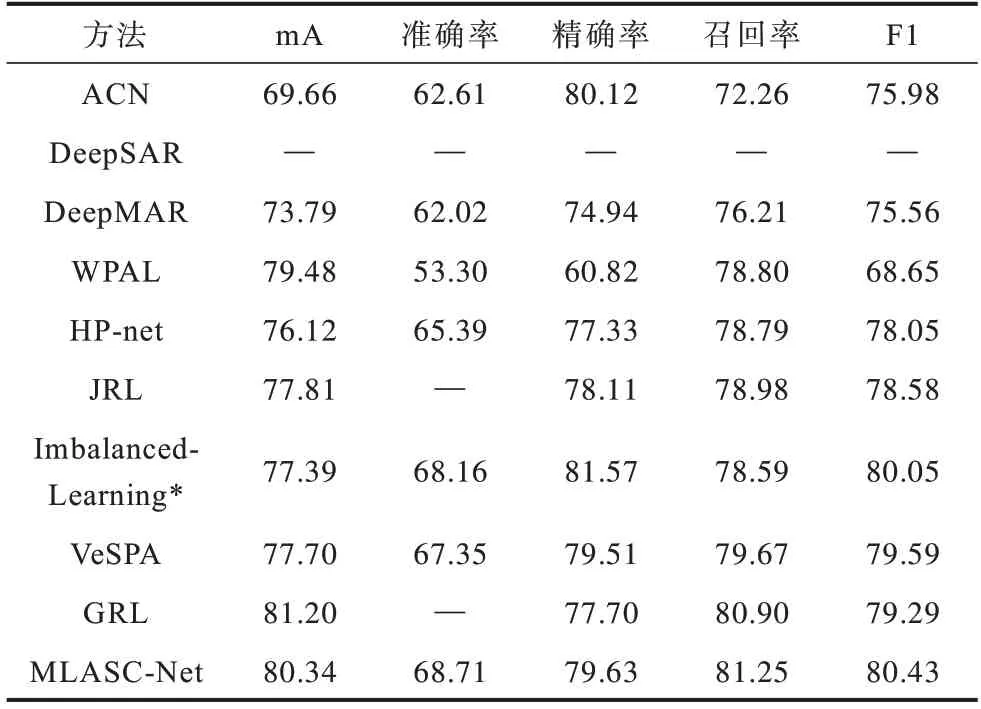

將本文MLASC-Net與深度單屬性識別(DeepSAR)、多屬性識別(DeepMAR)[19]、弱監督行人屬性定位網絡(WPAL-network)[20]、HP-net[9]、聯合循環學習模型(JRL)[21]和分組循環學習模型(GRL)[22]等方法進行對比,各方法在PETA和RAP數據集上的實驗結果分別如表1、表2所示。

表1 PETA數據集上不同方法的性能對比結果Table 1 Performance comparison results of different methods on PETA dataset %

表2 RAP數據集上不同方法的性能對比結果Table 2 Performance comparison results of different methods on RAP dataset %

從表1、表2可以看出,由于DeepSAR對每個屬性優化單獨的二值分類模型,未考慮各屬性間的關系,而其他方法均聯合訓練所有屬性,模型預測平均準確率均優于DeepSAR。對比其他方法,本文在殘差網絡的基礎上設計MLASC模塊和多尺度金字塔單元,同時結合加權損失層提高模型的整體性能。在2個數據集上,MLASC-Net均有3個基于樣本的評價指標達到了最高值,而對于基于標簽的度量指標mA,MLASC-Net略低于GRL方法,但相對其他多數方法仍有明顯優勢,該結果驗證了MLASC-Net在行人屬性識別任務中的有效性。

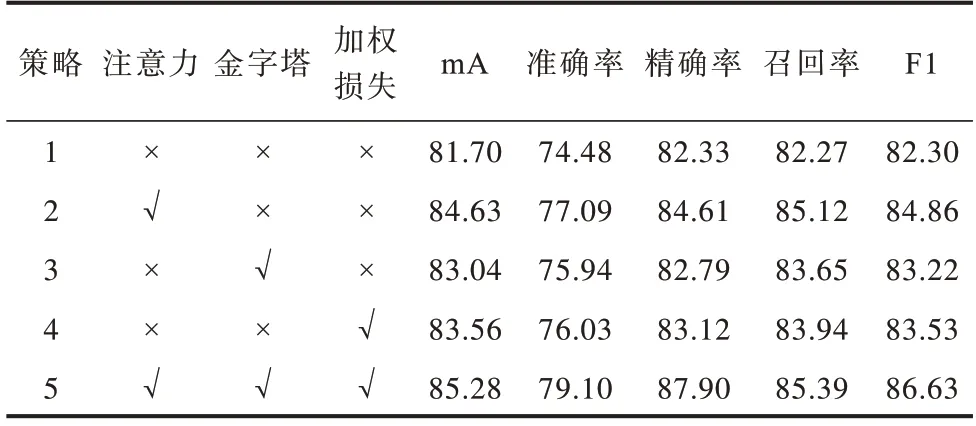

實驗2采用不同策略訓練網絡的識別效果

本文所采用的行人屬性識別方法中包含3個新的模塊:1)MLASC模塊,可以提升網絡對行人不同目標屬性的針對性;2)改進的多尺度金字塔單元,用以提取行人多尺度局部區域特征;3)在損失層引入了自適應加權策略。為了進一步評估各模塊對網絡性能的影響,本次實驗以未加入MLASC模塊和多尺度金字塔單元以及自適應加權策略的原網絡(baseline網絡)為基準,在此基礎上,將注意力(即MLASC模塊)、金字塔和加權損失視為3個實驗變量進行一系列消融實驗,在PETA與RAP數據集上的實驗結果分別如表3、表4所示。其中,“√”表示加入該模塊,“×”表示未加入該模塊。

表3 PETA數據集上采用不同策略訓練網絡時的識別效果對比Table 3 Comparison of recognition effect when training network with different strategies on PETA dataset %

表4 RAP數據集上采用不同策略訓練網絡時的識別效果對比Table 4 Comparison of recognition effect when training network with different strategies on RAP dataset %

對比表3、表4中策略1、策略5的實驗結果可以看出,相比于baseline網絡,MLASC模塊在mA、準確率、精確率、召回率和F1這5項指標上的分類性能均有所提高,其中,在PETA和RAP數據集上的識別準確率分別提高約4.62和6.54個百分點,這說明網絡在抽取不同屬性的相關特征時更具偏向性,模型的判別能力增強。對比策略1和策略3發現,采用改進的多尺度金字塔能夠使得模型對不同尺度的行人屬性更具魯棒性,增強模型的泛化能力。對比策略1和策略4發現,由于網絡通過衡量損失變化趨勢為各屬性賦予動態權重參數,從而調度不同的屬性任務,使得模型的各項性能指標均有顯著提升。通過策略1~策略4的對比可以看出,MLASC模塊對于提升模型性能的貢獻最大,損失加權策略的貢獻次之。實驗結果表明,本文所采用的MLASC模塊、多尺度金字塔以及損失加權策略,均能有效提升屬性識別模型的判別能力。

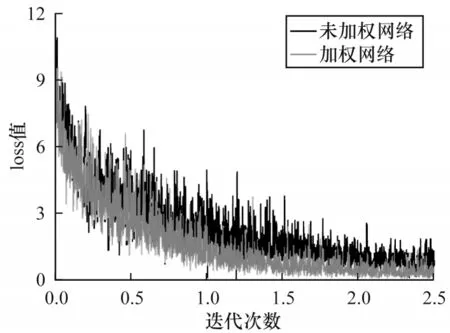

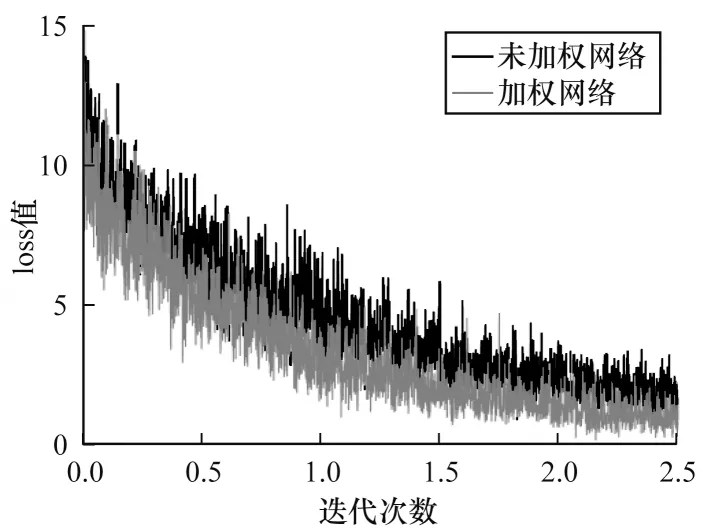

實驗3模型收斂速度對比

多信息模型自適應加權的思想就是在網絡訓練的過程中動態調度不同的目標任務,以得到優化的參數集合并加速模型的收斂。為了衡量自適應加權策略的有效性,本次實驗將對未加權網絡及動態加權網絡在訓練過程中loss值的變化趨勢進行對比分析,在PETA與RAP 2個數據集上的實驗結果分別如圖4、圖5所示。

圖4 PETA數據集上模型收斂速度對比Fig.4 Comparison of model convergence rates on PETA dataset

圖5 RAP數據集上模型收斂速度對比Fig.5 Comparison of model convergence rates on RAP dataset

從圖4、圖5可以看出,未加權網絡為各屬性任務賦予相同的權重參數,而加權網絡在訓練過程中可以階段性地衡量不同任務的重要程度,從而動態地指導任務調度,因此,加權網絡在PETA數據集上迭代至16 000次左右開始收斂,而未加權網絡在迭代次數達到約20 000次時趨近收斂。同理,在RAP數據集上加權網絡的收斂速度也快于未加權網絡。此外,由于網絡對具有不同學習難度及收斂速度的屬性賦予不同的權重,緩解了多屬性任務間的負遷移問題,因此從整體上來看,在相同迭代次數時加權網絡的loss值相對較低。在2個數據集上的實驗結果均表明,本文所采用的自適應加權策略可以有效加速模型的收斂并提高精度。

實驗4MLASC-Net的屬性識別結果

為了進一步驗證本文MLASC-Net的有效性,本次實驗隨機選取了測試數據集中不同視角、目標較模糊等不同場景下的單個行人樣本進行屬性識別,實驗結果如圖6所示,每個行人圖像下方是其對應的屬性預測結果,其中,淺色字體為細粒度屬性,如帽子、頭發和眼鏡。從圖6可以看出,第3個和第6個為同一行人在不同視角下的圖像,性別、背包、帽子和服裝屬性的檢測結果相同,但由于行人正面比背面的屬性信息更為豐富全面,因此,第3個樣本中的年齡范圍、圍巾、眼鏡屬性均被檢測出。綜合其他行人樣本的屬性識別結果得出,MLASC-Net可有效提高網絡對細粒度屬性的魯棒性。

圖6 MLASC-Net的屬性識別結果Fig.6 Attribute recognition results of MLASC-Net

3 結束語

本文提出多級注意力跳躍連接網絡MLASC-Net,以進行行人屬性識別。通過MLASC模塊和多尺度金字塔克服圖像編碼表征存在的局限性,增強網絡對屬性信息的敏感性。此外,自適應加權損失層不僅有利于模型訓練,同時盡可能地規避了不同屬性任務間的沖突。實驗結果表明,MLASC-Net能夠自動提取行人屬性的關鍵特征,訓練出的模型對于多尺度屬性具有良好的魯棒性和泛化能力。但是,本文實驗中還存在屬性樣本比例不均衡的問題,下一步將采集復雜環境下的行人圖像或視頻來擴充數據集,從而平衡屬性樣本并進一步提升識別效果。