基于知識庫對齊的命名實體識別方法

魯佩佩

摘要:訓練語料庫的貧乏對低資源語種的命名實體識別效果有很大影響,高資源語種向低資源語種進行標簽投影解決了低資源語種的語料問題。但由于詞典的投影昂貴且單一,而Wikidata提供多語詞條,一對多的標注投影極大地減少了投影產生的噪聲,通過易獲得的雙語平行文本,基于Wikidata詞條可構建多語種知識庫,完成標簽投影,構建訓練語料庫,提升低資源語種實體的識別功能。

關鍵詞:低資源語種;知識庫;命名實體識別;標簽投影

中文圖書分類號:TP393? ? ? 文獻標識碼:A

文章編號:1009-3044(2021)04-0184-03

命名實體識別任務的研究從基于規則、基于統計到基于深度學習,雖然深度學習的研究方法在英文等語種的實體識別中有極優的效果,但是對于沒有足夠多標注數據的低資源語種來說,深度學習模型效果不理想。

對于低資源語種的命名實體識別,文獻[1]主要實現了基于統計與規則相結合的人名通過條件隨機場識別;文獻[2]提出了基于學習的實體識別學習框架,向已有特定領域的模型進行學習,并遷移到任意神經網絡模型,避免受到數據噪聲的干擾;文獻[3]使用并行數據將詞性信息從資源豐富的語言傳輸到資源貧乏的語言使用少量帶注釋的數據來學習糾正錯誤,使用少量帶標注的訓練數據通過單詞對齊進行標簽投影來進行半監督學習。

本文將關系抽取中使用較廣泛的遠程監督方法應用到命名實體識別中,通過Wikidata[4]構建多語種知識庫,基于知識庫詞條對實體標簽投影。對于投影產生的標注數據,使用BILSTM處理輸入,輸出層后連接CRF對輸出結果進行約束。

1數據預處理及遠程監督知識庫構建

遠程監督是由Mintz[5]提出的一種弱監督學習方法,多用于進行信息抽取中的關系抽取領域,它主要是通過現有的知識庫對齊大量的無標注語料庫來構建監督學習所需的知識關系語料,可以用來解決監督學習中標注語料不足的問題,則對于本文涉及的低資源語種的標注數據量不足的問題,可通過遠程監督,通過對齊知識庫,構建低資源語種的實體標注語料庫。

1.1Wikidata構建知識庫

在Wikidata知識庫中,詞條數目超過四千萬,數據存儲以三元組的“主謂賓”方式。對于語句“新褲子樂隊的成員有彭磊、龐寬、趙夢和Hayato”則有三元組“name(entity)-member(relationship)-Hayato(entity)”。對Wikidata的數據查詢使用SPARQL[6]語言,它的主要操作是根據給定的關系,從三元組中獲得關系兩側的實體。

1.2基于Selenium的爬蟲翻譯

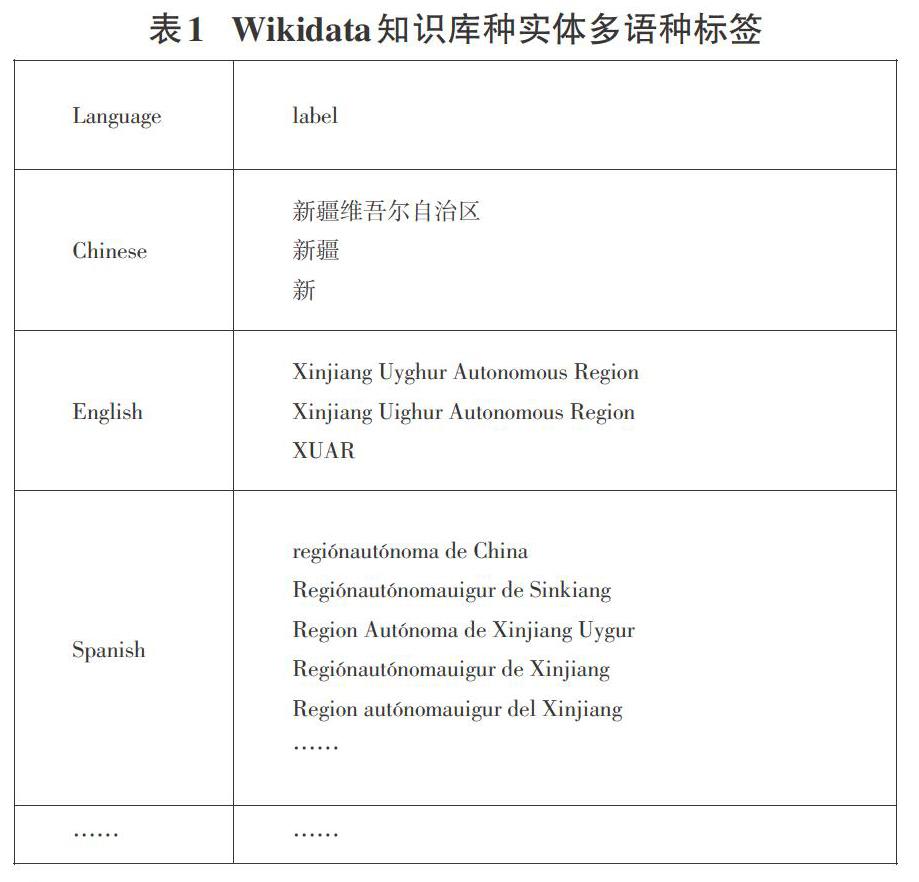

目前,谷歌翻譯支持109種語言,在構建知識庫時,因為實體的全稱或簡稱有多種,但都代表此實體,如表1所示,Wikidata中,新疆這個詞條對應的各語言個數存在多個,其中,西班牙語(Spanish)對應21個。此外,為了投影覆蓋率,本文基于谷歌翻譯,通過Selenium爬蟲工具,優化補足知識庫。

1.3基于知識庫的標注投影

根據前面的操作步驟,可以完成基本知識庫構建,主要存儲在neo4j數據庫中,如圖1所示:

對于平行語料的雙語文本,基于知識庫的投影如圖2所示,之后對目標語言投影結果分解,就可得到命名實體標注序列:B-PEROOB-LOC I-LOC I-LOCI-LOCI-LOC。

2命名實體識別模型

實體識別模型主要采用BILSTM-CRF[7],如圖3所示,其中BILSTM是由雙向的LSTM組成,此構造可以充分利用上下文信息,把正向和反向兩個方向計算的值拼接作為CRF層的輸入,BILSTM的輸出是標簽的概率值,在BILSTM后接入CRF層主要是預測標簽時可以充分考慮上下文關聯,規避如“B-ORG”后接“I-PER”的情況。

其中,長短期記憶網絡(long short-term memory, LSTM)結構如圖4所示,圖中G1,G2,G3表示門單元結構。G1通過sigmod激活函數處理上一隱藏狀態以及當前輸入來決定是否忘記上一隱藏狀態。G2通過sigmod和tanh來處理當前序列位置的輸入,G3則通過序列輸入和控制參數的輸出,決定需遺忘和需記憶的信息,得到當前位置的狀態。計算如下:

3實驗

3.1實驗數據集

本文雙語平行語料庫主要采用歐洲議會平行語料庫1996-2011,它包括21種歐洲語言,實驗中選取西班牙語-英語的平行語料,測試集采用CoNLL2002數據集,該數據集包含西班牙語和荷蘭語兩個語種,本文選取西班牙語的測試集進行測試。實驗數據詳情見表2:

3.2標注方式和評價標準

本文采用的是BIO標注,對人名、地名和機構名三類實體進行識別操作。評價標準采用精確率(P)、召回率(R)和F1值,定義如下:

3.3知識庫構建及訓練文本生成

對于平行文本,首先使用StanfordCorenlp工具對英語文本進行命名實體識別,該工具主要識別八種類型:O、MISC、LOCATION、GPE、FACILITY、ORGANIZATION、DEMONYM和PERSON,本文主要進行PERSON、LOCATION和ORGANIZATION的識別。源語種文本實體數如表3所示。根據實體識別生成的詞條,從Wikidata中獲得相應實體的西班牙語表示,再投影至西班牙語文本,形成訓練數據。

3.4基于BILSTM-CRF模型進行西班牙語命名實體識別

為了對比不同方法對低資源語種命名實體識別的效果,本文對比CRF模型、BILSTM模型和BILSTM-CRF模型對于只有少量訓練數據的語言進行訓練的結果,選取CoNLL2002語料庫中的200條數據進行訓練。之后再將本文生成的投影數據單獨使用BILSTM-CRF模型進行訓練,參數設置如下:學習率為0.01,dropout為0.5,訓練周期為20,詞向量維度100,隱藏層維度為100,優化器為SGD(Stochastic Gradient Descent)。實驗結果如表4所示:

實驗結果表明,對于只有少量訓練語料數據的低資源語種來看,測試中識別效果很差,對比CRF、BILSTM和BILSTM-CRF模型, BILSTM獲取了詞語前后的歷史信息,融入了詞語的上下文信息,相比于CRF模型,精確率卻下降了18%,因為訓練數量過少,命名實體少,但相對于測試集,命名實體多了很多,所以在召回率和F1的值中效果就會較差。輸出層后通過CRF約束可實現16.42%的改進。通過平行文本進行實體投影的語料來說,雖然投影中會產生不必要的噪聲,但可以在沒有訓練語料的情況下,僅僅通過平行文本,就可達到11%的提升。

4 結束語

在命名實體識別的研究中,對于訓練語料庫豐富的高資源語種可以達到幾近完全正確,而對于低資源語種,由于訓練數據的貧乏,深度學習無法學習實體分布。基于詞典投影是獲得大量低資源訓練語料最直接的方法,但是詞典構建較為昂貴,并且雙語為一對一對應。

本文提出了基于知識庫來完成標簽從高資源語種向低資源語種的投影,為實體標簽投影提供了新的思路,在實驗中對比直接對少量的低資源語種進行訓練。但是在標簽投影的過程中會出現投影丟失的情況,未來可通過跨語種詞向量對齊來優化知識庫,并且投影產生的噪聲不能忽略,直接影響訓練模型,未來可對投影數據進行降噪處理提升識別率。

參考文獻:

[1] 塔什甫拉提,尼扎木丁. 維吾爾語文本信息中人名實體識別研究[D].烏魯木齊:新疆大學,2016.

[2] 張寧. 面向特定領域的命名實體識別技術研究[D].杭州:浙江大學,2018.

[3] Duong L,Cohn T,Verspoor K,et al.What can we get from 1000 tokens?A case study of multilingual POS tagging for resource-poor languages[C]//Proceedings of the 2014 Conference on Empirical Methods in Natural Language Processing (EMNLP).Doha,Qatar.Stroudsburg,PA,USA:Association for ComputationalLinguistics,2014:886-897.

[4] Vrande?i?D,Kr?tzsch M.Wikidata:a free collaborative knowledgebase[J].Communications of the ACM,2014,57(10):78-85.

[5] Mintz M , Bills S , Snow R , et al. Distant supervision for relation extraction without labeled data[C]// International Joint Conference on Acl. Association for Computational Linguistics, 2009.

[6] Catherine COMPAROT,OllivierHAEMMERL?,Nathalie HERNANDEZ. Generation of SPARQL queries from keywords and query patterns[J]. Technique et Science Informatiques,2013,32(7-8).

[7] Huang Z ,Xu W , Yu K . Bidirectional LSTM-CRF Models for Sequence Tagging[J]. Computer ence, 2015.

[8] Yarowsky D,Ngai G,Wicentowski R.Inducingmultilingual text analysis tools via robust projection across aligned corpora[C]//2001:1-8.

[9] Wang M Q,Manning C D.Cross-lingual projected expectation regularization for weakly supervised learning[J].TransactionsoftheAssociation for Computational Linguistics,2014,2:55-66.

[10] Fang M,Cohn T.Learning when to trust distant supervision:an application to low-resource POS tagging using cross-lingual projection[EB/OL].2016:arXiv:1607.01133[cs.CL].https://arxiv.org/abs/1607.01133.

【通聯編輯:光文玲】