人工智能及其關鍵技術

廣州科技職業技術大學自動化工程學院 羅國榮

近年來,隨著社會生產和社會服務的需求,人工智能也成為學者研究的熱點之一。本文首先介紹人工智能的概念,梳理人工智能發展歷程;其次,概括人工智能產業生態及關鍵技術。

人工智能是包含計算機、生物、數學、思維、邏輯、控制等多學科的一門新科學,目的是計算機或者機器能像人類一樣能進行思考和學習,并完成需要人類智能才能完成相關的工作任務,如人類的語言識別、圖片識別、無人駕駛、工業機器人等。它是拓展人類的感知和思維的一種方式,是人工制造出來的計算機系統,主要用于提高人類社會生產效率和人類社會生活水平。目前,人工智能在許多領域取得了顯著的成績。

1 人工智能的發展歷史

人們對人工智能的研究到目前為止已經有60多年的歷史了,其發展過程曲折,有起有伏。1950年阿蘭·圖靈提出了一個“圖靈測試”,為人工智能的思維方式展奠定了良好的基礎;1956年,約翰·麥卡錫在達特茅斯學院提出了“人工智能”一詞,正式確立了AI這一術語,隨后人工智能得到較快的發展。但發展到70年代,由于當時的計算機性能不足、數據少,復雜問題難以解決等原因,導致人工智能的研究學者失去信心,發展一度停滯不前,時間長達6年。直到1980年,卡內基梅隆大學開發了以人工智能為基礎的“專家系統”,并成功應用于商業,又點燃了研究學者對人工智能的希望,進入一段平穩發展階段。1997年,由于計算機技術和數據獲取的快速發展,使得計算和數據獲取能力大幅提升,促進了人工智能的發展,IBM以人工智能技術開發的計算機系統“深藍”戰勝了國際象棋世界冠軍卡斯帕羅夫,引起了人們的極大關注,這一年被認為是人工智能發展的一個重要里程,之后人工智能的發展進入了快車道,加入人工智能的研究人員越來越多,開啟了人類對人工智能的新一輪探索。

2 人工智能產業及關鍵技術

人工智能可分為運算智能、感知智能、認知智能三個階段。運算智能主要是算法與數據庫相結合,使得機器開始像人類一樣會計算和傳遞信息;感知智能是數據庫與淺層學習算法結合,使得機器能看懂和聽懂,并做出判斷、采取行動;認知智能使得機器能夠像人一樣思考,主動采取行動。人工智能涉及的面廣,其產業鏈結構劃分為AI基礎技術層、AI技術層和AI應用層。

基礎技術層涉及數據資源的獲取、計算能力的提升和計算機硬件平臺性能的提高。數據資源獲取是人工智能機器學習訓練的基本素材,獲取數據并學習數據,使機器不斷地積累經驗,智力不斷地貼近人類。數據資源需要物聯網和大數據技術的支持,物聯網領域涉及傳感器技術和數據通信技術,傳感器技術為人類獲取可利用的數據提供了便利,使得數據得以爆炸式增長;數據通信技術特別是5G無線技術的發展,為數據的傳輸提供了堅實的基礎。而大數據技術領域可細分為數據采集、數據規范、數據安全、數據儲存與管理、數據分析與挖掘、數據運維和數據運用等七個方面,在數據的存儲、分析方面直到重要的作用。

計算能力與計算機硬件密切相關,硬件資源包括芯片研發、存儲設備開發等。其中,芯片是運算能力的核心,目前芯片廠家都在大力發展AI芯片,其中AI芯片主要類型有GPU、FPGA、ASIC和類人腦芯片四種。

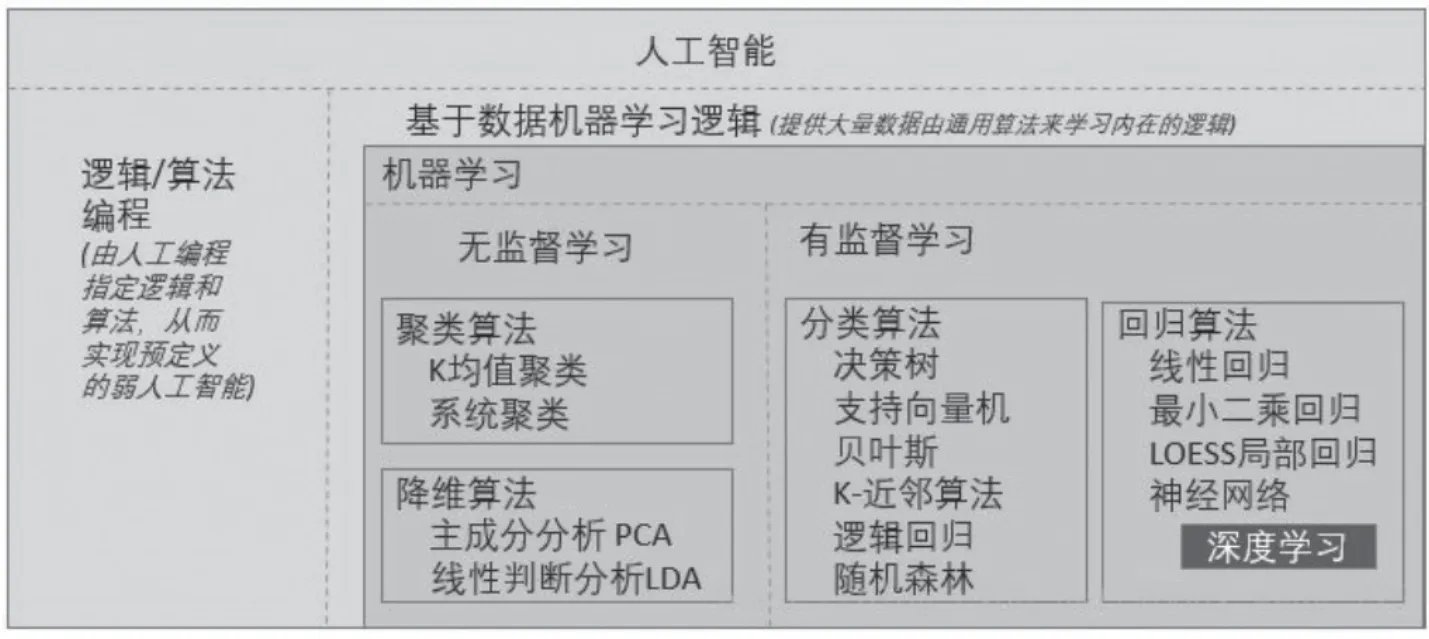

AI技術層主要是研究人工智能框架與算法。其中框架有TensorFlow,Caffe,Theano,Torch,DMTK,DTPAR,ROS等框架。人工智能算法按照學習方式的不同,可分為傳統機器算法和機器學習算法,其中傳統機器算法是一種由人工編程和邏輯計算的算法,受控于程序的設計,不具備適應外部變化的能力,是一種弱人工智能。而機器學習算法又可細分為監督式學習、非監督式學習、強化學習等算法。人工智能算法的關系如圖1所示。

圖1 人工智能算法的關系

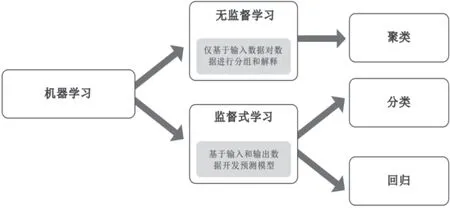

監督式學習算法根據已知的輸入數據集和已知的數據響應結果訓練模型,讓模型調整自身的參數達到最佳的狀態,并能夠根據新的輸入數據對未來的輸出響應合理的預測。這種算法需要對輸入數據集進行標識,通過標識讓輸入數據與輸出響應進行關聯,其可采用分類和回歸技術開發預測模型。如圖2所示。分類技術主要是針對具有離散特性的輸入數據,這類算法有決策樹、支持向量機、貝葉斯、K-近鄰算法、邏輯回歸、隨機森林等。回歸技術則是針對具有連續特性的輸入數據,這類算法有線性回歸、最小二乘回歸、Loess局部回歸、神經網絡等。

圖2 機器學習

無監督學習是從未知的輸入數據集中挖掘數據集中隱藏的模式或內在結構,不需要對輸入數據集進行標識,其算法主要包括聚類和降維算法。聚類是通過探索性數據分析發現數據中隱藏的模式或分組。降維是將原數據的特征空間的維度減小,以達到去除數據冗余、降低數據計算量和提高識別精度的目的。深度學習是機器學習的一個特殊分支,它模擬人類人腦神經網絡,不需要手動輸入數據的相關特征進行建模。常見的算法模型有卷積神經網絡、循環神經網絡和深度Q網絡。

強化學習也是機器學習的一個特殊分支,它采用的是獎勵懲罰機制,輸入數據作為對模型的反饋,檢查模型的對錯,對就獎勵,錯就懲罰,模型作出調整后,再利用輸入數據進行下一輪的對錯檢查,循環迭代。從而提高模型的準確度。其常見算法包括Q-Learning以及時間差學習(Temporal difference learning)。

人工智能按應用技術類型可分為計算機視覺、機器學習、自然語言處理和機器人。

計算機視覺主要是研究從圖像數據源中通過圖像識別技術識別出物體、場景和活動的問題。圖像識別是計算機對圖像進行處理、分析和理解,以識別各種不同模式的目標和對象的技術。識別過程包括圖像預處理、圖像分割、特征提取和判斷匹配。機器學習研究的是對大量已有數據的處理分析和學習,從而擁有預測判斷和做出最佳決策的能力。其核心在于機器學習是能從數據中自動發現模式,模式一旦被發現便可用于做預測。自然語言處理研究伯是對人類語文的識別、理解、處理和運用,具體是通過建立語言模型來預測語言表達的概率分布,從而實現目標。如機器翻譯、手寫體和印刷體字符識別、語音識別后實現文字轉換、信息檢索、抽取與過濾、文本分類與聚類、輿情分析和觀點挖掘等。機器人是將傳感器、機器視覺、自動規劃、自動控制等技術融合的綜合體,它有能力與人類一起工作,能在各種未知環境中靈活處理不同的任務。

總結:人工智能是一門新興學科,它是多門學科的交叉學科。人工智能作為互聯時代前沿的新興技術,將逐步滲透至各行各業,到目前為止,人工智能還存在著許多的問題,但是人工智能還是存在著很大的發展空間,而要使得存在的問題得到解決,那么就需要我們的科研人員一起去為了目標努力。