基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)方法

葉 陽(yáng),沈冰雁,沈毓琦

·農(nóng)業(yè)信息與電氣技術(shù)·

基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)方法

葉 陽(yáng),沈冰雁,沈毓琦

(浙江工業(yè)大學(xué)計(jì)算機(jī)科學(xué)與技術(shù)學(xué)院,杭州 310023)

森林遙感影像數(shù)據(jù)在采集過程中會(huì)因?yàn)楣庹盏挠绊懏a(chǎn)生陰影區(qū)域,為了解決這些陰影區(qū)域?qū)慰脴淠緳z測(cè)的干擾問題,該研究在快速區(qū)域卷積神經(jīng)網(wǎng)絡(luò)(Faster Region Convolutional Neural Networks,F(xiàn)aster RCNN)目標(biāo)檢測(cè)框架基礎(chǔ)上,提出基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)方法(Generative Adversarial Based Faster Region Convolutional Neural Networks,GA-Faster RCNN),通過采用基于對(duì)抗生成策略的樹木生成器,提高分類網(wǎng)絡(luò)對(duì)樹木信息的敏感度,降低陰影的干擾。該研究對(duì)3塊樹木陰影與郁閉度各不相同的測(cè)試樣地高分遙感影像進(jìn)行了樹木檢測(cè)試驗(yàn),并與現(xiàn)存的3種算法進(jìn)行了對(duì)比。結(jié)果顯示,基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影干擾樹木檢測(cè)方法在3塊樣地的綜合性能指標(biāo)1值分別達(dá)到了78.4%、91.6%和81.7%,均高于另外3種算法,并且樹木識(shí)別準(zhǔn)確率比現(xiàn)有方法有了明顯的提高,漏檢數(shù)和誤檢數(shù)也均明顯減少。此外,在采用不同特征提取網(wǎng)絡(luò)時(shí)該算法依然能保持其檢測(cè)的穩(wěn)定性。研究結(jié)果表明通過對(duì)抗生成訓(xùn)練策略學(xué)習(xí)表征樹木的最少特征信息可有效降低陰影對(duì)樹木檢測(cè)的干擾。

遙感;算法;樹木;檢測(cè);影像;陰影干擾;深度學(xué)習(xí)

0 引 言

森林資源是國(guó)家建設(shè)可持續(xù)發(fā)展經(jīng)濟(jì)和生態(tài)文明中不可缺少的重要物質(zhì)資源。而中國(guó)森林資源數(shù)量較少,森林覆蓋率低[1],所以亟待采取科學(xué)高效的森林資源管理手段來有效平衡開發(fā)與保護(hù)森林資源。此外,隨著生態(tài)無(wú)人農(nóng)場(chǎng)的興起,高分遙感技術(shù)也可以應(yīng)用到農(nóng)場(chǎng)中種植的果樹、苗木等經(jīng)濟(jì)作物的檢測(cè)和管理中[2-4],有助于實(shí)現(xiàn)綠色生態(tài)農(nóng)業(yè)生產(chǎn)的精準(zhǔn)化種植和可視化管理。

近年來,國(guó)內(nèi)外的研究人員提出了一些基于遙感影像的單棵樹木檢測(cè)方法。傳統(tǒng)樹木檢測(cè)算法[5-8]一般采用數(shù)字圖像處理方法,例如局部最大值結(jié)合區(qū)域生長(zhǎng)法、分水嶺方法、模板匹配法等。Novotny等[9]基于區(qū)域生長(zhǎng)方法,提出了采用可變窗口大小的局部最大值法提取種子點(diǎn)。郭昱杉等[10]利用面向?qū)ο蟮姆椒ǚ诸惲值睾头橇值兀⒁粤值貫檠谀L崛涔诘姆植挤秶詈笤倩跇?biāo)記控制分水嶺分割方法對(duì)不同疏密林區(qū)進(jìn)行樹冠提取。Malek[11]等基于模板匹配方法,使用尺度不變特征變換(Scale Invariant Feature Transform,SIFT)算法提取棕櫚樹的關(guān)鍵點(diǎn)特征,并經(jīng)過極限學(xué)習(xí)機(jī)(Extreme Learning Machine,ELM)學(xué)習(xí)分類達(dá)到檢測(cè)目的。

點(diǎn)云(Lidar)數(shù)據(jù)作為遙感數(shù)據(jù)的一種,不少研究也基于該數(shù)據(jù)提出了相應(yīng)的樹木檢測(cè)算法[12-15]。這些算法一般不直接使用點(diǎn)云數(shù)據(jù),而是在由點(diǎn)云數(shù)據(jù)轉(zhuǎn)換為柵格化圖像的基礎(chǔ)上實(shí)現(xiàn)樹木檢測(cè)。因?yàn)辄c(diǎn)云數(shù)據(jù)是通過使用激光直接獲得的,所以一般不會(huì)受到陰影干擾。

從2012年以來,深度學(xué)習(xí)中的卷積神經(jīng)網(wǎng)絡(luò)在計(jì)算機(jī)視覺中的目標(biāo)檢測(cè)領(lǐng)域被廣泛使用,且取得了巨大進(jìn)步,也促使相關(guān)學(xué)者將卷積神經(jīng)網(wǎng)絡(luò)應(yīng)用到遙感影像的單棵樹木檢測(cè)中[16-20]。卷積神經(jīng)網(wǎng)絡(luò)可以有效降低傳統(tǒng)樹木檢測(cè)方法中采用手動(dòng)選取種子點(diǎn),或者專家先驗(yàn)知識(shí)指定參數(shù)等造成的魯棒性低的問題。卷積神經(jīng)網(wǎng)絡(luò)不依賴手工選擇特征,而是通過海量影像數(shù)據(jù),按照設(shè)定的標(biāo)簽自動(dòng)地學(xué)習(xí)相關(guān)特征,將圖像的低維紋理顏色特征抽象為高維語(yǔ)義特征,具有良好的分類性能。Li等[21]提出了基于卷積神經(jīng)網(wǎng)絡(luò)的馬來西亞油棕櫚樹檢測(cè)算法,并正確識(shí)別出96%的樣本。Guirado等[22]基于卷積神經(jīng)網(wǎng)絡(luò),以Google Earth影像作為數(shù)據(jù)實(shí)現(xiàn)了灌木檢測(cè)。Culman等[23]基于卷積神經(jīng)網(wǎng)絡(luò),提出了從高分辨率RGB圖像中對(duì)單棵棕櫚樹進(jìn)行定位和分類的檢測(cè)方法。

在通用目標(biāo)檢測(cè)領(lǐng)域也有一些基于卷積神經(jīng)網(wǎng)絡(luò)的算法,例如快速區(qū)域卷積神經(jīng)網(wǎng)絡(luò)(Faster Region Convolutional Neural Networks,F(xiàn)aster RCNN)[24]和統(tǒng)一定位與分類的實(shí)時(shí)檢測(cè)器(You Only Look Once,YOLO)[25]等,但是這些方法的檢測(cè)結(jié)果經(jīng)常會(huì)受到遙感影像中的光照、陰影等因素影響。例如在遙感圖像中,樹木或山脈等會(huì)遮擋住光線從而造成一些陰影區(qū)域,這些陰影區(qū)域不僅會(huì)讓樹木的圖像特征嚴(yán)重退化失真,還會(huì)產(chǎn)生大量的噪聲,使得現(xiàn)有的樹木檢測(cè)方法受陰影干擾難以獲得令人滿意的檢測(cè)效果。在面對(duì)有陰影干擾的高噪音影像時(shí),這些方法需要在訓(xùn)練階段大批量標(biāo)定受到陰影干擾的樹木,并且在缺少優(yōu)質(zhì)標(biāo)定數(shù)據(jù)的情況下非常容易出現(xiàn)誤識(shí)別和漏識(shí)別,進(jìn)而造成檢測(cè)精度低的問題。

目前基于遙感影像的樹木檢測(cè)方法中沒有特別針對(duì)陰影進(jìn)行處理的抗陰影檢測(cè)方法,常見的樹木檢測(cè)方法中處理陰影的方式都是先檢測(cè)出陰影,去除后再檢測(cè)樹木。而現(xiàn)有的陰影檢測(cè)算法[26-27]主要針對(duì)多通道的遙感影像進(jìn)行處理,將其應(yīng)用在三通道影像數(shù)據(jù)的樹木檢測(cè)中具有局限性,應(yīng)用范圍有限。另外,這些處理算法通常存在大量需要手工調(diào)整的參數(shù),自動(dòng)化程度難以提高。

現(xiàn)有的數(shù)據(jù)集中存在的陰影樣本較少,從訓(xùn)練角度難以提升樹木檢測(cè)器對(duì)陰影的抗干擾效果,本文借鑒Wang等[28]為解決數(shù)據(jù)集無(wú)法涵蓋所有的變形與遮擋情況,使用對(duì)抗生成網(wǎng)絡(luò)生成形變與遮擋的對(duì)抗樣本的思路,提出了一種基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)方法(Generative Adversarial Based Faster Region Convolutional Neural Networks,GA-Faster RCNN)。該方法從待檢測(cè)樹木的局部特征出發(fā),通過引入對(duì)抗生成策略構(gòu)建樹木生成器,保留區(qū)域提議網(wǎng)絡(luò)(Region Proposal Network,RPN)提取特征圖中的樹木特征信息,削弱陰影等背景特征信息的干擾,強(qiáng)化網(wǎng)絡(luò)分類器對(duì)樹木特征的敏感度,最終達(dá)到提高樹木檢測(cè)精度的目標(biāo)。

1 算法結(jié)構(gòu)及訓(xùn)練

基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)方法首先引入一個(gè)樹木生成器,該生成器采取對(duì)抗生成訓(xùn)練的策略來學(xué)習(xí)表征樹木的最少特征信息,然后利用這些特征信息來訓(xùn)練分類網(wǎng)絡(luò),增強(qiáng)網(wǎng)絡(luò)對(duì)樹木特征的敏感性,降低陰影干擾對(duì)網(wǎng)絡(luò)的影響,從而提升算法的檢測(cè)能力。

1.1 總體流程

基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)方法總體流程如圖1所示,具體步驟包括數(shù)據(jù)采集與標(biāo)記,樹木生成器訓(xùn)練,網(wǎng)絡(luò)的端到端訓(xùn)練和最后的樹木檢測(cè)。

1)數(shù)據(jù)的采集和標(biāo)記:本文選取Google Earth上位于美國(guó)佛羅里達(dá)州和阿肯色州的30塊樣地作為訓(xùn)練集以及9塊樣地作為測(cè)試集,這些樣地兼顧各種類型的樹木種類和陰影量。在30塊訓(xùn)練樣地中標(biāo)記4 000余棵參考樹,而在9塊測(cè)試樣地中,標(biāo)記1 200余棵參考樹。其中30塊訓(xùn)練樣地和9塊測(cè)試樣地被分為3類,即樹木樹冠清晰且樹木陰影干擾較少、樹木郁閉度中等且有部分樹木陰影干擾和樹木郁閉度較大且樹木陰影干擾嚴(yán)重。

2)樹木生成器訓(xùn)練:生成器通過產(chǎn)生不同的黑色掩膜來模擬樹木在陽(yáng)光下生成的陰影以及其他較高樹木對(duì)該樹木的遮擋,之后將這些生成的樹木影像交由判別器識(shí)別,直至產(chǎn)生一個(gè)最佳的樹木生成器。

3)網(wǎng)絡(luò)的端到端訓(xùn)練:將訓(xùn)練好的生成器加入到整個(gè)檢測(cè)網(wǎng)絡(luò)中,通過對(duì)整個(gè)網(wǎng)絡(luò)進(jìn)行端到端的訓(xùn)練,讓整體網(wǎng)絡(luò)的參數(shù)迭代優(yōu)化,直至獲得一個(gè)最佳的抗陰影樹木檢測(cè)模型。

4)樹木檢測(cè):將測(cè)試樣地的影像數(shù)據(jù)放入基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)模型,返回樹木檢測(cè)信息。

1.2 網(wǎng)絡(luò)設(shè)計(jì)

基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)網(wǎng)絡(luò)由一個(gè)Faster RCNN網(wǎng)絡(luò)和樹木生成器組成,其網(wǎng)絡(luò)結(jié)構(gòu)設(shè)計(jì)如圖2所示。Faster RCNN網(wǎng)絡(luò)負(fù)責(zé)主要特征提取和檢測(cè)任務(wù),但由于數(shù)據(jù)中存在陰影,所以在RPN網(wǎng)絡(luò)獲得的感興趣區(qū)域(Region of Interest,ROI)中陰影干擾嚴(yán)重,使得傳遞給檢測(cè)網(wǎng)絡(luò)的樹木特征表征不明顯,從而影響后續(xù)識(shí)別。

本文引入樹木生成器,它共享Faster RCNN的卷積層和ROI池化層,連接在Faster RCNN的RPN網(wǎng)絡(luò)之后,再連接兩個(gè)單獨(dú)的全連接層,然后連接一個(gè)分類網(wǎng)絡(luò)。樹木生成器能將ROI區(qū)域進(jìn)行刪減修改,保留最少的表示樹木特征的信息,減少陰影干擾問題。該生成器需要先單獨(dú)訓(xùn)練,通過訓(xùn)練后,將訓(xùn)練后的樹木生成器放入到Faster RCNN網(wǎng)絡(luò)中,鎖定其參數(shù)后再進(jìn)行端到端訓(xùn)練,進(jìn)一步提高Faster RCNN網(wǎng)絡(luò)的樹木識(shí)別能力。

1.3 樹木生成器訓(xùn)練

進(jìn)行樹木生成器訓(xùn)練前,首先要訓(xùn)練一個(gè)具有識(shí)別能力的分類器。本文使用從30塊訓(xùn)練樣地中采集的1 000棵參考樹正樣本和1 000個(gè)背景負(fù)樣本,共2 000個(gè)訓(xùn)練樣本訓(xùn)練該分類器。分類器的目標(biāo)函數(shù)為

在訓(xùn)練完分類器后,使用該分類器獲得一些用于樹木生成器訓(xùn)練的正樣本。由于樹木生成器的目的是獲取最少表征樹木的特征信息,增強(qiáng)總體網(wǎng)絡(luò)對(duì)樹木的表征分辨能力,所以在訓(xùn)練該樹木生成器時(shí),需要確定表征樹木的最少特征是多少。在這里,本文將陰影作為樹木檢測(cè)過程中的遮擋問題進(jìn)行處理,也就是樹木特征的流失。通過對(duì)樹木圖像添加掩模的方式,模擬因陰影等光照因素對(duì)樹木特征產(chǎn)生的干擾,即模擬一些樹木信息丟失的過程。具體的操作如圖3所示。

在確定目標(biāo)函數(shù)后,本文首先訓(xùn)練沒有樹木生成器的Faster RCNN檢測(cè)器進(jìn)行10 000次迭代,再通過固定檢測(cè)器中的所有層來交替訓(xùn)練生成器和判別器,直至將生成器的生成數(shù)據(jù)擬合到真實(shí)數(shù)據(jù)的概率分布上。樹木生成器訓(xùn)練時(shí)的學(xué)習(xí)率為0.001,學(xué)習(xí)率的權(quán)重衰減為10-4,訓(xùn)練60 000輪次。訓(xùn)練結(jié)束后獲得的樹木生成器用于生成原檢測(cè)網(wǎng)絡(luò)難以檢測(cè)的對(duì)抗樣本,該生成器生成的信息在因陰影造成的信息丟失后仍能表征樹木特征。

1.4 端到端訓(xùn)練

在樹木生成器訓(xùn)練結(jié)束后,就可以將該網(wǎng)絡(luò)整合進(jìn)基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)網(wǎng)絡(luò)中進(jìn)行端到端訓(xùn)練。樹木生成器位于RPN網(wǎng)絡(luò)之后,可以直接接受RPN網(wǎng)絡(luò)返回的ROI數(shù)據(jù),無(wú)需映射回原圖再做特征提取,大大減少了網(wǎng)絡(luò)訓(xùn)練的計(jì)算量。

在選取由RPN網(wǎng)絡(luò)生成的ROI放入樹木生成器生成處理數(shù)據(jù)的步驟中,本文只選取與正樣本之間的交并比(Intersection over Union,IOU)超過50%的ROI中的1/4區(qū)域,這么做是因?yàn)闃淠旧善魃傻臄?shù)據(jù)質(zhì)量高低取決于傳入的數(shù)據(jù)包含真實(shí)樣本像素?cái)?shù)量的多少。真實(shí)樣本的像素?cái)?shù)量越高,生成的樣本質(zhì)量也越高。而選取IOU超過50%的區(qū)域則意味著該ROI區(qū)域包含正樣本的像素?cái)?shù)量比較多,其包含用以表征樹木信息的特征也比較完整,也就能在訓(xùn)練中提高分類器的分類性能。此外,隨機(jī)選取25%的樣本,而不是將全部樣本進(jìn)行處理,目的是為了減少網(wǎng)絡(luò)計(jì)算量;而所有樣本都經(jīng)處理后,信息丟失過于嚴(yán)重,反而不利于提高分類器的分類性能。其執(zhí)行過程如圖4所示。

在第一次樹木生成器訓(xùn)練后,保存并鎖定該網(wǎng)絡(luò)的狀態(tài)參數(shù),放入第二次訓(xùn)練中,端到端訓(xùn)練時(shí)的學(xué)習(xí)率為0.002,學(xué)習(xí)率的權(quán)重衰減為10-4,訓(xùn)練輪次為60 000。完整訓(xùn)練一次的時(shí)間在3 h左右。

本文提出的抗陰影樹木檢測(cè)算法在Pytorch框架上實(shí)現(xiàn),運(yùn)行的系統(tǒng)環(huán)境為AMD Ryzen R9 3900X CPU,圖形處理器(Graphic Processing Unit,GPU)為NVIDIA GeForce RTX 2080 Super。

2 案例分析

2.1 試驗(yàn)區(qū)域

由于傳統(tǒng)遙感數(shù)據(jù)保密性強(qiáng)、獲取復(fù)雜且價(jià)格昂貴,本文使用了相對(duì)容易獲取的Google Earth影像數(shù)據(jù)。本文總共篩選了3個(gè)測(cè)試區(qū)域,它們位于美國(guó)佛羅里達(dá)州和阿肯色州。3塊試驗(yàn)樣地都是自然環(huán)境下的森林場(chǎng)景,包含大量樹木的同時(shí)也有陰影的干擾。其中試驗(yàn)樣地一中有大量樹木陰影,且樹木的郁閉度很高,單棵樹木檢測(cè)難度較高;試驗(yàn)樣地二包含樹木陰影較少的同時(shí)樹木的郁閉度也不高,單棵樹木之間的分界較為清晰,因此單棵樹木檢測(cè)的難度相對(duì)較低;試驗(yàn)樣地三中包含的樹木陰影和樹木的郁閉度介于樣地一和樣地二之間,樹木有緊密相連的,也有間距較大的;既有被少量陰影干擾的樹木,也有被大塊陰影干擾的樹木。添加該樣地作為測(cè)試樣地,有助于研究算法在各個(gè)場(chǎng)景下的性能表現(xiàn)。圖5顯示了3個(gè)試驗(yàn)樣地及其陰影區(qū)域。

2.2 評(píng)價(jià)指標(biāo)

本文試驗(yàn)的數(shù)據(jù)均來自Google Earth,由于缺少實(shí)測(cè)參考數(shù)據(jù),本文采用目視結(jié)果進(jìn)行精度評(píng)價(jià)。很多文獻(xiàn)中都有使用目視解釋結(jié)果作為精度評(píng)價(jià)指標(biāo)的方法。Gougeon等[29]通過多人多次目視解釋判斷遙感影像中的單棵樹木的位置信息,統(tǒng)計(jì)樹木的總數(shù)。Erikson[30-31]等也使用目視解釋方式獲取參考數(shù)據(jù)。本文根據(jù)識(shí)別框和目視解釋獲得的參考樹木標(biāo)記框之間的重疊程度來判斷識(shí)別結(jié)果是否屬于分類正確(True Positive,TP)、分類錯(cuò)誤(False Positive,F(xiàn)P;False Negative,F(xiàn)N)。分類結(jié)果及其依據(jù)如下所示:

1)準(zhǔn)確識(shí)別結(jié)果:算法得到的單樹識(shí)別框與目視解釋獲得的標(biāo)記框重疊的區(qū)域超過50%,記該單樹識(shí)別框?yàn)闇?zhǔn)確識(shí)別結(jié)果,計(jì)入TP。

2)錯(cuò)誤識(shí)別結(jié)果:算法得到的單樹識(shí)別框與目視解釋獲得的標(biāo)記框重疊的區(qū)域少于50%,記該單樹識(shí)別框?yàn)殄e(cuò)誤識(shí)別結(jié)果,計(jì)入FP。

3)遺漏識(shí)別結(jié)果:目視解釋獲得的標(biāo)記框與任一單樹識(shí)別框都沒有超過50%的重疊,則該目視解釋的標(biāo)記框?yàn)檫z漏識(shí)別結(jié)果,計(jì)入FN。

本文采用用戶精度UA、生產(chǎn)者精度PA和1[32]這3個(gè)定量的評(píng)價(jià)指標(biāo)作為樹木檢測(cè)的精度評(píng)價(jià)指標(biāo),其計(jì)算公式如下

1引入自統(tǒng)計(jì)學(xué)評(píng)價(jià)方法,是用以平衡PA和UA兩者的結(jié)果,其計(jì)算公式如下

為了探討掩模對(duì)樹木識(shí)別的影響,本文對(duì)陰影誤識(shí)別率進(jìn)行分析。采用人工目視解釋統(tǒng)計(jì)算法結(jié)果FP中包含的陰影區(qū)域數(shù)量,并計(jì)算該值在所有檢出樹木中的百分比,陰影誤識(shí)別率SR計(jì)算公式可以表示為

2.3 與其他方法對(duì)比

為了驗(yàn)證本文提出的算法能有效解決陰影干擾下的樹木檢測(cè)問題,與其他方法進(jìn)行了對(duì)比。對(duì)比方法包括區(qū)域生長(zhǎng)法(Region-Growing)[9]、遞進(jìn)式級(jí)聯(lián)卷積神經(jīng)網(wǎng)絡(luò)(Progressive Cascaded CNN)[33]和Faster RCNN[24]。

由于不同場(chǎng)景下樹木的形態(tài)大小不等,所以要對(duì)不同測(cè)試樣地設(shè)置不同的滑動(dòng)窗口參數(shù)。對(duì)于3塊樣地,本文對(duì)區(qū)域生長(zhǎng)方法和遞進(jìn)式級(jí)聯(lián)卷積神經(jīng)網(wǎng)絡(luò)設(shè)置了不同的滑動(dòng)窗口參數(shù)。參考Dong等[33]對(duì)區(qū)域生長(zhǎng)方法參數(shù)的設(shè)置,將區(qū)域生長(zhǎng)方法在樣地一、樣地二和樣地三的滑動(dòng)窗口參數(shù)分別設(shè)置為3、5和2;遞進(jìn)式級(jí)聯(lián)卷積神經(jīng)網(wǎng)絡(luò)通過尺寸為3,步長(zhǎng)為2的滑動(dòng)窗口生成不同尺寸的預(yù)設(shè)檢測(cè)框,在3塊樣地設(shè)置的預(yù)設(shè)檢測(cè)框尺寸分別為32、34和32。Faster RCNN則在3塊樣地都采用默認(rèn)的預(yù)設(shè)檢測(cè)框。另外,F(xiàn)aster RCNN和遞進(jìn)式級(jí)聯(lián)卷積神經(jīng)網(wǎng)絡(luò)都使用了現(xiàn)有的模型,即加載了PyTorch上提供的官方模型權(quán)重,不需要再進(jìn)行其他人為設(shè)定。

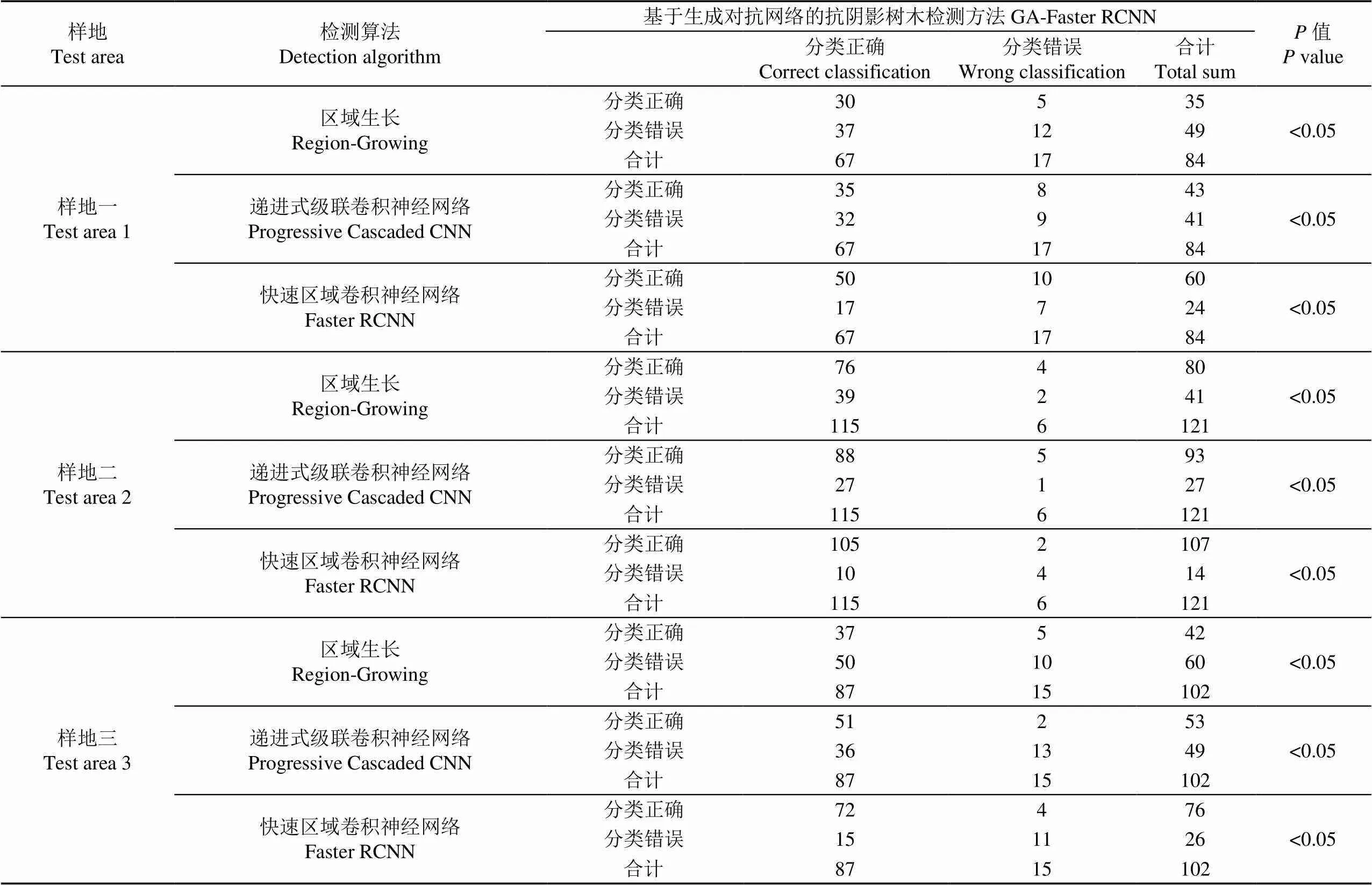

另外,本文還對(duì)試驗(yàn)結(jié)果進(jìn)行了顯著性分析排除試驗(yàn)誤差等因素的干擾,以驗(yàn)證提出的算法與其他方法具有統(tǒng)計(jì)學(xué)上的差異,從而更好地表明本文提出的方法具有更好的性能。在該研究中,樣本不是獨(dú)立的。因此,兩兩之間是否存在統(tǒng)計(jì)學(xué)意義上的差異可以通過McNemar檢驗(yàn)證明[34]。這是一個(gè)基于2×2混淆矩陣的非參數(shù)測(cè)試。McNemar的測(cè)試基于標(biāo)準(zhǔn)化的正常測(cè)試統(tǒng)計(jì)

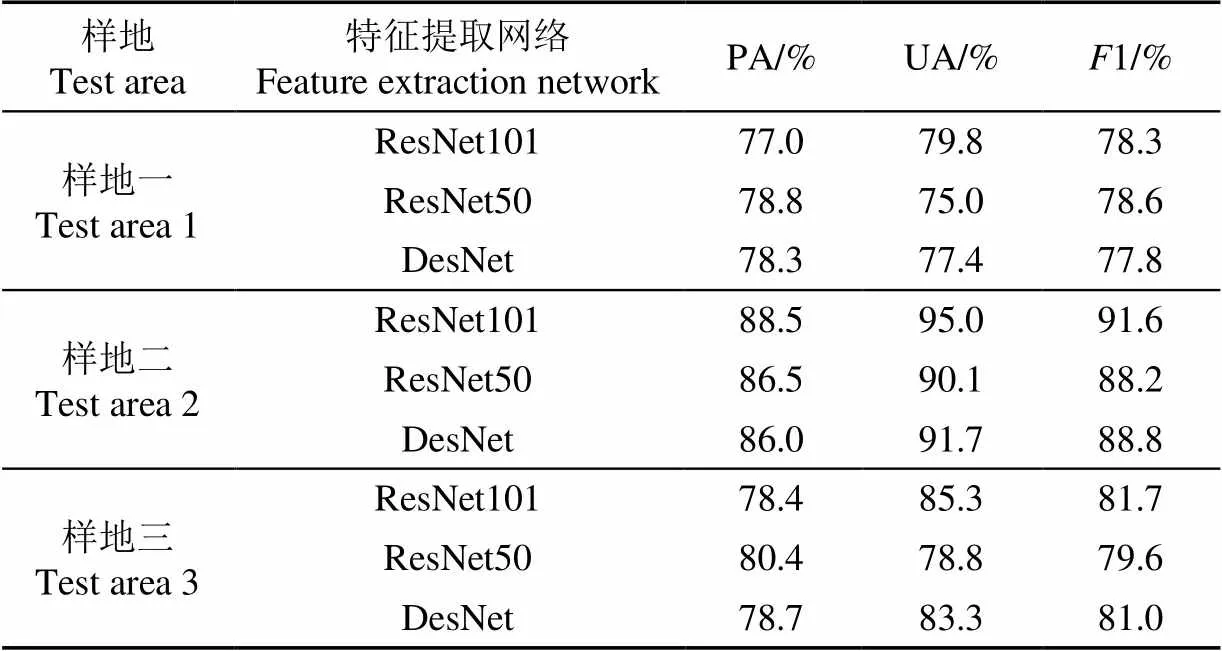

2.4 不同特征提取網(wǎng)絡(luò)對(duì)算法的影響

在基于深度學(xué)習(xí)的圖像算法中,不同特征提取網(wǎng)絡(luò)對(duì)于整體網(wǎng)絡(luò)的性能會(huì)產(chǎn)生較大的影響。為了驗(yàn)證本文提出的抗陰影樹木檢測(cè)算法在使用不同的特征提取網(wǎng)絡(luò)的情況下,依然能有較好的穩(wěn)定性和性能,通過修改算法結(jié)構(gòu)中的特征提取網(wǎng)絡(luò),將其分別替換為ResNet101、ResNet50和DenseNet來測(cè)試算法的結(jié)果。

3 結(jié)果與分析

圖6顯示了樣地一、二和三使用不同方法得到的樹木檢測(cè)結(jié)果。圖中藍(lán)色矩形框表示檢測(cè)成功的樹木;紅色框是樹木的誤識(shí)別結(jié)果,即將其他對(duì)象檢測(cè)為樹木;綠色框表示算法漏識(shí)別的樹木。

3.1 與其他方法對(duì)比結(jié)果與分析

結(jié)合圖6a和表1可以看到,在樣地一中,區(qū)域生長(zhǎng)方法的漏檢和誤檢是最多的,識(shí)別準(zhǔn)確率(生產(chǎn)者精度)也最低,主要原因是它無(wú)法有效規(guī)避大量陰影的干擾,選取了很多錯(cuò)誤的種子點(diǎn),導(dǎo)致識(shí)別準(zhǔn)確率較低;遞進(jìn)式級(jí)聯(lián)卷積神經(jīng)網(wǎng)絡(luò)的漏檢和誤檢也很多,用戶精度和生產(chǎn)精度也不高,這是因?yàn)樾枰ㄟ^一個(gè)滑動(dòng)窗口遍歷整個(gè)圖像獲得采樣樣本,經(jīng)過特征提取后交由分類網(wǎng)絡(luò)分類識(shí)別。而在樣地一中,樹木郁閉度較高且有相當(dāng)多的陰影干擾,在前期獲得的訓(xùn)練樣本不足以覆蓋所有陰影干擾的樹木種類,所以導(dǎo)致很多樹木的特征提取結(jié)果與模型不符合;而Faster RCNN和GA-Faster RCNN中ROI區(qū)域由RPN網(wǎng)絡(luò)提出,對(duì)檢測(cè)樹木的特征感知能力更強(qiáng),漏檢和誤檢相對(duì)前兩種方法明顯降低,并且由于GA-Faster RCNN采用了樹木生成器進(jìn)行優(yōu)化訓(xùn)練,所以對(duì)樹木的分類能力更強(qiáng),漏檢數(shù)量也最少,PA、UA和1值在四個(gè)方法中均為最高,分別達(dá)到了77.0%,79.8%和78.4%,比第二高的Faster RCNN分別高了2.2,8.4和5.7個(gè)百分點(diǎn)。

在樣地二中(圖6b,表2),可以看到4種方法的檢測(cè)結(jié)果都比在樣地一中的有了明顯提高,漏檢數(shù)和誤檢數(shù)也都明顯下降。這是因?yàn)樵跇拥囟淠镜挠糸]度較低,樹木樹冠紋理清晰,陰影干擾也不明顯。在該樣地中,由于遞進(jìn)式級(jí)聯(lián)卷積神經(jīng)網(wǎng)絡(luò)通個(gè)滑動(dòng)窗口獲得要分類的樣本,但其大小無(wú)法覆蓋所有大小的樹木,因此對(duì)一些較大的樹木樣本檢測(cè)結(jié)果較差。對(duì)于Faster RCNN,因?yàn)槿鄙貵A-Faster RCNN中對(duì)樹木特征的再提取過程,所以對(duì)于陰影干擾的排除不明顯,1值為83.9%,比GA-Faster RCNN 91.6%的1值低了7.7個(gè)百分點(diǎn)。綜合來看,在該樣地中各方法的1均比樣地一高,但是GA-Faster RCNN仍然是效果最好的。

在樣地三中(圖6c,表1),區(qū)域生長(zhǎng)34.0%的1值是最低的,漏檢和誤檢問題十分嚴(yán)重,這表明區(qū)域生長(zhǎng)方法受到陰影干擾等因素的影響較大,以至于檢測(cè)效果不佳。類似于樣地一,遞進(jìn)式級(jí)聯(lián)卷積神經(jīng)網(wǎng)絡(luò)在樹木郁閉度較高且有相當(dāng)多的陰影干擾情況下,漏檢和誤檢數(shù)相當(dāng)多,僅優(yōu)于區(qū)域生長(zhǎng)方法,PA和UA也不高,僅為55.8%和52.0%。在Faster RCNN中,因?yàn)槿鄙貵A-Faster RCNN中對(duì)樹木特征的再提取過程,所以對(duì)于陰影干擾的排除仍不明顯,所以比GA-Faster RCNN方法81.7%的1值低了5.3個(gè)百分點(diǎn)。

3塊樣地的綜合檢測(cè)結(jié)果中(表1),GA-Faster RCNN的PA和UA都較高,分別為82.0%和87.6%,1值也達(dá)到了84.7%,比性能第二的Faster RCNN高了6.2個(gè)百分點(diǎn),在不同數(shù)量的樹木陰影和不同樹木郁閉度的干擾下,都有良好的檢測(cè)效果,這對(duì)于樹木的自動(dòng)檢測(cè)精度以及單棵樹木的樹冠信息等提取都有較好的促進(jìn)作用。

表1 三塊樣地中采用不同方法的檢測(cè)結(jié)果

注:TP是準(zhǔn)確識(shí)別數(shù),F(xiàn)P是錯(cuò)誤識(shí)別數(shù),F(xiàn)N是漏識(shí)別數(shù),PA是生產(chǎn)者精度,UA用戶精度,1是精確率和召回率的調(diào)和平均數(shù)。

Note: TP is True Positive, FP is False Positive, FN is False Negative, PA is Producer Accuracy, UA is User Accuracy, and1 is the harmonic average of precision and recall.

在顯著性分析試驗(yàn)中,設(shè)定當(dāng)<0.05時(shí),兩種方法所得結(jié)果有顯著性差異。分別在3塊測(cè)試樣地,設(shè)GA-Faster RCNN所得到的結(jié)果和區(qū)域生長(zhǎng)、遞進(jìn)式級(jí)聯(lián)卷積神經(jīng)網(wǎng)絡(luò)和Faster RCNN所獲得的結(jié)果在統(tǒng)計(jì)學(xué)上沒有顯著性差異,然后計(jì)算在該假設(shè)上的值,表2顯示了GA-Faster RCNN與其他方法在3塊樣地檢測(cè)結(jié)果上的顯著性檢驗(yàn)結(jié)果,所得的值均小于0.05,故原假設(shè)不成立,即它們之間的差異具有統(tǒng)計(jì)學(xué)意義。而在這3塊樣地上,GA-Faster RCNN具有最高的1值,所以可以認(rèn)為本文提出的方法比另外3種方法更好。

表2 三塊樣地中采用不同方法的McNemar校驗(yàn)結(jié)果

為了探討掩模對(duì)樹木識(shí)別的影響,本文對(duì)GA-Faster RCNN的陰影誤識(shí)別率,即將陰影區(qū)域誤識(shí)別為樹木的數(shù)量占所有檢出樹木數(shù)量的百分比,進(jìn)行了分析,并與上文分析中除GA-Faster RCNN外表現(xiàn)最好的Faster RCNN進(jìn)行了對(duì)比。由于樣地一的光照影響嚴(yán)重,并且有大量的陰影區(qū)域干擾,對(duì)樹木檢測(cè)的影響較大,因此,本文選擇樣地一為試驗(yàn)對(duì)象。從表3可知,GA-Faster RCNN的陰影誤識(shí)別率SR略高于Faster RCNN。這是由于GA-Faster RCNN將一些與樹木外形相似、具有獨(dú)立的形狀的陰影區(qū)域識(shí)別為樹木(圖7)。盡管如此,由于樹木生成器能夠獲取最少表征樹木的特征信息,GA-Faster RCNN的生產(chǎn)者精度(識(shí)別準(zhǔn)確率)和漏識(shí)別數(shù)量等指標(biāo)均優(yōu)于Faster RCNN(表3)。因此,綜合來看,GA-Faster RCNN仍具有顯著的優(yōu)越性。

表3 樣地一中采用不同方法的陰影誤識(shí)別率結(jié)果

注:num是將陰影區(qū)域誤識(shí)別為樹木的數(shù)量,SR是陰影誤識(shí)別率。

Note:numis the number of shadow areas misrecognized as trees, and SR is the misrecognition rate of shadows.

3.2 采用不同特征提取網(wǎng)絡(luò)的算法結(jié)果分析

表4和圖8是在樣地一、樣地二和樣地三中GA-Faster RCNN分別采用不同的特征提取網(wǎng)絡(luò)后得到的試驗(yàn)結(jié)果。從表4中可以看出采用ResNet101、ResNet50和DenseNet的GA-Faster RCNN的PA、UA以及1三個(gè)評(píng)價(jià)指標(biāo)數(shù)值差異不大,證明本文提出的方法在使用不同的特征提取網(wǎng)絡(luò)時(shí)依然能保持其檢測(cè)的穩(wěn)定性。

表4 三塊樣地中采用不同特征提取網(wǎng)絡(luò)的檢測(cè)結(jié)果

4 結(jié) 論

1)針對(duì)現(xiàn)有單樹檢測(cè)算法在復(fù)雜陰影條件下檢測(cè)能力不足,無(wú)法很好應(yīng)用到通用的樹木檢測(cè)場(chǎng)景中的問題,提出了基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)算法(Generative Adversarial Based Faster Region Convolutional Neural Networks,GA-Faster RCNN)。該算法通過加入一個(gè)能最小表征樹木特征的樹木生成器,通過將區(qū)域提議網(wǎng)絡(luò)(Region Proposal Network,RPN)生成的感興趣區(qū)域(Region of Interest,ROI)進(jìn)行特征優(yōu)化,提高檢測(cè)器在樹木陰影干擾下對(duì)樹木的識(shí)別能力。

2)本文在Google Earth中選取了高分辨率遙感影像,通過標(biāo)記訓(xùn)練區(qū)域和測(cè)試區(qū)域,將其應(yīng)用到網(wǎng)絡(luò)的訓(xùn)練中,同時(shí)選擇了3塊包含不同程度的陰影干擾的測(cè)試樣地用以測(cè)試本文提出方法在不同陰影干擾下的性能。試驗(yàn)結(jié)果表明基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)算法在三塊測(cè)試樣地的1值均為最高,分別為78.4%、91.6%和81.7%,其平均1值為84.7%,比性能第二的Faster RCNN高了6.2個(gè)百分點(diǎn),樹木識(shí)別率相比現(xiàn)有方法有了明顯的提高,另外,本文提出的方法在采用不同特征提取網(wǎng)絡(luò)時(shí)依然能夠保持樹木檢測(cè)的穩(wěn)定性。

3)本文重點(diǎn)對(duì)GA-Faster RCNN中掩模對(duì)樹木檢測(cè)的影響進(jìn)行了研究,結(jié)果表明雖然陰影區(qū)域被誤識(shí)別為樹木的數(shù)量占所有檢出樹木數(shù)量的百分比有所提升,但樹木的識(shí)別準(zhǔn)確率仍比其他方法高,漏識(shí)別的樹木數(shù)量也遠(yuǎn)低于其他方法。未來研究中,可對(duì)與樹木外形接近的陰影被誤識(shí)別為樹木的問題做進(jìn)一步研究。

[1] 國(guó)家林業(yè)和草原局. 中國(guó)森林資源報(bào)告[M]. 北京:中國(guó)林業(yè)出版社,2019.

[2] 王維剛,史海濱,李仙岳,等. 遙感訂正作物種植結(jié)構(gòu)數(shù)據(jù)對(duì)提高灌區(qū)SWAT模型精度的影響[J]. 農(nóng)業(yè)工程學(xué)報(bào),2020,36(17):158-166.

Wang Weigang, Shi Haibin, Li Xianyue, et al. Effects of correcting crop planting structure data to improve simulation accuracy of SWAT model in irrigation district based on remote sensing[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(17): 158-166. (in Chinese with English abstract)

[3] 李宇宸,張軍,薛宇飛,等. 基于Google Earth Engine的中老緬交界區(qū)橡膠林分布遙感提取[J]. 農(nóng)業(yè)工程學(xué)報(bào),2020,36(8):174-181.

Li Yuchen, Zhang Jun, Xue Yufei, et al. Remote sensing image extraction for rubber forest distribution in the border regions of China, Laos and Myanmar based on google earth engine platform[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(8): 174-181. (in Chinese with English abstract)

[4] 趙晉陵,金玉,葉回春,等. 基于無(wú)人機(jī)多光譜影像的檳榔黃化病遙感監(jiān)測(cè)[J]. 農(nóng)業(yè)工程學(xué)報(bào),2020,36(8):54-61.

Zhao Jinling, Jin Yu, Ye Huichun, et al. Remote sensing monitoring of areca yellow leaf disease based on UAV multi-spectral images[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(8): 54-61. (in Chinese with English abstract)

[5] Hellesen T, Matikainen L. An object-based approach for mapping shrub and tree cover on grassland habitats by use of LiDAR and CIR orthoimages[J]. Remote Sensing, 2013, 5(2): 558-583.

[6] Yang L, Wu X, Praun E, et al. Tree detection from aerial imagery[C]//Proceedings of the 17th ACM SIGSPATIAL International Conference on Advances in Geographic Information Systems, Seattle, USA, 2009: 131-137.

[7] Pollock R J. The Automatic Recognition of Individual Trees in Aerial Images of Forests Based on a Synthetic Tree Crown Image Model[D]. Vancouver: The University of British Colombia, 1996: 172.

[8] Larsen M, Rudemo M. Optimizing templates for finding trees in aerial photographs[J]. Pattern Recognition Let, 1998, 19(12): 1153-1162.

[9] Novotny J, Hanu? J, Luke? P, et al. Individual tree crowns delineation using local maxima approach and seeded region-growing technique[C]//Proceedings of Symposium GIS Ostrava, Ostrava, Czech Republic, 2011: 27-39.

[10] 郭昱杉,劉慶生,劉高煥,等. 基于標(biāo)記控制分水嶺分割方法的高分辨率遙感影像單木樹冠提取[J]. 地球信息科學(xué)學(xué)報(bào),2016,18(9):1259-1266.

Guo Yushan, Liu Qingsheng, Liu Gaohuan, et al. Individual tree crown extraction of high resolution image based on marker-controlled watershed segmentation method[J]. Journal of Geo-information Science, 2016, 18(9): 1259-1266. (in Chinese with English abstract)

[11] Malek S, Bazi Y, Alajlan N, et al. Efficient framework for palm tree detection in UAV images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2014, 7(12): 4692-4703.

[12] Windrim L, Bryson M. Detection, segmentation, and model fitting of individual tree stems from airborne laser scanning of forests using deep learning[J]. Remote Sensing, 2020, 12(9): 1469.

[13] Dai W, Yang B, Dong Z, et al. A new method for 3D individual tree extraction using multispectral airborne LiDAR point clouds[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2018, 144: 400-411.

[14] Marinelli D, Paris C, Bruzzone L. An approach to tree detection based on the fusion of multitemporal LiDAR data[J]. IEEE Geoscience and Remote Sensing Letters, 2019, 16(11): 1771-1775.

[15] Marselis S M, Tang H, Armston J, et al. Exploring the relation between remotely sensed vertical canopy structure and tree species diversity in Gabon[J]. Environmental Research Letters, 2019, 14(9): 1748-9326.

[16] Sainath T N, Mohamed A, Kingsbury B, et al. Deep convolutional neural networks for LVCSR[C]//IEEE International Conference on Acoustics, Speech and Signal Processing, Vancouver, Canada, 2013: 8614-8618.

[17] Le Q V, Ranzato M A, Monga R, et al. Building high-level features using large scale unsupervised learning[C]//In Proceedings of the 2013 IEEE International Conference on Acoustics, Speech and Signal Processing, Vancouver, Canada, 2013: 8595–8598.

[18] Zhu X, Tuia D, Mou L, et al. Deep learning in remote sensing: a comprehensive review and list of resources[J]. IEEE Geoscience and Remote Sensing Magazine, 2017, 5(4): 8-36.

[19] Neupane B, Horanont T, Hung N D. Deep learning based banana plant detection and counting using high-resolution red-green-blue (RGB) images collected from unmanned aerial vehicle (UAV)[J]. PLoS ONE, 2019, 14(10): e0223906.

[20] Torres D L, Feitosa R Q, Happ P N, et al. Applying fully convolutional architectures for semantic segmentation of a single tree species in urban environment on high resolution UAV optical imagery[J]. Sensors, 2020, 20(2): 563.

[21] Li W, Fu H, Yu L, et al. Deep learning-based oil palm tree detection and counting for high-resolution remote sensing images[J]. Remote Sensing, 2016, 9(1): 22.

[22] Guirado E, Tabik S, Alcaraz-Segura D, et al. Deep-learning versus OBIA for scattered shrub detection with google earth imagery: ziziphus lotus as case study[J]. Remote Sensing, 2017, 9(12): 1220.

[23] Culman M, Delalieux S, Tricht K V. Individual palm tree detection using deep learning on RGB imagery to support tree inventory[J]. Remote Sensing, 2020, 12(21): 3476.

[24] Ren S, He K, Girshick R, et al. Faster RCNN: towards real-time object detection with region proposal networks[C]//Advances in Neural Information Processing System, Vancouver, BC, Canada, 2015: 91-99.

[25] Redmon J, Divvala S, Girshick R, et al. You only look once: unified, real-time object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas, USA, 2016: 779-788.

[26] Ding B, Long C, Zhang L, et al. ARGAN: Attentive recurrent generative adversarial network for shadow detection and removal[C]//International Conference on Computer Vision (ICCV), Venice, Italy, 2020: 10212-10221.

[27] Zheng Q, Qiao X, Cao Y, et al. Distraction-aware shadow detection[C]//Conference on Computer Vision and Pattern Recognition (CVPR), California, USA, 2019: 5162-5171.

[28] Wang X, Shrivastava A, Gupta A. A-Fast-RCNN: hard positive generation via adversary for object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Honolulu, Hawaii, 2017: 2606-2615.

[29] Gougeon F. A crown-following approach to the automatic delineation of individual tree crowns in high spatial resolution images[J]. Canadian Journal of Remote Sensing, 1995, 21(3): 274-288.

[30] Erikson M. Segmentation of individual tree crowns in colour aerial photographs using region growing supported by fuzzy rules[J]. Canadian Journal of Forest Research, 2003, 33(8): 1557-1563.

[31] Lamar W R, McGraw J B, Warner T A. Multi-temporal censuring of a population of eastern hemlock (. ) from remotely sensed imagery using an automated segmentation and reconciliation procedure[J]. Remote Sensing of Environment, 2005, 94(1): 133-143.

[32] Larsen M, Eriksson M, Descombes X, et al. Comparison of six individual tree crown detection algorithms evaluated under varying forest conditions[J]. International Journal of Remote Sensing, 2011, 32(20): 5827-5852.

[33] Dong T, Shen Y, Zhang J, et al. Progressive cascaded convolutional neural networks for single tree detection with google earth imagery[J]. Remote Sensing, 2019, 11(15): 1786.

[34] Foody G M. Thematic map comparison: Evaluating the statistical significance of differences in classification accuracy[J]. Remote Sensing, 2004, 70: 627–633.

Research on anti-shadow tree detection method based on generative adversarial network

Ye Yang, Shen Bingyan, Shen Yuqi

(,,310023,)

High-scoring remote sensing imaging has widely been applied in most management of agriculture and forestry, especially to monitor and evaluate crops and forest resources on a large scale. Nevertheless, there is a great challenge to the accuracy of single tree identification and detection during the image acquisition, due mainly to the fact that the shadow area is inevitably formed by the light. The shadow areas in the remote sensing images can be assumed as a kind of noise in the image sampling. As such, the degradation of high-resolution parameters can cause image distortion after post-processing. In this study, an anti-shadow tree detection method was proposed to detect the single tree with shadow interference using a generative adversarial network (GA-Faster RCNN). This framework consisted of a Faster RCNN network and a tree generator. The Faster RCNN network was mainly used for the tasks of feature extraction and detection. The tree generator was utilized to process the shadows in tree detection. The adversarial generation strategy was adopted by the tree generator to learn generating the minimum feature information characterizing trees. The generator was first trained separately and then put into the Faster RCNN network to finally lock its parameters. Two parts were then trained end-to-end to further improve the tree recognition ability of the network. The GA-Faster RCNN was also compared with 3 state-of-the-art methods, including region-growing, progressive cascaded convolutional neural network, and Faster RCNN on three test areas with shadows. Test area 1 presented a lot of shadows of trees, where the canopy density of trees was very high. Test area 2 showed fewer tree shadows and lower canopy closure, compared with test area 1. The shades of trees and the canopy density of trees in test area 3 were between those in test area 1 and 2. Results demonstrated that the GA-Faster RCNN achieved the highest harmonic average of precision and recall (1) on the test area 1, 2, and 3, which were 78.4%, 91.6%, and 81.7%, respectively. The average1 of three test areas was 84.7% for the GA-Faster RCNN, 6.2 percentage point higher than that of Faster RCNN. The user accuracy (UA) and producer accuracy (PA) of GA-Faster RCNN were also the highest among four methods, where UA was 79.8%, 95.0%, 85.3%, and PA was 77.0%, 88.5%, and 78.4% on test area 1, 2, 3, respectively. Moreover, a significance analysis, McNemar, was performed to eliminate the interference of experimental errors and other factors. It was found that there was a statistically significant difference between the three comparison methods and GA-Faster RCNN. The shadow misrecognition rate SR (proportion of the count of shadows misrecognized as trees to the count of total recognized trees) of GA-Faster RCNN was compared with that of Faster RCNN on test area 1, in order to clarify the effect of the mask on tree identification. Although the SR of GA-Faster RCNN was 13.8%, higher than that of Faster RCNN (8.6%), the UA and the number of missed tree identification were both better than those of Faster RCNN. Therefore, the GA-Faster RCNN behaved significant advantages over the other identification. In addition, the GA-Faster RCNN can still maintain the detection stability, when using different feature extraction networks, including ResNet101, ResNet50, and DenseNet. Consequently, the adversarial generative training strategy is highly suitable for learning the minimum feature information characterizing trees, while effectively reducing the interference of shadows, indicating the promising practical value for higher accuracy of tree detection.

remote sensing; algorithm; tree; detection; image; shadow interference; deep learning

10.11975/j.issn.1002-6819.2021.10.014

TP391

A

1002-6819(2021)-10-0118-09

葉陽(yáng),沈冰雁,沈毓琦. 基于生成對(duì)抗網(wǎng)絡(luò)的抗陰影樹木檢測(cè)方法[J]. 農(nóng)業(yè)工程學(xué)報(bào),2021,37(10):118-126.doi:10.11975/j.issn.1002-6819.2021.10.014 http://www.tcsae.org

Ye Yang, Shen Bingyan, Shen Yuqi. Research on anti-shadow tree detection method based on generative adversarial network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(10): 118-126. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.10.014 http://www.tcsae.org

2020-03-12

2021-04-13

國(guó)家自然科學(xué)基金資助項(xiàng)目(No. 61672464)

葉陽(yáng),實(shí)驗(yàn)師,主要研究方向?yàn)閳D像處理。Email:yeyang80@zjut.edu.cn