基于級(jí)聯(lián)生成對(duì)抗網(wǎng)絡(luò)的遙感圖像去霧方法

孫 瀟,徐金東

(煙臺(tái)大學(xué)計(jì)算機(jī)與控制工程學(xué)院,山東煙臺(tái) 264005)

0 引言

隨著對(duì)地觀測(cè)技術(shù)的快速發(fā)展,衛(wèi)星遙感和航空遙感提供了高空間分辨率和光譜分辨率的遙感圖像[1-4]。但對(duì)于任何光學(xué)遙感成像傳感器,大氣都是不可避免的噪聲源,如霧、霾、雪、灰塵或廢氣和云。因此,對(duì)遙感圖像有效去霧和保持地表原始細(xì)節(jié)之間的平衡非常重要。

為了提高遙感圖像的質(zhì)量,解決不適定的去霧問(wèn)題,提出了許多基于先驗(yàn)的算法[5-7]。這些方法將霧作為頻率域中的一種特殊低頻成分[8-15],但在抑制霧成分的同時(shí),無(wú)霧區(qū)域中的原始低頻信息可能被損壞。因此,基于先驗(yàn)的算法性能很大程度上取決于霧區(qū)域檢測(cè)的準(zhǔn)確性。也有利用統(tǒng)計(jì)學(xué)方法進(jìn)行圖像去霧,例如霧度優(yōu)化變換(Haze Optimized Transformation,HOT)[16]方法簡(jiǎn)單且具有魯棒性,但HOT方法在沒(méi)有充分利用原始圖像中空間相關(guān)性的情況下性能受到了一定的限制。另外一些基于光譜分析的方法主要依賴(lài)于光譜域內(nèi)的互補(bǔ)信息[17-18]。文獻(xiàn)[19]中提出基于經(jīng)驗(yàn)輻射轉(zhuǎn)移模型尋找可見(jiàn)光和近紅外波段之間的光學(xué)數(shù)據(jù)關(guān)系,去除可見(jiàn)光波段中的霧和薄云。當(dāng)波段有限時(shí),它們通常無(wú)法工作。目前已涌現(xiàn)出許多基于深度學(xué)習(xí)的去霧方法[20-24],在給定成對(duì)的彩色室內(nèi)帶霧圖像及其真實(shí)圖像組成的數(shù)據(jù)庫(kù)上學(xué)習(xí)去霧,文獻(xiàn)[20]介紹了一種去霧網(wǎng)絡(luò),通過(guò)特征提取、局部極值、非線(xiàn)性回歸和多尺度映射形成的端到端的卷積神經(jīng)網(wǎng)絡(luò)系統(tǒng)去霧,最新自然圖像去霧專(zhuān)注于使用生成對(duì)抗網(wǎng)絡(luò)(Generative Adversarial Network,GAN)[25]或 Conditional GAN[26]訓(xùn)練模型,但均需大量訓(xùn)練樣本對(duì)。

現(xiàn)有大多數(shù)工作都是關(guān)于自然圖像去霧,盡管自然圖像去霧的一些模型已有應(yīng)用于遙感圖像,但自然圖像和遙感圖像之間的成像機(jī)理差異致使去霧問(wèn)題并不能得到很好的解決。對(duì)于訓(xùn)練網(wǎng)絡(luò)去霧,有霧圖像和無(wú)霧圖像都是必不可少的,但在實(shí)際情況中,除了霧還會(huì)有多重因素(云、霾、雪、灰塵或廢氣)導(dǎo)致遙感圖像質(zhì)量不佳,如果無(wú)法獲取配對(duì)數(shù)據(jù),將很難精確建模達(dá)到完全去霧等覆蓋物的效果。因此需要設(shè)計(jì)一種不假定任何特定影響因素類(lèi)型的去霧方法,通過(guò)學(xué)習(xí)霧的生成過(guò)程,達(dá)到更好的去霧效果。

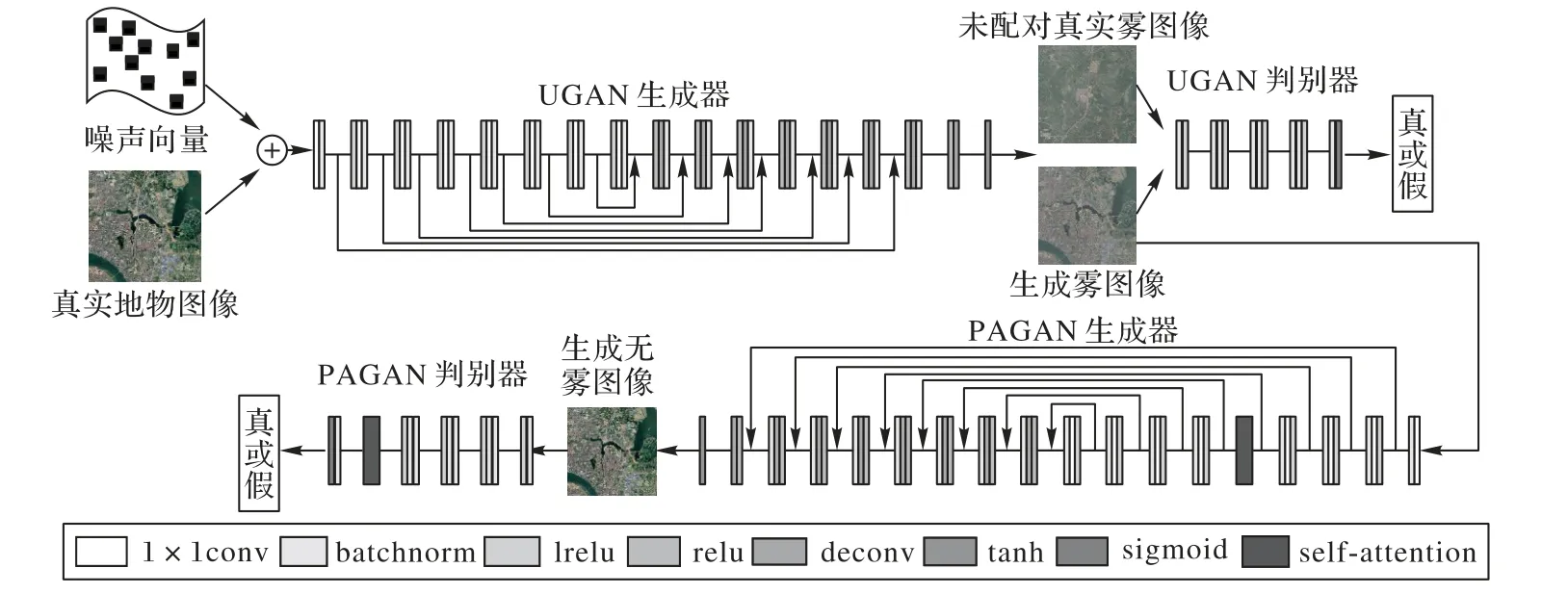

基于以上問(wèn)題,本文提出了級(jí)聯(lián)生成對(duì)抗網(wǎng)絡(luò)進(jìn)行遙感圖像去霧。以U-Net[27]的U型結(jié)構(gòu)為基礎(chǔ)搭建學(xué)習(xí)霧生成的UGAN(U-Net GAN)和學(xué)習(xí)去霧的PAGAN(Pixel Attention GAN)。UGAN和PAGAN互為支撐,UGAN使用未配對(duì)的清晰圖像和霧圖像進(jìn)行訓(xùn)練生成逼真的帶霧遙感圖像,模擬真實(shí)霧對(duì)遙感圖像的影響,PAGAN模塊增加自我注意機(jī)制從前一階段生成的霧遙感圖像中恢復(fù)無(wú)霧遙感圖像。

1 級(jí)聯(lián)生成對(duì)抗網(wǎng)絡(luò)

1.1 模型結(jié)構(gòu)

遙感圖像去霧訓(xùn)練使用的合成數(shù)據(jù)并不能模擬真實(shí)的遙感圖像,成對(duì)遙感數(shù)據(jù)集的缺失導(dǎo)致深度學(xué)習(xí)方法訓(xùn)練困難。為了解決這個(gè)問(wèn)題,級(jí)聯(lián)GAN可以降低模型對(duì)大量訓(xùn)練數(shù)據(jù)的需求和對(duì)成對(duì)數(shù)據(jù)的依賴(lài),拓寬模型的應(yīng)用場(chǎng)景。該網(wǎng)絡(luò)包含兩種GAN模型,即學(xué)習(xí)霧分布的UGAN和學(xué)習(xí)去霧的PAGAN。UGAN模型學(xué)習(xí)如何使用未配對(duì)的霧圖像和無(wú)霧遙感圖像集在保留遙感圖像細(xì)節(jié)的同時(shí)對(duì)無(wú)霧圖像進(jìn)行加霧處理,然后指導(dǎo)PAGAN正確地對(duì)此類(lèi)圖像進(jìn)行去霧操作。級(jí)聯(lián)網(wǎng)絡(luò)包含兩個(gè)主要模塊,UGAN和PAGAN,UGAN以噪聲和標(biāo)簽數(shù)據(jù)圖像作為輸入,輸出生成霧圖像并將其輸入PAGAN學(xué)習(xí)去霧。圖1給出了算法的整體架構(gòu)。

圖1 基于級(jí)聯(lián)對(duì)抗生成網(wǎng)絡(luò)的遙感圖像去霧算法的整體框架Fig.1 Overall framework of remote sensing image dehazingalgorithm based on cascaded GAN

在訓(xùn)練階段,將清晰的遙感圖像輸入U(xiǎn)GAN生成器中,生成的模擬霧圖像輸入到PAGAN中學(xué)習(xí)如何去霧,通過(guò)對(duì)抗學(xué)習(xí)逐步提高UGAN的霧生成能力和PAGAN的霧去除能力,同時(shí)減少對(duì)成對(duì)數(shù)據(jù)的依賴(lài)性。UGAN和PAGAN模塊中的生成器生成相應(yīng)的圖像,鑒別器進(jìn)行鑒別,生成更加逼真的合成圖像。在測(cè)試階段,遙感圖像去霧任務(wù)只需PAGAN生成器網(wǎng)絡(luò)。

1.2 UGAN

UGAN模塊在清晰的遙感圖像上直接生成霧圖像,U型結(jié)構(gòu)和跳躍鏈接操作可以較好地保留邊界、角點(diǎn)等高頻內(nèi)容,最大限度保留遙感圖像地物細(xì)節(jié)。UGAN由一個(gè)生成器和一個(gè)鑒別器組成。

UGAN生成器 UGAN生成器的輸入是來(lái)自公共數(shù)據(jù)集的清晰遙感圖像。考慮到眾多可能導(dǎo)致不理想的霧霾覆蓋因素,本文將輸入圖像與噪聲映射連接起來(lái),以模擬不同的條件在遙感圖像上生成霧。網(wǎng)絡(luò)結(jié)構(gòu)包括收縮路徑和擴(kuò)展路徑,各包含8層卷積,后半部分的前三層卷積使用Dropout。Dropout層在訓(xùn)練過(guò)程中以一定概率隨機(jī)去掉一些神經(jīng)元,起到防止過(guò)擬合的作用。卷積層代表的收縮路徑通過(guò)下采樣提取高維特征信息,每一次下采樣,圖片大小變?yōu)樵瓉?lái)的1/2,特征數(shù)量變?yōu)樵瓉?lái)的2倍。對(duì)于圖像去霧問(wèn)題,某些特征并不需要再進(jìn)入更深層的下采樣層中,而是可以直接跨越網(wǎng)絡(luò)到解碼器對(duì)應(yīng)的層。為了實(shí)現(xiàn)這樣的功能,在網(wǎng)絡(luò)中添加一種特殊的連接——跳躍連接(Skip Connection)。擴(kuò)張網(wǎng)絡(luò)在上采樣操作中,將每一次的輸出特征與相映射的收縮網(wǎng)絡(luò)的特征合并在一起,補(bǔ)全中間丟失的邊界信息。最后,加入1×1的卷積操作將之前獲得的特征映射到所屬分類(lèi)上面。通過(guò)這種方法,可以在一幅清晰遙感圖像的基礎(chǔ)上生成帶霧的遙感圖像。UGAN生成器的輸出是與輸入圖像大小相同的圖像。

UGAN判別器 UGAN判別器的輸入是UGAN生成器的輸出。其架構(gòu)主要包括5個(gè)步長(zhǎng)為2,卷積核大小為4的卷積模塊,輸出為生成帶霧的遙感圖像被劃分為真實(shí)圖像的概率。

1.3 PAGAN

PAGAN不同于UGAN,它的目標(biāo)是更有效地從霧遙感圖像中恢復(fù)清晰遙感圖像。自我注意模塊的加入是對(duì)卷積的補(bǔ)充,使生成器協(xié)調(diào)每個(gè)位置的細(xì)節(jié)和遠(yuǎn)端細(xì)節(jié),精確地對(duì)全局圖像結(jié)構(gòu)執(zhí)行復(fù)雜的幾何約束。

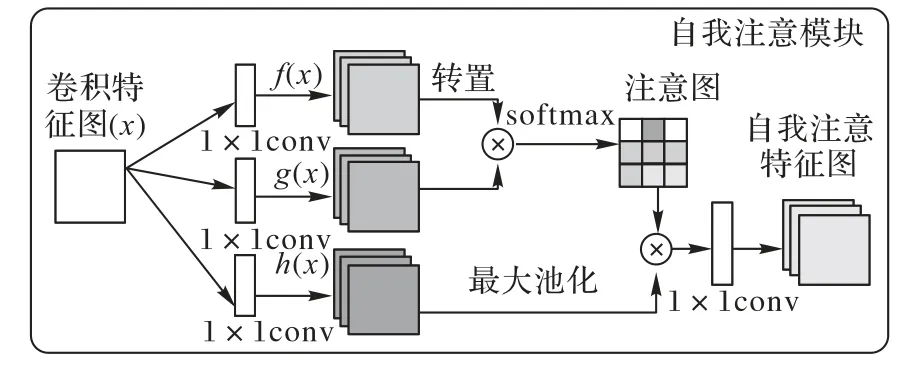

PAGAN生成器 PAGAN生成器的輸入是一個(gè)帶霧的遙感圖像。在沿用UGAN生成器的同時(shí)加入自我注意機(jī)制(Self-Attention)。具體結(jié)構(gòu)如圖2所示。在生成器的卷積過(guò)程中,模型嚴(yán)重依賴(lài)于卷積對(duì)不同圖像區(qū)域之間的相關(guān)性進(jìn)行建模。由于卷積操作符存在局部接受域,長(zhǎng)距離的依賴(lài)關(guān)系必須經(jīng)過(guò)幾個(gè)卷積層才能處理,導(dǎo)致卷積效率低下。自我注意模塊計(jì)算一個(gè)位置的響應(yīng)作為所有位置特征的加權(quán)和,其中的注意力向量并不會(huì)增加計(jì)算成本且可以成功捕獲全局依賴(lài)關(guān)系,有效地對(duì)廣泛分離的空間區(qū)域之間的關(guān)系進(jìn)行建模。PAGAN生成器的輸出是所需的清晰遙感圖像。

圖2 自我注意機(jī)制Fig.2 Self-attention mechanism

PAGAN判別器 PAGAN判別器中同樣加入自我注意機(jī)制,檢查圖像中較遠(yuǎn)部分的細(xì)節(jié)特征是否一致。判別器的輸出為生成去霧遙感圖像被劃分為真實(shí)圖像的概率。

1.4 損失函數(shù)

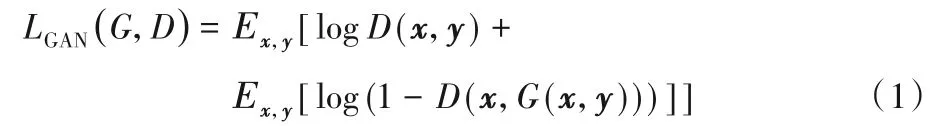

GAN是生成模型,它將輸入圖像與噪聲映射連接起來(lái),即將觀測(cè)到的圖像映射x和隨機(jī)噪聲向量z映射到輸出圖像y,G:{x,z}→y。GAN的生成器和判別器分別對(duì)合成圖像和真實(shí)圖像之間進(jìn)行對(duì)抗損失訓(xùn)練。UGAN和PAGAN的目標(biāo)可以表示為:

其中,生成器G試圖最小化這個(gè)目標(biāo)來(lái)生成更好的圖片,而判別器D會(huì)盡可能最大化目標(biāo)提高自己的判別能力,如式(2)所示:

將GAN目標(biāo)函數(shù)與更傳統(tǒng)的損失(如L1)混合有益于提升生成質(zhì)量,判別器只對(duì)高頻結(jié)構(gòu)進(jìn)行建模,讓L1對(duì)低頻進(jìn)行建模。判別器的工作保持不變,但生成器的任務(wù)不僅欺騙判別器,而且在L1約束下更加接近真值:

為了平衡不同類(lèi)型的損失,使用超參數(shù)λ(將其設(shè)置為100.0)共同計(jì)算最終目標(biāo):

2 實(shí)驗(yàn)與結(jié)果分析

2.1 數(shù)據(jù)集

為了驗(yàn)證算法的有效性,采用RICE[28]的兩個(gè)基準(zhǔn)數(shù)據(jù)集進(jìn)行實(shí)驗(yàn):

1)RICE-Ⅰ數(shù)據(jù)集。采集自Google Earth,通過(guò)設(shè)置是否顯示云層,得到相應(yīng)的云和無(wú)云圖像,然后將獲取的圖像裁剪為512×512大小,不含重疊片區(qū)。RICE-Ⅰ總共包含500對(duì)圖像。

2)RICE-Ⅱ數(shù)據(jù)集。RICE-Ⅱ數(shù)據(jù)來(lái)自L(fǎng)andsat 8 OLI_TIRS數(shù)據(jù)集,并且在美國(guó)國(guó)家地質(zhì)調(diào)查局地球探索者數(shù)據(jù)庫(kù)中使用了具有地理參考的LandsatLook圖像。在數(shù)據(jù)集中使用了LandsatLook圖像的自然彩色圖像(landsat8 OLI,波段6、5、4)和高質(zhì)量圖像(Landsat Level-1質(zhì)量帶生成的8位文件)。云圖像是間隔至少15 d在同一地區(qū)截取真實(shí)遙感圖像制作。獲取圖像大小為512×512,不含重疊片區(qū)。總共包含700對(duì)圖像。

2.2 實(shí)驗(yàn)結(jié)果與分析

在訓(xùn)練UGAN和PAGAN時(shí),均將學(xué)習(xí)率設(shè)定為0.000 2、epoch為200、超參數(shù)β為0.5、λ為100.0。如圖3所示,霧圖像被大面積均勻的霧及其相關(guān)陰影所覆蓋,該圖像數(shù)據(jù)集包含山川、河流和城鎮(zhèn)遙感圖像。CAP(Color Attenuation Prior)和DCP(Dark Channel Prior)是基于統(tǒng)計(jì)學(xué)并融合相關(guān)先驗(yàn)信息的去霧算法。結(jié)果顯示,CAP對(duì)于非均勻的霧并不能完全識(shí)別,只能減輕霧的厚度無(wú)法達(dá)到去除的效果,致使去霧后的圖像不能準(zhǔn)確區(qū)分細(xì)節(jié)信息。觀察DCP算法和GCANet(Gated Context Aggregation Network)的去霧圖像,在處理細(xì)節(jié)及飽和度、對(duì)比度方面欠佳。基于深度學(xué)習(xí)的MOF(Multiscale Optimal Fusion)方法將圖像分為有霧層和無(wú)霧層融合多尺度模塊去霧,但過(guò)度增強(qiáng)導(dǎo)致結(jié)果過(guò)飽和,存在光譜失真問(wèn)題。不同于近景的自然圖像,遙感圖像大量的地物細(xì)節(jié)信息對(duì)去霧算法提出了更高的要求。FFANet(Feature Fusion Attention Network)[29]是2020年提出的基于深度學(xué)習(xí)模型針對(duì)自然圖像去霧算法,但對(duì)遙感圖像去霧效果不夠理想。相比之下,本文方法更能反映遙感圖像地面真值且無(wú)光譜失真。

圖3 RICE-Ⅰ數(shù)據(jù)集去霧效果Fig.3 Dehazing effect on RICE-Ⅰdataset

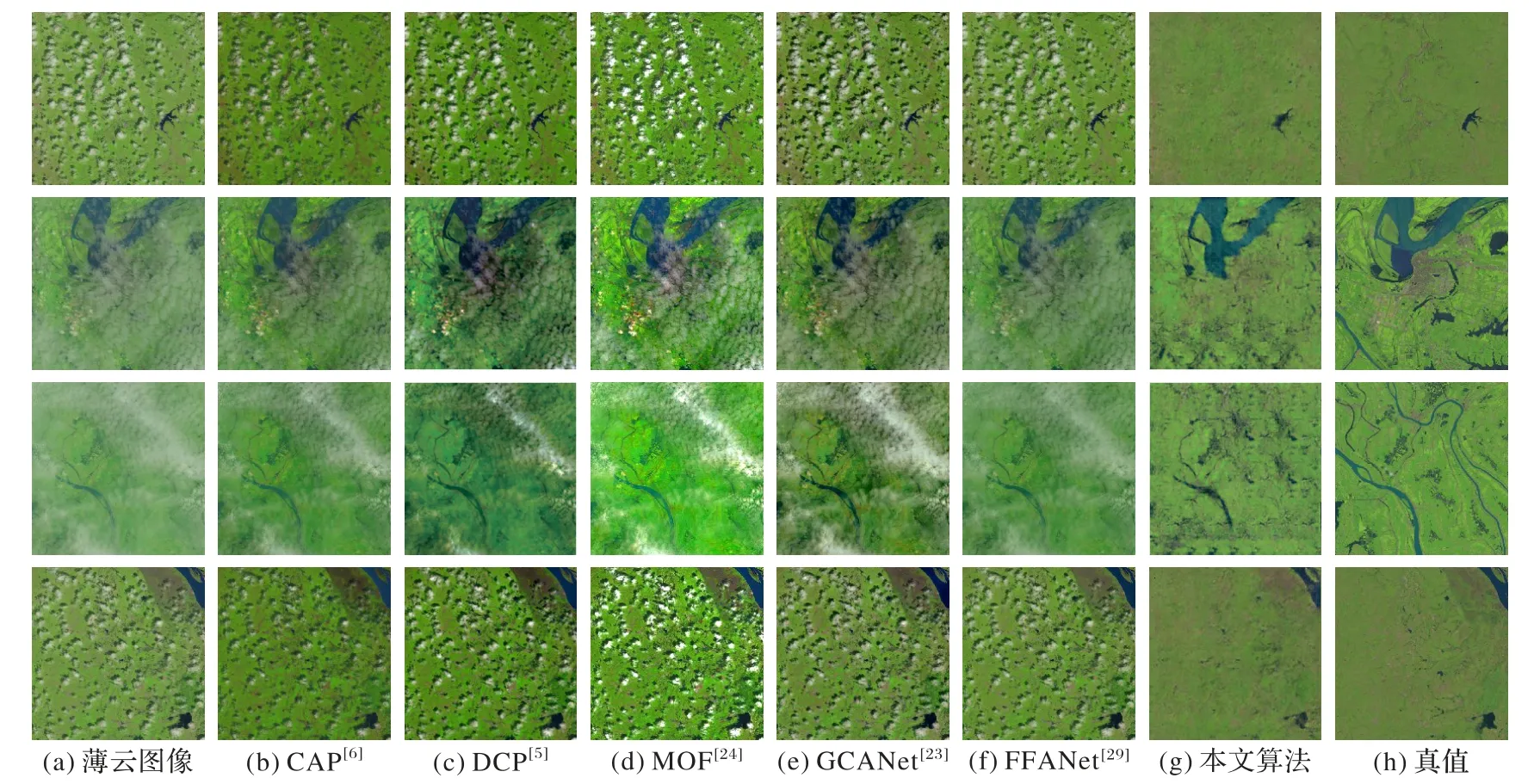

為了進(jìn)一步探討本文方法對(duì)大氣中其他顆粒的處理情況,在薄云遙感圖像上做了對(duì)比去除實(shí)驗(yàn)。與霧的均質(zhì)分布不同,云存在多種分布類(lèi)型,如大團(tuán)的積云、大片的層云和纖維狀的卷云,不同形狀的云在遙感圖像形成過(guò)程中產(chǎn)生了不同的影響。當(dāng)云層密度相對(duì)較低時(shí),薄云會(huì)減弱電磁信號(hào)的能量,被薄云遮擋的片區(qū)形成陰影。薄厚不一的云覆蓋了圖像的大部分區(qū)域,因此,大多數(shù)的圖像特征都變得不可見(jiàn),對(duì)于地物細(xì)節(jié)的恢復(fù)一直是遙感圖像處理領(lǐng)域的難題。

實(shí)驗(yàn)結(jié)果如圖4所示,多種類(lèi)型的云覆蓋了大部分像素,因此CAP、GCANet、MOF和DCP均沒(méi)有對(duì)薄云進(jìn)行完整去除。與其他算法相比,本文方法能有效地將云移除。

圖4 RICE-Ⅱ數(shù)據(jù)集去薄云效果Fig.4 Effect of thin cloud removal on RICE-Ⅱdataset

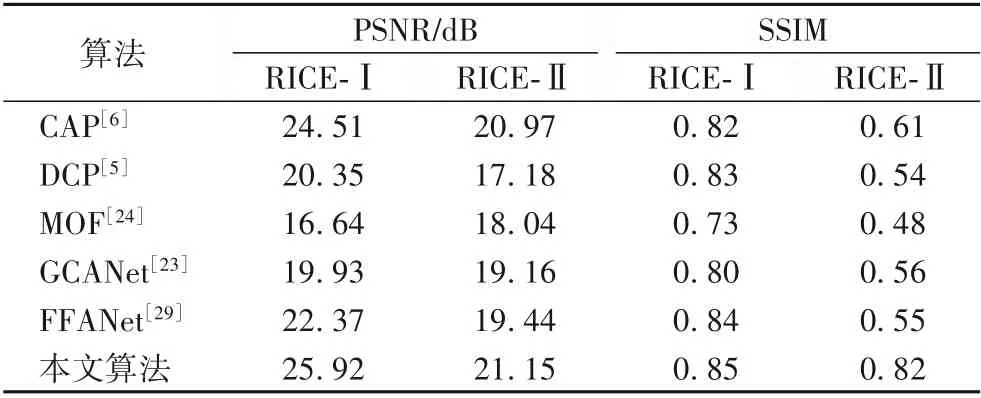

為了對(duì)算法進(jìn)行定量評(píng)估,選擇峰值信噪比(Peak Signal-to-Noise Ratio,PSNR)和 結(jié) 構(gòu) 相 似 性(Structural SIMilarity,SSIM)兩個(gè)指標(biāo)來(lái)評(píng)估圖像去霧效果。PSNR數(shù)值越大表示失真越小,SSIM的取值范圍[0,1],值越大表示分離的圖像與源圖像越接近。表1列出了每組實(shí)驗(yàn)的度量指標(biāo),可見(jiàn)本文方法在兩組實(shí)驗(yàn)中均取得了最好的指標(biāo)。

表1 不同數(shù)據(jù)集圖像去霧指數(shù)測(cè)量(PSNR,SSIM)Tab.1 Image dehazing index measurement for different datasets(PSNR,SSIM)

3 結(jié)語(yǔ)

本文提出了一種新的框架來(lái)解決遙感數(shù)據(jù)缺失問(wèn)題,通過(guò)級(jí)聯(lián)生成對(duì)抗網(wǎng)絡(luò)學(xué)習(xí)霧分布并將帶霧遙感圖像恢復(fù)為清晰的遙感圖像。與只專(zhuān)注于學(xué)習(xí)去霧的相關(guān)工作相比,該方法使用未配對(duì)的無(wú)霧和帶霧遙感圖像來(lái)真實(shí)地合成云霧效果,從而加強(qiáng)網(wǎng)絡(luò)的去霧性能。為了產(chǎn)生更逼真的無(wú)霧遙感圖像,PAGAN模塊采用的自我注意機(jī)制能夠?qū)θ謭D像結(jié)構(gòu)實(shí)施復(fù)雜的幾何約束,縮小生成和真實(shí)無(wú)云圖像之間的差距。該方法不僅可以將遙感圖像中的霧有效去除,而且對(duì)薄云去除和地物重建也取得了較好的效果。