基于檢測的艦載機多目標實時跟蹤算法

田少兵 朱興動 范加利 王正

摘 要: 面向航空母艦艦載機調運作業過程中安全引導、 運動狀態實時監控, 針對傳統的基于檢測的目標跟蹤算法跟蹤性能不佳且易受干擾的問題, 提出了將YOLO v3目標檢測算法和卡爾曼濾波相結合的艦載機多目標實時跟蹤算法。 通過K-means聚類算法優化了原YOLO v3算法的錨點框大小, 結合卡爾曼濾波算法對艦面艦載機目標實現有效的跟蹤, 并在自建的艦載機多目標跟蹤數據集和MOT16多目標跟蹤數據集上與基于光流法的跟蹤算法、 SORT多目標跟蹤算法進行了對比實驗。 結果表明, 本文提出的跟蹤算法準確性、 魯棒性、 穩定性更高, 且當目標框寬度、 高度發生突變時具有較強的適應能力。

關鍵詞:目標檢測; 卡爾曼濾波; 匈牙利算法; 目標跟蹤; 深度學習

中圖分類號:TJ760; TP391? 文獻標識碼:??? A? 文章編號:1673-5048(2021)04-0049-07

0 引? 言

航空母艦是國之重器, 艦載機是航空母艦的主要作戰武器, 其在航空母艦艦面作業過程中的安全保障問題尤為重要。 隨著計算機視覺技術在國防軍事領域的廣泛應用, 對航空母艦艦面作業的艦載機目標進行實時跟蹤, 可實時獲得艦載機運動狀態信息, 分析其運動軌跡, 從而對艦載機調運進行安全引導, 以保障艦載機裝備安全。

多目標跟蹤是計算機視覺領域的研究熱點, 可以分為基于檢測的跟蹤和非基于檢測的跟蹤。 前者需要在跟蹤過程中對每一幀圖像進行目標檢測, 跟蹤數量可隨著攝像機視野內的目標數目變化而變化, 適用于場景目標數量多變的情況, 但跟蹤性能依賴于目標檢測的性能。 后者需要在視頻第一幀手動標注目標初始位置。 跟蹤過程中目標數量固定, 不能適應目標數目變化的場景, 具有很大的局限性。 隨著檢測算法的不斷發展, 基于檢測的多目標跟蹤方法更受青睞。 文獻[1]采用背景幀差分法對紅外目標進行識別, 之后通過卡爾曼濾波對紅外目標進行預測跟蹤, 但由于幀差法要不停地調整速度快慢來調節幀間時間間隔, 會出現不同連續的空洞, 導致有時會檢測出不完整的目標輪廓, 且對噪音干擾的魯棒性較差, 跟蹤準確率不高。 文獻[2]提出一種將光流法和卡爾曼濾波相結合的目標跟蹤方法, 但由于光流法容易受光線、 抖動等無關運動的因素干擾, 且實時性較差, 跟蹤的準確性和實時性都不高。 可見, 傳統的基于檢測的跟蹤算法對環境干擾適應能力差, 跟蹤準確率不高。 隨著基于深度卷積神經網絡的目標檢測算法迅速發展, 其檢測和跟蹤的魯棒性、 準確性大大提高, 逐步取代了傳統檢測算法。 文獻[3]將基于MobileNet的目標檢測算法與Deep-SORT多目標跟蹤算法相結合, 算法的實時性得到了顯著提高。 文獻[4]采用Faster R-CNN算法對坦克目標進行檢測, 之后基于跟蹤-學習-檢測框架實現對目標的跟蹤, 跟蹤準確率大大提升。

艦載機在航空母艦艦面上執行調運任務具有不確定性, 因此, 視野內艦載機數目呈不確定性變化, 且艦載機跟蹤準確性要求高, 綜合考慮, 采用基于智能目標檢測的跟蹤算法對航空母艦艦面艦載機目標進行實時跟蹤, 旨在解決傳統檢測跟蹤算法準確性、 魯棒性不高的問題。 選取實時性強且檢測準確率較高的YOLO v3目標檢測算法對艦載機進行目標位置檢測,? 并結合卡爾曼濾波器對跟蹤目標序列進行目標位置更新, 實現了對艦載機目標的實時跟蹤。

1 算法概述

首先采用YOLO v3目標檢測算法對當前視頻幀中的艦載機目標進行檢測, 接著通過匈牙利算法對當前檢測的艦載機目標和上一幀艦載機跟蹤目標進行數據關聯, 得到關聯的目標框, 然后基于卡爾曼濾波器預測階段對前一幀跟蹤目標序列進行預測, 得到當前幀預測的跟蹤目標序列, 接著將關聯的目標框作為觀測量對預測的跟蹤序列進行修正更新, 得到當前幀跟蹤目標序列的更新結果, 跟蹤算法框架如圖1所示。

2 YOLO v3目標檢測算法

2.1 算法簡介

YOLO v3屬于單階段檢測算法[5-7], 將目標檢測的各個部分統一到神經網絡中, 目標位置回歸與目標分類預測同步進行, 實現了端到端的目標檢測, 檢測實時性強、 準確率較高。

YOLO v3網絡結構如圖2所示。將輸入圖像分成S×S的網格。 如果圖像中有一個目標的中心落入某個網格中, 則該網格負責預測此目標。 每個網格都會預測B個目標邊界框, 每個邊界框包含目標邊界框的位置偏移參數(tx, ty, tw, th)、 目標置信度c和C個類別概率。 c是邊界框中是否含有目標及對其預測準確性的判斷:

c=P(object)×IOUtruthpred(1)

若網格中含有目標, 則P(object)=1, 反之P(object)=0。 IOUtruthpred表示目標的真實邊界框與預測邊界框的交并比, 計算公式為

IOUtruthpred=area(pred)∩area(truth)area(pred)∪area(truth)(2)

類別概率用P(classi|object)表示, 則有

P(classi|object)*P(object)×IOUtruthpred=P(classi)*IOUtruthpred(3)

等式結果表示邊界框各個類別的置信度分數, 這些分數同時包含了某一類別出現在邊界框中的概率, 以及邊界框預測目標分類的準確度。

隨著網絡的不斷加深, 訓練時會出現梯度消失的問題, YOLO v3將Darknet-53網絡作為特征提取網絡, 類似于特征金字塔網絡的結構提取圖像特征, 并進行多尺度融合[8-9], 旨在提取更深層次的圖像特征, 提高模型的準確率。 在每個尺度上面生成3個anchor, 用于預測目標邊界框的位置, 最終網絡輸出一個三維向量, 包含4個位置參數、 1個目標置信度參數、 class_num個目標類別參數, 因此三維向量為N×N×[3-(4+1+class_num)], N×N為劃分的網格數, 即13×13。

2.2 基于聚類的anchor生成方案

YOLO v3算法在PASCAL VOC數據集上聚類而成的預先anchor大小, 雖然具有泛化能力, 但是對于只有一種檢測類別而言, 原始的anchor方案并不適合網絡模型訓練的要求。 因此, 本文在構建的艦載機數據集上進行anchor聚類, 這樣在邊界框回歸時, 能夠提高回歸工作效率, 加快網絡訓練收斂時間, 提高檢測精度[10]。

原K-means聚類算法通常將歐氏距離作為評價相似性的準則函數, 本文需要對候選框的寬度和高度進行聚類, 若采用歐氏距離作為評價指標, 則會造成大候選框比小候選框的誤差更大, 因此, 用聚類中心對應的框與周圍各候選框的IOU值來衡量兩者的差異, 則聚類目標函數定義為

d(box, center)=min∑ki∑nj(1-IOU(boxj, centeri))(4)

式中: k為聚類中心個數; n為數據集大小; IOU(boxj, centeri)為兩者面積交并比; boxj為數據集中每個艦載機尺寸; centeri為預設的聚類中心。

3 基于卡爾曼濾波的多目標跟蹤

3.1 艦載機目標位置預測

卡爾曼濾波預測艦載機目標位置可分為兩個階段:預測階段和更新階段。 預測階段主要根據前一幀圖像跟蹤目標的位置來預測當前幀目標的位置; 更新階段主要根據當前幀檢測到的艦載機目標位置來更新預測階段的艦載機目標位置[11-14]。

假設X(k|k)為第k幀圖像艦載機目標的位置, F為狀態轉移矩陣, P(k|k)為第k幀圖像艦載機目標位置的誤差協方差矩陣, Q為過程噪聲。 則預測階段方程為

X(k+1|k)=FX(k|k)(5)

P(k+1|k)=FP(k|k)FT+Q(6)

式中: X(k+1|k)為預測的第k+1幀的艦載機目標的位置;? P(k+1|k)為預測的第k+1幀的誤差協方差矩陣。

假設H為觀測矩陣, Y(k+1)為第k+1幀檢測的艦載機目標位置, R為觀測噪聲, ε(k+1)為第k+1幀艦載機目標檢測位置與預測位置之間的殘差, K(k+1)為第k+1幀的卡爾曼增益, X(k+1|k+1)為第k+1幀艦載機目標位置的更新值, P(k+1|k+1)為第k+1幀艦載機目標位置誤差協方差矩陣的更新值。 則更新階段方程為

K(k+1)=P(k+1|k)HT(HP(k+1|k)HT+R)-1(7)

ε(k+1)=Y(k+1)-HX(k+1|k)(8)

X(k+1|k+1)=X(k+1|k)+K(k+1)ε(k+1)(9)

P(k+1|k+1)=(I-K(k+1)H)P(k+1|k)(10)

Q和R為不相關的服從高斯分布的白噪聲, 將第一幀視頻檢測的艦載機目標位置X(0)=x1, x·1, y1, y·1, x2, x·2, y2,? y·2T作為初始狀態, (x1,? y1)和(x2,? y2)分別為目標框左上角、 右下角的坐標, x·1,? y·1和x·2,? y·2分別為其導數。 由于艦載機在航空母艦上調運時速度較慢, 可以看成為恒定速度, 沒有加速度, 因此定義狀態轉移矩陣F=110111018×8, 觀測器只輸出目標框的坐標, 定義觀測矩陣H=10000000001000000000100000000010, 初始化協方差矩陣定義為P(0)=10.010.08×8, 初始化觀測噪聲矩陣定義為R(0)=10.010.04×4, 初始化過程噪聲矩陣定義為Q(0)=0.250.50.510.250.50.518×8。

3.2 目標關聯與跟蹤管理

匈牙利算法主要用于解決二分圖的指派問題, 與最近鄰域算法、 概率數據關聯算法(PDA)、 聯合概率數據關聯算法(JPDA)等相比, 時間、 空間復雜度較低, 因此將其作為檢測目標和跟蹤目標的關聯算法。 假設在第k幀視頻中已經跟蹤到的艦載機目標數目為N, 將其記為T={t1,? t2,? …,? tn}, 在k+1幀視頻中檢測出的艦載機數目為M, 將其記為D={d1,? d2,? …,? dm}。 將跟蹤集T和檢測集D進行匹配, 使幀與幀間保持關聯, 繼承目標的ID。 以跟蹤目標框和檢測目標框面積的IOU為關聯依據, 得到匹配關聯矩陣C。 目標關聯示意圖如圖3所示。

從而可得

ci,? j=IOU(ti,? dj)(11)

矩陣R表示跟蹤目標與檢測目標之間的關聯關系, 當ri,? j為1時, 表示第i個跟蹤目標和第j個檢測目標相匹配, 同時在關聯過程中, 必須滿足一個跟蹤目標只能匹配一個檢測目標, 即滿足

max∑Ni=1∑Mj=1ci,? jri,? j?? s.t.∑Ni=1ri,? j=1∑Mj=1ri,? j=1ri,? j=0,? 1 (12)

艦載機多目標實時跟蹤還需考慮跟蹤列表的更新, 即跟蹤目標的創建和刪除。 考慮到檢測算法可能出現的誤檢情況, 如果出現了連續3幀某個檢測目標沒有與現有的跟蹤軌跡相關聯, 此時認為出現了新的目標, 即將這個目標添加至跟蹤列表, 并分配相應的ID。 艦載機在艦面運動速度約為1 m/s, 相機拍攝視頻的幀率可達25幀, 誤差最大可接受為0.2 m, 因此, 若某個跟蹤目標連續5幀沒有相應的檢測目標相匹配, 則認為此跟蹤目標消失, 可從跟蹤列表中刪除此跟蹤目標。

4 實驗結果及分析

4.1 anchor聚類分析

由于參與訓練的1 500多張圖片數據尺寸不盡相同, 因此在聚類之前先對各個數據集進行歸一化。 結果如圖4所示。 之后分別將聚類中心設置為5~9, 得到數據集中所有聚類集合的平均IOU值變化曲線如圖5所示。

由圖5可知, 聚類中心越多時, 平均IOU值越大, 說明此時數據聚類分布越能體現真實的艦載機目標框尺寸分布。 但是由于聚類越多, 候選框的數量就越多, 計算量也隨之增大, 因此選擇與原YOLO算法相同的9個聚類, 最終的聚類分布如圖6所示。

將各聚類中心乘以網絡輸入尺寸大小416, 得到最終的9對anchor的尺寸分別為[136,? 91]、 [176,? 94]、 [141,? 138]、 [211,? 156]、 [190,? 120]、 [174,? 190]、 [251,? 132]、 [280,? 185]、 [208,? 245], 將以上anchor作為預先anchor進行網絡模型訓練。

4.2 網絡訓練及測試

實驗的硬件環境為Inter Xeon@ Silver 4110, GPU為NVIDIA RTX 2080Ti, 8GB顯存。 實驗在Ubuntu16.04系統上進行, 深度學習框架選用tensorflow。

訓練時, 學習率設置從0.000 1到0.000 001遞減, 衰減系數為0.999 5, 訓練迭代次數為45 000次, 訓練批量數據大小設置為8, 并且對原數據進行數據增強, 以提高模型的泛化性能。

采用不同的anchor生成方案進行訓練, 得到總損失函數收斂圖如圖7所示。

選取平均精度(Average Precision, AP)作為衡量模型的指標, 其計算公式為

AP=∫01P(R)dR(13)

式中: P為準確率; R為召回率。

不同檢測算法對比如表1所示。 圖7和表1結果說明, 經過K-means聚類后, 模型更容易趨于收斂, 訓練時間縮短了0.4 h, 提高了訓練效

率。 在100張圖片上進行模型測試, 結果表明, 使用K-means對本文數據集聚類之后, 算法準確性提高了約2%。 同時, 與Faster R-CNN相比, 本文算法雖然準確率相差約4%, 但算法的實時性高出1倍左右, 在檢測精度滿足要求的前提下, 本文算法實時性更高。 艦載機目標檢測效果圖如圖8所示。

4.3 目標跟蹤實驗

采用多目標跟蹤準確度(Multi-Object Tracking Accuracy, MOTA)和多目標跟蹤精確度(Multi-Object Tracking Precision, MOTP)衡量算法的性能, 定義如下:

MOTA=1-∑t(mt+fpt+mmet)∑tgt(14)

式中: mt, fpt, mmet分別為視頻序列第t幀漏檢、 誤檢和錯誤關聯匹配的數量; gt為第t幀真實標注的目標個數。

MOTP=∑i,? tdit∑tct(15)

式中: dit為第i個目標匹配成功時的檢測目標框與跟蹤目標框之間面積的IOU值; ct為第t幀成功匹配的目標數量。

良好的檢測是跟蹤的基礎, 檢測算法的性能直接影響跟蹤的效果, 將本文提出的跟蹤算法與文獻[2]中的基于光流法和卡爾曼濾波的跟蹤算法、 SORT多目標跟蹤算法目標實驗對比, 以驗證本文提出算法的魯棒性、 準確性。

(1) 本文算法與文獻[2]算法對比

在本文的艦載機目標跟蹤數據集上實驗, 對比文獻[2]算法與本文跟蹤算法的性能, 實驗結果見表2。

由表2結果可知, 相比于文獻[2]中的跟蹤算法, 本文提出的跟蹤算法誤檢數、 漏檢數、 ID跳變數均得到了大幅改善, 跟蹤準確度提高了約10%, 跟蹤精確度提高了約12%, 原因在于基于深度卷積神經網絡的目標檢測算法提高了檢測的準確性、 魯棒性, 并結合卡爾曼濾波跟蹤, 實現了對航空母艦艦面艦載機的準確穩定跟蹤。 艦載機目標跟蹤測試結果如圖9所示。

(2) 本文算法與SORT算法對比

多目標跟蹤SORT算法[15]選用X=[u,? v,? s,? r,? u·,? v·,?? s·]T作為狀態量, 其中u,? v,? s,? r分別表示目標框的中心坐標、 面積和寬高比。 SORT算法認為寬高比是常數, 這就造成在目標框的寬高比發生變化時不能準確地進行跟蹤[16]。 以檢測到的目標框為實際位置, 分別將本文算法和SORT算法預測出的目標框參數轉換成(cx,? cy,? w,? h)與其進行實驗比較, cx, cy為目標框的中心坐標, w和h分別為目標框的寬度和高度。

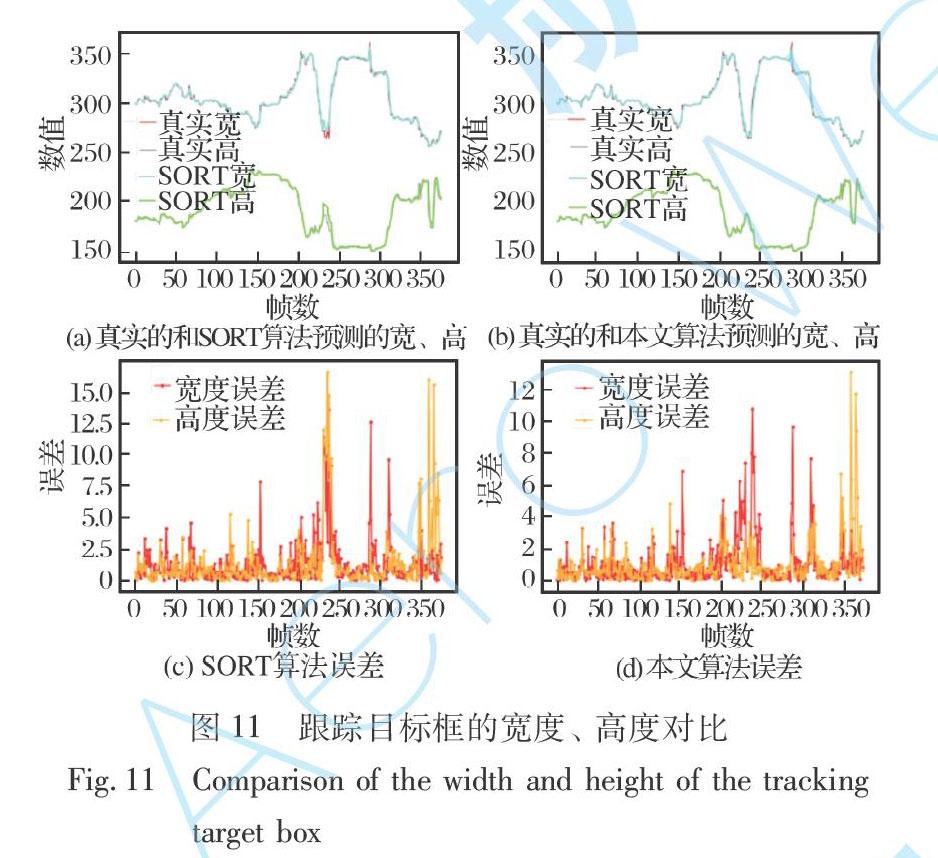

圖10為SORT算法和本文算法所跟蹤的目標框與實際檢測目標框的中心坐標誤差對比, 圖11為跟蹤目標框的寬度、 高度誤差對比。 在攝像機視野范圍內, 艦載機在1~220幀之間由遠到近運動, 230~250幀之間做轉向運動, 350幀之后艦載機離開視野。

由圖10~11和表3可知, 當艦載機在圖像視野范圍內由遠到近運動時, SORT算法和本文算法都能對目標實現較好的跟蹤, 誤差值對于艦載機目標框大小可忽略不計。 但相比于SORT算法, 本文算法誤差相對較小。

艦載機做轉向運動時, SORT算法的誤差明顯高本文算法,? 誤差值約為本文算法的2倍。? 原因是當艦載

機做轉向運動時, 其跟蹤框的寬度、 高度發生突變, 而SORT算法是將跟蹤框的寬高比看做常數, 因此, 其在面對寬度、 高度發生突變時的適應性不強, 誤差較大, 本文算法雖然有一定誤差, 但可以適應這種突變。

當艦載機離開視野時, 由于目標實際可見區域變小導致檢測不準確, 因此, SORT跟蹤算法與本文跟蹤算法寬度、 高度誤差都相對較大。

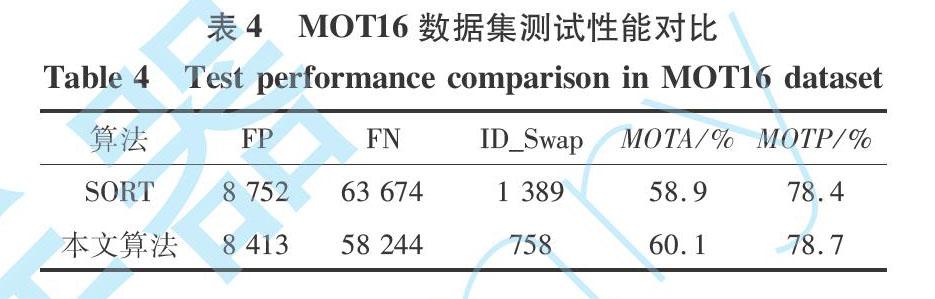

在MOT16多目標跟蹤數據集上實驗, 對比本文跟蹤算法和SORT多目標跟蹤算法的性能。 測試結果如表4所示。

表4結果表明, 本文提出的多目標跟蹤算法誤檢數、 漏檢數、 ID跳變次數相比于SORT算法均有所降低, MOTA提升了約1.2%, 表明本文算法更加穩定可靠, MOTP相比于SORT算法提升了約0.3%, 表明在跟蹤精確度方面也有所改善, 總而言之, 相比于SORT算法, 本文算法穩定性、 準確性更高。

5 結? 論

本文針對傳統基于檢測的目標跟蹤算法對環境干擾適應能力差, 且跟蹤準確率不高的問題, 提出了基于深度卷積神經網絡的YOLO v3目標檢測算法和卡爾曼濾波相結合的多目標跟蹤方法, 使用K-means聚類算法對原YOLO v3算法的錨點框進行優化, 提高了訓練效率和檢測的準確率, 并結合卡爾曼濾波器對航空母艦艦面多艦載機目標實現了有效的跟蹤。 與基于光流法的目標跟蹤算法、 SORT多目標跟蹤算法進行實驗對比, 結果表明本文算法具有更高的準確性和魯棒性。 下一步將致力于增強艦面其他目標對艦載機干擾下的算法跟蹤能力。

參考文獻:

[1] 婁康,? 朱志宇,? 葛慧林. 基于目標運動特征的紅外目標檢測與跟蹤方法[J]. 南京理工大學學報,? 2019,? 43(4): 455-461.

Lou Kang,? Zhu Zhiyu,? Ge Huilin. Infrared Target Detection and Tracking Method Based on Target Motion Feature[J]. Journal of Nanjing University of Science and Technology,? 2019,? 43(4): 455-461.(in Chinese)

[2] 石龍偉,? 鄧欣,? 王進,? 等. 基于光流法和卡爾曼濾波的多目標跟蹤[J]. 計算機應用,? 2017,? 37(S1): 131-136.

Shi Longwei,? Deng Xin,? Wang Jin,? et al. Multiple Object Tracking Based on Optical Flow and Kalman Filtering[J]. Journal of Computer Applications,? 2017,? 37(S1): 131-136.(in Chinese)

[3] 薛俊韜, 馬若寒, 胡超芳. 基于MobileNet的多目標跟蹤深度學習算法[J/OL]. 控制與決策, 2020. DOI: 10.13195/j.kzyjc.2019.1424.

Xue Juntao,? Ma Ruohan,? Hu Chaofang. Deep Learning Algorithm Based on MobileNet for Multi-Target Tracking[J/OL].Control and Decision,? 2020. DOI: 10.13195/j.kzyjc.2019.1424. (in Chinese)

[4] 王全東,? 常天慶,? 張雷,? 等. 基于深度學習算法的坦克裝甲目標自動檢測與跟蹤系統[J]. 系統工程與電子技術,? 2018,? 40(9): 2143-2156.

Wang Quandong,? Chang Tianqing,? Zhang Lei,? et al. Automatic Detection and Tracking System of Tank Armored Targets Based on Deep Learning Algorithm[J]. Systems Engineering and Electronics,? 2018,? 40(9): 2143-2156. (in Chinese)

[5] Redmon J,? Divvala S,? Girshick R,? et al. You only Look Once: Unified,? Real-Time Object Detection[EB/OL].

(2016-09-23)[2020-07-22]. https:∥arxiv.org/ abs/1506.02640.

[6] Redmon J,? Farhadi A. YOLO9000: Better,? Faster,? Stronger[C]∥ Proceedings of Conference on Computer Vision and Pattern Recognition,? 2017: 6517-6525.

[7] Redmon J,? Farhadi A. YOLO v3: An Incremental Improvement [EB/OL]. (2018-04-08)[2020-07-22]. https:∥ arxiv .org /abs /1804.02767.

[8] 陳詠秋,? 孫凌卿,? 張永澤,? 等. 基于YOLO v3的輸電線路鳥類檢測技術研究[J]. 計算機工程,? 2020,? 46(4): 294-300.

Chen Yongqiu,? Sun Lingqing,? Zhang Yongze,? et al. Research on Bird Detection Technology for Electric Transmission Line Based on YOLO v3[J]. Computer Engineering,? 2020,? 46(4): 294-300.(in Chinese)

[9] 張迪, 樊紹勝.基于YOLO v3的輸電線路故障檢測方法[J]. 自動化技術與應用, 2019,? 38(7): 125-129.

Zhang Di,? Fan Shaosheng. Fault Detection of Transmission Line Based on YOLO v3[J]. Techniques of Automation and Applications,? 2019,? 38(7): 125-129. (in Chinese)

[10] 胡超超,? 劉軍,? 張凱,? 等. 基于深度學習的行人和騎行者目標檢測及跟蹤算法研究[J]. 汽車技術,? 2019(7): 19-23.

Hu Chaochao,? Liu Jun,? Zhang Kai,? et al. Research on Target Detection and Tracking of Pedestrian and Cyclist Based on Deep Learning[J]. Automobile Technology,? 2019(7): 19-23. (in Chinese)

[11] 楊磊. 智能視頻監控系統中的目標檢測和多目標跟蹤技術研究[D]. 南京: 南京航空航天大學,? 2019.

Yang Lei. Research on Object Detection and Multi-Object Tracking Technology in Intelligent Video Surveillance System[D]. Nanjing: Nanjing University of Aeronautics and Astronautics,? 2019.(in Chinese)

[12] 陳志鴻,? 黃立勤. 基于卡爾曼濾波和多種信息融合的在線多目標跟蹤算法[J]. 信息通信,? 2019,? 32(3): 35-38.

Chen Zhihong,? Huang Liqin. Online Multi-Target Tracking Algorithm Based on Kalman Filtering and Multiple Information Fusion[J]. Information & Communications,? 2019,? 32(3): 35-38.(in Chinese)

[13] 趙廣輝,? 卓松,? 徐曉龍. 基于卡爾曼濾波的多目標跟蹤方法[J]. 計算機科學,? 2018,? 45(8): 253-257.

Zhao Guanghui,? Zhuo Song,? Xu Xiaolong. Multi-Object Tracking Algorithm Based on Kalman Filter[J]. Computer Science,? 2018,? 45(8): 253-257. (in Chinese)

[14] 宋歡歡. 基于深度特征共享的行人檢測與跟蹤研究[D]. 哈爾濱: 哈爾濱工業大學,? 2018.

Song Huanhuan. Pedestrian Detection and Tracking Based on Depth Feature Sharing[D]. Harbin: Harbin Institute of Technology,? 2018. (in Chinese)

[15] Alex B,? GR Z,? Lionel O,? et al. Simple Online and Realtime Tracking[C]∥IEEE International Conference on Image Processing (ICIP),? 2017.

[16] 何丹妮. 基于深度學習的多車輛檢測及跟蹤算法研究[D]. 大連: 大連理工大學,? 2019.

He Danni. Research on Multi-Vehicle Detection and Tracking Algorithm Based on Deep Learning[D]. Dalian: Dalian University of Technology,? 2019. (in Chinese)

Research on Real-Time Tracking Algorithm for

Multi-Objects of Shipboard Aircraft Based on Detection

Tian Shaobing1*,? Zhu Xingdong2,? Fan Jiali1,? Wang Zheng1

(1.Department of Ship Surface Aviation Support and Station Management,? Naval Aviation

University (Qingdao Campus),? Qingdao 266041, China;

2. Coast Guard Academy,? Naval Aviation University,? Yantai 264001, China)

Abstract:? For safe guidance and real-time monitoring? of the shipboard aircraft during the operation, for traditional detection-based object tracking algorithms has poor tracking performance and susceptibility to interference, proposed the multi-object real-time tracking algorithm of shipboard aircraft that combined YOLO v3 object detection algorithm and Kalman filtering. The anchor size of the original YOLO v3 algorithm is optimized by the K-means clustering algorithm,? combined with the Kalman filter algorithm to achieve effective tracking of shipboard aircraft objects,? and compared with? object tracking algorithm based on optical flow and SORT multi-object tracking algorithm on self-built shipboard aircraft tracking dataset and MOT16 multi-object tracking dataset. The results show that the tracking algorithm proposed is more accurate,? robust and stable, and has strong adaptability when the object frame width and height change suddenly.

Key words:? object detection; Kalman filtering; Hungarian algorithm; object tracking; deep learning