基于LBP特征的多視點目標分辨技術研究

孫維亞,陳科仲,李忠新,吳志林

(1.南京理工大學 機械工程學院,江蘇 南京 210094;2.陸裝裝駐重慶地區軍事代表局,重慶 400060)

0 引 言

戰爭的走向是一種多源信息的融合[1-2],從戰場走向中能獲得更多作戰信息。在未來作戰中,多視點的應用將會使得作戰部隊獲得更多的態勢信息,而在多視點條件下,己方單兵在各自的視點看到了一個敵方人員,這就需要進行信息的交互來確定是否為同一個敵人。能夠分辨多視點中的目標是否為同一目標,作戰部隊就能清楚前方的目標個數,這對我方作戰方式的決策有著重要的意義。在戰爭場景、戰場環境下,單兵往往因一些戰術動作的需要或者由于戰場環境的限制,其姿態往往不能保持正常行人的姿態且部分戰術動作可能保持一致,所以通過行人姿態并按照身軀進行多尺度的行人重識別方法,往往不能滿足戰爭環境的需求。戰場中單兵所穿著的迷彩服,在形狀、顏色等方面也往往保持一致,很難通過顏色、形狀或大小等特征來進行一致性判斷,所以需要針對目標的有效信息進行判斷。和人形姿態、軍裝顏色等特征不同,人臉檢測技術通過提取目標的臉部特征信息進而實現目標人臉的檢測,該技術的算法很成熟,最常用的算法是基于Haar-like的人臉檢測,如賀瑜飛利用Haar特征并結合改進的adaboost算法進行人臉的檢測[3],倪朋朋等人利用Haar-like和adaboost算法進行車輛檢測算法研究[4]。在提取到目標有效的信息后,需要對提取的信息進行分析,而人臉的特征可以看作一種局部的紋理特征,每個人的面部特征都不同,所以可以利用人臉紋理進行目標的分辨,如張雪梅等人利用LBP和WLD算法識別人臉面部表情[5],王強等人利用LBP和GLCM算法識別煤巖圖像[6]。綜上所述,本試驗利用Haar-like人臉檢測算法和LBP紋理檢測算法進行不同視點的目標分辨試驗。

1 試驗算法原理

對于圖像特征的提取,通常是基于三種特征算法:Haar[7]、HOG[8]以及LBP[9-10]。基于Haar-like特征的目標識別算法由Paul Viola和Michael jones提出[11-12],該算法結合Adaboost[13]算法廣泛應用于人臉檢測領域。LBP特征描述的側重點則是對圖像在局部范圍內對應的紋理信息,因此LBP特征檢測廣泛應用于特定圖像的特征提取[14-15]等方面。

1.1 Haar-like算法原理

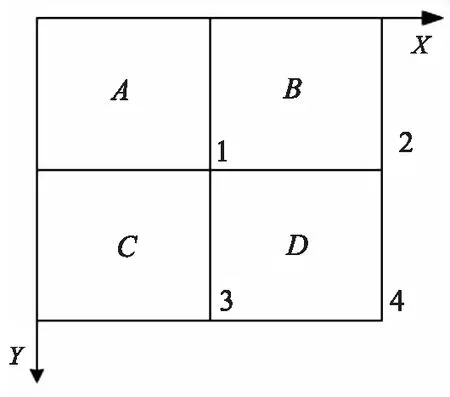

Haar-like目前常用的特征分為四類:邊緣特征、線型特征、中心特征、對角線特征。為了解決矩形特征計算量過大影響速度等問題,利用積分圖的方法獲取Haar-like特征,如圖1所示。ii(1)表示區域A的像素值,ii(2)表示區域A+B的像素值,ii(3)表示區域A+C的像素值,ii(4)表示區域A+B+C+D的像素值。D區域的像素值可用ii(1)+ii(2)+ii(3)+ii(4)。進行Haar-like特征計算時,利用積分圖原理,在對某一區域的像素和計算時,只需要對特定的點進行計算,所以在時間上會大大減少。

圖1 積分圖原理

在對圖像進行特征值的計算后,利用adaboost算法[16],實現對目標的檢測。首先定義弱分類器,弱分類器是由單個Haar特征值組成,adaboost算法對其進行訓練。弱分類器定義為:

式中,pj保證方向的不變,θj為閾值,fj(x)為提取的特征值。

強分類器由許多弱分類器組成,其訓練過程首先取樣本,將權值初始化,進行循環,對權重歸一化,訓練每一個特征值,并選取最低誤差的分類器,更新權重,達到循環次數后為最終的分類器。多個強分類器組成級聯分類器。本試驗利用Haar-like算法和adaboost算法實現對視點中目標的檢測。

1.2 LBP原理

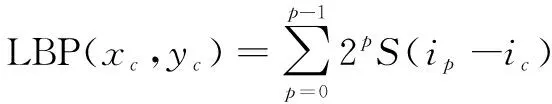

原始的LBP[17]算子定義像素在三階矩陣里,其原理為將圖像中心像素及其鄰域對應的像素進行比較,大于圖像的中心像素則記1,反之記0,從而得到二進制數字,計算公式如下:

式中,(xc,yc)為中心像素的坐標,p為鄰域的第p個像素,ip為鄰域像素的灰度值,ic為中心像素的灰度值,S(x)為符號函數。

由于原始的LBP特征在特定的區域內,不能很好地滿足使用要求,且圖像存在旋轉,所以采用圓形LBP特征代替正方形鄰域,并不斷旋轉圓形LBP特征,每旋轉一次會獲得一個新的LBP算子,從這些特征算子中選取最小的作為中心像素的LBP特征算子。本試驗利用LBP算法對視點中的目標進行紋理計算。

2 試驗流程

本試驗主要包括三個部分:目標采集系統、測試程序和人臉數據集。利用光電感知系統采集視點中出現的目標,經過測試程序檢測計算,與人臉數據集進行一致性判斷,實現對視點中目標的分辨。

圖2 試驗流程

2.1 目標采集系統

本試驗利用光電感知系統對視場中的目標進行采集。其主控開發板為stm32H743系列,是一個工作頻率可高達480 MHz的ARM Cortex M7控制器,并嵌入感光元件模組,即攝像系統,視場大小可達到640×480。將此模塊與計算機進行交互,能夠實時顯示視點前方的視場。

2.2 測試程序邏輯

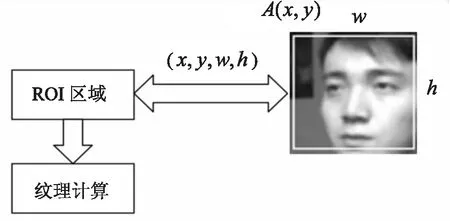

本試驗測試程序采用python語言編寫,當光電感知模塊與計算機交互并顯示采集的視場圖像后,初始化該系統的攝像模塊并進行灰度處理,當目標出現在視場當中,調用人臉檢測模塊,即利用Haar-like算法進行檢測并標記目標的ROI區域,計算其區域坐標,再調用紋理檢測模塊,即利用LBP算法計算該目標的ROI區域坐標范圍內的紋理特征。視場中目標檢測的ROI區域如圖3所示,該區域頂點坐標為A(x,y),長和寬分別為w和h,所以ROI區域范圍為(x,y,w,h),完成該區域范圍的計算后進行紋理計算。

圖3 ROI區域示意圖

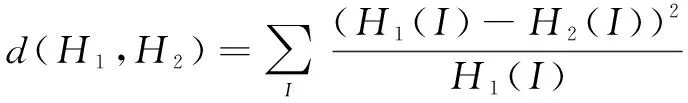

完成上述的計算后,將計算結果與人臉數據集進行目標一致性判斷。本試驗目標一致性判斷依據為:在完成對視場中目標檢測圖像的LBP特征計算后,對其LBP特征圖像進行分塊,將每個塊區域的特征圖像進行直方圖計算,按照一定的順序形成LBP特征的統計直方圖,并與數據集中每組圖像的每張圖像的LBP特征的統計直方圖進行卡方計算,計算結果越小,一致性程度越高。在不同視點的檢測下,輸出的最低特征差異度值所對應的數據集編號若一致,則判定為同一目標。其卡方計算公式如下:

式中,H1,H2分別表示圖像的直方圖數據。

利用一致性判斷函數進行計算,輸出視點中目標與每組數據集的每張圖像誤差累積和,根據目標一致性判斷依據,輸出測試結果。

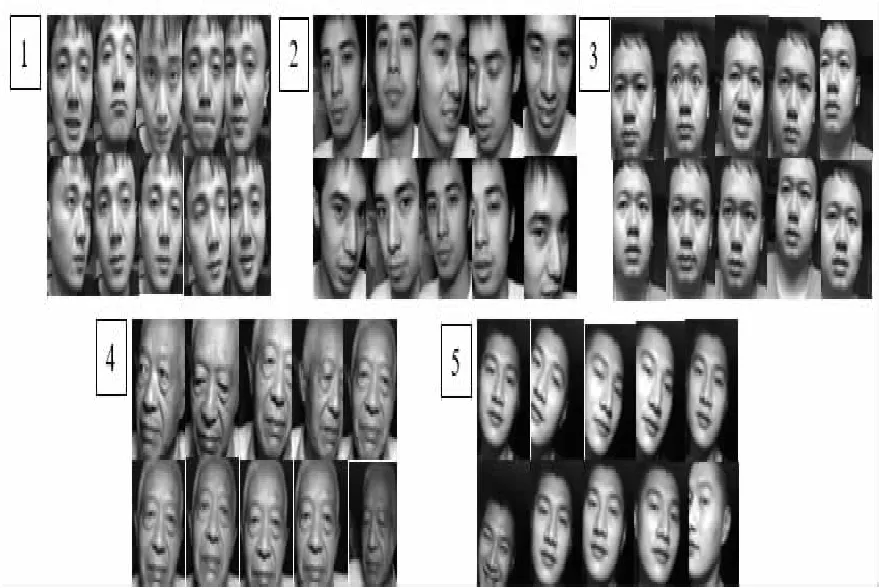

2.3 建立人臉數據集

本試驗制作人臉數據集,用于和視場中檢測到的目標進行一致性判斷。不同的人臉狀態均可作為一個數據,例如笑臉哭臉,戴眼鏡或不戴眼鏡等狀態,每組數據采集20張圖像,圖像大小保存為110×94。部分人臉數據集圖像如圖4所示,對應每組數據編號為1到5。

圖4 部分人臉數據集圖像

3 算法試驗結果與分析

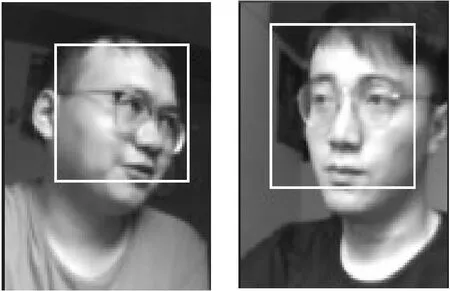

本試驗設定兩個不同方位視點的目標檢測裝置,當目標出現在視場范圍內,不同視點進行目標圖像的采集。首先利用Haar-like算法進行檢測并標記目標的ROI區域,計算標記的ROI區域坐標。將此區域坐標作為LBP特征檢測的計算范圍。每個視點檢測的結果與人臉數據集進行一致性計算,最終輸出與視場中目標特征最匹配的編號。下面是兩組試驗數據,兩組試驗不同視點采集的目標圖像如圖5~圖7所示,ROI區域范圍見表1、3、5,一致性計算結果見表2、4、6。

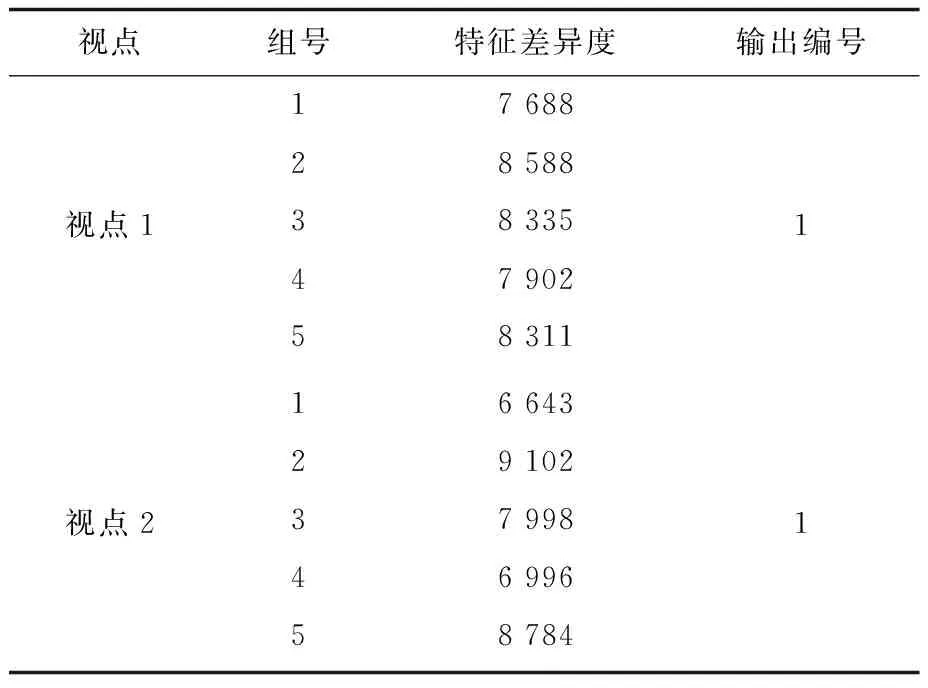

圖7 試驗二不同視點采集目標圖像

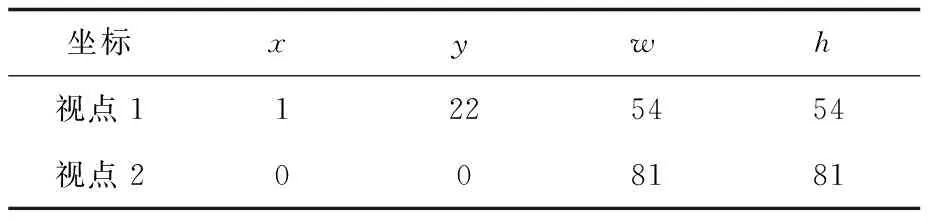

表1 組1檢測ROI區域坐標

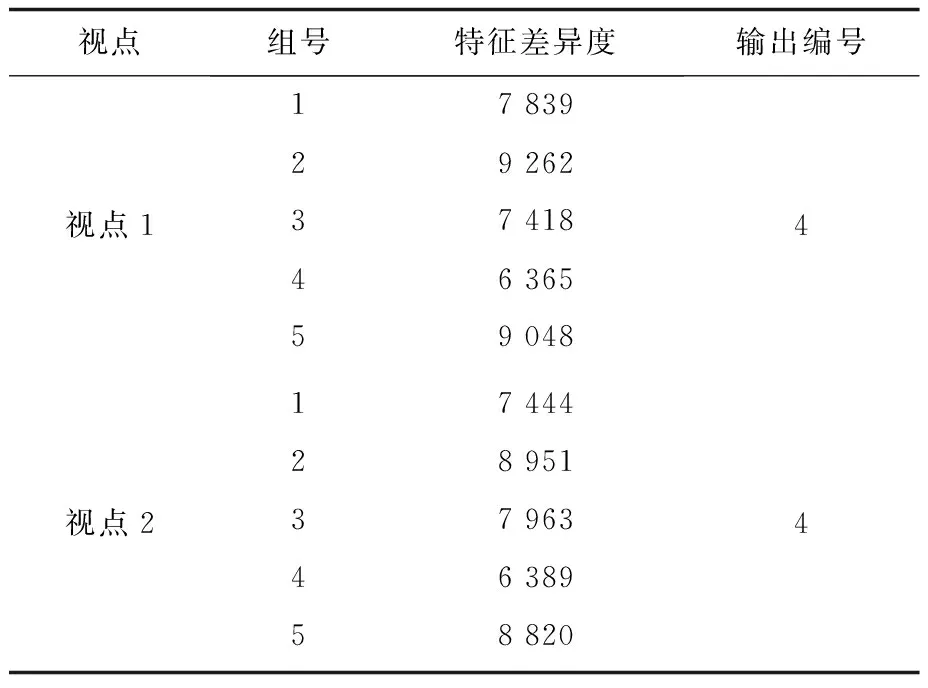

表2 組1目標一致性計算結果

圖5 試驗一不同視點采集目標圖像組1

(一)試驗一:不同視點對同一目標進行檢測識別。

表中:x,y為ROI區域左上方頂點橫縱坐標,w,h分別為ROI區域的寬和高。

圖6 試驗一不同視點采集目標圖像組2

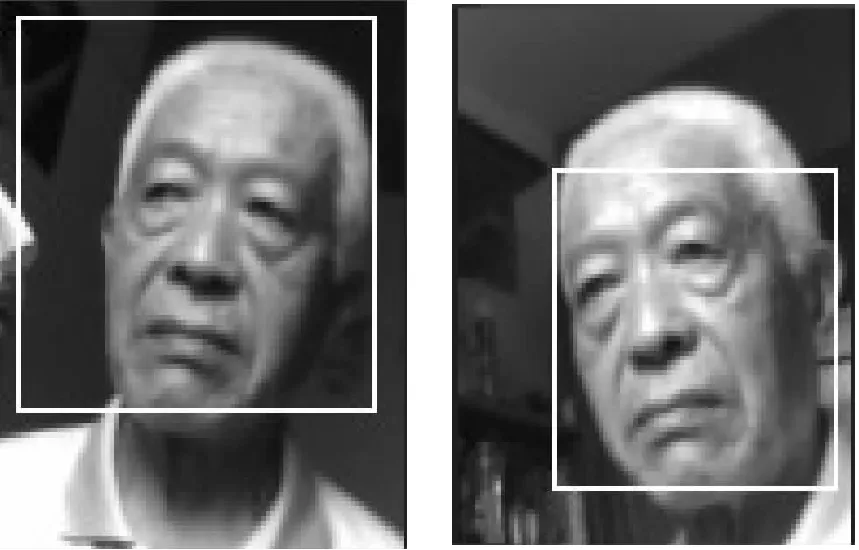

表3 組2檢測ROI區域坐標

表4 組1目標一致性計算結果

(二)試驗二:不同視點對不同目標檢測識別。

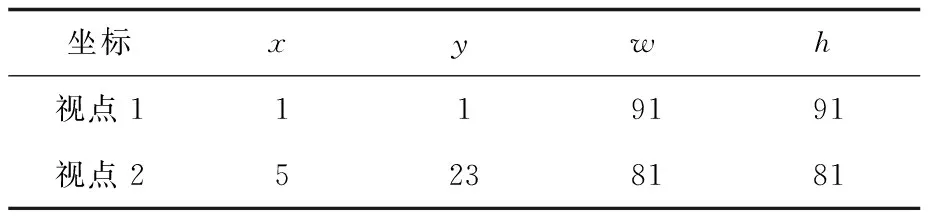

表5 試驗二不同視點ROI區域坐標

由表1、3、5可知,試驗一不同視點輸出檢測的ROI區域坐標分別為(1,22,54,54)和(0,0,81,81),(1,1,91,91)和(5,23,81,81);試驗二不同視點輸出檢測的ROI坐標區域為(20,16,54,54)和(12,7,67,67)。試驗結果表明,視場中出現的目標能夠實現檢測并能準確計算出視場中目標的ROI區域坐標。

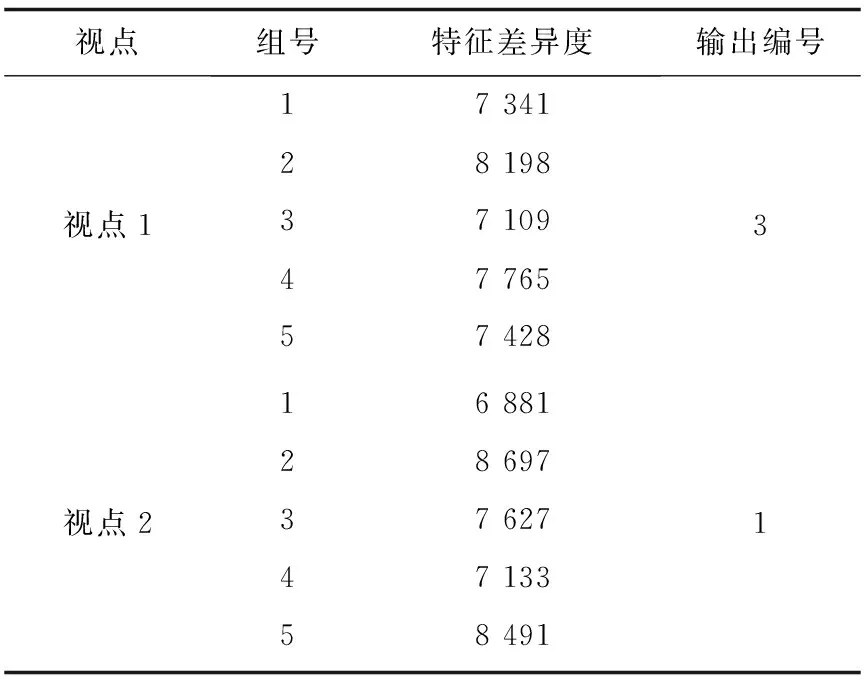

表6 試驗二目標一致性計算結果

兩組試驗中,不同視點檢測的數據與人臉數據集進行一致性計算結果如表2、4、6所示,可以看出試驗一中,組1、組2一致性計算結果的最小值分別為7 688和6 643,6 365和6 389,對應輸出的人臉數據編號分別為1和4,根據目標分辨的判斷依據,不同視點檢測到的目標為同一目標;試驗二中,一致性計算結果的最小值分別為7 109和6 881,對應輸出的人臉數據編號分別為3和1,根據目標分辨的判斷依據,不同視點檢測到的目標為不同目標。

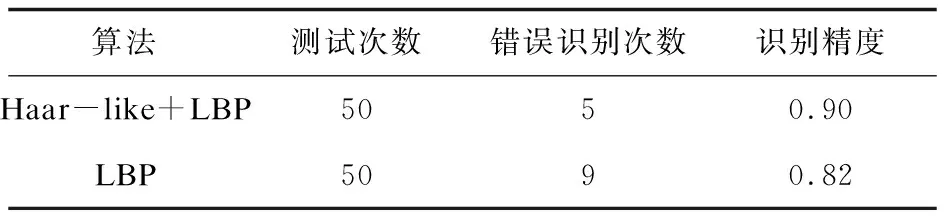

本試驗將Haar-like人臉檢測算法和LBP紋理檢測算法結合,進行不同視點的目標分辨,單一的LBP檢測方法會考慮視場中出現的整體目標進行檢測,并且包含一些背景信息,而本試驗方法首先提取目標的有效信息,以有效的信息區域為基礎再進行紋理檢測,排除了一些背景信息的干擾。針對Haar-like算法和LBP算法組合檢測的識別精度,將該方法與單一的LBP檢測方法進行對比。分別利用Haar-like+LBP和LBP算法對視點中出現的目標進行識別測試,測試實驗對五組數據集的每組目標進行十次測試,共五十次測試,測試結果如表7所示。結果表明,本試驗設計的試驗方法有效地提高了對視點中目標的識別精度。

表7 兩組方法識別結果

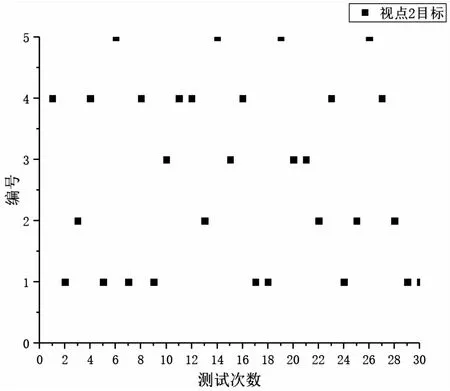

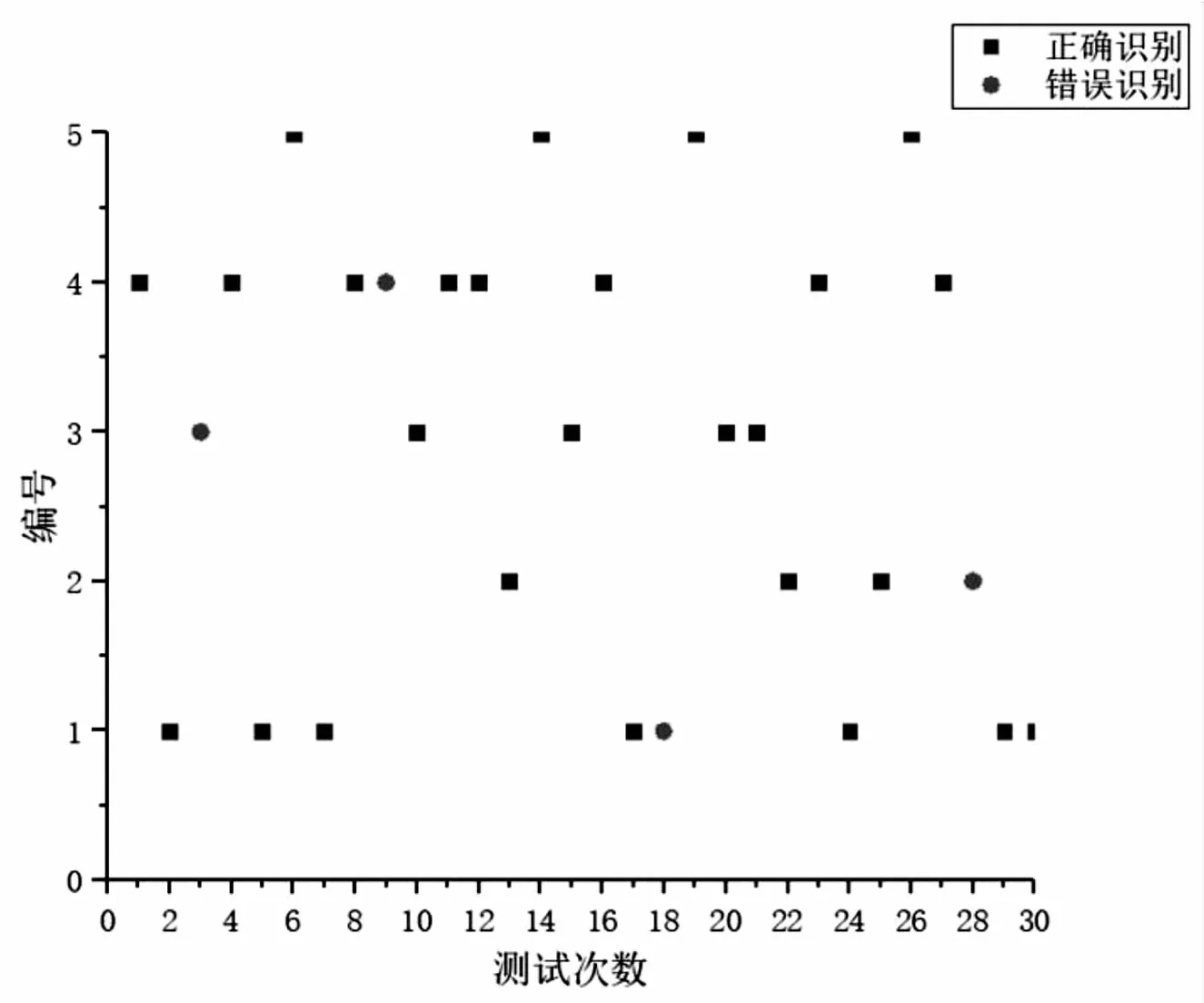

針對不同視點能否判斷該目標為同一目標,本試驗基于Haar-like和LBP算法進行測試。為了驗證該方法的有效性,進行30次一致性判斷測試。如圖8和9所示,橫坐標為測試次數,縱坐標為每次測試所對應的目標編號,兩組圖分別為視點1,視點2實際檢測的目標。測試結果如圖10所示,方框點為正確識別,圓點為錯誤識別,30組測試試驗中,有四組未能正確判斷不同視點目標是否一致,正確判斷率達到86.7%。

圖9 視點2實際測試目標類別

圖10 一致性判斷測試識別結果

4 結束語

針對未來作戰戰場,設計了在不同視點下對檢測到的目標進行分辨的試驗方法,即利用光電感知系統采集視場中出現的目標,利用Haar-like算法檢測并標記視場中目標的ROI區域,計算其區域的坐標,再利用LBP特征算法對此區域進行特征提取,將提取結果與數據集進行計算,根據一致性判斷依據進行目標的分辨。試驗結果表明,該方法對視場中出現的目標有較好的檢測效果且能輸出目標的ROI區域坐標;通過兩組試驗、精度對比試驗和一致性判斷測試可知,該方法能夠分辨出不同視點的目標,并具有較高的目標分辨率。不同視點的目標分辨技術研究,為我軍在未來作戰戰場獲取戰場信息提供了方法,同時對作戰過程中信息的融合有重要的意義。