無人機航測視頻交通流量提取

安哲 劉鴻潮

摘要 為高效獲取城市道路交叉口交通流量、優化檢測魯棒性、提升統計精度。使用航測法發揮無人機對地信息采集優勢,使用深層網絡模型YOLOv3訓練面向空中視覺角度的車輛識別模型,使用貝葉斯濾波與非極大值抑制算法對不同時間序列車輛對象做同一化匹配。實驗中車輛檢測平均損失2.79%,各流向車輛平均統計準確率97.88%,檢測器在停止線及直行待行區均能完成車輛目標的連續匹配與交通流量的實時統計。

關鍵詞 智能交通系統;檢測與監測技術;城市道路交叉口;YOLOv3

中圖分類號 U491.112 文獻標識碼 A 文章編號 2096-8949(2022)02-0015-03

0 引言

交通量調查是交通量特征解析的重要依據,同時也是交通流量建模、交通信號控制策略制定的重要參考數據[1]。由于航測法具有觀察角度優勢,可同時觀察到所有進口道車流情況,利用航測數據對交通管理關切的交通特征要素進行解析意義深遠[2],既有研究中,針對無人機視角下多車道流量實時統計方法研究較少。文章使用深度學習網絡模型訓練用以檢測航測視頻中車輛對象,針對道路交叉口航測視頻車輛對象多、車輛目標動向復雜、車輛目標小、車輛特征同質化嚴重的問題[3],對車輛對象匹配模型[4]及車流量統計精度優化方法展開研究。

1 車流量提取與算法實現

1.1 車輛目標識別

2016年前后由于圖形處理器算力的提升使得基于深度學習理論的目標識別方法飛速發展。比較具有代表性的方法有使用單階段的SSD(Single Shot MultiBox Detector)、YOLO[5](You Only Look Once),該類算法檢測速度較快檢測精度稍低[6];基于前啟發后回歸兩階段的R-CNN(Region-Convolutional Neural Networks),此類算法檢測精度較高但檢測度較慢。具體到交通影像數據特征提取任務,往往需要將實時性即檢測速度作為優先考慮的條件,YOLOv3是Joseph Redmon對YOLO算法的第三次改進[7],YOLOv3算法在保證較高的檢測速度的同時,達到更高的檢測精度。

1.2 車輛目標跟蹤

利用貝葉斯估計,迭代對車輛對象歷史位置給出先驗,定義同一對象判定規則。

約定當前時刻為t,建立預測模型如下:

(1)

式中:為依據t-1時刻目標最優估計及目標控制期望值作出的t時刻對象先驗坐標估計。是對t-1時刻目標坐標的估計,其中表示t-1時刻目標識別模型(YOLOv3)識別結果。表示對控制信息的估計。

(2)

車輛預測任務中控制信息的物理意義為t-1時刻對象車輛的運動速度期望值。是一個有大小有方向的矢量,控制信息的估計由滿足高斯分布的A、B卷積推導,x為坐標期望,為坐標的方差,易知控制信息同樣滿足高斯分布。

? (3)

? (4)

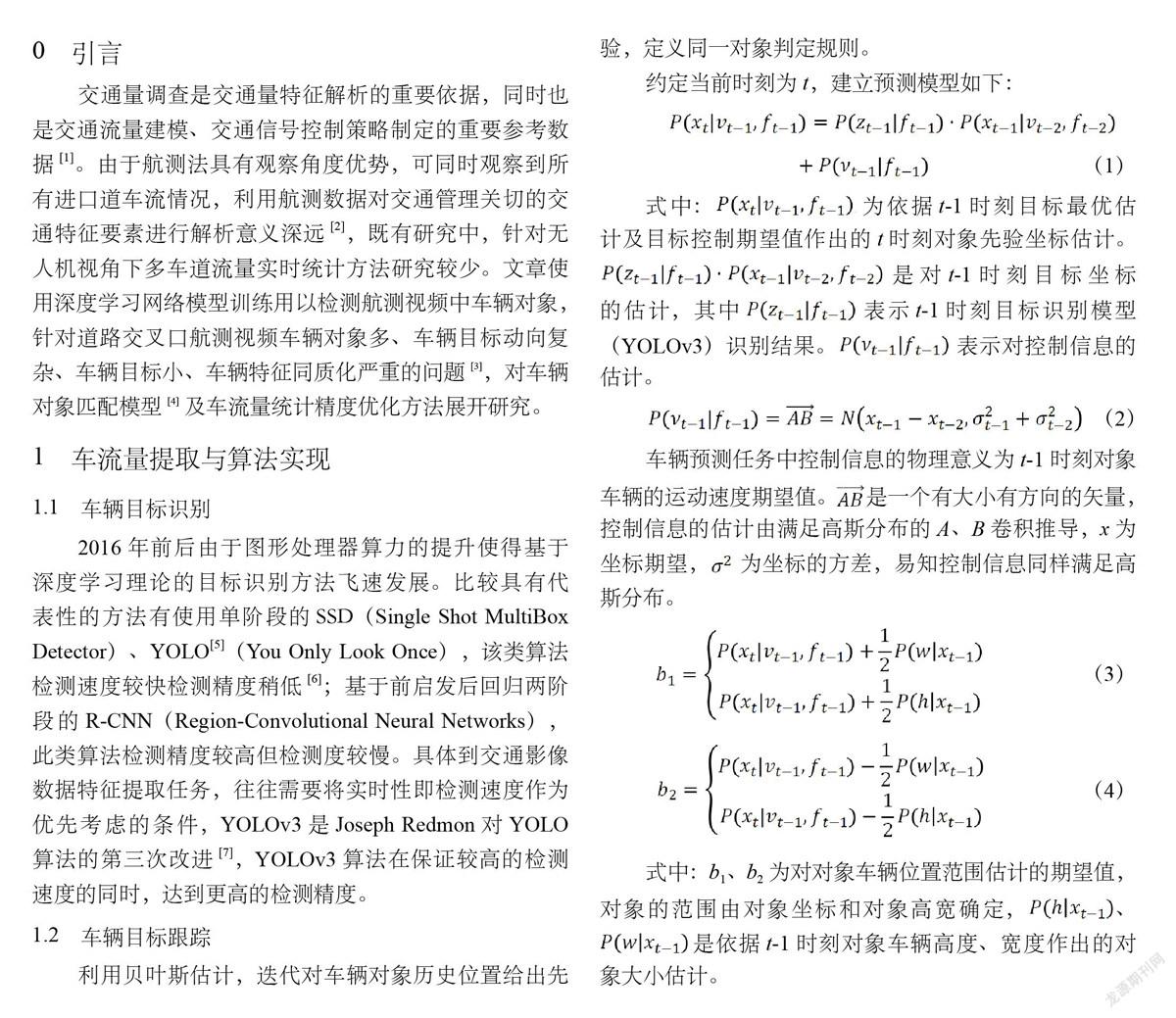

式中:b1、b2為對對象車輛位置范圍估計的期望值,對象的范圍由對象坐標和對象高寬確定,、是依據t-1時刻對象車輛高度、寬度作出的對象大小估計。

利用歷史檢測信息對當前時刻車輛的先驗位置作出估計,定義對象同一化判定規則,實現先驗位置同目標檢測結果的同一化匹配。

圖1中展示第821幀車輛檢測結果,和對象車在t時刻即第821幀的最優預測值,Bbox1為對象車輛在t時刻的檢測值,Bbox2為同一時刻由西向東直行的另一車輛對象,同一化匹配模型主要完成同一車輛對象預測值和檢測值的同一化匹配,對t時刻檢測結果中的車輛目標:Bbox1、Bbox2與t-1時刻(第820幀)為同一對象給出判斷。

2 實驗結果與討論

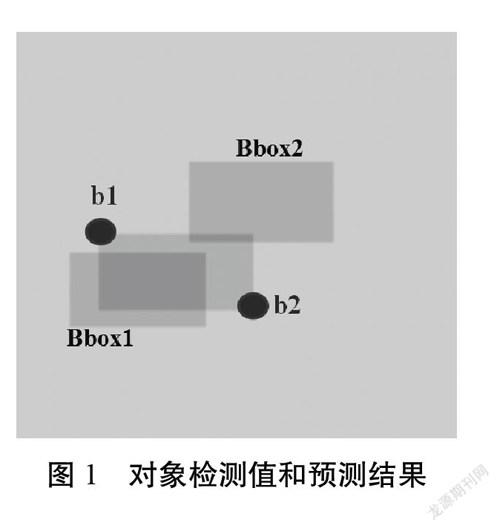

選取友誼路與新華道交叉口早高峰時段航測視頻進行實驗,模型訓練環境為Ubuntu 19.10.1,GCC 9.2.1, NVIDIA 440.100,CUDA V10.2.89,cuDNN 7.6.5,OpenCV 3.2.0,硬件環境NVIDIA GTX980M,顯存8 Gb兩張。設定訓練樣本/批次為16,再分率為4,最大批次設定為50 020。學習率選0.001,訓練步數小于30 000次使用初始學習率,小于40 000次時使用60%初始學習率,小于45 000次時使用6%初始學習率,大于45 000到訓練結束使用0.6%初始學習率。訓練過程中損失曲線如圖2所示。

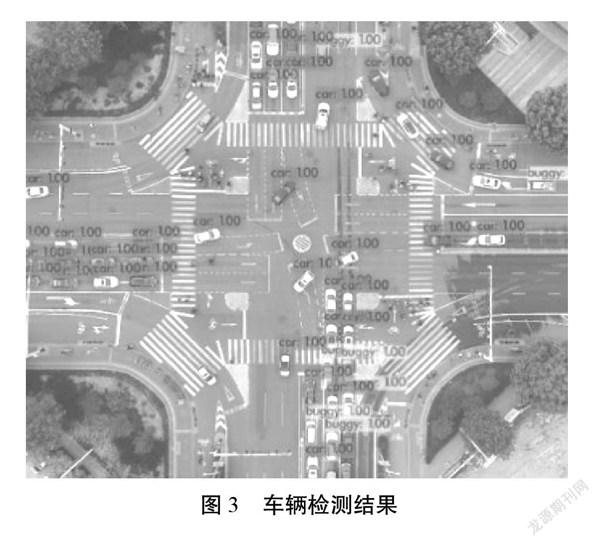

損失函數在震蕩多次后收斂于0.045 6,第47 000批時平均損失為0.027 907,損失最少,遂選取模型訓練到第47 000次時保存權重進行車輛識別。識別結果見圖3,車輛被準確識別,對背景變化有良好的魯棒性。

車輛對象匹配模型主要存在兩類問題:

(1)ID變換(ID switch,IDs)。

(2)ID誤匹配(Error Match,EM)。

為檢測對象匹配模型效能定義下述評價指標:

不良匹配(Bad Match,BM):IDs+EM,不論是IDs還是EM都會導致最終交通量統計錯誤,BM用于衡量跟蹤模型整體可靠度;

ID變換率(IDs-rate):IDs/BM,用于反應IDs在不良匹配中的占比;

誤匹配率(EM-rate):EM/BM,用于反應EM在不良匹配中的占比。

對ID凍結閾值分別取1、3、5、7、9時各評價指標表現如表1。

ID凍結閾值取1時容錯范圍為0,第一列為沒有容錯機制下的模型表現,作為對照樣本分析。觀察發現在3~9范圍內不論ID凍結閾值取多大,模型表現均好于直接匹配(對照組)。綜合各評價指標表現該實驗中選定ID凍結閾值為5,進行后序實驗。

如圖4:ID值為25的對象車輛正由東向北左轉彎,在連續漏檢4幀后被重新匹配,實驗表明算法留有設計冗余,可一定程度上提升車輛統計準確率。

表2為實驗中車輛統計實際交通量,統計準確率及同文獻[8]中經典目標檢測方法對比情況,布設在停止線的檢測器平均統計準確率98.35%,其中右轉車道準確率較低為93.1%,布設在交叉口內部待行區域的檢測器中通過直行待行檢測器的統計準確率為98.8%,相較于文獻[8]提出的基于經典目標識別算法的航測視頻車輛統計方法,該方法在平均統計精度上提升2.76%。

3 結論

(1)該文提出的車輛統計方法,使用基于深度學習網絡的車輛識別算法,實驗表明基于YOLOv3訓練的車輛識別模型面對道路背景突變問題較經典目標識別算法有更好的魯棒性。

(2)利用航測法對地觀測優勢,實現城市交叉口車流量的實時統計,一定程度上提升了目標識別過程中的異常保護能力。

參考文獻

[1]陳玉峰,買買提明·艾尼,依再提古麗·阿克甫,等.交叉口交通流的數學建模與數值模擬[J].機械設計與制造,2012(10):256-258.

[2]Papaioannou Panagiotis,Papadopoulos Efthymis,Nikolaidou Anastasia,Politis Ioannis,Basbas Socrates,Kountouri Eleni. Dilemma Zone: Modeling Drivers’ Decision at Signalized Intersections against Aggressiveness and Other Factors Using UAV Technology[J]. Safety,2021(1):11.

[3]康金忠,王桂周,何國金,等.遙感視頻衛星運動車輛目標快速檢測[J].遙感學報,2020(9):1099-1107.

[4].戚永剛.基于卡爾曼濾波的城市路口車輛檢測及分類[J].電視技術,2013(19):241-245.

[5]J.Redmon.Darknet.Open source neural networks in c[EB/OL].2013–2016[20200924].

[6]Redmon J,Divvala S,Girshick R,et al.You only look once:Unified,real-time object detection[C].Proceedings of the IEEE conference on computer vision and pattern recognition.2016:779-788.

[7]Redmon J,Farhadi A.Yolov3:An incremental improvement[J].arXiv preprint arXiv:1804.02767,2018.

[8]張敬,張林,王長偉.基于航拍視頻的交叉口車流量統計方法研究[J].計算機仿真,2020(12):117-121.