煤礦事故案例命名實體識別方法研究

潘理虎,趙彭彭,龔大立,閆慧敏,張英俊

(1.太原科技大學 計算機科學與技術學院,山西 太原 030024;2.精英數智科技股份有限公司,山西 太原 030006;3.中國科學院 地理科學與資源研究所,北京 100101)

0 引 言

煤炭是中國能源體系的主要組成部分,煤礦安全生產管理始終是經濟社會安全穩定的重要工作。據統計,中國2004-2020年因煤礦事故導致的死亡人數達到了40 000,煤礦事故已經成為威脅煤礦安全生產的最大挑戰。煤礦事故的預防是保障煤礦安全、穩定生產的重要手段。得益于知識圖譜理論和技術的發展,煤礦事故的預防可通過整合多源、異構的煤礦事故案例信息,構建煤礦事故領域知識圖譜,通過與現有的煤礦領域核心知識圖譜融合,構建煤礦安全生產知識圖譜,對煤礦事故、人員、設備、操作及環境進行智能化管理來實現。煤礦事故領域命名實體識別(named entity recognition,NER)是構建煤礦事故領域知識圖譜的基礎工作。

NER任務的目的是找出文本序列中特定標識符的開頭和結尾,并將其進行分類,是自然語言處理的一項基本任務。基于規則的方法和基于統計機器學習是早期NER識別任務的常用方法。其中基于規則的方法依賴于人工構建規則庫來解決特定領域的實體識別任務,費時費力且可移植性差,因此使用率越來越低,逐漸被基于統計機器學習的方法所替代;基于統計機器學習的方法出現了隱馬爾可夫、條件隨機場(conditional random field,CRF)、層疊馬爾可夫及多層條件隨機場等經典模型,這些模型面向海量的標注數據進行訓練,最大程度摒棄了對于人工的依賴,取得了較高的準確率,但是存在泛化能力不強的缺點。近年來深度學習和圖形處理器(graphics processing unit,GPU)的發展極大地促進了自然語言處理技術的升級,與基于規則和基于統計機器學習的方法相比,深度學習擁有速度更快、泛化能力更強的優點,因此神經網絡模型成為解決命名實體識別任務的主流方法。由于循環神經網絡(recurrent neural network,RNN)的線性結構與文本序列天然對齊,RNN在命名實體識別任務中應用廣泛,雙向長短時記憶網絡(bi-direction short and long term memory networks,Bi-LSTM)作為RNN的變體,以其獨特的門控結構解決了RNN的梯度消失和梯度爆炸問題,Bi-LSTM也成為了解決NER任務的典型代表。盡管基于RNN實體識別方法取得了不錯的成績,但是RNN的序列依賴結構決定其無法充分利用GPU的并行計算能力,導致模型的訓練時間過長,造成計算資源的嚴重浪費。為了充分利用GPU資源,縮短訓練時間,學者們將卷積神經網絡(convolutional neural networks,CNN)應用于NER中。盡管CNN與RNN相比有明顯的計算優勢,但受限于卷積核的大小,CNN抽取長距離特征的能力弱于RNN。

目前,面向煤礦事故領域的命名實體識別工作存在以下難點:第一,沒有煤礦事故領域的命名實體標注語料;第二,煤礦事故案例沒有統一的書寫規范,存在大量口語化表達;第三,相同實體表述不同,如“頂板冒落”、“片幫冒落”、“冒落”、“頂、邊幫冒落坍塌事故”都是指同一事故類型,但是表述卻不一致;第四,實體長度不一,識別難度較大;第五,煤礦事故案例文本涉及大量的專業詞匯,如“煤與瓦斯突出事故”、“瓦斯爆炸”、“頂板垮塌”等。

針對以上問題,基于帶有Dropout和自適應矩估計的迭代擴張卷積(iterative dilated convolution with dropout and adaptive moment estimation,IDCDA),該文給出了一種命名實體識別模型ALBERT-IDCDA-CRF,主要工作包括以下幾個方面:(1)構建了煤礦事故領域實體標注語料CoalMineCorpus;(2)使用ALBERT預訓練語言模型獲取文本序列的字向量表示,提升原有字向量的表達能力,解決實體表述不一致的問題;(3)針對長實體問題,采用四個相同結構的迭代擴張卷積模塊提升傳統CNN的特征抽取抽取長距離特征的能力;(4)研究了結合Dropout和自適應矩估計(adaptive moment estimation,ADAM)的卷積神經網絡優化算法解決過擬合問題。

1 煤礦事故領域標注語料集構建

1.1 煤礦事故領域語料集構建

煤礦事故案例主要包括時間、地名、煤礦名稱、事故原因、事故類型、傷亡情況及救援過程等,是關于煤礦事故的重要數據。該文以從煤礦安全生產網、煤礦安全網、國家煤礦安全監察局等網站發布的煤礦事故案例作為原始數據,預處理后得到規范的煤礦事故案例數據集,以句末點號為標志對數據集進行句子級劃分。針對煤礦事故領域實體邊界模糊問題,結合煤礦領域專家的意見及實際應用需求對煤礦事故領域命名實體進行分類,在字級別對數據集進行標注,構建了包含時間、地名、煤礦名稱、事故類型四類實體的語料集CoalMineCorpus。

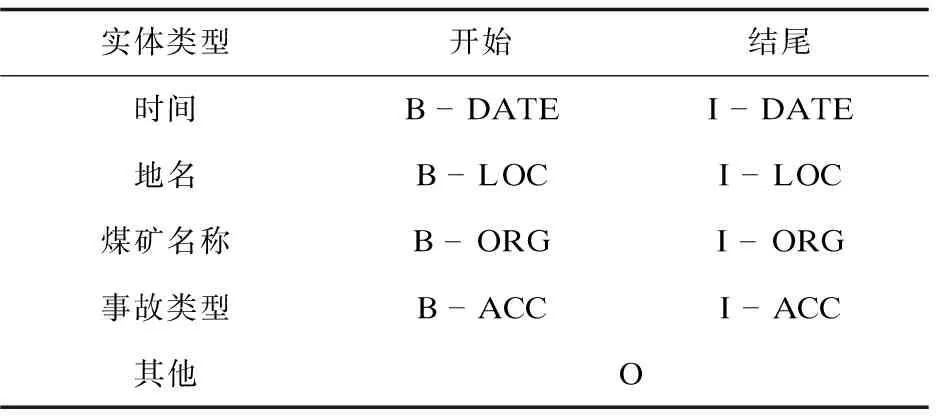

1.2 煤礦事故領域實體分類及標注

使用DATE、LOC、ORG、ACC分別表示時間、地名、煤礦名稱、事故類型四類實體,采用“BIO”標注體系進行實體標注,其中“B-”表示實體開始,“I-”表示實體的中間和結尾部分,“O”表示其他,所定義的標簽集合如表1所示。

表1 實體標簽集合

為了保證實體標注的準確性,該文使用支持多人同步進行標注工作和結果對比的YEDDA標注軟件完成序列標注。在實體標注過程采用雙人標注同一文檔的方式,標注完成后對結果進行對比,避免實體標注不一致問題;其次標注完成后請煤礦領域專家對標注結果進行檢查來避免實體標注錯誤。以“云南曲靖祠堂坡煤礦頂板冒落事故致5死2傷”為例,標注結果如表2所示。

表2 序列標注結果

1.3 CoalMineAccident標注語料集統計

應用1.2節的實體分類及標注方法對煤礦事故案例數據集進行處理,得到可用于煤礦事故領域的命名實體識別研究工作的煤礦事故領域標注語料集CoalMineCorpus,每類實體數目統計如表3所示。

表3 CoalMineCorpus語料集實體數目統計

2 命名實體識別模型

2.1 模型框架

ALBERT-IDCDA-CRF模型結構如圖1所示,包括詞嵌入層、CNN層和CRF層三個部分。模型的輸入為字向量序列,因此需要把煤礦事故案例文本數據嵌入到向量空間,將字符轉變為一定維度的字向量。該文使用ALBERT預訓練語言模型融合文本序列的上下文語義信息,將得到的字向量序列輸入CNN層,CNN層采用四個迭代擴張卷積(iterative dilated convolution,IDC)模塊來完成特征抽取,將四個模塊的結果疊加作為CNN層的輸出,使用結合Dropout和ADAM優化器的卷積神經網絡優化方法來解決神經網絡的過擬合問題。最后使用條件隨機場作為解碼器,通過在數據集中學習標簽的依賴關系,利用維特比算法進行推理,從而獲得最佳的標簽順序,對最終結果進行修正。筆者將在以下各節對三部分內容進行詳細介紹。

圖1 ALBERT-IDCDA-CRF網絡結構

2.2 詞嵌入層

詞嵌入層使用ALBERT預訓練語言模型獲取字向量表示,ALBERT為多層的雙向Transformer結構,Transformer是一個僅使用注意力機制的機器翻譯模型,由Encoder和Decoder兩部分組成,ALBERT僅使用其Encoder部分,Encoder由六個相同的層堆疊組成,每層主體結構為多頭注意力機制和全連接前饋網絡兩個子層。

多頭注意力機制(multi-head attention mechanism)是ALBERT最重要的部分,可視為h

個獨立注意力的拼接,如圖2所示。

圖2 多頭注意力機制結構

首先利用公式(1)對Q

、K

、V

進行線性變換,重復h

次,其中Q

、K

、V

為字向量:

(1)

將h

個結果輸入放縮點積注意力(scaled dot-product attention),利用公式(2)計算作為放縮點積注意力的結果:

(2)

最后將h

個結果利用公式(3)拼接后作為多頭注意力的最終輸出:

(3)

為了保證模型在提升訓練效率的同時保持充足的文本表示能力,ALBERT采用嵌入層參數因式分解和跨層的參數共享策略來減少參數量,并且添加句間連貫(sentence ordering objectives,SOP)子任務,通過預測句子間的順序來增強模型的理解能力。

2.3 CNN層

2.3.1 擴張卷積(dilated convolution,DC)

在自然語言處理中,CNN通常是一維的,通過卷積核在向量序列上的移動來完成卷積操作,實現特征的抽取。傳統卷積神經網絡如圖3(a)所示,卷積核大小為3×3,感受野大小為3×3,提取長距離特征的方法為增大卷積核大小或加深網絡層數。如堆疊3層圖3(a)所示的CNN進行卷積操作,在步長為1的情況下,雖然感受野增大為7×7,但會使模型參數量變大,導致訓練時間增加。擴張卷積執行相同的卷積操作時,通過設置不同的擴張率來擴大有效的輸入寬度以增大感受野,從而卷積得到更多特征,捕獲更多的上下文信息。圖3(b)為擴張率為4的擴張卷積,感受野增大為15×15。由此可知,擴張卷積可以在不增加網絡層數的同時實現感受野的擴散,從而縮短了訓練時間。

(a)傳統CNN (b)擴張率為4的擴張卷積

2.3.2 迭代擴張卷積(iterative dilated convolution,IDC)

簡單堆疊多層圖3(b)所示的擴張卷積可以有效整合序列的全局信息,但會造成局部信息的缺失,使卷積結果缺乏相關性,如圖中灰色區域的特征并沒有被提取到。而對于上下文關系緊密的NER任務而言,丟失一部分特征會對模型準確率產生很大影響。

該文采用四個如圖4所示的迭代擴張卷積模塊來避免丟失特征連續性,其中上一個迭代擴張卷積模塊的輸出是下一個模塊的輸入,最后將四次迭代的結果疊加作為最終的輸出。每個模塊由三層擴張率分別為1、1、2的擴張卷積組成,通過設置不同的擴張率來抽取多尺度上下文特征,前兩層使用擴張率為1的擴張卷積來避免局部信息丟失,保證特征提取的準確性;最后一層將擴張率設置為2,使卷積核的感受野擴大為7×7,提升模型提取長距離特征的能力。

圖4 擴張率分別為1、1、2的三層擴張卷積模塊

(4)

將式(4)的結果輸入網絡進行迭代,可以得到第k

次迭代時第一次循環結束的結果:

(5)

第k

次迭代中第j

次循環結束的結果為:

(6)

定義堆疊函數Stacking(),疊加四次迭代結果,可以得到最終的卷積結果C

:

(7)

2.3.3 損失函數及網絡優化

針對神經網絡的過擬合問題,該文采用結合Dropout和ADAM優化器的卷積神經網絡優化方法。在全連接層和輸出層之間加入Dropout層,以概率P

隨機選擇一部分神經元,使其暫時停止工作,概率P

為:P

=(P

=1|x

)=

(8)

其中,P

=1表示樣本a

生成1的概率值,B

表示所有i

類神經元中屬于a

的數量。同時采用交叉熵損失函數衡量模型預測結果的好壞,公式為:

(9)

在訓練階段調整ADAM優化器的學習率對損失函數進行優化,通過最小化交叉熵來提升模型的性能。

2.4 CRF層

CNN層雖然可以有效整合煤礦事故案例文本的上下文信息,但不能考慮實體標簽之間的先后順序,如“B-LOC”只能出現在地點實體的開頭,而不能出現在其他位置;而CRF可以在數據集中學習標簽的依賴關系,利用維特比算法進行推理,對CNN層的輸出結果進行修正,從而獲得最優的標簽序列。因此,該文選擇CRF作為模型最終的輸出層。

給定一條煤礦事故案例文本序列:W

=(w

,w

,…,w

),經過CRF可以得到一個預測標簽序列:X

=(x

,x

,…,x

),定義其預測分數為:

(10)

其中,為標簽由x

轉移到x

+1的概率轉移矩陣,N

為第i

個詞語被標記為標簽y

的概率。最后利用維特比算法即可得到當前文本序列W

的最優標簽序列。y

=argmax(P

(W

,X

))(11)

3 實驗設計及結果分析

3.1 實驗語料及評價標準

該文采用自構的CoalMineCorpus語料集作為數據集,采用信息檢索系統通用評價標準作為評價指標,即準確率(Precision,P

)、召回率(Recall,R

)和F測量度(F-measure,F

),概念公式如式(12)所示。

(12)

其中,n

為預測為真且正確預測的實體個數,M

為預測為真的實體個數,N

為標準結果中的實體個數。3.2 超參數設置

通過多組對比實驗,分析了不同超參數設置對模型識別效果的影響,得到ALBERT-IDCDA-CRF模型最優的超參數,如表4所示。其中過濾器大小為3×3,字向量維度為100維,訓練次數和Batch size設置為100、20。在訓練過程中,將Dropout的概率值設置為0.5,測試階段設置為1。

表4 ALBERT-IDCDA-CRF模型超參數

3.3 實驗結果分析

3.3.1 實驗1:不同學習率下ADAM優化器對ALBERT-IDCDA-CRF模型F值的影響

考慮到ADAM優化器的數學特性,若學習率過大或者過小都會導致交叉熵損失函數難以收斂,因此通過將學習率設置為0.02,0.03,…,0.09進行實驗,不同學習率下ALBERT-IDCDA-CRF模型的F值變化如圖5所示。

圖5 ALBERT-IDCDA-CRF模型F值變化

觀察圖5可知,當學習率位于[0.02,0.05)時,模型的F值與學習率呈正相關關系;當學習率位于[0.05,0.07],F值趨于穩定;當學習率大于0.07,F值呈下降趨勢。因此在后續實驗中將學習率設置為0.05。

3.3.2 實驗2:ALBERT-IDCDA-CRF在不同優化器下的性能對比

為了分析不同優化算法對模型識別性能的影響,分別采用隨機梯度下降(stochastic gradient descent, SGD)、自適應梯度算法(Adagrad)、ADAM三種優化算法對ALBERT-IDCDA-CRF模型進行優化。實驗結果如表5所示,可以發現當采用ADAM優化器時,模型的準確率、召回率和F值明顯優于其他兩種算法,因此后續實驗采用ADAM優化器對模型進行優化。

表5 不同優化器下模型性能對比 %

3.3.3 實驗3:ALBERT-IDCDA-CRF與其他模型的比較

由表6可知,在采用相同特征抽取模型的情況下,分別使用ALBERT和word2vec生成字向量,當使用ALBERT預訓練語言模型生成詞向量時,BILSTM-CRF的F值由76.64%提升到86.20%,IDCDA-CRF的F值由74.11%提升到90.65%,分別提高了9.56%和16.54%,說明使用雙向Transformer結構的ALBERT預訓練語言模型生成的字向量具有更好的文本表示能力,包含的語義信息更加豐富。同時ALBERT-IDCDA-CRF取得了最高的準確率、召回率和F值,和BILSTM-CRF和IDCDA-CRF相比F值提高14.01%、16.54%,比識別效果最好的ALBERT-BILSTM-CRF提高4.45%,可見該文所使用的迭代擴張卷積特征抽取能力最強,并且略優于經典的雙向長短時記憶網絡。

表6 不同模型性能對比 %

由圖6不同模型訓練時間對比結果可以看出,該文采用的方法解決了傳統命名實體識別方法訓練時間過長的問題,與BILSTM-CRF、IDCDA-CRF、ALBERT-BILSTM-CRF相比時間變化分別為-133 s,+148 s,-1 501 s(正為時間增加,負為時間減少),和ALBERT-BILSTM-CRF相比,訓練時間縮短一半,和IDCDA-CRF相比,雖然訓練時間有所增加,但P、R、F值卻大幅提升。

圖6 不同模型訓練時間對比

上述對比分析結果表明,所采用的ALBERT-IDCDA-CRF神經網絡模型在各項評價指標上有明顯提高,訓練時間也大幅縮短,是進行煤礦事故案例命名實體識別的最佳模型。

4 結束語

以自構的煤礦事故領域實體標注語料集CoalMineCorpus為研究對象,該文提出了面向煤礦事故案例的ALBERT-IDCDA-CRF命名實體識別模型。該模型詞嵌入層通過使用輕量級預訓練語言模型ALBERT來產生更高質量的詞向量,提升命名實體識別的性能;CNN層使用四個迭代擴張卷積模塊來提升CNN抽取長距離特征的能力和縮短模型的訓練時間,采用結合Dropout和ADAM的優化算法解決模型的過擬合問題;最后采用CRF對標簽序列進行約束,提升預測結果。通過多組對比實驗,驗證了ALBERT-IDCDA-CRF模型在煤礦事故領域命名實體識別任務中的有效性。

在未來的研究工作中,將進一步擴大語料集CoalMineCorpus的規模,將實體標注工作規范化,考慮采用融合字、詞特征的詞向量提升模型性能,抽取更多有應用價值的實體。