深度學習在胰腺醫學影像中的應用綜述

王曠怡,胡秀枋

(上海理工大學醫療器械與食品學院,上海 200093)

0 引言

胰腺癌發病隱匿、預后極差,經臨床數據統計,胰腺癌患者5 年生存率只有8%,當胰腺癌發生轉移時,該比例會下降到3%[1-2]。盡管胰腺癌診斷可通過醫學影像技術如CT 等進行初步診斷,但準確率差強人意[3]。

隨著人工智能技術的發展,作為其重要技術之一的深度學習也得到了廣泛研究。深度學習技術的日漸成熟為輔助醫生實現高精度診斷提供了新機會[4-5]。目前深度學習在醫學影像上的應用十分廣泛,并取得了顯著成果[6],但針對其在胰腺醫學影像上的應用還缺乏綜述性研究。因此,本文對其進行綜述,以期為后續相關研究提供參考。本文回顧了深度學習發展歷程,總結了深度學習在胰腺醫學影像上的應用,包括胰腺組織病理圖像、CT 圖像及超聲圖像等,并介紹了現階段深度學習在胰腺醫學影像診斷中面臨的問題及對未來的展望。

1 深度學習發展史

1.1 深度學習起源

從1943 年心理學家McCilloch與數學邏輯學家Pitts[7]提出MCP 模型開始,人工神經網絡的大門就此打開。1958年,計算機科學家Rosenblatt 發現了一種類似于人類學習過程的算法(感知機學習),并且提出了感知機模型,這對于神經網絡的發展具有里程碑式的意義[8]。但在1969 年,Marvin 等[9]編寫了《感知器》,證明感知器本質上就是一種線性模型(Linear Model),無法解決線性不可分問題,至此人工神經網絡進入第一個寒冬期,神經網絡研究也陷入了將近20 年的停滯。

1.2 深度學習發展

1986 年,神經網絡之父Hinton 提出一種適用于多層感知器(Multi-Layer Perceptron,MLP)的反向傳播(BackPropagation,BP)算法,采用Sigmoid 進行非線性映射,完美地解決了非線性分類問題[10],使得沉寂已久的神經網絡再一次獲得了大眾關注。但受當時計算機硬件條件的限制,無法解決由于神經網絡規模變大,BP 算法會出現梯度消失現象,導致模型無法進行有效學習的問題,阻礙了深度學習的進一步發展。

1.3 深度學習爆發

2006 年,Hinton 等[11]在世界頂尖刊物《科學》上提出解決梯度消失問題的方案:通過無監督預訓練對權值進行初始化,再使用有監督訓練進行微調。該文章一發表,立即在學術圈引起巨大反響,掀起了深度學習研究的高潮。2012 年,Hinton 課題組憑借深度學習模型AlexNet 在著名的ImageNet 圖像識別比賽中奪得冠軍,其首次采用ReLU 激活函數,可很好地抑制梯度消失問題。深度學習算法在世界大賽中的脫穎而出,再一次吸引了研究者們的關注,基于深度學習的卷積神經網絡(Convolutional Neural Networks,CNN)也得到了更深入的研究[12-14]。

2 深度學習在胰腺醫學圖像診斷中的應用

2.1 深度學習在胰腺病理學圖像上的應用

組織病理學是臨床上腫瘤診斷的金標準,組織病理學圖像是病理學醫生臨床診斷的重要輔助工具,病理學醫生通過顯微鏡觀察組織切片作出診斷。組織病理學診斷工作任務繁重,每組的病理醫生每天分析的病理切片數量約為400 張[15],而成為一名優秀的醫生需要有10 萬張以上的切片分析經驗。截至2018 年,我國有執照的病理醫生僅為一萬余人,缺口達到90%[16]。病理學醫生極為短缺,無法滿足我國日益增長的胰腺癌診斷需求。

如今深度學習在組織病理學上已被廣泛使用。如Wang 等[17]使用基于GoogleNet的模型在Camelyon 乳腺癌淋巴結轉移分類挑戰賽上取得了0.925的受試者工作特征曲線下面積(Area Under Curve,AUC)的最佳成績,說明深度學習在組織病理學圖像分類上具有很好的表現;Momeni-Boroujeni 等[18]使用多層感知器神經網絡(MNN)分析胰腺細針穿刺活檢細胞圖像,對胰腺非典型病例的良惡性分類可達到77%的準確率,說明深度學習在病理學中具有改善患者預后的潛力;Krzysztof 等[19]將神經網絡模型應用于胰腺管內增生性病變分類,分析來自慢性胰腺炎及需要胰腺切除的腫瘤手術患者細胞,細胞核分類的正確率達到73%,可作為探討胰腺導管癌早期診斷方法的起點。

以上研究采用了比較簡單的模型,對今后的研究具有啟發性作用,未來研究或許可應用更復雜的模型。目前深度學習在胰腺組織病理圖像上的應用尚較少,原因之一是可用的胰腺病理圖像數據集很少,因此還需作進一步研究。

2.2 深度學習在胰腺CT 圖像上的應用

電子計算機斷層掃描(Computed Tomography,CT)是利用精確、準直的X 線束、γ 射線、超聲波等,與靈敏度極高的探測器一同圍繞人體某一病變部位進行連續斷面掃描,具有掃描速度快、圖像清晰等特點,如今已得到了廣泛應用。深度學習在CT 圖像領域也有一定應用。基于CT 圖像的高精度胰腺是醫學圖像分析的基本內容[20],但因為胰腺在整個腹部CT 中只占很小比例,所以胰腺分割具有很大的挑戰性[21]。

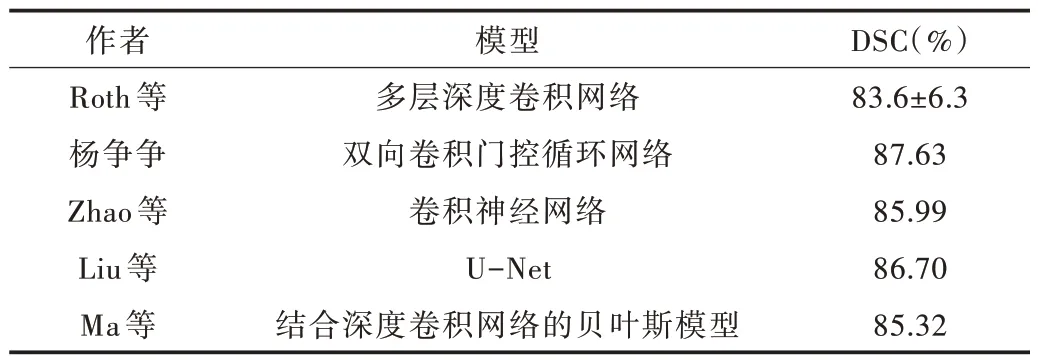

在胰腺CT 圖像分割方面,Roth 等[22]提出基于多層深度卷積網絡(convnet)的概率自底向上腹部CT 胰腺分割方法,戴斯相似性系數(Dice Similarity Coefficients,DSC)達到83.6±6.3%;楊爭爭[23]提出雙向卷積門控循環網絡(Bi-Directional Convolutional Gated Recurrent Unit,BDC-GRU),可有效提高胰腺分割精度,DSC 達到87.63%;Zhao 等[24]提出一個基于CNN的全自動兩階段胰腺分割框架,在NIT 數據集上DSC 平均值達到85.99%;Liu 等[25]利用U-Net 模型,使用邊界框處理CT 數據,同時添加邊界區域進行胰腺器官圖像分割,在NIS 數據集上DSC 達到86.70%;Ma 等[26]提出一種結合深度卷積網絡的貝葉斯模型,在NIS 數據集上DSC達到85.32%,如表1 所示。

Table 1 Application of deep learning in pancreatic CT image Segmentation表1 深度學習在胰腺CT 圖像分割上的應用

上述研究利用深度學習模型進行胰腺器官分割,取得了不錯的效果。胰腺分割分為兩個階段:①訓練一個神經網絡對胰腺器官進行粗分割,獲得一個胰腺器官的邊框;②訓練一個卷積神經網絡對胰腺器官邊界框進行細分割,最終實現對胰腺器官的分割。然而,目前基于深度學習的胰腺CT 影像分割在臨床上還沒有得到廣泛應用,在未來的研究中,進一步實現對胰管和腫瘤的分割對后續影像分析與腫瘤消融將具有重要作用。

在對胰腺CT 圖像良惡性分類預測方面,Liu 等[27]設計一種基于卷積神經網絡的增強CT 圖像識別模型,AUC 可達到0.96,診斷一張CT 圖像僅需0.2s,說明使用卷積神經網絡進行圖像分析是一種高效、精準的胰腺癌診斷方法;Chu 等[28]使用三維深度監督網絡對156 例胰腺癌患者及300 例正常病例進行分類,敏感性為94.1%,特異性為98.5%;Liu 等[29]利用卷積神經網絡在本地測試集(臺灣中心370 名胰腺癌患者及320 名對照者的對比增強CT 圖像)上的準確率達到98.6%~98.9%,在外部驗證集(美國公開的胰腺數據集)上的準確率為83.2%。

采用深度學習技術對CT 圖像良惡性進行預測,結果令人滿意,但在外部測試集上的預測精度相比內部測試集還存在一定差距,原因之一是不同地區的胰腺CT 圖像質量存在差異,甚至不同醫院及不同CT 機上獲得的圖像數據集都會對模型產生一定影響。目前的解決方法是獲取不同分布的數據集,模型通過學習可解決一部分因圖像質量差異造成在外部測試集上模型預測精度低的問題。將來會研究增強模型的泛化性,使其在不同分布的數據集上具有相似的效果。

2.3 深度學習在胰腺超聲圖像上的應用

超聲內鏡(EUS)是一種將內鏡與超聲相結合的消化道檢查技術,其將微型高頻超聲探頭安置在內鏡頂端,在體內觀察消化道的同時進行超聲實時掃描,獲得其層次結構及組織學特征的超聲圖像。臨床上,發生腫瘤改變的胰腺局灶性病變患者中近四分之一需要進行EUS 檢查,但由于胰腺腫瘤和胰腺炎癥通常具有相似的EUS 圖像,即使是經驗豐富的內窺鏡醫師也可能會出現誤診或漏診的情況。EUS 圖像是由像素組成的數字圖像,這些像素的排列反映了EUS 圖像的組織結構[30]。作為計算機輔助診斷技術之一的數字圖像分析可根據EUS 圖像信息對胰腺腫瘤作出診斷[4]。

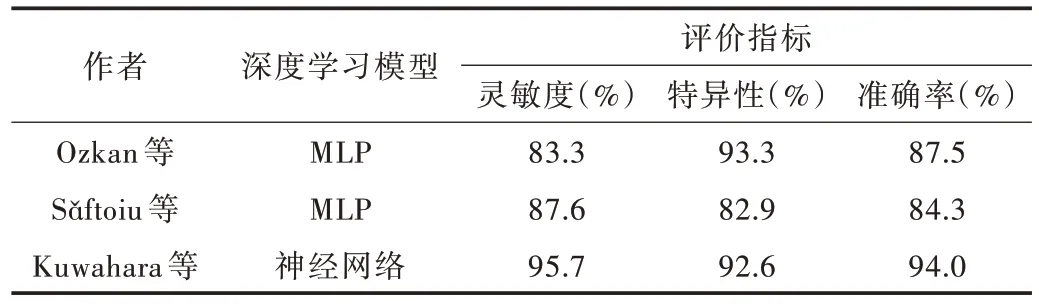

Ozkan 等[31]利用多層感知機(Multilayered Perceptron,MLP)模型對332 張胰腺EUS 圖像進行分析,診斷的靈敏度、特異性與準確率分別達到83.3%、93.3% 及87.5%;Sǎftoiu 等[32]利用基于實時EUS 彈性成像的MLP 模型,為達到區分胰腺癌良惡性的目的,將色調直方圖數據轉換為彈性成像幀數,診斷的靈敏度、特異性與準確率分別達到87.6%、82.9%及84.3%[32]。Kuwahara 等[33]的研究表明,與常規EUS 特征及人工診斷方式相比,深度學習算法可能是診斷胰腺導管內乳頭狀粘液腫瘤(IPMNs)更準確、客觀的方法,其靈敏度、特異性與準確率分別達到95.7%、92.6%及94.0%,其中準確率遠高于人工診斷的56.0%,如表2 所示。

Table 2 Application of deep learning in ultrasound image of pancreas表2 深度學習在胰腺超聲圖像上的應用

以上研究都只獲取了單中心的患者數據,還不足以證實該模型在其他數據集上也能達到同樣效果。Kuwahara等[33]的研究使用了數據增強與遷移學習等人工智能技術,獲得了超過500 000 張圖片,已足夠構建一個高效的模型,研究結果也證明了深度學習模型可用于術前評估IPMNs的惡性程度。但因為相關數據只包含了外科病例,而在臨床上,大多數IPMNs 患者只是接受監視而非進行手術切除,導致最后的結果可能會發生偏差。

3 結語

本文回顧了深度學習發展史,綜述了深度學習在胰腺病理學圖像、CT 圖像及超聲圖像上的應用現狀。目前深度學習在胰腺影像方面的應用仍存在許多困難,首先是樣本量不足,醫學影像數據集較難獲取,能夠用于訓練的數據集很少,而過少的數據集常常會造成模型過擬合,使得深度學習模型在其他數據集上表現很差;其次是醫學影像標注問題,需要經驗豐富的醫生花大量時間進行標注。此外,隨著醫學圖像的分辨率越來越高,當前的硬件設備無法支持對如此高分辨率圖像的處理,需要對圖像進行分塊送入深度學習網絡進行訓練,從而影響模型無法提取出更多完整的空間信息。

為應對這些問題,研究者們探索出了一些新方法,如遷移學習、數據集擴增與對抗生成網絡(Generative Adversarial Network,GAN)在處理數據集缺乏問題時具有較好效果。目前在醫學影像標注方面也進行了數據自動標記相關研究,可解決人工標注費時、費力等問題。使用少量標記數據和大量無標記數據的半監督學習在圖像分類任務中已取得了很好的效果,在胰腺癌診斷上的應用也指日可待。未來無監督學習的研究與發展也會解決人工標注數據集缺乏的問題,為胰腺癌的智能診斷提供很大幫助。