基于目標檢測的機械臂分揀研究

王臘苗

摘 要:機械臂分揀作業(yè),是當前制造、物流、環(huán)保等領(lǐng)域最常見的工作場景之一。以基于目標檢測的機械臂分揀作業(yè)系統(tǒng)為主要研究對象,利用深度學習對機械臂分揀抓取工作中的目標檢測算法進行優(yōu)化并進行實驗分析,結(jié)果表明:優(yōu)化以后的算法能夠有效提升機械臂分揀、抓取成功率。該系統(tǒng)可移植性強,可廣泛應(yīng)用于不同類型機械臂分揀作業(yè)流程。

關(guān)鍵詞:深度學習;目標檢測;機械臂抓取;機械臂分揀

中圖分類號:TP241 文獻標識碼:A 文章編號:1001-5922(2022)04-0166-04

Abstract: The sorting operation of robot arm is one of the most common working scenes in manufacturing, logistics, environmental protection and other fields. Taking the sorting operation system of the robot arm based on target detection as the main research object, this paper uses deep learning to optimize the target detection algorithm in the sorting and grasping work of the robot arm and carries out experimental analysis. The results show that the optimized algorithm can effectively improve the sorting and grasping success rate of the robot arm. The system has strong portability and can be widely used in the sorting operation of different types of robot arm.

Key words: deep learning; target detection; grasping of robot arm; sorting of robot arm

分揀工作已逐漸發(fā)展為工業(yè)生產(chǎn)、物流運輸、航空航天、教育醫(yī)療等領(lǐng)域不可或缺的重要環(huán)節(jié)[1]。在傳統(tǒng)的分揀作業(yè)工作中,多利用純?nèi)斯し绞竭M行工件抓取、分揀等存在分揀效率低、分揀錯誤率高等弊端。為此,有研究機構(gòu)開始嘗試利用圖像識別技術(shù)結(jié)合PLC等開發(fā)出一種能夠自動完成工件分揀工作的機械臂系統(tǒng),大大降低了工件分揀工作中的人力成本,縮短了分揀工作所耗時間。然而,隨著現(xiàn)代工業(yè)等領(lǐng)域?qū)χ貜?fù)性強、場景單一地分揀作業(yè)系統(tǒng)分揀智能化要求的不斷提升,利用傳統(tǒng)圖像方法完成機械臂分揀作業(yè)逐漸暴露出準確率低、魯棒性差以及可移植性不足等問題,需要一種更加智能化的方法進行機械臂分揀系統(tǒng)工作優(yōu)化。本文所開發(fā)系統(tǒng),具備一定的目標檢測模型配置選擇優(yōu)越性,能夠一定程度提升機械臂分揀系統(tǒng)工作成功率和穩(wěn)定性。

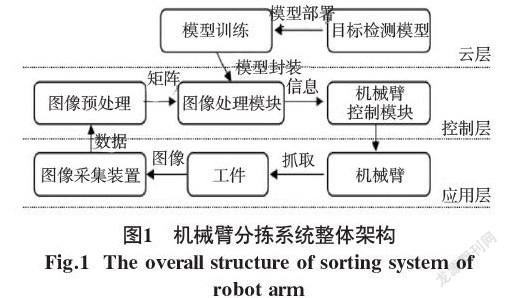

1 機械臂分揀系統(tǒng)整體架構(gòu)

傳統(tǒng)分揀系統(tǒng)作業(yè)需要通過人工手段提前為機械臂分揀系統(tǒng)構(gòu)建工件構(gòu)造特征,將構(gòu)造特征錄入系統(tǒng)以后作為模板進行分揀作業(yè)工件定位、識別等,一旦工件發(fā)生變化,則需要再次對檢測目標進行特征構(gòu)造,重新錄入系統(tǒng)開展后續(xù)工作[2-4]。而利用深度學習目標檢測算法,可以實現(xiàn)機械臂分揀系統(tǒng)特征構(gòu)造環(huán)節(jié)的機器學習,不再需要對工件特征進行多次構(gòu)造,進而增強分揀系統(tǒng)的可移植性。機械臂分揀系統(tǒng)整體架構(gòu)如圖1所示。

1.1 應(yīng)用層

該層主要由機械臂和圖像采集裝置(攝像頭)構(gòu)成:機械臂負責接收上層指令完成對工件的抓取和分揀工作;圖像采集裝置負責對工件的圖像信息進行獲取并傳送至上層控制層。系統(tǒng)應(yīng)用層是外部能夠直接觀察到的層面。

1.2 控制層

該層主要負責處理圖像采集裝置傳送的圖像并對機械臂發(fā)送控制指令。首先,圖像預(yù)處理軟件接收圖像采集裝置利用USB通信發(fā)送的圖像信息;其次,將預(yù)處理完畢后的圖像矩陣發(fā)送至圖像處理單元對獲取的工件信息和模型進行預(yù)測,得到工件的位置、類別等目標檢測信息;最后,將目標檢測信息發(fā)送至機械臂控制模塊生成G代碼等控制指令。

1.3 服務(wù)器層

該層主要用于對機械臂分揀系統(tǒng)的搭建,為系統(tǒng)運行提供算法資源并對基于深度學習目標檢測算法的機械臂分揀系統(tǒng)工件模型進行訓(xùn)練評估。服務(wù)器層在完成算法訓(xùn)練后,能夠得到大量浮點數(shù)組成的模型配置權(quán)重文件,利用該文件能夠準確描述多種構(gòu)造特征工件的結(jié)構(gòu)和參數(shù)值。服務(wù)器層通過系統(tǒng)搭建和算法訓(xùn)練,能夠?qū)C械臂分揀系統(tǒng)中的工件模型部署和封裝到控制層,進而對應(yīng)用層的機械臂具體動作與形態(tài)進行控制。

2 機械臂分揀系統(tǒng)硬件架構(gòu)

2.1 硬件選型

機械臂分揀性能對系統(tǒng)硬件設(shè)備依賴性極強,本研究在一定預(yù)算要求下對系統(tǒng)硬件設(shè)備進行了籌備,詳細系統(tǒng)硬件設(shè)備選型如表1所示。本次機械臂分揀系統(tǒng)硬件設(shè)備主要包括服務(wù)器、圖像處理平臺等。

2.2 硬件架構(gòu)

與系統(tǒng)整體框架對應(yīng)所得機械臂分揀系統(tǒng)硬件架構(gòu)如圖2所示。工件在處于USB工作環(huán)境下后,通過攝像頭USB方式將拍攝圖片傳輸至Jetson Xavier;圖片信息經(jīng)Jetson Xavier中的預(yù)處理模塊處理完成以后生成圖像矩陣;圖像矩陣發(fā)送給Jetson Xavier目標檢測模塊獲取工件的位置、形狀、類別等特征后發(fā)送給Jetson Xavier中的機械臂控制模塊生成G代碼,進而實現(xiàn)對機械臂的控制。該硬件架構(gòu)實現(xiàn)了機械臂分揀系統(tǒng)中指令與數(shù)據(jù)的回路。

3 基于深度學習的目標檢測算法優(yōu)化

3.1 算法流程

一般的機械臂分揀系統(tǒng)中,目標檢測模塊通過高清攝像設(shè)備中顏色模塊的感知等很容易對某物體進行定位并分類[5]。但是當背景復(fù)雜或存在多個物體混雜在一起時,單純的目標檢測難度往往迅速提升,一般的算法將很難從圖像中提取某些抽象概念并進行準確定位。

深度學習是一種發(fā)源于人工神經(jīng)網(wǎng)絡(luò)的學習結(jié)構(gòu),深度學習理論與目標檢測算法的融合,能夠通過組合圖像中的底層特征形成更加抽象的高層表示屬性類別或特征,以發(fā)現(xiàn)待檢測目標圖像中各區(qū)域數(shù)據(jù)的分布式特征表示[6]。基于深度學習的目標檢測算法,能夠利用服務(wù)區(qū)期限算法進行不斷的訓(xùn)練,使機械臂分揀系統(tǒng)構(gòu)造特征能夠適應(yīng)工件類型、位置等的不斷變化,具有較強的泛化性和高移植性如圖3所示。

圖3虛線框中目標檢測算法流程中RPN本質(zhì)上是一個能夠反映風險順序數(shù)的全卷積神經(jīng)網(wǎng)絡(luò),RPN接收的特征圖是經(jīng)卷積層、池化層等作用以后部分輸出的特征圖,輸出為待檢測目標圖像中某候選區(qū)域預(yù)測及算法對該檢測區(qū)域?qū)儆诒尘?目標等的判斷結(jié)果。RPN的輸出結(jié)果將會在ROI池化層中伴隨工件構(gòu)造特征數(shù)據(jù)庫提供數(shù)據(jù)生成固定長度的特征向量,之后通過全連接層對特征向量進行目標分類,進入最優(yōu)抓取位置檢測。

3.2 優(yōu)化算法模型

本文構(gòu)建基于深度學習目標檢測算法的機械臂分揀模型主要通過兩部分進行優(yōu)化:①構(gòu)建了用于提取待檢測工件圖像候選區(qū)域的RPN模塊;②構(gòu)建了用于檢測并識別待檢測工件圖像候選區(qū)目標的快速R-CNN模塊[7]。其中RPN模塊框架如圖4所示。

RPN框架主要由卷積層和全連接層構(gòu)成。如圖4所示,卷基層位于模塊框架下層,以一個像素為1,將若干個像素構(gòu)成的矩形作為圖像信息獲取中使用的矩形滑動窗口,在RPN框架中進行二維到三維的位姿轉(zhuǎn)換,得到該滑動窗口掃過圖片區(qū)域的256維特征向量。將所得特征向量按照cls、reg層兩種劃分原則進行分類,分別用于定位滑動窗口位置以及判斷掃過位置圖片信息屬于目標或者背景。將矩形滑動窗口中心作為錨點,分別生成基于該圖片的k個形狀各不相同的一系列矩形錨框,按照cls、reg層兩種劃分原則進行錨框目標得分和回歸邊界劃分。

快速R-CNN模塊利用CNN網(wǎng)絡(luò)結(jié)構(gòu)用來進行目標檢測和語義分割任務(wù)。快速R-CNN模塊工作流程主要分兩步:將卷積神經(jīng)網(wǎng)絡(luò)CNN運用到自下而上的region proposals上來定位和分割目標,當標簽訓(xùn)練樣本不足時,可以在相關(guān)監(jiān)督學習任務(wù)上進行精調(diào),能產(chǎn)生顯著的性能提升[8-9]。

4 機械臂分揀最佳抓取位置檢測與驗證

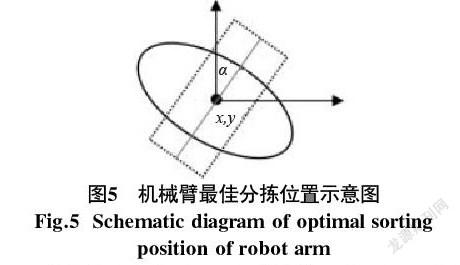

4.1 最佳分揀位置檢測

本文利用深度學習優(yōu)化后的目標檢測算法,將機械臂最佳分揀位置檢測分為兩步級聯(lián)系統(tǒng):第1步,利用RPN模塊和快速R-CNN模塊選擇一系列包含目標物的待檢測區(qū)域;第2步,將第1步獲取的檢測區(qū)域錨框目標得分和回歸邊界進行計算,得到最優(yōu)分揀框并表示為圖5所示的機械臂分揀位置示意圖。

其中橢圓部分表示工件帶分揀目標;(x,y)表示待檢測區(qū)域最佳分揀框在圖像坐標系中的中心位置;矩形框表示機械臂夾持器位置,實線部分待檢測區(qū)域分揀框的“長”為夾持器開口方向;α表示待檢測區(qū)域分揀框的“長”與坐標系縱軸之間的夾角。利用深度學習算法對不同矩形框的表面法向量特征進行提取,經(jīng)過旋轉(zhuǎn)、白化數(shù)據(jù)等操作,得到待檢測區(qū)域最佳分揀位置的若干組搜索框,通過權(quán)值訓(xùn)練得到最優(yōu)的唯一一個搜索框,該搜索框即為機械臂最佳分揀位置分揀框。

4.2 實驗驗證

為驗證本次構(gòu)建基于目標檢測算法的機械臂分揀系統(tǒng)工作性能,本文設(shè)計兩組實驗對機械臂分揀中的分揀動作成功率、準確率等進行分析。其中,實驗一為未進行深度學習的一般目標檢測算法機械臂分揀系統(tǒng)與本系統(tǒng)工作性能對比實驗;實驗二為兩種不同工藝、材料以及構(gòu)造特征工件利用本系統(tǒng)進行抓取時的性能驗證實驗。

4.2.1 實驗一

以一般目標檢測算法機械臂分揀系統(tǒng)為對照組(A),深度學習優(yōu)化目標檢測算法機械臂分揀系統(tǒng)為實驗組(B),對同一工件進行抓取分揀進行30次對比試驗,機械臂抓取分揀成功則記錄為1,未抓取分揀成功則記錄為0,所得實驗結(jié)果如表2所示。

按照“成功率=成功樣本數(shù)/總樣本數(shù)”進行計算,A組整體分揀成功率為46.7%,B組分揀成功率為93.3%,實驗組分揀成功率優(yōu)勢明顯更高,同時,利用深度學習優(yōu)化后的目標檢測算法,除第一次及第二次未抓取分揀成功以外,其余抓取分揀動作均成功,可見該學習算法在對機械臂分揀抓取動作進行訓(xùn)練后取得了明顯成效。

4.2.2 實驗二

以某一號工件為對實驗組Ⅰ,以某二號工件為實驗組Ⅱ,利用深度學習優(yōu)化目標檢測算法機械臂分揀系統(tǒng)進行30次抓取分揀試驗,機械臂抓取分揀成功則記錄為1,未抓取分揀成功則記錄為0,所得實驗結(jié)果如表3所示。

從整體成功率角度分析,兩組試樣分揀成功率相同均為96.7%,表明了本系統(tǒng)進行工件分揀時的優(yōu)越性;但工件二在進行第五次實驗時出現(xiàn)了一次抓取失敗,按照理論上對深度學習優(yōu)化以后的目標檢測算法分析,越往后抓取分揀的成功率應(yīng)越高,本文通過對實驗過程進行復(fù)原推理,并未發(fā)現(xiàn)實驗中存在不嚴謹情況,屬正常結(jié)論。

5 結(jié)語

綜上,本文構(gòu)建了一種基于目標檢測的機械臂分揀系統(tǒng),該系統(tǒng)的目標檢測算法在經(jīng)過深度學習優(yōu)化以后,能夠獲得遠高于一般目標檢測算法的抓取分揀成功率。隨著現(xiàn)代工業(yè)對機械臂分揀系統(tǒng)應(yīng)用范圍的擴大,分揀系統(tǒng)抓取分揀工件成功率、準確率成為機械臂分揀系統(tǒng)發(fā)展過程中最為主要的研究領(lǐng)域,本研究旨在為工業(yè)分揀、機械臂等研究領(lǐng)域提供理論與經(jīng)驗借鑒。

【參考文獻】

[1] 朱福喜,楊怡群,傅建明,等.人工智能原理[M].武漢:武漢大學出版社,2002.

[2] 詹煒.基于候選區(qū)域的深度學習目標檢測算法綜述[J].長江大學學報(自然科學版),2019,16(5):108-115.

[3] 張慧,王坤峰,王飛躍.深度學習在目標視覺檢測中的應(yīng)用進展與展望[J].自動化學報,2017,43(8):1 289-1 305.

[4] 郭憲,馬書根,李斌,等.基于動力學與控制統(tǒng)一模型的蛇形機器人速度跟蹤控制方法研究[J].自動化學報,2015,41(11):1 847-1 856.

[5] 朱雨賀.基于深度學習目標檢測的機械臂分揀系統(tǒng)研發(fā)[D].杭州:浙江大學,2019.

[6] 蔡漢明,趙振興,韓露,等.基于SSD網(wǎng)絡(luò)模型的多目標檢測算法[J].機電工程,2017,34(6):685-688.

[7] 曾慶源,沈洪銳,龍健云,等.智能移動垃圾分揀機器人設(shè)計與實現(xiàn)[J].電子制作,2019(23):24-25,44.

[8] 杜學丹,蔡瑩皓,魯濤,等.一種基于深度學習的機械臂抓取方法[J].機器人,2017,39(6):820-828,837.

[9] 宋煥生,張向清,鄭寶峰,等.基于深度學習方法的復(fù)雜場景下車輛目標檢測[J].計算機應(yīng)用研究,2018(4):1 270-1 273.