基于YOLOv5的艦船目標及關鍵部位檢測算法

錢 坤, 李晨瑄, 陳美杉, 王 瑤

(1. 海軍航空大學岸防兵學院, 山東 煙臺 264000; 2. 中國人民解放軍32127部隊, 遼寧 大連 116100)

0 引 言

近年來,隨著科技進步和技術革新,海上作戰形式有了新的變化,智能化、小型化、無人化、精確化已成為趨勢。同時,在大國博弈的背景下,以威懾為戰略目的,以失能為戰術目標的精確化打擊,將成為雙方展示實力的重要手段。

水面艦艇作戰過程中,中、遠段突防可以依托武器裝備的小型化和集群化對敵攔截武器系統施加壓力,所以末端突防階段的精確制導能力成為打擊能否成功的關鍵。在末制導技術中,圖像制導具有被動探測、抗電磁干擾、成本低廉、設備體積小巧等優勢。同時,由于可見光圖像包含更加豐富的顏色和紋理細節,也非常適合作為精確識別的信息來源,可有力支撐精確化打擊的實施。

由于計算機圖形處理器算力的限制,早期的圖像識別有著很強的手工設計痕跡,其解決問題的過程大致可以概括為區域選擇、特征提取和分類識別3個步驟。區域選擇多基于滑動窗口方式;特征提取主要依據目標顏色、紋理,設計專門的提取算法,典型方法有尺度不變特征變換(scale-invariant feature transform,SIFT)和方向梯度直方圖(histogram of oriented gradients,HOG);分類識別主要應用支持向量機(support vector machine,SVM)或AdaBoost。這種方法泛化能力差,難以在實際問題中實現多類別的、大數據量的、實時準確的檢測識別。2006年,深度學習思想的提出指出了多層人工神經網絡具備強大的特征學習能力,即從訓練模型中所提取的特征能夠更本質地表達輸入圖像具備的特征,從而解決了特征可視化和分類問題。同時,人工神經網絡可以對輸入圖像進行分層級地表達,這樣可以顯著降低多層人工神經網絡的訓練難度,正式開啟了深度學習領域的研究。

卷積神經網絡(convolutional neural network,CNN)的引入,解決了滑動窗口選擇和人工特征提取的問題,使得目標檢測的實時性和準確性有了大幅提升,其中最具代表性的有兩類算法,一是基于候選框的兩階段檢測,如區域CNN(region-CNN, R-CNN)算法,Fast R-CNN,Faster R-CNN,基于區域的全CNN(region-based fully CNN, R-FCN)算法以及Mask R-CNN。二是基于免候選框的單階段檢測,典型的有單次多框檢測器算法(single shot multibox detector, SSD),Retina-Net以及YOLO系列算法。2015年YOLOv1被提出,其核心思想與Faster R-CNN類似,將整幅圖片作為網絡的輸入,并直接在輸出層實現邊界框位置和分類的確定;隨后的YOLOv2在采用了批量歸一化、高分分類器和先驗框等優化策略后,實現了速度、準確率和識別對象類別數量上的提升;YOLOv3的結構更加復雜,引入了特征金字塔網絡(feature pyramid network,FPN)和darknet-53網絡,并允許改變網絡結構以權衡速度與精度,計算速度大幅提高;YOLOv4的網絡架構變化很大,通過大量的調參試驗,在輸入網絡分辨率、卷積層數和參數數量間找到最佳平衡,實現了綜合性能的提升;YOLOv5在網絡輕量化上貢獻明顯,速度更快,也更加易于部署。

基于衛星遙感合成孔徑雷達(synthetic aperture radar,SAR)圖像的海上艦船識別已經比較成熟,但無論是星載還是機載,所獲取的SAR圖像多為俯視視角,對于反艦武器掠海攻擊來說借鑒意義不大。同時,由于SAR成像機理限制,難以實時成像和對動目標高質量成像,因此并不適用于圖像制導。在小型化、集群化的突防武器上使用可見光圖像制導,利用豐富的圖像信息進行艦船要害部位檢測識別,而后實施高精度的打擊使敵艦失能,就成為一種可行的戰術思路。

在基于水平視角的艦船目標識別研究中,文獻[24]使用了傳統的HOG+SVM方法,經過圖像預處理、HOG特征提取訓練以及SVM分類器訓練來檢測船舶目標;文獻[25]則利用類FCN全卷積網絡,能夠接受任意尺寸圖像的輸入;文獻[26-27]分別使用了YOLOv2和YOLOv3,取得了較好的效果。

本文在YOLOv5網絡架構基礎上進行了深度優化,在原有的空間金字塔池化(spatial pyramid pooling,SPP)網絡中引入了隨機池化的多卷層,進一步提升了識別精度;運用雙向FPN(bi-directional FPN, BiFPN)進行多尺度特征融合,以提高特征融合效果,進而優化小目標檢測能力;使用指數線性單元(exponential linear unit,ELU)函數作為激活函數,加快了收斂速度,并提高了模型的魯棒性。同時,針對之前的艦船目標識別研究普遍將艦船視為一個質點,不區分具體打擊部位的情況,在本文的目標識別過程中,同時對幾何形狀明顯和相對位置固定的艦船關鍵部位進行精確識別,為海上精確打擊作戰提供了有益借鑒。

1 YOLOv5目標識別算法

1.1 YOLOv5網絡架構

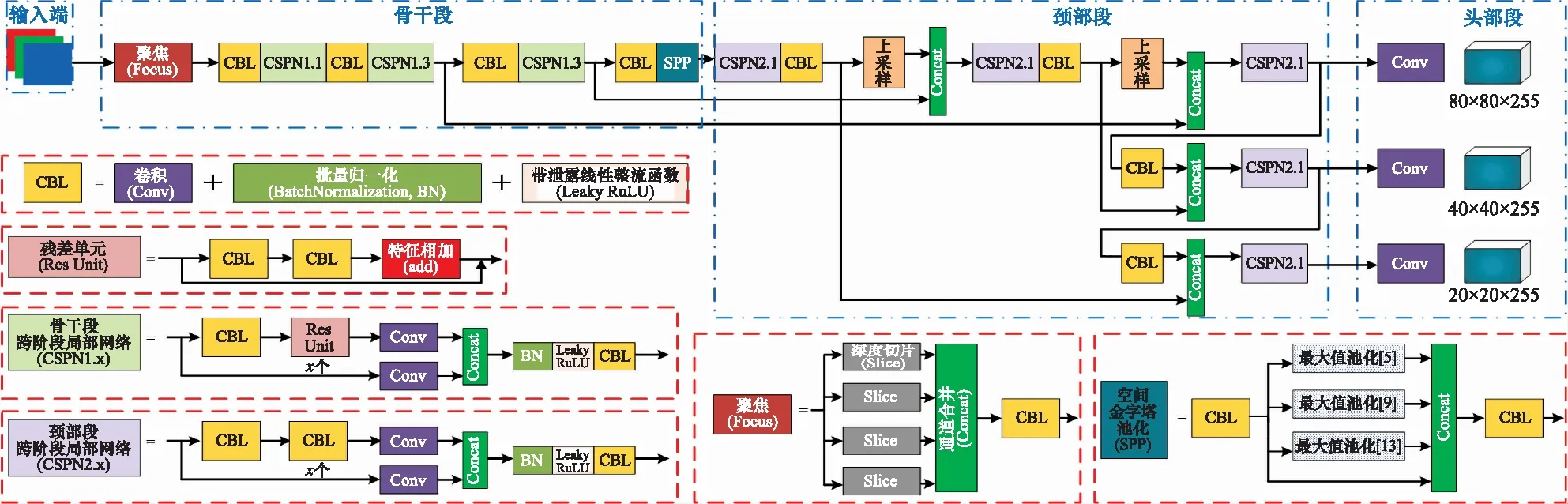

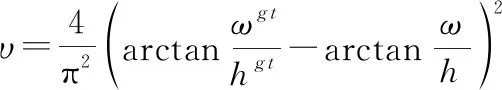

YOLOv5的網絡架構整體上與YOLOv4比較相似,從結構上大致可以分為輸入端、骨干段、頸部段和頭部輸出端4個部分,具體結構如圖1所示。

圖1 YOLOv5網絡結構示意圖

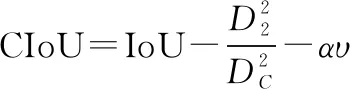

與YOLO之前版本不同的是,YOLOv5實現了網絡架構的系列化,有YOLOv5s、YOLOv5m、YOLOv5l和YOLOv5x這4種結構,結構的變化是通過調節深度倍數和寬度倍數實現的。通過在每個跨階段局部網絡(cross stage partial networks,CSPN)中設置不同的殘差組件數量,得到不同深度的網絡;在聚焦結構和每個CSPN設定不同數量的卷積核,得到不同寬度的網絡,表1是YOLOv5系列網絡結構的參數。

表1 YOLOv5系列網絡結構的深度和寬度倍數參數

隨著網絡深度和寬度的增加,其泛化學習能力、特征提取能力和特征融合能力也會隨之增強,代價是計算時間會有所增加。通過這樣靈活的設定,可以根據具體需求,在檢測速度和準確性間找到平衡。

1.2 YOLOv5模型檢測識別算法原理

在輸入端主要有如下幾項工作:一是基于馬賽克算法的數據增強,將4張圖像分為一組,經過隨機縮放、拼接或疊加合成一幅圖像進行后續訓練,目的是豐富數據集并縮短訓練時長,經驗證也可以降低內存的占用率。二是自適應錨框計算,訓練中,輸出的預測框與真實框進行比對,通過計算兩者之間的交并比得到偏移量,反向迭代后,得到最適應數據集的錨框大小。三是自適圖像片縮放,輸入圖像的尺寸是不一樣的,在YOLOv5中常用的尺寸有416×416,608×608,640×640等,通過等比縮放并用黑邊填充,得到尺寸統一的輸入圖像。

在骨干段網絡,采取聚焦結構來裁剪輸入圖像,將數據切分為4份,每份數據都相當于在2倍下采樣下得到,在縱向通道進行拼接,之后進行卷積運算。以YOLOv5s為例,原始的640×640×3的圖像輸入聚焦結構后,經過切片變成320×320×12的特征圖,再經過32個卷積核的卷積運算,得到320×320×32的特征圖。而在YOLOv5m架構中,則有48個卷積核,所以經過聚焦結構后輸出為320×320×48的特征圖,YOLOv5l,YOLOv5x也是同理。而在特征生成部分,則沿用YOLOv3的SPP網絡來完成。

在頸部段網絡,應用路徑聚合網絡(path-aggregation network,PANet)進行特征融合,PANet是在FPN基礎上增加了一條自底向上的信息流通路,縮短了信息傳輸路徑,旨在使準確的底層定位信息能夠增強到整個特征提取網絡。

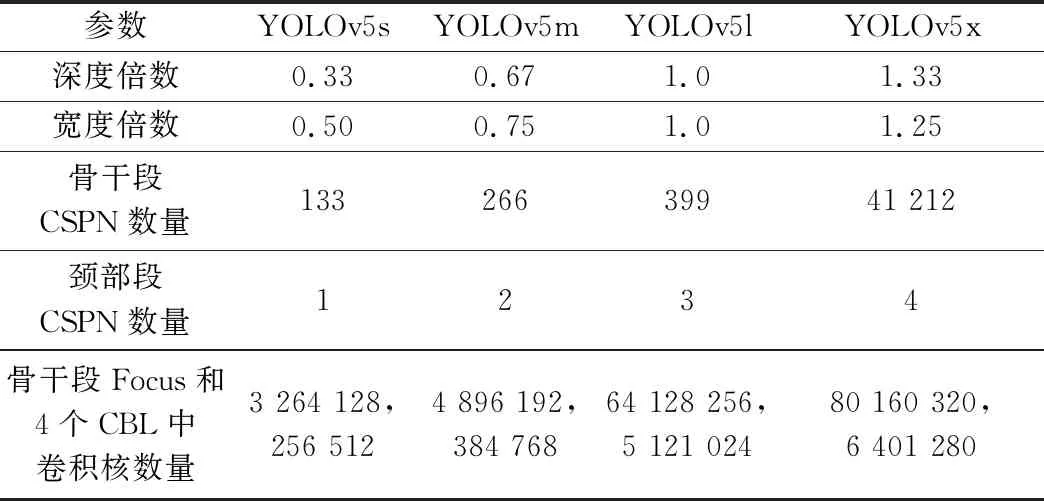

損失函數的選取對于評估預測準確性至關重要,早期的交并比損失函數(intersection over union loss, IoU Loss)設計比較簡單,只計算預測框與真實框交集面積與并集面積的比值,但實際情況是這個比值并不能完全反映預測框與真實框的相對位置。在頭部輸出端,通過引入中心點距離和寬高比兩個參數后,形成了完全IOU Loss(complete IOU Loss, CIoU Loss)。

(1)

(2)

(3)

式中:是預測框與目標框的中心點距離;是最小外接矩形對角線長度; 和分別是是預測框與目標框的寬高比。YOLOv5目標檢測流程如圖2所示。

圖2 YOLOv5目標檢測流程圖

2 基于改進YOLOv5的艦船目標關鍵部位檢測識別

2.1 算法整體框架

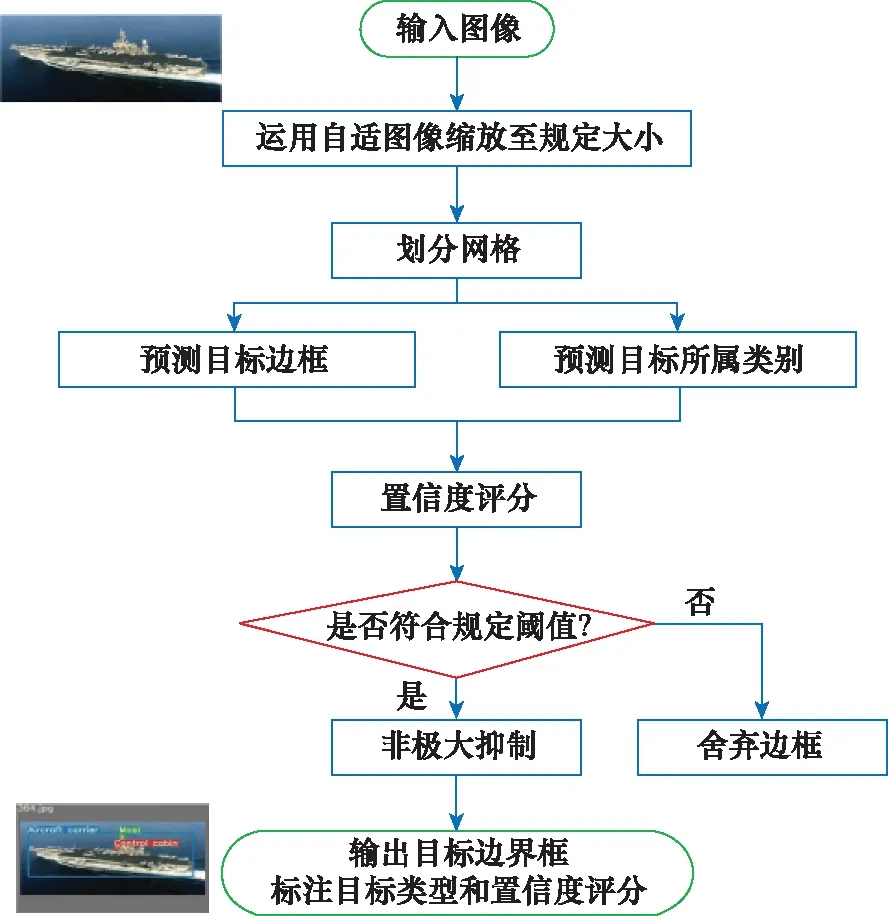

算法基于YOLOv5網絡模型,兼顧精度與速度,網絡輕量化優勢突出。輸入圖像尺寸靈活,經自適應縮放后統一為640×640后進入聚焦結構,經過多層卷積運算后,進入隨機池化SPP網絡,進行圖像下采樣,降低維度,減少網絡參數,增大卷積核的局部感受野;再進入BiFPN結構,進行不同尺度下的特征融合,旨在進一步減少冗余計算,提升后續檢測精度;同時在網絡中應用ELU激活函數,代替帶泄露線性整流函數(leaky rectified linear unit, Leaky ReLU),起到抑制噪聲、加快收斂速度并提升模型魯棒性的作用。算法整體框架如圖3所示,圖中Conv意為卷積。

圖3 算法整體架構

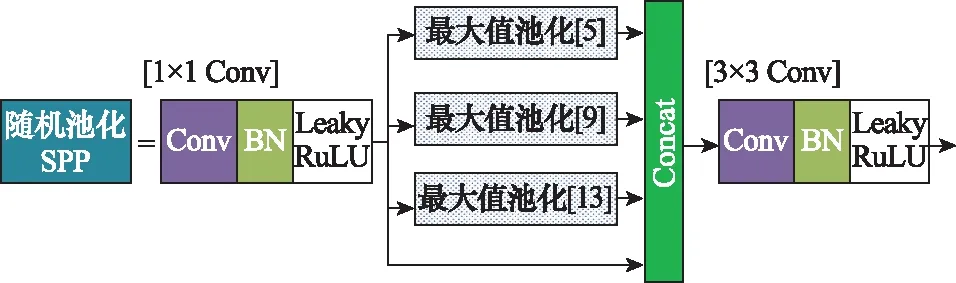

2.2 基于隨機池化的多卷積層SPP網絡

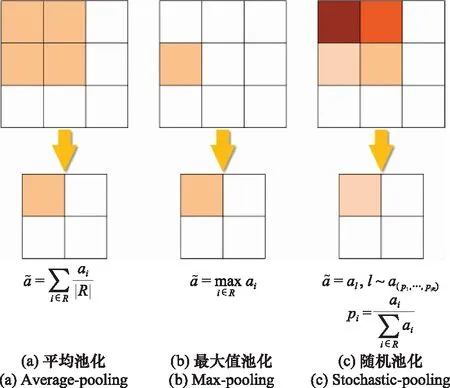

YOLOv5延續了YOLOv3中的SPP網絡,在SPP結構中,使用最大值池化進行運算。池化的目的是將區域中的信息進行壓縮,從而完成信息的提取和抽象,通過池化運算能夠達到數據降維、特征壓縮、擴大感受野以及實現不變性(包括平移、旋轉和尺度的不變性)。所以在設計池化運算的時候要在簡化運算的基礎上盡量減少特征圖中信息映射的丟失。3種典型池化方法如圖4所示。

圖4 3種典型池化方法

池化運算中,最為常用的是平均池化和最大值池化,前者可以輸出子區域內特征值的均值,能夠更多地保留背景信息,后者輸出子區域內特征值的最大值,強調輸出圖中最強烈的部分,但對于差異性不明顯的情況容易造成特征信息的丟失。隨機池化介于兩者之間,思路是通過對像素點按照數值大小賦予概率,即數值大的被選中的概率也大,這樣的設計在平均意義上與平均池化相近,但在局部信息上,依舊服從最大值池化的規則。

首先計算池化區域的統計和∑=,用每個特征值去除這個統計和,從而得到每個特征值的概率值=∑∈,之后按照這個概率值進行隨機采樣,從而實現隨機池化,如下式所示:

=,~P(,,…,||)

(4)

式中:是采樣的窗口大小;為被采樣的特征值;為按照隨機選擇的數值。

在SPP結構中應用隨機池化,改進后的隨機池化SPP結構如圖5所示。

圖5 隨機池化SPP結構圖

2.3 基于BiFPN的多尺度特征融合網絡

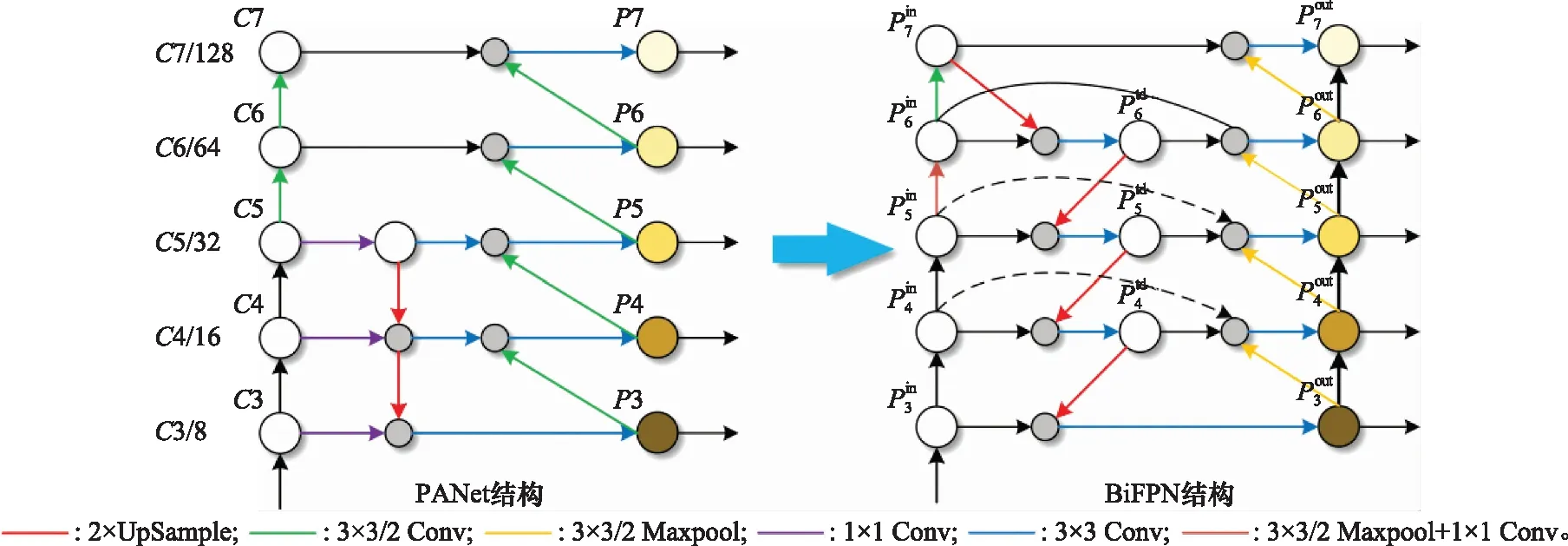

伴隨YOLO架構的發展,模型愈加復雜,網絡不斷加深,所提取的特征語義維度也越來越高,但每層網絡都會造成一定程度的特征丟失,這就需要對在不同尺度上提取的特征進行融合。YOLO架構的多尺度特征融合經歷了從類FPN,FPN,再到PANet的不斷優化改進,從原理來看,淺層網絡擁有更高的分辨率,涵蓋了更準確的位置信息;深層網絡感受野更大,涵蓋更多的高維語義信息,對目標的分類貢獻更大。所以優化不同尺度信息融合效果就成為提升網絡架構的一種方法。

單階段目標檢測算法面臨的問題是無法通過一個單一階段的特征抽取得到不同尺度的特征。在骨干段抽取生成的特征,按照階段進行劃分,記作、、…、,數字代表圖像分辨率減半的次數,如表示第4階段,輸出為原圖像116尺寸的特征圖。

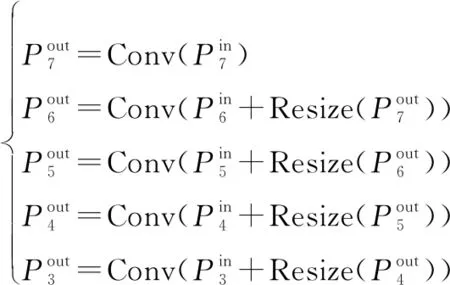

之后由上至下逐層進行特征融合,輸出的記作,這個過程可以用方程表示為

=(,+1),∈{3,4,…,6}

(5)

YOLOv5在頸部段應用了PANet進行特征融合,PANet結構的特點是在到層建立了自下而上的融合鏈路,加強了底層強定位特征的向上傳遞。由Google的大腦團隊在2020年提出的EfficientDet目標檢測網絡中首次應用了BiFPN多尺度特征融合,相對于PANet,BiFPN主要的改進有3點:減少了部分節點,BiFPN中刪除了入度為1的節點,因為這樣的節點相較于前一節點沒有額外信息,可以減少冗余計算;增加了跳躍鏈接,使輸出層不但能夠得到自下而上已經參與特征融合的信息,還保留了原始節點未經融合的信息;形成了融合模塊,可以作為整體繼續參與堆疊,做進一步融合,各層關系如下式所示:

(6)

通過這樣的設計,理論上可以實現精度的小幅提升和運算量的大幅降低,這對于設備空間極為有限,運算能力并不突出的彈載裝備來說具有很大的現實意義。PANet結構和BiFPN結構如圖6所示,其中,為各層的中間特征。

但是濕式電除塵器運行溫度在煙氣的露點以下,內部煙氣、液體具有強烈的腐蝕性,因此,在選材時必須考慮采用抗腐蝕性能強的材料,以保證濕式電除塵器正常運行和使用壽命。

圖6 PANet結構和BiFPN結構

2.4 ELU激活函數

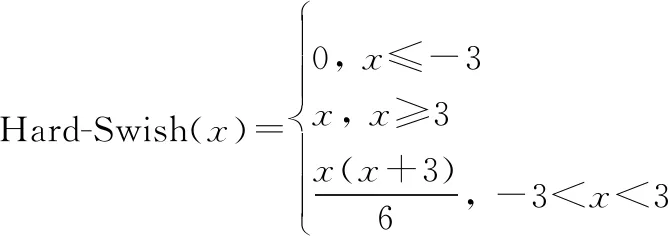

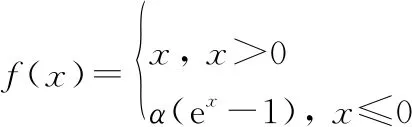

激活函數的設計在神經網絡設計中非常重要,其特點是具備非線性,可以決定神經網絡的感知機制是否觸發,同時,這種非線性也賦予了深度網絡學習復雜函數的能力,在YOLOv5網絡架構中的卷積模塊中應用了Hard-Swish激活函數,用分段函數可以表達為

(7)

在CSPN模塊中應用了Leaky ReLU激活函數,文獻[35]中提出了一種對Leaky ReLU函數的進一步優化方法。

(8)

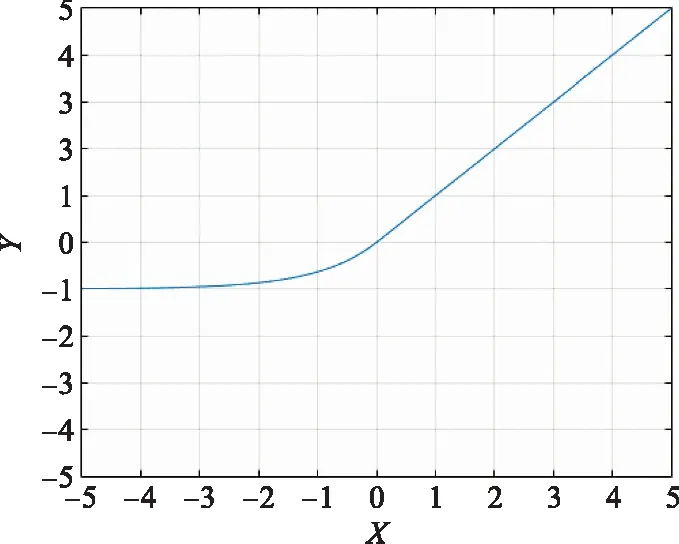

如圖7所示,ELU函數有效融合了S型曲線函數(Sigmoid)和線性整流(rectified linear unit,ReLU)函數的優點,其在零點的右側呈線性,可以進一步緩解梯度消失問題;在零點左側是非線性的,使其對輸入變化或者噪聲有著更優異的魯棒性。并且由于ELU函數的輸出均值接近于0,所以在收斂速度上也有一定提升。在YOLOv5網絡架構中用引入ELU函數代替原有的Leaky ReLU函數作為激活函數。

圖7 ELU激活函數圖像(α=1)

3 實驗驗證

3.1 數據集與實驗環境

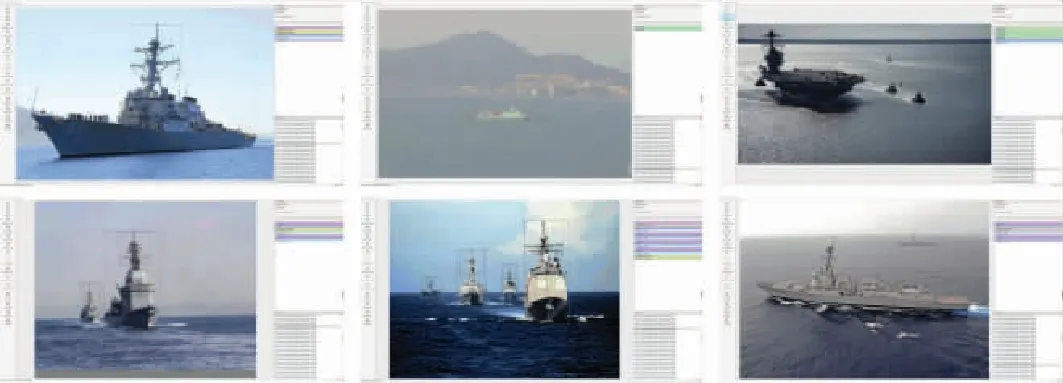

基于水平視角或較低視角的海上艦船可見光圖像目前尚無權威數據集,作戰艦艇圖像數據因涉密原因也比較難以獲取,所以本文所用數據集主要由兩部分組成。一部分是利用基于Python腳本的爬蟲技術爬取圖片素材網站中的目標圖像得到的,主要過程是在素材網站中搜索“航空母艦”“宙斯盾驅逐艦”“漁船”“貨輪”等關鍵字,得到含有大量搜索結果的網頁及其源代碼,分析獲取目標圖像的統一資源定位符(uniform resource locator,URL),并依照URL進行下載。另一部分是人工實地拍攝的,包括長焦鏡頭拍攝和無人機掠海航拍,兩部分經過人工篩選后匯總,所建立的數據集共有圖像1 544幅,包含民用船只558幅、作戰艦艇區分航空母艦和驅逐艦各636幅、741幅。圖像大小為1 200×800至300×200之間,經自適應縮放后統一為640×640大小。部分樣本如圖8所示。

圖8 部分樣本

在反艦裝備智能化、小型化、集群化的發展方向上,以命中艦艇為精度的攻擊已經難以滿足要求,因為小型化的反艦武器毀傷能力不足,難以對艦船造成實質性的傷害,所以必須命中艦船的要害部位,比如攻擊雷達或天線,可以癱瘓艦艇的偵察、火控和通信能力;攻擊艦艇駕駛艙,可以直接癱瘓指揮中樞,實施艦上“斬首”;攻擊船尾甲板下部舵機艙,可以破壞其機動能力;攻擊水線部位,則能夠造成船身進水,直接威脅艦船安全。

在以上要害部位中,可以優先選擇艦艇的相控陣雷達陣面,一方面是相控陣雷達是現代艦艇的標配,其陣面天線多為形狀規則的多邊型,且艦艇配有多個陣面,正向或是側向突防時都能明顯觀察。還可以選擇艦島上方桅桿,這個部位敏感器件密集,位于艦船的最高點,相對位置突出。舵機艙所占空間較大,允許的攻擊誤差也相對較大,且位于艦艇尾部甲板下方,位置也比較明顯。駕駛艙位于艦島中上部,單層(驅逐艦)或多層(航空母艦)的聯排的舷窗是其明顯的標志。

綜上,在具體標注過程中,選擇在驅逐艦上標注桅桿、相控陣雷達、駕駛艙和舵機艙;在航空母艦上標注桅桿和駕駛艙;民用船只不標注關鍵部位。經統計,共標注帶有關鍵部位的作戰艦艇圖像1 052幅,每幅作戰艦艇平均標注367個關鍵部位。數據集格式使用PASCAL VOC格式,并運用開源工具labelImg進行手工標注。圖9所示為標注樣例。

圖9 標注樣例

在關鍵部位尺度上,符合小尺度關鍵部位(小于50像素)的占81%,中尺度關鍵部位(介于50至130像素之間)的占17%,大尺度關鍵部位(大于130像素)的占2%,所以對小目標的檢測能力是模型優化的關鍵。

在數據集的劃分上,使用腳本文件將全部圖像按照8∶1∶1的比例隨機劃分成訓練集、測試集和驗證集,具體數量為訓練集1 237幅、測試集149幅和驗證集158幅,標注數據如表2所示,實驗的具體環境配置如表3所示。

表2 數據集標準情況統計表

表3 實驗環境

3.2 YOLOv5架構選擇及訓練參數

主要的訓練配置參數設置如下:訓練周期為100,批處理量為16,圖片尺寸為640×640。

3.3 評價指標

在識別精度方面采用混淆矩陣中的查準率和召回率作為基本指標(查準率主要評估預測是否準確,召回率主要評估查找是否完全),依據查準率和召回率計算平均精度均值(mean average precision, mAP),作為精度的最終評價指標,用以衡量訓練得到的模型在所有類別上的綜合表現,并將交并比為0.5作為判別檢測成功與否的閾值。

在運算速度方面采用每秒傳輸幀數(frames per second, FPS)和每秒浮點運算次數(floating-point operations per second, FLOPs)進行評價,一方面可以考察是否滿足動態實時檢測識別的要求,另一方面可以考察彈載設備的計算能力是否可以滿足模型的運算負載。

在模型大小方面主要考察參數量的大小,參數量完全由模型結構所決定,即一旦網絡結構確定,參數量也隨之確定。同時,由于參數以32位浮點數格式存儲,所以模型文件大小約等于參數量的4倍。

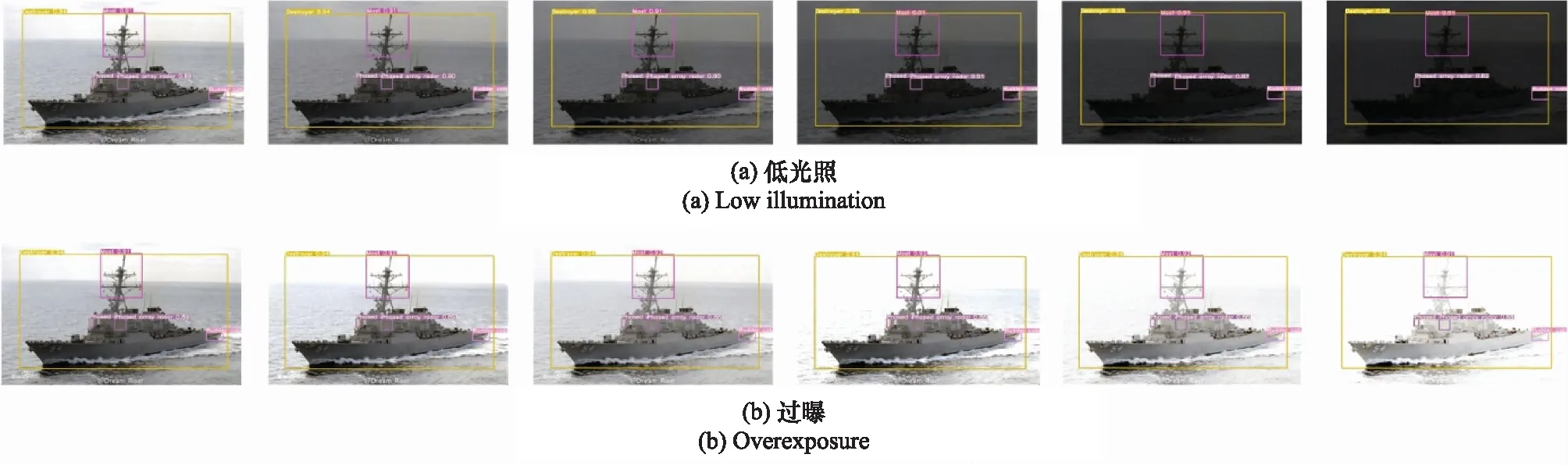

同時,為了檢驗網絡模型魯棒性表現,還設計了不同光照條件下的檢測識別實驗,為得到不同光照條件下的圖像,對原始圖像曝光度進行調節,得到一系列過曝和低照度情況的圖像,再用原YOLOv5s網絡和改進后的YOLOv5s網絡分別進行檢測,并進行效果對比。

3.4 識別結果與分析

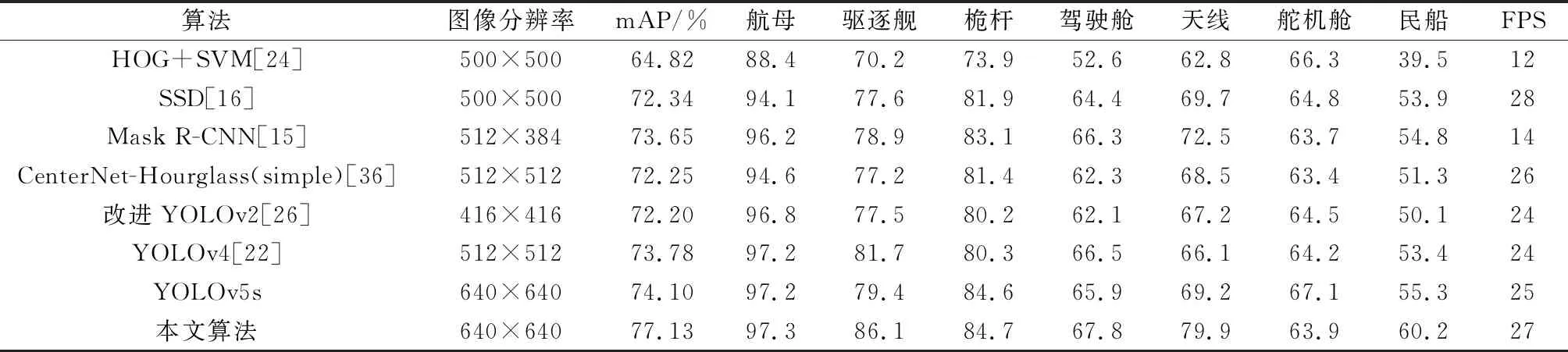

通過訓練,得到相應的訓練權重文件,使用權重訓練文件對圖像進行識別,結果如圖10所示。圖10(a)為待檢測的輸入圖像,圖10(b)為輸出的檢測結果,檢測結果中對于艦船目標,目標框準確標示目標外沿,對于艦船上小目標的檢測清晰準確,對于存在部分遮擋情況的目標也能夠準確識別。圖11和圖12是在不同光照條件下的檢測識別實驗結果,改進后的YOLOv5網絡在圖像存在明顯過曝或低照度條件下的檢測效果都比較穩定,原YOLOv5網絡在低光照情況下,先出現了漏檢情況,在圖11(a)最右圖中檢測出了兩處相控陣雷達天線,而在圖12(a)最右圖中漏檢了一處,說明改進后的網絡模型魯棒性有所提升,對于光照的變化不敏感。為客觀驗證算法性能,在相同實驗平臺,同一數據集情況下,對幾種主流目標識別網絡性能進行了對比,準確率和處理速度情況如表4所示。

圖10 實驗結果示例

圖11 本文算法光照魯棒性實驗結果

圖12 原算法光照魯棒性實驗結果

表4 在艦船關鍵部位數據集上幾種算法的檢測精度和速度

本文算法對比傳統的HOG+SVM方法有著大幅提升,mAP提升近13%,速度提升了15 FPS;對比同為單階段檢測的SSD算法,mAP提高4.79%,速度上略有不足,但均能滿足實時性檢測要求;對比兩階段檢測的Mask R-CNN算法,mAP提高3.48%,速度上近乎翻倍;對比單階段免錨框的CenterNet-Hourglass(simple)算法,速度小幅提升,mAP提高4.88%;對比同系列的YOLO算法,在mAP和速度上也均有提升,特別是對照原YOLOv5s算法,mAP提高了3.03%,速度提升了2 FPS。在對含有艦船目標的MP4格式視頻文件檢測試驗中,所訓練模型能夠準確識別艦船及其關鍵部位,且跟蹤穩定流暢。

分析7類目標的識別結果,民用船只、駕駛艙和舵機艙在各算法中的識別正確率普遍較低,主要原因可能是民用船只形態各異,漁船、客輪、貨輪、液化天然氣船外形差異巨大,在數據集較小情況下,訓練的效果比較一般;駕駛艙聯排舷窗屬于小目標,檢測相對較難;舵機艙位于船尾且較為低矮,在從船頭的正視角觀察時,容易產生大部分被遮擋的情況。

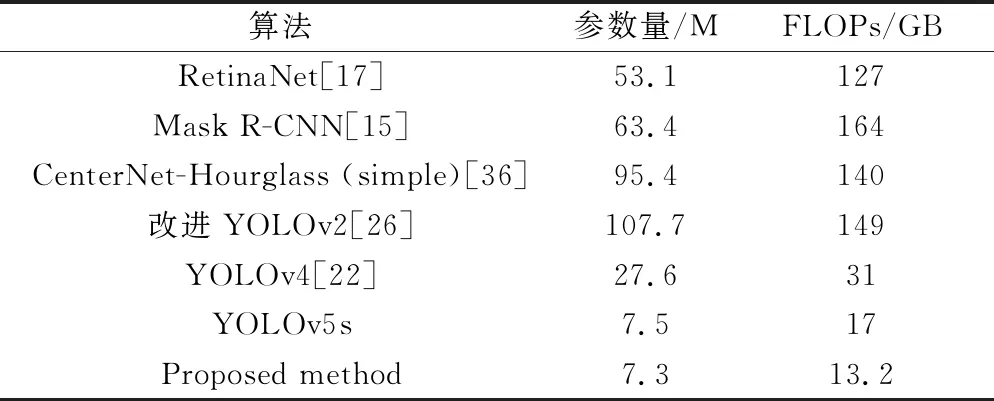

由于YOLOv5模型輕量化的特點,加之YOLOv5s對模型深度和寬度的精簡,原有模型的參數量僅有7.5 M,顯著優于其他算法,改進型算法在參數量方面進一步縮減了2.7%。在運算開銷上看,YOLOv5模型比其他算法的算力要求明顯更低,改進型算法在原有算法基礎上又降低了2.2%。

表5 各算法的參數量和運算量

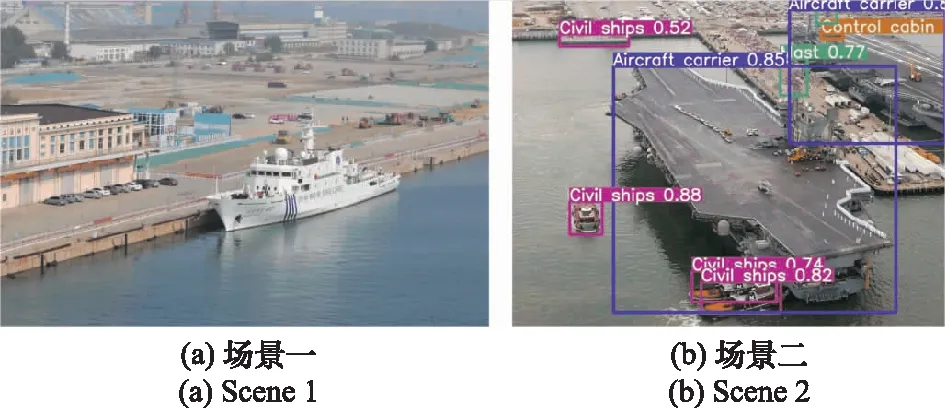

在實驗測試中發現,當艦船置于復雜島岸背景下,漏檢、錯檢概率明顯上升,如圖13所示。但復雜島岸背景下的精確化打擊有著極為重要的意義,甚至可能是我方面臨的主要海戰場環境,這說明模型還需進一步提升優化。如圖13(a)中漏檢了岸邊艦船目標,并錯檢了岸上停泊的轎車,圖13(b)中將船舶停靠的泊位錯檢成了民用船只。

圖13 復雜島岸背景下檢測示例

3.5 消融實驗

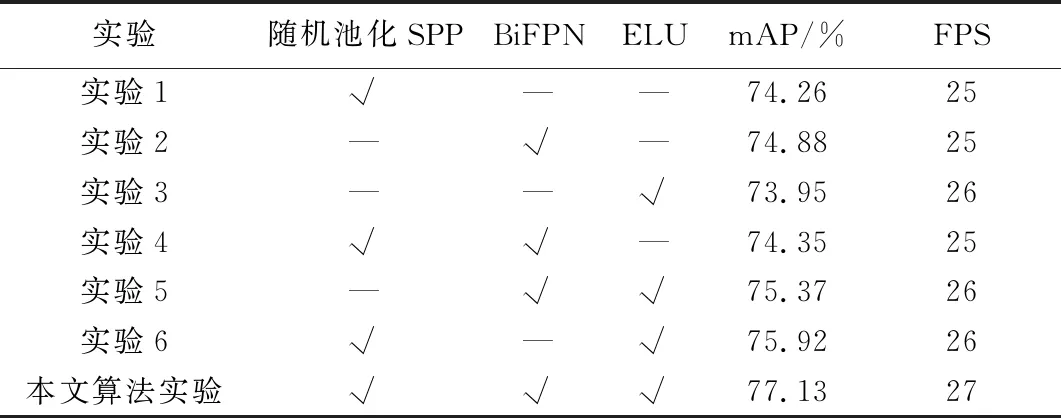

算法同時對原YOLOv5s模型的特征生成、特征融合和激活函數進行了改進,為評估不同模塊改動和不同模塊組合對于算法性能優化的程度,設計了消融實驗,表6為消融實驗數據。在相同的實驗環境下,在艦船目標及其關鍵部位數據集上進行實驗統計。數據表明,每個模塊單獨應用均能對最終結果產生正向優化,其中BiFPN對于識別準確率的貢獻相對較為明顯,mAP提升0.78%,ELU激活函數對于速度的提升相對顯著,提高1 FPS。不同的組合對模型整體表現也基本呈現正向優化。3個模塊的組合應用對于最終的識別精度和處理速度優化效果最好。

表6 消融實驗數據

圖14列出在消融實驗下檢測識別的效果對比。左列為消融實驗檢測識別結果,右列為本文算法檢測識別結果,實驗結果表明,消融實驗組多次出現漏檢,本文算法組準確識別出所有艦船目標及其關鍵部位。

圖14 消融實驗對比示例

4 結 論

在武器智能化、小型化和集群化的反艦作戰背景下,實現對艦船及其關鍵部位的識別是精確化打擊的基礎性工作。針對現有識別算法僅將艦船視為質點而不區分部位的情況,首先構建了艦船及其關鍵部位數據集,針對彈載設備算力有限的情況,提出了基于YOLOv5的改進型輕量化艦船目標及其關鍵部位識別算法。

改進了基于隨機池化的多卷積層SPP網絡,優化特征提取效果,在突出強烈特征的同時,也能對差異化不明顯的特征給予一定保留。在mAP指標上相較主流的SSD、Mask R-CNN、CenterNet-Hourglass(simple)分別提升4.79%、3.48%、4.88%,較同系列的YOLOv2、YOLOv3和原YOLOv5s模型也分別有4.93%、3.35%和3.03%的提升。

使用BiFPN結構進行多尺度特征融合,減少冗余計算,降低計算負載。在以輕量化為特點的YOLOv5算法基礎上進一步壓縮了2.7%的參數量。使用ELU函數代替原有的Leaky ReLU函數作為激活函數,加快收斂速度,提升了模型魯棒性。算法能夠滿足實時性要求,運算開銷較低,適合移動部署。

目前,海上艦船目標精確識別依舊面臨很多問題,如移動平臺采集圖像成像質量不佳;海上氣候條件惡劣,容易受煙、霧、不良光照干擾,從而丟失目標紋理細節,對要害部位識別造成困難。以上問題需要對圖像進行有針對性的預處理,完成圖像增強和重建等工作。在實驗測試中還發現,艦船在臨近島岸情況下漏檢、錯檢概率明顯增加,說明在復雜背景下的檢測識別能力還有提升空間,以上問題將是后續工作的重點研究方向。