基于卷積神經網絡的目標檢測算法綜述*

李炳臻 姜文志 顧佼佼 劉 克

(海軍航空大學岸防兵學院 煙臺 264001)

1 引言

目標檢測作為計算機視覺的重要任務,用于在圖像上檢測特定類別的目標。近年來隨著卷積神經網絡[1]技術的成熟應用,目標檢測發展迅速,在人臉識別、車輛識別等方面取得了廣泛的應用。近些年來,應用比較廣泛的的目標檢測算法主要分為兩個類別[2],它們分別是One-stage 與Two-stage 算法,算法過程中有無候選區域目標推薦的步驟,是它們兩類算法間最大的區別。

Two-stage 算法,主要基于區域檢測的基本思路,將檢測過程劃分為兩個步驟[2~3]。首先,提取候選框的特征信息;然后,利用卷積神經網絡(CNN)對候選框(ROI)位置進行分類(classification)與位置 回 歸(bounding box regression)。 故 稱 之 為“Two-stage”,較之于One-stage算法精度更高,但是速度較慢[4]。典型代表有R-CNN、Fast-RCNN、Faster-RCNN等。

One-stage 算法則根據回歸的基本思路,利用用卷積神經網絡(CNN)的卷積特征,得到待檢測目標的信息參數,包含所屬類別概率值與位置坐標值,結構更加簡潔,具有有更快的檢測速度,典型算法有YOLO V1/V2/V3、SSD、DSSD等。

2 Faster-RCNN算法

2.1 前任算法

2.1.1 RCNN

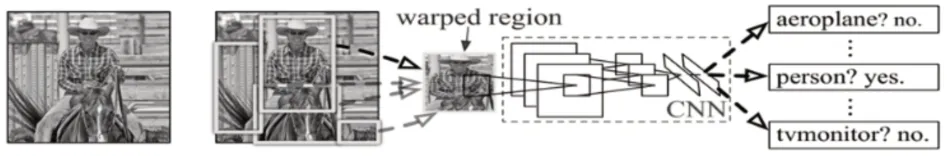

RCNN[5]是將CNN(卷積神經網絡)應用到目標檢測領域的開山之作,由美國工程師Ross Girshick于2013 年提出。采用Selective search[14]方法提取目標圖片的候選區域[7],再利用CNN提取候選區域的特征,完成目標檢測。整個過程分為四步:

1)采用Selective search 對輸入圖像提取約1~2千個候選區域;

2)候選區域wrap(縮放)成統一大小輸入CNN,提取特征;

3)將上一步提取出的特征送入每一類的SVM分類器,判斷是否屬于該類;

4)使用NMS(非極大抑制)排除重疊的候選框,再使用Bounding-box regression(線性回歸模型)修正候選框位置[8]。

RCNN網絡結構如圖1所示。

圖1 RCNN網絡結構圖

RCNN 的創新點:1)采用Selective search 生成候選區域再檢測,降低信息冗余度;2)首次采用CNN 提取特征,特征提取更充分提高了檢測精度。缺點:1)每個候選區域都要通過卷積網絡提取特征,速度較慢;2)wrap操作會改變圖片形狀,對檢測精度產生一定影響。

2.1.2 SSP Net(Spatial Pyramid Pooling Net)

為解決wrap后圖片形狀改變的問題,SSP Net[9]應運而生,它最大貢獻是輸入任意尺寸的圖片都會得到固定大小的輸出。

設計思想是在卷積層與全連接層之間加入某種結構,使得輸出特征滿足全連接層的輸入大小,這個結構就是SSP。RCNN 與SSP Net 的流程對比如圖2所示。

圖2 RCNN與SSP Net流程對比圖

卷積層后加入的SPP 層,可將任意尺寸的輸入按比例轉化為一些固定維度的bin,再對每個bin做池化[10],并輸入全連接層。應用到目標檢測如圖3所示。

圖3 SSP應用于目標檢測示意圖

SSP Net 的創新點:1)加入SSP 層,使得圖片輸入的大小可以是任意尺寸;2)只需對輸入圖片提取一次特征,提高了檢測速度。缺點:相比于RCNN,本質并沒有發生改變,檢測精度沒有很大提升。

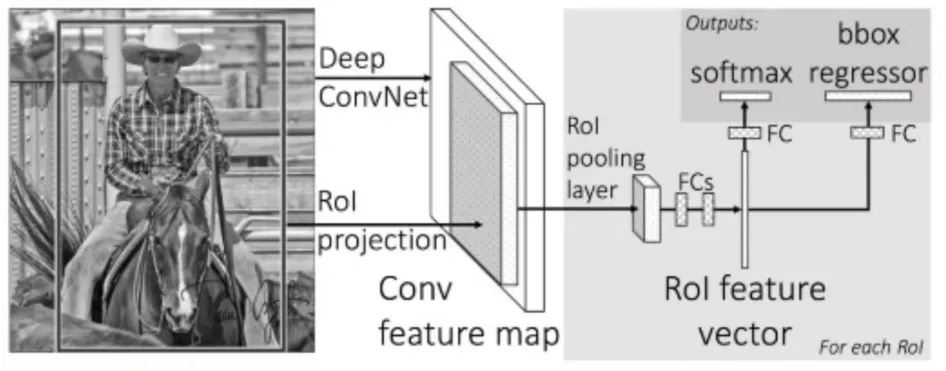

2.1.3 Fast RCNN

Fast RCNN 采用了SSP 的思想對RCNN 進行了改進。圖4給出了Fast RCNN[11]的網絡結構圖。

圖4 Fast RCNN網絡結構示意圖

簡要流程分為四步:

1)采用Selective search提取候選區域[12];

2)將圖片輸入CNN,并把候選區域映射到到conv5的feature map上,輸出卷積特征圖;

3)特征圖中的候選框經過ROI 池化層進行池化得到固定長度的特征向量,輸入全連接層[13];

4)全連接層后分成兩個分支,一個采用softmax做分類;另一個采用Bounding-box regression做定位。

Fast RCNN 創新點:1)卷積層加入了ROI pooling 層(SSP Net 精簡版);2)使用multi-task loss(多任務損失函數),并將Bounding-box regression 加入到CNN 網絡中進行訓練[14];3)使用softmax 分類器代替SVM 分類器;整個檢測過程都在一個網絡中進行(Selective search除外)速度和精度都有了大幅度的提升。

2.2 Faster RCNN設計思想

Fast RCNN 仍然采用Selective search 生成候選區域,耗時耗力。為此,Faster RCNN專門針對這個缺點,在算法中引進了Region Proposal Networks(區域檢測網絡),也就是大名鼎鼎的RPN 網絡,用來替換原來的Selective search 方法,專門用以生成待檢測目標的候選區域[15],同時在算法中加入了新的概念——anchor box。換句話說就是Fast RCNN 使用了一個單獨的卷積神經網絡,專門用來進行候選區域的特征提取,同時將這個網絡與之前的主檢測網絡一起進行大數據訓練與目標檢測,提高訓練效率。

Faster RCNN最大的創新點就是引入了RPN網絡,其本質是通過卷積神經網絡生成候選區域,并輸出目標候選框矩陣及得分[16],網絡示意圖如圖5所示:卷積核就是滑窗,每個滑窗位置對應輸出k個候選框的信息,2k個分類信息,4k個坐標信息。

圖5 RPN網絡結構示意圖

前文及圖中提到的anchor 在本質上是一組形狀、大小均固定的模板或者稱為參考窗格。根據它們的面積比例,首先可以分成三組,面積分別為128*128、256*256、512*512。而在這三種面積中,每一種面積根據長寬比例的不同(1∶1、1∶2、2∶1),又可以分為三組,總共的分類就是九個,如圖6 所示。

圖6 anchor示意圖

對于每一個窗格,可以采用計算anchor的中心點所對應原圖的中心點,可以通過anchor中心點與anchor的大小得到窗格位置同原圖的映射,RPN 網絡可以通過這種映射得到這個anchor 中是否包含待檢測目標。

2.3 Faster RCNN網絡架構

網絡架構如圖7所示。

圖7 Faster RCNN網絡結構圖

Faster RCNN算法具體的檢測步驟如下。

1)網絡結構中的卷積層,首先提取輸入圖片的特征,生成特征圖(feature map),然后將這個特征圖輸入后續的網絡,同時輸入RPN 網絡,使得后續的網絡與RPN網絡共享卷積特征;

2)根據前一步得到的特征圖,RPN網絡生成初步的檢測目標候選區域,同時輸出候選框信息參數;

3)特征圖接下來輸入到網絡中的ROI pooling層,該層對特征圖與上一步RPN 網絡傳輸的候選區域進行池化的操作,并將池化操作后的圖片輸入網絡的全連接層;

4)根據前一步得到的候選區域及特征圖,全連接層對候選區域進行類別分類,接下來進行檢測框的回歸,也就是bounding box regression,然后得到最終檢測框的參數信息,具體為檢測框在圖片上的位置信息與分類的類別得分。

需要特別注意的是,對于網絡的訓練過程,Faster RCNN 需要訓練兩個網絡,一個是用來生產候選區域的RPN 網絡,另一個則是分類網絡;一般情況下采用交替訓練的方法,即在一個batch size中,首先訓練RPN 網絡,再訓練分類網絡。此算法的優點是使用RPN 生成候選區域,減少冗余計算,提升了精度與速度。

3 YOLO V3算法

YOLO V3 是one stage 算法的典型代表,是YOLO(You Only Look Once)系列算法的第三代。其核心思想是將目標檢測問題看做回歸問題求解,檢測速度快是其最大特點。

3.1 前任算法

3.1.1 YOLO V1算法

在YOLO V1[17]中,將圖片劃分成S*S 個網格,每個網格直接預測B 個Bounding boxes 信息,YOLO V1 借鑒了GoogleNet[18]的網絡設計,但用1×1 和3×3 卷積層替代了GoogleNet 中的24 個卷積層和兩個全連接層[19],網絡結構如圖8所示。

圖8 YOLO V1網絡結構圖

YOLO V1的損失函數為

式(1)中x,y,w,h分別代表Bbox 的中心坐標對于網格邊界的相對值以及長寬比例值,S,B代表圖片的網格數以及Bbox 數,判斷第i個網格中第j個Bbox 是否包含檢測對象;判斷是否有物體中心落在第i個網格中;式(1)中前兩行代表坐標預測,第三行分別代表包含物體的box 的置信度預測以及不包含物體的置信度預測,最后一行是類別預測。

YOLO V1 的檢測速度很快,對于背景圖像的誤檢率低,但識別物體的準確度比較差,其將目標檢測看作一個回歸問題求解為目標檢測算法的發展提供了思路。

3.1.2 YOLO V2 算法

針對YOLO V1 的不足之處,YOLO V2[20]做了相應的改進。基礎網絡采用DarkNet-19,包含大量卷積,并采用1*1 卷積核用以壓縮特征,砍掉全連接層,采用anchor的思想等。具體采用的改進方法以及描述如表1所示。

從表1 可以看出,Batch normalization(BN)使得mAP 提高2%,即在卷積后加入BN 層,歸一化下一次卷積輸入的數據。能夠加速訓練收斂,增大了有效迭代次數;采用High Resolution Classifier,提升輸入的分辨率,使得mAP 提升了4%;采用Dimension Clusters 通過k-means 的方式對訓練集的Bboxes 做聚類,以找到合適的anchor box;Direct location prediction 則是采用YOLO 算法中直接預測坐標位置的方式。結合這兩項anchor box 改進方法,mAP 獲得了5%的提升。

表1 YOLO V2技術改進及對應的mAP值一覽表

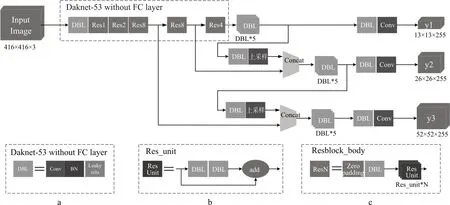

3.2 YOLO V3網絡架構

YOLO V3[21]重新設計了網絡結構,采用logistic取代了softmax 完成對象分類任務,性能的提升。網絡結構圖如圖9所示。

圖9 中下方的a,b,c是為網絡圖做的解釋圖;a中的DBL 是YOLO V3 中的基本組件DBL=卷積+BN+Leaky relu(激活函數);ResN 是YOLO V3 中的大組件,N代表代表有N個Res_unit,具體組成由b,c 所示,基本構件也是DBL;concat 代表張量拼接,將Darket中某一層和后面一層的上采樣進行拼接,擴充張量的維度;整個YOLO V3 模型中沒有池化層和全連接層,張量尺寸的變換是通過改變卷積核來實現的。

圖9 YOLO V3網絡結構圖

3.3 YOLO V3特點分析

YOLO V3 采用多尺度預測以提高檢測精度,如圖9 所示卷積后分為三個尺度:尺度1 在基礎網絡之后,增加了一些卷積層,輸出box 信息;尺度2從尺度1 的DBL 之后經過上采樣再與基礎網絡的特征圖進行張量拼接,卷積后輸出信息;尺度3 與尺度2 類似;并且YOLO V3 采用logistic regression取代softmax 預測類別得分,softmax 的分類基于類別相互獨立,但某類物體可能屬于不同的類別,因此softmax 不適用于多標簽分類,而logistic regression 則預測每個類別的得分,并設定一個閾值,高于閾值分數的就是真正的類別,能夠提升算法的準確度。

YOLO V3 優點:一是基于端到端的網絡模型,簡潔高效,訓練與檢測速度非常快;二是背景誤判率低;三是通用性強,工程上應用廣泛。缺點:一是漏檢率比較高;二是識別物體位置精準性較差。

4 SSD算法

4.1 設計思想

SSD 同時借鑒了Faster RCNN 與YOLO 的設計思想[22]:SSD 借鑒YOLO 中基于回歸的模式,直接回歸出物體的類別和位置;同時采用Faster RCNN中區域的設計思想,生產尺度不一的特征圖用于檢測目標,其中尺度大的特征圖在網絡結構中生成位置比較靠前,對于小目標的檢測效果很好;而尺度比較小的特征圖,在網絡結構中生成位置比較靠后,對于大目標檢測效果很好。除此之外,SSD 還根據尺度與長寬比不同的先驗框進行初步檢測。值得一提的是,這個先驗框,在Faster RCNN中就是前文提到的anchor。

4.2 SSD網絡結構

SSD 的主干網絡結構是VGG16(也可以采取VGG,ResNet,MobileNets等來代替),網絡結構如圖10所示。從圖中可以看出,SSD利用了多尺度特征圖進行目標檢測。

圖10 SSD網絡結構圖

SSD 將VGG16 中最后兩個全連接層及輸出層替換成卷積層,并在最后又額外增加了四個卷積層。這樣一來,就增加了網絡提取目標特征的能力。其中,用于目標檢測的第一個特征圖是由主干網絡VGG16中的卷積層Conv4_3提取得到的,后續五個特征圖,分別是由網絡后續的卷積層提取得到的,網絡中總共提取了6個卷積特征圖,其大小分別是(38,38)、(19,19)、(10,10)、(5,5)、(3,3)、(1,1)不同特征圖設置的先驗框數目不同。各個特征圖的先驗框尺度分別為30、60、111、162、213、264。對特征圖進行卷積操作,得到進一步的檢測結果,檢測結果同其他檢測算法得到的檢測結果類似,包括兩個部分,分別是類別置信度也就是分類分數與檢測邊界框的位置信息,在這些信息的基礎上,再分別采用一個3×3 的卷積來進行優化檢測,最后再使用NMS(非極大抑制值)得到邊界框的最優解。

SSD 創新點:1)采用多尺度特征圖,在SSD 中,不僅在最后一個特征層產生anchor,在之前的幾個高層特征層中也會產生anchor,特征層依次遞減,低層特征對應于細節信息,用以檢測小目標,而高層特征則對應于抽象的語義信息,用以檢測大占比目標,可以使得SSD能夠檢測不同尺度的目標。2)在檢測過程中采用了先驗框的檢測方法,采用大小與長寬比不同的先驗框作為檢測結果中最終檢測框的基準,這種檢測思路在降低了網絡訓練的訓練難度。

缺點:用于小目標檢測的低層卷積僅有一層Conv4_3,因此小目標檢測效果較差。

4.3 改進算法

DSSD[23]是SSD 改進算法中效果最為顯著的一個,在VOOC2007上,mAP值達到了81.5%,fps只有6fps;DSSD基礎網絡采用Resnet-101[24]代替VGG16,提高特征提取能力;并在SSD添加的輔助卷積層后又添加了反卷積層形成“沙漏”結構,對小目標的檢測度上有了很大的提升,圖11 給出了DSSD 的網絡結構圖。

圖11 DSSD網絡結構圖

圖中的淺色部分是在基礎網絡的基礎上添加的輔助層,深色部分是DSSD添加的輔助層,將其反卷積之后并與對應卷積層中的語義信息相融合再送入上面Prediction Module 模塊進行分類回歸,并輸出信息。

創新點是預測模塊和反卷積模塊,預測模塊用于提取更深維度的特征用于分類回歸;反卷積模塊則更充分利用淺層的特征,使小目標和密集目標的檢測率上有很大的提高。

5 結語

基于深度學習的目標檢測算法中,最經典的無異于Faster RCNN、YOLO V3 以及SSD 算法,Faster RCNN 毫無疑問是檢測精度最高的,但速度確比不上其他兩種算法;SSD 速度和精度都不差,但是對小目標檢測效果卻不好;YOLO V3 速度快,易上手,在工業檢測方面應用十分廣泛。目前各類新的算法層出不窮,但是大都是基于經典算法之上改進而來。

雖然目標識別發展迅速,但某些問題仍然得不到很好的解決:比如小目標物體的檢測,由于小目標物體在圖像中分辨率低、信息量少,因此還沒有針對小目標物體檢測效果較好的算法出現。除此之外還有被遮擋的物體、在環境干擾下的目標識別問題等,都是仍然存在的難題。而當目標檢測應用到實際情況中時,如何獲取清晰全面而又高質量、高數量的數據集以滿足訓練模型的需要也是一大難題。

目標檢測技術未來的發展方向:1)應用在生產生活中時如何將能耗降低;2)如何集成化、定制化的應用到不同需求的產業上;3)實際應用中,如何在檢測精度與速度間取得絕佳的平衡等這些都是目標檢測技術的發展方向。