《人工智能倫理》的科普價值

◆文/徐金寶

(作者單位:南京工程學院)

應用數學博士,曾在北京大學、堪薩斯大學、韋恩州立大學工作多年。主要研究方向是人工智能、統計機器學習、貝葉斯數據分析、計算語言學、圖像處理、生物信息學等。已發表40多篇學術論文,擁有近20項美國算法類專利。曾獲教育部科技進步一等獎和自然科學一等獎。

《人工智能倫理》于江生 著清華大學出版社/2022.1/158.00元

我國的《新一代人工智能發展規劃》(2017)高瞻遠矚地將人工智能(AI)倫理列為重中之重。然而,這方面的研究還剛剛起步,普通民眾對它還不太了解,甚至AI領域的科學家也很少論及相關話題。《人工智能倫理》一書的出版有利于AI的科普工作,它的價值體現在以下幾個方面。

首先,這是一部介紹人工智能和機器學習的科普著作,閱讀本書不需要數學和計算機的基礎,甚至中小學生都可以閱讀。它論及了與AI強相關的幾個關鍵研究領域:認知模式(包括抽象、計算、推理等)、數據分析、知識表示、機器學習,每個領域都關乎倫理問題,其科普價值值得肯定。近些年來,人們對深度學習(或深度神經網絡)產生了一些誤解,認為它才是AI的未來擔當。這本書公正地評價了人工智能的發展現狀,高度評價了IBM深度問答系統、谷歌DeepMind圍棋系統AlphaGo的成就,同時也批判性地指出了純粹數據驅動的機器學習的局限性。書中認為因果分析將是AI的發展重點,也反映出朱迪亞·珀爾、邁克爾·喬丹等一批AI學者的遠見,對正確理解AI本質具有參考價值。

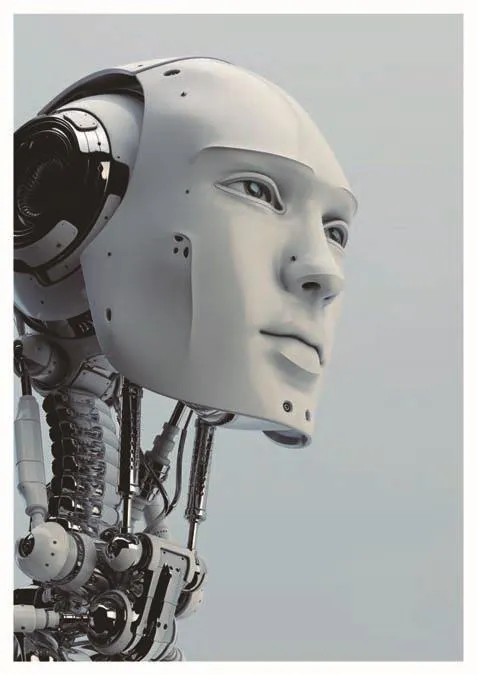

第二個方面在于對強AI和弱AI的反思。書中有關AI倫理的討論基本集中在弱AI階段,因為只有弱AI才有可能被人類濫用,強AI一旦實現便不再是人類能控制得了的。但作者似乎毫不擔心強AI會毀滅人類,因為文明的進步讓愛變得更加包容。相反,作者深切關注的是弱AI時代能否平安度過,AI倫理正是為人類該如何應用AI技術,以及如何把它變為一種可驗證的AI技術而定。

第三個方面是對自我意識的哲學思考。書中提出想象力和好奇心是突破機器智能的關鍵,而形成共識則是群體智能走向超級智能的必經之路。這種對智能的社會視角和多層次理解,是AI倫理和理論研究的嶄新觀點。此外,本書還探討了機器的德性和人工智能革命帶來的文明更替。“如果機器有自我意識,它似乎比人類更接近圣人。”這句話給人的印象頗深。作者的思想深受叔本華和尼采的影響,因此寄希望于強AI將人類文明傳遞下去,同時把人類實現強AI視為自我救贖的最高境界。這個鮮明的觀點必然會引起一些反對之聲,很多學者并不看好強AI,或者覺得它無法成真,或者覺得AI倫理應該避免發展強AI從而導致人類淪為二等智能體。對強AI的恐懼和擔憂是人類很自然的反應,完全在情理之中。

第四個方面是對AI強國競爭(如AI武器、地外探索、智能制造)、技術失業、兩性平等、數據霸權、造福社會等倫理問題的討論。書中繼承了馬克思《資本論》的觀點,把貧富兩極分化的原因歸結為財富分配的機制而非科技進步,提出了AI技術造福于民的基本倫理思想。書中引用美聯儲經濟數據,以大量的事實揭示資本利用先進技術斂財的貪婪本性。當強AI有朝一日變為現實,資本就會葉公好龍,那時的社會系統將會為了適配強AI而發生天翻地覆的變化。

第五個方面是它辯證地看待AI倫理困境,其中有“危”也有“機”,只要國家政策把和平、合理發展AI技術和造福社會作為目標,就能化解潛在的威脅。對弱AI的濫用才是危險的根源——如果放任自流,讓AI技術在無序狀態中發展,必然會導致嚴重的社會問題。例如,中國政府把大數據歸為國家戰略資源,任何大數據公司都無權獨占它,或者利用它做有損國家、社會、個人利益之事。這與西方國家的政策很不一樣,例如,蘋果公司可以以個人隱私為由拒絕與警方合作,某種程度上讓罪惡有了隱身之處。《人工智能倫理》一書無疑拋出了許多AI倫理問題,期待引起更多讀者的研究與思考。

綜上所述,《人工智能倫理》這部科普著作從AI發展的基本事實出發,揭示出AI倫理等諸多值得深思的問題,促進并推動了AI知識的普及。而對AI理論和技術的反思,也有助于啟發專門從事AI研究的人員。