基于改進YOLOv5算法的PCB裸板缺陷檢測

許思昂,李藝杰,梁橋康,楊彬

基于改進YOLOv5算法的PCB裸板缺陷檢測

許思昂1,2,3,李藝杰1,2,3,梁橋康1,2,3,楊彬1,2,3

(1.湖南大學 電氣與信息工程學院,長沙 410082;2.電子制造業(yè)智能機器人技術湖南省重點實驗室,長沙 410082;3.機器人視覺感知與控制技術國家工程實驗室,長沙 410082)

將基于深度學習的YOLOv5算法應用于PCB裸板的缺陷檢測上,以提高檢測的準確率。通過增加特征融合通路,將C2、C3、C4層直接與P2、P3、P4層相連,從而減小信息的損耗;引入更淺層的C2、F2、P2特征圖以增加圖像的細節(jié)信息;并且使用注意力機制SE_block,大幅提高原算法的準確率。改進后的網(wǎng)絡的平均精度由91.54%提高至97.36%,提高了5.82%,并且對于各類缺陷,算法的檢測精度都能保持在90%以上,滿足工業(yè)的需求。文中的算法提高了檢測精度,體現(xiàn)了淺層信息在小目標檢測上的作用,驗證了多信息融合通路的優(yōu)勢,彰顯了注意力機制的優(yōu)越性,相比于原算法具有一定的優(yōu)勢。

PCB裸板;YOLOv5;缺陷檢測;深度學習;目標檢測

傳統(tǒng)印刷電路板檢測是工人借助檢測設備,通過肉眼和經(jīng)驗來檢測目標的一種檢測方法。這種方法因人的主觀因素的存在而產(chǎn)生準確率低、人員成本投入較大等缺點。之后出現(xiàn)了利用元件的電性質來檢測印刷電路板的故障的電檢測法,這種方法相比人工檢測來說減少了成本,但需要元件與檢測器產(chǎn)生電接觸,可能存在損壞元件的問題。

隨著機器視覺的逐漸成熟,機器視覺由于其更低的成本、更高的準確率和效率等優(yōu)勢而被人們逐漸應用于各大檢測現(xiàn)場。目前,基于機器視覺的PCB板缺陷檢測方法[1]主要有三大類:參考法[2]常表示使用圖像分割的檢測方法,如文獻[3]提出通過比較目標與標準圖像的像素來分辨缺陷;非參考法[4]主要指使用機器學習的檢測方法;混合法[5]是同時使用以上2種方法。圖像分割方法包括:基于閾值分割方法的PCB缺陷檢測,如Ardhy等[6]通過自適應的高斯閾值分割,在參數(shù)量較小的情況下實現(xiàn)了快速檢測,但在光線條件不同的地方,檢測效果會有較大變化;基于邊緣分割方法的缺陷檢測,如Baygin等[7]使用Hough變換進行邊緣分割,并結合Canny算子,使檢測效率得到了提高;基于區(qū)域分割的缺陷檢測,如Ma等[8]改進了區(qū)域生長算法,以此獲得了更好的檢測效果。這些方法都需要人工設定模型的參數(shù),無法保證精確度和效率。

近些年卷積神經(jīng)網(wǎng)絡的性能得到了驗證,一系列利用卷積神經(jīng)網(wǎng)絡進行識別的算法應用廣泛,如以高檢測精度著稱的二階段檢測算法(如R–CNN[9]、Faster R–CNN[10])和精度和速度并重的一階段檢測算法(如YOLO[11]、SSD[12])等。相較于傳統(tǒng)的機器學習方法,深度學習的算法網(wǎng)絡更深,非線性能力較強,適用于更多復雜場所,具有更高的魯棒性[13]。其中,在Faster R–CNN的基礎上,賀賢珍[14]提出的一種改進措施,使精度達到了96.91%;耿朝暉等[15]提出一種改進檢測方法,將損失函數(shù)改為focal loss并替換主干網(wǎng)絡為ResNet50,使檢測精度達到了96.65%。但Faster R–CNN算法作為先生成候選區(qū)域,再進行分類的二階段算法,它檢測速度較YOLO算法慢,在實際工業(yè)應用中缺少優(yōu)勢。同時2種算法都采用了FPN特征金字塔的多尺度融合方式,但沒有針對小目標的數(shù)據(jù)集為多個尺度賦予不同的注意力,而是對所有的尺度給予相同的權重。基于以上算法存在的缺陷,文中以YOLOv5算法為基礎,通過構建更淺層的F2、P2層,利用特征提取網(wǎng)絡的C2、C3、C4特征層將它們與最終的P2、P3、P4層相連,并引入注意力機制SE_block,改進對于PCB的檢測算法,在一定程度上減小這些缺點對算法的影響。

1 YOLOv5簡述

YOLO(You Only Look Once)從v1發(fā)展到如今的v5,已經(jīng)發(fā)展為兼顧準確率與速度的算法。根據(jù)網(wǎng)絡深度與寬度的不同,yolov5又可分為s、m、l、x這4個版本。文中采用的算法為YOLOv5s,其結構見圖1。

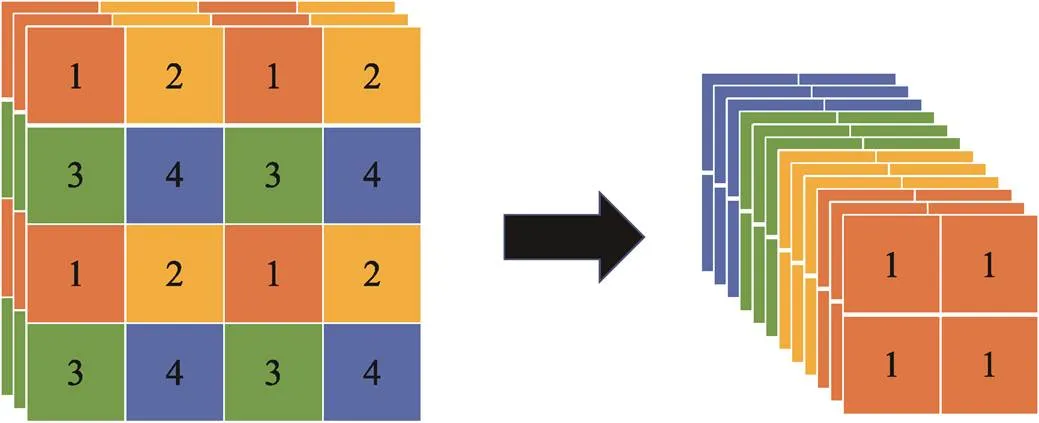

YOLOv5借鑒了跨階段局部網(wǎng)絡[16](Cross Stage Partial Network,CSPNet)的思想,使用CSPdarknet作為主干網(wǎng)絡,并引入了Focus切片結構。Focus在圖片進入網(wǎng)絡前,將其切片為4張圖片,使得三通道的圖片擴展為12個通道,然后將其卷積操作得到最終輸入網(wǎng)絡的特征圖,以此來保留更多的圖像信息。Focus操作過程見圖2。

圖1 YOLOv5結構

圖2 Focus結構

Focus切片后的圖片,經(jīng)過CONV卷積層,對數(shù)據(jù)進行卷積、正則化、激活函數(shù)激活后,通過C3進行殘差塊的堆疊,能夠在減少計算量的同時保持準確,提高模型的學習能力。文中使用的C3及bottleneck的結構見圖3。YOLOv5設計了2種不同的bottleneck結構:使用了殘差邊的bottleneckTrue和不使用殘差邊的bottleneckFalse。這2種結構分別應用于不同的C3中。C3的一部分僅僅通過卷積處理,另一部分經(jīng)過卷積塊和Bottlenect堆疊,與殘差部分按通道拼接后,再經(jīng)過一個CONV模塊得到最終輸出。

圖3 C3結構圖

與YOLOv3不同的是,YOLOv5采用了ReLU的改進版SiLU作為激活函數(shù)。SiLU激活函數(shù)圖像見圖4,SiLU的表達式見式(1)。

在YOLOv3采用的特征金字塔網(wǎng)絡[17](Feature Pyramid Networks,F(xiàn)PN)結構的基礎上,為了增加信息的傳遞通路,減少信息的損耗,YOLOv5與YOLOv4一樣使用了FPN+PANet的結構,見圖5。YOLOv5借鑒了實例分割路徑聚合網(wǎng)絡(Path Aggregation Network for Instance Segmentation,PAnet)[18]的思想,通過加入反金字塔的雙向融合,加強信息在網(wǎng)絡中的流通,實現(xiàn)了3個維度的特征圖的反復融合。

2 文中方法

2.1 整體結構

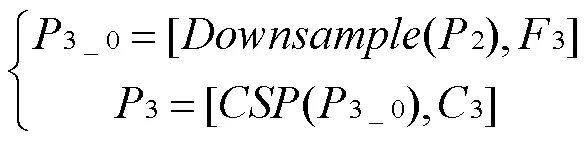

對小目標檢測來說,難點主要在于網(wǎng)絡的加深會引起圖像信息的丟失。在網(wǎng)絡加深的過程中,小目標在特征圖中占據(jù)的像素會越來越小,導致檢測分類的效果不好。針對以上原因,文中考慮將特征提取網(wǎng)絡中的C2、C3、C4層以通道融合的方式直接與P2、P3、P4連接,以此增加信息的傳輸通路,減少信息的損耗;同時構建更淺層的F2、P2模塊并引入注意力機制。最終改動后的特征融合網(wǎng)絡見圖6。

2.2 對特征融合網(wǎng)絡的改進

在FPN中,在主干網(wǎng)絡向深層延伸的過程中,會使用很多個卷積塊。經(jīng)過如此多的網(wǎng)絡層,淺層信息會得到較大的損失,使得網(wǎng)絡對于部分占比較小的目標不敏感導致漏檢。因此,PANet在FPN后添加了一個倒金字塔結構,可以讓淺層的信息經(jīng)過很少的網(wǎng)絡傳到網(wǎng)絡深處。借鑒PANet的思想,文中考慮將YOLOv5的特征提取網(wǎng)絡CSPdarknet的一部分特征層直接與PANet相連,增加信息在網(wǎng)絡中的流通通路,以此減少信息在網(wǎng)絡中的損失。同時隨著網(wǎng)絡的加深,感受野一直增大,主干網(wǎng)絡在不斷進行下采樣的同時,也會損失許多細節(jié)信息。相比深層網(wǎng)絡,淺層網(wǎng)絡由于保留了更多的信息,對小目標更敏感。由于文中所面對的數(shù)據(jù)集主要為小目標,故文中同時也嘗試充分利用淺層信息,引入了更淺層的特征層,將特征提取網(wǎng)絡CSPdarknet中尺度為(160, 160)的特征層與網(wǎng)絡融合,以保留更多細節(jié)。

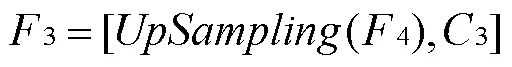

為了方便理解,文中以式(2)的形式表達特征融合過程。

式中:為融合后的特征圖; [ ]表示按通道維度拼接;123為融合的3個特征圖。那么,特征圖3可用式(3)表示。

同理2可用式(4)表示。

圖6中F2、P2特征層及4個SE_block結構為文中改動新增加的結構。特征圖2、3、4可用式(5)—(7)表示它的形成過程。

(7)

圖6 文中數(shù)據(jù)融合結構

其中,CSP表示文中采用的C3結構,其結構見圖1。

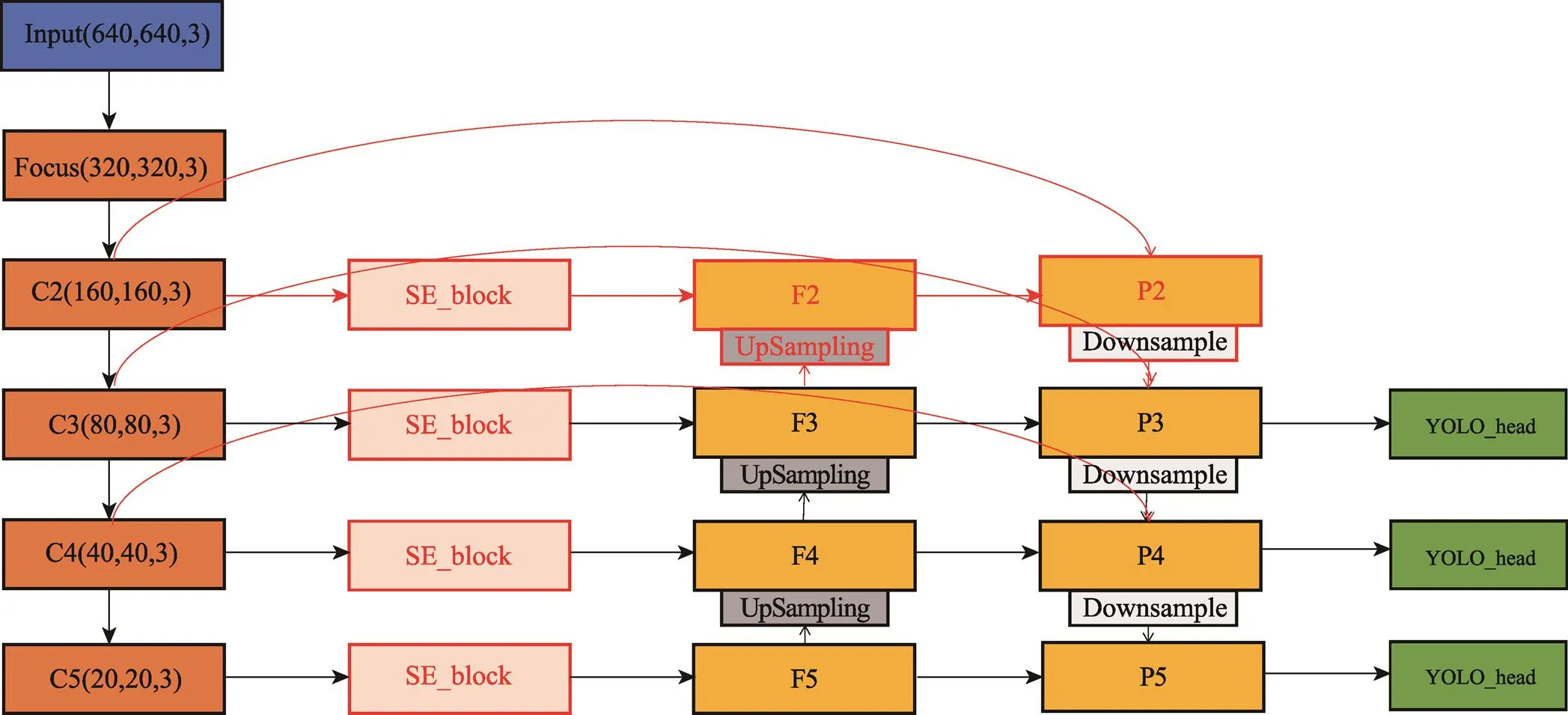

2.3 注意力機制SE_block的引入

當輸入圖片為(640, 640)時,YOLOv5輸出3個不同尺度的預測層分別為(80, 80)、(40, 40)、(20, 20),分別負責預測小、中、大3個不同尺度的目標。而PCB板的缺陷基本局限于小目標上,很少有尺寸較大的目標。因為原網(wǎng)絡給3個不同尺度的輸出層給予了相同的權重,而沒有給不同大小的特征層賦予不同的注意力,所以文中引入了注意力機制SE_Block模塊[19],嘗試通過給不同尺度預測層附加權重來突出占比更高的部分。SE_block結構見圖7。

圖7 SE_block結構

Fsq為壓縮(Squeeze)模塊,將c通過全局平均池化壓縮為一個維度為1×1×的特征向量。

接下來是激勵模塊

1的維度為/,是一個縮放系數(shù),文中將其賦值為16;縮放后分網(wǎng)絡經(jīng)過ReLU激活后進行全連接,恢復通道數(shù)為;之后通過閾值函數(shù)sigmoid得到最終的權重;最后將原輸入特征層乘上得到的權值即可。

3 實驗

3.1 條件

為了驗證文中改動對小目標缺件檢測的有效性和先進性,文中使用CPU為Intel(R) Core(TM) i7–7820X CPU @ 3.60 GHz, GPU為GeForce RTX 2080 Ti,開發(fā)語言為Python,深度學習框架為pytorch的環(huán)境進行實驗。

3.2 數(shù)據(jù)集簡介及PCB板缺陷圖像預處理

3.2.1 PCB圖像簡介

文中采用北京大學智能機器人開放實驗室Ding公開的數(shù)據(jù)集,一共有6種缺陷類型。每張圖片上有3~5個缺陷。表1列出了圖片的張數(shù)和缺陷數(shù)量。

表1 各缺陷圖片數(shù)量及各類型缺陷數(shù)量

Tab.1 Number of defective images and number of defects of each type

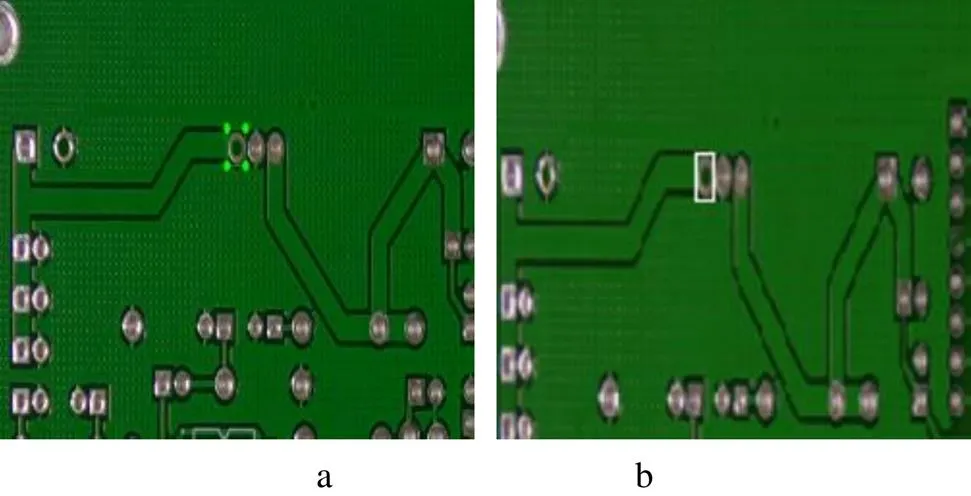

圖8為數(shù)據(jù)集中PCB裸板存在的各種缺陷放大后的圖像,其中框出來的部分是存在缺陷的部分。

3.2.2 數(shù)據(jù)增強

由于使用的數(shù)據(jù)集僅有693張圖片,如果僅僅只用原數(shù)據(jù)集進行訓練,很可能因為數(shù)據(jù)量較小而難以得到好的結果。并且,數(shù)據(jù)集中拍攝的PCB板均為規(guī)整的矩形,傾斜角度較小。若實際使用時PCB板的擺放有傾斜或其他擾動,很可能干擾檢測的結果,同時,使用時的光照等其他條件同樣對檢測結果有影響。所以文中使用隨機數(shù)據(jù)增強,將原數(shù)據(jù)集中的圖片進行隨機的旋轉、水平平移、垂直平移、縮放、水平反轉、對圖像的亮度進行隨機增強等方式,得到擴充后的數(shù)據(jù)集。

圖9為對一張圖片進行數(shù)據(jù)增強得到的一部分結果。由于在對圖片進行數(shù)據(jù)增強的同時,標記框的坐標也會隨之改變。所以要同步變換圖片扭曲后標記框的坐標。改變標記框的數(shù)據(jù)增強示例見圖10。

圖8 6種缺陷類型圖

3.2.3 評價指標

文中采用平均精度(mean Average Precision, mAP)、準確率(Precision)、召回率(Recall)作為評價指標。

當檢測框與真實框的交并比IoU的值大于0.5時,將該樣本記為正樣本(P);反之記為負樣本(P)。將正樣本的數(shù)量與所有檢測出的該類目標的比記為精確度。即:

圖10 改變標記框的數(shù)據(jù)增強示意圖

式中:P為被分為正樣本但實際為負樣本的樣本。

召回率Recall為檢測出的正類與所有正類的比,即:

式中:N為被分為負樣本但實際為正樣本的樣本。

單獨使用精確度或單獨使用召回率都無法客觀地反映檢測結果的好壞,因此,文中使用綜合了2項評價指標的精度指標(Average Precision,AP)來衡量算法的性能。利用不同的精確度和召回率的點的組合,可以畫出PR曲線。AP就是PR曲線下的面積,將所有類別的AP求和后除類別數(shù)即得到平均精度(mAP)。

3.3 消融實驗

文中將訓練集與驗證集的比例設為9∶1,設立4組不同條件的實驗:未改動的YOLOv5、僅改動特征融合網(wǎng)絡的YOLOv5、僅添加注意力機制的YOLOv5和文中算法,通過比較4組實驗的mAP來驗證文中算法的有效性。這4組實驗的mAP見表2。

表2 文中算法與YOLOv5算法精度比較

Tab.2 Comparison between proposed algorithm accuracy and YOLOv5 accuracy

由表2可知,改動后的算法相比原算法,精度得到了大幅提升。這說明改動的算法可以有效的檢測中小目標。這也驗證了前文的猜想,即通過使用淺層信息C2以及增加信息在網(wǎng)絡中的傳遞路徑,可以有效減少信息的損耗,保留小目標的信息。

圖11 檢測結果對比

圖11為改動前后檢測效果的對比圖。從圖11中可發(fā)現(xiàn),針對原版YOLOv5沒有檢測出來的小目標,改動后的算法能將其檢測并標記出來。圖12為該目標的局部放大對比圖。

文中實驗結果見圖13,文中算法可以準確地識別故障類型并在圖片中標記。

圖12 檢測結果局部放大圖

3.4 對比實驗

將文中算法與文獻[14―15]所示算法的平均精度進行對比,結果見表3。

將文中算法與文獻[15]所示算法的不同種類缺陷的AP進行對比,結果見表4。

表3 文中算法與文獻算法平均精度對比

Tab.3 Comparison between average accuracy of proposed algorithm and other algorithms

表4 文中算法與文獻[15]算法各類缺陷精度對比

Tab.4 Comparison between detection accuracy of various defects of proposed algorithm and algorithms in literature [15]

由表4可以看出,除余銅與鼠咬2類文中算法略低于文獻[15]算法外,其余各類精度均更高,彰顯了文中算法的優(yōu)勢。

4 結語

文中提出的基于YOLOv5的PCB板缺陷檢測方法通過增加特征融合通路,并且引入注意力機制SE_block,提升了算法對于印刷電路板的缺陷識別的精度。改進后的模型比原模型更適合小目標的檢測,在6種缺陷上的精度均值均高于90%,滿足工業(yè)的需求。總體來說,文中的方法體現(xiàn)了淺層信息在小目標檢測上的作用,驗證了多信息融合通路的優(yōu)勢,彰顯了注意力機制的優(yōu)越性,相比于其他算法具有一定的優(yōu)勢。

[1] 董靜毅, 呂文濤, 包曉敏, 等. 基于機器視覺的PCB板表面缺陷檢測方法研究進展[J]. 浙江理工大學學報(自然科學版), 2021, 45(3): 379-389.

DONG Jing-yi, LYU Wen-tao, BAO Xiao-min, et al. Research Progress of the PCB Surface Defect Detection Method Based on Machine Vision[J]. Journal of Zhejiang Sci-Tech University (Natural Sciences Edition), 2021, 45(3): 379-389.

[2] 陳殊. 探析基于圖像處理的PCB缺陷檢測技術及其重要性[J]. 數(shù)字技術與應用, 2016(10): 64-65.

CHEN Shu. Analysis of PCB Defect Detection Technology Based on Image Processing and Its Importance[J]. Digital Technology and Application, 2016(10): 64-65.

[3] 王家宏. 基于圖像處理的印制電路板缺陷檢測研究[J]. 通訊世界, 2017(4): 175-176.

WANG Jia-hong. Research on Defect Detection of Printed Circuit Board Based on Image Processing[J]. Telecom World, 2017(4): 175-176.

[4] 劉百芬, 李海文, 張姝穎, 等. 基于機器視覺PCB裸板缺陷自動檢測研究[J]. 工業(yè)控制計算機, 2014, 27(10): 7-8.

LIU Bai-fen, LI Hai-wen, ZHANG Shu-ying, et al. Automatic Defect Inspection of PCB Bare Board Based on Machine Vision[J]. Industrial Control Computer, 2014, 27(10): 7-8.

[5] MOGANTI M, ERCAL F. Automatic PCB Inspection Systems[J]. IEEE Potentials, 1995, 14(3): 6-10.

[6] ARDHY F, HARIADI F I. Development of SBC Based Machine-Vision System for PCB Board Assembly Automatic Optical Inspection[C]// 2016 International Symposium on Electronics and Smart Devices (ISESD), Bandung, Indonesia, 2016: 387-393.

[7] BAYGIN M, KARAKOSE M, SARIMADEN A. Machine Vision Based Defect Detection Approach Using Image Processing[C]// 2017 International Artificial Intelligence and Data Processing symposium (IDAP), Malatya, Turkey, 2017: 1-5.

[8] MA J. Defect Detection and Recognition of Bare PCB Based on Computer Vision[C]// 2017 36th Chinese Control Conference (CCC), Dalian, China, 2017: 11023-11028.

[9] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich Feature Hierarchies for Accurate Object Detection and Semantic Segmentation[C]// Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2014: 580-587.

[10] GIRSHICK R. Fast R-Cnn[C]// Proceedings of the IEEE International Conference on Computer Vision, 2015: 1440-1448.

[11] REDMON J, DIVVALA S, GIRSHICK R, et al. You only Look Once: Unified, Real-Time Object Detection[J]. Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2016, 2016-December: 779-788.

[12] LIU WEI, ANGUELOV D, ERHAN D, et al. SSD: Single Shot MultiBox Detector[C]// European Conference on Computer Vision, Springer, Cham, 2016: 22-37.

[13] 盧榮勝, 吳昂, 張騰達, 等. 自動光學(視覺)檢測技術及其在缺陷檢測中的應用綜述[J]. 光學學報, 2018, 38(8): 23-58.

LU Rong-sheng, WU Ang, ZHANG Teng-da, et al. Review on Automated Optical (Visual) Inspection and Its Applications in Defect Detection[J]. Acta Optica Sinica, 2018, 38(8): 23-58.

[14] 賀賢珍. 基于深度學習的焊點缺陷圖像檢測研究[D]. 綿陽: 西南科技大學, 2021: 30-38.

HE Xian-zhen. Research on Image Detection of Solder Joint Defects Based on Deep Learning[D]. Mianyang: Southwest University of Science and Technology, 2021: 30-38.

[15] 耿朝暉, 龔濤. 基于改進Faster R-CNN的PCB板表面缺陷檢測[J]. 現(xiàn)代計算機, 2021(19): 89-93.

GENG Zhao-hui, GONG Tao. PCB Surface Defect Detection Based on Improved Faster R-CNN[J]. Modern Computer, 2021(19): 89-93.

[16] WANG C Y, LIAO H Y M, YEH I H, et al. CSPNet: A New Backbone that can Enhance Learning Capability of CNN[C]// IEEE Conference on Computer Vision and Pattern Recognition Workshop, 2020: 1003-1012.

[17] LIN T Y, DOLLáR P, GIRSHICK R, et al. Feature Pyramid Networks for Object Detection[C]// IEEE Conference on Computer Vision and Pattern Recognition, 2017: 2117-2125.

[18] DENG J, DONG W, SOCHER R, et al. 2009 IEEE Conference on Computer Vision and Pattern Recognition[C]// IEEE Conference on Computer Vision and Pattern Recognition, 2018: 8759-8768.

[19] HU Jie, SHEN Li, SUN Gang.Squeeze-and-Excitation Networks[C]// IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2018, 42(8): 7132-7141.

Bare PCB Defect Detection Based on Improved YOLOv5 Algorithm

XU Si-ang1,2,3,LI Yi-jie1,2,3, LIANG Qiao-kang1,2,3, YANG Bin1,2,3

(1. College of Electrical and Information Engineering, Hunan University, Changsha 410082, China; 2. Hunan Key Laboratory of Intelligent Robot Technology in Electronic Manufacturing, Changsha 410082, China;3. National Engineering Laboratory for Robot Vision Perception and Control Technologies, Changsha 410082, China)

The work aims to apply YOLOv5 algorithm to defect detection of bare PCB, so as to improve detection accuracy. Feature fusion path was added to directly connect layers C2, C3 and C4 with layers P2, P3 and P4, so as to reduce the loss of information. Shallower C2, F2 and P2 feature images were introduced to increase the details of the image. Moreover, the attention mechanism SE_block was used to improve the accuracy of the original algorithm. The average accuracy of the improved network increased from 91.54% to 97.36%, with a growth of 5.82%. For all kinds of defects, the algorithm could keep a detection accuracy above 90%, which met the needs of industry. The proposed algorithm improves the detection accuracy, reflects the role of shallow information in small target detection, verifies the advantages of multi-information fusion pathway, and highlights the advantages of attention mechanism. Compared with the original algorithm, the proposed algorithm has certain advantages.

bare PCB; YOLOv5; defect detection; deep learning; object detection

TP391.4

A

1001-3563(2022)15-0033-09

10.19554/j.cnki.1001-3563.2022.15.004

2022–04–21

許思昂(2000—),男,湖南大學本科生,主攻仿生機器人運動控制與決策。

梁橋康(1986—),男,博士,湖南大學教授,主要研究方向為仿生機器人運動控制與決策。

責任編輯:曾鈺嬋