一種面向高分辨率衛星影像語義分割的雙分支遷移神經網絡

黃 磊 程鐵洪

(中國電建集團江西省電力設計院有限公司,江西 南昌 330096)

0 引言

近年來,高分辨率衛星遙感影像的使用越來越普及,使得基于高分遙感影像的解譯和地物提取在土地資源管理、城市規劃和環境保護等許多領域的應用中發揮著越來越重要的作用[1-3]。高分辨率影像在提供更加豐富的地表細節信息的同時,也給影像分類帶來了更多的挑戰[4]。

僅使用光譜特征難以描述影像中完整的語義信息,傳統的衛星影像解譯方法主要使用人工設計的影像特征[5-6],但是空間分辨率的提高使得特征類內方差變大、類間方差變小,對地物的識別能力下降[7]。

近年來,隨著硬件發展和深度學習方法的普及,基于深度學習的影像語義分割網絡[8-9]在多個領域得到廣泛關注。卷積神經網絡通過多層卷積逐步提取地物的語義描述,提取的深度特征被許多研究者證實優于傳統人工設計的特征[10]。但是深度學習方法需要大量的樣本[11],而樣本的獲取往往需要大量的人力進行標注。為此,研究者們構建了大量標準數據集,這些數據集基本是由紅-綠-藍三個可見光波段影像組成,因此基于此構建的神經網絡無法直接用于處理更多波段的衛星影像。為此,許多研究者直接將網絡模型的輸入層進行擴展以處理更多的波段,雖然成功利用了多波段影像,但是破壞了原有的網絡結構,導致需要完全重新訓練網絡,不僅浪費了計算機視覺領域通過大量樣本訓練的網絡成果,同時也需要構建專門的遙感影像海量樣本庫[12]。

針對這個問題,本文提出了一種面向高分辨率衛星影像語義分割的雙分支遷移神經網絡,一個分支輸入可見光影像,另一個分支輸入其他波段影像。本文將殘差網絡(residual network,ResNet)進行遷移,將ResNet-101[13]的網絡結構和其對應的參數遷移到其中的可見光分支,在訓練時僅更新深層的網絡參數而保持淺層參數不變。另一個分支采用ResNet-50[13]網絡結構,整個網絡參與參數的更新。

1 本文方法

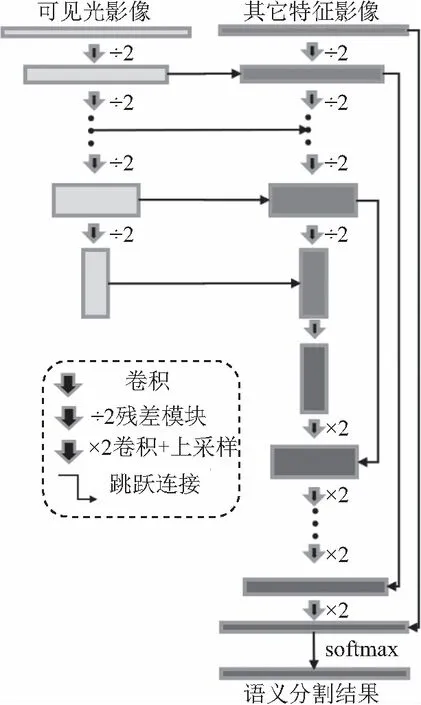

本文提出的網絡基本框架見圖1,該框架為全卷積網絡[14]。縱向來看網絡分為編碼器和解碼器兩部分,橫向來看編碼器有兩個輸入分支。兩個輸入分支通過跳躍連接[15]相連,同時解碼器和編碼器也通過跳躍連接相連。編碼器主要通過殘差模塊進行特征提取,而解碼器通過卷積和上采樣逐步提高特征的分辨率,直至得到原始分辨率的語義分割結果。

1.1 編碼器

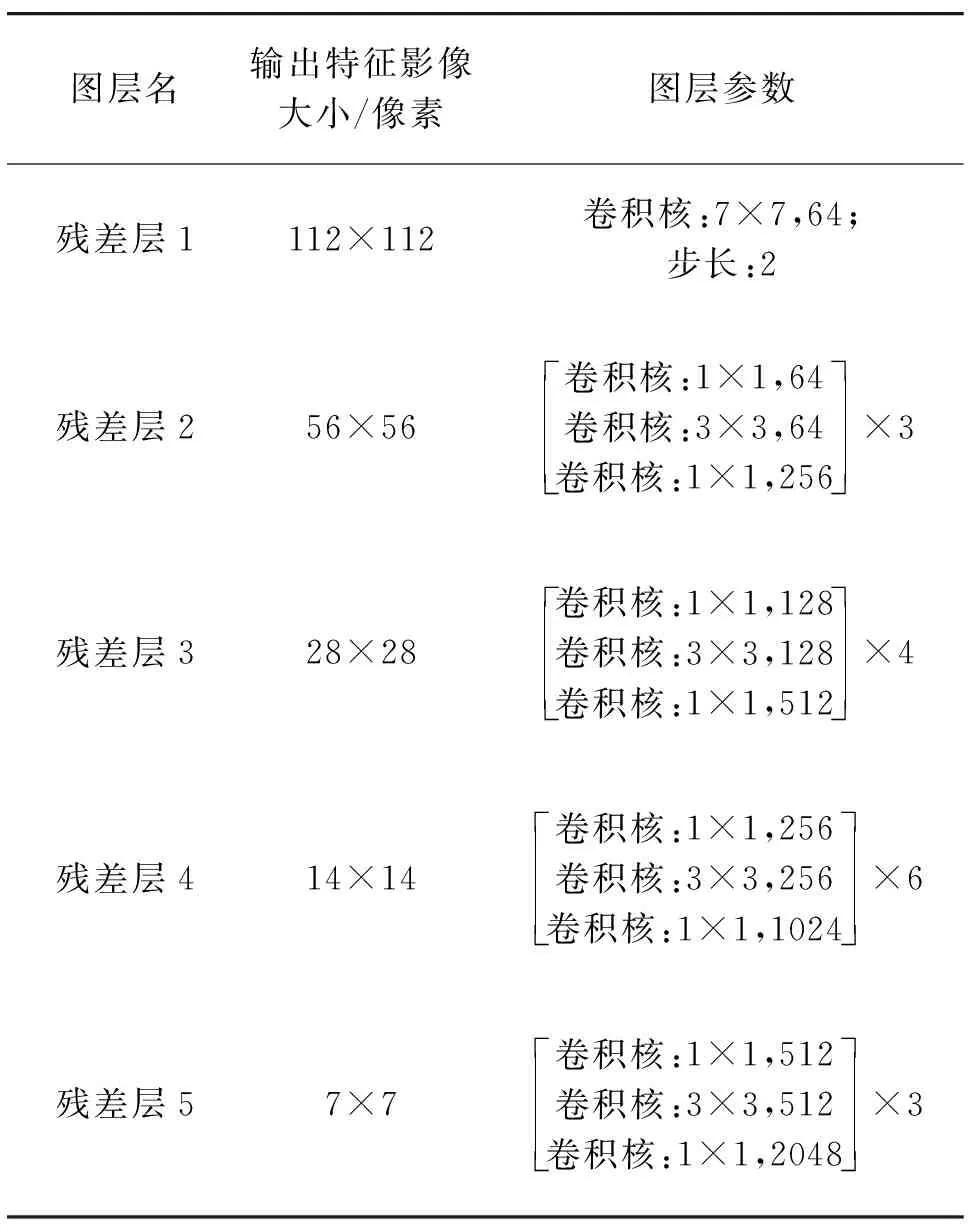

如圖1所示,橫向看編碼器,有兩個輸入分支,一個分支輸入紅-綠-藍的三波段可見光影像,另一個分支輸入其他波段,不同分支之間通過跳躍連接相連。可見光分支采用殘差網絡RseNet-101的骨干框架,表1是ResNet-101骨干網絡的參數。

圖1 本文提出的網絡框架

其他特征影像輸入分支仍然是殘差結構[16],為了降低訓練難度和對訓練樣本的要求,此分支采用ResNet-50的骨干網絡,表2是ResNet-50骨干網絡的參數。

表1 ResNet-101骨干網絡參數

表2 ResNet-50骨干網絡參數

可以看出,兩個分支的結構基本相同,主要是“殘差層4”層,Resnet-50的殘差模塊較ResNet-101少了17個,由于一個殘差模塊由三個卷積組成,故總共少了51個卷積。每個圖層輸出的特征影像大小是相同的,因此可以通過跳躍連接直接進行合并,將可見光分支圖層輸出的特征影像直接合并到其他特征影像分支對應的圖層之后,并將合并結果作為其他特征影像分支下一個圖層的輸入。

1.2 解碼器

縱向來看網絡分為編碼器和解碼器兩部分。編碼器通過卷積網絡逐層提取多尺度特征,解碼器通過上采樣逐層恢復特征影像分辨率,同時對應尺度層之間通過跳躍連接相連。由于通常網絡淺層的特征細節信息豐富而網絡深層特征影像語義信息豐富,因此通過跳躍連接可以使解碼器獲取不同粒度的特征信息,得到高精度的語義分割結果[15]。

由于編碼器兩個分支也通過跳躍連接相連,因此其他特征影像分支每個圖層輸出的特征實際上包含了影像所有的波段特征,因此解碼器只需要與其他特征影像分支里每個圖層的輸出結果相連即可。

1.3 網絡訓練與精度評價

本文提出的網絡最大的優點在于不需要訓練所有的分支,而僅需要訓練其他波段分支和可見光分支靠后的卷積層。這是由于可見光分支可以將計算機視覺領域被廣泛使用的高精度ResNet-101分類網絡直接進行遷移[17],而不需要再對該網絡全部進行訓練。深度神經網絡淺層通常是低級視覺特征,這部分特征是遙感影像和普通可見光影像所共有的特征,可以直接進行遷移,而深層的網絡則包含高級的語義特征,需要重新訓練。

語義分割網絡訓練完成后,需要進行精度評定。本文使用兩種精度指標來評價網絡的分類性能,一種是F1分數(F1-score),用于評價網絡對不同地物的分類能力;另一種是總體精度,用于評價網絡整體的分類能力。

(1)

其中

(2)

對于某個地物的分類而言,精確率(Rp)是指分類正確的像素個數與所有分類為該地物的像素個數的比值;召回率(Rr)指分類正確的像素個數與該地物實際像素個數的比值,那么F1-score為

(3)

2 實驗與分析

2.1 實驗數據與方法

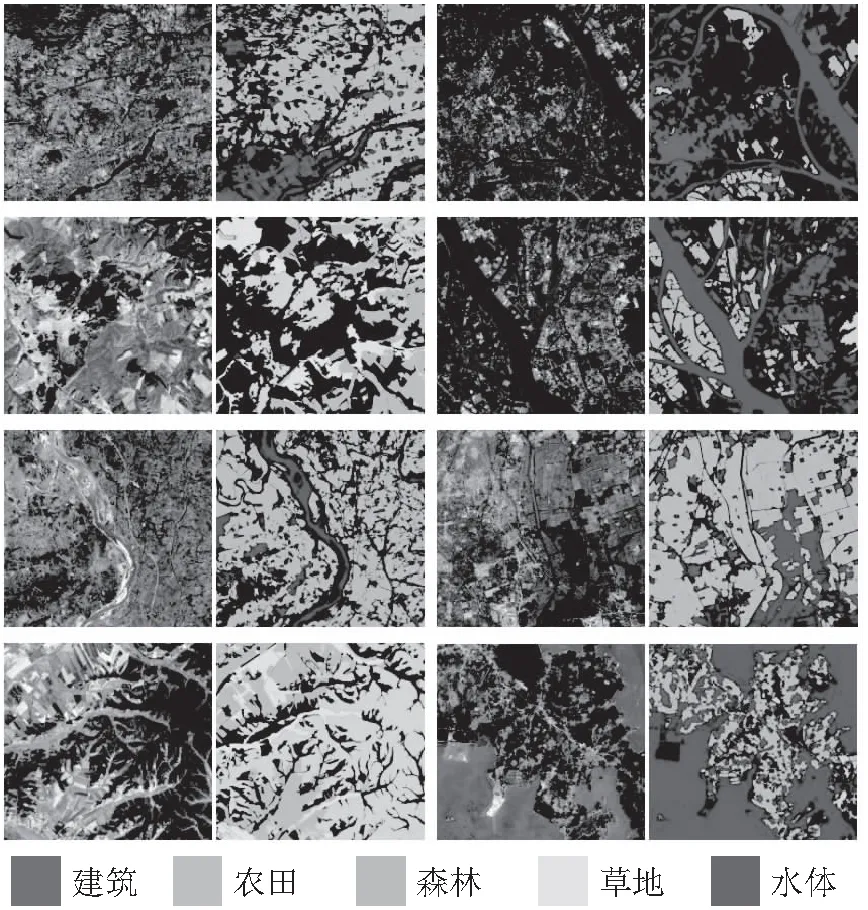

實驗使用的是武漢大學提供的高分二號衛星影像數據集(Gaofen image dataset,GID)。GID包含了150幅帶有真實標注的多光譜影像,影像包含四個波段,分別是藍色(0.45~0.52 μm)、綠色(0.52~0.59 μm)、紅色(0.63~0.69 μm)和近紅外(0.77~0.89 μm),影像分辨率為4 m。圖2顯示了8幅樣例數據,GID數據集中標注了建筑、農田、森林、草地和水體五個類別,分別用紅色、綠色、青色、黃色和藍色進行標記,對于沒有標注的區域用黑色標記。圖3顯示了某典型區域的真彩色影像(紅-綠-藍波段)和彩色紅外影像(紅外-紅-藍波段)。

圖2 GID數據集樣例數據

為了驗證本文提出方法的精度和效率,將本文提出的網絡與其他兩種經典網絡進行了對比,分別是ResNet-50和ResNet-101[13]。本實驗直接將原始的網絡的輸入影像波段數改為4,其他的網絡結果不變。三種網絡皆通過GID數據集進行訓練和測試,其中100幅影像用于訓練,50幅影像用于測試。

實驗使用的操作系統為Windows-10,采用Tensorflow2.4作為深度學習框架,訓練的ResNet-50和ResNet-101網絡皆由Tensorflow官方提供,顯卡為一塊NVIDIA Geoforce 2080Ti。

2.2 實驗結果與分析

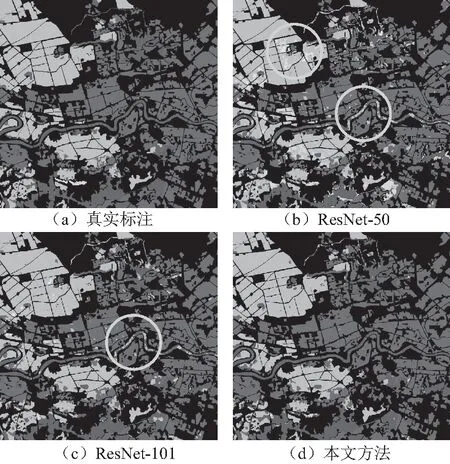

圖4顯示不同方法對圖3區域的分類結果,可以發現本文方法分類錯誤的區域少于其他兩種網絡,如圖4(b)和圖4(c)中灰色圓圈內的分類錯誤區域在圖4(d)中基本被分類正確,同時圖4(b)和圖4(c)的建筑區域有一些細碎的區域被分為了綠色農田。

圖3 典型區域的真彩色影像(紅-綠-藍波段)和彩色紅外影像(紅外-紅-藍波段)

圖4 三種網絡的分類結果

表3顯示了三種網絡的量化精度評價,本文提出方法的總體精度更高,同時迭代次數最少,訓練時間也最短。這是由于本文使用遷移學習方法,直接使用大量數據訓練的RensetNet-101網絡處理可見光波段,充分利用了先驗知識,因此用較少的迭代次數和訓練時間就可以取得高精度分類結果。

表3 三種網絡的精度評價

為了驗證樣本數量對網絡精度的影響,本文設計了五組樣本對三種網絡進行訓練,訓練樣本數目分別是10、40、70、100、130,得到的總體精度見表4。可以發現,在樣本充足的情況下,本文提出方法的精度相較ResNet-101提升不明顯,但是當樣本數量較少時,ResNet-50和ResNet-101精度劇烈下降。當樣本數量只有10時,ResNet-50和ResNet-101總體精度不足0.7,而本文方法仍有0.791,說明本文方法可以適應樣本數量較小的遙感影像分類的應用。

表4 不同樣本數量的精度評價

3 結束語

為了降低基于深度學習的遙感影像語義分割對樣本數量的要求,充分利用已被大量數據集訓練的經典網絡的參數,本文提出了一種面向高分辨率衛星影像語義分割的雙分支遷移神經網絡,一個分支輸入可見光影像,基于遷移學習方法將殘差網絡ResNet-101的網絡結構和其對應的參數遷移到其中可將光分支,在訓練時僅更新深層的網絡參數而保持淺層參數不變;另一個分支輸入其他波段和特征影像,采用ResNet-50網絡結構,整個網絡都參與參數的更新。通過武漢大學提供的高分二號衛星影像數據集上對本文方法、ResNet-50和ResNet-101進行實驗對比,證明了本文方法的在訓練影像充足時,分類精度較ResNet-50和ResNet-101略有提高,同時僅需較少的訓練收斂次數和訓練時間;在訓練樣本不足時,本文方法分類精度較ResNet-50和ResNet-101有明顯提升,說明本文方法可以適應樣本數量較小的遙感影像分類的應用。