基于局部特征描述的圖像匹配方法分析

付苗苗,杜光星(通信作者)

(1洛陽師范學院信息技術學院 河南 洛陽 471000)

(2武漢理工大學計算機與人工智能學院 湖北 武漢 430070)

0 引言

圖像匹配用于幾何對齊傳感器在相同或不同時間從不同視點拍攝的同一場景的多個圖像,是圖像處理中的一項最重要且最基礎的任務。圖像匹配不僅廣泛應用于圖像分類與檢索、圖像拼接以及3D重建等計算機視覺任務中,還應用于人臉識別和指紋解鎖等實際工程應用中。圖像匹配方法分為基于區域的方法和基于特征的方法2種類型[1]。基于區域的圖像匹配方法處理圖像用于檢查參考圖像和感測圖像之間像素的相似性,而無需使用優化算法檢測顯著特征。但該方法會受到強度分布、光照變化和噪聲引起的幾何變形的影響,具有局限性。而基于特征的圖像匹配方法直接使用從兩幅圖像中提取的顯著特征匹配,不受圖像強度值影響,更適合光照變化和復雜的幾何變形。基于特征的圖像匹配由于其靈活性、魯棒性和廣闊的應用前景而受到國內外科研工作者的廣泛關注。

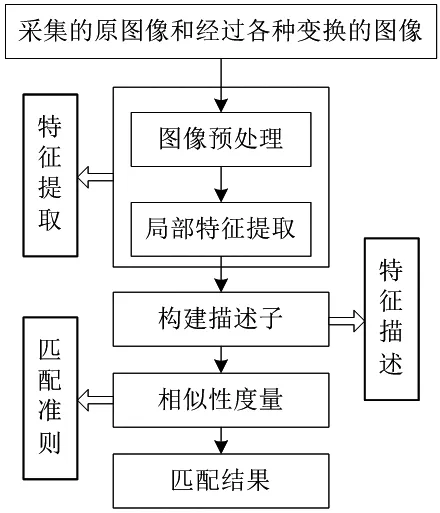

由于深度學習技術在深度特征獲取和非線性表達方面具有強大能力,常被應用于圖像信息表示或相似性度量,是當前圖像匹配任務中的熱點話題。與傳統方法相比,基于深度學習的圖像局部特征描述已被證明具有更好的匹配性能和更大的潛力。一般基于局部特征描述的圖像匹配方法通常分為如圖1所示的3個步驟。

圖1 基于局部特征描述的圖像匹配方法流程圖

文章全面客觀的比較與分析當前主流傳統經驗驅動的基于手工設計的圖像局部特征描述方法和由數據驅動的基于深度學習的圖像局部特征描述方法,總結圖像局部特征描述的現狀,以期為未來該領域研究者給出一定的參考。

1 手工設計的圖像局部特征描述方法

1.1 基于梯度的圖像局部特征描述方法

基于梯度的圖像局部特征描述方法因在多種應用中均有良好性能表現而受到研究者的廣泛關注,其中最具有代表性的是Lowe[1]在1999年所發表,并在2004年得到修正完善的尺度不變特征變換(Scale-invariant feature transform,SIFT)方法。該方法將獲取的支撐區域劃分成4×4的子區域,并對每個子區域中的直方圖進行統計,然后將這些直方圖串連并進行歸一化得到一個128維的特征描述向量,即為SIFT描述子(如圖2所示),其在視角變化、尺度變化、旋轉變化等多種圖像變化的圖像上表現出較強的區分性。但該描述子在場景較復雜的圖像上表現的匹配性能不佳。王志衡等[2]受到SIFT描述子鄰域位置劃分思想的啟發而提出了直線特征描述子MSLD,接著又將其應用到曲線特征描述當中,從而獲得了曲線特征描述子MSCD。MSLD(如圖3所示)和MSCD描述子分別解決了因直線和曲線長短不一而造成直線與曲線無法統一描述的問題,但在視角變換圖像上,圖像變形會使區域形狀發生畸變,從而導致描述子匹配能力下降。陳璐璐等[3]通過采用梯度序映射的方法獲得描述子GOCD,該描述子是基于全局梯度幅值級來劃分子區域和局部梯度序映射的,因此其不但能夠克服因采用固定形狀來劃分子區域的相關算法而產生的邊界誤差缺陷問題,還能克服因圖像遮擋而造成的錯誤匹配問題,但存在匹配速度較慢的缺陷。

圖2 SIFT描述子

圖3 直線特征描述子MSLD

1.2 基于亮度的圖像局部特征描述方法

基于圖像亮度的圖像局部特征方法用于比較不同位置采樣的像素的亮度,目前許多方法都是使用像素值的順序而不是原始亮度來設計的,亮度對旋轉和單調的強度變化是具有不變性的,它還將有序信息編碼到描述符中,同時可以保持描述子的旋轉不變性,而無需估計參考方向(如SIFT),這是大多數現有方法的主要誤差源。智珊珊等[4]受到根據亮度序映射來對子區域進行劃分的思想啟發而提出了局部特征描述子IOCD,該方法在旋轉變化、視角變化、光照變化、噪聲變化等多種圖像變化上表現出較強的區分性和良好的匹配性能。但若圖像上存在遮擋或陰影情況時,根據亮度序映射來劃分子區域時會出現子區域錯誤劃分的狀況,從而導致不正確的匹配。王志衡等[5]在MSCD的基礎上,通過將亮度序劃分子區域的方法引入而提出了描述子IOMSD,該算法是根據全局梯度幅值序列和亮度序映射構建的,該算法原理簡單、穩定,但在弱紋理圖像上并不適用。江燕等[6]在已有的IOMSD和IOCD基礎上,通過將重疊亮度序劃分的思想引入而提出曲線特征描述子OIOMSD和OIOCD,兩個算法在一般的變換圖像上表現出較強的區分性和良好的匹配性能,特別是OIOCD在非線性光照變化圖像上表現出更好的區分性和魯棒性,但對尺度變化并不適用。

1.3 基于局部二值模式的特征描述方法

近年來,隨著大量實時系統和嵌入式設備的廣泛應用,對空間占用小和匹配速度高的描述子的需求越來越高,因此該領域相關的研究人員也提出了許多存儲空間占用更少與匹配速度更快的二值描述子。LBP需要根據給定圖像塊的LBP特征,在像素距離r處將像素的灰度亮度與相鄰像素k的灰度亮度進行比較,可以從比較中獲得表示感興趣點處灰度亮度與其每個相鄰點灰度亮度之間關系的二元向量,該方法具有在旋轉變化和灰度上具有較強的區分性等優點,但其不僅會在運算時產生較長的直方圖,而且在平面圖像區域中魯棒性不明顯。Huang等[7]提出了BGP,在局部區域提取結構梯度模式作為二值描述子,BGP及其增強的BGPM對各種變化具有魯棒性。Liu等[8]提出了BDVRP,該算法是通過聯合引入的局部梯度特征信息和灰度特征信息來對關鍵點周圍的特征信息進行描述表達。以上幾種描述子都是基于局部二值模式統計信息進行確定的。

二值描述子的另一種形式是基于局部特征信息的比較,其核心是比較選擇規則。Calonder等[9]提出了BRIEF,該算法是通過圖像拼接中幾個隨機點對強度的二進制測試結果串聯而成。Gao等[10]提出了LTD,與BRIEF相比,LTD引入了一個閾值,將兩個像素的差異描述為三個值,與BRIEF相比,其可分辨性更高,同時對圖像變形更具有魯棒性。這些二值型描述子占有更少的存儲空間且擁有更快的匹配速度,極大地促進了相關應用的發展。

1.4 基于深度學習的圖像局部特征描述方法

隨著深度學習在圖像識別任務中的不斷成功,近年來,利用深度學習進行圖像局部特征描述和匹配的嘗試也顯示了巨大的機遇。基于深度學習的圖像局部特征描述方法其實可以當做是對基于學習方法的擴充。Tian等[11]提出了基于不帶度量學習層的全卷積結構的CNN模型L2-Net(如圖4所示),并在訓練過程中比較了所有正樣本和負樣本之間的距離,這大大超過了以前的方法的性能,進而表明L2-Net可以作為現有手工描述子的直接替代。Mishchuk等[12]提出了HardNet,在訓練時只考慮一批訓練數據中正樣本與最難分辨的負樣本之間的距離,進一步提高了網絡的匹配性能。霍占強等[13]通過直接從原圖像塊中進行訓練學習而獲得了直線特征描述子,并在相關實驗中取得了良好的性能,但由于構造的訓練樣本缺乏多樣性,該方法對遮擋和低紋理變化較為敏感。

圖4 L2-Net網絡架構圖

2 結語

圖像局部特征描述作為圖像匹配技術當中的核心算法已被廣泛應用于3D重建、智慧安防、視頻導航、指紋解鎖、零件自動檢測和質量檢測等視覺和實際工程領域當中。局部圖像特征描述方法是把局部區域描述成一個具有唯一性的特征描述子。一個魯棒的描述子應該對于匹配塊不會因為視角、光照、旋轉、模糊和噪音等的變化而變化,同時對于非匹配塊要保持不同圖像塊之間的區分性。

在過去的幾十年里,相關研究人員在這一領域也取得了重大進展。因此本文對現有的圖像局部特征描述方法(從手工設計到可訓練的)進行了全面的回顧,以便為該領域的研究人員提供更好的參考和理解,本文做了以下總結:

(1)在實際的應用過程中,常常遇到復雜且多樣的圖像變換情況,而傳統經驗驅動的基于手工設計的圖像局部特征描述方法在面對復雜環境時,已經無法取得令人滿意的結果,并且基于手工設計的方法幾乎接近瓶頸。

(2)近年來,深度學習在諸多視覺任務中也成功地展現出了其具有強大的函數擬合能力。而局部圖像特征描述算法的本質任務也是設計一個復雜的函數映射使得相同物理的局部圖像輸出距離相近的特征向量,同時保證不同物理的局部圖像輸出距離較大的特征向量。因此,為了能夠充分利用深度學習的強大學習能力,基于深度學習設計局部圖像特征描述算法以獲得更加強區分性的特征描述子也是研究發展的必然趨勢。

(3)但是數據驅動的基于深度學習的圖像局部特征描述方法也有一些不足之處。該類方法的缺陷表現為:訓練樣本缺乏多樣性且泛化的問題,如今不能獲得具有普遍且通用的數據集,因此導致在面對訓練數據集中未出現的場景圖像時具有較強的敏感性。這其實是圖像局部特征描述方法的最大且重要的問題之一。與此同時,由于加入深度學習而加大了計算量,一部分方法需要加入大量的運行內存、性能較好的CPU以及顯存較高的GPU,然而這對低功耗與實時性要求較為嚴格的領域便顯得更加明顯。

(4)近年來,隨著深度遷移學習、圖神經網絡以及多任務學習的不斷深入發展,不僅可以看到解決訓練樣本不足且多樣性問題的曙光,還可看到局部特征描述與圖像匹配使用一個框架來解決的曙光。