弱對齊的跨光譜人臉檢測

閆夢凱 錢建軍 楊 健

眾所周知,可見光人臉圖像中含有豐富的面部紋理、顏色等細節信息,然而紅外人臉圖像中含有面部熱信息,跨光譜人臉圖像能夠將兩者的優點相結合,彌補各自的不足.另外,熱紅外相機能夠采集人臉面部的溫度信息,可用于快速推算人體體溫,這在公共場所的體溫篩查任務中有著重要的應用價值.

在實際應用中,跨光譜圖像的人臉檢測是必不可少的過程.可見光圖像中的人臉檢測較為容易,紅外圖像中的人臉檢測較難.原因是紅外圖像人臉的表征很弱,不同場景下采集的紅外圖像差異較大.如果分別對可見光圖像和紅外圖像進行人臉檢測又需要耗費雙倍的時間和計算資源.

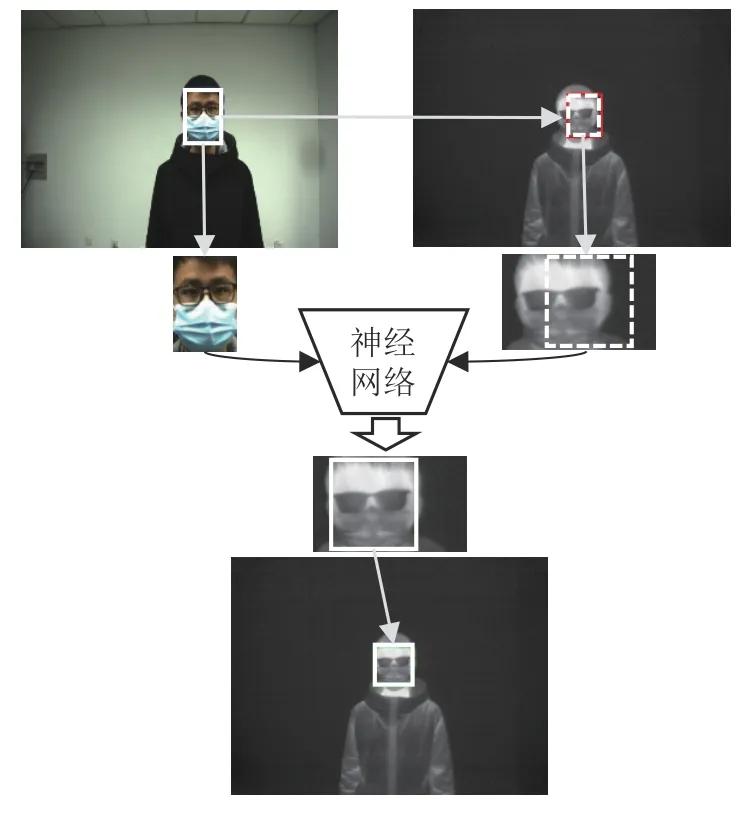

為了有效地檢測紅外圖像中的人臉,通常利用雙目相機的位置關系,使用平移和旋轉參數將可見光圖像中檢測到的人臉邊界框投影至紅外圖像中,以此得到粗略的紅外人臉位置.由于雙相機之間存在視場不一致和成像時間差等缺點,導致跨光譜圖像之間的像素無法嚴格對應,因此以該方式獲取的紅外人臉邊界框存在較大偏差,如圖1 中虛線邊界框所示.

圖1 跨光譜人臉檢測Fig.1 Cross-spectral face detection

針對上述問題,本文對跨光譜圖像之間的偏差進行了深入的分析,偏差主要是由雙相機視差和成像時間差導致的.相機的視差是指由于雙相機光軸無法完全重疊,導致視場存在一定的偏差.據所知,使用光線分束器可以將雙目相機的視場對齊,但是分束器成本高、調試難、并且有光損耗,應用范圍較小.相機的成像時間差主要是由于雙相機成像時間不一致,導致采集到的圖像時間戳無法嚴格對齊,從而導致場景中動態目標的成像存在偏差.

為了克服雙目相機采集到的跨光譜圖像之間的偏差,準確定位紅外圖像人臉,本文設計了候選框布置策略和跨光譜特征表示方法.候選框的布置利用了坐標映射的結果,坐標映射雖有偏差,但是能夠為候選框的布置提供較強的先驗信息.跨光譜特征表示方法用于選擇能夠準確表達紅外人臉位置的候選框.

本文還構建了一個跨光譜人臉數據集,數據采集場景為人員進出密集的樓宇出入口,涵蓋白天和夜晚場景,采集到的人臉圖像含有遮擋、不同姿態等情況.數據集中的紅外人臉圖像含有手工標注的人臉邊界框,作為評估算法性能的基準.

本文主要貢獻如下:

1)深入分析了跨光譜相機的視差和成像時間差對跨光譜圖像偏差的影響.

2)提出了一種針對弱對齊圖像的跨光譜人臉檢測算法,依據跨光譜圖像之間的弱對齊關系布置候選框;為選擇最優候選框,設計了跨光譜特征表示方法.

3)構建了一個跨光譜人臉數據集(Cross-spectrum face,CSF).并在CSF和OTCBVS[1]上測試了人臉檢測算法的性能.實驗結果證明,本文方法在紅外圖像中可以表現出更好性能.

1 相關工作

1.1 人臉檢測

人臉檢測的任務是檢測人臉在圖像中的具體位置以及大小,檢測結果通常用邊界框在圖像中的位置表示.早期的人臉檢測算法[2-3]采用密集滑動窗口進行采樣分類,檢測速度慢、精度低.后續基于AdaBoost 分類器的算法[4-5]等在保證檢測精度的同時極大地提升了檢測速度,簡單特征的優化級聯框架[5]是當時主流的人臉檢測框架.為了提升算法的魯棒性,文獻[6] 設計了基于可變形組件模型的人臉檢測算法,能夠檢測各種姿態的人臉,文獻[7] 利用稀疏表示提取泛化能力更好的面部特征.隨著深度學習的發展,基于深度學習的人臉檢測算法逐漸代替了基于手工設計特征的方法.目前的一些基于深度學習的人臉檢測算法已取得了巨大的進展,文獻[8-13]等人臉檢測算法在WIDER-face 數據集[14]上達到了非常好的檢測性能.但是基于深度學習的人臉檢測算法通常依賴大量的訓練數據,目前紅外圖像人臉數據集有限,使用深度學習方法檢測紅外人臉仍存在較大的挑戰.現有的紅外圖像人臉檢測工作[15-18]很難達到令人滿意的結果.早期,有文章介紹了使用手工特征進行紅外人臉檢測的方法,例如文獻[15]提出了兩種用于熱紅外人臉檢測的局部特征,文獻[18]提出了使用邊緣檢測、模板匹配以及兩者結合的紅外人臉檢測算法,文獻[19-20] 開發了用于發熱篩查的移動平臺,該平臺利用可見光圖像定位人臉,并將人臉位置映射至紅外圖像中以獲取面部溫度信息.但是以上紅外人臉檢測算法檢測性能有限,對于環境復雜、有遮擋、面部較小等特征不明顯的面部,檢測結果不理想.

1.2 跨光譜圖像處理

跨光譜圖像處理包含跨光譜圖像融合以及跨光譜圖像立體匹配等方面的工作.跨光譜圖像的融合的目的,是將可見光圖像和紅外圖像各自的優勢結合起來,文獻[21-22]提出了可見光和紅外配對的人臉數據集,用于活體人臉識別的研究,數據集中含有不同的姿勢、遮擋的人臉.文獻[23]提出了跨光譜行人數據集,紅外信息的引入能夠大大增強夜間行人的檢測性能.另外,文獻[24-28]介紹了跨光譜圖像融合的相關算法.跨光譜圖像立體匹配是依靠交叉光譜之間的匹配特征估計視差,通常由于跨光譜圖像之間存在差異導致特征匹配較為困難.為了克服特征匹配的困難.文獻[29]針對玻璃等材料在不同光譜中的不同表現設計了材料感知損失函數,降低了材料對交叉光譜特征匹配的影響.文獻[30]針對交叉光譜外觀差異較大的問題,提出了使用生成對抗網絡對圖像進行風格轉換,從而降低了交叉光譜之間的差異.此外,文獻[31]提出了弱對齊圖像對行人檢測的影響,并將對齊偏差融入損失函數,提高了檢測性能,該文中明確指出跨光譜雙目相機采集到的圖像存在不嚴格對齊的情況.文獻[32]使用紅外相機獲取面部眼部的溫度進行體溫測量,但是紅外圖像中人臉難以被檢測,因此文中使用可見光與紅外圖像配對的方案,在可見光圖像中檢測到人臉后再將可見光與紅外圖像中的人臉通過可變形方法進行對齊,從而獲取紅外圖像中人臉位置.以上工作表明,可見光圖像與紅外圖像之間存在較大的差異,包括像素位置無法對齊的差異和圖像特征的差異,這些差異導致跨光譜圖像的處理依然是一個極具挑戰的問題.

2 跨光譜人臉圖像偏差分析

跨光譜雙目相機采集到的圖像之間無法嚴格對齊,導致同一個人臉在不同的相機中的成像位置無法準確對應,因此將可見光圖像中的人臉坐標映射至紅外圖像中時,會出現偏差.在以往的工作中,文獻[31]提出了跨光譜圖像行人檢測存在偏差,但是并未具體分析原因,僅從數據集的層面指出了存在該問題.本節對跨光譜人臉圖像的坐標映射進行了推導,分析了視差和雙相機成像時間差對坐標映射的影響.

2.1 視差對坐標映射的影響

由于雙目相機的光軸無法完全重合,且可見光相機與紅外相機的鏡頭材質不同,因此雙相機采集到的同一人臉很難實現精確的一一對應.本節以坐標映射的方式推導了雙相機圖像之間的像素對應關系,根據推導結果分析了人臉到鏡頭的距離與像素對應偏差之間的關系.

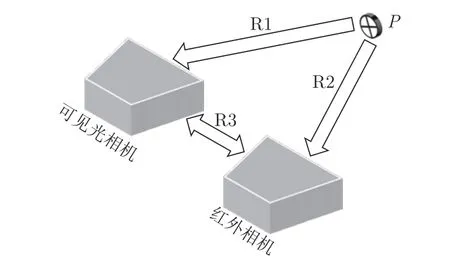

可見光圖像和紅外圖像分別由可見光相機和紅外相機采集,根據相機的成像原理和雙相機之間的位置關系,可以推算出跨光譜圖像之間的像素關系.如圖2 所示,空間內任意一點P 與其在可見光相機中成像位置的關系為R1,與其在紅外相機中成像位置的關系為R2,可見光相機與紅外相機之間的位置關系的R3.依據R1、R2、R3 可以推導出雙相機所拍攝的兩圖像之間的像素關系.

圖2 雙相機與空間內任意一點的關系Fig.2 The relationship between dual cameras and any point in space

依據相機的成像原理,在相機坐標系下,可以推導出空間中一點與其在圖像中成像位置的關系,如圖3 所示,是相機坐標系下的一點,是相機成像面上的一點,相機成像原理為小孔成像,根據相似三角形相似原理,可得兩點的關系如式(1):

圖3 空間中任意一點在相機中的成像坐標Fig.3 The imaging coordinates of any point in space in the camera

式中,f為相機焦距.

在相機成像面上,如圖4 所示,P點像素坐標(u,v) 與其在圖像坐標系下的坐標 (xu,yu) 的關系為式(2)~(3).

圖4 像素坐標系與圖像坐標系的關系Fig.4 The relationship between pixel coordinate system and image coordinate system

式中,u0、v0是圖像坐標系原點O2在像素坐標系下的位置.dx、dy 分別代表兩個像素點之間的實際距離.

根據式(1)~(3)可得,可見光相機坐標系下一點(xc1,yc1,zc1) 與像素坐標系下一點 (u1,v1) 的關系R1 可表示為式(4)和式(5):

同理可得紅外相機坐標系下一點(xc2,yc2,zc2)與像素坐標系下一點 (u2,v2) 的關系R2 可表示為式(6)和式(7):

雙相機之間存在一段空間距離的偏移,假設偏移量為p,那么雙相機坐標系之間的關系R3 可表示為式(8)~(10).

根據式(4)~(10) 可得,可見光圖像中一點(u1,v1) 與紅外圖像中對應位置點 (u2,v2) 的關系為式(11)和式(12),該推導結果即為跨光譜圖像之間的像素對應關系.

式(11)中的zc為相機坐標系下物體的豎坐標,是點到相機鏡頭的距離,即為深度.

基于以上分析可得跨光譜圖像之間像素對應關系可以等同為縮放和平移,縮放系數為常數au,av,平移系數為bu/zc+cu,cv,橫向平移系數與當前像素點的深度zc相關,縱向平移系數為常數.

將可見光圖像像素坐標映射至紅外圖像中時,根據式(11)和式(12)可知,除了需要事先對偏移和縮放參數標定,還需要獲取圖像中每個像素點準確的深度信息.因此視差對坐標映射的影響可以轉換為深度估計對坐標映射的影響,深度值的估計的精度直接影響了坐標映射的準確程度.

本文通過實驗證明了深度值對坐標映射的影響.如圖5 所示,左列為可見光圖像,右列為與左列對應的紅外圖像,從上至下人臉到鏡頭的距離由遠及近.可見光人臉邊界框表示人臉在可見光圖像中的位置,紅外人臉邊界框是可見光圖像中的邊界框通過縮放和平移變換后的結果.由于深度信息未知,因此在實驗中以較遠處的人臉位置偏移為基準,將遠處人臉對齊時的平移參數作為實驗時的平移參數,在圖5 中,將第1 行的圖像之間縮放和平移參數作為實驗過程中的參數.由圖5 可以看出,隨著距離的縮小,映射后的坐標偏移越來越大,這是因為距離變近時,平移量本應當隨著深度值的變小而變大,但是由于在實驗過程中使用了固定的平移量,導致坐標映射的偏差變大,這也驗證了本文的推理結論.

圖5 不同深度下的跨光譜人臉圖像Fig.5 Cross-spectral face images at different depths

2.2 雙相機成像時間差對坐標映射的影響

當雙相機采集面對運動目標時,雙相機需完全同步工作才能保證采集到同一時刻的圖像,此過程往往需要使用軟件或硬件控制雙相機同時采集圖像,但是實際應用時很難控制雙相機的采集時間絕對一致,即使是毫秒級別的誤差,在圖像上也會表現出較大的偏差.

可見光相機與紅外相機的工作方式不一致,可見光相機需要調節曝光時間來應對外界光照的變化.在夜晚,曝光時間過短,會導致圖像過暗;曝光時間過長會導致圖像失真.雖然紅外圖像的每幀采集時間固定,即便能夠獲取可見光相機的曝光時間,也很難保證雙相機的采集時間絕對一致.對于靜態的人臉,雙相機采集時間的影響基本可以忽略不計,但是對于動態移動的人臉,尤其距離鏡頭較近時快速移動的人臉,由于雙相機的采集時間差異,會導致跨光譜人臉坐標映射存在一定偏差.

本文也通過實驗驗證了雙相機成像時間差對坐標映射的影響.如圖6 所示,當人臉在鏡頭前勻速移動時,可見光圖像中人臉坐標映射到紅外圖像中后出現不同程度的偏差,并且偏差大小不穩定.

圖6 含有運動目標的跨光譜人臉圖像Fig.6 Cross-spectral face images with moving target

在實際應用中,除上述影響以外,相機的控制信號觸發、相機硬件延遲等過程都需要一定的時間,并且可能由于相機工作環境不穩定等不可抗因素導致圖像的采集時間會出現一定的抖動,從而加劇雙相機之間的偏差.

3 跨光譜人臉檢測

根據第2 節中對跨光譜雙相機之間的偏差分析,本節提出了消除誤差的跨光譜人臉檢測框架.首先針對距離對偏差的影響,提出了一種基于深度估計的偏差修正方法,隨后針對整體的偏差(雙相機視差和成像時間差導致的偏差)介紹了跨光譜人臉檢測框架,包括候選框布置策略以及跨光譜特征表示網絡的構建與訓練等.

3.1 基于深度估計的坐標偏差修正

根據對式(11)的分析,在可見光圖像人臉坐標映射到紅外圖像坐標系下的過程中,需獲取對應像素點準確的深度,本文提出了一種簡潔的深度估計方式,即通過圖像中人臉大小粗略估計深度zc.

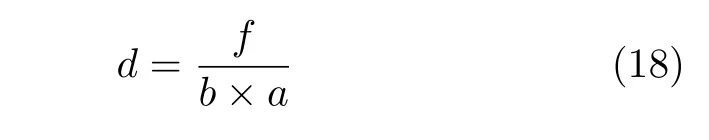

由于成年人的人臉大小之間差異較小,此處暫時假設所有人的人臉實際高度為b.根據相機的成像原理,如圖7 所示,a和b分別表示圖像中人臉的像素高度與實際三維空間中人臉高度,f為相機焦距,d為人臉到相機鏡頭的距離,可以得出:

圖7 人臉高度與其成像高度的關系Fig.7 Relationship between face height and image height

將式(18)代入等式(11),即可完成坐標的初步映射.

實際情況下,每個人臉的大小有略微的差異,尤其是人臉圖像存在遮擋和姿態變化時,會導致檢測器檢測到的人臉邊界框發生變化.此時的人臉高度估計不準確,從而導致人臉到鏡頭的距離估計精度下降,因此基于人臉大小的邊界框坐標映射僅能在一定程度上降低坐標映射的偏差,并且只能針對距離遠近的變化帶來的誤差進行糾正.如需準確檢測紅外圖像中的人臉位置,還要進一步對坐標映射后的位置進行糾正.

3.2 跨光譜人臉檢測框架

為了彌補雙相機之間的偏差,準確檢測紅外圖像中的人臉,本文設計了跨光譜人臉檢測框架,該框架在坐標映射的基礎上對邊界框進行修正,并且能夠提升紅外人臉檢測的精度.

本文的跨光譜人臉檢測框架主要包括候選框布置策略和跨光譜特征表示.依據坐標映射的結果,可以獲取紅外人臉的大致位置,如圖1 中候選框對應區域所示,候選框在此區域內以坐標映射后的人臉框大小為基準,由左至右密集布置.分別截取候選框位置對應的紅外圖像和可見光圖像中檢測到的人臉圖像,截取到的圖像如圖8 中黃色虛線區域所示.使用跨光譜特征表示網絡分別提取每個紅外候選圖像的特征和可見光人臉圖像的特征,特征提取示意圖如圖8 中特征提取對應區域所示,最后分別計算每個候選框對應特征向量與可見光人臉對應的特征向量之間的距離,與可見光人臉最近的候選框即為檢測結果,如圖8 中檢測結果對應區域所示.

圖8 跨光譜人臉檢測框架Fig.8 Cross-spectral face detection framework

布置候選框是目標檢測任務中常用的方法,其目的是找到所有可能涵蓋有目標的區域,候選框的質量與數量是影響最終檢測性能的重要因素.借助跨光譜圖像的優勢,根據可見光圖像提供的人臉位置先驗信息,可以產生質量較高,數量較少的候選框.根據第2 節中坐標映射偏差的分析可知,坐標映射的偏差主要存在于水平方向,因此以映射后的邊界框為中心,分別向其左右密集布置候選框,能夠有效將真實的人臉邊界框涵蓋在內.

在圖像中,遠處的人臉像素面積較小,近處的人臉像素面積較大,使用固定像素點步長布置候選框不合理,過于稀疏的候選框布置會導致每個候選框之間的間距較大.而真實的人臉邊界可能存在于兩個候選框之間,最終可能導致定位不準確.過于密集的候選框布置會增加候選框的數量,同時兩個候選框之間的圖像過于相似,不利于后續的精確定位.因此根據人臉的大小對候選框進行布置,本文使用1/8 人臉框的橫向長度為步長,并且最遠布置到1/2 人臉橫向長度,左右對稱布置,每個人臉具有9 個候選框.

檢測框架第2 個步驟的關鍵是挑選出能準確表達紅外人臉位置的候選框.本文在非常深的卷積神經網絡(GG-very-deep-11 CNN,VGG11)[33]的基礎上設計了跨光譜特征表示網絡,該網絡的卷積層與VGG11 一致,僅使用了一個全連接層(Fully connected layers,FC),最終網絡的輸出是維度為8 的特征向量.網絡結構如圖9 所示,主要由卷積層、池化層和全連接層組成,“Conv 3 × 3,64”表示卷積的卷積核大小為3 × 3,輸出通道數為64,池化層的過濾器為2 × 2,步長為2,全連接層的輸入向量的維度是512,輸出特征向量的維度是8.該方法用于表示可見光圖像和紅外候選框圖像之間的相似特征,根據所提取特征判斷候選框圖像與可見光圖像的相似程度,以此來選擇最優候選框.網絡的訓練方式如圖10 所示,訓練的目的是使得可見光人臉的特征與對應的紅外圖像人臉特征之間的距離盡可能小,而與背景特征之間的距離盡可能大.本文使用了FaceNet[34]中的三元損失函數來引導卷積神經網絡學習鑒別特征.在FaceNet 中,三元損失函數能夠拉近同一個人臉的特征,而使不同人臉提取到的特征疏遠.此處,使用三元損失函數的目的是能夠將同一人的可見光人臉特征與紅外人臉特征拉近,而使得偏離準確人臉位置的候選框圖像特征與可見光人臉特征之間的距離變大.

圖9 跨光譜特征表示網絡Fig.9 Cross-spectral feature representation network

圖10 跨光譜特征表示網絡訓練方式Fig.10 Cross-spectral feature representation network training method

由于候選框布置較為密集,相鄰候選框之間蘊含的信息差異有限,尤其是靠近真實人臉位置的候選框,所以網絡提取到的特征極為相似.為了提高網絡對相似候選框圖像的分類能力,獲取了含有部分人臉的負樣本用于訓練網絡.如圖11 所示,負樣本包括左右兩側7/8 的人臉、6/8 的人臉、5/8 的人臉、4/8 的人臉以及完全的背景部分.在訓練過程中,將每種負樣本作為一類,即網絡的預測含有六類.此種負樣本的選取方式是為了使分類器對相似候選框中的人臉具有更好的區分性,從而增強人臉檢測的準確度.

圖11 含有部分人臉的負樣本Fig.11 Improved negative sample selection method

在測試階段,由于受材料等因素的影響,可能存在可見光圖像中含有人臉而紅外圖像中不含人臉的情況.例如,可見光相機可以透過玻璃拍攝到玻璃后的人臉,但是紅外相機只能采集到玻璃表面的紅外信息.此時由于紅外圖像中不含有人臉,導致所有候選框的置信度均較低,當置信度低于某個閾值時檢測結果將被舍棄.

4 CSF 跨光譜人臉數據集

CSF 跨光譜數據集包含可見光相機和熱紅外相機同時采集的人臉圖像,采集場景為人員密集的樓宇出入口.值得說明的是人臉數據采集的過程中,未對過往人員進行任何行為約束,因此采集到的人臉圖像包含有遮擋、姿態變化等情況.

CSF 數據集主要包含測試集和訓練集兩部分.測試集含有3 000 幀手工邊界框標簽的數據,其中包括白天8:00 至8:30 的數據1 500 幀,夜間19:30至21:30 的數據1 500 幀,用于測試算法性能的基準;訓練集包含1 500 幀不含有手工標簽的數據,用于訓練模型.測試集包含4 821 個人臉標注框,單張圖像中最多含有7 個人臉標注框.訓練集共有2 155個人臉標注框.

數據集中的圖像由跨光譜雙目相機進行采集,可見光相機是邁德威視GigE 彩色工業相機,紅外相機是FOTRIC 680 系列熱紅外相機.

雙相機被固定在同一個平臺上,左、右擺放,光軸同向,如圖12 所示,兩相機固定在鋼板上,由于安裝精度原因,可能存在一定的誤差.可見光相機采用的光學鏡頭,紅外相機采用的是特殊材質的鏡頭,因此無法實現鏡頭視場角的嚴格統一.雙相機均為網絡相機,通過網線與采集控制設備相連接.使用電腦控制兩相機同時采集圖像,紅外相機的采集頻率保持30 Hz 不變,可見光相機由于隨著外界光照的變化需要自動調整曝光時間,采集頻率也會隨之改變.由于保存每幀的數據需要巨大的存儲空間,所以在可見光圖像上檢測到人臉時才保存當前幀數據.除了保存可見光圖像和紅外圖像以外,存儲了紅外相機采集到的原始輻射值,以便后續進一步開展深入研究.

圖12 相機安裝位置Fig.12 Camera installation location

采集設備的環境含有正常光線,夜間照明不足等情況.如圖13 所示,左列為可見光圖像,右列為與可見光圖像對應的紅外圖像;第1 行為白天光照較強的場景的可見光圖像,第2 行為夜間光照不足的場景.可見光相機曝光時間較長會導致圖像的動態性能較差,采集到的運動的人臉模糊,因此在夜間采集數據時可見光相機的曝光時間被限制在30 ms 以內,并且盡可能保證可見光圖像中的人臉可以被檢測到.

如果不是極為細膩的口味,是不會知道,糖藕中的糯米球才是最好吃的。吸收了藕的清甜,卻沒有藕的渣口,代之以糯米的綿密,是江南甜點里登峰造極的東西。如日劇《白夜行》的女主角雪穗所說:“年輕時沒有嘗過美味,就不能培養真正的味覺。”

圖13 不同采集條件下的圖像Fig.13 Images under different acquisition conditions

5 實驗部分

本文實驗是在CSF 數據集上和OTCBVS 數據集上,進行跨光譜人臉檢測實驗.

OTCBVS 數據集是在室內采集的可見光和紅外配對的數據集,其數據采集形式與CSF 數據集的采集形式一致,采用左右雙相機,分別為可見光相機和紅外相機.本文研究重點是跨光譜圖像的人臉檢測問題,因此對該數據集中的1 500 幀紅外人臉進行了人工標注,以評估檢測算法的性能.

可見光圖像中的人臉檢測使用的是人臉檢測器(Dual shot face detector,DSFD)[3].

可見光與紅外圖像之間坐標映射依據式(11)和式(12)進行實驗,相機在使用前需要進行標定,以獲取平移和縮放參數.其中縮放參數和縱向平移參數為常數.依據式(11)可知橫向平移參數與當前深度值相關,但是深度值無法實時準確獲取.因此在標定時以較遠處(約5 m)為基準獲取橫向平移參數,當深度發生變化時,再依據第3.1 節中的粗略補償方案對橫向平移量進行粗略修正.

跨光譜特征表示網絡使用未標注的紅外和可見光數據構建訓練集.DSFD 用來分別檢測可見光和紅外圖像中的人臉.在可見光圖像與紅外圖像中同時檢測到同一個人臉時,將可見光人臉圖像保存,并按照紅外圖像中的正負樣本選取規則保存對應的紅外圖像.在跨光譜特征表示網絡的訓練階段,以可見光人臉圖像作為模板,將紅外人臉圖像作為正樣本,紅外圖像的非人臉區域作為負樣本,所有圖像的大小統一調整至 32×32,使用三元損失函數對網絡進行訓練.通過損失函數的約束,可見光人臉圖像提取到的特征與紅外人臉圖像提取到的特征會趨于相似,而與紅外圖像非人臉區域提取到的特征差異變大.

在測試階段,分別提取可見光圖像的特征與紅外候選框圖像的特征,計算所有候選框特征與可見光人臉圖像特征的距離.由于三元損失函數約束正樣本時使用了二范數距離的平方,因此在測試階段計算特征相似度時仍使用相同的計算方式.將計算得到的距離進行排序,距離最近的特征對應的候選框為檢測結果.

實驗將紅外圖像中人臉檢測的準確度作為檢測結果的評估標準,采用平均正確率(Average precision,AP)作為人臉檢測的評價指標.Intersection over union (IoU)閾值分別選取0.5和0.3,IoU 為0.5 的AP 值是常用的目標檢測評估標準.此處也選取IoU 為0.3 時,通過實驗說明本文方法相比于直接在紅外圖像中檢測人臉性能更好.

本節分別測試了坐標映射、坐標糾正以及本文提出的跨光譜人臉檢測算法在不同數據集上的性能,實驗結果如表1~3 所示.

表1 測試集為CSF-白天的實驗結果Table 1 Experiment results on CSF-day

實驗結果顯示,僅通過坐標映射得到的紅外人臉位置精度不高,粗略修正能夠在一定程度上提高檢測的精度,但是結果仍無法令人滿意.然而,本文提出的跨光譜人臉檢測算法能夠大幅提高檢測性能,并在IoU 為0.3 時的實驗數據表明,本文算法仍有較大的提升空間.

此外,本文對候選框的召回率進行了評測.當紅外人臉的真實邊界框與任一候選框的交并比大于設定閾值時,即認為該真實邊界框被召回.分別評估了交并比為0.5和0.3 情況下的召回率,結果如表4 所示.

表4 候選框召回率(%)Table 4 Proposal recall (%)

表2 測試集為CSF-夜間的實驗結果Table 2 Experiment results on CSF-night

表3 測試集為OTCBVS 的實驗結果Table 3 Experiment results on OTCBVS

表4 的實驗結果顯示,本文的候選框布置策略所產生的候選框能夠將絕大多數的真實人臉涵蓋在內,基本滿足人臉檢測需求.

為了探究候選框的布置策略對模型精度和效率的影響,本節依據第3.2 節的候選框設置策略,分別對模型進行測試,并評估了測試精度和不同設置下的模型運行時間.模型的訓練及測試使用的GPU為NVIDIA TITAN V.實驗結果如表5和表6 所示,表中1/8 代表含有1/8 步長的候選框,1/8和2/8 表示含有1/8 步長的候選框和2/8 步長的候選框,以此類推.在不同的候選框設置條件下,分別測試了當IoU > 0.5 時模型的精度和模型處理單張圖像的時間.

表5和表6 的實驗結果顯示,隨著候選框數量的增多,模型的精度也在逐步上升,時間消耗也隨之增加.當候選框達到3/8 步長時,模型的精度基本達到最大值,也說明了數據集中的人臉偏差基本分布在3/8 人臉寬度內.在實際應用中可能由于相機型號不同,導致偏差略有增大或減小,可根據實際情況對候選框的布置策略進行調整,以達到最佳的性能或速度.

表5 CSF 中候選框的選取對模型的影響Table 5 Influence of the selection of the proposal on the model in CSF

表6 OTCBVS 中候選框的選取對模型的影響Table 6 Influence of the selection of the proposal on the model in OTCBVS

為了證明不同難度的負樣本對模型訓練的影響,本文設置了不同難度的負樣本用于訓練模型,測試集數據使用的是CSF 中的測試集.實驗結果見表7 所示.

表7 負樣本類型對模型精度的影響Table 7 Effect of negative sample type on model accuracy

表7 的實驗結果顯示,僅使用完全背景的圖像作為負樣本時,訓練得到的網絡性能不理想.使用含有部分人臉圖像作為負樣本時,人臉占比面積越大,網絡性能越差.當綜合使用所有負樣本時,訓練得到的網絡性能最佳.

為了進一步證明跨光譜人臉檢測算法的優越性,本文使用了當前主流的人臉檢測算法在CSF數據集和OTCBVS 數據集上進行了測試.分別使用在WIDER-face 數據集上訓練好的模型的測試結果和使用紅外數據重新訓練后的測試結果.為了保證實驗的公平性,使用紅外數據訓練主流檢測模型時,應用了與本文訓練跨光譜特征提取網絡同樣的訓練集.不同的是,本文算法在訓練時,僅用了人臉區域及其附近的圖像,而主流算法在訓練時使用了完整的紅外圖像,測試數據使用的是CSF 測試集全部數據和OTCBVS 數據集的測試集.實驗結果如表8和表9 所示,其中FaceBoxes[12]、S3FD[9]、Pyramidbox[13]、DSFD[8]、Tinyface[10]均為在WIDER-face 數據集上訓練得到的人臉檢測模型,S3FD-IR和DSFD-IR 分別為S3FD和DSFD 在紅外數據上重新訓練后的模型.

表8 CSF 數據集上的對比實驗結果Table 8 Comparative experiment results on CSF dataset

表9 OTCBVS 數據集上的對比實驗結果Table 9 Comparative experiment results on OTCBVS dataset

表8和表9 的實驗結果顯示,使用現有的人臉檢測算法直接應用在紅外圖像時,檢測結果很不理想;即便使用紅外數據重新訓練檢測模型,最終的檢測結果依然不能令人滿意.而本文提出的跨光譜人臉檢測顯著的優于其他具有競爭力的人臉檢測算法.

本節展示了DSFD 在紅外圖像中重新訓練(DSFD-IR)的檢測結果、S3FD 在紅外圖像中重新訓練(S3FD-IR)的檢測結果以及DSFD-本文算法的檢測結果的對比圖,如圖14 所示.其中左側一列為S3FD-IR 的檢測結果,中間一列為DSFD-IR 的檢測結果,右側一列為DSFD-本文算法的檢測結果,第1 至3 行為CSF 測試集中的部分檢測結果,第4 至5 行為OTCBVS 數據集中的部分檢測結果,每張圖像中,紅色邊界框表示算法檢測的人臉位置,綠色邊界框表示真實的人臉位置.

由圖14 第1 行的檢測結果可以看出,S3FDIR和DSFD-IR 的檢測結果中存在誤檢的情況,原因是紅外人臉數據面部細節特征不明顯,模型容易將熱量較高部分作為人臉的主要特征,因此發熱物體可能會被檢測器檢測為人臉,而本文的檢測算法不易誤檢,原因是可見光圖像的人臉檢測步驟過濾掉了大部分的背景區域.

由圖14 第2 行的檢測結果可以看出,S3FDIR和DSFD-IR 檢測結果的邊界框會包含脖子部分,導致邊界框不能完全表示人臉的位置,原因是在紅外圖像中脖子與人臉融為一體,模型難以準確獲取其邊界.相比之下,本文的算法由于有可見光圖像對邊界框的約束,能夠得到較準確的檢測結果.

由圖14 第3 行的檢測結果可以看出,DSFDIR 存在漏檢人臉的情況,當人臉遮擋較為嚴重時,DSFD-IR 算法難以檢測到人臉位置.

由圖14 第4 行的檢測結果可以看出,所有算法均漏檢了最右側的人臉,原因是紅外圖像中該人臉熱量較低,難以檢測,本文算法依賴可見光圖像中的人臉檢測結果,當可見光圖像中未檢測到人臉時,紅外圖像中的人臉同樣會被漏檢.

由圖14 第5 行的檢測結果可以看出,S3FDIR 檢測到的人臉邊界框存在較大偏差,未能準確表示人臉的位置,DSFD-IR 存在漏檢的情況,而本文的算法能夠較好的檢測紅外圖像中的人臉.

圖14 檢測結果對比圖Fig.14 Comparison of face detection results

通過對實驗結果的分析可知,S3FD-IR和DSFD-IR 檢測紅外圖像中的人臉時存在較多的檢測缺陷,而DSFD-本文算法能夠更好的檢測紅外圖像中的人臉位置.但是本文算法較為依賴可見光圖像中的檢測結果,可見光圖像中的人臉檢測性能較差時,將直接影響最終的檢測結果.后續工作將考慮依靠紅外視頻幀之間的相關性對候選框進行布置,降低對可見光圖像的依賴.

6 結束語

本文提出了一種弱對齊跨光譜圖像的人臉檢測算法,該算法利用了可見光圖像與紅外圖像的弱對齊關系和兩者之間的一致特征,克服了跨光譜圖像之間的偏差,達到了準確檢測紅外人臉的目的.與直接在紅外圖像中檢測人臉的算法相比,本文的算法速度更快,人臉位置檢測精度更高,模型訓練成本更低.大量的實驗證明,本文提出的跨光譜人臉檢測算法能夠快速準確地檢測紅外圖像中的人臉.雖然本文的算法已經能夠較好解決紅外人臉檢測難的問題,但是算法部分模塊設計不夠細致,數據集的構建也不夠完善,對可見光圖像中的人臉檢測結果依賴性強.在后續的工作中,將深入挖掘可見光人臉與紅外人臉之間的一致特征,設計更加有效的跨光譜特征表示網絡和目標函數,依靠紅外圖像視頻幀之間的相關性設計候選框布置策略,以進一步提升檢測性能,同時也會進一步在更多場景下采集跨光譜人臉數據,以增加數據集的多樣性.