深度視覺手勢識別協作機械臂物體抓取系統

黃旭陽,韓建海,2,李向攀,2

(1 河南科技大學機電工程學院,河南 洛陽 471023;2 河南科技大學河南省機器人與智能系統重點實驗室,河南 洛陽 471023)

0 引 言

手勢不僅是人與人之間的一種重要交流方式,同時也改變了人與機器之間的交流方式[1],手勢識別目前被廣泛應用在多種領域[2]。 在控制領域,手勢識別系統取代了按鍵或者觸摸屏控制,通過手勢實現機器人運動過程中的目標辨識使用戶感到更加自然[3]。在計算機交互領域,手勢取代了鼠標、鍵盤對計算機的控制,使人與計算機之間的交互更加智能化[4]。 隨著卷積神經網絡的不斷發展,基于深度學習的視覺手勢識別系統的應用范圍也會越來越廣泛。

最初的手勢識別方法主要有數據手套和視覺識別.。 第一種方法主要利用穿戴設備獲取手部各個關節的角度信息,這些設備將手勢信息傳入識別系統中,精確度比較高,但是需要大量傳感器輔助,佩戴繁瑣且設備成本較高[5]。 視覺識別方法應用更加方便,通過圖像處理、圖像分割完成特征提取,然后通過分類算法對手勢特征進行識別。 但是對數據集的依賴性大,容易受到環境光照、背景干擾,算法的局限性比較大。

隨著卷積神經網絡的發展,手勢識別中的目標分類問題被轉換成了目標檢測的問題。 Girshick 等學者提出R-CNN 用于目標檢測,隨后又提出Fast R-CNN,Faster R-CNN 等基于區域建議的目標檢測算法,提高了識別的速度和精度[5]。 Redmon 等學者[6]在2016年的CVPR 大會提出了基于回歸的YOLO 算法,YOLO 算法不生成候選區域,直接利用檢測網絡生成目標的位置、類別信息,進一步提高了檢測的速度。

YOLOv1 自2016年提出,因其檢測速度較快而廣受關注,但對目標的定位不夠準確,隨后又相繼提出了YOLOv2,YOLOv3。 在2020年,Bochkovskiy 等學者[7]提出了YOLOv4,該網絡在YOLOv3 的基礎上結合了很多提高精度的技巧,包括加權殘差鏈接(WRC)、跨階段部分連接(CSP)、交叉小批量標準化(CmBN)、自對抗訓練(SAT)等,最終在COCO 的數據集上的AP值為43.5%,在TeslaV100 上的實時監測速度達到了65 FPS,有效提高了識別速度和精度。

1 系統方案設計

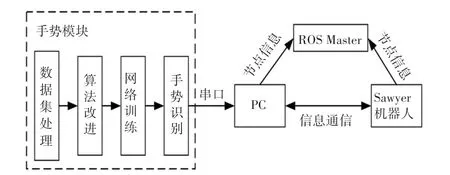

基于深度視覺手勢識別的協作機械臂物體抓取系統整體設計方案的設計共由2 部分組成,包括手勢識別系統和協作機械臂物體抓取系統(圖1)。

圖1 系統整體方案設計Fig. 1 Overall scheme design of the system

手勢識別系統是指通過數據集處理,將數據通過改進后的算法模型進行訓練,訓練后的網絡模型對單目攝像機采集到的數據進行預測,再將預測的手勢信息通過串口發送到PC 端。

在機械臂抓取物體的系統中,PC 端和sawyer 機器人會把自身的節點信息發送到ROS Master 中保存起來,ROS Master 會根據節點信息進行匹配,匹配成功后PC 端可以直接和Sawyer 機器人進行通信,PC端將通過串口獲得的手勢信息進行處理后,轉換成相應的指令通過節點以話題、服務、動作的通訊方式發出,機器人節點接收指令后完成相應的動作。

2 手勢識別系統設計

手勢識別系統主要分為如下步驟。

(1)數據采集:采集不同背景,保存手勢的數據信息,并對采集后的數據進行數據標定。

(2)算法設計:為了更加方便地控制機械臂的運動,基于YOLO v4 算法進行改進,增加輸出信息的種類,可以實現機械臂的更全面地控制。

(3)網絡模型訓練:將處理后的圖片通過卷積、池化、全連接進行特征提取和分類,通過不斷地更新網絡權值使預測值和真實值之間的loss小于某一期望值。

(4)手勢識別:通過對相機采集到的數據進行識別,將手勢的分類信息進行輸出,獲得有效的手勢識別結果。

2.1 YOLOv4 檢測原理

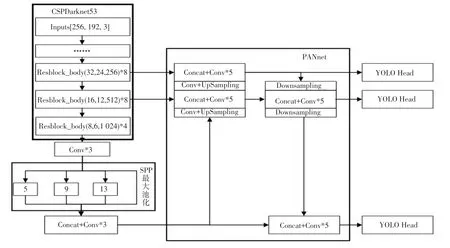

YOLOv4 算法是在原有YOLOv3 的基礎上,結合了很多提升精度的技巧,優化了數據處理、基礎網絡的算法,使用了Mish激活函數,提高了識別的速度和精度,YOLOv4 的改進如圖2 所示。 這里,可對圖2 中的重要設計內容,展開闡釋分述如下。

圖2 YOLOv4 網絡結構圖Fig. 2 YOLOv4 network structure diagram

(1)YOLOv4 的主干網絡使用了CSPDarkNet53網絡,CSPNet 的核心思想是輸入切分,通過分割梯度流,將基礎層的特征圖分為2 部分,然后利用跨階段特征融合策略將其合并起來。 CSPNet 不僅減少了計算量,而且實現了更豐富的梯度組合。 YOLOv4 的主干網絡使用Mish激活函數代替了Leaky_ReLU激活函數,平滑的激活函數取代了硬零邊界,允許更好的信息深入神經網絡,提高準確性和泛化能力[8]。

(2)YOLOv4 在CSPDarkNet53 結構后添加了SPP 模塊,SPP 用最大池化來滿足最后輸入特征一致,解決輸入圖像尺寸不統一的問題,可以增加感受視野,分離出最顯著的上下文特征,使算法適應不同分辨率的圖像。

(3)YOLOv4 采用了FPN+PAN 模塊,FPN+PAN一個非常重要的特點就是特征反復提取。 FPN 將高特征層通過上采樣和低特征層做融合得到預測的特征圖,增強了語義信息;PAN 自底向上傳遞定位特征,通過對FPN 模塊的補充,進一步提高了特征提取的能力,從而加強了對目標的檢測能力。

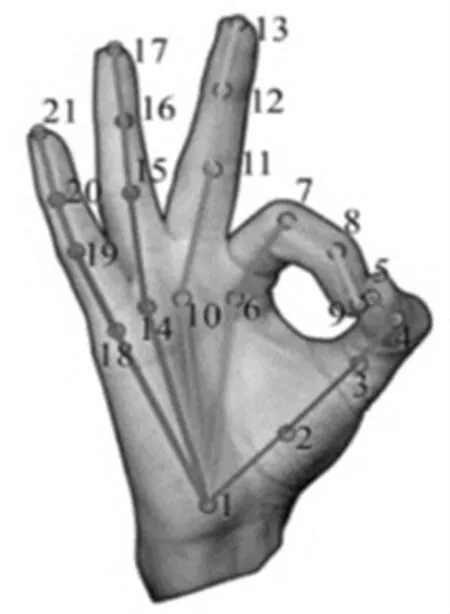

2.2 改進的YOLOv4 算法

YOLOv4 在YOLOv3 的基礎上融合了提高精度的技巧,包括數據增強、加權殘差連接、跨階段部分連接、交叉小批量標準化、Mish 激活等,使得YOLOv4 在識別精度和識別速度方面有了很大的提升,但在最后網格的特征通道上只有先驗框的位置、置信度和種類的信息,不能滿足對機械臂靈活控制時的數據要求。針對這種情況,本文在YOLOv4 算法的基礎上優化YOLOv4 的輸出模型結構,將網格特征通道上加入2個手勢關鍵點的分析,通過對這2 個關鍵點的訓練和分析,得到手的水平方向,進而控制機械臂手爪的夾持方向,提高機械臂控制的靈活性。

YOLOv4 通過CSPDarkNet53 網絡完成對輸入圖片特征的提取,并對輸入圖片提取3 個有效特征層,將3 個有效特征層分成大小不同的網格,比如特征層為(N,8,6,75)的格式就是將輸入圖像分成了8?6 的網格;接下來在這些網格中心建立3 個先驗框,再通過網絡預測結果來判斷哪些先驗框中有所需要檢測的物體,并判斷出所檢測到物體的種類。

以特征層(N,8,6,75)為例,由于每個網格中共同有3 個先驗框,所以75 可以看作3×25,25 中包括4 個先驗框調整參數(x,y,h,w),1 個置信度信息用來確定框內有沒有檢測到物體,20 是網絡檢測物體的種類。

為了更加靈活地控制機械臂,將特征層輸出內容做出調整,如圖3 所示,通過增加1,10 兩個關鍵點的位置信息來判斷手的水平方向,為此將特征層的輸出結果改變為(N,8,6,3,29),新增的4 組數據表示2 個手勢關鍵點的坐標信息,隨即推得最后特征層的輸出結果為(N,8,6,87)。

圖3 手勢關鍵點Fig. 3 Gesture key points

2.3 網絡模型訓練

深度神經網絡中的損失是衡量訓練出來的模型泛化能力好壞的重要指標。 損失是指訓練后網絡模型的預測值和目標值之間的差值,預測值和目標值之間的差值越小,損失值也就越小,說明訓練的模型也就越準確,泛化能力也就越好。 當損失值比較高時,就需要通過優化函數不斷地更新網絡權值,使差值達到最小或者小于某一期望值,從而提高模型的準確度和泛化能力[8-9]。

2.3.1loss的計算

損失一般由3 部分組成。 第一部分是預測框x,y,w,h帶來的誤差,用CIoU loss計算;第二部分是置信度帶來的誤差,用BCE loss來計算;第三部分是類別和關鍵點帶來的誤差,用BCE loss來計算。

Intersection over Union (IoU) 是目標檢測中的一種重要的評價值。IoU通過計算這2 個框A、B間的Intersection AreaI(相交的面積)和Union AreaU(總的面積)的比值來獲得:

IoU是比值的概念,對尺度不敏感,而且當2 個框的重疊為0 時,IoU無法進行反向傳播。CIoU將預測框和真實框距離、重疊率和懲罰項都考慮進去了,使目標回歸更趨穩定[10]。CIoU的公式如下:

其中,ρ2b,bgt() 表示預測框和中心框的距離,c表示能同時包含預測框和真實框的對角線的距離。α和v的公式如下:

把1-CIoU就得到了lossbox,所以lossbox的公式如下:

其中,帶“^” 的變量表示標簽真值;s表示特征層的長寬;B表示每個網格點先驗框的個數;表示預測框是否為正樣本,是、為1,否、為0;表示該檢測框是否是負樣本,是、為1,否、為0,如果2 個值都為0,說明該檢測框為忽略樣本。

2.3.2 手勢識別結果分析

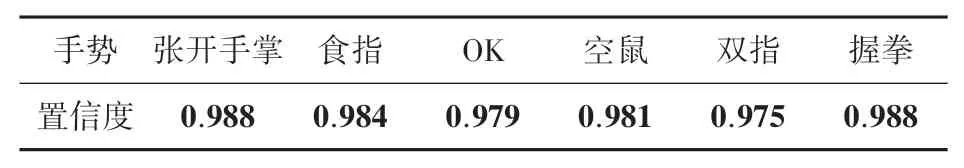

使用改進后的YOLOv4 算法對自制數據集進行檢測,手勢檢測結果如圖如4 所示,各類手勢的置信度見表1。 在圖4 中,預測框在原圖上的位置就是手勢所在的位置,手勢關鍵點的連線代表著各個手勢點的坐標信息,預測框上面左邊的標簽表示檢測出來的手勢種類,右邊的表示所識別手勢的置信度。在表1 中,可以看到各類手勢的置信度達到了98%,置信度表示該手勢被正確識別的概率,根據實驗數據顯示,改進的YOLOv4 算法可以準確地識別出手勢種類以及各個關鍵點的坐標信息。

表1 各類手勢置信度Tab. 1 Gestures confidence

圖4 手勢檢測結果Fig. 4 Gesture detection results

3 基于改進YOLOv4 改進算法的協作機械臂物體抓取實驗

3.1 實驗環境

實驗所用平臺來自實驗室搭建的基于ROS 系統的Sawyer 協作機械臂控制系統,操作系統及版本:Ubuntu20.04;手勢識別模塊: PaddlePi-K210 AI開發套件。

3.2 機械臂抓取物體系統步驟

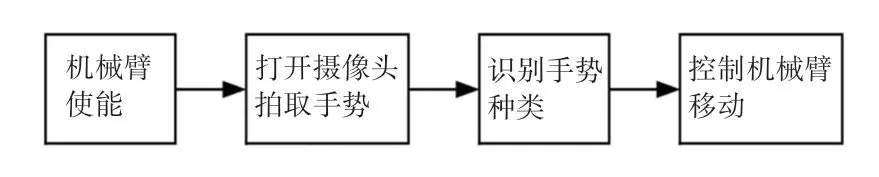

在手勢識別系統中,根據識別到的不同手勢信息,來實現機械臂的物體抓取動作,手勢識別系統的步驟流程如圖5 所示。 在圖5 中,首先將機械臂處于使能狀態,進入準備階段,隨后打開攝像頭獲取手勢種類、手勢關鍵點和手勢水平方向的信息,通過手勢的種類控制機械臂執行相應的動作,利用手勢的關鍵點和水平方向的信息來實現機械臂跟蹤手勢以及抓取物體方向的控制。

圖5 機械臂抓取物體系統步驟Fig. 5 Steps of mechanical arm grabbing object system

3.3 手勢識別應用結果

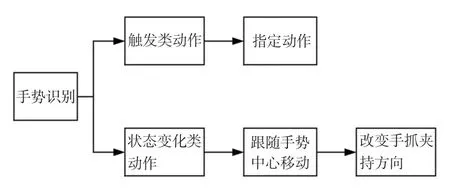

將手勢識別模塊應用在機械臂控制中,本文主要設計了2 種應用模式,如圖6 所示。 第一種為指令控制模式,也就是檢測到觸發類動作時輸出該指令,隨即控制機械臂做出相應的動作。 第二種為跟隨模式,指檢測到手勢狀態變化時輸出該指令,接著使機械臂手爪跟隨手勢中心點移動,再通過檢測手勢水平方向控制跟隨移動過程中機械臂的手爪夾持方向。

圖6 應用模式圖Fig. 6 Application pattern diagram

3.3.1 指令控制模式

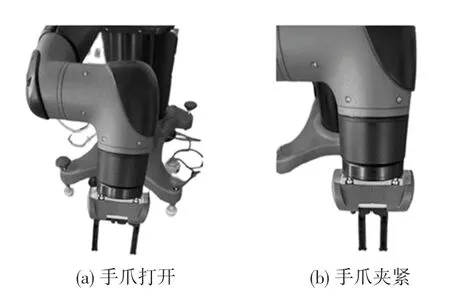

在該控制模式中,由手勢模塊將手勢信息通過串口的方式發送到PC 端,在PC 端對手勢信息進行分析,通過手勢分析將指令發送到Sawyer 機器人。當識別的手勢為兩指時,機械臂的手爪夾緊;當檢測的手勢為空鼠時候,機械臂的手爪張開,如圖7 所示。 當檢測的手勢為張開手掌時,機械臂進行搖頭操作。 指令模式下手勢對應指令見表2。

表2 指令模式下手勢對應指令Tab. 2 Instructions gesture correspond to gestures in instruction mode

圖7 指令控制實驗結果圖Fig. 7 Command control experiment result chart

3.3.2 跟隨控制模式

在這種控制模式下,機械臂不僅實現指令控制,而且可以跟隨手勢中心點移動,完成準確的物體夾取動作。 跟隨模式實驗結果如圖8 所示。

圖8 跟隨模式實驗結果圖Fig. 8 Experiment result diagram of in follow-up mode

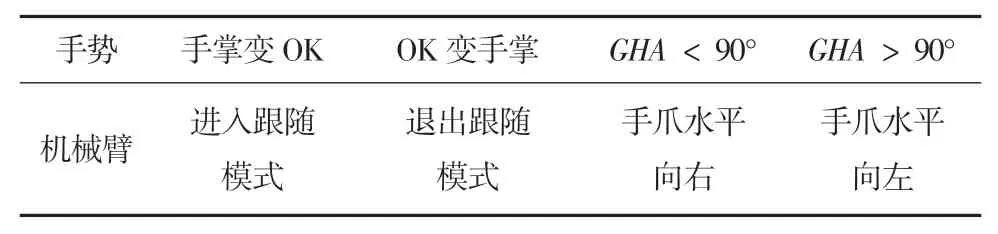

當檢測的手勢為手掌變OK 時,進入跟隨模式,手爪跟隨手勢中心點移動同時根據手勢水平方向的夾角來調整手爪的夾持方向。 當檢測的手勢為OK變手掌時,退出跟隨控制,稍后就可以利用指令控制進行物體的夾取。 跟隨模式下手勢對應指令見表3。表3 中,GHA(Gesture horizontal angle)表示手勢中1,10 兩個關鍵點與水平方向的夾角。

表3 跟隨模式下手勢對應指令Tab. 3 Instructions corresponding to gestures in follow-up mode

4 結束語

本文利用視覺識別的方法實現了手勢對機械臂的控制,最終的效果為機械臂跟隨手掌移動到指定位置后完成抓取動作。 本文設計了多種手勢動作,進行了機械臂的控制實驗,而后通過對YOLOv4 算法的改進,在訓練結果中引入了手勢方向的訓練,從而有效實現了在跟隨手掌移動過程中手爪夾持方向的問題,讓機械臂的控制更加靈活。