GNSS/INS/視覺組合導航數(shù)據融合研究探討

李凱林,李建勝,王安成

GNSS/INS/視覺組合導航數(shù)據融合研究探討

李凱林,李建勝,王安成

(信息工程大學 地理空間信息學院,鄭州 450000)

為了進一步提高導航定位的可靠性、精度、連續(xù)性和完好性,融合各類可用導航傳感器構成組合導航系統(tǒng)成為必然趨勢;隨著全球導航衛(wèi)星系統(tǒng)(GNSS)終端、慣性導航系統(tǒng)(INS)器件和視覺傳感器向模塊化、小型化、低成本不斷發(fā)展,GNSS/INS/視覺組合導航得到了廣泛關注。分析其研究進展:通過介紹GNSS/INS/視覺組合系統(tǒng)的基本結構與原理,總結出GNSS/INS/視覺組合系統(tǒng)關鍵技術發(fā)展現(xiàn)狀及行業(yè)應用情況;然后梳理GNSS/INS/視覺融合架構與典型算法;最后分析GNSS/INS/視覺組合系統(tǒng)中當前存在的主要問題與發(fā)展趨勢。

組合導航;數(shù)據融合;時空同步;聯(lián)邦濾波;圖優(yōu)化

0 引言

隨著綜合定位、導航與授時(positioning, navigation and timing,PNT)體系[1]和彈性PNT框架[2]的完善,多源PNT數(shù)據融合技術朝著智能融合和自適應融合不斷發(fā)展。為了防止國防行動過分依賴于全球定位系統(tǒng)(global positioning system,GPS),早在2010年,美國就開始謀劃國家綜合PNT架構[3],多源PNT系統(tǒng)在美軍的無人潛航器、無人機等無人自主平臺上應用廣泛[4],是未來無人系統(tǒng)自主導航發(fā)展的重點方向。全球導航衛(wèi)星系統(tǒng)(global navigation satellite system,GNSS)/慣性導航系統(tǒng)(inertial navigation system,INS)/視覺組合導航系統(tǒng)作為多源PNT系統(tǒng)的一種,單目相機和低成本慣性測量單元(inertial measurement unit,IMU)的融合可以顯著提高GNSS失效情況下的局部定位精度和魯棒性,而GNSS定位有效時可以為視覺/慣導組合導航位置解算提供全局性的定位軌跡修正,對研究低成本、高精度、高可靠性的導航方式具有重大意義。

國內外對GNSS/INS、INS/視覺2種傳感器組合的研究已經比較成熟,綜述類文獻比較多。文獻[5]對2009年以前20年內非線性濾波理論所取得的成果進行了總結,且闡述了它們的優(yōu)缺點及在組合導航系統(tǒng)中的應用情況。文獻[6]對新近的GNSS/INS自適應智能組合導航算法進行了分類并一一解析。文獻[7]對基于濾波技術的視覺/慣性組合技術做了全面的介紹,特別是對濾波器的客觀性和濾波狀態(tài)的一致性進行了深入分析。文獻[8]的研究中介紹了近年來發(fā)展迅猛的基于機器學習的視覺/慣性組合導航方法。GNSS/INS/視覺組合導航技術近年來取得了長足的發(fā)展,文獻[9]對GNSS/INS/視覺組合導航系統(tǒng)的現(xiàn)狀、架構、測量模型進行了全面的解析。國內在GNSS/INS/視覺組合方面的研究相對較少,這方面的綜述性文獻不多。本文首先介紹GNSS/INS/視覺組合導航系統(tǒng)組成,其次從數(shù)據融合方式和算法框架等層面給出GNSS/INS/視覺組合導航技術目前的整體現(xiàn)狀,最后分析GNSS/INS/視覺組合導航技術當前所處階段以及未來的發(fā)展趨勢,以期在GNSS/INS/視覺組合導航技術的系統(tǒng)層面和算法層面為后續(xù)研究提供參考。

1 系統(tǒng)組成與工作原理

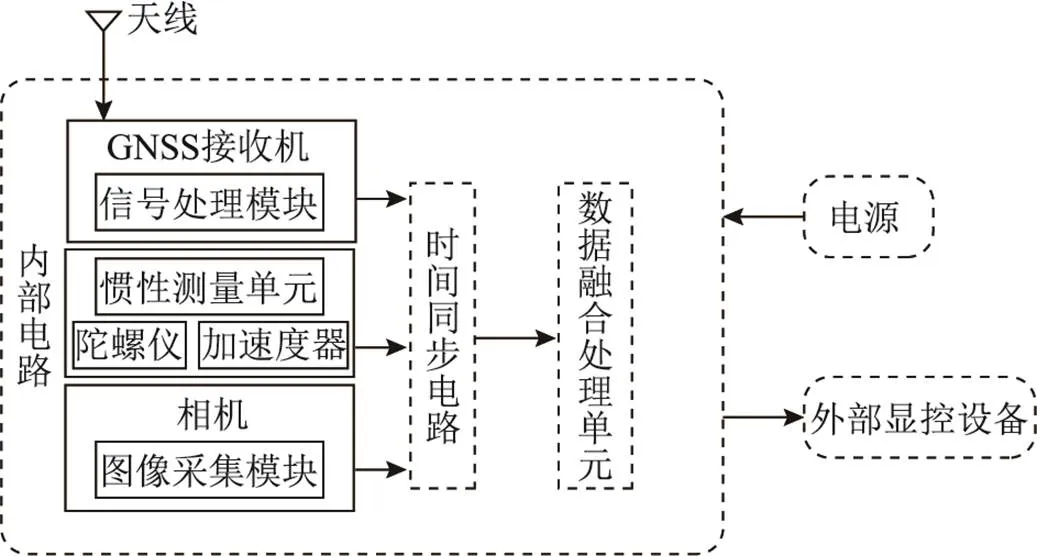

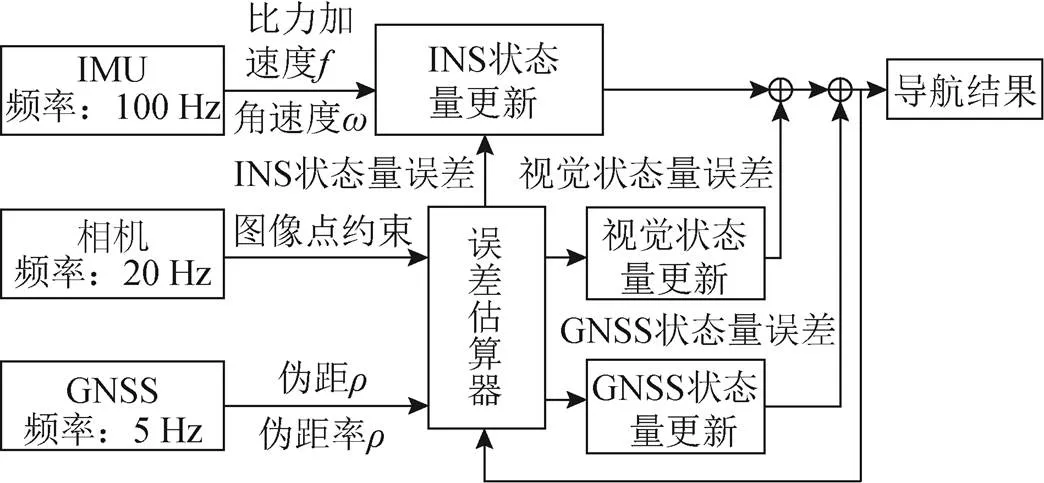

GNSS/INS/視覺組合導航系統(tǒng)按硬件結構可以劃分為GNSS接收機、慣性測量單元、圖像采集單元(相機)、時間同步電路和數(shù)據處理單元(如圖1所示)。

圖1 GNSS/INS/視覺組合導航系統(tǒng)組成

1.1 傳感器組成

GNSS/INS/視覺組合導航系統(tǒng)的傳感器由GNSS接收機、慣性測量單元和圖像采集單元(相機)3個部分組成。GNSS接收機在空曠環(huán)境下可以解算載體的位置、速度和航向,也能夠輸出偽距、偽距率、載波相位等觀測量。一般而言,其輸出頻率不超過10 Hz,在組合系統(tǒng)中輸出頻率最低。慣性測量單元由三軸陀螺儀和三軸加速度計組成,直接輸出慣性坐標系下的三軸角速度和比力測量值。慣性測量單元作為組合導航的核心單元,輸出頻率最高,一般為50、100、200 Hz甚至以上[10]。圖像采集單元即為一般意義上的相機,由視角數(shù)分類,有單目、雙目、全向相機等。相機用來提供對應時刻的圖像,為后續(xù)位姿估計提供原始數(shù)據。一般的相機輸出頻率可達20 Hz。在3種傳感器中,由于相機和IMU的輸出頻率較GNSS更大,因此在局部或短期內,利用相機和慣導的組合可以提供精度更高的定位定姿結果。

1.2 組合導航系統(tǒng)時空同步

在GNSS/INS/視覺組合導航系統(tǒng)中,由于3種傳感器具有不同的采樣電路和輸出頻率,需要時間同步電路實現(xiàn)數(shù)據之間嚴格的時間同步。時間同步的主要目的是為了避免數(shù)據融合時產生較大的時間偏移,導致系統(tǒng)發(fā)散,因此需要將傳感器輸出數(shù)據的時間戳統(tǒng)一到同一時間參考系下。除了硬件上的時間同步,在軟件層面上,需要對傳感器進行空間同步。空間同步的過程就是組合導航系統(tǒng)的初始化過程,用以確定各傳感器坐標系之間的旋轉平移關系。對于 GNSS/INS/視覺組合導航而言,需要同時確定GNSS和慣導的桿臂值以及相機和慣導坐標系之間的相機-慣導外參數(shù)。

1.3 數(shù)據融合框架

數(shù)據融合處理單元在硬件選擇上往往是一臺計算能力可觀的上位機,用來對經過時間同步后的傳感器數(shù)據進行融合,具體的融合框架視使用的算法結構而定。目前主流的算法框架有濾波和圖優(yōu)化2種。

利用融合結果重置子濾波器,進行時間更新。仿真結果表明,整體定位誤差控制在6 m以內。

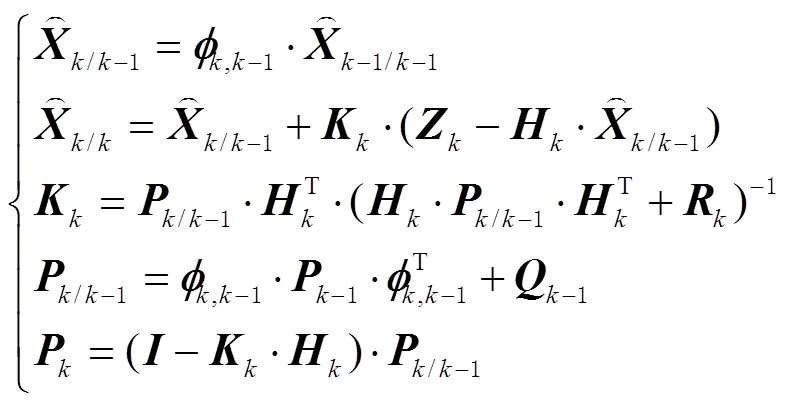

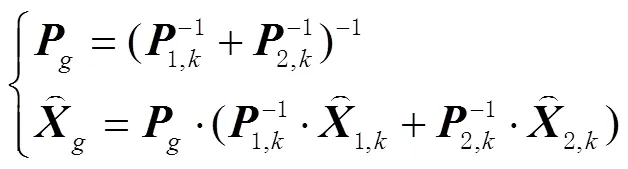

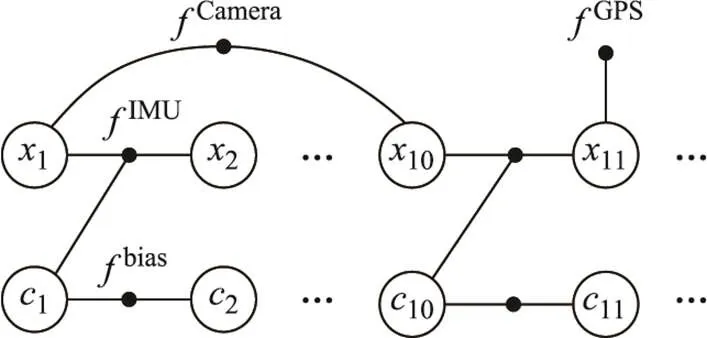

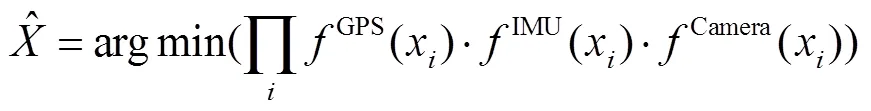

第二級濾波,即信息融合,融合過程的表達式為

在子濾波器的算法選擇上,GNSS/INS組合除了EKF之外,還有能夠有效解決顯著動態(tài)模型誤差問題的模型預測濾波器(models predictive filter,MPF)算法[12]、以近似非線性函數(shù)的概率分布為核心思想的無跡卡爾曼濾波(unscented Kalman filter,UKF)算法[13]和基于貝葉斯采樣估計的順序重要采樣濾波方法粒子濾波(particle filter,PF)算法[14]等等。相比于EKF,MPF能夠通過模型誤差實時調整系統(tǒng)模型,UKF在處理強非線性系統(tǒng)時具有更高的穩(wěn)定性和濾波精度,PF不受高斯模型以及非線性的限制。還有學者將EKF、MPF、UKF、PF等算法綜合應用于GNSS/INS組合濾波器中[15],取得了不錯的濾波效果。在INS/視覺子濾波器的選擇上,使用最廣泛的是多狀態(tài)約束卡爾曼濾波(multi-state constraint Kalman filter,MSCKF),該方法能在保證算法實時性的基礎上取得較高的精度。

2)基于圖優(yōu)化的算法框架。文獻[16]提到信息融合問題可表述為給定所有可用測度,計算系統(tǒng)狀態(tài)隨時間后驗概率的最大后驗概率( maximum a posteriori, MAP )估計值。其中因子圖優(yōu)化方法將系統(tǒng)狀態(tài)的改變表示成因子形式的遞進,因子圖模型如圖2所示。

以貴州習水案為例,此案中人們的普遍感受是,行為人主觀惡性大,造成社會影響十分惡劣,行為上符合強奸罪構成要件,但也許攝于行為人手中掌握的公權力的強大,他們被定為嫖宿幼女罪,替換了強奸罪,免去了強奸罪的更高刑法處罰,拿到了免死牌。惡劣行徑不能施以應有懲處,此罪因此被認為是讓人鉆了法律的漏洞。

圖2 因子圖模型

施工技術人員應在生產制造鋼結構構件時利用Tekla Structure軟件模擬建檔施工時間與構件制造時間,得到最佳的鋼結構施工工期,有效控制施工進度。實際施工期間,為了確保鋼結構工程在預期時間內完成,技術人員應有效開展工期控制,充分利用BIM技術的4D演示功能,全方程模擬鋼結構的施工情況。除此之外,在施工管理期間,技術人員還應利用4D模型全過程分析施工流程,及時發(fā)現(xiàn)施工期間存在的時間問題,并完善改進,提高施工效率。

并行式在GNSS/INS/視覺組合導航中,是將傳感器分組融合,最后再將組合結果進行融合,例如文獻[19]采用的聯(lián)邦卡爾曼濾波算法。算法結構如圖3所示,其中GNSS/IMU、IMU/相機分別構成2個子濾波器,將子濾波器的局部最優(yōu)估計輸入到主濾波器求解,得到最終導航結果。

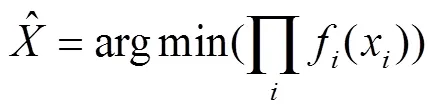

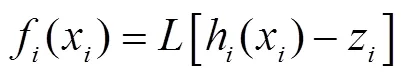

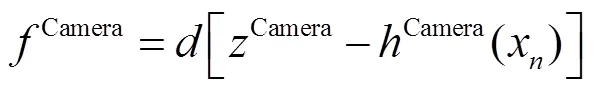

通常,因子節(jié)點所代表的誤差函數(shù)可以由導航系統(tǒng)的量測函數(shù)和測量值的差值給出,即

東博會舉辦的十幾年確實給南寧的旅游業(yè)帶來了極大的促進作用,南寧的知名度在一定程度上得到了提升,來南寧旅游人次每年都有不同程度的上升,但同時也存在較多問題。

1) 從通航設施看,船舶吃水主要受航道水深和船閘門檻水深兩方面制約,但結合航運實際經驗,考慮到進船閘時船舶航速較低,最大船舶限制吃水通常指向航道限制吃水。因此,船閘門檻水深一般不作為船舶通航的限制因素。

隨著新獲取的觀測信息,根據相應的觀測方程和代價函數(shù)進行變量節(jié)點的狀態(tài)更新。

文獻[17]分別采用基于因子圖框架的增量式平滑組合導航方法和傳統(tǒng)的擴展卡爾曼濾波方法,在裝配有IMU、光流傳感器的四旋翼無人機上進行實驗,結果驗證了基于因子圖的增量式平滑算法在即插即用和整體精度方面,相比傳統(tǒng)的濾波算法性能更好。

以佳能專業(yè)級膠片單反相機EOS-1V為藍本而開發(fā)的1Ds在機身性能上得到了充分性的優(yōu)勢性特顯,不論是機身的耐用程度還是操控性設計都超越了同時期的對手。再加上優(yōu)秀的對焦系統(tǒng)和成像,1Ds成了當時當之無愧的旗艦。1Ds機身設計指標足夠過硬,因此市場反響非常強烈,是一款極受歡迎的頂級產品。最終這款產品在2003年初上市后的三年的2006年內退市。

林孟是個性格開朗的人,他的茶杯是一只很大的玻璃瓶,裝速溶雀巢咖啡的玻璃瓶,他喜歡將一把椅子拖到門后,靠著門坐下來,端著那只大玻璃瓶,對著我們哈哈地笑,他的話超過十句以后,就會胡說八道了。他經常很不謹慎地將他和萍萍之間的隱私泄露出來,并且以此為樂,笑得腦袋抵在門上,把門敲得咚咚直響。

2 GNSS/INS/視覺組合導航系統(tǒng)發(fā)展與應用現(xiàn)狀

2.1 GNSS/INS/視覺組合導航數(shù)據融合方式

文獻[18]將多源傳感器的數(shù)據處理方法分為集中式、并行式和序貫式3類,GNSS/INS/視覺組合導航數(shù)據融合方式也是基于這3類發(fā)展的。

集中式立足于建立統(tǒng)一的觀測方程組求解導航參數(shù),缺點是隨著變量數(shù)增加,計算負擔會變得很大,實時性較差。由于各個傳感器的輸出頻度不一致,GNSS/INS/視覺組合導航中很少采用這種方式。

紫蘇葉總三萜超聲提取工藝優(yōu)化及對10種常見致病菌的抑菌作用研究 …………………………………… 魏 磊等(16):2193

圖3 聯(lián)邦卡爾曼濾波結構

序貫式是將各個傳感器的觀測量按照其輸出頻率依次融合,適應傳感器的輸出頻率不同的融合場景,融合結構靈活。例如,文獻[20]在對描述衛(wèi)星和特征點空間幾何分布強度的性能指標所展開的研究中,采用了序貫的數(shù)據融合模式。如圖4所示,IMU為核心傳感器,先利用更新頻率次于IMU的相機測量值與IMU測量值進行融合,最后再用更新頻率最低的GNSS測量值與二者結果進行融合。

圖4 序貫式數(shù)據處理方式

2.2 GNSS/INS/視覺組合導航算法框架

GNSS/INS/視覺組合導航技術是在GNSS/INS、INS/視覺組合導航技術的基礎之上發(fā)展的,因此很多方法繼承了傳統(tǒng)的組合導航卡爾曼濾波框架以及實時定位與地圖構建(simultaneous localization and mapping,SLAM)領域的圖優(yōu)化框架。

國外相關研究中,文獻[21]于2005年在GNSS/INS導航系統(tǒng)中融合了計算6自由度位姿的SLAM方法,仿真實驗結果表明,該系統(tǒng)能夠在GNSS拒止環(huán)境中提供可靠的導航解。但由于采用松耦合的濾波結構,在視覺信息的利用上不夠充分,精度有待提高。2012年文獻[22]同樣基于EKF采用松耦合模式構建了相機/IMU/GNSS 組合導航系統(tǒng),利用GPS偽距觀測值來恢復相機幀間尺度信息,從而計算幀間旋轉和平移,最后將結果與慣導進行松耦合。該方法中尺度的確定依賴于初始的GPS定位精度且在初始環(huán)境處于衛(wèi)星拒止條件時不可用。2013年文獻[23]提出了一種多傳感器融合的拓展卡爾曼濾波框架,能夠處理具有時延的相對測量和絕對測量。同年,文獻[16]提出了一種基于因子圖優(yōu)化的增量式平滑方法,該方法同樣采取松耦合方式。與卡爾曼濾波框架不同的是,該方法采用因子圖模型來表示聯(lián)合概率分布的最大后驗估計,充分利用了系統(tǒng)的稀疏性,提供了傳感器即插即用的能力,實現(xiàn)了多位姿約束下的整體最優(yōu)解,但仍存有誤差向下累積的問題。2014年,針對GNSS衛(wèi)星和視覺傳感器特征點分布不均勻,GNSS挑戰(zhàn)環(huán)境下的位置解算精度有時會下降的問題,文獻[20]提出并采用加權最小二乘法推導了衡量衛(wèi)星和特征點空間幾何分布強度的性能指標權重精度因子(weighted dilution of precision,WDOP),該成果在評估傳感器測量值質量上邁出了第一步。仿真和實測結果表明,WDOP值合理地對3種傳感器進行了選擇性集成,提高了GNSS挑戰(zhàn)環(huán)境下的定位精度。同年,文獻[24]首次將GPS載波相位差分計算出的位置測量值納入基于光束法平差的SLAM算法中,GPS差分得到的全局位置用于關鍵幀的選擇,IMU測量值只作用于導航濾波器來進行狀態(tài)更新,而不作用于后端批優(yōu)化(bundle adjustment,BA)。仿真表明,該系統(tǒng)在室外開放區(qū)域可獲得厘米級以上的絕對定位精度和分度級絕對姿態(tài)精度。自2013年,基于優(yōu)化的組合導航方法不斷發(fā)展延拓,到2018年,文獻[25]提出了一種基于解耦圖優(yōu)化的多傳感器融合方法(graph-optimization based multi-sensor fusion,GOMSF),該方法將融合看作視覺慣性里程計局部坐標系與全局坐標系之間的實時對準問題,通過優(yōu)化包含機器人最新狀態(tài)的滑動窗口位姿圖來不斷更新與這些坐標系相關的對準變換。實驗結果表明,該方法可以為無人機在非結構化室外環(huán)境中進行長期作業(yè)提供精確、高速率的位姿估計。

國內相關研究起步較晚,文獻[26]最早在2013年將數(shù)字可量測影像(digital measurable image,DMI)作為融合濾波框架的一部分與GPS/IMU進行松耦合,信息的融合與利用尚不夠充分。2015年,文獻[27]對基于GPS 位置的影像/ GPS/INS 組合導航算法開展了研究,采用GPS/INS松組合、INS/影像緊組合的模式。仿真與實驗結果表明,該算法能夠在局部GNSS拒止環(huán)境下提供較高的定位定姿精度。2017年,文獻[28]將卡爾曼濾波與圖優(yōu)化方法結合,通過GPS/INS卡爾曼濾波松組合,解算圖像幀初始位姿,從而解算特征點空間位置,最后用SLAM圖優(yōu)化方法對信息進行融合得到最終的定位定姿結果。該方法在GPS惡劣的情況下本質上是一種基于圖優(yōu)化的視覺慣性實時定位與建圖(visual inertial-simultaneous localization and mapping,VI-SLAM)方法。2019年,文獻[29]對低成本衛(wèi)星/慣性/視覺組合導航關鍵技術開展了研究,提出借助載波相位歷元間差分定位結果對系統(tǒng)進行約束,解決了由于偽距定位誤差較大而導致視覺慣導解算約束效果差的問題。位姿融合后位置精度優(yōu)于3 m,航向角精度優(yōu)于0.12°。同年,文獻[30]基于滑動窗口的非線性優(yōu)化方法提出了一種基于圖優(yōu)化的多傳感器狀態(tài)估計器視覺慣性系統(tǒng)-融合(visual-inertial system-fusion,VINS-Fusion),該方法采用視覺/IMU緊耦合的方式,獲得了較小的全局誤差漂移和厘米級的局部定位定姿精度。

總體上,GNSS/INS/視覺組合導航經歷了卡爾曼濾波框架到圖優(yōu)化框架的發(fā)展過程,這個過程很大程度上受到GNSS/INS組合導航、INS/視覺SLAM技術發(fā)展的影響。目前的研究大部分是在算法框架和濾波結構上的改進,在傳感器的接入策略和測量值的優(yōu)劣評價機制上進行的研究還比較少。

2.3 GNSS/INS/視覺組合導航系統(tǒng)應用

由于GNSS/INS/視覺組合導航硬件成本較低,因此廣泛應用于機器人、無人車等智能平臺,國內外眾多研究機構也發(fā)布了自己的數(shù)據集。例如,米蘭理工大學在輪式機器人上搭載單目、雙目、三目及全向相機、IMU、GPS接收機和激光測距儀等傳感器,搭建了一個適用于大場景的組合導航平臺[31]。德國卡爾斯魯厄理工學院于2012年公開了基蒂(KITTI)數(shù)據集[32],研究人員在自動駕駛平臺上搭載雙目相機、IMU、激光雷達、載波相位差分(real-time kinematic,RTK)/INS組合導航系統(tǒng),采集了不同城市、鄉(xiāng)村等場景下的多組數(shù)據,KITTI數(shù)據集是目前視覺、激光、慣導、衛(wèi)導組合導航方向使用最為廣泛的數(shù)據集。密歇根大學研究人員在平衡車上搭載了高精度GNSS接收機、全向相機、激光雷達、IMU等傳感器采集數(shù)據,于2015年公開了北校區(qū)長期數(shù)據集(north campus long-term,NCLT)[33]。阿爾托大學在2018年公開了一組真實的視覺慣性里程測量數(shù)據集(authentic dataset for visual-inertial odometry,ADVIO)[34],他們將GNSS、IMU 和相機集成在智能設備上,該數(shù)據集同樣被業(yè)界研究人員廣泛使用。此外,一些商用公司也開始設計和研發(fā)自己的組合導航智能平臺來滿足自身的自動駕駛需求,例如百度的阿波羅(Apollo)平臺、恩智浦的自動駕駛工具包(automated drive kit),以及英偉達(NVIDIA)的海普瑞開發(fā)者工具包( Hyperion developer kit)等等。

3 存在的問題與發(fā)展趨勢

近十年內,隨著濾波方法和圖優(yōu)化方法不斷發(fā)展,局部定位精度達到厘米級,GNSS/INS/視覺組合技術的發(fā)展也在不斷向前推進,總的目標是精度更高、實時性更好、硬件模塊化、環(huán)境適應力更強。未來的主要工作在以下幾個方面展開:

1)更具備環(huán)境挑戰(zhàn)性的數(shù)據集。目前的數(shù)據集如KITTI和ADVIO,數(shù)據質量相對完好。在GNSS數(shù)據方面,基本不存在如GNSS干擾區(qū)域、欺騙區(qū)域的數(shù)據;在視覺方面,對于光照強度變化大、紋理特征少、特征不明顯的區(qū)域,缺乏如隧道、地底通道等場景。由于環(huán)境魯棒性算法的研究依賴于涵蓋特殊場景的數(shù)據集,因此,目前的GNSS/INS/視覺組合算法所具備的魯棒性還只是停留在GNSS拒止環(huán)境下組合導航定位這一階段,未來的數(shù)據集將會具備更強的環(huán)境復雜度。

Application of the tongue-and-groove method in concrete pipeline joint construction

2)更具魯棒性的算法框架。目前的數(shù)據集不能滿足算法魯棒性的進一步拓展。文獻[20]建立了一種衛(wèi)星和空間特征強度的評估機制,是魯棒性算法的先驅性工作。傳感器數(shù)據是組合導航算法的基礎;基于傳感器的數(shù)據接入策略,應用于算法相關權重的數(shù)據質量評估機制將會成為未來魯棒性算法的拓展方向。其次,目前的算法框架都具有很強的獨立性。文獻[23]的濾波算法和文獻[16]的優(yōu)化算法各自在實時性和定位精度上尋求平衡點,二者在不同環(huán)境下具備各自領先的精度優(yōu)勢,未來的組合導航算法會考慮最優(yōu)的算法框架應用于當前環(huán)境,實現(xiàn)真正意義上的算法靈活性和魯棒性。

3)多機協(xié)同組合導航定位。目前國內外的組合導航平臺大多是單一的獨立平臺,是為數(shù)據采集、算法驗證服務的。鑒于未來導航任務的復雜性,在完成大場景、寬范圍的定位導航以及SLAM建圖任務時,單一平臺的工作效率往往很低,而且受到自身平臺誤差影響會很大,多機協(xié)同的定位與建圖模式能夠平衡單機誤差,并且成倍提高工作效率。但是由于目前無論是在誤差分析還是在算法模型上,多機組合的研究還不夠深入,GNSS/INS/視覺的組合在多機協(xié)同導航定位方向上還有很長的路要走。

傳統(tǒng)的教學評價過分強調了對學科知識的考查,而忽視了對學生思維品質、學習策略、情感態(tài)度、文化意識等方面的評價。殊不知,英語核心素養(yǎng)的培養(yǎng)離不開對學生思維能力的培養(yǎng)、對英語學習策略的點撥和對文化意識的灌輸。新課標指出,英語課程評價體系要有利于促進學生綜合語言運用能力的發(fā)展,要采用多元優(yōu)化的評價方式。所以,教學評價的內容和標準要以新課標為依據,優(yōu)化評價方式,從多個維度進行評價,形成科學、立體的多元評價模式,激發(fā)學生學習的積極性。

4)更加模塊化、小型化、低成本的GNSS/INS/視覺組合導航硬件。目前國內尚無公開報道滿足實用要求的GNSS/INS/視覺組合模塊,更多的是2種傳感器組合的設備集成來應用于GNSS/INS/視覺組合的定位,成本方面會偏高。文獻[29]設計的低成本衛(wèi)星/慣性/視覺組合導航具有模塊化的雛形,但是在小型化方面做得還不夠好。隨著視覺相機和慣導設備越做越小,GNSS定位元件目前也已經是芯片級,低成本的GNSS/INS/視覺組合導航定位器件將會做到更加模塊化、小型化。

很多家長會覺得被欺負就打回去,是最簡單粗暴有效的方式。但這種方式“粗暴”是夠粗暴的,但真的簡單和有效么?我們設想一下自己如果被“欺負”了會如何。

4 結束語

隨著研究的深入和技術的發(fā)展,GNSS/INS/視覺組合導航作為一種高精度、高可靠性、低成本的導航方式目前已經被廣泛采用。GNSS/INS組合導航技術的不斷發(fā)展以及VI-SLAM技術的推廣應用,都為GNSS/INS/視覺組合導航的融合與創(chuàng)新奠定了基礎,以低成本的組合方式來解決全域、無縫導航定位也將成為重點的研究方向。而未來的導航定位任務面臨更強的環(huán)境復雜度,GNSS和視覺技術的應用在很多具備挑戰(zhàn)性的環(huán)境中仍然存在很多難題需要解決。本文研究結果可為該領域學習者和研究人員提供參考思路。

[1] 楊元喜. 綜合PNT體系及其關鍵技術[J]. 測繪學報, 2016, 45(5): 505-510.

[2] 楊元喜. 彈性PNT基本框架[J]. 測繪學報, 2018, 47(7): 893-898.

[3] HUESTED P, POPEJOY P. National positioning, navigation, and timing architecture[C]//The Institute of Aeronautics and Astronautics(AIAA).AIAA SPACE 2008 Conference & Exposition. San Diego, California: ARC, 2008: 7785[2022-03-09].

[4] 薛春祥, 黃孝鵬, 朱咸軍, 等. 外軍無人系統(tǒng)現(xiàn)狀與發(fā)展趨勢[J]. 雷達與對抗, 2016, 36(1): 1-5,10.

[5] 趙琳, 王小旭, 丁繼成, 等. 組合導航系統(tǒng)非線性濾波算法綜述[J]. 中國慣性技術學報, 2009, 17(1): 46-52,58.

[6] 趙方, 吳凡. GNSS/INS自適應智能組合導航算法綜述[J]. 北京郵電大學學報, 2022, 45(2): 1-7.

[7] HUANG G. Visual-inertial navigation: a concise review[C]//The Institute of Electrical and Electronics Engineers (IEEE).2019 international conference on robotics and automation (ICRA). Brisbane, Australia: IEEE,2019:9572-9582[2022-03-09].

[8] 張禮廉, 屈豪, 毛軍, 等. 視覺/慣性組合導航技術發(fā)展綜述[J]. 導航定位與授時, 2020, 7(4): 50-63.

[9] AFIA A B. Development of GNSS/INS/SLAM algorithms for navigation in constrained environments[D]. Toulouse: Institut National Polytechnique de Toulouse, 2017.

[10] 莫善會. GNSS與視覺里程計輔助IMU的行人導航方法研究[D]. 成都: 電子科技大學, 2019.

[11] 薛偉羅晨, 岳富占, 董啟甲. 視覺輔助的INS/GNSS導航系統(tǒng)在動態(tài)場景下的特性分析[C]//中國衛(wèi)星導航系統(tǒng)管理辦公室學術交流中心.第九屆中國衛(wèi)星導航學術年會論文集: S10多源融合導航技術.北京:中國衛(wèi)星導航系統(tǒng)管理辦公室, 2018: 113-117[2022-03-09].

[12] CRASSIDIS J L, MARKLEY F L. Predictive filtering for nonlinear systems[J]. Journal of Guidance, Control, and Dynamics, 1997, 20(3): 566-572.

[13] JULIER S J, UHLMANN J K. A new approach for filtering nonlinear system[C]//The Institute of Electrical and Electronics Engineers (IEEE).Proceedings of the 1995 American Control Conference. Seattle, WA, USA: IEEE,1995: 1628-1632[2022-03-09].

[14] GORDON N, SALMOND D. Novel approach to non-linear and non-Gaussian Bayesian state estimation[J]. IEEE Proceeding of Institute Electric Engineering, 2002, 140(2): 107-113.

[15] MOURIKIS A I, ROUMELIOTIS S I. A multi-state constraint Kalman filter for vision-aided inertial navigation[C]//The Institute of Electrical and Electronics Engineers (IEEE).International Conference on Robotics & Automation. Brisbane, Australia: IEEE, 2007: 2-6[2022-03-09].

[16] INDELMAN V, WILLIAMS S, KAESS M, et al. Information fusion in navigation systems via factor graph based incremental smoothing[J]. Robotics and Autonomous Systems, 2013, 61(8): 721-738.

[17] LANGE S, SüNDERHAUF N, PROTZEL P. Incremental smoothing vs. filtering for sensor fusion on an indoor UAV[C]//The Institute of Electrical and Electronics Engineers (IEEE).Proceeding of International Conference on Robotics and Automation(ICRA). Brisbane, Australia: IEEE,2013: 1773-1778[2022-03-09].

[18] 唐璐楊, 唐小妹, 李柏渝, 等. 多源融合導航系統(tǒng)的融合算法綜述[J]. 全球定位系統(tǒng), 2018, 43(3): 39-44.

[19] CARLSON N A. Federated square root filter for decentralized parallel processors[J]. IEEE Transactions on Aerospace and Electronic Systems, 1990, 26(3): 517-525.

[20] WON D H, LEE E, HEO M, et al. Selective integration of GNSS, vision sensor, and INS using weighted DOP under GNSS-challenged environments[J]. Transactions on Instrumentation and Measurement, 2014,63(9): 2288-2298.

[21] KIM J, SUKKARIEH S. 6DoF SLAM aided GPS/INS navigation in GPS denied and unknown environments[J]. Journal of Global Positioning Systems, 2005,4(1): 120-128.

[22] CHU T, GUO N, BACKéN S, et al. Monocular camera/IMU/GNSS integration for ground vehicle navigation in challenging GNSS environments[J]. Sensors, 2012, 12(3): 3162-3185.

[23] LYNEN S, ACHTELIK M W, WEISS S, et al. A robust and modular multi-sensor fusion approach applied to mav navigation[C]//The Institute of Electrical and Electronics Engineers (IEEE). 2013 IEEE/RSJ International Conference on Intelligent Robots and Systems. Tokyo, Japan: IEEE, 2013:3923-3929[2022-03-09].

[24] SHEPARD D P, HUMPHREYS T E. High-precision globally-referenced position and attitude via a fusion of visual SLAM, carrier-phase-based GPS, and inertial measurements[C]//The Institute of Electrical and Electronics Engineers (IEEE).Position, Location and Navigation Symposium. Monterey, CA, USA: IEEE, 2014:1309-1328[2022-03-09].

[25] MASCARO R, TEIXEIRA L, HINZMANN T, et al. GOMSF: graph-optimization based multi-sensor fusion for robust UAV pose estimation[C]//The Institute of Electrical and Electronics Engineers (IEEE).International Conference on Robotics and Automation(ICRA). Brisbane, Australia: IEEE,2018:1421-1428[2022-03-09].

[26] 張曉東. 可量測影像與GPS/IMU融合高精度定位定姿方法研究[D]. 鄭州: 信息工程大學, 2013.

[27] 王力. 影像/GNSS/INS組合精密定位定姿方法研究[D]. 武漢: 武漢大學, 2015.

[28] 王加芳. GPS/Visual/INS多傳感器融合導航算法的研究[D]. 杭州: 浙江大學, 2017.

[29] 馮哲煜. 低成本衛(wèi)星/慣性/視覺組合導航關鍵技術研究[D]. 鄭州:信息工程大學, 2019.

[30] QIN T, CAO S, PAN J, et al. A general optimization-based framework for global pose estimation with multiple sensors[EB/OL]. [2022-03-09]. https://arxiv.org/pdf/1901.03642.pdf.

[31] CERIANI S, FONTANA G, GIUSTI A, et al. Rawseeds ground truth collection systems for indoor self-localization and mapping[J]. Autonomous Robots, 2009, 27(4): 353-371.

[32] GEIGER A, LENZ P, URTASUN R. Are we ready for autonomous driving? the kitti vision benchmark suite[C]// The Institute of Electrical and Electronics Engineers (IEEE).2012 IEEE Conference on Computer Vision and Pattern Recognition. Providence, RI: IEEE, 2012: 3354-3361[2022-03-09].

[33] CARLEVARIS-BIANCO N, USHANI A K, EUSTICE R M. University of Michigan north campus long-term vision and LiDAR dataset[J]. The International Journal of Robotics Research, 2016, 35(9): 1023-1035.

[34] CORTéS S, SOLIN A, RAHTU E, et al. ADVIO: an authentic dataset for visual-inertial odometry[C]//FERRARI V. Proceedings of the European Conference on Computer Vision(ECCV). Munich, Germany: Springer, 2018: 425–440[2022-03-09].

Discussion on development of GNSS/INS/Visual integrated navigation technology and data fusion

LI Kailin, LI Jiansheng, WANG Ancheng

(Institute of Geospatial Information, Information Engineering University, Zhengzhou 450000, China)

In order to further improve the reliability, accuracy, continuity and integrity of navigation and positioning, it is an inevitable trend to integrate various available navigation sensors into an integrated navigation system; furthermore, with the continuous development of global navigation satellite system (GNSS) terminals, inertial navigation system (INS) devices and visual sensors towards modularization, miniaturization and low cost, GNSS/INS/visual integrated navigation has received extensive attention. The paper analyzed the research development: the basic structure and principle of GNSS/INS/visual integrated system were introduced, and the key technology development status and industry application of the integrated system were summarized; then the visual fusion architecture and typical algorithms were sorted; finally, the main problems and development trends in GNSS/INS/visual integrated system were discussed.

integrated navigation; data fusion; space-time synchronization; federated filtering; graph optimization

P228

A

2095-4999(2023)01-0009-07

李凱林,李建勝,王安成. GNSS/INS/視覺組合導航數(shù)據融合研究探討[J]. 導航定位學報, 2023, 11(1): 9-15.(LI Kailin, LI Jiansheng, WANG Ancheng. Discussion on development of GNSS/INS/Visual integrated navigation technology and data fusion[J]. Journal of Navigation and Positioning, 2023, 11(1): 9-15.)DOI:10.16547/j.cnki.10-1096.20230102.

2022-03-31

李凱林(1998—),男,湖南婁底人,碩士研究生,研究方向為機器視覺與智能應用。

李建勝(1975—),男,湖北鐘祥人,博士,教授,研究方向為視覺導航、計算機視覺等。