基于T1增強成像的人工智能算法在肛瘺內口診斷中的可行性研究

袁軍, 陳欣悅, 常時新, 王樂, 周自明

肛瘺又稱肛管直腸瘺, 是肛管或直腸與肛周皮膚相通的肉芽腫性管道, 主要侵犯肛管, 故常稱為肛瘺。肛瘺內口多位于齒狀線附近, 外口位于肛周皮膚處。肛門腺和隱窩的感染被認為是瘺管形成的主要原因[1]。 肛周外瘺口破潰流膿、疼痛是肛瘺的臨床表現。肛瘺一旦形成, 病人自愈機會極少, 手術是治愈的唯一手段[2]。術中準確地尋找到內口并進行妥善處理, 是肛瘺手術根治、避免術后復發的重要保證。目前診斷肛瘺的常規影像檢查技術主要包括臨床檢查、直腸腔內超聲、螺旋CT檢查及磁共振檢查等[3-5]。其中, 磁共振檢查作為一種無創、易行的檢查技術手段, 由于其軟組織分辨率高, 具有可任意角度成像等優勢, 已經成為臨床用于診斷肛瘺, 確定內口及瘺管、瘺管走形的重要手段[6]。疑為肛瘺病人的磁共振掃描序列通常包括T1 WI、T2WI、T2壓脂成像(T2WI with fat-saturated, T2 WIFS)、擴 散 加 權 成 像(diffusion weighted imaging, DWI)、T1增強成像等。與其他序列相比, T1增強成像對提高復雜性肛瘺病人的內口定位準確性及分型評估具有更重要意義[7]。

人工智能(artificial intelligence, AI)是當前科學技術發展中的一門前沿學科[8], 其強大的后處理能力和進一步學習、分析能力逐漸得到醫療界的認可, 廣泛應用于醫學領域。如在肺小結節CT診斷[9]、糖尿病眼病的眼底鏡診斷[10]、惡性黑素瘤的皮膚鏡診斷[11]等。但在肛瘺的磁共振人工智能診斷方面目前還未有明確報道。卷積神經網絡(convolutional neural network, CNN)是AI領域中一種廣為應用的模型, 2012年在ImageNet圖像分類大賽上奪得冠軍的AlexNet[12]使得CNN正式進入大規模研究和應用階段。后來有研究在AlexNet的基礎上將網絡的層數增加到19層, 對圖像特征的提取能力進一步增強[13]。其后研究者發現在GoogLeNet中使用的Inception結構, 使用多個卷積核在不同尺度上提取圖像特征再進行融合, 能使模型更好地感知圖像[14]。ResNet模型使用的殘差單元能夠克服以往隨著網絡加深反而準確率下降的問題[15]。在ResNet的基礎上, 有研究在提出的DenseNet中使用了密集連接, 使得與ResNet具有相同性能的DenseNet的參數量減少了一半[16]。基于此, 本研究擬采用CNN模型對病人的磁共振T1增強圖像進行分類, 探討遷移學習及端到端學習兩種不同的AI算法技術對肛瘺內口診斷的價值及意義。

1 資料與方法

1.1 一般資料回顧性分析上海中醫藥大學附屬岳陽中西醫結合醫院2019年5月至2021年5月行肛管磁共振掃描病人103例。其中磁共振診斷為肛瘺并經手術確診的病人58例, 其中男39例, 女19 例, 年齡(41.39±10.12)歲, 范圍為20~59歲, 于58例病例中選取526幅顯示肛瘺內口的磁共振T1橫斷位圖像。正常病例45例。其中男32例, 女13例, 年齡(38.375±8.90)歲, 范圍為25~54歲, 于45例病例中選取522幅磁共振T1橫斷位的正常圖像。病人或其近親屬知情同意, 本研究符合《世界醫學協會赫爾辛基宣言》相關要求。

納入標準:①有詳細的手術記錄證實為肛瘺的病人;②術前行磁共振T1增強和其他常規序列掃描的病人。排除標準:①既往有肛周、直腸手術史者;②合并其他肛管疾病, 如腫瘤、克羅恩病;③不宜進行磁共振T1增強檢查病人。通過數據增強的方法將圖像擴增至3 400幅, 根據是否患病進行分層, 采用分層隨機抽樣的方法將數據分為訓練組(n=2 720)和驗證組(n=680)。

1.2 掃描設備所有病人均使用飛利浦ingenia3.0 T磁共振儀進行檢查, 采用體部線圈, 仰臥位, 頭先進, 以恥骨聯合為中心定位。T1增強采用mDixon-w序列, 層厚4 mm, 層間隔2 mm, Fov=250 mm×250 mm×110 mm, voxel=1 mm×1 mm×4 mm, TR=4.4 ms, TE=1.54 ms, flip angle=10°, 打藥后90 s采集圖像。

1.3 數據來源與增強將肛瘺病人及正常病例的Dicom格式圖像轉化為JEPG格式, 并調整對比度、亮度, 形成圖像集。圖像集中包括522幅橫斷位的正常圖像, 526幅顯示肛瘺內口的異常圖像。

出于增加圖像數量的考慮, 本研究使用Color Jittering進行數據增強。Color Jittering是一種基于色彩抖動的數據增強方式。通過改變原始圖像的圖像亮度(brightness)、飽和度(saturation)、對比度(contrast)和色調(hue)產生新數據。本研究進行4次色彩抖動, 將正常圖像擴增到1 692幅, 異常圖像擴增到1 708幅, 共3 400幅圖像形成擴增圖像集。

1.4 方法

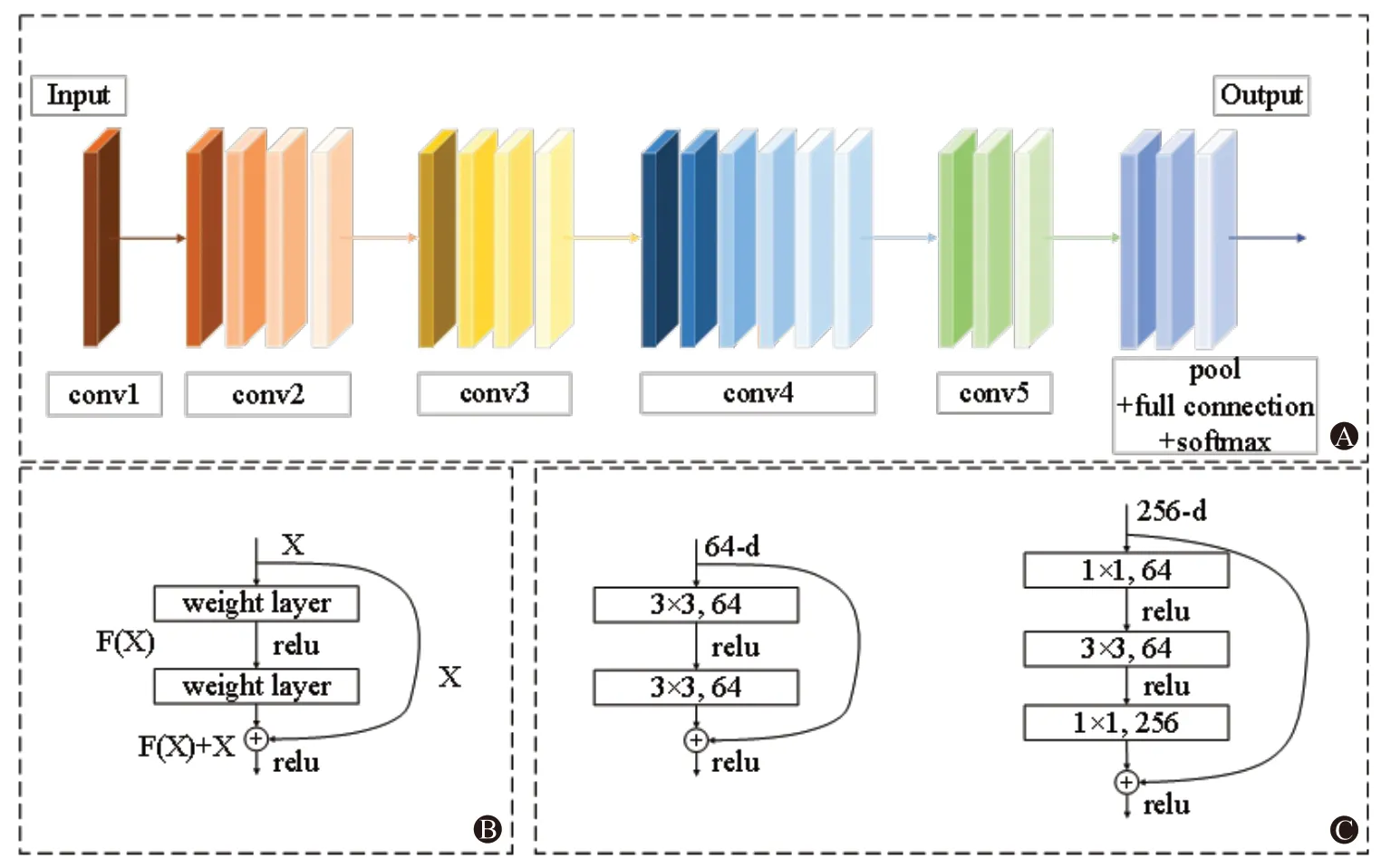

1.4.1 模型選用 現有研究發現, 在神經網絡訓練過程中網絡梯度會隨著網絡深度的加深容易造成梯度爆炸或梯度消失問題, 導致網絡Loss無法收斂, 易造成網絡無法更新或退化[17-20]。因此, 本研究在ResNet(圖1A)中引入殘差模塊(shortcut connection)來對抗深度學習中深層網絡的退化問題, 殘差模塊連接方式如圖1B所示。

該連接方式構成的殘差結構輸出xi如下式(1)所示, 包括兩部分即原本的輸入xi-1和殘差Fi(xi-1)。 ResNet不僅保留了輸入信息的完整性, 而且當網絡深度增加時, 殘差Fi(xi-1)會逐漸趨于0而只保留輸入xi-1, 從而解決網絡性能的退化問題。

本研究所用的兩種殘差模塊結構如圖1C所示, 左側為兩層殘差結構, 通過串聯兩個3×3卷積層構成, 參數較簡單, 泛化能力強。右側為三層殘差結構, 串聯兩個1×1和一個3×3卷積層, 能夠更加充分地學習復雜特征, 且由于在第一個1×1卷積層進行了降維, 降低了網絡的參數, 即使網絡的深度進一步增加也不會出現梯度爆炸問題。

圖1 用于肛瘺內口診斷的圖像分類模型ResNet結構及其連接方式:A為ResNet網絡結構;B為殘差模塊連接方式;C為兩種殘差模塊結構

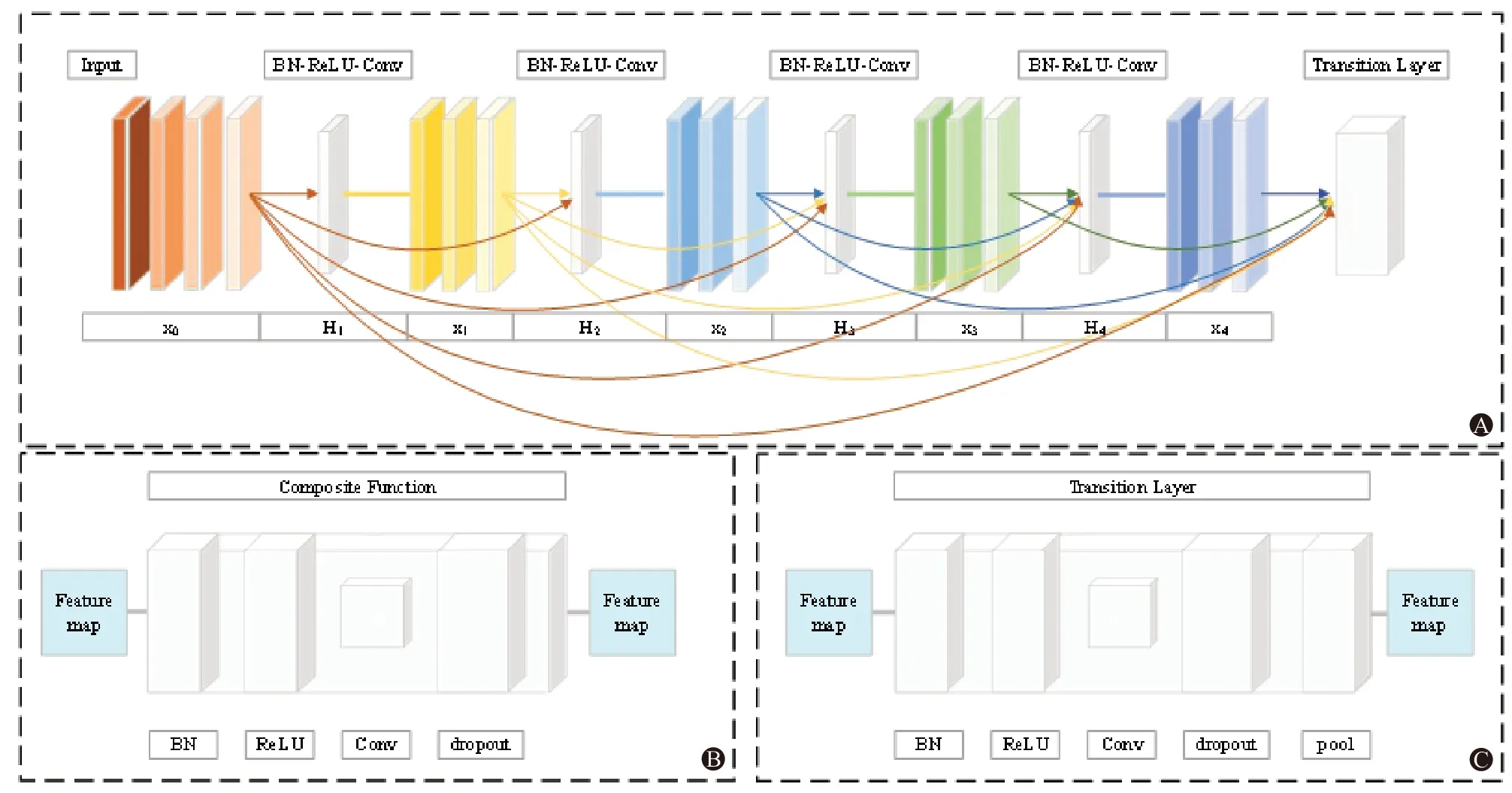

此外, 本研究還使用由密集塊(dense block)和過渡層(transition layer)組成的DenseNet[16]作為主要網絡進行訓練和測試。其中, 密集塊起到加強特征重用、緩解梯度消失的作用。過渡層則能夠降低密集塊輸出的特征通道數減少網絡的參數, 避免過擬合, 本研究DenseNet結構如圖2A所示。

復合函數之間的密集連接(dense connection)構成了密集塊, 與ResNet的設計類似, DenseNet也是直接將輸入與輸出相連, 但密集連接是將網絡的任意層均與其后所有層直接相連。如圖2A所示。

如式(2)所示, 后面層的復合函數的輸入xi-1取決于前面所有層的復合函數輸出Hi, 當前層的輸出又作為后面層的輸入。

[x0, x1, x2...xi-1]表示將0~i-1層的輸出深度級聯。如圖2B, 復合函數Hi主要由批量歸一化[16](batch normalization, BN)、ReLU激活函數層[21]、3×3的卷積層和dropout層構成。其中批歸一化是在網絡中任意一層對該層的輸入進行歸一化處理, 進而解決網絡訓練中的梯度消失或梯度爆炸問題。

密集塊之間為過渡模塊結構如圖2C所示, 主要由BN層、ReLU層、1×1卷積層、dropout層和池化層構成。過渡模塊將密集塊輸出的特征圖的通道數降低并輸入下一個密集塊中, 使得網絡參數量大大減少, 避免了網絡發擬合現象的發生。

圖2 用于肛瘺內口診斷的圖像分類模型DenseNet結構及其密集連接方式:A為DenseNet結構;B為復合函數結構;C為過渡層結構

1.4.2 遷移學習 深度學習需要大量的數據進行訓練, 但肛瘺病人及正常病例的數據較少, 因此使用遷移學習方法來提升網絡檢測準確率。本研究首先使用ResNet-18、ResNet-34和DenseNet-121在ImageNet數據集上進行預訓練, 然后將訓練得到的網絡各層權重作為遷移學習的初始化參數, 然后將模型遷移到肛瘺圖像數據集上進行訓練和微調。在ImageNet數據集上進行預訓練的模型能夠提升肛瘺圖像重要的顏色特征和紋理邊緣特征的提取能力。保留預訓練模型中全連接層前的各層參數, 然后使用肛瘺病人和健康圖像數據集進行全部層的遷移學習訓練, 得到基于ResNet-18、ResNet-34和DenseNet-121的肛瘺病人檢測模型, 最后進行模型預測和對比實驗。

2 實驗與結果

2.1 實驗環境實驗環境為基于ubuntu系統的tensorflow1.5, NVIDIA GeForce RTX 2080 Ti(11 GB), CPU為英特爾Xeon(R) silver 4210, 運行內存為64 GB。

2.2 評價指標診斷實驗需要具備正確診斷患病和未患病的能力, 從而準確反映疾病實際情況。本研究使用到的評價指標為靈敏度、特異度、受試者操作特征曲線(ROC曲線)和曲線下面積(AUC)。AUC能夠度量分類模型的好壞, AUC值越大, 模型的分類效果就越好。

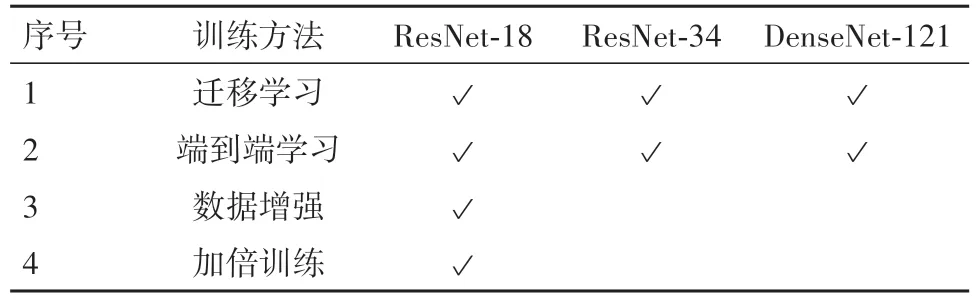

2.3 實驗設置本研究選用ResNet-18、ResNet-34和DenseNet-121進行訓練和驗證。設計以下兩個對比 實 驗:(1)分 別 對ResNet-18、ResNet-34和DenseNet-121進行端到端學習和遷移學習對照實驗。(2)選用ResNet-18, 并分別進行正常訓練(端到端學習)、遷移學習、改變訓練epoch以及數據增強的三組實驗, 實驗設置如表1所示。

表1 用于分析ResNet-18、ResNet-34和DenseNet-121模型病人檢測效果的八組對比實驗設置情況

2.4 實驗結果ResNet-18和ResNet-34使用遷移學習, epoch=50的loss曲線分析表明, 在原始數據集下訓練得到的ResNet-18模型不收斂, ResNet-34達到收斂。在使用增強數據集訓練后得到的ResNet-18達到收斂效果。通過修改訓練參數epoch為100, 使ResNet-18的訓練次數翻倍, 得到的loss曲線同樣達到收斂效果。證明本研究采用的數據增強方法達到預期結果。

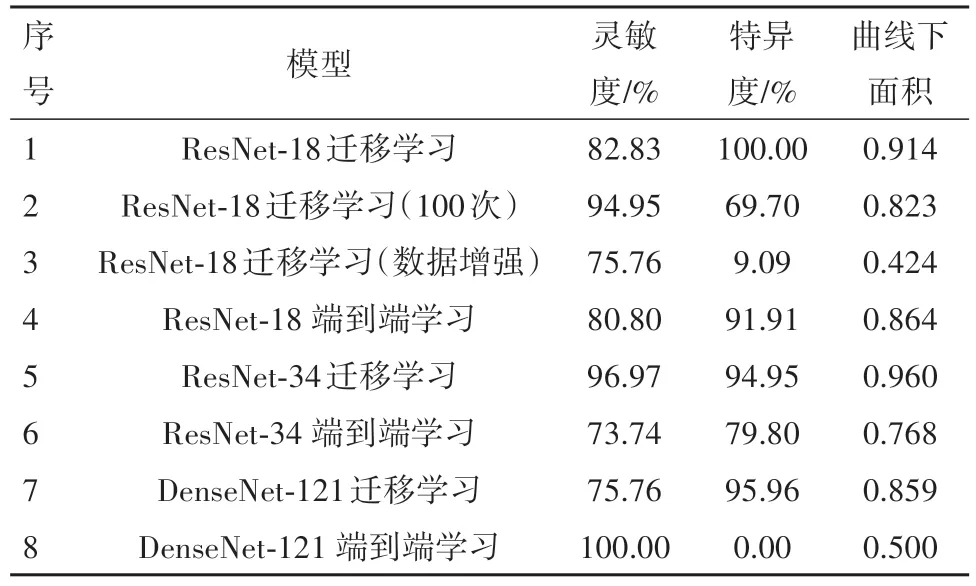

以ROC曲線分析對比八組實驗, 其中效果最好的是基于遷移學習的ResNet-34模型, 能夠在較低的假陽性率下取得最高的真陽性率, 說明該模型的漏診率和誤診率均較低, 能夠滿足病人的診斷需求。每個模型在測試集上的靈敏度、特異度、AUC值如表2所示。通過將第1組和4組、5組和6組、7組和8組分別對比得出, 同種網絡在其他條件都相同時, 使用遷移學習比使用端到端學習訓練得到的模型AUC值大, 證明使用本研究使用的遷移學習方法達到了預期效果。

表2 用于分析ResNet-18、ResNet-34和DenseNet-121模型病人檢測效果的八組對比實驗的實驗結果

對比第1組和第5組數據, ResNet-18和ResNet-34的AUC值均在0.9以上;而在第7組和第8組數據中, DenseNet-121兩種模型的效果差于同條件下兩類ResNet模型, 但使用遷移學習的模型也在0.85以上。根據“2.2”中的指標, 在第1、5、7三組中使用遷移學習的網絡模型都屬于效果較好的分類器, 但其中AUC最大的是ResNet-34, 證明分類效果最好的是使用遷移學習的ResNet-34模型。

同時, 比較第1組和第5組數據的靈敏度與特異度后, ResNet18模型的特異度更高, 但靈敏度較低。而ResNet-34模型的靈敏度更高, 特異度相對低。特異度高表示誤診率低, 即使用ResNet-18遷移學習模型時, 對正常圖像的判斷結果較準確, 但同時由于其靈敏度較低, 對異常圖像的分類不夠準確。靈敏度高表示漏診率低, 即使用ResNet-34遷移學習模型時, 對異常圖像的判斷結果較準確, 能夠達到對肛瘺病人的診斷要求。

3 討論

肛瘺由于其瘺管、內口數量和位置的不確定性, 容易造成術后復發。術前磁共振檢查可以有效地提高診斷的準確率并對瘺管走形與分布提前進行了解, 有利于后續手術的開展。尤其是T1增強序列, 由于肛瘺的內口及瘺管通常由豐富的炎性肉芽組織組成, 所以在T1增強序列上可呈現出不同程度強化, 這種對比增強為快速診斷內口提供了依據。由于內口位置關系, 有時會受到周圍水腫組織的擠壓而變形, 當臨床及影像醫生面臨大量磁共振圖像數據時, 有可能存在診斷不準確的情況。因此, 快速準確地進行肛瘺的診斷特別是內口的尋找, 對提高診斷準確率, 提升診斷效率, 提供臨床分型依據, 具有重要價值。AI技術的進步為快速準確尋找肛瘺內口提供了支撐。由于瘺管圖像紋理復雜, 需要使用較深的CNN提取特征, 但隨著網絡深度的增加可能會發生準確率下降的問題。ResNet中使用的殘差單元避免了該問題的發生, 且在利用圖像深層特征的基礎上對醫學圖像的分類性能優異[22]。由于使用了密集連接, DenseNet在和ResNet保持相同的分類精度的同時其網絡模型的參數量和運算量大大減少, 在最少的存儲和運算基礎上實現對醫學圖像的精確診斷[23]。

端到端模型往往需要更多的數據樣本訓練才能使得模型收斂而不至于過擬合, 因此本研究采用遷移學習的方式來完成網絡模型的訓練, 并與端到端的學習方式做了對比分析。研究表明, 不同數據集的圖像分類任務間通過微調可以有效地共用網絡模型參數, 甚至共用數據集, 并能取得良好的效果[24]。也就是說可以使用ImageNet 訓練的網絡模型的權值, 初始化網絡從而進行遷移學習。

遷移學習作為一種常用的模型學習方法, 可以根據任務之間的相似性, 進行模型的遷移, 試圖盡可能地將一個任務已有的經驗類推到另一個任務上, 輔助完成另一個任務, 解決弱計算的矛盾。基于模型的遷移方法是指從源域和目標域中找到它們之間共享的參數信息以實現遷移[24]。

根據不同的實現方法, 遷移學習分為(1)基于樣本的學習;(2)基于特征的學習;(3)基于參數的學習;(4)基于相關性的學習。其中, 最常用的方法就是基于參數的學習, 即在不同的任務領域中共享網絡結構, 論文中進行基于參數的遷移學習, 在基于ResNet網絡和DenseNet網絡在ImagNet數據集預訓練所得模型參數基礎上, 在實驗中進行參數微調, 使得提取特征區域更加匹配于肛瘺病變區域, 從而使得模型逐漸適應影像特征的提取。

在本研究中, 我們基于殘差網絡模型采用遷移學習方法構建了較為準確的肛瘺識別診斷模型。在保證網絡深度的情況下, 有效緩解影像數量不足的問題, 使得網絡能夠充分提取圖像的淺層及深層特征, 提高網絡性能及識別準確率。

4 結論

綜上所述, 本研究使用遷移學習策略訓練得到的ResNet-34模型的靈敏度高、漏診率低, 特異度高、誤診率低, 可以有效識別肛瘺內口, 對提高臨床診斷準確性及提升診斷效能有重要意義。可在此研究基礎上, 拓寬該智能診斷模型在其他肛周病變檢測與輔助診斷的相關研究, 擴大樣本量并優化迭代算法, 進一步提高診斷效能。