面向小樣本學習的動態分布校正方法

趙金偉,任文靜,周錦繡,黑新宏*

(1.西安理工大學 計算機科學與工程學院,陜西 西安 710048;2.網絡計算與安全技術陜西省重點實驗室,陜西 西安 710048)

0 引 言

人類顯著的一個標志是能夠僅通過一個或幾個示例就快速建立對新概念的認知能力,可以將先驗知識快速推廣到僅包含少量具有監督信息樣本的學習任務中。例如,兒童只需觀察幾張有關斑馬與犀牛的圖片就能輕松通過以前的認知經驗識別出“斑馬”與“犀牛”。相比之下,大多數機器學習算法需要大量數據。在實際應用中,由于采集得到的數據往往難以標注或標注成本很高,所以只能得到大量未標記數據。這時模型容易陷入過擬合或者欠擬合的困境。由此可見,目前人工智能與人類智能仍存在巨大差距。

受到人類學習觀點的啟發,小樣本學習(few-shot learning)的概念被提出,近幾年得到廣泛關注,在圖像分類任務上已取得重大發展。如Li等人[1]使用貝葉斯學習框架求解單樣本學習問題。人們又提出了許多基于元學習的解決方案,其核心思想是將從其它學習任務中得到的元模型遷移到新學習任務中。但是訓練得到的元模型的結構往往過于復雜,如網絡層數太深或者網絡參數過多,模型訓練過程十分困難。在這類方法中通常假設目標小樣本學習任務的訓練樣本集的分布特征與輔助訓練樣本集的分布特征一致。

除了圖像分類任務,在其他領域中也存在著小樣本問題。在計算機視覺領域,利用小樣本學習進行人臉識別[2]、手寫字體識別[3]等。在自然語言處理領域,使用小樣本方法實現對話系統[4]、口語理解[5]等。在生物與醫學領域, 可以應用于疾病診斷[6]、水量分析[7]等。

最近的工作試圖利用有限數量的樣本來評估樣本的真實分布。因為樣本特征空間的分布更具有可分性,所以這類方法嘗試對小樣本特征空間的分布進行校準,將有偏差的小樣本分布向真實分布逼近[8]。他們假設特征向量的每個維度服從高斯分布,基于“相似的類別具有相似的分布和相似的屬性值域”的思想提出將基類特征分布的統計量遷移到相似的小樣本類中以校正其特征分布[9]。基于這種校準分布方法即可得到更精確的小樣本特征分布,再通過隨機采樣即可增廣出更多的樣本。然而,該類方法直接遷移距離小樣本均值中心最近的前k個基類的特征分布,且只考慮最近鄰類分布特征在校正中的正作用,未考慮遠域類分布特征的負作用,另外計算兩類之間的相似度時未考慮樣本特征的量綱差異,在分布校正階段,更多地強調了基類的分布特征,忽略了新類本身的分布特征。這些問題極易引起知識的負遷移現象。

為此,該文提出了動態分布校正方法來解決上述問題,貢獻如下:

(1)為了減弱基類特征分布統計量造成的負遷移現象,提出通過主動或自適應地基于閾值來選擇近鄰基類或遠域基類的正向校正或負向校正,并主要研究基于閾值動態選擇近鄰基類。通過實驗證明提出的動態篩選基類的方法比靜態篩選方法更有利于實現分布特征的正遷移。

(2)因為嵌入特征量綱不同易導致嵌入特征分布各向異性,從而造成對新類分布特征的負遷移。故該文提出對嵌入特征進行冪變換后,再對其進行標準化處理,以消除嵌入特征量綱之間的差異。并通過實驗證明加入標準化操作后的分類精度要優于不加標準化的分類精度。

(3)引入懲罰參數來校正基類對新類嵌入特征分布的影響,并通過實驗證明加入懲罰參數有利于實現分布特征的正遷移。

在常規的數據集miniImageNet和CUB上與其它最新方法的對比實驗驗證了提出的動態分布校正方法可以有效地提升小樣本分類任務的性能。

1 相關工作

小樣本學習是一個具有挑戰性的機器學習問題。研究人員提出基于模型微調的方法解決小樣本問題。該方法是小樣本學習中較為傳統的方法,通常在大規模數據集上預訓練神經網絡模型,在目標小樣本數據集上對模型的全連接層或者頂端幾層進行參數微調,得到微調后的模型。目前許多工作已經證明,與基線模型相比,加入微調可以有效提高5-way-1-shot任務的準確率。目前基于模型微調方法的研究取得了較好效果。Cai等人[10]通過利用基于一階MAML的元學習算法將微調集成到訓練過程中并在微調期間對支持集進行數據增強。基于模型微調的方法較為簡單,適用于目標域與源域數據分布較為類似的情況,但是在現實場景中該條件難以保證,采用模型微調的方法會導致在目標任務上出現欠擬合或過擬合現象。

基于數據增強方法是指借助輔助數據或輔助信息,對原有的小樣本數據集進行數據擴充或特征增強。對于數據集數據增強主要是對輸入數據的轉換,旨在通過對數據進行少量修改來擴展現有數據來實現模型輸入的多樣性。Zhang等人[11]提出當源類和目標類都只有有限數量的樣本時,實現從互聯網資源中抓取數據,并自動去除無關噪聲,以實現可控的數據擴充。對于特征級數據增強,主要將像素信息映射到高維潛在空間,它比原始像素攜帶更多有效信息。如Chu等人[12]提出一種基于最大熵圖塊采樣算法的強化學習模型來解決小樣本學習問題。Zhang等人[13]提出兩種前景背景融合策略,將圖像分割成前景與背景,選擇原始圖像、前景圖像和背景圖像重新縫合為新的視覺特征。Li等人[14]提出可微分自動數據增強,可大幅度降低成本。Kang等人[15]針對特殊數據缺失、連續長期數據缺失等問題,提出一種圖矢量化算法與條件Wasserstein生成對抗網(CWGAN)相結合的方法實現數據增強。Schwartz等人[16]基于一個經過修改的自動編碼器,只需通過幾個示例,就可以學習為一個看不見的類別合成新樣本。然而基于數據增強方法有可能引入許多噪聲,對小樣本分類的效果造成負面影響。

基于遷移學習的方法是目前較為前沿的方法,是指將舊知識遷移到一個新的領域中。基于遷移學習的方法又可分為基于度量學習、基于元學習的方法。度量學習也稱為相似度學習,是指通過給定的距離函數計算兩個樣本之間的距離,從而度量它們的相似度。將度量學習的框架應用到小樣本學習,通過計算待分類樣本和已知分類樣本之間的距離,找到鄰近類別來確定待分類樣本的分類結果。Koch等人[17]最先提出使用孿生神經網絡進行單樣本圖像識別。通過有監督的方式訓練孿生網絡,并將網絡所提取的特征進行單樣本或小樣本學習。Vinyals等人[18]繼續就單樣本學習問題進行深入探討,提出了匹配網絡,該網絡為支持集和查詢集構建不同的編碼器,最終分類器的輸出為支持集樣本與查詢集之間預測值的加權求和。為進一步深入解決小樣本問題,Snell等人[19]提出原型網絡,該網絡使用深度神經網絡將圖像映射成向量,對同屬一個類別的樣本,求得這一類樣本向量的均值作為原型,并比較查詢集與每個類別原型的歐氏距離。基于度量學習的方法最簡單、容易操作,只需通過距離來衡量樣本之間的相似度。但是學到的知識較少,并且在樣本數量較少的情況下,簡單地通過距離衡量相似度的方法準確率會有所降低。基于元學習比基于度量學習的方法學習能力更強,可以學到更多的知識。元學習是目前解決小樣本學習的主流方法。元學習也叫做學會學習[20],是機器學習領域一個前沿的研究框架,針對于解決模型如何學習的問題。元學習的目的是讓模型獲得一種學習能力,這種學習能力可以讓模型自動學習到一些元知識。例如,UMTRA[21]、MAML[22]、Meta-SGD[23]、爬行動物[24]和LEO[25]優化了模型,使其能夠快速適應新任務。然而,基于元學習解決小樣本問題時時空復雜度較高,而且對于目標域與源域數據分布要求較高。

2 動態分布校正

2.1 問題設置

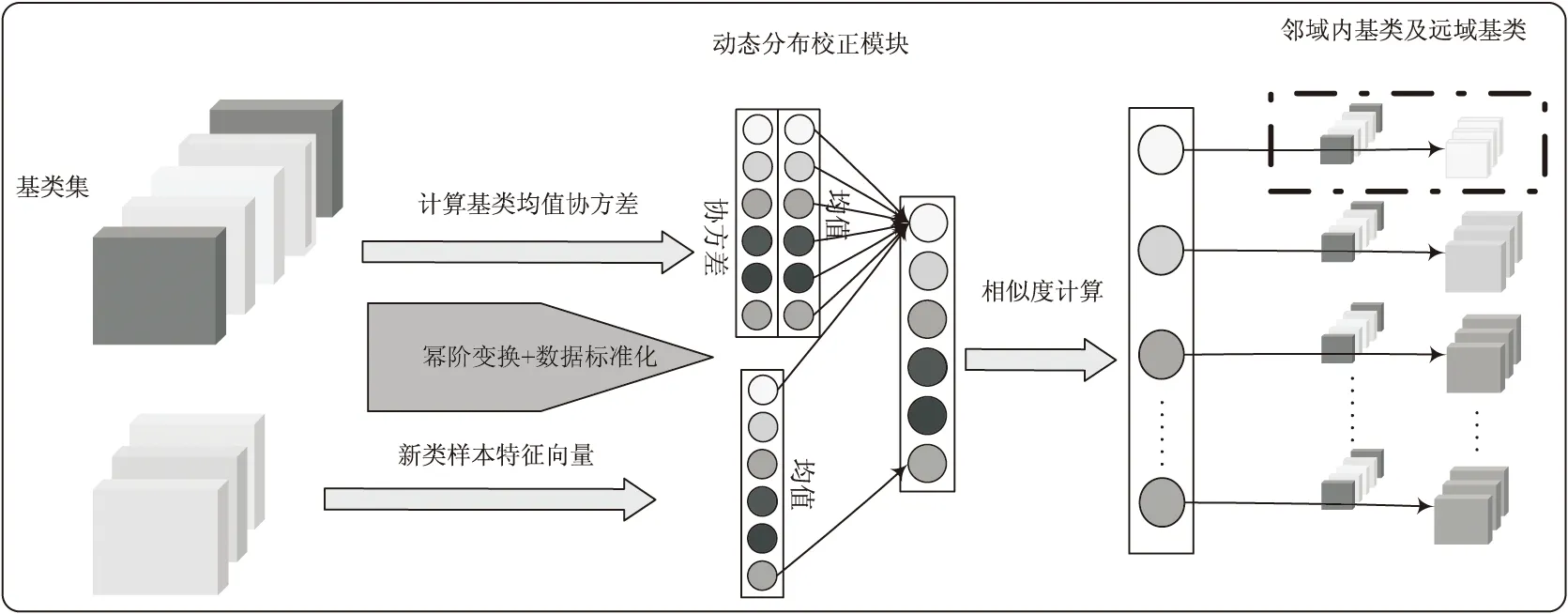

框架主要包括兩個階段。在第一階段,利用預訓練的模型提取樣本特征,計算基類的統計信息。在第二階段,為使特征分布更像高斯分布,使用冪階變換操作保證目標任務中的支持集和查詢集的特征接近于高斯分布,并加入特征向量標準化處理來消除特征量綱影響。為了避免“負遷移”,通過距離閾值動態挑選近鄰基類與遠域基類,并引入校正參數,校正新類的樣本特征分布。最后利用校正后的分布生成特征與小樣本任務的原始支持集特征一起用作特定任務分類器的訓練數據。

整個過程如圖1所示。新類樣本分布的校正過程分為兩個階段。第一階段為計算基類分布的統計量。第二階段是動態分布校正階段,計算基類與新類之間的嵌入空間的距離,基于閾值選擇近鄰基類與遠域基類的分布特征,將其遷移到新類中對其分布進行校正,基于校正后的分布采樣足夠數量的樣本來增廣新類的訓練樣本集。

圖1 動態分布校正方法

2.2 基類的統計信息提取

假設基類的特征分布為高斯分布。基類i的特征向量均值為該類所有數據的特征向量在每個維度上的均值。

(1)

(2)

2.3 校正新類分布

2.3.1 冪變換

為了實現嵌入空間不同類分布特征的正遷移,除了將每個類的樣本從原始樣本空間映射到嵌入空間,還需將嵌入空間的特征向量進行冪階變換,將每個類的支持集和查詢集樣本的嵌入空間分布變換為類高斯分布。該文基于單位方差投影給出類似于Tukey的冪階變換(Power Transform,PT),其公式如下:

(3)

為了避免除數為零,其中,ε=1e-6。β為指數,通過調整β來減少冪變換結果分布的扁平程度,其中β=1時為線性變換。單位方差投影將特征向量縮放到單位空間,以進一步縮小相似類間的分布差異。

將經過冪變換的特征向量x'的每一維進行數據標準化處理來實現特征向量的各向同性。

(4)

2.3.2 基于分布特征遷移的新類分布校正

(5)

(6)

(7)

(8)

(9)

其中,φ為對新類中心點進行校準的權值參數以表征鄰域內基類的正遷移作用強度,a為新類分布中樣本嵌入特征分散程度的偏置。

(10)

(11)

其中,b,c∈[-1,1],n,v∈[-1,1]為對新類中心點進行校準的權值參數,b和n為正遷移作用的強度,c和v為負遷移作用強度,e∈[0,1]為新類分布中樣本特征分散程度的偏置。

2.3.3 數據增強

為了避免一個特定樣本所提供的偏差并獲得更多樣化和更準確的新類分布特征估計,基于新類支持集中的每個樣本的嵌入特征向量都要進行動態分布校正。因此,對于每個新類進行動態分布校正后,會得到一組分布特征,將校正后的分布表示為一組統計數據。對于類別y∈Cn,將新類特征分布的統計數據表示為:

對于類別y的目標任務,利用其校正分布集合中的所有分布組合全部采樣,生成一組標簽為Dy的特征向量:

Dy={(x,y)|x~N(μ,γ),?(μ,γ)∈Uy}

其中,將每個類別生成的特征總數設置為超參數。將生成的樣本特征與原始支持集特征一起作為任務分類器的訓練數據,并通過最小化支持集特征和生成特征上的分類交叉熵損失來訓練分類器。

3 實 驗

3.1 實驗設置

該文使用miniImageNet、CUB兩種數據集,并利用查詢集的準確率作為評估指標來衡量方法的性能。在5-way-1-shot和5-way-5-shot分類設置上進行評估實驗,并且實驗結果是10 000個任務的平均分類精度。

本章節使用文獻[26]訓練的WideResNet作為特征提取器,并分別使用SVM與LR兩種分類器來驗證所提方法的有效性。其中Logistic Regression/SVM with DC (ours)表示分類器為Logistic Regression或SVM的基于閾值選擇近鄰基類的方法,利用粒子群算法對動態分布校正算法的超參數進行尋優,兩種數據集下最終得到的最優超參數為:miniImageNet:threshold=3.3,β=0.7,φ=0.2,a=0.1,生成樣本的個數為850;CUB: threshold=3.3,β=0.8,φ=0.5,a=0.1,生成樣本的個數為850。Logistic Regression/SVM with RDC (ours)表示在分類器為Logistic Regression或SVM的基于閾值同時選擇近鄰基類與遠域基類的方法。同樣采用粒子群算法獲得最優超參數。miniImageNet:threshold=2.5,t=2,β=0.7,b=0.15,c=0.05,n=0.4,v=0.05,e=0.3,生成樣本的個數為850;CUB:threshold=2.5,t=2,β=0.8,b=0.6,c=0.0,n=0.65,v=0.05,e=0.3,生成樣本的個數為850。3.2節中其他先進技術的具體實驗細節設置引用于他們的來源論文。

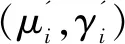

3.2 與最先進技術的性能對比

表1給出了動態分布校正算法與目前最先進的小樣本學習技術的分類性能對比。從表中的結果發現,所提方法的分布校準性能遠高于最先進的小樣本分類方法,這證明所提方法能夠更好地處理極低的樣本的分類任務。從表1發現,所有分布校正方法在四個任務上的分類精度明顯高于其它方法。說明分布校正方法在解決小樣本分類問題上性能是很優秀的。表中將提出的兩種動態分布校正算法與分布校正算法進行對比。兩種數據集下的兩種動態分布校正方法相比分布校正方法的分類精度都平均提升2%左右,并且所提方法的分類精度的方差更小。這些結果說明,提出的兩種方法能進一步提升分布校正方法的性能,并且相對于分布校正算法,進一步說明所提動態篩選基類的方法比靜態篩選方法更有利于實現分布特征的正遷移。

表1 miniImagenet和CUB數據集上的分類準確率 %

將Logistic Regression/SVM with RDC與Logistic Regression/SVM with DC相比較。對于兩種數據集的5-way-1-shot分類任務,從表1中可以觀測到Logistic Regression/SVM with RDC算法的分類精度比Logistic Regression/SVM with DC算法平均提升了1%左右。在兩種數據集的5-way-5-shot分類任務上,Logistic Regression/SVM with RDC算法的分類精度比Logistic Regression/SVM with DC算法平均降低了1%左右。說明當小樣本分類任務的原始樣本較多,樣本分布多樣性較強時,遠離新類的基類分布特征會帶來負遷移。相反,當小樣本分類任務的原始樣本較少,樣本分布多樣性較弱時,遠離新類的基類分布特征會增強原始樣本分布的多樣性,從而帶來正遷移。

3.3 超參數對算法性能的影響

將基于閾值動態選擇近鄰基類(Logistic Regression/SVM with DC(ours))作為主要的研究方法。在兩個數據集的5-way-1-shot分類設置且分類器選為LR的情況下,研究超參數的設置對該方法分類性能的影響。

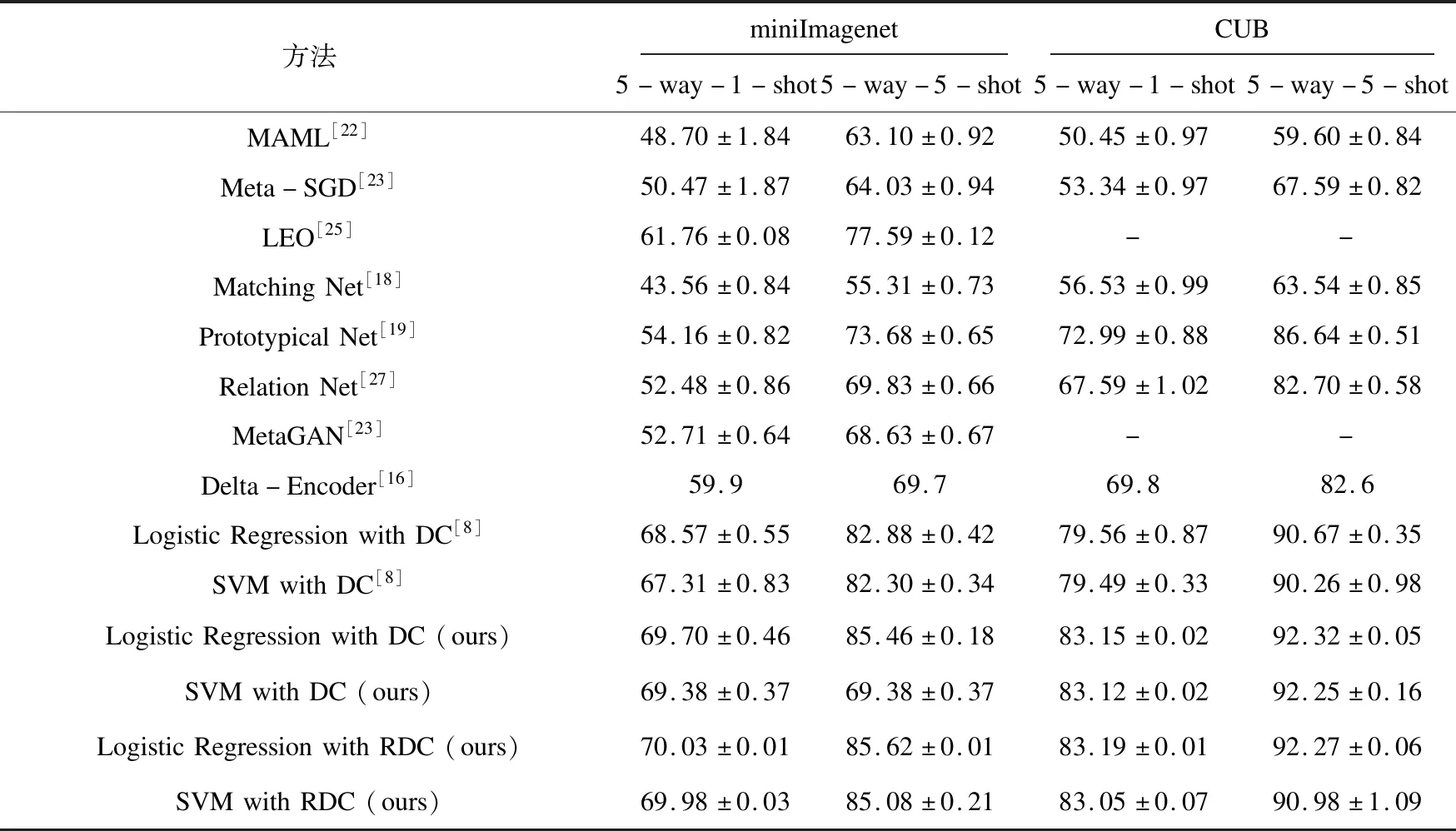

圖2顯示了k值固定的情況下閾值threshold的變化對分類準確率的影響。從圖2中的結果發現,當k∈{0,1,2,3}時,隨著閾值threshold的不斷增大,準確率呈不斷增大的趨勢。且對于兩種數據集,在閾值threshold=3.3時準確率都達到最高值。其原因為,隨著閾值的不斷增大,用于校正新類特征分布的基類個數不斷增多,當閾值達到3.3時,由該閾值確定的鄰域內的基類統計信息遷移到新類中能較好地校正新類的特征分布。隨之閾值的不斷增大,鄰域內會引入一些對新類分布產生負遷移現象的基類,從而造成測試準確率下降的狀態。當k∈{0,1,2,3}時,曲線處于重合狀態,說明不考慮k時僅通過threshold選擇基類可以獲得較好的小樣本分類性能。

圖2 threshold的取值對實驗結果的影響

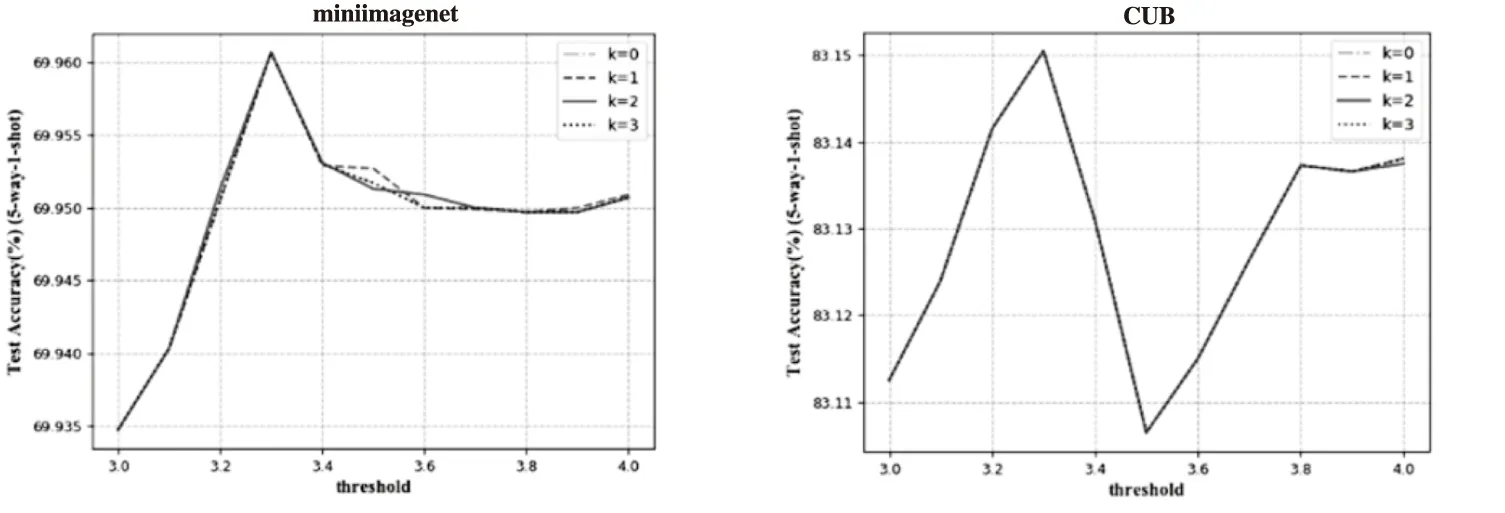

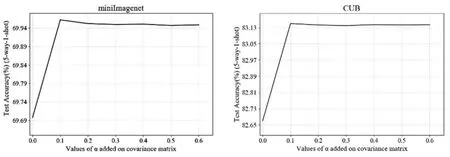

從圖3中的結果觀測到,對于miniImagenet數據集(左圖)和CUB數據集(右圖),隨著φ值不斷增大,平均分類準確率(Test Accuracy)呈現先穩定再下降的趨勢。曲線變化的主要原因在于,隨著φ不斷增大,新類的特征分布受基類影響程度也不斷增大,但當φ取值太大,又會產生負遷移,造成準確率下降。

圖3 φ的取值對實驗結果的影響

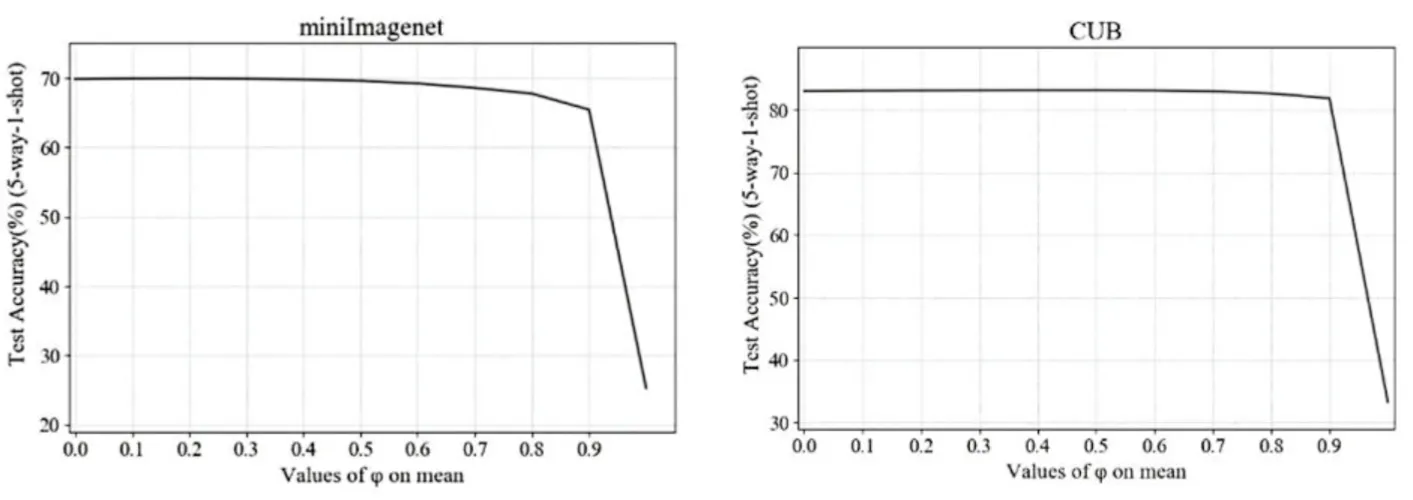

公式(9)中的a確定從校正后的分布中樣本嵌入特征分散的程度。圖4顯示了不同的a取值對測試準確率的影響。隨著a的增大,測試精度快速上升達到最大值后幾乎保持穩定。其主要原因在于,當a的值等于0.1的時候,校正的新類協方差是逼近它的真實樣本嵌入特征分布。a隨后繼續增大,校正的新類協方差又偏離了真實樣本嵌入特征分布,所以預測精度會有所降低。

圖4 a的取值對實驗結果的影響

3.4 消融實驗

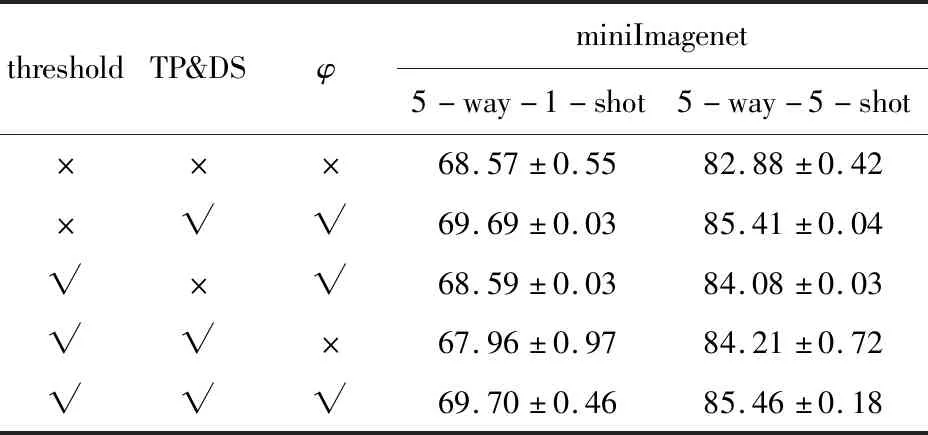

為研究提出的動態分布校正方法(Logistic Regression/SVM with DC(ours))中每一計算過程對小樣本分類性能的影響,進行了消融實驗。表2展示了在訓練模型時未基于閾值選擇近鄰基類、在訓練模型時未進行冪變換(Power Transform,TP)與數據標準化(Data Standardization,DS)而是使用Tukey的冪階變換以及在訓練模型時未引入校正參數處理時的分類結果。由表2知,通過TP與DS操作使小樣本的分類精度提高接近1%,引入校正參數后的分類精度提高2%左右,基于閾值選擇近鄰基類對于分類精度提高0.1%。由此可知,三步過程對解決分布校正算法負遷移問題起著積極作用。

表2 在miniImagenet數據集上的分類準確率 %

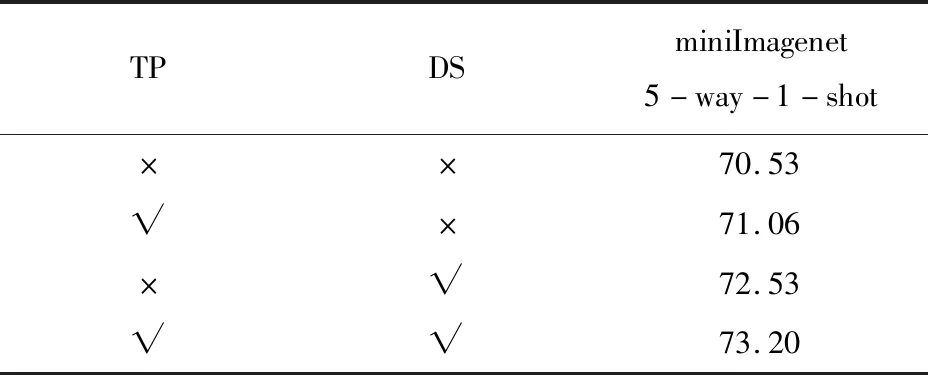

為了研究冪變換之后的數據標準化處理對小樣本分類性能的影響,在miniImageNet數據集上進行了消融實驗。實驗的結果為10個任務的測試集平均分類精度。由表3中的實驗結果發現,在冪變換之后加入數據標準化處理,分類準確率提高接近1%。實驗證明數據標準化處理對于分類性能同樣能夠起著積極作用。

表3 在miniImagenet數據集上的分類準確率 %

4 結束語

基于分布校正方法,提出了一種動態分布校正方法來解決分布校正過程中的負遷移問題。具體來說,首先,通過冪變換使新類的嵌入特征分布近似于高斯分布,再對新類嵌入特征進行數據標準化處理來消除由特征量綱不同造成的負遷移現象;其次,基于閾值提取了近鄰基類與遠域基類嵌入特征的分布統計量后,遷移到新類中來校正新類的嵌入特征分布;最后,基于校正后分布擴增新類的嵌入特征數據來提高預測模型的分類性能。在CUB和miniImageNet兩個數據集上評估了所提方法,實驗證明所提方法得到的預測模型分類性能要高于目前最先進的小樣本學習方法。在未來的工作中,會探索更高效的小樣本學習方法。