基于雙參數閾值的蠶繭分割及雙宮繭識別研究

蔣昭瓊 應婧 王春霞 宋樂見 何清燕 郭鵬 吝祥根 鄧立黎

摘要: 針對粘連蠶繭難以準確分割、現有雙宮繭識別方法局限性等問題,本文提出了基于雙參數閾值的蠶繭分割計數、蠶繭形狀復原及雙宮繭識別的串聯算法。首先,應用可變分割閾值結合形態學運算的方法對圖像進行分割計數,再遍歷完成分割的每個蠶繭的像素點,應用基于邊緣檢測與橢圓擬合的蠶繭形狀復原方法擬合蠶繭形狀,然后計算蠶繭長短軸比值和面積參數,采用雙參數多級閾值對雙宮繭進行檢測。實驗結果顯示,圖像分割計數準確度為100%,雙宮繭全部檢出,雙宮繭與單宮蠶繭分類準確率為98.6%。該方法檢出了面積閾值法易漏檢的小雙宮繭,也較準確地識別出與長短軸比值閾值接近的蠶繭類型。

關鍵詞: 圖像分割;雙宮繭;計數;分類;算法;閾值

中圖分類號: TS143.215

文獻標志碼: A

文章編號: 1001-7003(2023)04-0018-08

引用頁碼:

041103

DOI: 10.3969/j.issn.1001-7003.2023.04.003(篇序)

蠶繭原料的質量直接影響生絲質量,在繅絲前應對蠶繭進行分選,剔除無法用于繅絲的下繭。傳統的蠶繭分選基本依靠人工視覺進行判別,勞動強度大、選繭效率低、漏選率高,選繭的準確性易受選繭人員的技術水平、精神狀態等主觀因素影響[1-3]。近年來,隨著人工智能的高速發展,機器視覺技術廣泛應用于代替人眼進行測量和判定。目前,以蠶繭圖像為研究對象開展了一系列研究,包括蠶繭表面積的展開[4]與測量[5-7]、雌雄蠶蛹分類識別[8]、方格蔟蠶繭分割定位[9]與黃斑繭檢測[10]、蠶繭表面污斑面積的自動檢測[3]、下繭與上車繭的分類識別[1-2,11-13]等,充分展現出機器視覺技術在蠶繭分選領域的應用潛力。在實際應用中,蠶繭的分類識別首先需要解決目標蠶繭的計數問題。黃靜等[14]針對二值圖像中出現的多個對象相互粘連的情況,應用形態學方法和K-means聚類算法,實現了對蠶繭圖像的分割和計數。孫衛紅等[15]提出了一種基于凹點定向腐蝕的粘連蠶繭圖像分割方法,平均分割準確率為96.2%。古亭等[16]提出了一種基于距離變換的粘連蠶繭分割方法,計數準確率達99%以上。孔繁圣等[17]利用改進的多層次距離變換并結合分水嶺的分割算法,計數精度達到99.97%,但該方法在對大小差異大的蠶繭計數時會造成準確率下降。這些方法主要用于分割計數,沒有進一步討論分割后的蠶繭種類識別。

雙宮繭是制作蠶絲被的最佳原料,在選繭過程中,要與其他類型下繭分開單獨歸為一類。目前機器視覺技術中,雙宮繭的識別主要有面積閾值法和橢圓長短軸比值閾值法。杜昕等[18]、宋亞杰等[19]通過不同蠶繭圖像面積計算方法,利用面積閾值來判斷是否為雙宮繭。Prasobhkumar等[20]采用橢圓擬合蠶繭形狀,計算橢圓的長短軸比值,將比值小于1.426的蠶繭判斷為雙宮繭。面積閾值法的缺點是較小的雙宮繭不能檢出。橢圓長短軸比值閾值法則不適用于頭尾相連類型的雙宮繭,且過度依賴于對蠶繭形狀的準確擬合。然而,由于蠶繭形狀的輕微不規則、附絲及蠶繭之間的粘連,使得橢圓擬合與實際形狀有出入,可能誤判在閾值附近的蠶繭種類。因此,僅依靠面積閾值或者擬合的橢圓長短軸比值閾值進行雙宮繭識別,均存在一定局限性。針對粘連蠶繭難以準確分割、雙宮繭識別局限性等問題,本文提出了基于可變閾值結合形態學運算的蠶繭分割計數、基于邊緣檢測與橢圓擬合的蠶繭形狀復原及基于雙參數多級閾值的雙宮繭識別算法。

1 方 法

1.1 圖像采集

蠶繭圖像采集裝置由光源、工業相機(海康威視MV-CE200-10UC)、鏡頭(LOMOSEN ZX-SF3528T)、實驗架和計算機構成。在蠶繭分選的視覺系統中,一旦結構固定,每臺相機與測試視野之間的距離就不會改變,故本實驗采用固定的工業相機與測試臺距離,采集蠶繭圖像進行分析。

1.2 蠶繭圖像分割計數

圖像分割方法一般是通過灰度、顏色、紋理和形狀等特征對圖像進行分割。常見的傳統分割方法有基于閾值、邊緣、聚類的分割,這些方法在界限分明的目標分割中能又快又好地

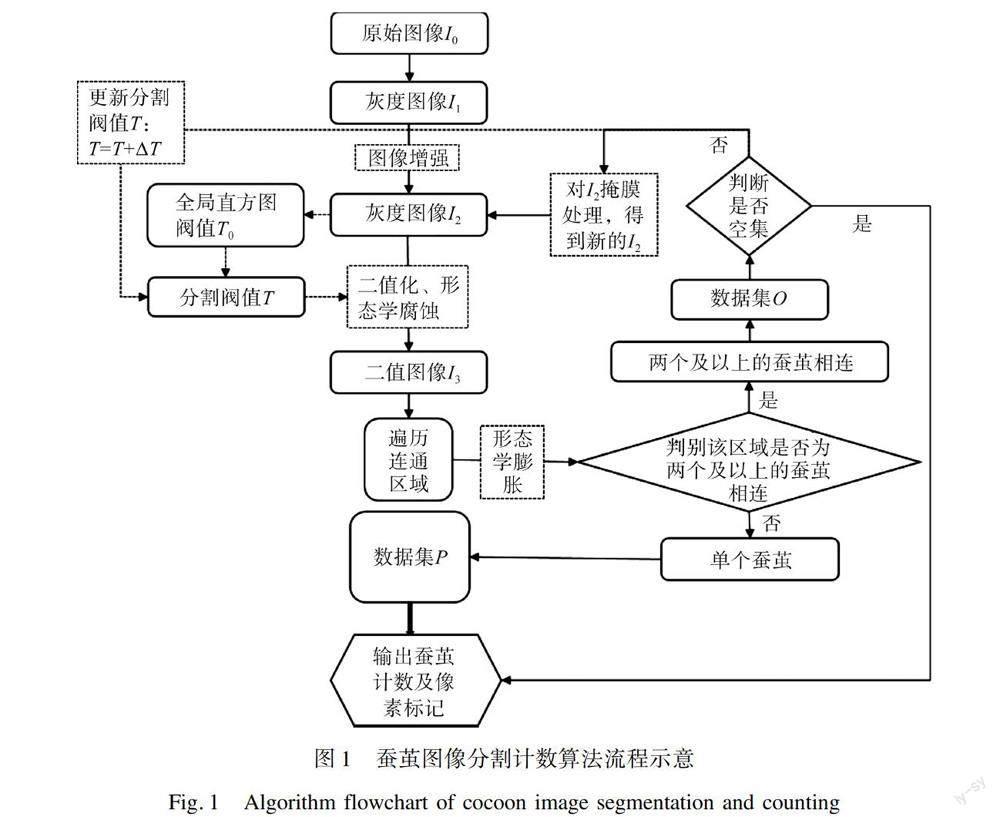

完成分割,但對于光照不均勻、分割對象多、相鄰分割對象的邊緣灰度相近等情況較難完全分割。由于蠶繭圖像中蠶繭分布密集且有附絲干擾,相鄰蠶繭邊緣灰度相近,傳統圖像分割方法難以分割完全。為解決直接應用傳統圖像分割算法的缺陷,本文提出了一種基于可變分割閾值結合形態學運算的圖像分割改進算法,其算法流程如圖1所示。

1) 將采集的彩色圖像I0轉化為灰度圖I1,再增加圖像對比度I2,然后提取圖像全局直方圖閾值T0,將其作為初始的圖像分割閾值T。

2) 應用分割閾值T對圖像I2進行二值化、形態學腐蝕運算,得到二值圖I3,去掉I3中面積較小的連通區域,遍歷余下的每個連通區域,進行形態學膨脹運算,應用單個蠶繭像素面積閾值S0及長寬閾值L0來判別該區域是否為兩個及以上的蠶繭相連。若不是,則該連通區域為單個蠶繭,將該區域像素點進行標記并計數,依次存入數據集P;若是蠶繭相連,則將該區域像素點放入數據集O。

3) 若數據集O非空,對I2進行掩膜處理,使數據集O中像素點為前景,其余像素點為背景,得到新的只包含未分割開的蠶繭的灰度圖像I2;更新分割閾值T,新的分割閾值在上一級閾值的基礎上增加ΔT,即T=T+ΔT,返回步驟2。

4) 若數據集O為空集,或迭代次數到達上限,則退出循環。

分割好的蠶繭數據集P,由數組p1、p2…pi…pn組成,代表圖像中有n個蠶繭,向量pi為第i個蠶繭的像素點。

該算法應用了連通區域的像素面積和連通區域像素點外接矩陣的長邊長兩個參數,對每個連通區域是否進入下一級分割進行判定。

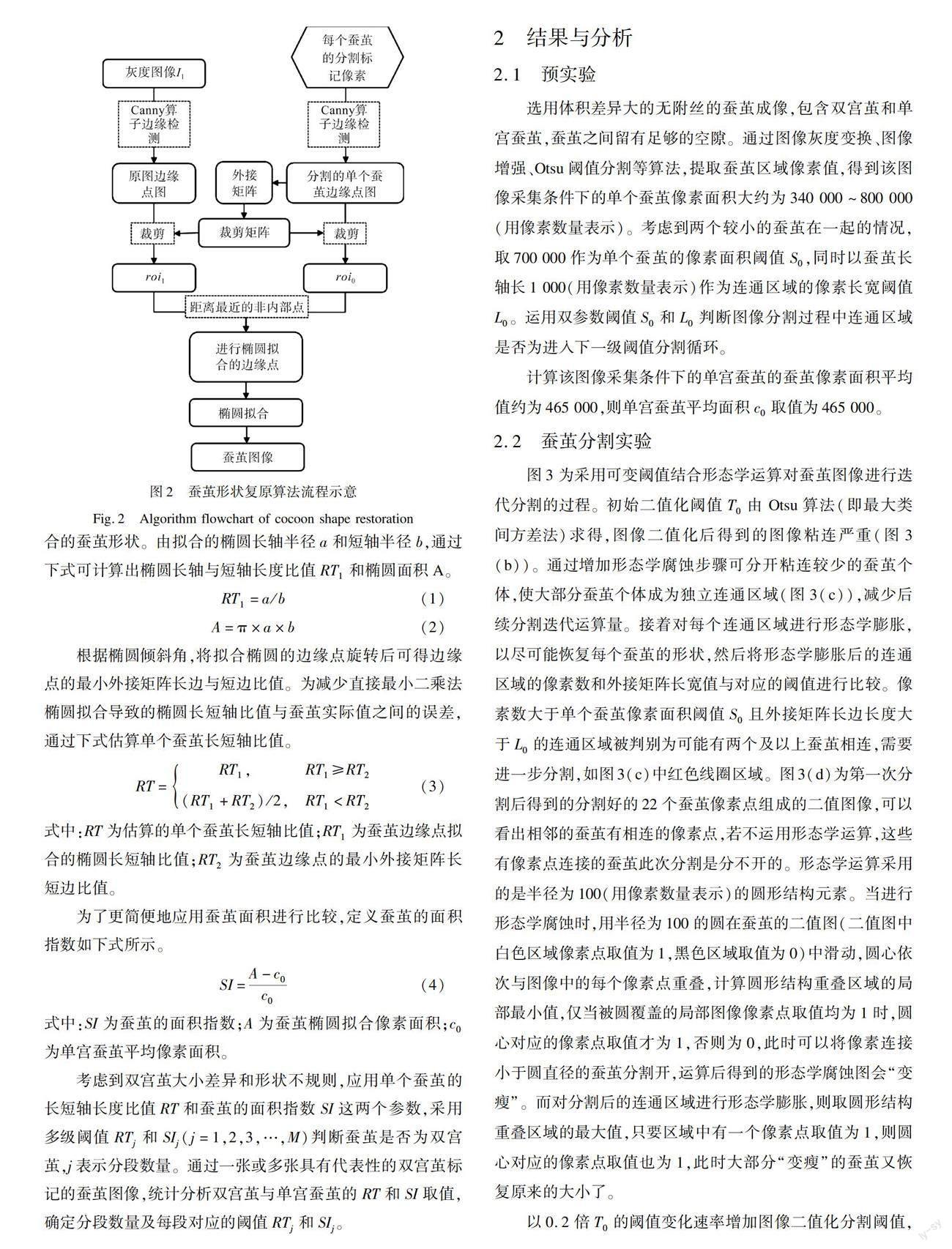

1.3 單個蠶繭形狀復原

由于高閾值分割導致得到的單個蠶繭圖像小于原圖像大小,要進一步對每個蠶繭進行分析,需要進行蠶繭形狀復原。由此提出基于邊緣檢測與橢圓擬合的蠶繭形狀復原算法:對于每個蠶繭,分割出的像素點組成的圖像小于等于實際圖像,重疊兩圖像后,前者在后者的內部;選用合適的標準差和高低閾值,通過Canny算子進行邊緣檢測;根據像素點真值區域,適當拓寬確定目標區域位置,并進行裁剪,得到兩個大小相同的邊緣點組成的二值圖像roi0和roi1,roi0為分割出的像素點組成的圖像邊緣檢測圖,roi1為從原圖邊緣檢測圖中裁剪的目標區域;對roi0中的邊緣點進行去冗,去掉內部點和多余的輪廓點,以減少運算量;遍歷roi0中的邊緣點,在roi1中找到非roi0邊緣輪廓區域內的、與該點距離最近的點,由這些點進行橢圓擬合[21],得到該蠶繭的圖像(圖2)。

1.4 雙宮繭的識別

對于每一個蠶繭,經過目標分割、形狀復原,得到橢圓擬合的蠶繭形狀。由擬合的橢圓長軸半徑a和短軸半徑b,通過下式可計算出橢圓長軸與短軸長度比值RT1和橢圓面積A。

RT1=a/b(1)

A=π×a×b(2)

根據橢圓傾斜角,將擬合橢圓的邊緣點旋轉后可得邊緣點的最小外接矩陣長邊與短邊比值。為減少直接最小二乘法橢圓擬合導致的橢圓長短軸比值與蠶繭實際值之間的誤差,通過下式估算單個蠶繭長短軸比值。

RT=RT1,RT1≥RT2(RT1+RT2)/2,RT1 式中:RT為估算的單個蠶繭長短軸比值;RT1為蠶繭邊緣點擬合的橢圓長短軸比值;RT2為蠶繭邊緣點的最小外接矩陣長短邊比值。 為了更簡便地應用蠶繭面積進行比較,定義蠶繭的面積指數如下式所示。 SI=A-c0c0(4) 式中:SI為蠶繭的面積指數;A為蠶繭橢圓擬合像素面積;c0為單宮蠶繭平均像素面積。 考慮到雙宮繭大小差異和形狀不規則,應用單個蠶繭的長短軸長度比值RT和蠶繭的面積指數SI這兩個參數,采用多級閾值RTj和SIj(j=1,2,3,…,M)判斷蠶繭是否為雙宮繭,j表示分段數量。通過一張或多張具有代表性的雙宮繭標記的蠶繭圖像,統計分析雙宮繭與單宮蠶繭的RT和SI取值,確定分段數量及每段對應的閾值RTj和SIj。 2 結果與分析 2.1 預實驗 選用體積差異大的無附絲的蠶繭成像,包含雙宮繭和單宮蠶繭,蠶繭之間留有足夠的空隙。通過圖像灰度變換、圖像增強、Otsu閾值分割等算法,提取蠶繭區域像素值,得到該圖像采集條件下的單個蠶繭像素面積大約為340 000~800 000(用像素數量表示)。考慮到兩個較小的蠶繭在一起的情況,取700 000作為單個蠶繭的像素面積閾值S0,同時以蠶繭長軸長1 000(用像素數量表示)作為連通區域的像素長寬閾值L0。運用雙參數閾值S0和L0判斷圖像分割過程中連通區域是否為進入下一級閾值分割循環。 計算該圖像采集條件下的單宮蠶繭的蠶繭像素面積平均值約為465 000,則單宮蠶繭平均面積c0取值為465 000。 2.2 蠶繭分割實驗 圖3為采用可變閾值結合形態學運算對蠶繭圖像進行迭代分割的過程。初始二值化閾值T0由Otsu算法(即最大類間方差法)求得,圖像二值化后得到的圖像粘連嚴重(圖3(b))。通過增加形態學腐蝕步驟可分開粘連較少的蠶繭個體,使大部分蠶繭個體成為獨立連通區域(圖3(c)),減少后續分割迭代運算量。接著對每個連通區域進行形態學膨脹,以盡可能恢復每個蠶繭的形狀,然后將形態學膨脹后的連通區域的像素數和外接矩陣長寬值與對應的閾值進行比較。像素數大于單個蠶繭像素面積閾值S0且外接矩陣長邊長度大于L0的連通區域被判別為可能有兩個及以上蠶繭相連,需要進一步分割,如圖3(c)中紅色線圈區域。圖3(d)為第一次分割后得到的分割好的22個蠶繭像素點組成的二值圖像,可以看出相鄰的蠶繭有相連的像素點,若不運用形態學運算,這些有像素點連接的蠶繭此次分割是分不開的。形態學運算采用的是半徑為100(用像素數量表示)的圓形結構元素。當進行形態學腐蝕時,用半徑為100的圓在蠶繭的二值圖(二值圖中白色區域像素點取值為1,黑色區域取值為0)中滑動,圓心依次與圖像中的每個像素點重疊,計算圓形結構重疊區域的局部最小值,僅當被圓覆蓋的局部圖像像素點取值均為1時,圓心對應的像素點取值才為1,否則為0,此時可以將像素連接小于圓直徑的蠶繭分割開,運算后得到的形態學腐蝕圖會“變瘦”。而對分割后的連通區域進行形態學膨脹,則取圓形結構重疊區域的最大值,只要區域中有一個像素點取值為1,則圓心對應的像素點取值也為1,此時大部分“變瘦”的蠶繭又恢復原來的大小了。 以0.2倍T0的閾值變化速率增加圖像二值化分割閾值, 對需要進一步分割的區域對應的蠶繭原圖進行分割。圖3(e~g)為圖3(c)中紅色線圈區域的蠶繭在分割閾值為T0的1.6倍時的圖像分割過程。分割結束后,根據每個蠶繭對應的像素點,就能找到該蠶繭在圖中的位置(圖3(h))。 應用該蠶繭目標分割算法,本文測試了10張圖片共222個蠶繭的分割計數。結果顯示,每張圖片中的蠶繭均分割完全,計數準確度100%,如表1所示。 2.3 蠶繭形狀復原 蠶繭圖像經過目標分割后,應對每個蠶繭的像素點進行處理以復原該蠶繭形狀,以便進行蠶繭種類識別(圖4)。從圖4(a~c)可以看出,高閾值分割的蠶繭、光照不均和表面污點的蠶繭在圖像分割中得到的像素點圖小于原圖像大小。本文以圖4(a)中的紅色線圈區域的蠶繭像素點為例,對單個蠶繭形狀復原過程進行描述。采用Canny算子(邊緣檢測算子),選用標準差為20,低閾值為0,高閾值為0.2,對像素點圖和原圖進行邊緣檢測,以像素點圖的邊緣點外接矩陣為中心,向四面擴展300像素點數來確定感興趣區域位置和大小,并對圖像進行裁剪,得到兩個大小相同的邊緣點組成的二值圖像roi0和roi1。為了可視化區分兩個邊緣點圖,本文以分割出的像素點組成的圖像代替其對應的邊緣點圖roi0,如圖4(d)所示,白色區域為目標蠶繭像素點,點線部分為原圖邊緣檢測裁剪后的蠶繭輪廓邊緣點。 接著應用兩個邊緣點圖的幾何關系篩選目標蠶繭的邊緣點,去除其他蠶繭和附絲的邊緣點。再對目標蠶繭邊緣點進行橢圓擬合,如圖4(e)所示。為了對比蠶繭形狀復原效果,本文在蠶繭原圖中用彩色線條畫出了擬合的橢圓,如圖4(c)(f)所示,可以看出大部分擬合的橢圓線條與蠶繭輪廓重合。 2.4 雙宮繭檢測實驗 由于蠶繭的輕微不規則及個別外點的存在,有的蠶繭擬合的橢圓與蠶繭輪廓有些許出入。從圖4(f)可以看出,該蠶繭擬合的橢圓短軸長度比實際蠶繭的短軸長,這樣會導致橢圓長短軸比值比蠶繭實際情況小,因此需要適當對長短軸比值進行校正。應用橢圓擬合的傾斜角度,對目標蠶繭的輪廓邊緣點進行角度變換,得到新的坐標,使變換后的這些點擬合的橢圓長短軸與坐標軸平行。由此可得到這些邊緣點區域的最小外接矩陣的長邊與短邊像素長度比值RT2,并與擬合的橢圓長短軸比值RT1進行比較,應用式(3)確定該蠶繭長短軸比值RT。通過擬合的橢圓面積A及預實驗中得到的單宮蠶繭平均像素面積c0,應用式(4)可計算出面積指數SI。應用估算的蠶繭長短軸半徑比RT和面積指數SI,來判斷該蠶繭是否為雙宮繭。在本文實驗中,通過統計分析,結合雙宮蠶繭特征,設定滿足以下條件之一即為雙宮繭,如下式所示。 ①RT<1.4且SI>0②RT<1.5且SI>0.1③RT<1.6且SI>0.21④RT<1.7且SI>0.25⑤SI>0.4(5) 式(5)為雙宮繭識別的雙參數多級閾值,只要滿足其中一個條件則判別為雙宮繭。條件①和條件②主要依據蠶繭的長短軸半徑比進行判斷,為了限制邊緣不完整的蠶繭圖片被歸為雙宮繭,在長短軸半徑比閾值的基礎上,加了面積指數限制條件。條件③和條件④協同考慮蠶繭長短軸半徑比與面積指數。條件⑤主要依據雙宮蠶繭的面積比正常蠶繭大得多來進行判斷,能兼容頭尾相接的雙宮繭類型。若五個條件均不滿足,則認為不是雙宮繭(圖5)。 表2顯示了圖5中12個蠶繭的類型及其橢圓擬合參數。第1~7個蠶繭為雙宮繭,滿足條件①或條件②。其中第6個蠶繭和第7個蠶繭,若僅用Prasobhkumar等[20]橢圓擬合的長短軸半徑比閾值0.426來判斷,會被歸為單宮蠶繭類。若單純以面積來進行判別,第4個蠶繭的面積比第8~12個蠶繭的面積都小,會優先將后者判斷為雙宮繭而漏檢前者。因而,采用基于估計的蠶繭長短軸比與面積參數相結合的雙參數判別方式對雙宮繭進行識別,比僅采用一種參數的方法實用性更強。 應用本文提出的算法,分別對10張蠶繭圖片進行蠶繭圖形分割、蠶繭形狀復原及雙參數閾值的雙宮繭判別,實驗結果如表3所示。10張圖片共222個蠶繭,實際雙宮繭數為46個,檢出數共49個。檢出的49個蠶繭中,實際雙宮繭有46個,另外3個是誤檢為雙宮繭的單宮蠶繭。總體上,雙宮繭與單宮蠶繭分類識別準確率為98.6%。 進一步對誤檢的蠶繭進行分析,本文截取了這3個誤檢蠶繭的橢圓擬合進行對比,如圖6所示。圖6(a)為板印蠶繭,可能由于蠶結繭時受到擠壓使得該視野面的面積較大。這類誤檢可以通過提取板印繭特征、建立多分類模型、板印繭類型優先判定來排除。圖6(b)(c)蠶繭橢圓擬合不準確,通過分析發現,因為蠶繭周邊附絲厚,部分位置附絲與蠶繭邊緣之間幾乎沒有灰度梯度,邊緣檢測時,這些位置的蠶繭的邊緣點未能檢出,而是擴張到更遠的附絲區域,此時采用直接最小二乘法進行橢圓擬合會使擬合的橢圓與蠶繭形狀差異較大,從而導致出現誤檢。實際人工選繭生產線上,會優先去除附絲,以避免附絲遮擋蠶繭特征,影響選繭效率和準確度。機器視覺成像質量同樣受附絲影響,實際應用中也應去除厚重的附絲,讓圖像顯現出蠶繭本身面貌,才能更準確分類。 3 結 論 蠶繭目標分割與定位是蠶繭種類識別的基礎,為解決蠶繭分選環節雙宮繭機器視覺識別技術難題,針對粘連蠶繭難以準確分割、雙宮繭識別局限性等問題,本文提出了基于可變閾值結合形態學運算的雙參數控制的蠶繭分割計數算法、基于邊緣檢測與橢圓擬合的蠶繭形狀復原及基于雙參數的多級閾值雙宮繭識別方法,將蠶繭分割與種類識別串聯,以保證方法的適用性。圖像分割計數算法能有效地標記蠶繭個體位置,分割計數準確度高達100%,保證后續的蠶繭種類識別能夠順利開展。通過蠶繭形狀復原算法擬合的蠶繭形狀,根據估算的蠶繭長短軸比值和面積指數兩個參數,采用多級閾值對雙宮繭進行檢測,既能檢出面積閾值法不能檢出的小雙宮繭,也能避免橢圓長短軸比值閾值法識別雙宮繭的局限性。在雙宮繭檢測實驗中,雙宮繭全部檢出,極少數單宮蠶繭被誤檢為雙宮繭,雙宮繭與單宮蠶繭分類識別的準確率為98.6%。 本文提出的蠶繭目標分割和雙宮繭識別串聯算法,能有效地對機器視覺圖像進行處理得到各蠶繭目標是否為雙宮繭的結論。該串聯算法以預實驗確定所攝圖像中正常蠶繭面積、正常蠶繭長軸長作為先驗條件。對于輕微重疊的蠶繭目標可以分割開,但對于重疊放置嚴重的蠶繭可能會誤分割為同一個蠶繭,從而影響蠶繭分類識別。因此,此方法適用于蠶繭平鋪在視野中成像的圖像處理。 參考文獻: [1]孫衛紅, 黃志鵬, 梁曼, 等. 基于顏色特征和支持向量機的蠶繭分類方法研究[J]. 蠶業科學, 2020, 46(1): 86-95. SUN Weihong, HUANG Zhipeng, LIANG Man, et al. Cocoon classification method based on color feature and support vector machine[J]. Acta Sericologica Sinica, 2020, 46(1): 86-95. [2]陳國棟. 引入注意力機制的蠶繭識別算法[J]. 紡織報告, 2020, 39(11): 23-25. CHEN Guodong. Cocoon recognition algorithm based on attention mechanism[J]. Textile Reports, 2020, 39(11): 23-25. [3]陳浩, 楊崢, 劉霞, 等. 基于MATLAB的桑蠶繭選繭輔助檢驗方法的研究[J]. 絲綢, 2016, 53(3): 32-36. CHEN Hao, YANG Zheng, LIU Xia, et al. Study on auxiliary testing method for mulberry silkworm cocoon sorting based on MATLAB[J]. Journal of Silk, 2016, 53(3): 32-36. [4]孫衛紅, 廖藝真, 梁曼, 等. 蠶繭表面圖像等效階梯柱面展開[J]. 中國圖象圖形學報, 2020, 25(3): 498-506. SUN Weihong, LIAO Yizhen, LIANG Man, et al. Equivalent step cylinder unfolding of silkworm cocoon surface image[J]. Journal of Image and Graphics, 2020, 25(3): 498-506. [5]甘勇, 孔慶華, 韋荔甫. 基于數字圖像處理的蠶繭表面積計算方法[J]. 光學技術, 2007(1): 27-28. GAN Yong, KONG Qinghua, WEI Lifu. A method to calculate cocoons superficial areas based on the digital image processing[J]. Optical Technique, 2007(1): 27-28. [6]華中平, 甘勇. 基于圖像處理的蠶繭表面積計算方法[J]. 絲綢, 2004(3): 16-18. HUA Zhongping, GAN Yong. A method to calculate cocoons superficial area based on image processing[J]. Journal of Silk, 2004(3): 16-18. [7]周志宇, 劉喜昂, 楊東鶴. 機器視覺在蠶繭表面積測量中的應用[J]. 紡織學報, 2006(12): 29-31. ZHOU Zhiyu, LIU Xiang, YANG Donghe. Application of machine vision in measurement of cocoon superdicial area[J]. Journal of Textile Research, 2006(12): 29-31. [8]龔攀, 李光林. 基于計算機視覺的蠶蛹性別識別應用研究[J]. 農機化研究, 2014, 36(1): 206-209. GONG Pan, LI Guanglin. The recognition application research of the tupa gender based on computer vision[J]. Journal of Agricultural Mechanization Research, 2014, 36(1): 206-209. [9]劉莫塵, 許榮浩, 李法德, 等. 基于顏色與面積特征的方格蔟蠶繭分割定位算法與試驗[J]. 農業機械學報, 2018, 49(3): 43-50. LIU Mochen, XU Ronghao, LI Fade, et al. Algorithm and experiment of cocoon segmentation and location based on color and area feature[J]. Transactions of the Chinese Society for Agricultural Machinery, 2018, 49(3): 43-50. [10]劉莫塵, 許榮浩, 閆筱, 等. 基于FCM及HSV模型的方格蔟黃斑繭檢測與剔除技術[J]. 農業機械學報, 2018, 49(7): 31-38. LIU Mochen, XU Ronghao, YAN Xiao, et al. Detection and elimination of yellow spotted cocoon in mountage based on FCM algorithm and HSV color model[J]. Transactions of the Chinese Society for Agricultural Machinery, 2018, 49(7): 31-38. [11]李時杰, 孫衛紅, 梁曼, 等. 基于CD-YOLO算法的蠶繭種類識別[J]. 中國計量大學學報, 2021, 32(3): 398-405. LI Shijie, SUN Weihong, LIANG Man, et al. Cocoon species recognition based on CD-YOLO algorithms[J]. Journal of China University of Metrology, 2021, 32(3): 398-405. [12]孫衛紅, 楊程杰, 邵鐵鋒, 等. 基于MSRCR與注意力機制的群體蠶繭智能識別算法[J]. 絲綢, 2022, 59(6): 58-65. SUN Weihong, YANG Chengjie, SHAO Tiefeng, et al. Intelligent recognition algorithm of group cocoons based on MSRCR and CBAM[J]. Journal of Silk, 2022, 59(6): 58-65. [13]張印輝, 楊宏寬, 朱守業, 等. 基于輕型調控網絡的下繭機器視覺實時檢測[J]. 農業機械學報, 2022, 53(4): 261-270. ZHANG Yinhui, YANG Hongkuan, ZHU Shouye, et al. Machine vision real time detection of inferior cocoons based on lightweight manipulation network[J]. Transactions of the Chinese Society for Agricultural Machinery, 2022, 53(4): 261-270. [14]黃靜, 張琦, 江文斌. 基于改進K-means算法的蠶繭自動計數方法的研究[J]. 絲綢, 2014, 51(1): 37-40. HUANG Jing, ZHANG Qi, JIANG Wenbin. Study on automatic cocoon counting method based on improved K-means algorithm[J]. Journal of Silk, 2014, 51(1): 37-40. [15]孫衛紅, 洪徐健, 梁曼, 等. 基于凹點定向腐蝕的粘連蠶繭圖像分割方法[J]. 蠶業科學, 2019, 45(3): 369-376. SUN Weihong, HONG Xujian, LIANG Man, et al. Image segmentation method for adhesive cocoons based on directional erosion in concave point[J]. Acta Sericologic of Science, 2019, 45(3): 369-376. [16]古亭, 李子印, 王樂. 基于距離變換的粘連蠶繭分割方法[J]. 計算機工程與應用, 2019, 55(23): 177-181. GU Ting, LI Ziyin, WANG Le. Method for segmentation of silkworm cocoons based on distance transformation[J]. Computer Engineering and Applications, 2019, 55(23): 177-181. [17]孔繁圣, 李子印, 古亭, 等. 基于多層次距離變換的蠶繭分割計數算法[J]. 蠶業科學, 2020, 46(2): 190-196. KONG Fansheng, LI Ziyin, GU Ting, et al. Cocoon segmentation and counting algorithm based on multi-level distance transformation[J]. Acta Sericologic of Science, 2020, 46(2): 190-196. [18]杜昕, 劉文烽, 林毅堅. 基于機器視覺動態選繭系統的研究[J]. 企業科技與發展, 2018(4): 91-94. DU Xin, LIU Wenfeng, LIN Yijian. Research on dynamic cocoon selection system based on machine vision[J]. Sci-Tech & Development of Enterprise, 2018(4): 91-94. [19]宋亞杰, 謝守勇, 冉瑞龍. 機器視覺技術在蠶繭無損檢測中的應用研究[J]. 現代農業裝備, 2006(9): 48-51. SONG Yajie, XIE Shouyong, RAN Ruilong. Application research on machine vision technology in nondestructive test of cocoon[J]. Modern Agricultural Equipment, 2006(9): 48-51. [20]PRASOBHKUMAR P P, FRANCIS C R, GORTHI S S. Automated quality assessment of cocoons using a smart camera based system[J]. Engineering in Agriculture, Environment and Food, 2018, 11(4): 202-210. [21]FITZGIBBON A, PILU M, FISHER R B. Direct least squares fitting of ellipses[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1999, 21(5): 476-480. Research on cocoon segmentation and double cocoon recognition based on two-parameter thresholds JIANG Zhaoqiong1,2, YING Jing1,2, WANG Chunxia1,2, SONG Lejian1, HE Qingyan1,2, GUO Peng1, LIN Xianggen1, DENG Lili1 (1.Sichuan Research & Design Institute of Agricultural Machinery, Chengdu 610066, China; 2.Key Laboratory of Agricultural EquipmentTechnology for Hilly and Mountainous Areas, Ministry of Agriculture and Rural Affairs, Chengdu 610066, China) Abstract: The quality of cocoons directly affects the quality of raw silk. Before reeling, the cocoons should be sorted to remove the inferior cocoons that cannot be used for reeling. The double cocoon is the best raw material for making silk quilts. Therefore, it should be separated from other types of inferior cocoons and classified separately in the process of selecting cocoons. The traditional cocoon sorting basically relies on manpower, which involves high labor intensity, low efficiency of cocoon selection and high missing rate, and the accuracy of cocoon selection is easily affected by subjective factors such as the technical level and mental state of cocoon selection personnel. With the rapid development of artificial intelligence, machine vision technology is widely used to replace human eyes for detection and recognition. At present, in machine vision technology, the recognition of double cocoons mainly includes area threshold method and the threshold method of the ratio of long to short axis of ellipse. The disadvantage of the area threshold method is that small double cocoons cannot be detected. The threshold method of the ratio of long to short axis of ellipse is not applicable to the double cocoon of the head-to-tail type and relies too much on the accurate fitting of the cocoon shape. However, due to the slight irregularity of the cocoon shape, the attachment silk and the adhesion between the cocoons, the ellipse fitting is different from the actual shape, which may result in peoples misjudging the cocoon type near the threshold. Therefore, there are some limitations in the identification of double cocoons by only depending on the area threshold or the threshold of the ratio of long to short axis of the fitted ellipse. Due to the dense distribution of cocoons in the cocoon image and the interference of attached silk, the gray scale of adjacent cocoons is similar, so it is difficult to conduct segmentation completely by traditional image segmentation methods. Therefore, the segmentation and counting problem of target cocoons should be solved first for the classification and recognition of cocoons. Aiming at the problems that it is difficult to accurately segment the adhered cocoons and the limitations of the existing double cocoon recognition methods, we proposed a series of algorithms for the segmentation and counting of cocoons, the shape restoration of cocoons and the recognition of double cocoons. Firstly, we proposed an improved image segmentation algorithm based on variable segmentation threshold by combining with morphological operation. Otsu binarization threshold was used as the initial segmentation threshold, and binarization, morphological erosion operation and morphological expansion operation were performed on the image. The pixel area threshold and length-width threshold of single cocoons were used to distinguish the connected region. If a cocoon is a single one, it is marked and counted. If it is determined to be connected to other cocoons, the segmentation threshold is increased again for another segmentation. Then, a cocoon shape restoration method based on edge detection and ellipse fitting was proposed. The pixels of each cocoon that had been segmented were traversed. The Canny operator was used to detect the edge of the original image. The pixel points of the segmented cocoon were used to determine the edge points of the cocoon, and the edge points were elliptically fitted to obtain the image of the cocoon. Finally, the ratio of long to short axis of the cocoon and the area parameters were calculated, and the double-parameter threshold was used to recognize the double cocoon. And then, the serial algorithm proposed in this paper was used to segment cocoon graphics, restore cocoon shape, and distinguish double cocoons in 10 cocoon images. The results show that the 222 cocoons of all the ten pictures are completely segmented, and the counting accuracy is 100%. A total of 46 double cocoons in the pictures are detected, and the classification accuracy of double cocoons and single cocoons is 98.6%. This method detects the small double cocoons which are easy to be missed by the area threshold method, and accurately identifies the cocoon type which is close to the threshold of the ratio of long to short axis. The series algorithm of cocoon target segmentation and double cocoon recognition proposed in this paper can effectively process the machine vision image to get the conclusion whether each cocoon is a double one. In the series algorithm, the pre-experiment is used to determine the area of the normal cocoon and the length of the long axis of the normal cocoon as the prior conditions in the captured image. The cocoon target with slight overlap can be separated, but the cocoons with serious overlap may be mistakenly divided into the same group, thus affecting the classification and recognition of the cocoon. Therefore, this method is suitable for the image processing of cocoons laid flat in the field of vision. Key words: image segmentation; double cocoons; counting; classification; algorithm; threshold 收稿日期: 2022-08-26; 修回日期: 2023-03-01 基金項目: 四川省省級科研院所基本科研業務費項目(2021JBKY0014-05);四川省蠶桑創新團隊項目(SCCXTD-2022-17) 作者簡介: 蔣昭瓊(1984),女,高級農藝師,主要從事農產品質量與品質檢測技術、農產品加工及貯藏技術研究。