語音識別技術在錄音錄像檔案管理中的應用探析

許振哲

摘要:當前錄音錄像檔案存在著錄效率低下、著錄質量不高的問題。論文提出,將語音識別技術應用于錄音錄像檔案管理,能夠有效提升錄音錄像文件文本化轉換的速度與精度,適應錄音錄像檔案急劇增長的浪潮;將語音識別技術與詞云圖、時間戳結合,納入智慧檔案館建設總體進程,可以實現錄音錄像檔案的自動化著錄、智能化檢索,從而提高錄音錄像檔案的總體利用水平。

關鍵詞:語音識別技術 錄音錄像檔案 詞云圖

錄音錄像檔案是國家機構、社會組織或個人在社會活動中直接形成的以聲音或影像為主要反映形式的具有保存價值的歷史記錄。由于錄音錄像檔案的本質是非結構化數據,檔案檢索依賴于文字著錄信息,著錄信息的有限性與用戶需求的多元性難以協調,極大地限制了錄音錄像檔案價值的發揮。近年來,卷積神經網絡迅猛發展,機器深度學習能力不斷加強,語音識別技術逐漸走向成熟,語音識別技術的應用有助于實現錄音錄像檔案內容文本化、著錄自動化以及檢索智能化。語音識別技術將是錄音錄像檔案管理未來發展的新方向。

一、錄音錄像檔案管理現狀與問題

隨著科技的不斷發展、智能化設備的全面普及,錄音錄像的采集變得愈發便捷。近年來,錄音錄像檔案數量劇增,國家檔案局發布的數據顯示:2018年,全國各級國家綜合檔案館館藏數字錄音、數字錄像總量為30.5萬GB(≈297.85TB),全年共接收錄音磁帶、錄像磁帶、影片檔案2.9萬盤;到2021年,館藏數字錄音、數字錄像總量為690.6TB,全年共接收錄音磁帶、錄像磁帶、影片檔案6.1萬盤。[1]短短3年,錄音錄像檔案的館藏總量在原有基礎上翻了一番,實現了跨越式增長。

錄音錄像檔案總量不斷增長的同時,也暴露出一系列問題。一方面,錄音錄像檔案的編目著錄仍在沿用傳統人工著錄的方式,難以滿足用戶的利用需求。張海劍曾指出:“目前檔案部門對音、視頻檔案的整理還停留在人工視聽階段,一邊看一邊聽一邊錄,不僅效率低、內容采集不全,還費時費力。”[2]然而單憑人力,想要完成海量錄音錄像檔案的著錄工作無異于天方夜譚。另一方面,錄音錄像檔案的著錄層次結構較為單一。錄音錄像檔案管理參照的行業標準主要包括《錄音錄像檔案數字化規范》(DA/T 62—2017)、《錄音錄像類電子檔案元數據方案》(DA/T 63—2017)以及《錄音錄像檔案管理規范》(DA/T 78—2019),以上標準普遍存在對著錄尤其是必選著錄的規定過于籠統,描述不夠詳盡的問題,缺少對鏡頭、場景的著錄項,不利于準確、高效查找具體內容。[3]不僅如此,在技術發展日新月異的今天,錄音錄像檔案管理面臨的新問題層出不窮,行業標準如不能及時推陳出新,必然無法適應時代需求。

由此可見,當前錄音錄像檔案在著錄模式、著錄規范上存在一定問題,從而導致錄音錄像檔案的著錄效率較低、著錄質量不高。錄音錄像檔案著錄信息的有限性與檔案內容的高效檢索利用之間,形成了無法避免的矛盾。[4]因此需要引入語音識別技術,通過機器的深度學習、自動編目幫助完成錄音錄像檔案著錄工作,全面發揮錄音錄像檔案的價值。

二、語音識別技術的發展與應用

語音識別是以語音為研究對象,通過語音信號處理和模式識別讓機器自動識別與理解人類口述的語言。語音識別技術是讓機器通過識別和理解過程把語音信號轉變為相應的文本或命令的技術。而語音識別系統本質上是一種模式識別系統,包括特征提取、模式匹配、參考模式庫三個基本單元。[5]

語音識別技術產生至今,已有半個多世紀的發展歷程。早在20世紀50年代,貝爾實驗室的研究者就通過模擬元器件提取語音中元音的共振峰頻率變化信息,從而對孤立數字的語音實現了識別。[6]20世紀60年代后期,倫納德·E.包姆(Leonard E. Baum)和其他一些作者在一系列論文中提出隱馬爾可夫模型(Hidden Markov Model,HMM),并于70年代中期開始將其應用于語音識別。2006年,杰弗里·辛頓(Geoffrey Hinton)發表關于計算機深度學習的論文,其中深度神經網絡(Deep Neural Networks,DNN)的提出,標志著語音識別技術進入人工智能時代。截至2015年,計算機在深度學習語音識別模型庫的語音識別錯誤率為3.1%,已經超過正常人的識別能力(正常人的語音識別錯誤率為5%)。[7]

隨著深度學習理論的不斷發展,語音識別技術已經在圖書領域有了廣泛而深入的應用:中山大學鐘遠薪等人將語音識別技術用于徽州文書文本化工作,研究發現語音識別技術的識別率相較OCR有顯著提升,而識別時間僅為手工錄入的六分之一,語音識別技術可以大幅提高徽州文書的文本提取效率。[8]反觀檔案領域,目前對語音識別技術開展的相關研究并不多,且側重于探討如何實現人機智能語音交互。[9]誠然,人機語音交互可以在一定程度上優化檔案利用者的操作體驗,然而對于錄音錄像檔案查全率、查準率的提升作用還不夠顯著。語音識別技術的相關研究更應注重編目和著錄環節而非人機交互環節。換句話說,識別錄音錄像檔案中“說話的人是誰”以及“說的是什么”顯然比識別“檢索利用者是誰”以及“想查詢什么”更加重要。將語音識別技術用于錄音錄像檔案的文本轉化,能夠讓技術的優勢得到更加全面的發揮。

三、語音識別技術應用于錄音錄像檔案管理的前景與展望

(一)利用深度學習語音識別模型,實現錄音錄像檔案內容文本化

目前我國錄音錄像檔案整體利用水平不高,主要原因在于錄音錄像檔案的本質是聲音或畫面,屬于非結構化數據,無法直接進行檢索,需要先將聲音和畫面轉化為文字,再對文字信息進行歸納總結,提取關鍵字著錄后方可供用戶檢索。然而,我國現階段錄音錄像檔案仍在沿用傳統人工轉寫的方式,邊聽邊錄,一個小時的錄音錄像文件,往往要花費幾倍的時間才能實現文本轉換。此外,一些包含噪聲或者夾雜方言的片段還需要檔案工作者反復收聽、仔細確認,效率低下,費時費力,人工轉寫的速度遠不及錄音錄像檔案生成的速度。此外,人工轉寫后的檔案全文,只能籠統對應一個時間區間,難以將文字與錄音錄像檔案中的時間點精準匹配。用戶通過全文檢索查詢到對應內容后,仍需拖動進度條,播放一個片段才能找到文字對應的關鍵幀。

隨著深度學習的不斷發展、卷積神經網絡的逐步優化,如今語音識別技術的發展應用已日趨成熟,機器可以替代人工,將錄音錄像檔案中的聲音快速轉化為文字。一個小時的錄音錄像文件,只需十分鐘左右即可完成轉寫,極大地提升了工作效率、節約了人力成本。隨著深度神經網絡的優化,機器可以在轉寫過程中不斷訓練升級,并根據上下文語義對內容進行智能糾錯。[10]相比于人工轉寫一次只能對單個文件進行加工,機器可以24小時不間斷對多個錄音錄像文件同時進行文本轉換,在識別速度、識別精確度等方面均優于人工,完全能夠適應近年來錄音錄像檔案急劇增長的勢頭。不僅如此,通過語音識別技術完成的文本轉換,文字與時間線聯系更加緊密:轉換后的文字可以作為內嵌字幕添加到錄音錄像檔案中,確保文字內容和聲音幀數的精準匹配,用戶通過全文檢索,即可實現對錄音錄像關鍵幀的快速定位。

(二)結合詞云圖與文字流時間戳,實現錄音錄像檔案著錄自動化

《錄音錄像類電子檔案元數據方案》(DA/T 63—2017)將檔案元數據劃分為四大類,并進一步細化為96個著錄項,每個元數據的約束性和可重復性又分為必選、條件選、可選、可重復、不可重復五種類型,內容煩瑣,形式復雜,給檔案著錄造成不便;方案未將主題、職能業務、管理活動等涉及錄音錄像內容信息的元數據列入必選著錄項,這就導致錄音錄像檔案著錄過程中對于活動主題的描述過于簡略或干脆省略,給檔案利用帶來極大的困難。《錄音錄像檔案管理規范》(DA/T 78—2019)對基本著錄項進行了凝練,將工作活動描述納入必選著錄項中,然而囿于篇幅限制,寥寥數語顯然難以精準概括錄音錄像檔案的全部內容。因此在實際工作中,錄音錄像檔案常以下面的形式著錄:

題名:××年××活動開幕式

內容描述:××部門領導A主持開幕式

內容起始時間:××′××″

內容結束時間:××′××″

內容描述:××部門領導B發表講話

內容起始時間:××′××″

內容結束時間:××′××″

不難看出,傳統模式下錄音錄像檔案的著錄主要按照時間順序,將所涉活動劃分為若干流程,再提取各流程中涉及的重要人員作為關鍵詞,通常不提及具體講話內容。這就導致在利用環節,著錄項比較籠統,用戶很難通過著錄項快速了解活動主題,只能逐幀瀏覽原文件,從中尋找錄音錄像檔案蘊藏的關鍵信息。

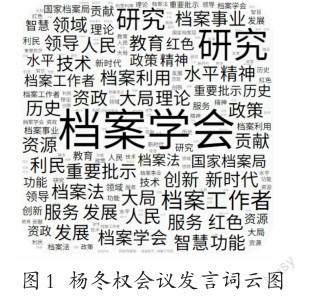

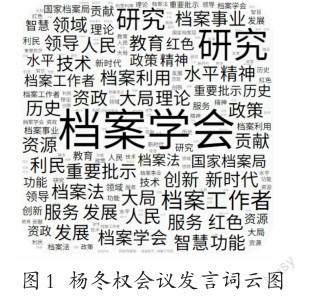

提升錄音錄像檔案著錄質量、幫助用戶迅速把握重點信息的關鍵在于如何自動提取文本中的高頻關鍵詞并加強可視化。筆者將詞云圖、文字流時間戳與語音識別技術有機結合,以求進一步優化用戶的檢索體驗。以中國檔案學會成立40周年學術研討會會議錄像為例,[11]會議召開于2021年12月16日,時長2小時55分08秒。按照傳統著錄模式,想要提取會議中某個發言人發言的重點信息需要耗費大量的時間,而通過語音識別技術,則可以在實現錄音錄像檔案文本化轉換的基礎上生成詞云圖,并為關鍵詞添加時間戳,從而解決當前著錄與利用環節中存在的問題。會議的一個議程為中國檔案學會理事長楊冬權致辭,對應時間段為33′06″~46′43″。想要提取這段發言的重要內容,首先可以通過語音識別技術對發言內容進行識別,將約14分鐘的講話內容轉換為2000余字的文本;接著對發言文本進行詞頻分析,生成詞云圖,如圖1所示;最后為詞云圖中每個關鍵詞添加文字流時間戳,點擊對應關鍵詞即可顯示它在視頻中每次出現時的上下文信息,選中對應上下文條目則可直接跳轉至文本信息對應的視頻位置,無須逐幀觀看原文件。

按照上述操作方法,通過語音識別軟件的識別與加工,就可以將時長接近3小時的會議視頻轉換成一個添加了文字流時間戳的文本文件及若干個詞云圖。一方面,這樣做省去了傳統模式下錄音錄像檔案著錄邊聽邊看邊記錄的煩瑣工作,機器可以通過語音文字識別結果自動著錄會議的每一項議程,并呈現對應內容,著錄信息更為詳盡。另一方面,這樣做可以有機結合詞云圖與文字流時間戳,使錄音錄像檔案的可視化更強,主題一目了然,極大地方便用戶快速瀏覽。文字流時間戳的添加可以實現文字內容——視頻關鍵幀的一鍵跳轉,方便用戶對重點信息進行精準定位。

(三)納入智慧檔案館建設總體進程,實現錄音錄像檔案檢索智能化

隨著科技的不斷進步,人工智能技術已逐步發展成熟,將語音識別技術與開放檔案信息系統有機結合,納入智慧檔案館建設總體進程,能使技術的優勢得以更加全面的發揮。語音識別技術不僅可以使檔案著錄更加精準、高效,還可以增強錄音錄像檔案與其他門類檔案的內在關聯,在檢索形式與檢索邏輯上更加趨于智能。

傳統錄音錄像檔案檢索機制相對單一,停留在文字檢索階段,通過對檢索詞與著錄項的關鍵字進行匹配,進而輸出音視頻結果。語音識別技術的應用為檢索形式的創新奠定了基礎,也使“以聲搜聲”得以實現:在開放檔案信息系統中上傳一個音頻片段,語音識別軟件會自動解碼文件,進行文字化轉換,判定音頻片段中“說話的內容是什么”,并將檔案庫中文字匹配度最高的音視頻作為結果輸出;不僅如此,語音識別軟件還可以對片段進行聲紋識別,判定“說話的人是誰”,將人物信息元數據一并呈現,并將該人物的其他音視頻檔案作為拓展信息與檢索結果一并推送給用戶。

通過上述功能,用戶可以根據音頻片段溯源原始文件,詳細了解事件或講話的背景信息及來龍去脈,或是了解哪些場合曾出現過與音頻片段內容相關或近似的講話內容。聲紋識別可以關聯同一個人在不同場合的錄音錄像檔案,實現人物身份信息元數據的串聯,不僅可以對檢索結果進行智慧化推送,也可以對年代久遠、六要素模糊的錄音錄像檔案進行信息補全。

目前錄音錄像檔案的著錄水平難以滿足用戶的利用需求,因此語音識別技術當前的出發點是提升錄音錄像檔案的查全率。隨著技術的深化應用、音視頻全文檢索功能的逐步完善,提升錄音錄像檔案的查準率將是未來發展的落腳點。今后還可以使用方言檔案數據庫和多語種語音庫對語音識別模型進行訓練,進一步提升模型的識別能力。在語音識別模型基本成熟的前提下,將語音識別技術與其他人工智能技術協同納入智慧檔案館建設總體進程,充分運用大數據和云計算技術,最終將提高錄音錄像檔案的總體利用水平。

注釋及參考文獻:

[1]中華人民共和國國家檔案局.2021年度全國檔案主管部門和檔案館基本情況摘要[EB/OL].(2022-08-18)[2022-10-27].https://www.saac.gov.cn/daj/zhdt/202208/ b9e2f459b5b1452d8ae83d7f78f51769.shtml.

[2][6][10]張海劍.人工智能賦能檔案事業創新成果與研究[EB/OL].[2022-10-27].http://cpfd.cnki.com.cn/Ar? ticle/CPFDTOTAL-ZGDA201907001009.htm.

[3]劉金月.我國聲像檔案長期保存相關標準的研究[D].沈陽:遼寧大學,2022:37-38.

[4]劉濤.人工智能技術在錄音錄像檔案管理中的可用性[J].檔案管理,2022(3):71-72.

[5]玩人工智能的你必須知道的語音識別技術原理[EB/OL]. (2022-07-14)[ 2022-10-27 ]. https : //news. eda365.com/appl/smcp/12008831711504.html.

[7]周宣汝,趙麗亞,趙地,等.人工智能對科研信息化的推動作用[J].科研信息化技術與應用,2016,7(6):14-26.

[8]鐘遠薪,王蕾,楊新涯,等.徽州文書文本化語音識別技術應用研究[J].圖書館論壇,2022(1):1-10.

[9]張倩.生物特征識別技術在“高校檔案云”服務平臺的應用研究[J].浙江檔案,2018(3):62-64.

[11]中國檔案學會.中國檔案學會成立40周年學術研討會[EB/OL].(2021- 12- 16) [2022- 10- 27].https:// marketing.csslcloud.net/video/A7AA77B67BEC691A/ 35DB5A93C0BF2D139C33DC5901307461.

作者單位:上海理工大學檔案館