可解釋學(xué)習(xí)者建模:價值意蘊與應(yīng)用圖景

王一巖 鄭永和

一、問題的提出

以“數(shù)據(jù)密集型科學(xué)”為代表的第四研究范式的快速發(fā)展,使得教育研究不再僅依靠“經(jīng)驗驅(qū)動”的傳統(tǒng)模式,越發(fā)重視依靠人工智能技術(shù)發(fā)揮教育數(shù)據(jù)的核心價值。然而,智能分析與決策的“黑箱問題”造成了人對機器的“信任危機”,這限制了人工智能教育應(yīng)用實際效用的發(fā)揮。在此背景下,可解釋教育人工智能逐漸受到重視,其關(guān)注機器如何通過有意義的交互為使用者解釋智能決策的緣由與依據(jù),以促進教育系統(tǒng)的可理解、可信任、可管理,已成為智能教育領(lǐng)域的新方向(王萍等,2021)。教育系統(tǒng)中的教師、環(huán)境、資源、活動、服務(wù)等核心要素均作用于學(xué)生,利用人工智能技術(shù)對學(xué)習(xí)者進行建模、分析和刻畫是可解釋教育人工智能關(guān)注的核心話題(盧宇等,2022),有助于了解學(xué)生的學(xué)業(yè)狀況和潛在特征,明確智能教育決策的依據(jù)和邏輯,進而增強人們對機器決策的信任度和接受度。

可解釋的學(xué)習(xí)者建模對教育人工智能研究提出了極大挑戰(zhàn),其根本原因在于學(xué)習(xí)者特征具有較高的復(fù)雜性,具體表現(xiàn)在:一是“內(nèi)隱性”,即反映學(xué)習(xí)者內(nèi)在屬性的知識結(jié)構(gòu)、認知水平、學(xué)習(xí)態(tài)度、學(xué)習(xí)偏好、學(xué)習(xí)動機等特征不易通過直接觀察得出;二是“層次性”,即學(xué)習(xí)者深層次的特征無法通過單一的外顯表征來呈現(xiàn),而需要構(gòu)建層次化的分析模型來進行揭示;三是“生長性”,即學(xué)習(xí)者的特征會隨著學(xué)習(xí)過程不斷變化,對其全面刻畫需要反映特征的變化規(guī)律及個體的成長歷程;四是“關(guān)聯(lián)性”,即學(xué)習(xí)者的認知和非認知特征之間存在關(guān)聯(lián),對其關(guān)系的挖掘也是學(xué)習(xí)者建模要解決的關(guān)鍵問題;五是“情境性”,即教育情境要素會對學(xué)習(xí)者產(chǎn)生作用,明確其對學(xué)習(xí)者特征的影響有助于揭示學(xué)習(xí)發(fā)生的內(nèi)在機理。可見,如何準確刻畫學(xué)習(xí)者特征,進而揭示特征要素間的關(guān)聯(lián)和變化規(guī)律,是可解釋的學(xué)習(xí)者建模研究需要解決的關(guān)鍵問題。基于此,本文利用可解釋人工智能(Explainable Artificial Intelligence,XAI)的方法全方位構(gòu)建學(xué)習(xí)者模型,從“數(shù)據(jù)感知—行為刻畫—特征挖掘—模型構(gòu)建—機理闡釋”等多個層面還原學(xué)習(xí)過程、刻畫學(xué)生特征、挖掘?qū)W習(xí)規(guī)律,以此實現(xiàn)可解釋的教育評價、學(xué)習(xí)干預(yù)和教育決策。

二、相關(guān)內(nèi)涵詮釋

1.學(xué)習(xí)者建模

學(xué)習(xí)者建模旨在對學(xué)習(xí)者的知識技能、認知行為、情感體驗等特征進行描述、分析并構(gòu)建相應(yīng)的數(shù)字模型(王小根等,2021),以此實現(xiàn)對學(xué)習(xí)者的深層次、全方位表征與刻畫。基于智能技術(shù)的學(xué)習(xí)者特征挖掘與建模是智能教育研究的重點,也是近年來國家自然科學(xué)基金教育信息科學(xué)與技術(shù)領(lǐng)域(F0701)關(guān)注的核心話題(鄭永和等,2023)。通過對近年來國內(nèi)外學(xué)習(xí)者建模研究的系統(tǒng)梳理,發(fā)現(xiàn)該領(lǐng)域的前沿理論和實踐研究主要涉及以下三個方面:其一,面向?qū)W習(xí)者單一特征要素的復(fù)雜建模。其主要關(guān)注對學(xué)習(xí)者知識、認知、情感等單一維度特征的復(fù)雜建模和精準刻畫,例如:利用知識圖譜的方法對學(xué)習(xí)者的知識掌握情況和學(xué)科能力水平進行多層次、細粒度、可視化的精準刻畫(李艷燕等,2019);利用知識追蹤的方法對學(xué)習(xí)者與學(xué)習(xí)資源之間的交互過程進行跟蹤和建模,以此對學(xué)習(xí)者的知識水平和認知結(jié)構(gòu)進行精準評估,并對學(xué)習(xí)者的作答表現(xiàn)進行預(yù)測(王志鋒等,2021);利用學(xué)習(xí)者的面部表情、身體姿態(tài)、生理指標(biāo)、話語信息等多模態(tài)數(shù)據(jù)對其情緒狀態(tài)進行識別,或是對學(xué)習(xí)者的學(xué)習(xí)偏好、學(xué)習(xí)態(tài)度、學(xué)習(xí)風(fēng)格進行診斷評估;等等。其二,面向?qū)W生多特征要素的聯(lián)合建模以及動態(tài)演化的全景化學(xué)習(xí)者建模。其關(guān)注學(xué)習(xí)者信息的多源整合性、學(xué)習(xí)發(fā)生的情境依存性、學(xué)習(xí)狀態(tài)的時序變化性、學(xué)習(xí)者模型的層次表征性、學(xué)習(xí)者發(fā)展的協(xié)同進化性(王一巖等,2021a),既強調(diào)利用多模態(tài)數(shù)據(jù)之間的信息互補機制對學(xué)習(xí)者的外顯狀態(tài)和內(nèi)隱特征進行精準刻畫,同時也注重通過分析特征要素間的相互關(guān)聯(lián)挖掘?qū)W習(xí)者知識、認知、情感的動態(tài)演化機理。其三,基于情境感知的學(xué)習(xí)者建模。其關(guān)注真實教育情境中“人—機—物—環(huán)境—活動”等要素對學(xué)習(xí)者知識建構(gòu)、認知發(fā)展和情緒狀態(tài)的影響機制,探究學(xué)習(xí)者深層次的學(xué)習(xí)動機、學(xué)習(xí)風(fēng)格、學(xué)習(xí)偏好等特征(王一巖等,2022b)。

2.可解釋學(xué)習(xí)者建模

可解釋人工智能是以可理解的方式向人類解釋并呈現(xiàn)智能系統(tǒng)行為與決策的新一代人工智能,其目標(biāo)是使用戶能夠理解和信任機器學(xué)習(xí)算法所產(chǎn)生的結(jié)果和輸出(Guidotti et al.,2018)。可解釋人工智能意味著人工智能在其操作中是透明的,這樣人類就能夠理解和信任機器做出的決策,其目標(biāo)是使人工智能系統(tǒng)具備類人化的解釋能力,幫助人類通過動態(tài)生成的圖表和文字描述理解機器智能決策的邏輯、依據(jù)與機制,從而避免人工智能的黑盒模型帶來的人對機器的“信任危機”,建立起人與機器之間的信任橋梁。

隨著智能教育研究的快速發(fā)展和計算教育學(xué)研究范式的逐步推進(鄭永和等,2020),學(xué)界越發(fā)強調(diào)學(xué)習(xí)者模型的“可解釋性”,旨在通過對學(xué)習(xí)者多維度、多層次、多場景的精準刻畫,實現(xiàn)學(xué)習(xí)者的可表征、可理解、可干預(yù),進而為學(xué)習(xí)策略的調(diào)整、教學(xué)模式的設(shè)計、教育評價的開展提供科學(xué)有效的參考依據(jù)。可解釋學(xué)習(xí)者建模的核心在于:一是構(gòu)建描述學(xué)習(xí)者本體特征的教育模型,建立起相關(guān)數(shù)據(jù)表征和學(xué)習(xí)者特征之間的映射關(guān)系并揭示學(xué)習(xí)者特征間的關(guān)聯(lián);二是對教育情境和學(xué)習(xí)者特征之間的因果關(guān)系進行分析,明確哪些外部因素會對學(xué)習(xí)者的學(xué)習(xí)產(chǎn)生影響,以揭示學(xué)習(xí)發(fā)生的內(nèi)在機理;三是利用可解釋的方式將機器智能決策的依據(jù)和邏輯呈現(xiàn)給學(xué)習(xí)者、教師和管理者,增加其對機器智能決策的信任度。

可解釋學(xué)習(xí)者建模的“可解釋性”主要體現(xiàn)在以下兩個層面:其一,學(xué)習(xí)者分析與建模的可解釋性,即關(guān)注學(xué)習(xí)者本體特征刻畫及其模型構(gòu)建的可解釋性,旨在構(gòu)建學(xué)習(xí)者本體和客觀數(shù)據(jù)模型之間的橋梁,通過建立合理完善的結(jié)構(gòu)模型和指標(biāo)體系來表征學(xué)習(xí)者特征,進而為教育評價的開展、教育規(guī)律的挖掘、教育干預(yù)的實施提供參照依據(jù)。學(xué)習(xí)者分析與建模的可解釋性主張利用學(xué)業(yè)測評數(shù)據(jù)、心理測評數(shù)據(jù)、學(xué)習(xí)行為數(shù)據(jù)、生理指標(biāo)數(shù)據(jù)、人機交互數(shù)據(jù)、學(xué)習(xí)情境數(shù)據(jù)來表征學(xué)習(xí)過程和刻畫學(xué)生狀態(tài),并利用知識追蹤、情感計算、時間序列分析、關(guān)聯(lián)規(guī)則挖掘等技術(shù)來分析學(xué)習(xí)者特征和探究學(xué)習(xí)機理,進而構(gòu)建基于“數(shù)據(jù)感知—行為刻畫—特征挖掘—模型構(gòu)建—機理闡釋”的層次化分析模型,從多個維度、多個層次來還原學(xué)習(xí)者的本體特征,幫助利益相關(guān)者了解學(xué)習(xí)者內(nèi)在的認知結(jié)構(gòu)和心理偏好,以此為學(xué)習(xí)策略的修正、教學(xué)模式的優(yōu)化、教育治理的改善提供可靠保障。其二,學(xué)習(xí)診斷與干預(yù)的可解釋性,即關(guān)注學(xué)習(xí)者學(xué)情診斷與教學(xué)干預(yù)的可解釋性,旨在利用易于理解的方式呈現(xiàn)機器智能決策的邏輯和依據(jù)。傳統(tǒng)教育人工智能在對學(xué)生學(xué)習(xí)進行診斷與干預(yù)時,大多直接呈現(xiàn)解決方案與策略,但忽視了“算法黑箱”造成的“信任危機”。學(xué)習(xí)診斷與干預(yù)的可解釋性主張在利用智能技術(shù)進行學(xué)業(yè)診斷和學(xué)習(xí)干預(yù)時,能夠通過圖表或文字描述的方式幫助學(xué)生、教師和管理者理解機器決策的內(nèi)在緣由,以及相關(guān)決策可能產(chǎn)生的效果,進而增強教育主體對機器的信任度。

三、可解釋學(xué)習(xí)者建模的價值意蘊

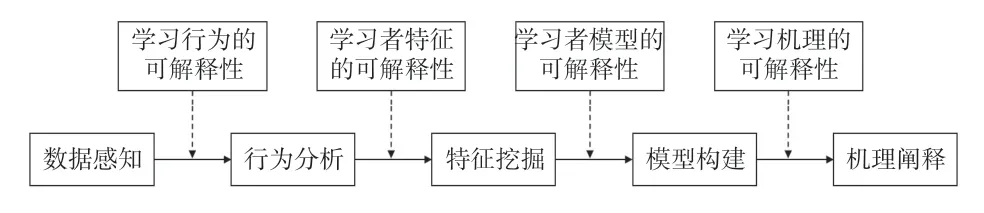

要實現(xiàn)人工智能與教育教學(xué)的深度融合,提升機器智能決策的透明度和可解釋性是關(guān)鍵所在,這不僅關(guān)系到教育主體對決策結(jié)果的理解和接受程度,也影響到其對教育人工智能應(yīng)用的采納意愿。就可解釋學(xué)習(xí)者建模而言,其核心價值體現(xiàn)在對外在學(xué)習(xí)行為的準確表征、對學(xué)習(xí)者潛在特征的深度挖掘、對學(xué)習(xí)者模型的完整構(gòu)建以及對學(xué)習(xí)機理的準確闡釋,并且在模型構(gòu)建過程中要充分體現(xiàn)出透明度和可解釋性。為便于理解可解釋學(xué)習(xí)者建模如何在構(gòu)建過程中體現(xiàn)其核心價值,本文提出了基于“數(shù)據(jù)感知—行為分析—特征挖掘—模型構(gòu)建—機理闡釋”的層次化概念模型(如圖1 所示),并以此對建模各階段中需要達成的價值目標(biāo)進行闡釋。

圖1 可解釋學(xué)習(xí)者建模的層次化概念模型

1.學(xué)習(xí)行為的可解釋性:從學(xué)習(xí)數(shù)據(jù)感知到學(xué)習(xí)行為表征

學(xué)習(xí)行為的可解釋性主要致力于呈現(xiàn)復(fù)雜非線性模型內(nèi)在的計算邏輯,建立客觀數(shù)據(jù)表征和學(xué)習(xí)行為特征之間的映射關(guān)系,對學(xué)習(xí)者的學(xué)習(xí)行為進行智能感知和精準刻畫。近年來學(xué)界愈發(fā)注重利用多模態(tài)數(shù)據(jù)來表征學(xué)習(xí)行為和學(xué)習(xí)狀態(tài)(王一巖等,2022a),依靠多模態(tài)數(shù)據(jù)之間的信息互補機制來提升數(shù)據(jù)分析的成效、挖掘?qū)W習(xí)者的潛在特征(王一巖等,2021b)。例如,基于卷積神經(jīng)網(wǎng)絡(luò)和決策級融合的方法構(gòu)建多模態(tài)學(xué)習(xí)情感計算模型,利用面部表情和身體姿態(tài)數(shù)據(jù)對學(xué)習(xí)者的開心、困惑、平靜、厭倦四種情緒狀態(tài)進行識別(翟雪松等,2022)。也有學(xué)者關(guān)注可解釋人工智能技術(shù)在學(xué)習(xí)者行為刻畫和狀態(tài)表征層面的應(yīng)用,例如,Rathod等(2022)創(chuàng)建了一個面向7~10歲兒童的面部表情數(shù)據(jù)庫用于在線學(xué)習(xí)中的學(xué)生情緒識別,采用三種可解釋人工智能算法(Grad-CAM、Grad-CAM++和ScoreGrad)解釋情緒識別的依據(jù)和預(yù)測情緒的關(guān)鍵特征,并通過熱圖的方式對嘴唇、眼睛、眉毛等表情特征對于情緒表征的貢獻程度進行可視化展示,以提高在線學(xué)習(xí)當(dāng)中情緒識別的精準度。學(xué)習(xí)行為的可解釋性需要建立數(shù)據(jù)感知和行為表征間的映射關(guān)系,通過對算法模型計算過程的呈現(xiàn)來解釋所采集的特征指標(biāo)數(shù)據(jù)與學(xué)習(xí)者行為和學(xué)習(xí)狀態(tài)之間的關(guān)聯(lián),從而便于利益相關(guān)者理解學(xué)習(xí)者的學(xué)習(xí)行為和學(xué)習(xí)狀態(tài)。當(dāng)然,從研究內(nèi)容來看,對算法模型計算過程的呈現(xiàn)更多的是計算機領(lǐng)域?qū)W者關(guān)注的問題,教育領(lǐng)域的研究者則需要將注意力放在描述學(xué)習(xí)行為的特征指標(biāo)上,關(guān)注如何以更易于理解的方式呈現(xiàn)特征指標(biāo)與學(xué)習(xí)行為分析結(jié)果的對應(yīng)關(guān)系,并以此來為學(xué)習(xí)機理的挖掘和干預(yù)措施的制定提供有效支撐。

2.學(xué)習(xí)者特征的可解釋性:從外顯行為表征到潛在特征挖掘

學(xué)習(xí)者特征的可解釋性主要致力于挖掘?qū)W習(xí)者外顯行為和潛在特征之間的關(guān)聯(lián)關(guān)系,以此來對學(xué)習(xí)者復(fù)雜的認知結(jié)構(gòu)進行表征。筆者認為,不能將學(xué)習(xí)行為直接作為學(xué)習(xí)者模型的要素之一,原因在于學(xué)習(xí)行為是學(xué)習(xí)者知識技能、認知行為和情感體驗等潛在心理特征的外顯表征,學(xué)習(xí)行為和知識、認知、情感要素之間具有復(fù)雜的內(nèi)在聯(lián)系,在對學(xué)習(xí)者特征進行刻畫的過程中,如果既關(guān)注學(xué)習(xí)者外顯的行為表征,也關(guān)注學(xué)習(xí)者內(nèi)在的隱性特征,則將極大地增加學(xué)習(xí)者建模的復(fù)雜度(王一巖等,2022b)。因此,在可解釋學(xué)習(xí)者建模研究中,更多是將外顯行為作為學(xué)習(xí)者模型的觀測點,以學(xué)習(xí)者的外顯行為來反映其潛在的認知和非認知特征。相關(guān)研究主要關(guān)注以下三個方面:一是基于多維度的學(xué)習(xí)行為表征來獲取學(xué)習(xí)者的隱含特征,并以此來解釋學(xué)業(yè)表現(xiàn)與學(xué)習(xí)行為之間的關(guān)聯(lián)。例如,胡欽太等(2021)采用深度學(xué)習(xí)算法提取學(xué)習(xí)者的淺層次學(xué)習(xí)行為特征,而后利用HDRBM神經(jīng)網(wǎng)絡(luò)分析其隱含特征,在此基礎(chǔ)上采用貝葉斯因果分析法解釋學(xué)習(xí)行為對成績的影響。二是利用知識追蹤的方法對學(xué)生考試、作業(yè)等測評數(shù)據(jù)進行時序性、動態(tài)化的挖掘分析來反映其內(nèi)在的知識結(jié)構(gòu)和認知水平。例如,Nakagawa 等(2019)將課程作業(yè)的圖結(jié)構(gòu)關(guān)系納入知識追蹤模型,并構(gòu)建了基于圖神經(jīng)網(wǎng)絡(luò)的深度知識追蹤模型,研究結(jié)果表明,該方法可以提高對學(xué)生成績的預(yù)測效果,且具有較高的可解釋性。三是利用學(xué)習(xí)者的面部表情、身體姿態(tài)、生理信息、話語信息等對其在學(xué)習(xí)過程中的情緒狀態(tài)進行識別,并對與學(xué)業(yè)情緒相關(guān)的學(xué)習(xí)偏好、學(xué)習(xí)態(tài)度、學(xué)習(xí)動機等深層次特征進行深入的挖掘分析(王一巖等,2021a)。從外顯行為表征到內(nèi)隱特征的挖掘是可解釋學(xué)習(xí)者建模的核心,通過利用可解釋人工智能的方法對學(xué)習(xí)者外顯行為進行分析以揭示其潛在特征,能夠幫助教師更好地理解學(xué)習(xí)者行為表現(xiàn)背后反映出的個體特點和差異,這往往是因材施教得以有效實施的前提。

3.學(xué)習(xí)者模型的可解釋性:從單一特征刻畫到完整個體建模

學(xué)習(xí)者模型的可解釋性致力于探究潛在特征要素之間的關(guān)聯(lián)關(guān)系,關(guān)注學(xué)習(xí)者知識、認知、情感等特征之間的協(xié)同演化機制。從學(xué)習(xí)者建模的研究現(xiàn)狀來看,大多研究主要是對知識結(jié)構(gòu)、認知水平、情感狀態(tài)等單一特征的建模分析,或是通過多模態(tài)的數(shù)據(jù)感知與建模方法對學(xué)習(xí)者某個維度特征進行刻畫。然而,個體的發(fā)展并非單向度的,其認知與非認知特征之間具有一定的關(guān)聯(lián)。認知心理學(xué)相關(guān)研究也表明,情緒可以發(fā)動、干涉、組織或破壞認知過程和行為,認知對事物的評價則可以發(fā)動、轉(zhuǎn)移或改變情緒反應(yīng)和體驗。由此可見,要想全方位刻畫學(xué)習(xí)者的潛在特征、挖掘?qū)W習(xí)者的成長規(guī)律,除了對學(xué)習(xí)者的認知和非認知特征進行多層次、長周期、動態(tài)性的建模分析外,還需要重視學(xué)習(xí)者認知和非認知特征的協(xié)同建模和演化分析,挖掘其相互作用機理與動態(tài)變化過程,構(gòu)建易于理解的“聯(lián)合模型”,并合理解釋各類特征之間的作用規(guī)律。因此,如何實現(xiàn)從單一特征的刻畫到完整個體的復(fù)雜建模,并對其中的蘊含的潛在機理進行科學(xué)解釋,是可解釋學(xué)習(xí)者建模需要達成的另一個價值目標(biāo)。Mangaroska 等(2022)關(guān)于編程教學(xué)中學(xué)習(xí)者認知和情感的作用機制的研究是此方面的代表性案例,該研究采用腦電、眼動、面部表情和編程日志等多模態(tài)數(shù)據(jù)來表征學(xué)習(xí)者的認知和情感特征,建模分析結(jié)果表明,注意力、收斂思維等認知特征和挫敗感等非認知特征與學(xué)業(yè)表現(xiàn)正相關(guān)。從目前來看,關(guān)于學(xué)習(xí)者認知和非認知特征協(xié)同演化機制的研究仍然較少(Noroozi et al.,2020),是未來可解釋學(xué)習(xí)者建模研究需要關(guān)注的重要方向。

4.學(xué)習(xí)機理的可解釋性:從學(xué)習(xí)者模型構(gòu)建到學(xué)習(xí)機理闡釋

學(xué)習(xí)機理的可解釋性致力于分析外在的情境要素對學(xué)習(xí)者知識、認知、情感的作用機制,挖掘教育情境對學(xué)習(xí)者個體發(fā)展的影響機制,以此揭示深層次的教育規(guī)律。從近年來學(xué)習(xí)科學(xué)領(lǐng)域的相關(guān)研究來看,主要通過對特定教育情境下教師教學(xué)行為、教學(xué)內(nèi)容、教學(xué)資源、教學(xué)環(huán)境、教學(xué)服務(wù)、教學(xué)活動等要素的刻畫,來揭示“人—機—物—環(huán)境—活動”等教育情境要素對學(xué)生知識建構(gòu)、認知發(fā)展和情緒狀態(tài)的影響機制,以此探究學(xué)習(xí)發(fā)生的內(nèi)在機理(王一巖等,2021c)。其核心要點在于解釋什么樣的教育情境更有助于學(xué)生知識、認知、情感的發(fā)展,進而揭示外界環(huán)境對個體學(xué)習(xí)過程和學(xué)習(xí)結(jié)果的影響機理。例如:楊九民等(2020)采用眼動追蹤、學(xué)業(yè)測評和問卷測量的方法,探究視頻學(xué)習(xí)中教師形象、目光、手勢對于學(xué)生學(xué)習(xí)效果和學(xué)習(xí)體驗的影響機制;王雪等(2020)使用問卷測量、眼動儀和腦波儀的方法,探究教學(xué)視頻的視聽覺情緒設(shè)計對學(xué)習(xí)者的情緒、認知加工過程、認知負荷與學(xué)習(xí)效果的影響機制。未來,如何探究教育情境要素與學(xué)習(xí)者特征之間的動態(tài)映射關(guān)系,實現(xiàn)學(xué)習(xí)者特征與教育情境的智能匹配和動態(tài)調(diào)整,挖掘深層次的教育規(guī)律,進而為教育情境的優(yōu)化設(shè)計提供依據(jù),是可解釋學(xué)習(xí)者建模需要長期關(guān)注并解決的核心問題。但在此方面僅有部分學(xué)者分析了教育情境和學(xué)習(xí)者特征的關(guān)鍵維度,提出了“基于情境感知的學(xué)習(xí)者建模”的實踐框架(王一巖等,2022b;Huang et al.,2017),還沒有更為深入的技術(shù)實踐研究。究其原因,主要是對教育情境的全面感知實現(xiàn)難度較大,教育情境與學(xué)習(xí)者特征間的關(guān)聯(lián)關(guān)系又較為復(fù)雜,國家雖然在部署教育環(huán)境智能計算相關(guān)的研究項目,但目前尚未有系統(tǒng)化的解決方案。

四、可解釋學(xué)習(xí)者建模的應(yīng)用圖景

隨著各類智能教育產(chǎn)品的逐漸成熟和多源異構(gòu)教育數(shù)據(jù)的逐步積累,在教育教學(xué)活動中通過“人機協(xié)同”的方式實現(xiàn)人和機器的智能交互、協(xié)同工作、對話協(xié)商和共同決策已成為趨勢。在此背景下,可解釋學(xué)習(xí)者建模能夠增強教育主體對機器智能分析與決策的信任度和接受度,在人機協(xié)同模式下的學(xué)習(xí)、教學(xué)和管理活動中具有廣闊的應(yīng)用前景。

1.個體層面:實現(xiàn)全景化細粒度的教育診斷

對于人工智能教育應(yīng)用而言,需要在提升學(xué)習(xí)分析與診斷精準度的同時,加強對分析診斷結(jié)果的解釋和說明,以幫助學(xué)習(xí)者易于理解和接受機器的智能決策。可解釋學(xué)習(xí)者建模在個體層面的應(yīng)用主要體現(xiàn)在對教育診斷的全景化、細粒度呈現(xiàn)上,具體包括兩個方面:其一,利用學(xué)習(xí)分析儀表盤等方式(如知識圖譜、雷達圖、折線圖等)對學(xué)習(xí)者的知識結(jié)構(gòu)、認知水平、學(xué)科能力、學(xué)習(xí)態(tài)度、學(xué)習(xí)風(fēng)格等特征進行可視化呈現(xiàn),并對其學(xué)業(yè)表現(xiàn)進行精準預(yù)測,幫助學(xué)習(xí)者更加清晰地了解自身學(xué)習(xí)狀況。比如利用學(xué)科知識圖譜的形式對知識點之間的層次和關(guān)聯(lián)進行呈現(xiàn),根據(jù)學(xué)習(xí)者的學(xué)情診斷結(jié)果對其知識掌握情況進行評判,并在知識圖譜中用不同的顏色進行標(biāo)識,利用此種方式幫助學(xué)習(xí)者了解自身的知識薄弱點,并及時調(diào)整學(xué)習(xí)計劃和學(xué)習(xí)策略。其二,利用圖表和文字說明的形式,對機器智能診斷的邏輯、過程和目的進行清晰說明,幫助學(xué)習(xí)者了解智能決策的依據(jù),從而提升其接受教育診斷結(jié)果的意愿。例如,Conati 等(2021)開發(fā)的智能導(dǎo)師系統(tǒng)ACSP,利用可解釋人工智能的方法對學(xué)業(yè)問題的成因進行分析,并通過可視化的界面來呈現(xiàn)學(xué)業(yè)成績的計算規(guī)則、判斷理由和預(yù)測機制,以此來保證學(xué)習(xí)者對系統(tǒng)的信任度,提升學(xué)習(xí)者對系統(tǒng)有用性的感知;Chen 等(2022)提出了一種可解釋的學(xué)生表現(xiàn)預(yù)測智能分析框架,基于學(xué)生在虛擬學(xué)習(xí)環(huán)境中的學(xué)習(xí)活動數(shù)據(jù),利用混合神經(jīng)網(wǎng)絡(luò)模型對其學(xué)業(yè)表現(xiàn)進行分析與預(yù)測,并通過可視化和分析典型預(yù)測、學(xué)生活動圖和特征重要性的方式來提升預(yù)測結(jié)果的可解釋性。

2.學(xué)習(xí)層面:提供易理解可接受的學(xué)習(xí)干預(yù)

在以往的人機協(xié)同學(xué)習(xí)過程中,人工智能教育應(yīng)用對于學(xué)習(xí)者學(xué)習(xí)的干預(yù),主要通過對其知識結(jié)構(gòu)、認知水平、學(xué)習(xí)偏好的挖掘分析,實現(xiàn)學(xué)習(xí)者模型和學(xué)習(xí)資源之間的智能適配,以此為學(xué)習(xí)者提供個性化的資源推薦和學(xué)習(xí)路徑規(guī)劃服務(wù),幫助其實現(xiàn)個性化、自適應(yīng)的學(xué)習(xí)。此種學(xué)習(xí)干預(yù)模式一方面容易造成學(xué)習(xí)者對于智能學(xué)習(xí)服務(wù)不加辨別的盲從,另一方面也容易導(dǎo)致學(xué)習(xí)者對智能學(xué)習(xí)服務(wù)的質(zhì)疑和不信任,甚至產(chǎn)生“算法厭惡”。因此,無論是向?qū)W習(xí)者推薦個性化的學(xué)習(xí)資源、學(xué)習(xí)路徑、學(xué)習(xí)活動,還是為其提供自適應(yīng)的學(xué)習(xí)支架和學(xué)習(xí)改進策略,都應(yīng)該對相關(guān)干預(yù)措施進行充分的解釋說明,以此來提升學(xué)習(xí)者對人工智能教育應(yīng)用的信任度和使用意愿,從而增加其采納學(xué)習(xí)干預(yù)策略的可能性。例如,Barria-Pineda 等(2021)設(shè)計了具有視覺解釋和文本解釋功能的智能學(xué)習(xí)系統(tǒng),利用視覺解釋的方式讓學(xué)習(xí)者了解參與活動或解決問題所需要的概念,利用文本解釋的方式為學(xué)習(xí)者推薦學(xué)習(xí)活動,以此來增強學(xué)習(xí)者對智能學(xué)習(xí)系統(tǒng)所做出的學(xué)習(xí)干預(yù)策略的理解度和信任度;Afzaal等(2021)采用學(xué)習(xí)分析技術(shù)和可解釋機器學(xué)習(xí)方法對學(xué)習(xí)者的學(xué)業(yè)表現(xiàn)進行預(yù)測和原因解釋,并通過學(xué)習(xí)分析儀表盤的方式為其提供學(xué)習(xí)改進建議,幫助學(xué)生進行自我調(diào)節(jié)學(xué)習(xí)。

3.教學(xué)層面:推動高適配可實施的教學(xué)決策

在智能技術(shù)與教育教學(xué)深度融合的時代背景下,人機協(xié)同教學(xué)逐漸成為引領(lǐng)智能時代教學(xué)模式變革的核心思想,但機器智能決策的“不透明性”往往容易造成教師難以基于對機器生成的教學(xué)決策的充分理解去有針對性地制定便于實施的教學(xué)方案。因此,可解釋學(xué)習(xí)者建模在教學(xué)層面改進人機協(xié)同教學(xué)的應(yīng)用需聚焦兩個方面:一是通過對學(xué)習(xí)者的學(xué)業(yè)狀況和個體特征的全面分析和可視化呈現(xiàn),為教師提供便于實施的針對性教學(xué)改進建議;二是向教師充分解釋生成相關(guān)教學(xué)決策背后的原因,以及執(zhí)行相關(guān)決策后能在哪些方面、何種程度上提升學(xué)習(xí)表現(xiàn)和結(jié)果。例如,Ledeboer 等(2019)基于荷蘭中學(xué)智能教學(xué)系統(tǒng)中的數(shù)據(jù),利用隨機森林和前饋神經(jīng)網(wǎng)絡(luò)等方法構(gòu)建了預(yù)測學(xué)生留級率和畢業(yè)率的模型,并通過全局解釋和局部解釋的方式將分析結(jié)果呈現(xiàn)給教師,為教師教學(xué)決策的改進提供有效支持;Pereira 等(2021)利用學(xué)生在編程學(xué)習(xí)中的學(xué)習(xí)日志數(shù)據(jù)來預(yù)測其學(xué)業(yè)表現(xiàn),并利用基于博弈論的可解釋人工智能分析框架SHAP(Lundberg et al.,2017)實現(xiàn)對預(yù)測模型決策機制的全局和局部解釋和呈現(xiàn),幫助教師對編程學(xué)習(xí)的教學(xué)策略進行改進和優(yōu)化。

4.管理層面:助力綜合化高效能的教育管理

人機協(xié)同教育治理是實現(xiàn)教育治理現(xiàn)代化的必然路向,旨在將治理主體從自然人擴展到智能機器,通過人機交互、優(yōu)勢互補、高效合作,變革教育治理主體的結(jié)構(gòu)與關(guān)系,提升教育治理效能(陳星等,2022)。可解釋學(xué)習(xí)者建模在管理層面的應(yīng)用主要是通過對學(xué)習(xí)者家庭背景、學(xué)業(yè)狀況、智力水平、身體健康等數(shù)據(jù)的智能采集與匯聚,構(gòu)建面向區(qū)域?qū)用娴慕逃皵?shù)據(jù)大腦”,具體包括三個方面:其一,利用統(tǒng)計分析和數(shù)據(jù)可視化的方法為管理者直觀呈現(xiàn)區(qū)域內(nèi)學(xué)生的整體發(fā)展?fàn)顩r,包括學(xué)業(yè)水平、智力水平、體質(zhì)健康、競賽獲獎情況,等等;其二,利用數(shù)據(jù)挖掘的方法對影響學(xué)生學(xué)業(yè)發(fā)展和素養(yǎng)養(yǎng)成的核心要素進行分析,明確哪些要素會對教育質(zhì)量產(chǎn)生何種影響,以及其中的內(nèi)在邏輯;其三,通過對學(xué)生數(shù)據(jù)的智能分析,利用數(shù)據(jù)模擬的方法構(gòu)建相應(yīng)的預(yù)測模型,對未來一段時間內(nèi)區(qū)域教育的發(fā)展水平進行模擬與預(yù)測,制定智能化的應(yīng)對措施對教育發(fā)展的潛在風(fēng)險進行干預(yù)和防控,并通過圖表和文字的方式解釋措施制定的內(nèi)在原因。例如,Yakunin等(2019)基于哈薩克斯坦國家教育數(shù)據(jù)庫中兩萬多所中學(xué)的數(shù)據(jù),構(gòu)建學(xué)校教育質(zhì)量的預(yù)測模型,利用局部解釋的方式呈現(xiàn)地理位置、學(xué)校設(shè)施、人口組成、教職工特征與學(xué)生成績和大學(xué)錄取率的關(guān)系,進而為國家教育政策的制定提供可行建議。

五、可解釋學(xué)習(xí)者建模的研究展望

總體而言,可解釋學(xué)習(xí)者建模對于還原教育過程、刻畫學(xué)生特征、揭示學(xué)習(xí)機理、優(yōu)化教育決策具有重要意義。然而,當(dāng)前可解釋學(xué)習(xí)者建模的相關(guān)研究仍處于起步階段,要真正推動其在教育教學(xué)實踐中的落地,還需要在明確可解釋學(xué)習(xí)者建模核心價值的基礎(chǔ)上,加強建模理論研究、分析方法創(chuàng)新和實踐應(yīng)用探索。

1.推動多學(xué)科交叉的可解釋學(xué)習(xí)者建模理論研究

可解釋學(xué)習(xí)者建模是可解釋教育人工智能研究的核心,旨在打破人工智能的“算法黑箱”,提升機器智能分析與決策的“透明度”,破除教育主體對機器的“信任危機”,實現(xiàn)學(xué)習(xí)者的可表征、可理解、可干預(yù),從而為教育的數(shù)字化轉(zhuǎn)型和智能化變革提供有效支持。但從目前來看,其在相關(guān)建模理論上的研究仍有待加強:一方面,由于對學(xué)習(xí)者特征的認知存在偏差,對影響學(xué)業(yè)發(fā)展的核心要素及相關(guān)特征之間的關(guān)系認識不清晰,往往造成對學(xué)習(xí)者特征難以準確把握和精準刻畫;另一方面,由于學(xué)習(xí)者個體的復(fù)雜性和特征的多樣性,單一學(xué)科的理論難以支撐學(xué)習(xí)者建模的現(xiàn)實需要,有必要綜合多學(xué)科的理論來實現(xiàn)對復(fù)雜學(xué)習(xí)現(xiàn)象的深入詮釋。因此,未來需要在加強人工智能技術(shù)方法和標(biāo)準規(guī)范研制的基礎(chǔ)上,利用教育學(xué)、心理學(xué)、認知科學(xué)、腦科學(xué)、系統(tǒng)科學(xué)等領(lǐng)域的相關(guān)理論對真實情境下的學(xué)習(xí)過程進行深入分析,從“行為—生理—心理—神經(jīng)”等多個層次還原學(xué)習(xí)者的本質(zhì)特征,更加準確和清晰地揭示學(xué)習(xí)發(fā)生的內(nèi)在機理,從而為學(xué)習(xí)干預(yù)、教學(xué)改進、教育評價、教育管理等實踐問題提供可解釋的解決方案。

2.強化基于科學(xué)智能的可解釋學(xué)習(xí)者建模方法研究

可解釋學(xué)習(xí)者建模遵循“指標(biāo)設(shè)計—數(shù)據(jù)感知—特征刻畫—模型構(gòu)建—機理探究”的研究路線,主要依賴教育專家從實踐經(jīng)驗出發(fā)確定需要收集的學(xué)習(xí)者數(shù)據(jù),并基于此進行智能化的分析和建模,從而建立“數(shù)據(jù)模型”和“客觀世界”之間的橋梁。然而,此種方法從根本上還是遵循教育經(jīng)驗來進行學(xué)習(xí)者模型的建模和分析,無法脫離研究者自身思維和認知的局限性。當(dāng)前人工智能領(lǐng)域提出“AI for Science”的概念,即科學(xué)智能,旨在讓AI幫助人類在海量的數(shù)據(jù)中迅速找到規(guī)律,構(gòu)建起模型與數(shù)據(jù)雙向驅(qū)動的研究范式,再通過人類的介入對AI分析結(jié)果中的謬誤進行甄別,并從中篩選出真正有實踐價值和推廣意義的規(guī)律,從而推動科學(xué)的發(fā)展。未來可解釋學(xué)習(xí)者建模研究可以參照科學(xué)智能的思想,讓人工智能幫助研究者分析學(xué)習(xí)者數(shù)據(jù)、提取學(xué)習(xí)者特征、構(gòu)建學(xué)習(xí)者模型并挖掘其中蘊含的規(guī)律,之后再由研究者對分析結(jié)果進行鑒別和甄選,以此推動可解釋學(xué)習(xí)者建模的科學(xué)化、智能化發(fā)展。

3.加強基于智能產(chǎn)品的可解釋學(xué)習(xí)者建模實踐研究

可解釋學(xué)習(xí)者建模的應(yīng)用需要通過智能教育產(chǎn)品來實現(xiàn),其基于學(xué)習(xí)者模型提供精準化的學(xué)業(yè)問題解決方案,能夠在很大程度上提升教育服務(wù)供給能力,促進教育規(guī)模化和個性化的協(xié)調(diào)統(tǒng)一(王一巖等,2021d)。然而,個體對機器決策的“信任危機”也成為阻礙智能教育產(chǎn)品推廣的壁壘,這一問題的解決在很大程度上取決于是否能讓學(xué)生、教師和管理者充分理解、接受并采納智能分析與決策。因此,未來智能教育產(chǎn)品的研發(fā)除了需要強化分析與決策的精準度外,還需要加強智能分析、診斷與干預(yù)的“可解釋性”,來幫助利益相關(guān)者充分理解智能決策的邏輯和依據(jù),增強對智能教育產(chǎn)品的信任度,以此來保證智能技術(shù)教育應(yīng)用的有效落地,推動智能技術(shù)與教育教學(xué)的深度融合。