融合Stacking 和深度學習的中文產品評論情感分析

方 紅, 蔣廣杰, 李德生, 沙雷雨馨

(1. 上海第二工業大學a. 數理與統計學院;b. 資源與環境工程學院;c. 計算機與信息工程學院,上海 201209)

0 引言

近年來,電商平臺飛速發展,網上購物已成為用戶的主流消費方式, 研究表明, 81% 的用戶在進行網購前至少一次在網絡平臺上搜索過該商品[1],產品評論為瀏覽者提供了意見參考。對平臺上的大量用戶評論進行情感分析,可以有效幫助企業了解用戶的產品偏好,提高用戶滿意度[2]。情感分析(sentiment analysis, SA) 也叫觀點挖掘(opinion mining,OM),是自然語言處理研究的熱點問題之一,主要是判別給定文本中蘊含的情緒、觀點或意見[3]。情感極性二分類是情感分析中的基礎任務之一[4],即識別文本數據中情感持有者的情感極性是積極的還是消極的, 除此之外, 還有多分類情感極性分析任務,例如情感極性三分類任務在二分類的基礎上將數據集中增加了識別情感極性為中性的文本數據。而從文本角度來看,進行情感分析的文本可以是一篇文章、幾句話、一個特定的詞語(方面),因而又可將文本情感分析任務劃分為篇章級、句子級、方面級3個級別[5]。

情感分析應用領域十分廣泛,目前的情感分析方法主要有以下3 類:

第1 類情感分析的方法是基于詞典,即針對某一特定領域建立專門的情感詞典用于情感分析。對英文的情感分析研究早于中文,國外最早出現的英文情感詞典是SentiWordNet,其他常用的有Opinion Lexicon 和MPQA (Question and Answer from Multiple Perspectives) 等, 中文應用比較廣泛的情感詞典有知網詞典HowNet 和大連理工大學的中文情感詞匯本體庫等, 此外, 也有一些其他語種詞典研究。Tran 等[6]提出一種適用于越南語的情感詞典,涵蓋了超10 萬個越南語的情感詞匯;Wu 等[7]利用網絡資源建立了一部俚語詞典SlangSD, 來判別用戶的情緒。但基于情感詞典的研究方法通常具有領域局限性,遷移性不好,在一些新興領域,詞典的更新與維護還要耗費一定的人力與物力。

第2 類情感分析法是基于機器學習算法, 比如樸素貝葉斯[8](naive bayesian,NB)、支持向量機[9](support vector machine,SVM)、極限梯度提升樹[10](extreme gradient boosting, Xgboost) 等機器學習算法。其中,SVM 是早期業界公認在使用傳統機器學習算法處理文本情感分析任務中具有良好性能的模型[11]。Ahmad 等[12]使用SVM 在3 個推文數據集進行情感極性多分類任務并取得了不錯的效果;Cai 等[13]使用基于Stacking 集成思想的混合模型將SVM 和GBDT 集成在一起進行情感分析, 取得了比單一模型更好的分類效果。但使用傳統的機器學習算法對文本進行情感分析任務時有時并不能充分利用文本中的語境信息,因此對預測效果有一定的影響。

第3 類情感分析方法是基于深度學習, 比如卷積神經網絡[14](convolutional neural network,CNN)、長短期記憶網絡[15](long short-term memory,LSTM)、雙向長短期記憶網絡[16-17](bi-directional long short-term memory,BiLSTM)、基于transformer的雙向編碼器[18](bidirectional encoder representation from transformers,BERT)等。2020 年,Li 等[19]提出了一種具有自注意機制和多通道特征的雙向LSTM 模型SAMF-BiLSTM, 并在5 個公共英文數據集上進行情感極性二分類、情緒五分類和十分類任務, 其分類準確率相差較大, 模型效果并不穩定; 2021 年, Behera 等[20]建立了一個與領域無關的情感分析模型CO-LSTM 模型, 并在4 個公用英文數據集上進行情感極性二分類和三分類任務,實驗取得了較好的準確率;2021 年,Basiri 等[21]提出融合不同算法的混合集成模型,在百萬規模的推文數據上進行情感分析實驗,實現了不錯的分類準確率; 2020 年, Cai 等[22]提出了BERT-BiLSTM 的模型用于10 萬條中國能源市場中投資者和消費者評論的情感極性二分類, 實驗達到86.2% 的準確率;2021 年,Li 等[23]提出了BERT+FC 模型用于9 204條中國股票評論進行情感極性二分類任務,達到了92.56%的準確率。2022 年,楊春霞等[24]提出基于BERT 與注意力機制Attention 的方面級隱式情感分析模型DCAB 模型, 該模型首先用AABERT 生成與方面詞相關的詞向量, 接著使用DBGRU 進行編碼,再使用語境感知注意力機制提取上下文中與給定方面詞相關的深層特征信息,實驗效果優于基線模型。2023 年, 胡曉麗等[25]提出一種融合ChineseBERT 和雙向注意力流(bidirectional attention flow,BiDAF)的中文商品評論方面情感分析模型,該模型主要將Transformer 和雙向注意力流的輸出同時輸入到多層感知機中,進行信息級聯和情感極性的分類輸出,并在其中一個數據集上達到82.90%的識別準確率。深度學習算法在處理海量文本數據時比較有優勢,而且能夠取得不錯的分類效果。

由上述分析可知,相較于英文,當前中文情感極性分類任務以二分類居多,其分類任務細粒度和分類準確率還有很大的上升空間。針對該問題,本文依托京東網站上真實的手機評論建立了一個中文電商產品評論數據集Q, 該數據集包含積極評論、消極評論和中性評論,3 類評論,其中的中性評論定義為包含積極情緒與消極情緒的復合語句。同時,一些機器學習算法和深度學習算法在許多工程應用的分類問題中取得了不錯的效果,但單一模型的效果并不穩定, 模型的泛化能力有待進一步提升。針對該問題,文中提出一種新的混合深度學習算法和機器學習算法的中文情感分析方法, 該方法使用Stacking 集成學習思想, 在第1 層使用Chinese-BERT-wwm、TextCNN、BiLSTM 對訓練集數據進行特征信息提取, 捕獲中文文本數據上下文的語境、語義、語序重點特征信息,得到具有不同中文評論特征信息的句子代表向量,將其進行拼接得到含有豐富句子特征信息的特征融合向量,然后將SVM 作為第2 層添加到模型中,對第1 層得到的特征向量進行分類, 實現最終的情感極性分類。通過在數據集上驗證,新的方法使得情感分析過程中提取到的每條文本數據的信息更加豐富,提高了中文情感極性分類的準確率,能夠為后續方面級別的情感分析任務提供更好地支撐。

1 融合Stacking 集成學習和深度學習技術的模型

1.1 Stacking 算法與模型框架

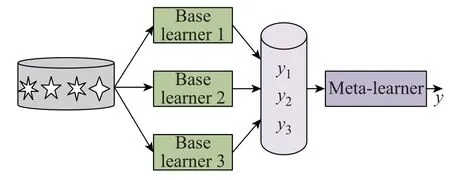

集成方法是一組結合了個體預測(單個模型)的學習模型。根據三向決策[26]理論,屬于一個分類器的低置信度決策區域的數據樣本可能屬于另一個分類器的高置信度決策區域。使用不同的分類器可以提高分類系統的整體置信度,提高結果的準確性,提升模型的泛化能力。Stacking 集成算法在1992 年被Wolpert 提出[27],包含基學習器和元學習器2 層。其基學習器結構理論上要求是異構的,即所采用的基學習器來自于不同的學習算法,并且分類結果具有的一定的準確性[28]。如圖1 所示,3 個不同類型的基學習器使用相同的數據集來訓練,其他算法可以作為元學習器。其中元學習器對基學習器的輸出y1、y2、y3進行進一步學習得到最后的輸出結果yc。

圖1 3 個基學習器的Stacking 集成示意圖Fig.1 Stacking integration diagram of three base learners

為了評價中文電商產品評論文本中情緒的整體表現, 本研究提出了一種新的融合Stacking 集成學習和深度學習技術的情感分析模型,模型結構如圖2 所示,該模型總體分為2 層: 第1 層為文本特征提取層, 包括3 個深度學習算法, 主要是取得豐富的文本信息特征,通過將句子分別輸入Chinese-BERTwwm、TextCNN、BiLSTM 三基分類器學習,分別提取評論中的語義、語序等重要信息特征并將其融合,形成最終的表示向量作為元分類器的輸入; 第2 層是一個經典的有監督分類算法SVM,實現對其特征的情感極性分類,SVM 應用在文本情感情感分析中有較好的分類效果,但SVM 未能深入提取文本中的語義信息,應用集成學習思想同時結合深度學習算法可以克服這個問題,進一步提高分類準確率。

1.2 文本信息特征提取層

文本信息特征提取層使用深度學習算法, 關鍵是如何提取語義特征并融合信息,本研究在該層考慮了Chinese-BERT-wwm、TextCNN、BiLSTM,3 個基學習器。評論文本輸入到中文BERT 即Chinese-BERT-wwm 得到768 維度的句子表征向量,取倒數第2 層記作Vi1。

對于TextCNN 和BiLSTM,首先使用Tokenizer編碼將預處理后的中文電商產品評論文本序列化,然后經過embedding 層進行向量化, 設置最大句子長度128, 詞向量維度128, 將該128×128 的句子向量矩陣分別輸入到TextCNN 和BiLSTM 中進行文本特征信息提取,其中TextCNN 利用一維卷積法提取文本情感極性分類任務中的重要字詞語義特征信息,卷積層共設置3 個不同大小的卷積核,每個通道中卷積核的數量設置為256 以學習不同的特征和獲得更多的特征信息,核大小分別為3、4、5。然后通過最大池化操作進一步抽取局部關鍵語義特征信息,將3 個向量矩陣進行拼接,經過Flatten 一維扁平化和dense 層降維,取倒數第2 層維度為128 的特征向量Vi2。

BiLSTM 用于從前后2 個方向捕獲更深層次的上下文語義信息,將embedding 后的向量矩陣輸入到BiLSTM 中, 經過dense 層降維, 取倒數第2 層128 維度的句子表征向量Vi3。

將Vi1、Vi2和Vi3拼接融合,該1 024 維的文本信息特征向量記為Vi。特征提取層引入Dropout 層,設置dropout 值為0.1,隨機丟棄一些激活參數,選擇一些神經元將其設置為零,迫使神經元在不相互依賴的情況下獨立提取合適的特征,有助于緩解模型過擬合問題[29]。

在接下來的小節中,將描述每種分類方法。

1.2.1 Chinese-BERT-wwm

最初的BERT 預訓練模型[30]由谷歌于2018年提出, 在SA 的任務中, BERT 在面對一些陌生且更復雜的句子上取得了比以往的詞向量模型更好的性能[31]。后面谷歌為中文提供了BERT 模型BERT-base, Chinese, 并使用全詞Mask 技術(whole word masking, WWM)作為預訓練階段的訓練樣本生成策略,在BERT-base,Chinese 中,中文是以字為粒度進行切分, 沒有考慮到傳統NLP 中的中文分詞(Chinese word segmentation, CWS), 模糊了中文完整詞語的邊界。2021 年, Cui 等[32]基于谷歌的研究工作針對中文提出了一系列中文BERT 模型,Chinese-BERT-wwm 就是其中之一。Chinese-BERTwwm 模型考慮了中文分詞, 將WWM 技術應用在中文環境中, 使用中文維基百科(包括簡體和繁體)進行訓練, 并且使用了哈工大的語言技術平臺LTP(http://ltp.ai)作為分詞工具。

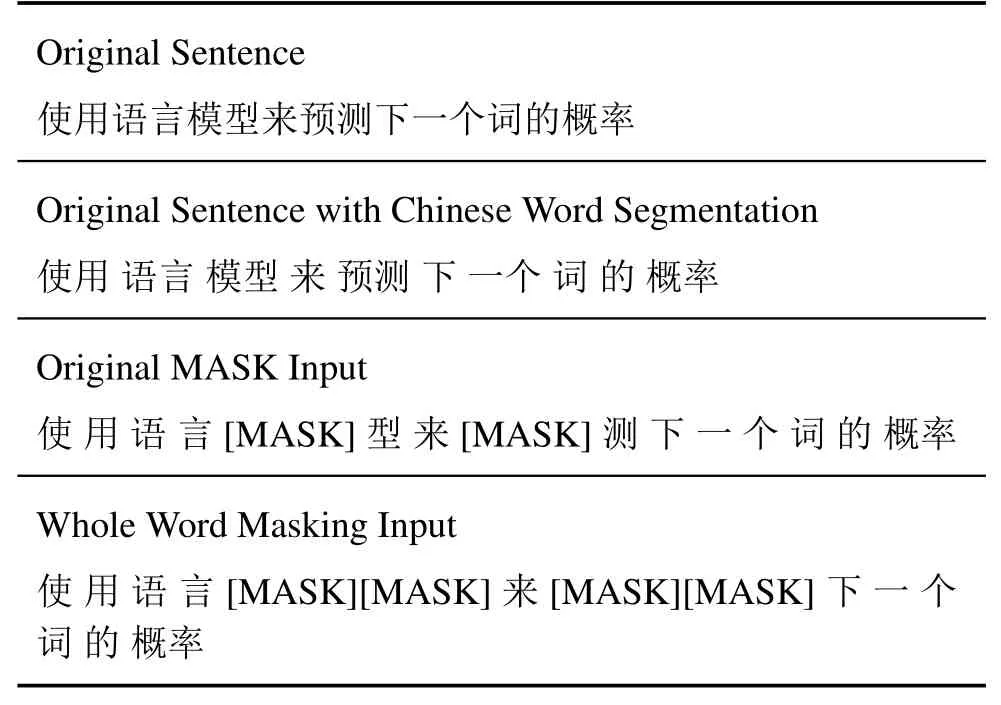

Chinese-BERT-wwm 模型中, WWM 是指如果一個詞語的部分字被Mask 替換,則對應詞語的剩余漢字部分也全被Mask 替換。Mask 包括用[MASK]標簽替換、保留原始字詞, 或隨機替換為另一個字詞, 這增強了Chinese-BERT-wwm 模型捕捉詞語間邊界關系的能力。對于中文文本數據, Chinese-BERT-wwm 模型具有更靈活和穩健的中文文本特征信息提取能力。以一個中文句子中一個詞其余部分被替換為[MASK] 標簽為例展示使用WWM 的句子生成樣例, 如表1 所示。Chines-BERT-wwm 的輸出是一個768 維的動態向量, 以[CLS]作為整個句子開始的向量化表示。

表1 1 個分詞后的中文句子使用WWM.的樣例Tab.1 Example of using WWM.for a Chinese sentence after a word break

1.2.2 TextCNN

TextCNN 模型由Kim 等[14]提出,是CNN 模型的變體,在CNN 的基礎上增加了不同卷積核大小的卷積通道,增強了其捕獲文本不同長度字詞關鍵特征信息的能力,TextCNN 主要結構包括以下4 層。

TextCNN 的第1 層為輸入層,包含1 個句子向量矩陣E ∈Rn×d,n表示固定的最大句子長度,d表示詞向量維度,ei表示句子中第i個字詞,ei ∈Rd表示句子中第i個字詞的d維詞向量,長度為n的句子E可以表示為

TextCNN 的第2 層為卷積層,TextCNN 中可以使用不同高度的卷積核進行多通道局部語義信息特征的提取,保證特征的多樣性,本文設置3 個不同的卷積核高度。將卷積核K ∈Rk×d由上至下滑動與句子向量矩陣E中全部詞向量進行一維卷積操作輸出特征映射(Feature mapping)

式中,卷積核寬度與輸入層中詞向量維度保持一致,均為d,k代表卷積核高度。

TextCNN 的第3 層是池化層。池化對C進行壓縮以保留主要特征,同時去除冗余信息,提高速度。標準的池化方法包括最大池化(Max pooling)、均值池化(Mean pooling)等。本文使用1-Max pooling 最大池化方法取C的最大值C′=max{C},并拼接所有卷積核的池化結果得到更具代表性的新的特征向量Z作為輸出層的輸入,即

式中,t為卷積核總數量。

TextCNN 的第4 層是輸出層。輸出層通過Softmax 函數計算每個類別的概率分布,使用交叉熵損失函數。

1.2.3 BiLSTM

與傳統的RNN 相比,LSTM 通過引入一種特殊設計的門機制和單元狀態確定輸出特征信息的有效性。1 個LSTM 單元包含1 個輸入門、1 個遺忘門、1個輸出門和1 個貫穿整個時間步長的單元狀態,其結構可分別表示為:

式中:t時輸入記為st;t時輸出記為ht;oi表示輸出門t時輸出;Ct表示當前的單元狀態; ~Ct當前時刻待更新的單元狀態;it表示輸入門t時輸出;ft表示遺忘門t時輸出;w表示在計算過程中不斷更新的權重;b表示在計算過程中不斷更新的偏差項;σ代表Sigmoid 函數;⊙表示對應位置元素乘法。

而BiLSTM 由前向LSTM 和后向LSTM 組成,在BiLSTM 中,后向LSTM 可以逆時間順序捕獲后文對前文影響的特征信息并與前向LSTM 編碼的特征信息進行拼接,因此,BiLSTM 可以更好地提取到雙向語義特征,它們是真正基于上下文從而使得提取的特征更具有代表性,一個BiLSTM 神經元輸出二維隱層狀態向量的連接向量為

式中:為t時刻前向LSTM 編碼的前向隱層向量,包含從左到右的序列信息特征;為t時刻后向LSTM 編碼的后向隱層向量,包含從右到左的序列信息特征;Ht是雙向LSTM 單元在t時刻的隱藏狀態的輸出拼接向量,包含雙向序列特征。

1.3 文本情感極性分類層

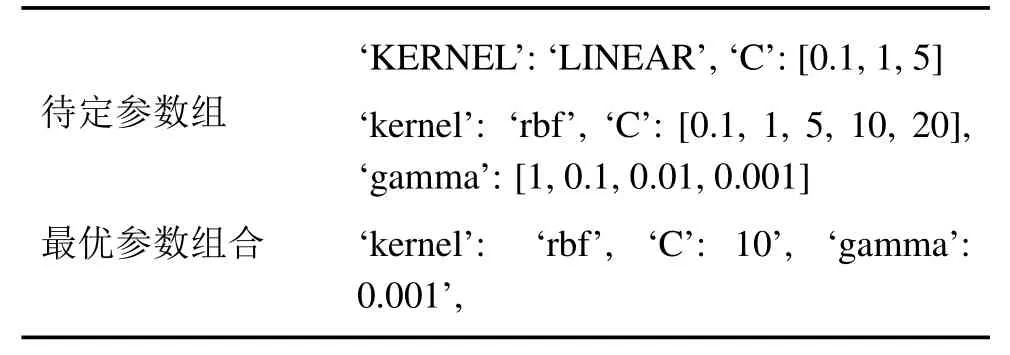

本研究選擇SVM 作為情感極性分類層中的元學習器。SVM 由Vapnik 等[9]提出, 是經典的統計機器學習算法之一,它通過尋找最優超平面實現樣本的二分類,同時可以使用核函數將原始的特征空間映射至更高維空間解決非線性樣本分類問題,在文本情感極性分類任務中相對高效。本文給出核函數及其超參數組合,通過三折交叉驗證和網格搜索方法選出該層最優的參數組合, 如表2 所示。其中,rbf 是徑向基核函數;C 和gamma 是SVM 的超參數;實驗表明當C 取10;gamma 取0.001 時,SVM 在訓練樣本數據上有更好的效果。

表2 情感極性分類層參數選擇Tab.2 Selection of affective polarity classification layer parameters

2 實驗和分析

2.1 數據集

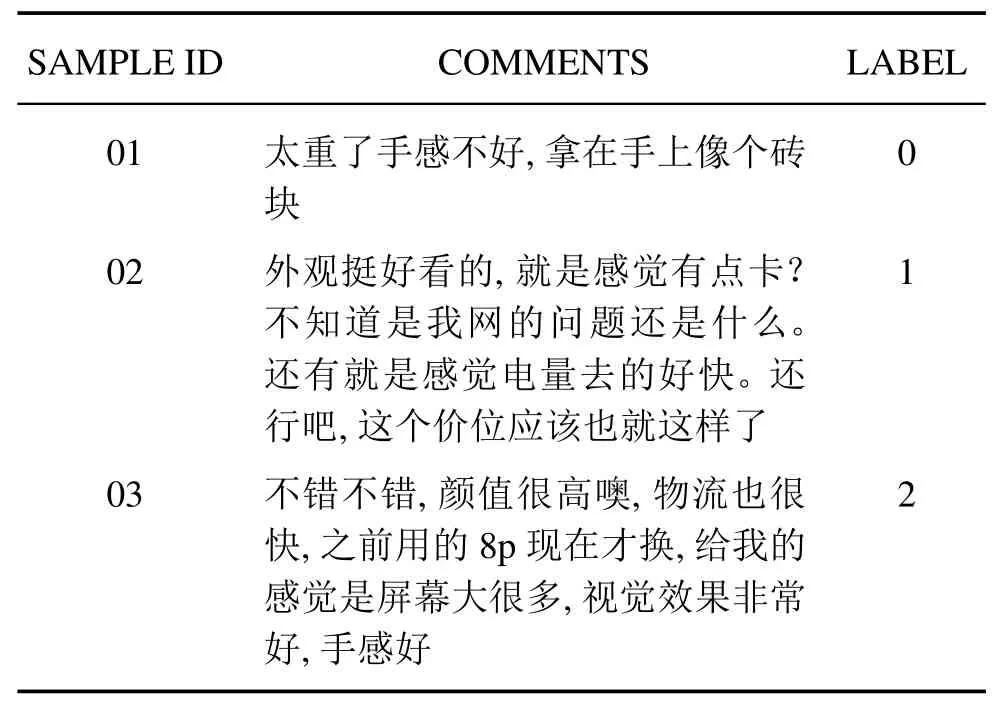

本文數據集來自從京東網站上爬取多個品牌手機購買的真實用戶評論,經人工標簽校正構建了一個新的中文電商產品評論數據集,該數據集共3 萬條, 包含消極評價、中性評價和積極評價3 種情感極性各1 萬條,其中消極評價與積極評價定義為只包含消極、積極各一種情感極性的評論,中性評價定義為包含用戶消極評價與積極評價的復合評論,可廣泛用于中文情感分析領域。消極評價、中性評價和積極評價標簽分別是0、1 和2,部分評論展示如表3 所示。

表3 電商產品評論數據集部分數據Tab.3 Partial data of E-commerce product review dataset

2.2 評價指標

本文按照2:1 劃分訓練集與測試集,并使用宏平均準確率值Acc_macro 和宏平均F值F-macro 作為模型的評價指標,其計算式分別為:

2.3 實驗環境及對比模型

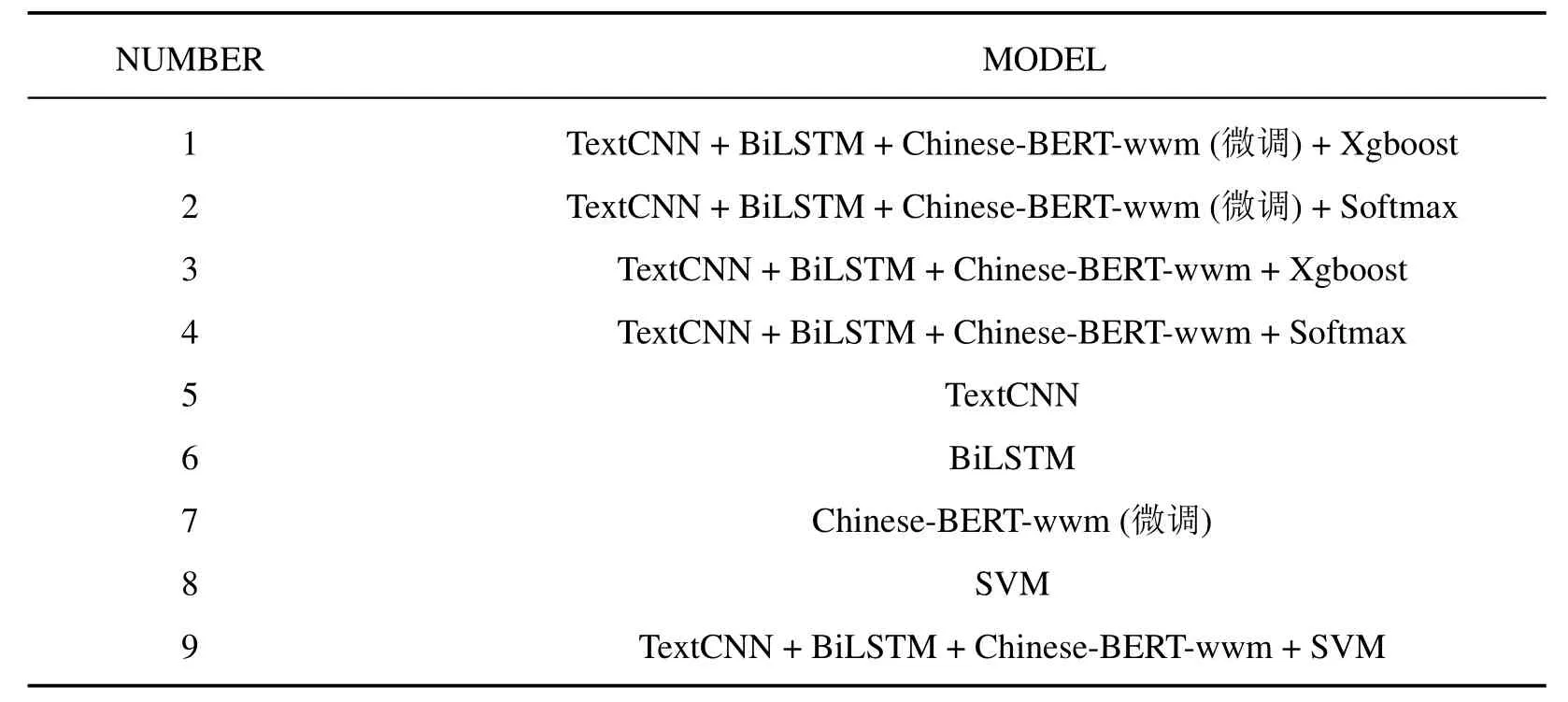

為了評估所提模型的有效性與泛化能力, 文中從特征提取層和分類層2 個方面設置了對比實驗,對比實驗考慮了直接對文本信息特征提取層用Softmax 函數進行分類和在分類層使用Xgboost[10]作元學習器時模型的性能變化, 并對比了基學習器算法TextCNN、BiLSTM、Chinese-BERT-wwm,元學習器SVM 單獨的模型分類效果及基學習器中Chinese-BERT-wwm 不使用訓練集進行預訓練對模型分類效果的影響, 實驗均基于Python3 中的Tensorflow 框架進行,訓練批次為128,各個對比模型及其實驗編號設置如表4 所示。

表4 對比模型列表Tab.4 List of comparison model

2.4 實驗與結果分析

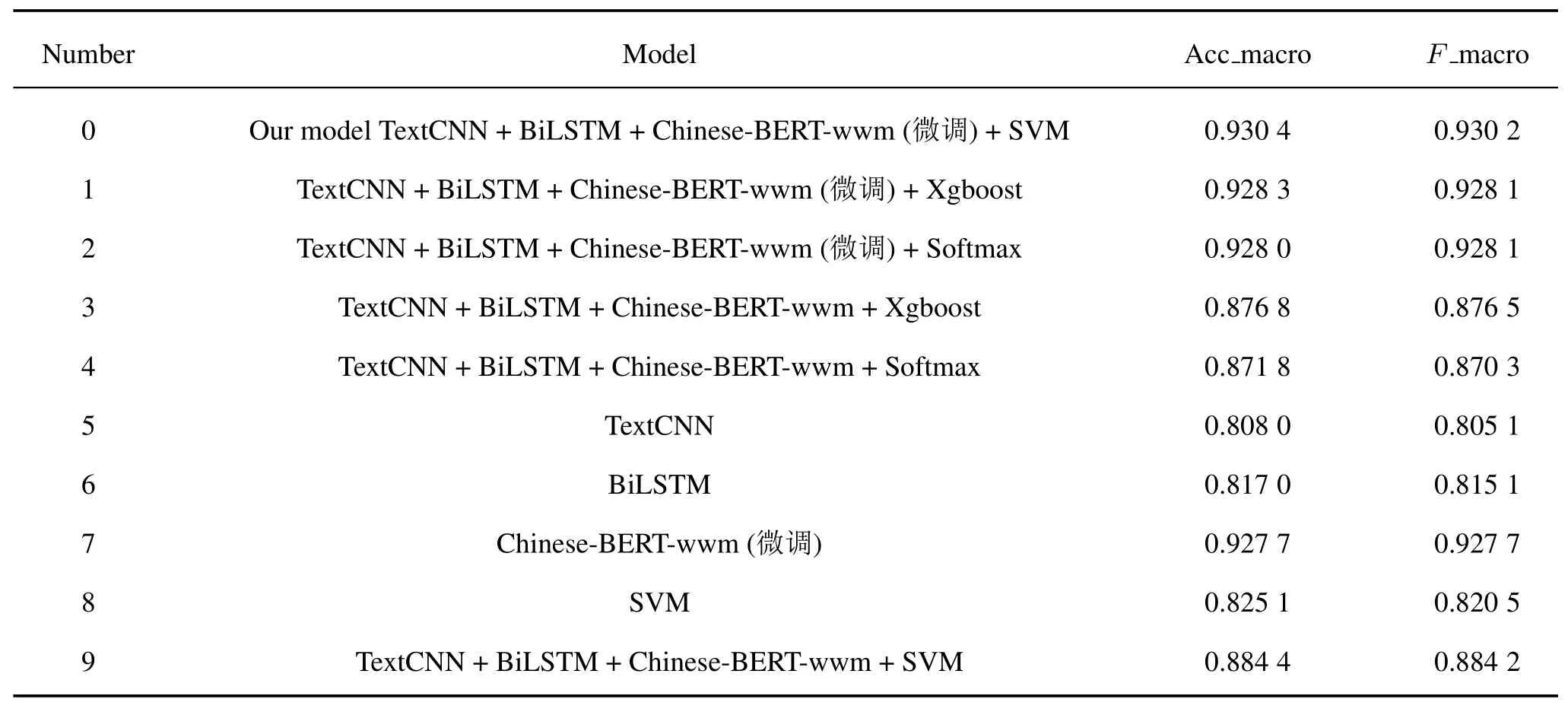

表5 展示了基線模型與本文提出的模型在1 萬條電商產品評論文本測試數據集上預測的情感極性分類效果。為了更直觀的觀察模型效果,做柱狀圖如圖3 所示。

表5 提出的模型與基線模型性能對比Tab.5 Performance comparison between the proposed model and the baseline model

圖3 基線模型與提出模型分類效果柱狀圖Fig.3 Baseline model and proposed model classification performance bar chart

由表5 和圖3 可見,在第0 組實驗中,本文提出的模型Acc_macro 值可以達到93.04%, F-macro 值達到93.02%, 與第1、第2 組實驗相比, 使用SVM做分類層比使用Xgboost 和直接對特征提取層的融合特征向量直接分類的評價指標均有所提高, 而與第5~8 組TextCNN、BiLSTM、Chinese-BERT-ww 和SVM 單個算法的分類效果相比,Acc_macro、F_macro 值最大可以提高10% 以上,這表明使用集成思想將深度學習算法與監督學習算法SVM 相結合的思路是正確并有效的,本文提出的模型具有更好的分類準確性和穩健性。另外,將第0組與第9 組實驗、第1 組與第3 組實驗、第2 組與第4 組實驗結果依次兩兩相比發現,在集成模型特征提取層使用微調后的Chinese-BERT-wwm 對模型效果有著顯著的提升,Acc_macro 值、F_macro 值從87%~88%提高到92%~93%,這證明了使用相關的語料庫對Chinese-BERT-wwm 進行預訓練可以提高模型預測的準確度,增強模型的泛化能力。

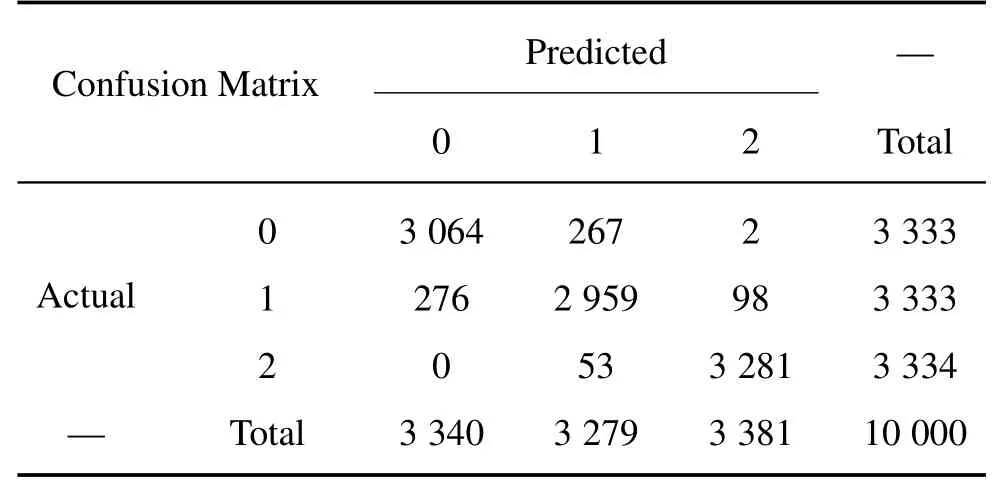

進一步對文中提出的模型在各類別分類預測的效果進行統計,1 萬條測試數據中,其中消極評論和中性評論各3 333 條,積極評論3 334 條,得到混淆矩陣(Confusion Matrix)如表6。

表6 提出的模型中對不同極性評論的預測效果Tab.6 Prediction of different polarity comments in the proposed model

在表6 中,測試集中3 333 條消極評價數據預測為積極評價僅有2 條,預測為中性評價267 條;3 334條積極評價預測為消極評價是0 條, 預測為中性評價是53 條; 3 333 條中性評價預測為真的數據量是2 959, 誤判374 條, 其中276 條被誤判為消極評價, 98 條被誤判為積極評價, 可以看出積極評論與消極評論互相誤判的概率很小,而二者與中性評論誤判的概率稍大,計算得到模型預測消極評價的準確率是91.93%, 預測積極評價的準確率是98.41%,而預測中性評價的準確率是88.78%, 可見模型對積極評論最為敏感, 預測準確率最高, 對中性評價最不敏感, 預測的準確率最低, 拉低了模型最終的Acc_macro,分析數據集可知文中用到的中性評論包含用戶對商品的積極情緒和消息情緒兩種情緒,相對于積極評論和消極評論情感詞多有變化且句式更加復雜,這在一定程度上可能增加模型對中性評價學習與預測的困難程度,因此導致了預測中性評價的誤判率高于另外2 類。

3 總結與展望

針對當前中文電商產品評論數據多為2 種單極性的情況, 本文依托電商平臺構建了一個真實的3 類別中文電商產品評論數據集, 并提出了使用Stacking 集成學習將能夠多維度提取豐富的文本數據信息特征的Chinese-BERTwwm、TextCNN、BiLSTM 3 類深度學習算法與傳統高效的有監督機器學習算法SVM 相結合構建新的模型的思想,和基線模型的實驗結果比較,提出的模型在分類預測準確度和泛化能力上表現更好,使用相關領域的語料庫預訓練Chinese-BERT-wwm 對提高模型性能也是必要的,通過該模型可以有效識別出電商產品中的積極評論、消極評論和中性評論三類評論。但不足之處在于模型對于中性評論的識別準確率還有待提高,需要進一步的研究與探索,并且使用Chinese-BERT-wwm 訓練文本數據的時間相對其他模型長,未來可以研究輕量化的中文BERT 以提高模型運行效率。