基于時序異常檢測的動力電池安全預警

張安勤,王小慧*

基于時序異常檢測的動力電池安全預警

張安勤1,2,王小慧1*

(1.上海電力大學 計算機科學與技術學院,上海 201306; 2.汕頭大學地方政府發展研究所,廣東 汕頭 515063)(?通信作者電子郵箱y21208007@mail.shiep.edu.cn)

電動汽車由于電池內部異常情況無法得到及時預測與預警,易導致事故發生,給駕駛員和乘客的生命和財產安全帶來嚴重威脅。針對上述問題,提出基于Transformer和對比學習的編碼器解碼器(CT-ED)模型用于多元時間序列異常檢測。首先,通過數據增強構造一個實例的不同視圖,并利用對比學習捕獲數據的局部不變特征;其次,基于Transformer對數據從時間依賴和特征依賴兩方面進行編碼;最后,通過解碼器重構數據,計算重構誤差作為異常得分,對實際工況下的機器進行異常檢測。在SWaT、SMAP和MSL這3個公開數據集和電動汽車動力電池(EV)數據集上的實驗結果表明,所提模型的F1值對比次優模型分別提升6.5%、1.8%、0.9%和7.1%。以上結果表明CT-ED適用于不同實際工況下的異常檢測,平衡了異常檢測的精確率和召回率。

時間序列;異常檢測;對比學習;多頭注意力;自動編碼器

0 引言

由于溫室效應,新能源汽車逐漸取代燃油汽車成為綠色出行的工具。電池作為汽車最主要的構成部分存在老化和濫用而導致爆炸的危險[1]。駕駛人的不良習慣可能會損害電動汽車動力電池的性能,因此需要對整車數據進行監控,對異常情況進行及時預警。

對于電池故障預警,研究人員基于實驗室電池故障數據形成了初步的理論體系和解決方案。然而在電動汽車實際應用過程中運行工況的變化復雜,實驗條件下所建立的風險報警機制難以應對實車工況下多因素耦合的故障現象[1]。并且傳統電池診斷的方法大都需要進行特征工程,依賴人工設計的特征提取方法,需要有專業知識,同時每個方法都是針對具體故障,泛化能力及魯棒性較差。

近年來,深度學習和大數據技術在醫學、交通、自然語言領域均得到廣泛應用,在新能源汽車領域也展現出良好的應用前景。深度學習主要是數據驅動進行特征提取,根據大量樣本的學習得到深層的、數據集特定的特征表示,對數據集的表達更高效和準確,所提取的抽象特征魯棒性更強,泛化能力更好。其中,多元時間序列異常檢測技術通過監測物聯網運營產生的大量高維傳感器數據,檢測數據是否含有不符合預期趨勢的行為,及時發現機器的故障并修理[2],避免了故障機器持續運行而產生更大的損耗,推動了現代工業和智慧城市的發展。電動汽車在實際運行中,也產生了大量多維時間序列,因此可以將時間序列異常檢測領域的技術和大數據背景下的動力電池故障預警結合起來,監測電動汽車在行駛狀態下的動力電池數據,對異常情況進行及時預警。

實際工況下的時間序列異常檢測通常存在如下挑戰:1)數據通常是沒有標簽的,并且異常類型繁多;2)傳感器在運行過程中和數據傳輸到系統中都會產生噪聲,可能導致模型產生錯誤報警;3)現有的異常檢測方法大都需要人工設定閾值。大量研究使用無監督模型重構數據,利用重構誤差作為異常指標判斷數據,通常訓練數據為不包含異常的正常數據,因此模型可以學習到傳感器的正常行為模式,對異常數據進行重構時可能產生較大誤差,從而檢測到異常情況。傳感器的正常行為模式通常是不變的,若數據分布產生變化,可以參考文獻[3]中使用遷移學習訓練新的模型,實現模型的動態更新。經典的無監督模型,比如基于聚類的K均值算法忽視了數據的時間依賴,而能捕獲時間相關性的基于循環神經網絡(Recurrent Neural Network, RNN)[4]的相關模型缺少對特征之間依賴關系的捕獲[5]。由于交通路況的復雜和駕駛人的駕駛習慣不同,電動汽車行駛狀態下的動力電池數據相較于其他多元時間序列的動態性更強。

基于以上思考,本文提出了基于Transformer[6]和對比學習[7]的編碼器解碼器結構。對比學習作為自監督學習通過縮小不同形式相同數據來源的編碼距離學習數據的一般特征,Transformer在自然語言處理和圖像中均取得了廣泛應用,它通過多頭注意力機制和位置編碼函數捕獲數據的時間依賴和數據之間的相關性。利用以上技術,針對數據缺少異常標簽、含有時間依賴和特征依賴、動態性較強的3個特點進行建模,并對幾種不同的閾值調整方法進行了對比。

本文的主要工作如下:

1)提出一種新的基于Transformer和對比學習的編碼器解碼器(Contrastive Transformer Encoder Decoder, CT-ED)模型用于多元時間序列異常檢測,對原始數據進行頻域數據增強構建一個實例的不同視圖,利用對比學習增強模型捕獲動態時間序列中不變特征的能力并對比了不同數據增強方式的性能。

2)結合Transformer和SENet(Squeeze and Excitation Network)[8]對數據進行時間依賴和特征相關性兩方面的編碼,使模型編碼表示更加全面。使用一次性解碼重構數據,利用重構偏差作為異常得分。

3)在3個公共數據集和電動汽車動力電池(Electric Vehicle power battery, EV)數據集上進行大量實驗,評估CT-ED的性能,實驗結果表明,CT-ED的性能優于其他基線模型。

1 相關工作

1.1 多元時間序列異常檢測

傳統的多元時間序列異常檢測采用統計學方法或者經典機器學習方法對數據分布建模。這些方法通常效率較高,但不能有效捕捉數據的時間依賴性。

最近基于深度學習的方法在多元時間序列異常檢測方面取得了顯著的進步。根據所使用的技術可以分為基于時間的方法、基于相關性的方法和綜合方法。

基于時間的方法 大部分依賴RNN相關模型,比如長短期記憶(Long Short-Term Memory, LSTM)網絡和門控循環單元(Gated Recurrent Unit, GRU)。文獻[4]中提出了長短期記憶非參數動態閾值(LSTM-Nonparametric Dynamic Thresholding, LSTM-NDT)算法,利用LSTM構造編碼器解碼器結構,并基于預測誤差提出自動閾值調整方法檢測異常。文獻[9-11]中采用不同的方式組合LSTM和變分自動編碼器(Variational Auto-Encoder, VAE),增加了重構數據的多樣性。文獻[12]中提出了多變量異常檢測生成對抗網絡(Multivariate-Anomaly Detection with Generative Adversarial Networks, MAD-GAN),采用了生成式對抗網絡(Generative Adversarial Networks, GAN)框架,利用LSTM作為生成器和鑒別器捕獲時間依賴;然而在原始GAN的結構中,隨機采樣的向量重構的數據和需要檢測的時間序列片段在隱空間(Latent Space)可能是不對應的,因此在檢測階段需要迭代尋找對應的向量,比較耗時。文獻[13]中提出了隨機遞歸神經網絡OmniAnomaly,將GRU和VAE進行有效融合,利用相對熵(Kullback-Leibler Divergence,KL散度)學習數據在隱空間的分布,可以有效地重構數據。

基于相關性的方法 文獻[14]中提出了多尺度卷積循環編碼器解碼器(Multi-Scale Convolutional Recurrent Encoder-Decoder, MSCRED)網絡,構造不同窗口大小的多元時間序列相關性矩陣,通過LSTM變體獲得數據的時間依賴和特征相關性,但該模型不適用于維度較少或者相關性較低的數據。文獻[15]中提出的圖偏差網絡(Graph Deviation Network, GDN)和文獻[16]中提出的多元時間序列異常檢測圖注意力網絡(Multivariate Time-series Anomaly Detection via Graph ATtention network, MTAD-GAT),通過圖注意力機制學習傳感器和相關傳感器之間的關系。

綜合方法 文獻[17]中提出的無監督異常檢測(Unsupervised Anomaly Detection,USAD)模型參考GAN的思想,提出了一種同步對抗式訓練策略放大正常和異常數據之間的差異,可以適應訓練數據中含有少量的異常樣本的情況,僅使用全連接層構成編碼器和解碼器。Transformer在自然語言領域的廣泛應用證實了它在序列數據上的優越性,因此也有不少基于Transformer的異常檢測模型,比如:文獻[2]中提出的基于Transformer的異常檢測(Transformer-based Anomaly Detection, TranAD)模型在Transformer基礎上通過同步對抗式訓練和自調節技術提高性能,不依賴RNN模型,具有很高的效率。文獻[18]中提出多尺度基于Transformer的殘差變分自動編碼器(Multiscale Transformer-based Residual VAE, MTRVAE)在VAE的基礎上,使用Transformer的自注意力機制捕獲序列之間的潛在相關性,并通過改進的位置編碼和上采樣算法捕獲多尺度時間信息,通過殘差連接抵抗KL散度消失問題。文獻[5]中提出對比自動編碼器(Contrastive AutoEncoder for Anomaly Detection,CAE-AD)模型,通過多粒度對比方法捕獲數據的時間相關性和局部不變特征。

1.2 Transformer

Transformer主要由多頭自注意力機制和前饋層通過殘差連接組成,模型結構是自動編碼器。一段時間序列長度為、特征維度為的時序數據,通過不同的線性映射后得到、、,注意力計算如式(1)所示:

其中:是數據在滑動窗口中的位置,是一個時間戳中不同特征的位置,model是模型的特征維度。

2 動力電池異常檢測模型

2.1 問題定義

對每個時間序列片段進行重構得到異常分數,當異常分數超過某個閾值時,判斷該時間點為異常。

2.2 模型框架

CT-ED模型整體框架如圖1所示。首先,針對數據的動態性,通過頻域增強創建一個實例的不同視圖作為一對正例,利用對比學習捕獲數據的局部不變特征;其次,針對數據的時間依賴和特征依賴,通過多尺度卷積學習時間片段中不同范圍的特征、編碼器的時間模塊和特征模塊捕獲卷積結果在時間維度和特征維度上的相關性;最后,模型的解碼器結合編碼器輸出對數據進行重構。

圖1 CT-ED模型整體框架

2.3 頻域數據增強

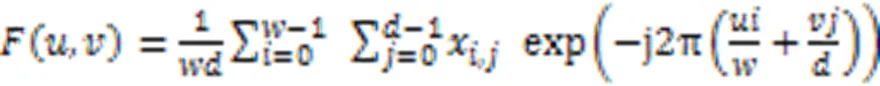

在信號處理中,時序數據可以從時域和頻域兩個角度分析。有時,時域上復雜的信號從頻域角度看會比較簡單,因此對于時間序列的數據增強方式也可以從時域和頻域兩個角度進行。模型CAE-AD[5]將數據通過注意力機制映射后,從時域和頻域兩個角度進行數據增強。由于傳感器數據本身含有噪聲以及電動汽車行駛時隨機性較大,并且經過實驗發現如果對數據分別進行時域和頻域增強,模型訓練會極不穩定。本文的模型選擇在原始數據上進行頻域增強和原數據構成一對實例的不同視圖,另外在3.7節對比了不同數據增強方式的性能。首先將輸入數據進行式(3)的二維傅里葉變換:

2.4 編碼器

圖2是CT-ED模型編碼器的細節,主要由數據嵌入模塊、特征模塊和時間模塊三部分組成。

圖2 CT-ED模型編碼器的細節

2.4.1數據嵌入模塊

不同大小的一維卷積在時間維度上滑動捕獲不同范圍的特征,單一大小的卷積核得到的結果可能遺失信息,因此融合不同大小卷積核的結果,可以獲得更強健的表示。在編碼器中,首先通過多尺度卷積對數據進行映射。模型自動學習3種卷積核的權重,通過式(5)的softmax后與各自的卷積結果相乘后融合。如式(6)所示,數據卷積融合后添加位置信息:

其中w是模型學習到的權重,通過softmax后歸一化。

其中:Conv()是一維卷積操作,是通過與原始Transformer相同的位置編碼函數得到的位置信息矩陣。

2.4.2時間模塊和特征模塊

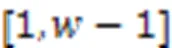

多元時間序列包含時間依賴和特征依賴,因此需要從兩個角度捕獲數據特征。在時間依賴方面,沿用Transformer的Encoder部分作為模型中時間編碼模塊;在特征依賴方面,如圖3所示,將每個特征序列全局池化后通過兩層非線性激活得到特征注意力,特征注意力和對應的特征序列相乘后進行殘差相加,對數據進行調整。時間模塊和特征模塊作為一個整體,可進行多次迭代。最終得到CT-ED模型的Encoder編碼表示。

圖3 模型編碼器中的特征模塊

2.4.3對比損失

2.5 解碼器

原始Transformer的解碼器需要迭代解碼,后面的輸出依賴前面一個時間步的預測結果,導致推理變慢[19]。如圖4所示,模型的解碼器對Transformer的Decoder的改進,結合GRU進行數據重構。

圖4 模型解碼器

將解碼器輸入decoder通過式(6)的多尺度數據嵌入后進行不同的線性映射得到111。通過掩碼多頭注意力機制輸出,如式(9)所示;將模型編碼器輸出的兩個編碼表示加權相加得到,如式(10)所示:

其中:MultiHeadAtt()代表多頭注意力,F()是由兩層全連接和激活函數組成的前饋層。最后訓練階段的總體損失計算公式如式(12)所示:

2.6 異常檢測

經過實驗發現計算窗口內最后一步時間的重構誤差比計算窗口的平均誤差效果更好,因此利用單步重構誤差作為異常得分。當該窗口的異常得分大于設定的閾值時,判定為異常。對于不同的數據集定義初始閾值并逐步尋找最優閾值需要消耗人力,因此采用文獻[20]中的自動閾值調整方法。該方法基于極值理論中不通過原始數據分布推斷極端事件的分布的思想,目標是給定一系列觀測值和異常發生的概率,計算閾值Z,使(>Z)<。首先初始化一個閾值,通常為數據的百分數,篩選超過初始閾值的時間點作為新的峰值數據,通過極大似然估計與廣義帕累托分布進行擬合,其次通過這個分布自動調整閾值。對于誤報警,采用文獻[4]中的剪枝方法對正常波動進行處理。當檢測到異常值時,與異常時間點之前的正常時間點序列的最大值進行比較,若比值小于(為一個超參數,根據實驗獲得),則判定為正常波動。

3 實驗與結果分析

本文實驗的對比模型包括MAD-GAN[12]、OmniAnomaly[13]、USAD[17]、GDN[15]和TranAD(Transformer-based Anomaly Detection model)[2]。

實驗使用PyTorch-1.11.0,隨機梯度下降優化器(Stochastic Gradient Descent, SGD)訓練所有模型。

3.1 實驗指標

通過精確率(Precision, P),召回率(Recall, R)和F1值測評模型效果。

其中:是被正確檢測的異常時間點數,是被誤判為異常的正常時間點數,是被誤判為正常的異常時間點數。

3.2 數據集

安全水處理數據集(Secure Water Treatment, SWaT)[21]。一共包括連續11 d數據,7 d為正常操作,4 d為階段性受到攻擊,共41次攻擊。參考文獻[22]中的18個連續值屬性作為特征。

土壤濕度主動被動衛星(Soil Moisture Active Passive satellite, SMAP)/火星漫游車(Mars Science Laboratory rover, MSL)數據集[4]。真實航天器遙測數據和異常。數據集由多個小數據集組成,變量主要是離散型變量。其中SMAP選擇P-1、S-1、E-1:9(除了6),MSL選擇C-1、D-16、M-1:5、T-12:13、P-11。兩個數據集都包含點異常和上下文異常兩種類型。

電動汽車動力電池(EV)數據集。電動汽車在行駛狀態下的動力電池傳感器數據,包含電流電壓溫度極值等,來自新能源汽車國家大數據聯盟和數字汽車大賽。

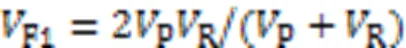

EV數據集和其他3個公開數據集都是多元時間序列,圖5顯示了EV數據集的電流時間序列和SMAP數據集的遙測值,其中灰色部分是異常時間點。可以看到EV數據集在時間維度上的表現和SMAP類似,因此在3個公開數據集上有效的模型也可以用于EV數據集的異常檢測。表1統計了數據集的大小和異常率等信息。

圖5 EV和SMAP數據集的時間序列

表1數據集統計信息

Tab.1 Statistics of datasets

3.3 實驗結果

表2展示了CT-ED和其他模型在不同數據集上的精確率(P)、召回率(R)和F1值,其中相較于次優模型,CT-ED的F1值在SWaT、SMAP、MSL和EV數據集上分別提升了6.5%、1.8%、0.9%和7.1%。CT-ED在所有數據集上的F1都取得了最優成績。CT-ED在不同數據集上的F1平均值達到0.884 1,說明了模型廣泛的適用性。

SMAP數據集大部分是點異常,MSL數據集大部分是上下文異常。OmniAnomaly在SMAP數據集取得次優的成績,在MSL數據集表現最差,可能由于模型學習數據的正常分布,因此能夠識別與正常分布差別較大的點異常,但忽視了符合正常數據分布的上下文異常。相反,MAD-GAN可以有效檢測MSL數據集異常,在SMAP數據集上表現較差,可能因為對抗式訓練放大了生成數據和真實數據的差別,將數據中的噪聲或其他正常狀態下的窗口數據也檢測為異常,導致精度較低。

USAD和TranAD在SMAP和MSL數據集上的表現比較平均,其中TranAD在MSL數據集的F1達到了次優,可能是其中的多頭注意力能有效捕獲特征相關性,因此在變量更多的MSL數據集上表現優于USAD。另外,GDN在兩個數據集上也表現得比較平均,說明基于多元數據之間相關性建模,可以有效地識別不同類型的異常。

CT-ED在SMAP和MSL數據集上的F1值都達到了0.950 0以上,說明模型適用于不同類型的異常。編碼器中的多尺度卷積有效地學習窗口內的局部特征和全局特征,能有效檢測小范圍的點異常和整體的上下文異常。SWaT數據集與SMAP數據集和MSL數據集類似,但數據量更大,大部分模型在該數據集上表現相對較差,而CT-ED的F1相較次優模型提升了6.5%,驗證了它能適應不同規模的數據集。

表2CT-ED在不同數據集上的實驗結果

Tab.2 Experimental results of CT-ED on different datasets

注:加粗和下畫線分別表示最優和次優值。

EV數據集相較于其他數據集,由于工況的變化和駕駛人不同的行為習慣,數據的隨機性更強。大部分模型在該數據集上表現不佳,F1值在[0.3,0.7];OmniAnomaly在編碼時添加了高斯噪聲,在EV數據集上取得次優的成績并遠優于其他模型。類似地,CT-ED在頻域增強時也對數據添加了高斯噪聲,增強了模型對抗數據噪聲能力和重構數據多樣性的能力。另外在CT-ED訓練階段,通過對同一實例不同視圖的對比學習,模型能夠獲得數據的一般特征,以及從時間和特征兩個角度進行編碼,使模型能夠適應不同維度的數據。

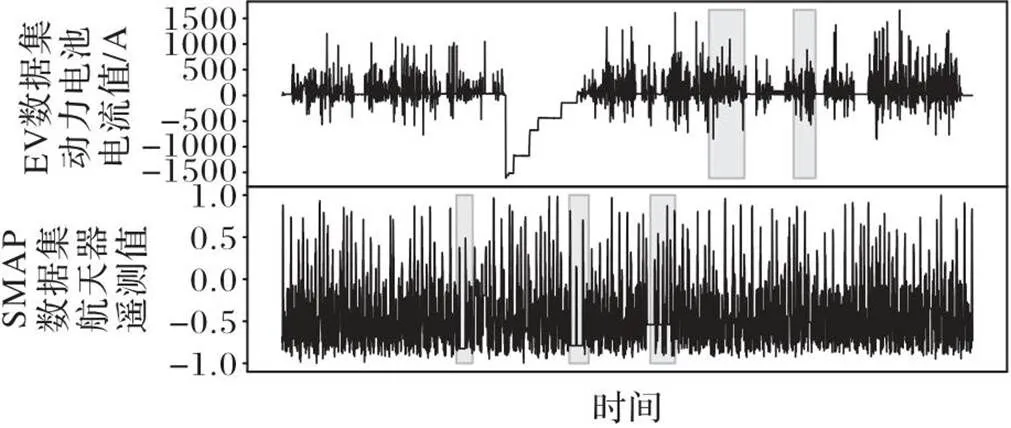

3.4 訓練過程分析

異常檢測需要時刻監測設備狀態,設置時間步為1,對于EV數據集,產生的訓練時間序列片段數為343 626,測試片段數為33 811。對于由多個子集構成的數據集SMAP和MSL,每個子集構造的時間序列片段范圍為[2 000,8 000]。由于數據集較小,SMAP和MSL數據集通常在1~5輪訓練達到最優F1值,EV和SWaT數據集在10~20輪訓練達到最優F1值。

以EV數據集為例,觀察模型訓練過程中的損失值和模型指標之間的關系。如圖6所示,MSELoss為重構損失,ConLoss為對比損失,隨著訓練召回率下降,精確率上升,F1在18輪達到最優值,后續損失值繼續下降,模型的整體性能卻下降了。說明了無監督異常檢測不同于有監督學習,可以通過監測訓練過程中的損失值判斷模型的性能,這是大部分無監督異常檢測都存在的問題。

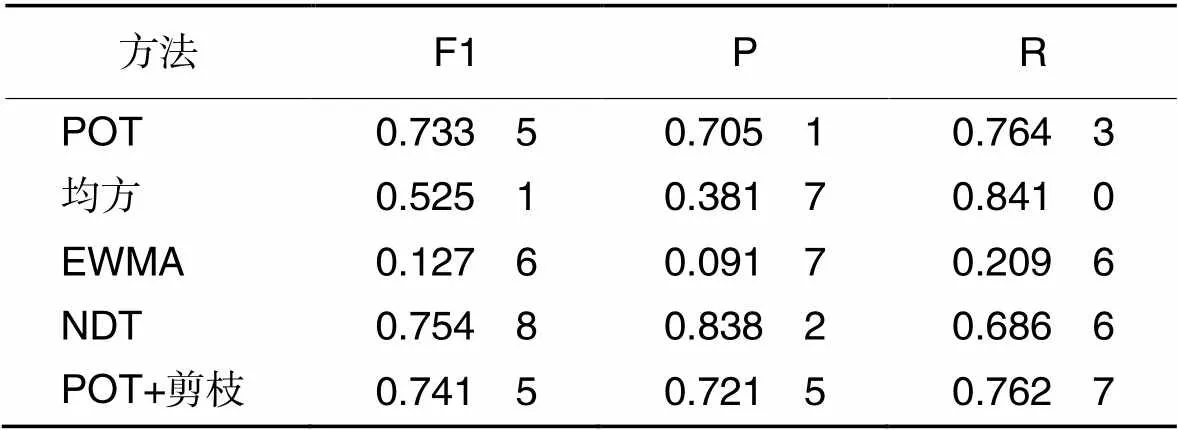

閾值的選擇對異常檢測任務十分重要,對比不同的自動閾值選擇方法的性能,在一個模型產生的異常分數上進行實驗。POT為本文采用的自動閾值選擇方法;EWMA是對異常分數進行平滑處理后選擇均值加方差作為閾值;均方是不對異常分數做處理,直接使用均值加方差作為閾值;NDT是文獻[4]中的閾值選擇方法。表3顯示了在相同模型上,通過均方和EWMA計算閾值效果很差。NDT的F1值最高,但召回率較低;POT相對平衡了召回率和精確率;而POT+剪枝可以在POT的基礎上減少錯誤報警,提高精確率。因此對異常檢測任務來說,POT閾值加上適當的剪枝更優。

圖6 EV數據集上的訓練過程

表3相同模型在不同閾值選擇方法下的實驗結果

Tab.3 Experimental results of same model with different threshold selection methods

3.5 單變量對比實驗

EV數據集中含有多個變量,選擇其中的電壓、電流和絕緣電阻單變量時間序列進行實驗。表4顯示了CT-ED的變量實驗結果,單變量情況下,最優F1為電流時間序列的0.695 4。單變量相較于多元變量缺少相關性信息,需要更大的窗口提供更多時間信息,但仍然達不到多元變量可以提供的信息量。

表4CT-ED的變量實驗結果

Tab.4 Variate experimental results of CT-ED

表5顯示了不同模型在EV數據集電流時間序列上的表現。TranAD和OmniAnomaly都取得較優F1值,但對于異常檢測任務,檢測的異常數更為重要,召回率反映了異常被檢測的概率,CT-ED在多元數據上,同等F1值下具有更高的召回率。

表5不同模型在電流單變量時間序列上的實驗結果

Tab.5 Experimental results of different models on current univariate time series

3.6 參數敏感度

本節研究不同參數對CT-ED性能的影響。模型的主要參數包括編碼器的窗口大小、解碼器的窗口大小和批大小。本節的所有實驗均在EV數據集上進行。

在對比學習中,批大小(batchsize)越大,模型效果越好。如圖7所示,其中b為批大小,d為解碼器的窗口大小。可見在大部分情況下,小批次的實驗結果更好,這和對比學習的結論相悖,可能是因為數據的動態性較強,一批數據中每個窗口的差異較大,因此噪聲較大的小批次訓練更適合動態性強的EV數據集。

圖7 不同參數下CT-ED在EV數據集上的F1值

編碼器的輸入作為重構數據的歷史信息,不同長度會產生不同的效果。從圖7可見,模型的性能比較不穩定,沒有隨著編碼器窗口大小變化趨勢而變化的規律,但是在窗口為6時取得最好成績。說明了不同于一些長序列任務,由于數據隨機性大,冗余的歷史信息反而會使模型性能降低。

解碼器輸入進行重構后在訓練階段計算重構損失直接影響模型的參數,因此需要選擇合適的解碼器窗口大小。對比解碼器窗口大小為3和6的結果,可以看到在大部分情況下,窗口為6的實驗結果更優。

3.7 消融實驗

為了研究模型主要模塊的效果,刪除了一些主要模塊,觀察模型在EV數據集上的結果變化。

CT-ED-WO-Conv:將編碼器的多尺度卷積替換為卷積核為3的單一卷積映射。

CT-ED-WO-Contrastive:刪除頻域增強和訓練時的對比損失,通過單個編碼器解碼器結構進行訓練和檢測。

CT-ED-WO-Feature:刪除編碼器中的特征注意力模塊。

CT-ED-WO-Time:刪除編碼器中時間注意力模塊。

如表6所示,CT-ED在EV數據集上性能最佳。

表6 CT-ED在EV數據集上的消融實驗結果

其中:CT-ED-WO-Time性能下降最明顯,說明了在對時間序列數據建模時,捕獲它的時間依賴的重要性;CT-ED-WO-Conv精度有明顯下降,說明多尺度卷積有效提取不同范圍特征,提高異常檢測精度;CT-ED-WO-Contrastive性能也明顯下降,說明對比學習有利于模型獲取數據的一般特征;CT-ED-WO-Feature性能下降最少,但編碼器中的特征注意力模塊仍然是整個模型中不可或缺的一部分。

在相同的參數和輪次下,對比不同時間序列數據增強方式,結果如表7所示。其中:FFT是頻域增強,移動窗口是將窗口數據往前移,噪聲是指對原始序列直接添加高斯噪聲。3個數據增強方式在性能上沒有明顯差別。

表7 不同數據增強方式的結果對比

4 結語

目前動力電池的相關研究大部分需要專業知識,并且使用實驗數據進行建模,不能很好地適應實際工況。本文針對電動汽車行駛狀態下的動力電池數據,將相對成熟的時間序列異常檢測領域的技術改進后應用于動力電池安全預警。

本文提出了一個適用于不同數據集的多元時間序列異常檢測模型。通過頻域數據增強產生一個實例的不同視圖,利用對比學習捕獲動態數據的一般特征;另外,模型在時間和特征兩個角度進行編碼,使編碼更加全面。

對于關系人身安全的動力電池安全預警任務,目前的實驗結果并不是很理想,F1值僅達到0.742 8。但本文模型無須特征工程或其他預備知識,并且模型可以識別不同于正常模式的異常行為而無須事先知道異常類型。CT-ED較其他模型在EV數據集上性能有了大幅提升,驗證了通過深度學習進行新能源汽車安全監測的可行性。

模型的精確率較低,本文嘗試對部分異常值剪枝以減少誤報警,但效果不明顯,而且模型目前只針對一輛車的運行狀態進行建模。在未來的工作中,將提高模型的運算效率,選擇合適的閾值調整方法和誤報警處理方法;另外,將融合遷移學習修改模型使模型可以適應不同狀態和不同車輛的電動汽車數據。

[1] 王震坡,李曉宇,袁昌貴,等. 大數據下電動汽車動力電池故障診斷技術挑戰與發展趨勢[J]. 機械工程學報, 2021, 57(14):52-63.(WANG Z P, LI X Y, YUAN G C, et al. Challenge and prospects for fault diagnosis of power battery system for electrical vehicles based on big-data[J]. Journal of Mechanical Engineering, 2021, 57(14):52-63.)

[2] TULI S, CASALE G, JENNINGS N R. TranAD: deep transformer networks for anomaly detection in multivariate time series data[J]. Proceedings of the VLDB Endowment, 2022, 5(16):1201-1214.

[3] 毛文濤,施華東,張艷娜,等. 軸承在線早期故障檢測的無監督張量深度遷移學習方法[J/OL]. 控制與決策(2022-11-27)[2023-03-04].https://kns.cnki.net/kcms/detail/detail.aspx?doi=10.13195/j.kzyjc.2022.1101.(MAO W T, SHI H D, ZHANG Y N, et al. Research on unsupervised tensor-based deep transfer learning for online early fault detection of bearing[J/OL]. Control and Decision (2022-11-27)[2023-03-04].https://kns.cnki.net/kcms/detail/detail.aspx?doi=10.13195/j.kzyjc.2022.1101.)

[4] HUNDMAN K, CONSTANTINOU V, LAPORTE C, et al. Detecting spacecraft anomalies using LSTMs and nonparametric dynamic thresholding [C]// Proceedings of the 24th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM, 2018: 387-395.

[5] ZHOU H, YU K, ZHANG X, et al. Contrastive autoencoder for anomaly detection in multivariate time series[J]. Information Sciences, 2022, 610: 266-280.

[6] VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need [C]// Proceedings of the 31st International Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2017: 6000-6010.

[7] CHEN T, KORNBLITH S, NOROUZI M, et al. A simple framework for contrastive learning of visual representations[C]// Proceedings of the 37th International Conference on Machine Learning. New York: JMLR.org, 2020: 1597-1607.

[8] HU J, SHEN L, SUN G. Squeeze-and-excitation networks[C]// Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2018: 7132-7141.

[9] LIN S, CLARK R, BIRKE R, et al. Anomaly detection for time series using VAE-LSTM hybrid model [C]// Proceedings of the 2020 IEEE International Conference on Acoustics, Speech, and Signal Processing. Piscataway: IEEE, 2020: 4322-4326.

[10] XU H, CHEN W, ZHAO N, et al. Unsupervised anomaly detection via variational auto-encoder for seasonal KPIs in Web applications[C]// Proceedings of the 2018 World Wide Web Conference. Republic and Canton of Geneva: International World Wide Web Conferences Steering Committee, 2018: 187-196.

[11] PARK D, HOSHI Y, KEMP C C. A multimodal anomaly detector for robot-assisted feeding using an LSTM-based variational autoencoder[J]. IEEE Robotics and Automation Letters, 2018, 3(3): 1544-1551.

[12] LI D, CHEN D, JIN B, et al. MAD-GAN: multivariate anomaly detection for time series data with generative adversarial networks[C]// Proceedings of the 2019 International Conference on Artificial Neural Networks, LNCS 11730. Cham: Springer, 2019: 703-716.

[13] SU Y, ZHAO Y, NIU C, et al. Robust anomaly detection for multivariate time series through stochastic recurrent neural network[C]// Proceedings of the 25th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM, 2019: 2828-2837.

[14] ZHANG C, SONG D,CHEN Y, et al. A deep neural network for unsupervised anomaly detection and diagnosis in multivariate time series data[C]// Proceedings of the 33rd AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2019: 1409-1416.

[15] DENG A, HOOI B. Graph neural network-based anomaly detection in multivariate time series [C]// Proceedings of the 35th AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2021: 44027-4035.

[16] ZHAO H, WANG Y, DUAN J, et al. Multivariate time-series anomaly detection via graph attention network [C]// Proceedings of the 2020 IEEE International Conference on Data Mining. Piscataway: IEEE, 2020: 841-850.

[17] AUDIBERT J, MICHIARDI P, GUYARD F, et al. USAD: unsupervised anomaly detection on multivariate time series[C]// Proceedings of the 26th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM, 2020: 3395-3404.

[18] WANG X, PI D, ZHANG X, et al. Variational Transformer-based anomaly detection approach for multivariate time series[J]. Measurement, 2022, 191: No.110791.

[19] ZHOU H, ZHANG S, PENG J, et al. Informer: beyond efficient transformer for long sequence time-series forecasting[C]// Proceedings of the 35th AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2021: 11106-11115.

[20] SIFFER A, FOUQUE P A, TERMIER A, et al. Anomaly detection in streams with extreme value theory [C]// Proceedings of the 23rd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM, 2017: 1067-1075.

[21] MATHUR A P, TIPPENHAUER N O. SWaT: a water treatment testbed for research and training on ICS security [C]// Proceedings of the 2016 International Workshop on Cyber-Physical Systems for Smart Water Networks. Piscataway: IEEE, 2016: 31-36.

[22] AHMED C M, ZHOU J, MATHUR A P. Noise matters: using sensor and process noise fingerprint to detect stealthy cyber attacks and authenticate sensors in CPS[C]// Proceedings of the 34th Annual Computer Security Applications Conference. New York: ACM, 2018: 566-581.

Power battery safety warning based on time series anomaly detection

ZHANG Anqin1,2, WANG Xiaohui1*

(1,,201306,;2,515063,)

Abnormal situations inside the vehicle battery cannot be predicted and warned in time, which leads to electric vehicle accidents and brings serious threats to drivers and passengers’ life and property safety. Aiming at the above problem, a Contrastive Transformer Encoder Decoder (CT-ED) model was proposed for multivariate time series anomaly detection. Firstly, different views of an instance were constructed through data augmentation, and the local invariant features of the data were captured by contrastive learning. Then, based on Transformer, the data were encoded from two perspectives of time dependence and feature dependence. Finally, the data were reconstructed by the decoder, and the reconstruction error was calculated as the anomaly score to detect anomalies of the machine under the actual operating conditions. Experimental results on SWaT, SMAP, MSL three public datasets and Electric Vehicle power battery (EV) dataset show that compared to the suboptimal model, the F1-scores of the proposed model increase by 6.5%, 1.8%, 0.9%, and 7.1% respectively.The above results prove that CT-ED is suitable for anomaly detection under different operating conditions, and balancing the precision and recall of anomaly detection.

time series; anomaly detection; contrastive learning; multi-head attention; autoencoder

This work is partially supported by Open Fund Project of Guangdong Province Key Research Base of Humanities and Social Sciences — Local Government Development Research Institute of Shantou University (07422002).

ZHANG Anqin, born in 1974, Ph. D., associate professor. Her research interests include data mining, ubiquitous computing.

WANG Xiaohui, born in 1998, M. S. candidate. Her research interests include data mining, anomaly detection.

TP183; TP206

A

1001-9081(2023)12-3799-07

10.11772/j.issn.1001-9081.2022111796

2022?12?06;

2023?03?16;

2023?03?23。

廣東省人文社會科學重點研究基地—汕頭大學地方政府發展研究所開放基金課題(07422002)。

張安勤(1974—),女,安徽六安人,副教授,博士,主要研究方向:數據挖掘、普適計算;王小慧(1998—),女,浙江臺州人,碩士研究生,主要研究方向:數據挖掘、異常檢測。