基于改進Informer模型的區域電力負荷預測

摘要:電力負荷預測對電力系統的安全穩定運行具有至關重要的作用。鑒于當前預測算法在精度及穩定性方面的優化仍存在不足,文章提出了一種改進的Informer電力負荷預測模型——FWInformer。該模型針對電力負荷預測易受溫度、風速等多種不確定性因素影響的問題,采用快速傅里葉變換法篩選出相關性較高的特征變量作為輸入變量。為驗證改進效果,將FWInformer模型與原Informer模型進行了對比實驗分析。實驗結果表明,FWInformer模型在均方誤差和平均絕對誤差兩項指標上均優于Informer模型,展現出更高的預測精度和更優的計算效率。

關鍵詞:Informer模型;電力負荷預測;注意力機制;傅里葉變換

中圖分類號:TP391" " " "文獻標識碼:A" " " 文章編號:1674-0688(2024)12-0012-05

0 引言

電力作為支撐各行各業穩定發展的基礎能源,其負荷預測的準確性對保障電力系統的經濟性、效率和安全性至關重要。隨著電動汽車等新型電力消費設備的普及,電力系統的隨機性、不確定性和不穩定性顯著增強,因此研發兼具穩定性和預測準確性的電力負荷預測模型顯得尤為迫切。電力負荷預測方法大致可分為物理方法、統計方法和人工智能方法。其中,人工智能方法憑借迅速發展的計算機技術成為當前的研究熱點,其強大的非線性擬合能力和自適應學習能力為預測精度及計算效率帶來了顯著提升。人工智能方法包括支持向量機、卷積神經網絡、長短期記憶網絡和Transformer等模型。在針對這些模型的應用研究中,趙婷婷等[1]對機器學習在時間序列預測領域中的應用進行了綜述,介紹了包括股票走勢、氣象變化、能源消耗在內的典型時間序列數據分析。Zhou等[2]提出了針對長序列數據預測問題的 Informer 模型,該模型利用稀疏自注意力機制大幅降低了運算量,提升了長序列數據預測的運算效率。Informer 模型在捕獲長序列輸入信息方面表現出色, 預測性能優于現有主流預測模型, 并逐漸應用于負荷預測領域。朱莉等[3]針對電力負荷數據的波動性和非平穩性導致的預測精度低的問題,提出了一種結合二次分解重構策略與Informer模型的深度學習電力負荷預測模型。魏震波等[4]采用快速傅里葉變換(FFT)計算原始電力負荷序列的期望頻率,作為負荷聚類的特征量。許越等[5]分析了外部因素對電價的數據變化的影響,提出了一種多步預測模型,將電價相關性較高的因素作為模型原始輸入序列,經信號分解后分別輸入改進的Informer模型進行多步預測。席禹等[6]提出了基于Informer的變電站設備數據清洗技術,通過預測模型識別異常值、修正噪聲并記錄異常時間,有效滿足了清洗需求。

盡管Informer模型在處理序列數據方面具有優勢,但是其概率稀疏的自注意力機制更側重于捕捉全局信息,可能忽略了數據中的局部特征細節,這可能導致在處理局部上下文匹配時出現異常。基于已有研究,本文提出了一種改進的Informer電力負荷預測模型——FWInformer。該模型在輸入序列經過概率稀疏自注意力機制計算過后,增加了一層傅里葉變換層,用于篩選輸入變量中的重要上下文信息,提取序列數據的局部特征信息,從而提高預測準確度。為評估 FWInformer 模型的有效性,本文采用了某地近3年的電力設備運行數據進行實驗。實驗結果表明,與Informer預測模型相比,FWInformer模型在不同預測步長下均取得了更優的預測效果。

1 FWInformer模型構建

1.1 FWInformer模型總體架構

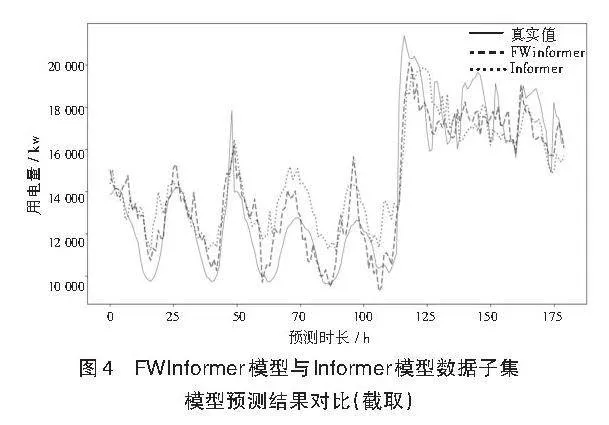

FWInformer模型主要由輸入序列、編碼器、解碼器、全連接層以及輸出序列組成。Informer模型是專為應對時間序列預測而設計的基于注意力機制的Transformer模型,它對傳統Transformer模型存在的幾個主要問題進行了優化。這些問題包括自注意力機制導致的高時間復雜度、多層堆疊引發的內存瓶頸以及預測速度較慢等。為克服這些難題,Informer模型引入了概率稀疏自注意力機制,該機制有效降低了計算的時間復雜度和內存消耗,大幅減少了計算成本,并增強了模型處理長序列數據的能力。此外,為減少輸出維度和網絡參數數量,同時強化核心注意力信息,Informer模型還采用了自注意力蒸餾機制。該機制通過在每個注意力層后應用正則化卷積與池化操作,將每層輸出量減半,使模型能夠更聚焦于關鍵信息,同時減輕了計算負擔。Informer模型還提出了并行生成式解碼器機制,使模型能夠在單次前向傳播過程中完成所有預測結果的輸出,不僅避免了誤差累積,還顯著提高了時間序列預測的速度和效率。這一改進對于需要快速響應和精確預測的應用場景尤為重要。FWInformer模型在Informer模型的基礎上進行了進一步改進。在輸入序列經過概率稀疏自注意力機制和蒸餾操作后,還需歷經一層快速傅里葉變換操作。這一步驟提高了特征數據的穩定篩選能力,有助于更精確地識別數據的周期性特征。FWInformer模型總體架構見圖1。

1.2 輸入模塊

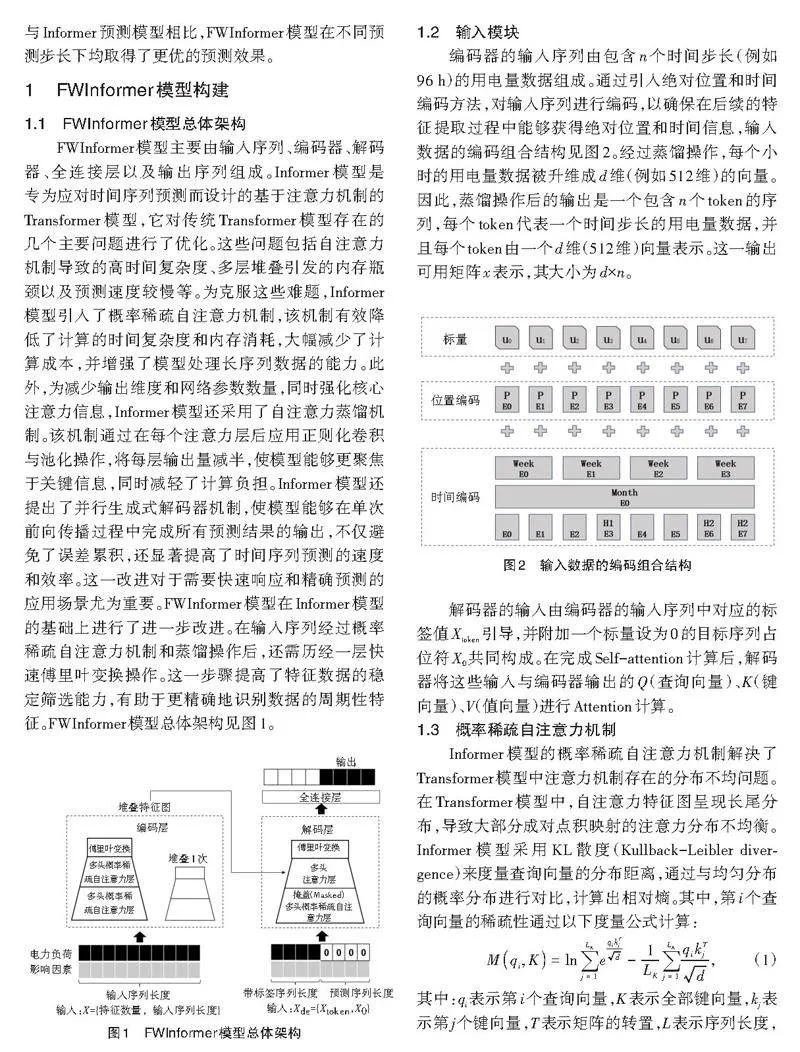

編碼器的輸入序列由包含n個時間步長(例如96 h)的用電量數據組成。通過引入絕對位置和時間編碼方法,對輸入序列進行編碼,以確保在后續的特征提取過程中能夠獲得絕對位置和時間信息,輸入數據的編碼組合結構見圖2。經過蒸餾操作,每個小時的用電量數據被升維成d維(例如512維)的向量。因此,蒸餾操作后的輸出是一個包含n個token的序列,每個token代表一個時間步長的用電量數據,并且每個token由一個d維(512維)向量表示。這一輸出可用矩陣x表示,其大小為d×n。

解碼器的輸入由編碼器的輸入序列中對應的標簽值Xtoken 引導,并附加一個標量設為0的目標序列占位符X0共同構成。在完成Self-attention計算后,解碼器將這些輸入與編碼器輸出的Q(查詢向量)、K(鍵向量)、V(值向量)進行Attention計算。

1.3 概率稀疏自注意力機制

Informer模型的概率稀疏自注意力機制解決了Transformer模型中注意力機制存在的分布不均問題。在Transformer模型中,自注意力特征圖呈現長尾分布,導致大部分成對點積映射的注意力分布不均衡。Informer模型采用KL散度(Kullback-Leibler divergence)來度量查詢向量的分布距離,通過與均勻分布的概率分布進行對比,計算出相對熵。其中,第i個查詢向量的稀疏性通過以下度量公式計算:

[Mqi, K=lnj=1LKeqikTjd-1LKj=1LKqikTjd]," " " " "(1)

其中:qi表示第i個查詢向量,K表示全部鍵向量,kj表示第j個鍵向量,T表示矩陣的轉置,L表示序列長度,d表示變量輸入維度。公式(1)中等式右邊第一項計算的是每個查詢向量相對于所有鍵向量的對數求和指數(LSE),用于度量各個鍵在每個查詢向量作用下的總體影響,第二項是所有鍵的點積值的算術平均值,能夠反映鍵向量對查詢向量的整體平均響應。為避免梯度消失,還對數據進行了歸一化處理。計算之后,隨機選擇u個點積對,以將計算復雜度降低至O(LlnL)。基于上述方法,得到Informer模型的概率稀疏自注意力計算公式:

[A(Q, K, V)=Softmax(QKTd)V]," " " " " " "(2)

其中:A表示Attention機制,[Q]表示經過隨機選擇后的查詢向量,K、V分別表示鍵向量和值向量組成的矩陣,Softmax是激活函數。

1.4 自注意力蒸餾機制

完成概率稀疏計算后,模型將對輸入序列進行堆疊處理,并對每一層采用一維卷積和池化操作,以實現下采樣,從而解決長輸入序列導致的內存占用過高問題。從j到j+1層的蒸餾操作過程的表達式如下:

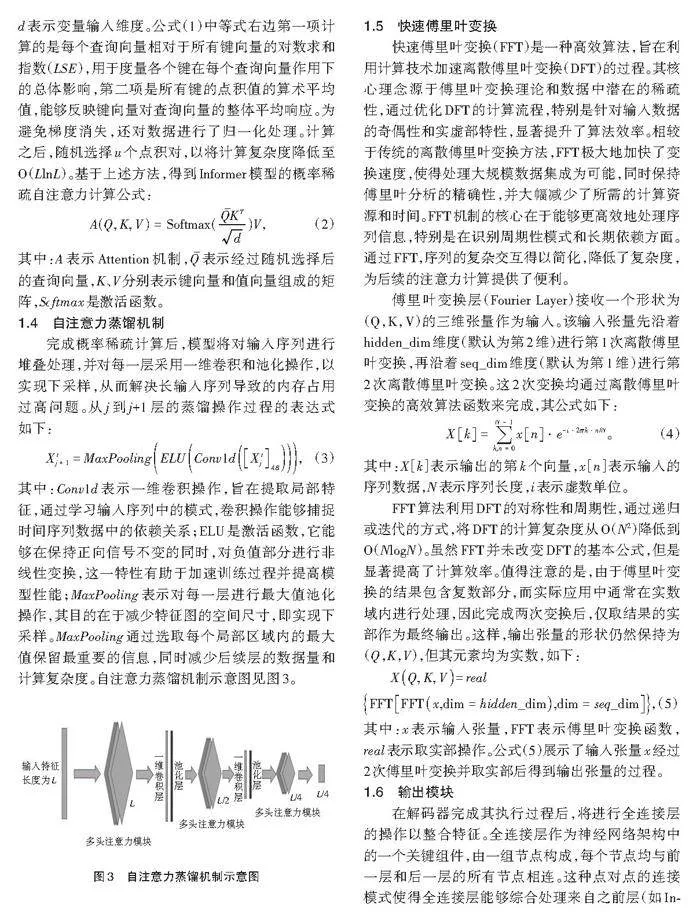

[Xtj+1=MaxPoolingELUConv1dXtjAB]," (3)其中:Conv1d表示一維卷積操作,旨在提取局部特征,通過學習輸入序列中的模式,卷積操作能夠捕捉時間序列數據中的依賴關系;ELU是激活函數,它能夠在保持正向信號不變的同時,對負值部分進行非線性變換,這一特性有助于加速訓練過程并提高模型性能;MaxPooling表示對每一層進行最大值池化操作,其目的在于減少特征圖的空間尺寸,即實現下采樣。MaxPooling通過選取每個局部區域內的最大值保留最重要的信息,同時減少后續層的數據量和計算復雜度。自注意力蒸餾機制示意圖見圖3。

1.5 快速傅里葉變換

快速傅里葉變換(FFT)是一種高效算法,旨在利用計算技術加速離散傅里葉變換(DFT)的過程。其核心理念源于傅里葉變換理論和數據中潛在的稀疏性,通過優化DFT的計算流程,特別是針對輸入數據的奇偶性和實虛部特性,顯著提升了算法效率。相較于傳統的離散傅里葉變換方法,FFT極大地加快了變換速度,使得處理大規模數據集成為可能,同時保持傅里葉分析的精確性,并大幅減少了所需的計算資源和時間。FFT機制的核心在于能夠更高效地處理序列信息,特別是在識別周期性模式和長期依賴方面。通過FFT,序列的復雜交互得以簡化,降低了復雜度,為后續的注意力計算提供了便利。

傅里葉變換層(Fourier Layer)接收一個形狀為(Q,K,V)的三維張量作為輸入。該輸入張量先沿著hidden_dim維度(默認為第2維)進行第1次離散傅里葉變換,再沿著seq_dim維度(默認為第1維)進行第2次離散傅里葉變換。這2次變換均通過離散傅里葉變換的高效算法函數來完成,其公式如下:

[Xk=k,n=0N-1xn?e-i?2πk?n/N]。" " " " " " "(4)

其中:X[k]表示輸出的第k個向量,x[n]表示輸入的序列數據,N表示序列長度,i表示虛數單位。

FFT算法利用DFT的對稱性和周期性,通過遞歸或迭代的方式,將DFT的計算復雜度從O(N2)降低到O(NlogN)。雖然FFT并未改變DFT的基本公式,但是顯著提高了計算效率。值得注意的是,由于傅里葉變換的結果包含復數部分,而實際應用中通常在實數域內進行處理,因此完成兩次變換后,僅取結果的實部作為最終輸出。這樣,輸出張量的形狀仍然保持為(Q,K,V),但其元素均為實數,如下:

[XQ, K, V=real]

[FFTFFTx,dim=hidden_dim,dim=seq_dim],(5)

其中:x表示輸入張量,FFT表示傅里葉變換函數,real表示取實部操作。公式(5)展示了輸入張量x經過2次傅里葉變換并取實部后得到輸出張量的過程。

1.6 輸出模塊

在解碼器完成其執行過程后,將進行全連接層的操作以整合特征。全連接層作為神經網絡架構中的一個關鍵組件,由一組節點構成,每個節點均與前一層和后一層的所有節點相連。這種點對點的連接模式使得全連接層能夠綜合處理來自之前層(如Informer模型的特征提取階段)的信息。全連接層模仿生物神經系統中神經元間的密集連接,具備強大的信息整合能力,能將局部具有分類意義的特征映射為全局描述。在神經網絡中,全連接層的作用之一是將卷積層或池化層輸出的空間或時間上的局部特征轉化為更高層次的抽象表示。為增強模型性能,全連接層通常會應用激活函數,如ReLU、Softmax等。ReLU函數能加速訓練過程并緩解梯度消失問題,而Softmax函數則常用于多分類任務,通過將輸出轉換為概率分布來輔助分類決策。在Informer模型中,針對具體任務選擇適當的損失函數至關重要,因為它指導模型的學習方向。全連接層傾向于使用Softmax函數配合交叉熵損失進行最終的數據分類或預測生成,這有助于提高模型的分類準確性,并確保輸出結果的概率解釋性。模型最終采用批量生成式預測,直接輸出所有預測結果,從而提高長序列的預測速度,公式如下:

[Xtfeed_de=ConcatXttoken, Xt0∈RLtoken+Lydm] ," " "(6)

其中:[Xtfeed_de]代表輸入序列中的動態采樣部分,[Xttoken]代表序列的長度。在自注意機制中,采用masked多頭注意力技術的關鍵在于將不合規的點積值設為負無窮大([-∞]),以確保每個位置不會獲取到其后續位置的信息,從而避免自回歸現象。最終的輸出結果來自全連接層,并且該層的規模會根據預測任務是單變量還是多變量而相應調整。

2 實驗內容

2.1 數據集

本文數據來源于美國亞利桑那州立大學(Arizona State University)2021—2023年的23 847條變壓器用電量數據,以及同期從美國國家海洋和大氣管理局(National Oceanic and Atmospheric Administration,NOAA)獲取的亞利桑那州立大學附近氣象站的氣象數據。數據單位時間為 1 h,并按照 7∶2∶1 的比例劃分為訓練集、測試集和驗證集。數據集特征包括Temperature(溫度)、Dew Point Temperature(露點溫度)、Pressure(氣壓)、Wind direction(風向)和Wind speed(風速)。

在使用數據集之前,需進行數據預處理,包括缺失值處理和數據歸一化處理。針對缺失值處理問題,考慮到電力數據存在較強的波動性和隨機性,導致局部數據缺失的情況時有發生。對于大范圍的連續數據缺失,選擇使用歷史同期數據進行填充;而對于小范圍缺失的部分,則通過計算前后數據的平均值進行填充。數據歸一化的目的在于消除不同特征之間因量綱差異帶來的影響,從而提高模型訓練的收斂速度和穩定性。本文采用Min-Max歸一化方法,將各特征的數據數值范圍統一映射至[0,1]區間內,以確保每個特征對模型的影響權重更加均衡。具體的轉換公式如下:

[x=x-xminxmax-xmin]," " " " " " " " " " " " " " "(7)

其中:[x]表示原始數據值,[xmin]和[xmax]分別表示該特征下的最小值和最大值,[x]表示歸一化后的數據值。

為了使預測結果更貼近實際情況,本文在完成模型預測后還進行了反歸一化操作。該過程將預測值及其誤差從歸一化后的[0, 1]區間還原至其原始的數據值范圍,以精確呈現預測誤差的實際意義和大小。

2.2 實驗評價標準

實驗選用均方誤差(MSE)作為模型預測評價指標之一,MSE通過計算每個預測值與對應真實值之差的平方的平均值,量化模型的預測精度。MSE不僅能反映模型的整體預測精度,還能凸顯預測偏差較大的情況。另一評價指標為平均絕對誤差(MAE),它通過計算預測值與對應真實值之差的絕對值的平均值,同樣量化模型的預測精度。MSE和MAE的公式如下:

[MSE=1mi=1myi-yi2]," " " " " " " " " " (8)

[MAE=1mi=1myi-yi]," " " " " " " " " "(9)

其中:m為測試數據集大小,[yi]表示第i個樣本的預測值,[yi]表示第i個樣本的實際值。

2.3 實驗結果與分析

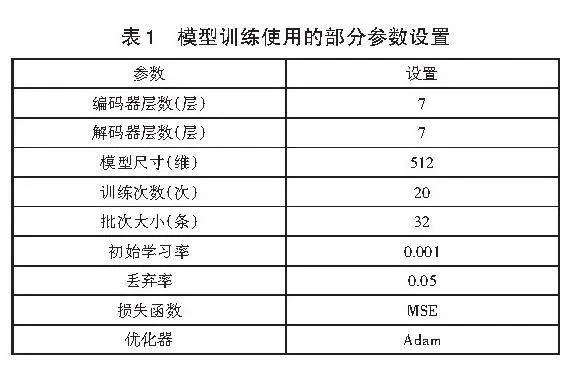

實驗代碼采用 Python語言及第三方庫編寫,深度學習環境選用 Pytorch框架,并在 GPU(圖形處理單元)上進行模型訓練。模型訓練使用的部分參數設置見表1。

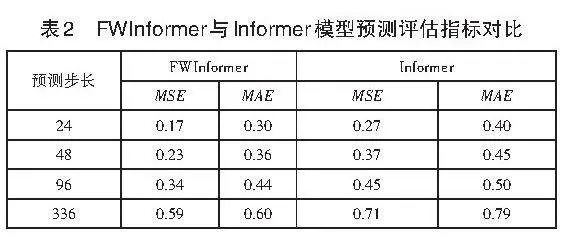

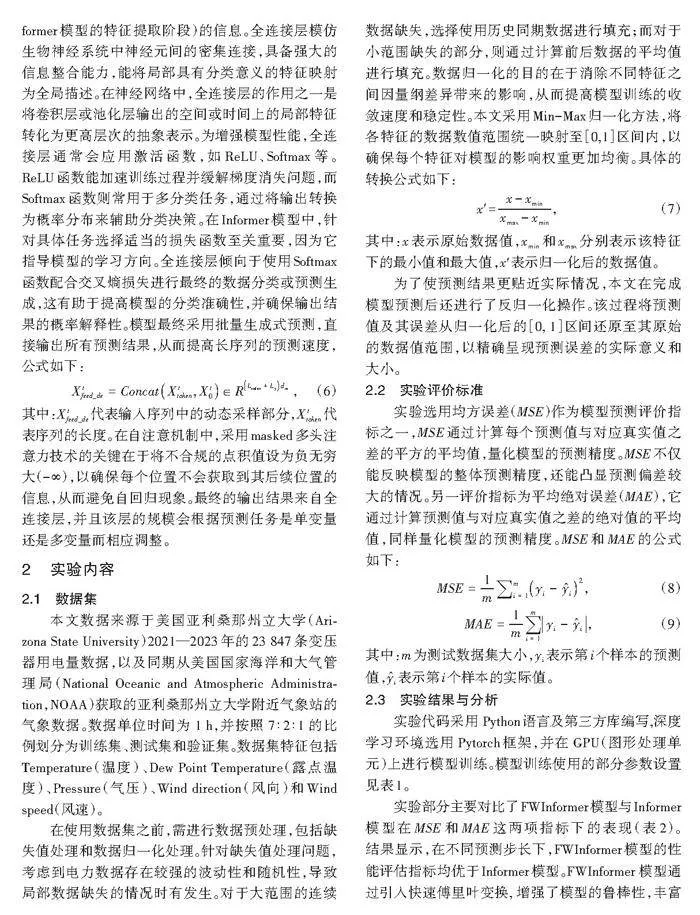

實驗部分主要對比了FWInformer模型與Informer模型在MSE和MAE這兩項指標下的表現(表2)。結果顯示,在不同預測步長下,FWInformer模型的性能評估指標均優于Informer模型。FWInformer 模型通過引入快速傅里葉變換, 增強了模型的魯棒性,豐富了特征多樣性, 并提升了結構信息的提取和保留能力,從而在多步預測過程中取得了更優的效果。具體而言,在預測步長為96 h時,FWInformer模型的MSE和MAE分別為0.34和0.44,相較于Informer模型的0.45和0.50,分別降低了約24%和12%,充分表明了FWInformer模型的性能優于原始的Informer模型。

此外,在對模型的穩定性進行的測試中,通過在不同數據子集上重復進行訓練和測試,發現FWInformer模型的預測結果展現出較高的一致性和魯棒性。FWInformer模型與Informer模型數據子集模型預測結果對比(截取)見圖4。

3 結論

本文針對區域電力負荷預測,提出了一種基于改進Informer的電力負荷預測模型——FWInformer。通過實際場景中使用電力數據與氣象數據進行實驗驗證,并與Informer模型進行對比,結果表明,FWInformer模型在不同預測步長下均展現出優異性能。其優勢主要是通過引入快速傅里葉變換,增強了模型對序列數據特征信息的提取的能力,同時減輕了計算負擔,提升了模型的魯棒性。FWInformer模型能有效捕捉電力負荷數據的周期性和長期依賴性,從而提高了預測的精度和效率。未來的研究方向可進一步探索該模型在不同地區和不同規模電力系統中的應用,并研究其他類型因素(如突發事件、經濟指標等)對電力數據的影響,以期進一步提升預測的準確性和適用性。

4 參考文獻

[1]趙婷婷,韓雅杰,楊夢楠,等.基于機器學習的時序數據預測方法研究綜述[J].天津科技大學學報,2021,36(5):1-9.

[2]ZHOU H.,LI J.,ZHANG S,et al.Expanding the prediction capacity in long sequence time-series forecasting[J].Artificial Intelligence,2023,Vol.318:103886.

[3]朱莉,韓凱萍,朱春強.二次分解策略組合Informer的短期電力負荷預測方法[J].國外電子測量技術,2023,42(6):23-32.

[4]魏震波,余雷.基于FFT,DC-HC及LSTM的短期負荷預測方法[J].智慧電力,2022,50(3):37-43.

[5]許越,李強,崔暉.基于MIC-EEMD-改進Informer的含高比例清潔能源與儲能的電力市場短期電價多步預測[J].電網技術,2024,48(3):949-958.

[6]席禹,孟令雯,班國邦,等.基于Informer的變電站設備狀態數據清洗方法[J].制造業自動化,2023,45(9):15-21.

【作者簡介】唐博,男,湖南長沙人,在讀碩士研究生,研究方向:工業大數據;王志兵,男,湖南邵東人,碩士,副教授,研究方向:大數據、軟件工程。

【引用本文】唐博,王志兵.基于改進Informer模型的區域電力負荷預測[J].企業科技與發展,2024(12):12-16.