基于圖卷積網(wǎng)絡(luò)的兒童坐姿檢測(cè)學(xué)習(xí)桌椅設(shè)計(jì)方法研究

■張飛宇,蘭 揚(yáng),朱 偉,宋 玲,王張恒,李 芳,孫德林

(1.中南林業(yè)科技大學(xué)材料科學(xué)與工程學(xué)院,湖南長(zhǎng)沙 410004;2.中國(guó)人民大學(xué)信息學(xué)院,北京 100089;3.北京金隅天壇家具股份有限公司,北京 100010)

坐姿與健康有著緊密的關(guān)系,不良的坐姿會(huì)對(duì)兒童成長(zhǎng)發(fā)育期的肌肉、脊柱及腰椎間盤等組織造成不同程度的生理壓力,長(zhǎng)此以往極易引發(fā)脊柱畸形、駝背、頸椎病、近視眼等疾病。6-12歲的兒童正是身體生長(zhǎng)發(fā)育的黃金時(shí)期,但在升學(xué)壓力日益激烈的大背景下,學(xué)生成了新時(shí)代的“久坐族”。這段時(shí)期的兒童骨骼肌肉與生理各項(xiàng)機(jī)能尚未發(fā)育完全,不良的坐姿會(huì)對(duì)兒童的健康產(chǎn)生極大的影響[1-4]。

■圖1 基于ST-GCN的兒童坐姿矯正家具方法流程圖

研究表明,外界的及時(shí)提醒或矯正可以有效幫助兒童養(yǎng)成良好的坐姿習(xí)慣[5-6]。運(yùn)用機(jī)器視覺技術(shù)識(shí)別兒童姿態(tài)、幫助兒童實(shí)現(xiàn)健康的學(xué)習(xí)坐姿是一種可行的方式,可為智能趨勢(shì)下的兒童坐姿矯正家具設(shè)計(jì)提供有效支撐[7]。目前,坐姿檢測(cè)的研究方法主要有基于接觸式傳感器與基于計(jì)算機(jī)視覺圖像識(shí)別兩種。其中接觸式傳感器的坐姿檢測(cè)需要傳感器與人體直接接觸,不僅設(shè)備價(jià)格昂貴、采集過(guò)程繁雜,且靈敏度受環(huán)境因素影響較大降低,易出現(xiàn)信息誤差[8-10]。而基于計(jì)算機(jī)視覺圖像的識(shí)別技術(shù)具有較高的識(shí)別率和魯棒性,可擴(kuò)展性高、信息豐富且更加靈活,更適合實(shí)際應(yīng)用[11]。機(jī)器視覺技術(shù)可以利用人體姿態(tài)估計(jì)開源庫(kù)(OpenPose)和深度攝像機(jī)捕獲得實(shí)時(shí)骨架數(shù)據(jù),進(jìn)而獲取動(dòng)態(tài)的人體關(guān)鍵節(jié)點(diǎn)。OpenPose的優(yōu)勢(shì)在于它可以實(shí)時(shí)地估計(jì)人體姿態(tài),即使在復(fù)雜的環(huán)境下也能夠保持準(zhǔn)確性。郭園[12]等將OpenPose與Kinect V2傳感器相結(jié)合,精準(zhǔn)捕捉了小學(xué)生動(dòng)態(tài)學(xué)習(xí)坐姿中的身體關(guān)鍵指標(biāo),幫助判斷坐姿與桌椅的適應(yīng)情況;魏華良[13]等使用連通域分析法,實(shí)現(xiàn)兒童不當(dāng)坐姿行為的檢測(cè)和警報(bào);任宏[14]等提出了以人體工學(xué)觀測(cè)方法作為坐姿行為健康判定模型,探究了不同桌面傾角對(duì)兒童脊椎健康的影響;鄭佳罄[15]等使用雙目攝像頭實(shí)時(shí)采集用戶圖像,利用簡(jiǎn)化的OpenPose模型提取人體骨骼關(guān)鍵點(diǎn)并實(shí)時(shí)檢測(cè)。在上述研究中,大部分使用成本較高的Kinect傳感器,導(dǎo)致這種技術(shù)在兒童家具領(lǐng)域難以大規(guī)模應(yīng)用。而利用普通攝像頭采集數(shù)據(jù)的,又因其算法或數(shù)理統(tǒng)計(jì)的方法的局限存在一定的誤差,導(dǎo)致結(jié)果精度也差強(qiáng)人意。

本研究從為兒童坐姿矯正學(xué)習(xí)桌椅的設(shè)計(jì)提供科學(xué)依據(jù)的角度出發(fā),提出一種基于圖像識(shí)別的兒童坐姿矯正家具研究策略。將OpenPose與圖卷積神經(jīng)網(wǎng)絡(luò)(spatial temporal graph convolutional networks, ST-GCN)相結(jié)合,其中,STGCN的核心是將GCN與時(shí)間卷積網(wǎng)絡(luò)(Temporal Convolutional Network,TCN)相融合,將圖卷積網(wǎng)絡(luò)擴(kuò)展到時(shí)空?qǐng)D模型,基于算法對(duì)動(dòng)態(tài)人體骨骼序列進(jìn)行建模,通過(guò)保留骨骼關(guān)節(jié)點(diǎn)之間在時(shí)間和空間維度上的相關(guān)性信息,使模型具有很強(qiáng)的學(xué)習(xí)能力和泛化能力[16-17]。以解決傳統(tǒng)物理矯正器給兒童帶來(lái)的束縛和圖像識(shí)別坐姿部分遮擋及復(fù)雜背景等問(wèn)題,使識(shí)別系統(tǒng)擁有判斷兒童健康坐姿的能力,實(shí)現(xiàn)低成本、無(wú)需穿戴且實(shí)時(shí)的坐姿檢測(cè)。這可以進(jìn)行及時(shí)坐姿勸導(dǎo),為智能兒童坐姿矯正家具的設(shè)計(jì)提供支撐。

1 內(nèi)容與方法

1.1 方法原理

基于ST-GCN的兒童坐姿矯正家具研究方法流程如圖1所示。首先,自主采集兒童坐姿行為并構(gòu)建研究數(shù)據(jù)集,將數(shù)據(jù)集經(jīng)過(guò)一系列預(yù)處理之后輸入到OpenPose人體2D姿態(tài)估計(jì)模型來(lái)提取目標(biāo)的骨骼關(guān)節(jié)點(diǎn)作為運(yùn)動(dòng)特征信息;然后,將獲取的數(shù)據(jù)輸入到ST-GCN時(shí)空?qǐng)D卷積網(wǎng)絡(luò)中識(shí)別兒童坐姿所屬類別,訓(xùn)練SOFTMAX分類器來(lái)判斷兒童坐姿是否標(biāo)準(zhǔn),并在識(shí)別到非正確坐姿時(shí)進(jìn)行實(shí)時(shí)語(yǔ)音提醒;最后結(jié)合智能座椅對(duì)兒童坐姿進(jìn)行提示或矯正等。在滿足坐姿識(shí)別率條件下,進(jìn)一步分析在實(shí)際應(yīng)用中的效果,并進(jìn)行不斷地優(yōu)化。

1.2 數(shù)據(jù)集構(gòu)建及預(yù)處理

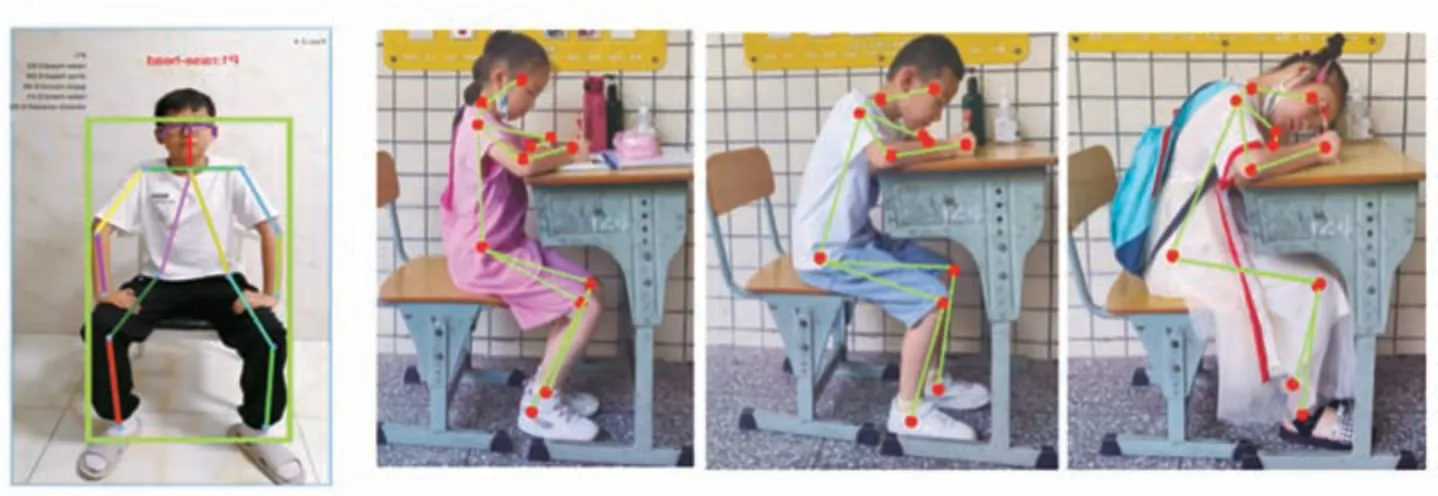

從湖南省砂子塘新世界小學(xué)自主采集兒童坐姿行為數(shù)據(jù)集,供模型訓(xùn)練研究。數(shù)據(jù)集共1800段視頻樣本,包含正確坐姿和非正確坐姿,其中非正確坐姿為調(diào)研相關(guān)研究資料確認(rèn)的七種兒童常見錯(cuò)誤坐姿:趴寫、含筆、左手托腮、右手托腮、駝背、頭往左斜、頭往右斜,如圖2所示。為了更好地滿足后續(xù)模型提取目標(biāo)骨骼關(guān)節(jié)點(diǎn)的需要,先對(duì)采集的視頻樣本進(jìn)行預(yù)處理:將所有的視頻大小都裁剪為340×256的分辨率,并將視頻中包含人體的部分裁剪出來(lái),獲得更穩(wěn)定更好的關(guān)節(jié)點(diǎn)準(zhǔn)確率。

1.3 基于OpenPose模型的兒童坐姿檢測(cè)

OpenPose是經(jīng)典的基于深度學(xué)習(xí)的人體姿態(tài)估計(jì)模型,可以檢測(cè)圖像中單人或多人的人體動(dòng)作[18]。通過(guò)提取視頻中人體骨骼關(guān)鍵點(diǎn)的位置坐標(biāo),將輸出的坐標(biāo)信息作為動(dòng)作識(shí)別算法的輸入,最終實(shí)現(xiàn)坐姿行為動(dòng)作識(shí)別的功能,實(shí)現(xiàn)了實(shí)時(shí)檢測(cè)并保證了識(shí)別精度。由于在研究中足部關(guān)節(jié)點(diǎn)對(duì)最終的識(shí)別效果沒(méi)有顯著影響[19],故采用18個(gè)關(guān)節(jié)點(diǎn)的輸出形式。人體姿態(tài)骨架圖(Skeleton Graph)用圖形格式表示人的動(dòng)作,如圖3所示。

使用OpenPose提取每段視頻數(shù)據(jù)中每幀的18個(gè)帶置信度的2D骨骼點(diǎn)(x,y,score),然后在時(shí)間和空間維度進(jìn)行歸一化,也就是對(duì)每一個(gè)關(guān)節(jié)在幀序列中的位置坐標(biāo)(x,y)和置信度歸一化到[0,1],最后生成json文件,添加對(duì)應(yīng)的標(biāo)簽,將數(shù)據(jù)集轉(zhuǎn)成圖神經(jīng)網(wǎng)絡(luò)使用的格式,如圖4所示。

1.4 基于ST-GCN模型的兒童坐姿識(shí)別

CNN被廣泛應(yīng)用于圖像分類、文本分類、半監(jiān)督學(xué)習(xí)等深度學(xué)習(xí)任務(wù)中[20],為了采用ST-GCN模型提取兒童坐姿的嵌入特征,圖像經(jīng)過(guò)OpenPose處理后,得到一系列關(guān)節(jié)點(diǎn)序列,可以構(gòu)建人體關(guān)節(jié)點(diǎn)序列的時(shí)空?qǐng)D結(jié)構(gòu),作為圖卷積網(wǎng)絡(luò)的輸入。

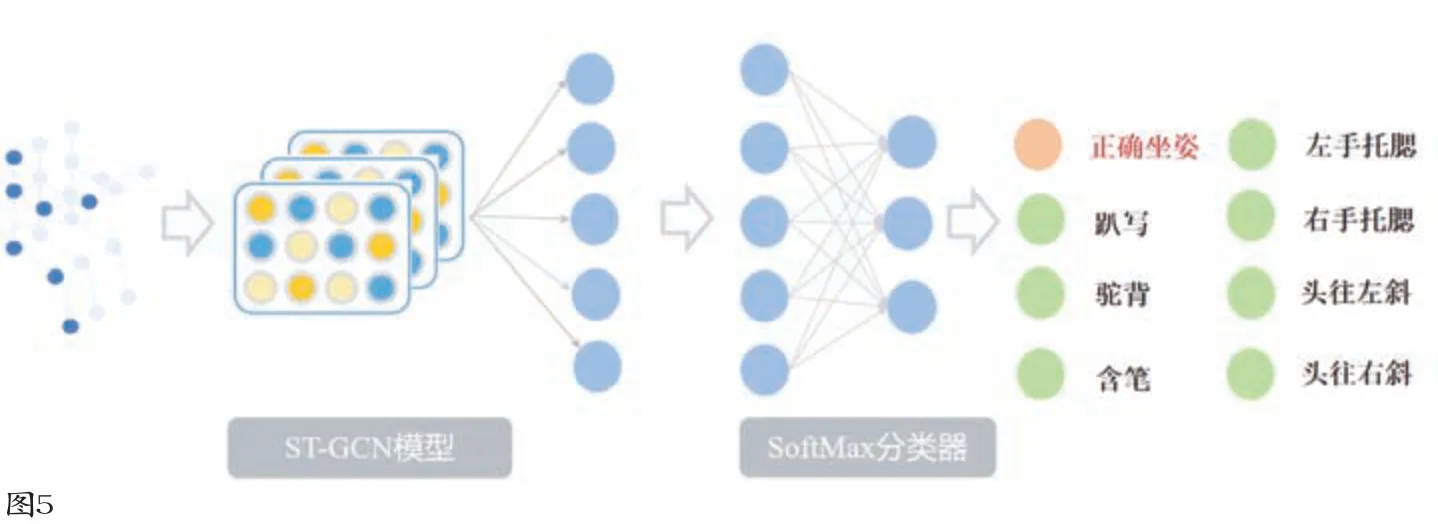

將上述骨骼關(guān)節(jié)點(diǎn)時(shí)空?qǐng)D輸入STGCN模型后提取時(shí)空?qǐng)D的高階特征圖,然后使用SoftMax分類器識(shí)別視頻中兒童坐姿的所屬類別。坐姿分類時(shí)采用top1準(zhǔn)確率,此處模型輸出的是概率向量和對(duì)應(yīng)的動(dòng)作類別標(biāo)簽,top1準(zhǔn)確率表示概率向量中,最大概率的預(yù)測(cè)類別與真實(shí)類別一致則為正確,否則是預(yù)測(cè)錯(cuò)誤。最后當(dāng)模型識(shí)別出兒童坐姿為非正確坐姿時(shí),調(diào)用第三方接口進(jìn)行實(shí)時(shí)語(yǔ)音提醒,如圖5所示。

■圖5 基于圖表示學(xué)習(xí)的姿態(tài)估計(jì)架構(gòu)示意圖

1.5 實(shí)驗(yàn)參數(shù)設(shè)置

實(shí)驗(yàn)平臺(tái)硬件環(huán)境配置如下:服務(wù)器操作系統(tǒng)Ubuntu 16.04;CPU:英特爾(Intel)12核至強(qiáng)ES-2680,主頻為2:40GHz;顯卡:4個(gè)英偉達(dá)(NVIDIA)TITAN V;軟件配置:CUDA版本10.0.130,cuDNN版本7.6.4。

ST-GCN模型的輸入是(N, C, T, V, M)的張量。首先將輸入BN層進(jìn)行歸一化,接著通過(guò)9層ST-GCN單元,每個(gè)單元包含ResNet結(jié)構(gòu),經(jīng)過(guò)每個(gè)單元后以0.5的概率隨機(jī)dropout特征,空間維度是關(guān)節(jié)的特征,開始是3,前三層關(guān)節(jié)的特征維度是64,中間三層特征維度128,最后三層特征維度256;第四、七層特征維度翻倍將stride設(shè)為2;最后使用SoftMax分類器。訓(xùn)練時(shí)使用Glorot來(lái)初始化模型的參數(shù),并且使用Adam優(yōu)化器來(lái)訓(xùn)練模型,批處理大小設(shè)置為16,學(xué)習(xí)率設(shè)為0.01,每經(jīng)過(guò)10個(gè)epochs學(xué)習(xí)率自乘0.1。

1.6 評(píng)價(jià)指標(biāo)

本文在節(jié)點(diǎn)分類任務(wù)上廣泛使用的Macro-F1和Micro-F1作為評(píng)估指標(biāo)。對(duì)于兒童坐姿識(shí)別多分類實(shí)驗(yàn),分類算法的性能可以通過(guò)精確率(precision P)、準(zhǔn)確率(accuracy,Acc)和召回率(recall,R)來(lái)評(píng)判,公式如(1)-(3)式所示:

首先,統(tǒng)計(jì)各個(gè)類別的真正例(TP)、假正例(FP)、假反例(FN)和真反例(TN),加和構(gòu)成新的TP、FP、FN、TN;然后,計(jì)算micro-Precision和micro-Recall;最后,計(jì)算得到micro-F1。同理可得統(tǒng)計(jì)各個(gè)類別的TP、FP、FN、TN,分別計(jì)算各個(gè)類別的Precision和Recall,得到各個(gè)類別的F1值,然后取平均值得到macro-F1。

2 實(shí)驗(yàn)結(jié)果及分析

2.1 實(shí)驗(yàn)結(jié)果對(duì)比

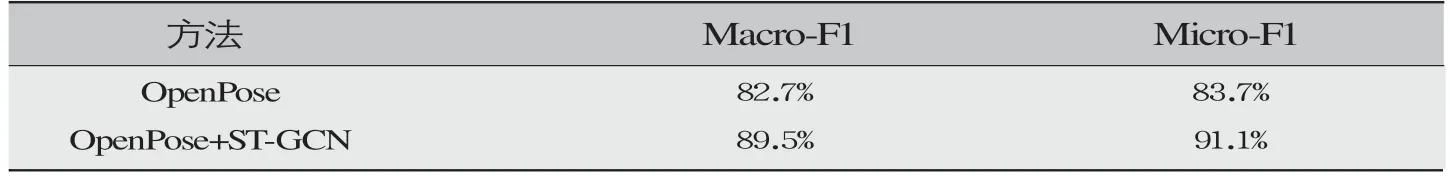

為了驗(yàn)證所提出的算法有效性,邀請(qǐng)10名6-12周歲的兒童進(jìn)行準(zhǔn)確性測(cè)試,對(duì)每位兒童的8種坐姿分別測(cè)試3次,共測(cè)試240次測(cè)試。將算法與base01 line進(jìn)行了對(duì)比,結(jié)果如表1所示,可以發(fā)現(xiàn)引入ST-GCN模型后Macro-F1和Micro-F1評(píng)分分別提高了6.8%和7.4%。

表1 兒童數(shù)據(jù)集上實(shí)驗(yàn)結(jié)果對(duì)比

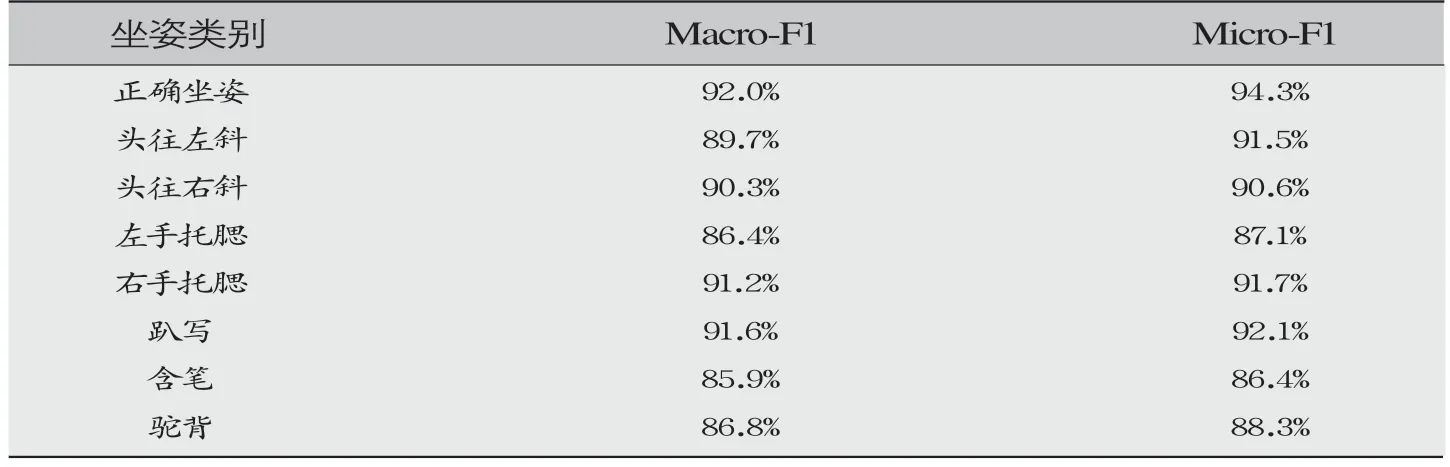

將模型輸出的分類結(jié)果按照坐姿的不同類別進(jìn)行拆分,如表2所示,本文方法識(shí)別率高且穩(wěn)定性好,可以發(fā)現(xiàn)正確坐姿、右手托腮、頭往左斜、頭往右斜、趴寫這五種坐姿的識(shí)別率相對(duì)較高。而左手托腮、含筆、駝背這三種坐姿的識(shí)別率相對(duì)較低,一種原因是這三種坐姿的動(dòng)作幅度較小,另一種原因是具有與其他類別相似的關(guān)節(jié)位置。鑒于OpenPose一共有兩種人體骨骼關(guān)節(jié)點(diǎn)的輸出方式,分別為18個(gè)關(guān)節(jié)點(diǎn)和25個(gè)關(guān)節(jié)點(diǎn),兩者主要差別在于足部關(guān)節(jié)點(diǎn)的多少。而足部關(guān)節(jié)點(diǎn)的多少對(duì)最終的識(shí)別效果并沒(méi)有太大影響。因此,為提高其余三種坐姿識(shí)別率,本文采用18個(gè)關(guān)節(jié)點(diǎn)的輸出格式,當(dāng)僅輸入上肢的關(guān)節(jié)點(diǎn)時(shí),減少了冗余信息。

表2 兒童八種坐姿分類結(jié)果評(píng)價(jià)

圖6為實(shí)驗(yàn)得到的混淆矩陣圖,其中橫行表示是數(shù)據(jù)樣本的真實(shí)標(biāo)簽,豎列表示對(duì)應(yīng)預(yù)測(cè)類別標(biāo)簽的概率,對(duì)角線為各個(gè)類別樣本標(biāo)簽預(yù)測(cè)正確的概率。從圖6中可以較為直觀地看出識(shí)別率較低的左手托腮、含筆、駝背這三種坐姿容易被錯(cuò)誤識(shí)別成其他類別,因此該場(chǎng)景下需要提取更多的特征信息來(lái)進(jìn)行更為準(zhǔn)確的分類識(shí)別,上述數(shù)據(jù)集屬于自采數(shù)據(jù),而為了完成兒童八種坐姿分類精準(zhǔn)結(jié)果評(píng)估,在研究中增加了大量的動(dòng)作種類和數(shù)據(jù)樣本來(lái)進(jìn)一步完善,以上可以說(shuō)明本研究提出的模型在目標(biāo)坐姿具有相似動(dòng)作的場(chǎng)景中識(shí)別準(zhǔn)確度僅有較少影響。

2.2 實(shí)驗(yàn)驗(yàn)證

為了充分研究模型的穩(wěn)定性,針對(duì)所提出的方法進(jìn)行了關(guān)于參數(shù)敏感度的分析實(shí)驗(yàn),研究了節(jié)點(diǎn)嵌入維度、學(xué)習(xí)率和權(quán)重衰減三個(gè)參數(shù)對(duì)于坐姿識(shí)別準(zhǔn)確性的影響,具體的參數(shù)選擇設(shè)置范圍如表3所示。

表3 參數(shù)敏感度實(shí)驗(yàn)設(shè)置范圍

針對(duì)不同參數(shù)組合設(shè)置的實(shí)驗(yàn)結(jié)果如圖7所示:發(fā)現(xiàn)本文提出模型的性能表現(xiàn)比較穩(wěn)定,最終節(jié)點(diǎn)分類的得分只在1%~2%的范圍內(nèi)波動(dòng)。對(duì)于不同節(jié)點(diǎn)嵌入維度的設(shè)置,模型的性能呈現(xiàn)出在小范圍內(nèi)先上升后下降的趨勢(shì)。因?yàn)槟P托枰粋€(gè)合適的維度來(lái)編碼輸入時(shí)空?qǐng)D上的結(jié)構(gòu)信息,而更大的維度可能會(huì)引入額外的噪聲;經(jīng)過(guò)多次實(shí)驗(yàn)測(cè)試發(fā)現(xiàn),節(jié)點(diǎn)嵌入維度按照不同模型層次進(jìn)行組合時(shí),比如前三層關(guān)節(jié)的特征維度設(shè)置64,中間三層特征維度設(shè)置128,最后三層特征維度設(shè)置256,模型的性能達(dá)到最佳。對(duì)于不同學(xué)習(xí)率和權(quán)重衰減的設(shè)置,模型的性能同樣呈現(xiàn)出小范圍先上升后下降的趨勢(shì),最優(yōu)的學(xué)習(xí)率和權(quán)重衰減參數(shù)設(shè)置值為0.01。

■圖8 學(xué)齡期兒童坐姿檢測(cè)識(shí)別最終效果圖

為了實(shí)現(xiàn)本文提出的智能兒童坐姿矯正學(xué)習(xí)桌椅設(shè)計(jì)研究的目的,進(jìn)行健康坐姿行為的引導(dǎo),進(jìn)一步提高人機(jī)交互性,將上述模型部署到智能兒童座椅上,實(shí)驗(yàn)結(jié)果如圖8所示。當(dāng)識(shí)別到目標(biāo)出現(xiàn)非正確坐姿時(shí),將調(diào)用百度AI開放平臺(tái)的語(yǔ)音合成接口進(jìn)行及時(shí)提醒,當(dāng)系統(tǒng)連續(xù)3次檢測(cè)到同一不正確的坐姿時(shí),將語(yǔ)音播報(bào)提醒用戶。考慮到實(shí)際工作學(xué)習(xí)中不宜過(guò)于頻繁地提醒用戶坐姿,系統(tǒng)每隔60s進(jìn)行一次檢測(cè),引導(dǎo)兒童調(diào)整坐姿。

3 結(jié)語(yǔ)

本研究針對(duì)學(xué)齡期兒童這類特殊人群的需求,基于圖卷積網(wǎng)絡(luò)搭建姿態(tài)估計(jì)和動(dòng)作識(shí)別的混合模型,借助OpenPose提取人體骨骼關(guān)鍵點(diǎn)坐標(biāo)并利用ST-GCN進(jìn)行動(dòng)作分類和識(shí)別,獲取兒童學(xué)習(xí)過(guò)程中的行為特征,對(duì)讀寫坐姿行為分類進(jìn)行定義、訓(xùn)練與驗(yàn)證。通過(guò)建立學(xué)習(xí)坐姿數(shù)據(jù)集,有效識(shí)別出八種坐姿狀態(tài),使得坐姿識(shí)別準(zhǔn)確率和魯棒性得到大幅提升,并證實(shí)了對(duì)矯正兒童坐姿的有效性和可行性。實(shí)驗(yàn)結(jié)果可為具有坐姿提示功能的兒童桌椅的設(shè)計(jì)提供參考,引導(dǎo)學(xué)生培養(yǎng)健康的坐姿習(xí)慣。