用于SAR圖像艦船目標(biāo)檢測(cè)的MAF-Net和CS損失

張麗麗,蔡健楠,劉雨軒,屈樂樂

(沈陽航空航天大學(xué)電子信息工程學(xué)院,遼寧沈陽 110136)

0 引 言

合成孔徑雷達(dá)(Synthetic Aperture Radar,SAR)具有高分辨率、全天時(shí)、全天候工作等特點(diǎn)[1],相比于傳統(tǒng)光學(xué)傳感器,其在海洋監(jiān)測(cè)等任務(wù)中擁有更大的優(yōu)勢(shì)。基于SAR 圖像的艦船目標(biāo)檢測(cè)任務(wù)在海上巡邏和監(jiān)測(cè)、海上交通管理、海上搜索和救援等領(lǐng)域中具有重要作用,在軍用和民用領(lǐng)域均有廣泛的應(yīng)用場景[2]。

對(duì)于傳統(tǒng)的SAR 艦船檢測(cè)方法,恒虛警率(Constant False Alarm Rate,CFAR)[3-5]算法由于其較低的算法復(fù)雜度而被廣泛使用。其原理是估計(jì)表面雜波的概率密度函數(shù),并根據(jù)預(yù)先設(shè)定的虛警率自適應(yīng)地調(diào)整檢測(cè)閾值。然而在近岸場景下,陸地區(qū)域的背景較為復(fù)雜,這使得雜波建模和閾值設(shè)定變得困難,導(dǎo)致檢測(cè)性能降低。最近,隨著深度學(xué)習(xí)的發(fā)展,SAR 圖像艦船目標(biāo)檢測(cè)的準(zhǔn)確率得到了進(jìn)一步的提高。文獻(xiàn)[6]提出了一種無錨框的功率變換和特征對(duì)齊引導(dǎo)網(wǎng)絡(luò)(Power Transformation and Feature Alignment-guided Network,Pow-FAN),它包含了用于抑制噪聲的PCB(power-based convolution block)模塊和用于特征融合的FAB(feature alignment block)模塊。為了抑制噪聲和復(fù)雜背景的影響,文獻(xiàn)[7]設(shè)計(jì)了跨尺度自注意力模塊,除此之外,還提出了區(qū)域預(yù)測(cè)感知一對(duì)一標(biāo)簽分配以挑選最合適的正負(fù)樣本。文獻(xiàn)[8]基于協(xié)調(diào)注意模塊[9]提出了一個(gè)CSPMRes2(cross stage partial network with a modified res2net)模塊,并將其應(yīng)用于YOLOv5 網(wǎng)絡(luò)中,取得了較好的效果。文獻(xiàn)[10]提出了注意力引導(dǎo)的平衡特征金字塔網(wǎng)絡(luò)(Attention-guided Balanced Feature Pyramid Network,A-BFPN)并設(shè)計(jì)了通道注意力引導(dǎo)的融合網(wǎng)絡(luò)模型,在利用語義和多級(jí)互補(bǔ)特征的同時(shí)緩解特征圖融合過程中的混疊效應(yīng)。文獻(xiàn)[11]為提高對(duì)密集目標(biāo)的檢測(cè)能力提出了關(guān)鍵點(diǎn)估計(jì)模塊,并設(shè)計(jì)通道注意力模塊減少噪聲對(duì)艦船目標(biāo)的干擾。文獻(xiàn)[12]設(shè)計(jì)一個(gè)AFF(adjacent feature fusion)模塊減少了由于注意力分散導(dǎo)致的不同尺度特征之間的信息差異,同時(shí)將AFF 和swin Transformer[13]結(jié)合提出了ESTD-NET(enhancement Swin transformer detection network),進(jìn)一步提高檢測(cè)精度。上述方法都通過注意力模塊提高網(wǎng)絡(luò)的特征提取能力。然而,文獻(xiàn)[6,8,10-11]的注意力機(jī)制較為簡單,注意力結(jié)果不理想。文獻(xiàn)[7]和[12]中使用的基于transformer 的注意力機(jī)制雖然可以取得較好的效果,但計(jì)算量較大。此外,在SAR 圖像中,斑點(diǎn)噪聲、近岸場景下的陸地背景均會(huì)影響檢測(cè)結(jié)果,使艦船目標(biāo)被漏檢或者將陸地區(qū)域誤檢為目標(biāo)。

為了解決上述問題,本文提出了多尺度特征注意力融合網(wǎng)絡(luò)(Multi-scale Attention Fusion Network,MAF-Net),其包含MFAF(multi-scale feature attention fusion)模塊和余弦相似(Cosine Similar,CS)損失。MFAF 模塊用于對(duì)FPN(Feature Pyramid Network)輸出的3 個(gè)不同尺度特征圖進(jìn)行增強(qiáng),通過融合深層的語義信息,增強(qiáng)了對(duì)噪聲的抑制效果,從而提高了檢測(cè)的準(zhǔn)確率。CS 損失在訓(xùn)練過程中計(jì)算目標(biāo)與非目標(biāo)區(qū)域的余弦距離,并在訓(xùn)練過程中讓此距離減小,以增強(qiáng)網(wǎng)絡(luò)對(duì)目標(biāo)的識(shí)別精度。

1 MFAF模塊

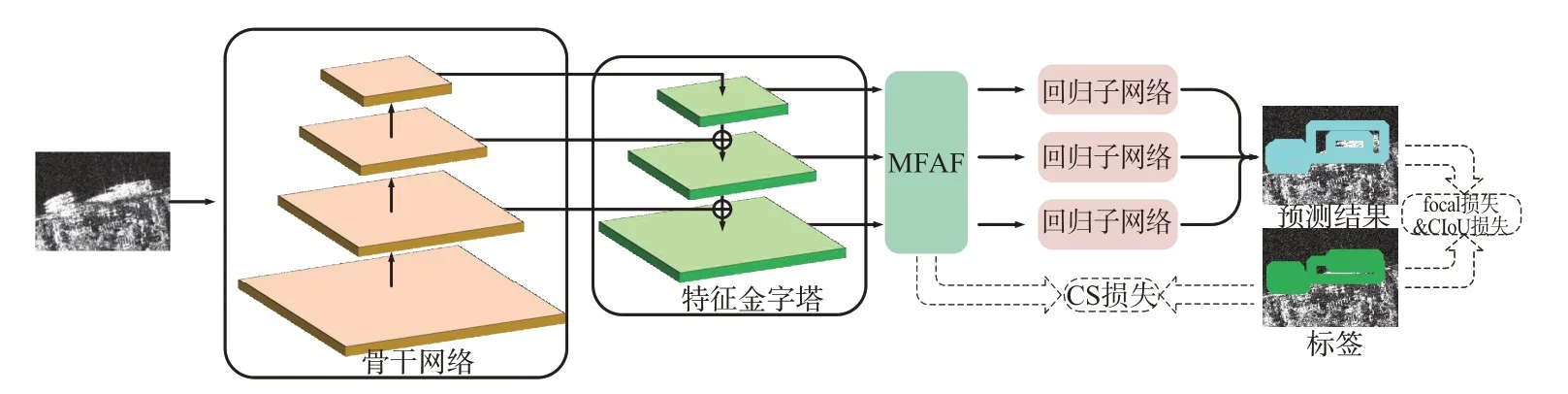

本文基于FCOS(fully convolutional one-stage object detection)[14]提出了MAF-Net,其結(jié)構(gòu)如圖1所示,該網(wǎng)絡(luò)包含4個(gè)部分:主干網(wǎng)絡(luò)、MFAF模塊、FPN和分類回歸子網(wǎng)絡(luò)。其中MFAF模塊對(duì)FPN輸出的特征圖進(jìn)行增強(qiáng)。并且使用focal損失、CIoU[15]損失和CS損失進(jìn)行訓(xùn)練。

圖1 MAF-Net網(wǎng)絡(luò)結(jié)構(gòu)

在SAR 圖像中,艦船目標(biāo)的長寬比普遍較為極端,且船只朝向不固定。因此在特征圖中,艦船目標(biāo)對(duì)應(yīng)的位置很容易包含較多的背景信息,從而對(duì)檢測(cè)結(jié)果造成干擾,影響精度。此外,由于分辨率以及拍攝角度的不同,SAR 艦船目標(biāo)的尺寸跨度較大。單一的特征金字塔網(wǎng)絡(luò)結(jié)構(gòu)較為簡單,不能充分地利用每個(gè)尺度的特征中的信息。在近岸場景下,陸地背景復(fù)雜,部分島嶼與艦船目標(biāo)的形狀相似,因此會(huì)造成誤檢,同時(shí)部分艦船目標(biāo)離陸地較近且排列密集,易受到噪聲的影響,從而導(dǎo)致漏檢。所有這些問題都將導(dǎo)致網(wǎng)絡(luò)檢測(cè)性能受到限制。為了解決上述問題,本文提出了MFAF 模塊。其結(jié)構(gòu)如圖2 所示。該模塊使用不同尺度間的信息對(duì)FPN 輸出的特征圖進(jìn)行增強(qiáng),以提升網(wǎng)絡(luò)的特征提取能力,抑制噪聲對(duì)艦船目標(biāo)的干擾。,i= 3,4,5 是從FPN 輸出的特征圖,其中X5和X3分別是FPN 輸出的最深層特征和最淺層特征,通道數(shù)為256,Hi、Wi分別為特征圖的高和寬。首先對(duì)特征圖X5在空間上分別使用最大池化和平均池化操作,隨后將結(jié)果送入MLP 模塊以得到和。然后通過和對(duì)特征圖X5進(jìn)行通道維度上的增強(qiáng)。對(duì)于其他的特征Xi,i= 3,4,先經(jīng)過空間上的最大池化和平均池化操作,然后將結(jié)果與和分別相加后再送入MLP模塊中。其公式可以表示如下:

式中,X'i∈?Ci×Hi×Wi,i= 3,4,5 為經(jīng)過通道增強(qiáng)后的特征,BD()為廣播操作,·表示按元素相乘。

MLP 是層數(shù)為2 的多層感知機(jī)。將經(jīng)過通道增強(qiáng)后的特征圖X'5在通道維度上分別取最大值和平均值,隨后將結(jié)果在通道維度進(jìn)行拼接得到,然后將送入SCAM 模塊以得到,然后使用對(duì)X'5進(jìn)行空間上的增強(qiáng)。對(duì)于其他的特征X'i,i= 3,4,將通道維度的最大值和平均值拼接后,再分別與相加來得到,i= 3,4,然后再將送入SCAM 模塊以得到。其公式可以表示如下:

2 CS損失

SAR 圖像中的陸地背景較為復(fù)雜,且部分船只受噪聲影響較大,因此網(wǎng)絡(luò)很難有效地區(qū)分背景與艦船目標(biāo)之間的差異,導(dǎo)致檢測(cè)結(jié)果較差。為了引導(dǎo)網(wǎng)絡(luò)學(xué)習(xí)艦船目標(biāo)與背景之間的差異,本文提出了CS損失。其目的是使特征圖中包含目標(biāo)的區(qū)域與不包含目標(biāo)的區(qū)域的相似度盡可能的低,從而減少背景與目標(biāo)的混淆。X∈?1×H×W表示輸入的圖片。X上屬于第k個(gè)目標(biāo)的標(biāo)簽框內(nèi)的位置集合可以表示為

式中:chk,cwk分別表示第k個(gè)目標(biāo)框的中心位置;bhk,bwk表示k個(gè)目標(biāo)框的高和寬;d是用于調(diào)整Pk,d中包含區(qū)域的大小。Pd={p1,d,p2,d,…,pn,d}表示X上所有目標(biāo)框內(nèi)的位置集合,n是X上目標(biāo)的個(gè)數(shù)。

相應(yīng)地,X″i∈?Ci×Hi×Wi,i= 3,4,5 上包含在目標(biāo)框內(nèi)的位置集合Ωi和不包含在目標(biāo)框內(nèi)的位置集合Γi可以表示為

式中di表示特征圖X″i所對(duì)應(yīng)的理論感受野大小。CS損失的公式如下:

式中 |Ωi|和 |Γi|分別為集合Ωi和Γi的大小,‖ . ‖2表示向量的二范數(shù),X″i,p∈?Ci×1×1表示特征圖X″i上位置p對(duì)應(yīng)的向量。因此網(wǎng)絡(luò)的分類損失可以表示為

式中Lfocal為focal 損失,超參數(shù)α用于調(diào)整CS 損失占比,其被設(shè)置為0.5時(shí)可以達(dá)到最佳結(jié)果。

3 實(shí)驗(yàn)與討論

3.1 數(shù)據(jù)集與實(shí)驗(yàn)設(shè)置

1)數(shù)據(jù)集

Official-SSDD(SSDD):SSDD 數(shù)據(jù)集[16-17]是SAR 船舶檢測(cè)領(lǐng)域使用最廣泛的數(shù)據(jù)集。于2017年第一次發(fā)布,并在2021 年發(fā)布了更新版。SSDD數(shù)據(jù)集包含多尺度目標(biāo)并且背景復(fù)雜,大多數(shù)圖片大小為500 像素寬,分辨率從1 m 到15 m 不等,來自RadarSat-2、TerraSAR-X 和Sentinel-1,包含多種極化方式(HH、VV、VH 和HV)。SSDD 中船舶的平均尺寸僅為約35×35像素。

SAR-Ship-Dataset:2019 年,Wang 等人發(fā)布了SAR 船舶數(shù)據(jù)[18]。它包含43 819 張圖像,圖像大小為256×256,主要來自Sentinel-1和高分-3。其具有5 m 至20 m 的分辨率,以及HH、HV、VV 和VH極化。與文獻(xiàn)[18]中的設(shè)置相同,整個(gè)數(shù)據(jù)集被隨機(jī)分為訓(xùn)練(70%)、驗(yàn)證(20%)和測(cè)試數(shù)據(jù)集(10%)。

2)實(shí)現(xiàn)細(xì)節(jié)

骨干網(wǎng)絡(luò)采用ResNet50,并且使用ImageNet數(shù)據(jù)集對(duì)其進(jìn)行預(yù)訓(xùn)練。然后通過COCO 數(shù)據(jù)集對(duì)整個(gè)網(wǎng)絡(luò)進(jìn)行預(yù)訓(xùn)練。本文使用15 vCPU Intel(R)Xeon(R)Platinum 8358P CPU@2.60GHz,NVIDIA RTX 3090 顯卡。使用的編程語言是python3.9,深度學(xué)習(xí)框架為PyTroch1.8.1。GPU 計(jì)算平臺(tái)為CUDA 11.1。優(yōu)化器是初始學(xué)習(xí)率為0.01的隨機(jī)梯度下降(SGD)優(yōu)化器,其學(xué)習(xí)率在每個(gè)衰減步驟被除以10。SSDD 和SAR 船舶數(shù)據(jù)集的迭代次數(shù)分別為16K 和32K。所有的圖片尺寸均被縮放為512×512,為了公平地與其他方法進(jìn)行比較,訓(xùn)練階段使用的數(shù)據(jù)增強(qiáng)方法只包括隨機(jī)反轉(zhuǎn)以避免過擬合。

3.2 驗(yàn)證評(píng)價(jià)指標(biāo)

為了定量地分析所提方法的有效性,本文使用目標(biāo)檢測(cè)領(lǐng)域中廣泛使用的平均精度(AP)當(dāng)做驗(yàn)證指標(biāo)。AP的計(jì)算方法如下:

式中Pd和Rd分別為準(zhǔn)確率和召回率,其計(jì)算方式如下:

其中d是IoU 閾值,對(duì)于網(wǎng)絡(luò)輸出的一個(gè)樣本,其回歸框與標(biāo)簽框的IoU 大于d時(shí),該樣本定義為TPd;否則,該樣本定義為FPd。對(duì)于某一個(gè)標(biāo)簽框來說,如果沒有網(wǎng)絡(luò)輸出的樣本與其IoU大于d,則將其定義為FNd。AP為d取0.5 到0.95 時(shí)APd的平均值:

此外,按照目標(biāo)所占像素區(qū)域的大小可以分為大目標(biāo)(大于962)、中目標(biāo)(大于322 并且小于962)和小目標(biāo)(小于322)。分別計(jì)算大、中和小目標(biāo)的AP,將所得結(jié)果分別定義為APL、APM 和APS。

3.3 消融實(shí)驗(yàn)

為了驗(yàn)證所提出的MFAF 模塊和CS 損失的有效性,本文以不同的設(shè)置在SSDD數(shù)據(jù)集上對(duì)MAFNet進(jìn)行訓(xùn)練。消融實(shí)驗(yàn)的結(jié)果如表1所示。

由于FCOS 網(wǎng)絡(luò)的特征提取能力較弱,因此只能達(dá)到96.5% AP50,通過添加了MFAF 模塊以后,提升了網(wǎng)絡(luò)的特征提取能力,針對(duì)所有尺度的目標(biāo)的檢測(cè)能力均有所提升,使AP50達(dá)到了97.4%。在FCOS 的訓(xùn)練階段中添加CS 損失可以有效地引導(dǎo)網(wǎng)絡(luò)針對(duì)目標(biāo)與背景之間的差異進(jìn)行學(xué)習(xí),從而提高準(zhǔn)確率,可達(dá)97.4% AP50。聯(lián)合使用MFAF模塊和CS 損失可以達(dá)到最佳的結(jié)果,提升了1.7% AP50,可達(dá)98.2% AP50。并且在所有尺度上的AP50均可以達(dá)到最佳。額外地,通過添加MFAF模塊后網(wǎng)絡(luò)的檢測(cè)速度僅降低了8%,依舊可以滿足對(duì)網(wǎng)絡(luò)的實(shí)時(shí)性的要求。

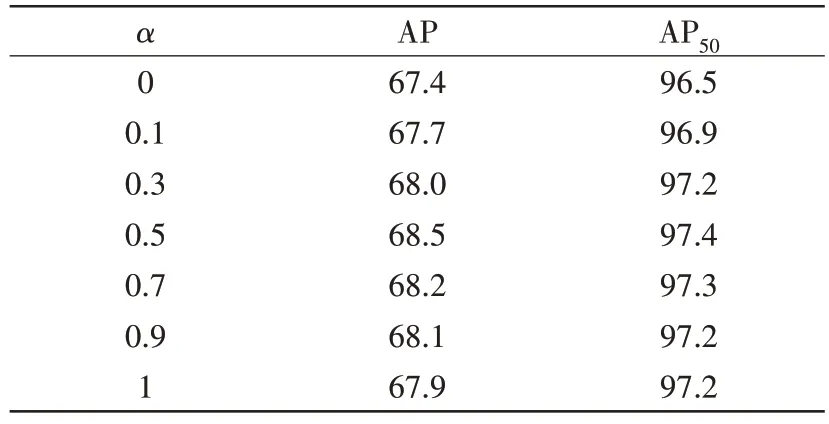

為了進(jìn)一步驗(yàn)證CS 損失的有效性,并確定最佳的超參數(shù),本文使用占比不同的CS損失在SSDD數(shù)據(jù)集上對(duì)FCOS進(jìn)行訓(xùn)練,其結(jié)果如表2所示,其中超參數(shù)α用于調(diào)整CS 損失的占比。當(dāng)α為0 時(shí)相當(dāng)于不添加CS 損失。其AP50為最低的96.5%。通過添加占比不同的CS損失后,均能提高AP50,當(dāng)α為0.5時(shí)可以取得最佳的97.4% AP50。

表2 在SSDD上不同參數(shù)α的檢測(cè)結(jié)果

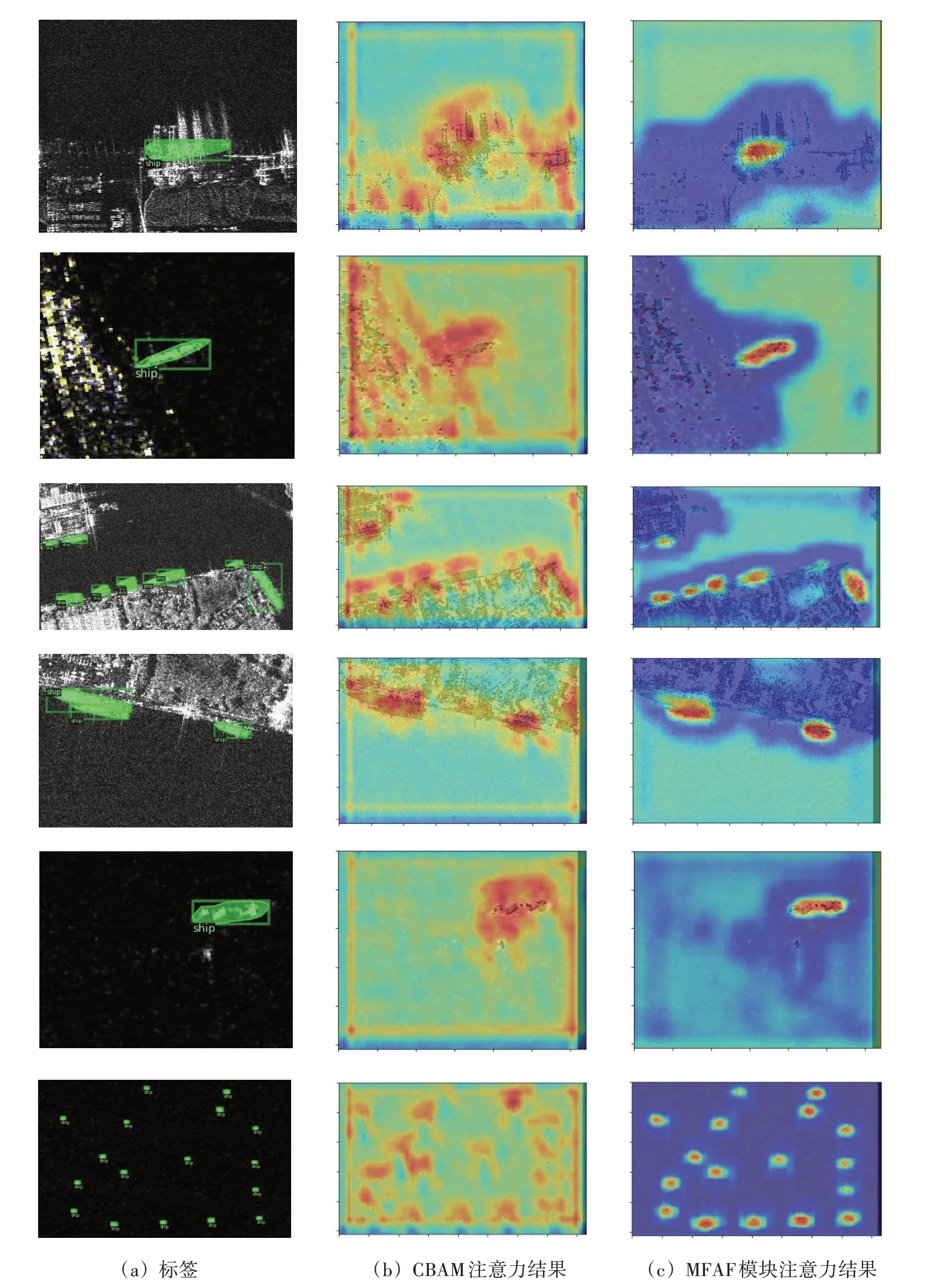

為了直觀地展示MFAF模塊的作用,網(wǎng)絡(luò)注意力可視化結(jié)果如圖3所示。其中圖3(a)為標(biāo)簽,圖3(b)為僅使用CBAM 模塊的注意力結(jié)果,圖3(c)為MFAF 模塊的注意力結(jié)果。如圖3(b)中前4 行所示,當(dāng)僅用CBAM 模塊時(shí),在近岸場景下,網(wǎng)絡(luò)注意的位置會(huì)受到陸地背景的干擾。而在深海場景下,網(wǎng)絡(luò)注意的位置不能很好地集中在艦船目標(biāo)上,注意力較為分散,如圖3(b)中后兩行所示。當(dāng)使用MFAF模塊時(shí),網(wǎng)絡(luò)注意的位置受到陸地的干擾較小,并且注意力的結(jié)果可以很好地集中在艦船目標(biāo)上,從而可以取得較好的檢測(cè)結(jié)果。

圖3 網(wǎng)絡(luò)注意力結(jié)果圖

3.4 與其他方法的比較和討論

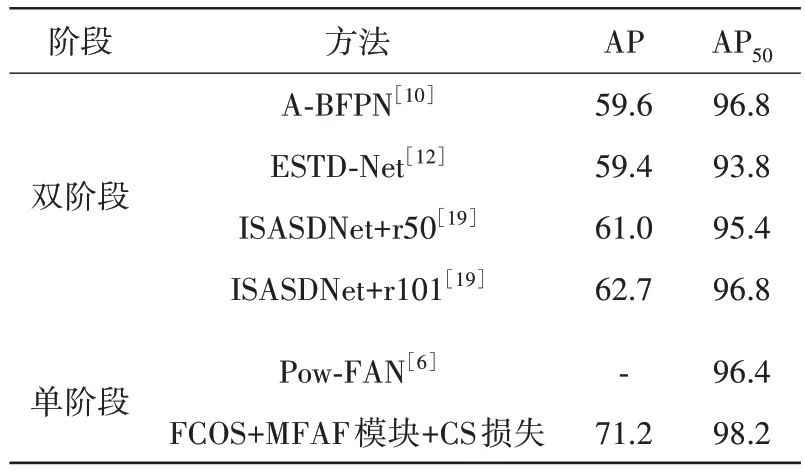

本文所提的MAF-Net 與其他方法的比較如表3和表4所示,MAF-Net在SSDD和SAR-Ship-Dataset中均可以取得最佳的AP50。在SSDD 數(shù)據(jù)集上,MAF-Net 可以達(dá)到最佳的98.2% AP50,與雙階段和單階段最佳的A-BFPN 和Pow-FAN 相比,分別提高了1.4% AP50和1.8% AP50。對(duì)于SAR-Ship-Dataset,MAF-Net 達(dá)到了最佳的96.5% AP50,與雙階段網(wǎng)絡(luò)中性能最佳的ISASDNet+r101 相比,提高了0.7% AP50。與單階段網(wǎng)絡(luò)中的MSSD-Net 相比,提高了1.4% AP50。作為單階段網(wǎng)絡(luò),MAF-Net不僅在單階段網(wǎng)絡(luò)中有最佳的性能,還可以獲得比雙階段網(wǎng)絡(luò)更佳的檢測(cè)結(jié)果。

表3 SSDD上的對(duì)比實(shí)驗(yàn)結(jié)果

表4 SAR-Ship-Dataset上的對(duì)比實(shí)驗(yàn)結(jié)果

4 結(jié)束語

為了解決SAR 圖像中艦船目標(biāo)檢測(cè)精度不高的問題。本文提出了一個(gè)單階段無錨框的MAFNet。其中包含的MFAF 模塊使用不同尺度特征中的信息對(duì)特征進(jìn)行空間和通道維度的增強(qiáng),可以有效提升網(wǎng)絡(luò)的表達(dá)能力,抑制背景噪聲的干擾,從而提高網(wǎng)絡(luò)的檢測(cè)準(zhǔn)確度。此外,本文提出了一個(gè)CS損失,在訓(xùn)練過程中添加CS損失可以使網(wǎng)絡(luò)更清晰地區(qū)分目標(biāo)與背景之間的差異。通過在兩個(gè)數(shù)據(jù)集上的實(shí)驗(yàn)表明,MAF-Net 使用的MFAF模塊和CS 損失均可以有效地提升檢測(cè)精度,并且MAF-Net與其他方法相比,擁有更佳的準(zhǔn)確率。在未來,為了方便模型的部署,可以從模型剪枝的角度出發(fā),在不影響模型準(zhǔn)確率的前提下去除網(wǎng)絡(luò)中冗余的參數(shù),提高網(wǎng)絡(luò)的運(yùn)行速度。