基于“技術道德化”理論的生成式人工智能教育應用潛能與風險研究

童慧 楊彥軍

基金項目:江西省社會科學“十四五”基金項目2024年度課題“基于‘技術道德化視角的生成式人工智能應用潛能與風險研究”(項目編號:24JY17);江西科技師范大學2022年度教學改革課題“混合式課程中過程性學習評價改革與實踐”(課題編號:202/6000011842)

[摘? ?要] 隨著生成式人工智能的快速發展及其在教育領域的廣泛應用,國內外研究者圍繞它及其背后的大語言模型教育應用問題展開了熱烈的討論,但大部分研究因缺乏對生成式人工智能技術原理的了解而在問題探討中存在伊莉莎效應。研究首先在對生成式人工智能技術學原理進行深入剖析的基礎上,從維貝克“人—技雜合”視角對生成式人工智能的本質展開技術哲學分析;其次,基于“技術道德化”理論分析了生成式人工智能教育應用的四大潛能和面臨的五大風險挑戰;最后,提出基于“人—技雜合”的思想從“設計者”和“使用者”兩種視角構建“雙向奔赴”的全球人工智能治理體系,將成為未來探索的重要方向。

[關鍵詞] 生成式人工智能; 技術道德化; 大模型; 人—技雜合; 應用風險

[中圖分類號] G434? ? ? ? ? ? [文獻標志碼] A

[作者簡介] 童慧(1987—),女,回族,甘肅平涼人。副教授,博士,主要從事教育技術學基本理論研究與計算機支持的協作學習研究。 E-mail: leiyuth@126.com。

一、引? ?言

隨著生成式人工智能(Generative Artificial Intelligence, 以下簡稱GAI)的快速發展及其在教育領域的廣泛應用,國內外學者圍繞GAI及其背后的大語言模型教育應用展開了熱烈的討論。“GAI對教育領域將會產生怎樣的影響”“GAI時代人類教師將會遇到哪些挑戰”等問題成為熱點議題。技術樂觀主義者認為,它將徹底變革人類學習方式和教育模式,因而成為GAI教育應用的積極推動者和探索實踐者;技術悲觀主義者認為,它的應用不但會帶來抄襲、學術造假、教師失業等問題,還會導致學生因缺乏思考而喪失其主體性,因而常采用抵制或批判的態度;還有部分技術中性主義者認為,它的出現和以前教育技術發展史上的其他技術變革教育的預言一樣,終將消失在教育技術發展的歷史長河中。雖然技術樂觀主義者和技術悲觀主義者分析問題的視角和得出的觀點截然相反,但深入分析后發現,大部分研究者的觀點背后都充斥著對GAI“黑箱”的過度遐想,其中,有些研究者以自己想象的GAI為出發點討論問題;技術中性論者看似客觀冷靜,但實則存在因循守舊之嫌,缺乏對GAI新產品及其影響的審慎思考和分析。GAI實際上能夠做什么,它在教育中應用的潛能有哪些,它的教育應用存在哪些風險挑戰,人類該如何面對GAI,要深入解答這些問題,不但要深入GAI“黑箱”分析其技術原理,還應當從人—技關系的底層邏輯展開哲學思考,深刻審視人、技術與倫理道德的關系。

二、生成式人工智能的技術學原理探析

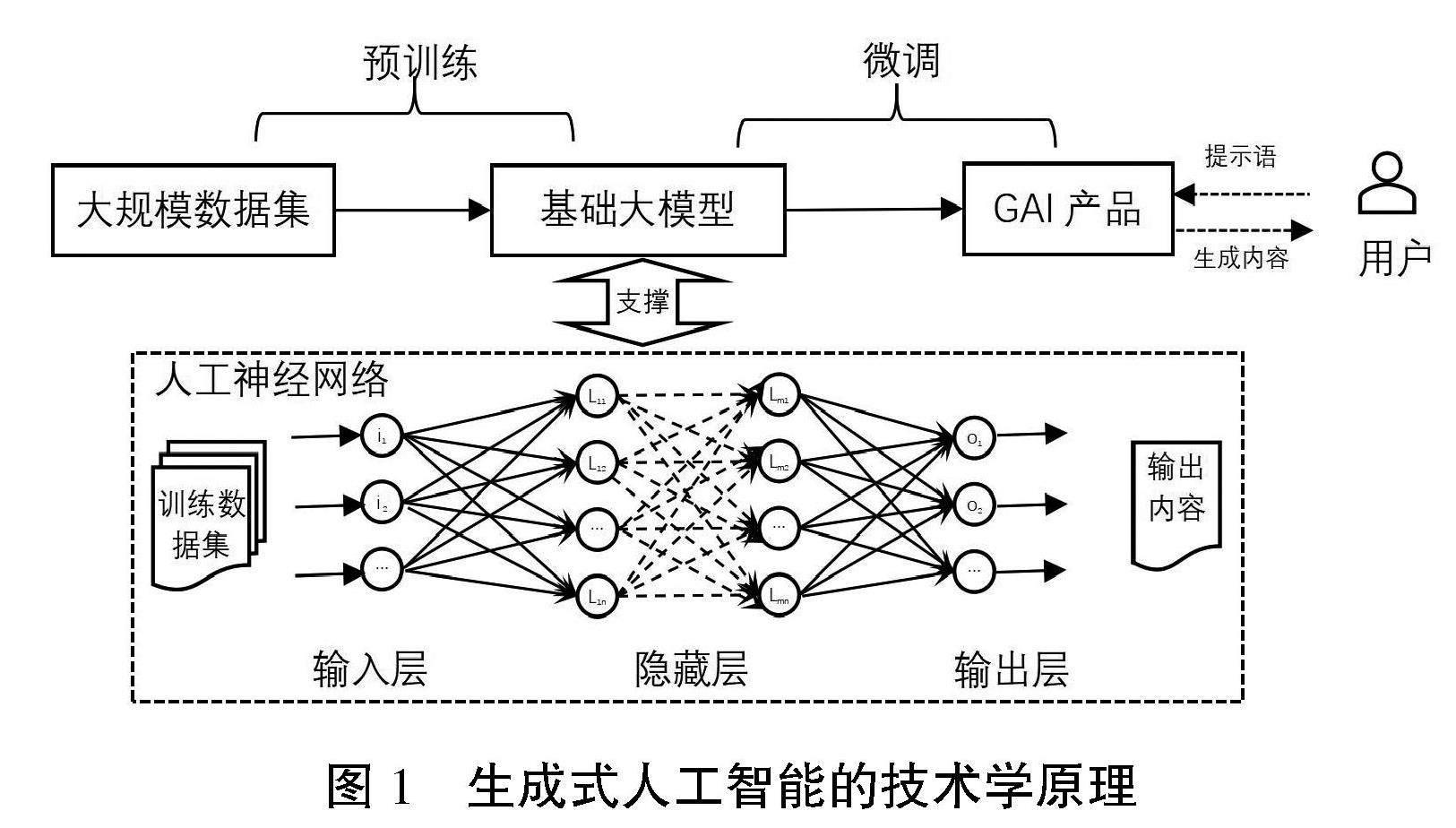

當前對GAI應用潛能及其風險的討論大多存在伊莉莎效應(Eliza Effect),即由于人們對機器缺乏足夠的理性認識而產生的用“擬人化”思維去理解機器及其行為的現象,更傾向于下意識地將人類情感和意圖賦予機器,認為機器和人類的行為機理與模式類似[1]。要深入思考和探討GAI的應用潛能、風險挑戰等問題,需要對其運行原理進行必要了解。本文所指的GAI是指能夠根據用戶的提示信息自動生成文本、圖片、音頻、視頻等內容的計算機程序[2]。根據生成內容的不同,GAI可分為文本生成、圖片生成、音頻生成、視頻生成、代碼生成及多模態生成等類型。不同類型的GAI在可接受的輸入信息、可輸出的內容類型、內部處理機制復雜程度及具體算法方面存在較大差異,但其基本工作原理具有相似之處。簡單地講,能夠為公眾提供服務的各類GAI都是建立在相應的大型或基礎模型之上的計算機程序,即其底層支撐技術為大模型(Big Model)或基礎模型(Foundation Models)。例如,ChatGPT背后的GPT模型、文心一言背后的ERNIE Bot模型、通義千問背后的Qwen模型等。大模型是指具備大規模參數和復雜計算結構的機器學習模型,可以簡單地理解為一套復雜的計算機程序,它由一系列實現復雜算法的函數及相應參數列表構成。所有的大模型都具備自我學習和生成輸出兩項基本功能,自我學習是完成大模型訓練的過程,生成輸出是完成大模型應用的過程。當前主流的大模型都是基于深度人工神經網絡算法實現的,屬于機器學習中的連接主義技術路線。人工神經網絡就是模擬人類大腦中的神經元運作模式的計算機系統,其中的參數描述神經元之間連接的權重,模型訓練的過程就是通過讓程序學習大量訓練數據集并掌握背后存在的關聯規律,進而動態調整每個神經元連接之間的連接權重將關聯規律表征為參數的過程,最終使得該計算機程序可以輸出與訓練數據相似的或模型開發人員期望得到的新數據的過程[3]。如圖1所示,支撐基礎大模型的底層人工神經網絡由一個個的神經元構成,每個神經元之間的連接權重即一個參數。神經元可分為輸入層、輸出層和隱藏層,其中,隱藏層的數量決定了神經網絡的深度,進而決定了神經網絡的學習能力及模型的參數規模。由于模型訓練過程需要花費大量的時間,經常采用預先訓練的技術路線使其具備相關輸出能力,因此,大模型也常稱為預訓練大模型。值得強調的是,模型預訓練階段使用何種數據集將直接決定模型輸出內容的特征。例如,使用教育學相關數據集訓練的模型將生成具備教育學學科特色的話語。預訓練完成的基礎大模型雖然具備了相應類型內容輸出的基本功能,但輸出的內容共性有余而特色不足,常常難以獲得良好的實際應用體驗。因此,需要根據實際應用場景(即下游任務)再對基礎大模型進行微小調整(即微調)以形成具備特定功能的GAI產品。例如,訓練一個教育技術學專業智能導師,通過大量通用文本數據集預訓練的基礎模型使其具備自動生成類人語言的基本功能——即“會說話”;如果想讓其輸出具備教育技術學專業知識、乃至某個導師個人話語風格的指導語言——即“說專業的話”,還需要對基礎大模型進行微調以開發具備特色功能的GAI產品。常見的微調技術有基于人類反饋的強化學習、提示學習等,前者通過人類標注者對模型的輸出質量進行排序來訓練獎勵模型以優化內容生成策略,后者通過讓模型學習提問附加答案配對數據使得模型的生成內容更符合用戶要求。無論采用何種策略,模型微調的過程就是能夠讓模型輸出更符合人類偏好或特定價值取向內容的過程。模型訓練完成后,用戶使用GAI的過程實際上是通過“提問”或“指令”觸發模型的輸出功能,從而輸出類人語言或其他期望得到的多模態信息的過程。同時,用戶的使用行為及產生的過程性數據也已經被用來優化基礎模型,即用戶使用行為對基礎模型具有反向塑造作用。

圖1? ?生成式人工智能的技術學原理

綜上所述,GAI的技術學本質就是一個復雜的計算機程序,核心是一個多層次的復雜人工神經網絡。GAI的預訓練過程就是利用大規模數據集對神經網絡進行“通識教育”的調整神經元連接參數的過程,微調過程就是利用特色數據集對神經網絡進行“專業教育”的實現特色功能的過程,最終目的是讓人工神經網絡可以具備開發者期望的輸出能力,這種輸出能力的本質實際上是根據統計或關聯規律連續輸出基本信息表達單元的過程。例如,文字生成是按照得到的統計規律生成文字序列,圖片生成是按照相關規律生成像素序列,視頻生成是按照相關規律生成圖像序列等。用戶使用GAI的過程就是通過“提問”等互動方式觸發神經網絡輸出的過程。可以看出,整個模型訓練的過程就是對該人工神經網絡進行“教育”的過程,訓練階段使用的數據集、算法和微調策略、意識形態、價值傾向都將影響模型的最終輸出“表現”。

三、基于“技術道德化”理論的生成式

人工智能本質分析

(一)維貝克“技術道德化”理論要義

人類的進化與技術的發展密不可分,人本身就是一種技術性存在。古希臘時期的阿那克薩戈拉就認為,人在體力和敏捷性上比不上野獸,但人能使用自己的經驗、記憶、智慧和技術[4]。法國哲學家貝爾納·斯蒂格勒指出,人類自起源就是“缺陷存在”,因此,需要創造技術作為“代具”來彌補人類先天缺陷[5]。現象學技術哲學家唐·伊德(Don Ihde)認為技術并非自然存在,不能以本質主義的視角出發理解技術,而應當立足人類發展歷史和人類勞動實踐活動,從人與技術、自然的關系中把握技術,伊德基于“人—技互補”的視角將人—技關系歸為具身、解釋、他異和背景四種[6]。布魯諾·拉圖爾(Bruno Latour)則更加關注技術人工物對人行動的影響,基于“人—技對等”的視角認為,人與技術人工物都是行動網絡中對稱的行動者而相互交織、互塑共生,技術人工物通過“腳本”激勵或抑制人的行為。荷蘭技術哲學家彼得·保羅·維貝克(Peter-Paul Verbeek)則進一步將人—技關系的認識推向了新的高度,基于“人—技雜合”的視角提出了技術道德化理論,對當前深入理解人—技關系相關問題開辟了新的視野[7]。“技術道德化理論”由“技術調節”理論和“道德物化”理論兩部分構成,前者側重于對技術本質與功能的理解,后者側重于對技術倫理問題的反思。維貝克認為,技術在人類世界不單單是中性的手段或工具,技術與人是相互塑造、糾纏的關系,技術具有物質意義上的“道德能動性”,從而對人的精神和行為具有不可忽視的塑造與影響的“調節”作用,并據此提出“技術調節”理論[7] 。蘭登·溫納(Langdon Winner)的技術政治理論認為,技術在前期設計和部署中潛藏著對政治秩序的影響,在技術的使用之前以一種物質的方式體現著人們的意圖[8]。維貝克在此基礎上發展出一種更加內在的“技術伴隨”的倫理學,認為技術在設計時就已經嵌入了倫理考量,從而影響著人們對技術的使用和決策,這種人—技伴隨的行動倫理學強調技術與人共同發揮倫理作用,技術在調節過程中具備了道德性,據此形成了“道德物化”理論[7]。維貝克在整合了技術哲學“經驗轉向”和“倫理轉向”兩次轉向的基礎上,將技術倫理的討論放在人—技雜合體中進行,提出了“技術調節”理論和“道德物化”理論,實現了技術哲學的第三次轉向——“道德轉向”[9]。

(二)基于“人—技雜合”視角的GAI本質探析

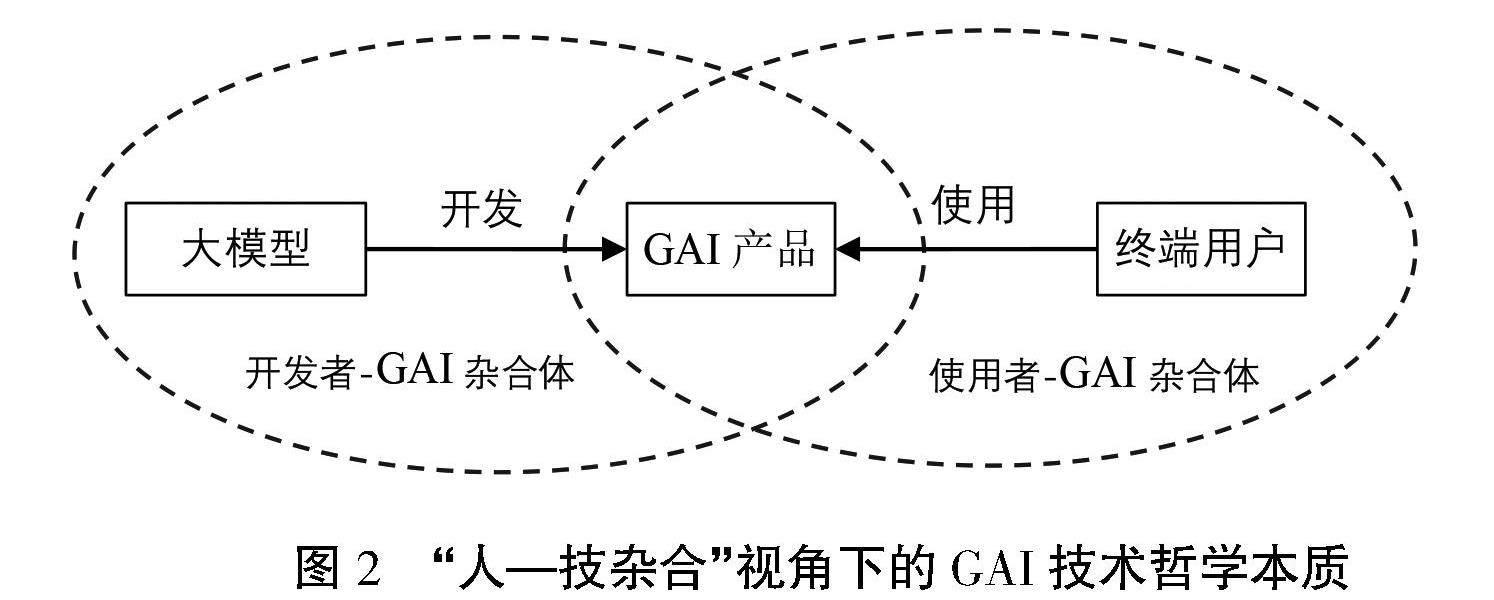

從維貝克技術道德化理論“人—技雜合”視角來看,GAI在開發階段構成“開發者—GAI雜合體”技術調節主體,GAI是技術開發人員本質力量的外化,在這個“外化”的過程中既是一個開發者對其網絡信息搜索與處理能力“編碼”的過程,也是一個開發者意識形態與價值觀“道德物化”的過程,開發者在GAI模型訓練過程中用什么來源的數據、用什么類型的算法、用什么微調規則,均體現著開發者的價值取向與偏好。在使用階段則構成“使用者—GAI雜合體”的技術調節主體,在這個過程中首先是終端用戶對GAI中內嵌的技術知識“解碼”的過程,是對使用者原有信息獲取與處理能力的增強;其次是GAI中物化了的技術開發者道德準則對用戶使用行為的“激勵”或“抑制”過程,潛移默化地影響著使用者的意識形態、價值判斷和道德實踐;同時,也是用戶發揮自身主觀能動性,對GAI進行創造性使用與反向塑造的過程,使用者自身的信仰觀念、價值判斷也最終決定著產品發揮的實際效能,如圖2所示。值得說明的是,在“使用者—GAI雜合體”的糅合關系形成過程中,GAI用戶自身的數字素養決定著“使用者—GAI雜合體”整體功能的發揮。如果使用者具備良好的數字素養,能夠較好地理解GAI底層運行邏輯并有效“解碼”其潛在功能,則更有可能獲得高質量的輸出。因此,可以說GAI的技術哲學本質是一個模型開發者信息處理能力與價值觀念“物化”的技術人工物,正如卡爾·馬克思指出,技術的本質不過是人的本質力量的對象化。GAI中隱含的開發者知識能力及價值觀念,一方面,會“激勵”或“抑制”用戶特定行為的發生,也可能賦予用戶前所未有的新能力;另一方面,GAI生成的內容本身也會隱含模型開發者的意識形態和價值取向,進而對生成內容的消費群體產生顯性或隱性的“教育”性影響。

圖2? ?“人—技雜合”視角下的GAI技術哲學本質

四、基于“技術道德化”理論的生成式

人工智能應用潛能與風險

“技術道德化”理論基于“人—技雜合”的視角認識技術本質及其實踐倫理問題,并從設計和使用兩種語境提出 “道德物化”和“技術調節”理論。以下將分別從“技術調節”理論和“道德物化”理論分別闡釋GAI教育應用潛能和教育應用風險。

(一)基于“技術調節”理論的GAI教育應用潛能分析

GAI在教育應用過程中并不是一種中立的媒介,GAI與使用者積極主動地共塑人在世界的方式,包括人的知覺和行動、體驗和存在。一方面,它調節著人類對現實的經驗和解釋,另一方面,它又調節著人類的行為和生活方式。技術新產品的使用過程既是產品內涵知識及價值的“解碼”和對用戶賦能的過程,也是使用者發揮自身能動性建構“人—技復合的道德實踐者”創生倫理實踐場景的過程。GAI的教育教學應用潛能分析應基于使用者場景分析其對師生用戶的賦能及用戶創造性應用的可能性,具體如下:

1. 基于人機自然交互的教育信息服務獲取

大數據時代的到來,使得“我們生活在信息的海洋中,卻忍受著知識的饑渴”這一問題日趨嚴峻。20世紀末,為應對網絡信息激增而誕生的搜索引擎顯然已經無法滿足大數據時代人類對信息獲取準確性、便捷性和實用性的要求。GAI的出現讓人和計算機程序可以用擬人化的“聊天”方式更加便捷地獲取直接可用的多模態信息,人們無須在雜亂無章的搜索結果中二次遴選所需信息。Google 管理團隊認為,GAI的發展將催生新一代搜索引擎的出現[10]。為此,各大搜索引擎也迅速將GAI整合其中或探索布局基于大模型之上的對話式搜索引擎接口。GAI的廣泛應用降低了人機交互的技術門檻,使得信息技術產品更加容易“上手”,“使用者—GAI雜合體”的形成更加容易,這是GAI對使用者信息獲取能力增強的過程,極大地提升了人類獲取教育信息與服務的效率。同時,GAI與語音識別、機器翻譯、跨模態理解、腦機接口、數字人等技術的深度融合,促使人機自然交互的質量大幅提升,人們獲取高質量網絡信息與服務將逐漸變為“零”技術門檻活動。

2. 基于多模態GAI的適應性數字教育資源開發

GAI技術的不斷成熟,各類GAI也逐漸實現跨模態內容理解與生成功能。例如,訊飛星火大模型、百度文星一格、阿里的通義千問、OpenAI新發布的Sora等均已具備根據文本、圖片、語音等輸入生成文本、視頻等多模態信息的功能。多模態GAI的發展,將極大提升數字教育資源開發的效率,使得適應性數字教育資源開發與應用成為可能。適應性數字教育資源是人工智能內容生成、自適應學習技術與數字教育資源個性化服務的有效整合[11],強調以師生真實需求和個性特征為數字教育資源服務的前提,重點提升數字教育資源生成與教學應用之間的適配性[12]。適應性數字教育資源開發時代教師無須為搜索、加工和整合各類數字資源而發愁,GAI系統將會根據教師定制的提示工程,生成滿足教學需要和富有教師個性風格的數字教育資源,甚至根據每個學生的個性特點生成個性化學習資源也將成為可能。基于多模態GAI的“使用者—GAI雜合體”為教師賦予新的多模態教育資源自主開發能力,助力數字教育進入適應性教育資源開發與應用時代。

3. 基于人機共生互補的雙師課堂教學創新

GAI最受關注的應用場景是課堂教學應用,目前,國內外已有許多學者對此進行了較為深入的理論探討和實證研究[13]。維貝克的“技術道德化”理論正是基于“人—技雜合”的視角認識技術的本質及其作用問題。人類教育技術持續發展的動力在于教師探索利用技術工具彌補自身不足,以提升教學效果的不懈追求。教師應用GAI的過程中形成“教師—GAI雜合體”將更加便捷有效地彌補教師諸多缺陷,發揮替代、協助、增強和賦能等功能[14]。具體包括:(1)GAI替代功能,即教師無須參與可全部交付給GAI處理的任務。(2)GAI協助功能,即GAI協助教師更高效、優質地完成教師原本可以獨立完成的工作,使教師專注于創造性更高、情感導向性更強的工作。(3) GAI增強功能,即GAI支持教師更好地完成教師原本難以獨立完成的任務。(4)GAI賦能功能,即GAI支持教師完成自己原本無法完成的工作。

4. 基于人機對話博弈的學習教練與助理

GAI作為模型開發者信息處理能力與價值觀念“物化”了的技術人工物,它本身所具有的“擬人”功能賦予它成為用戶學習教練或助理的潛能。恰當地應用 GAI可在自主發展方面發揮如下功能:(1)自主學習的“GAI學伴”,學習者在語言學習中可以將GAI擬人化為語言“學伴”,在與GAI的連續性對話中發展語言能力;在繪畫技能學習或作曲練習中利用相關GAI輔助自己能力發展。(2)技能性任務的“GAI助理”,學習者在完成程序編寫、數據分析、學習資料查找的學習任務時利用GAI生成程序代碼、分析報告或文獻綜述,GAI扮演學習者助理的角色。(3)思維發展的“GAI教練”,學習者在與GAI交互的過程中學會人機交互式“提問(Prompt)”技巧,發展學生的精致化思維和計算思維;在與GAI“挑戰性”對話博弈中發展學生的批判性思維。(4)數字孿生的“GAI代理”,目前,大部分GAI都提供了相關的接口使得二次開發變得更加容易,每個專業級用戶都可以對GAI進行模型微調訓練和用戶界面定制化開發,生成用戶在數字孿生世界的“GAI代理”。

(二)基于“道德物化”思想的GAI教育應用風險分析

維貝克從技術的設計語境和使用語境相關聯的視角探討了技術“道德物化”的路徑。技術產品的開發過程是開發者將道德物化的過程,技術產品的使用過程是用戶完成物化道德解碼與發揮主觀能動性的道德實踐過程,是“產品道德+主體道德”的復合性道德實踐活動。目前,已有大量有關GAI應用風險挑戰的理論研究,本文從“技術設計語境”和“技術使用語境”相關聯的動態視角將GAI教育應用的風險挑戰總結為以下5個方面。

1. GAI模型黑箱導致的意識形態風險

由前文GAI技術學原理的分析中可知,GAI在底層模型采用的算法機制、預訓練階段使用的語料數據、微調階段人類反饋強化學習的價值導向等問題共同決定了它本身就是一個“黑箱”。我國教育的根本任務是“立德樹人”,主要使命是為黨和國家培養一代又一代德智體美勞全面發展的社會主義建設者和接班人。GAI作為對話式內容生成人工智能產品,其在教育教學應用中扮演著“準教師”的角色。學生利用GAI提哪些問題、生成哪些內容,既顯性地反映了學生的認知需求與期望,也隱性地透露著學生的價值取向及意識形態;GAI生成的內容也隱含著模型訓練數據集、產品開發者及技術資本的價值取向。Rudin等人認為,基于黑箱模型的科技公司可能會隱瞞GAI的工作原理,這導致很難對機器人所生成知識的來源及鴻溝進行揭示[15];GAI能憑借內容生成的首要功能對意識形態的價值觀念層進行滲透,依靠交互對話的產品形態對意識形態的話語方式產生影響,利用多維應用的功能屬性對社會生活實踐領域展開強勢介入,導致當下意識形態斗爭態勢風云詭譎[16]。GAI模型黑箱導致的意識形態風險具有辨識難度大、滲透性強、外泄風險高等特點,這是其教育應用的最大風險挑戰。

2. GAI教育應用成本導致的新型數字鴻溝

談及GAI教育應用種種潛能與風險,其基本前提是師生能有機會便捷公平地使用GAI產品。信息基礎設施建設情況、數字化終端擁有情況、數字素養與技能發展水平及網絡信息服務支付能力等因素,均決定著每個終端用戶的GAI使用機會。數字鴻溝的表現形態可分為20世紀的接入鴻溝、21世紀初的素養鴻溝和當下智能鴻溝三個階段[17]。GAI教育應用導致的數字鴻溝據此可分為一級接入鴻溝、二級素養鴻溝和三級智能鴻溝。首先,網絡設施普及情況、數字終端擁有情況、網絡信息有償服務支付能力以及區域網絡管理政策共同造就了一級接入鴻溝的形成。其次,GAI使用的過程是用戶對GAI技術產品內涵價值的“解碼”過程,師生的數字素養決定著解碼過程中的價值損耗進而形成二級素養鴻溝,例如,數字素養高的用戶更容易理解GAI技術黑箱的原理、更容易制定高質量的提示工程(Prompt)、更容易批判性地評價GAI生成內容的質量,進而導致使用效果的差異。最后,部分GAI產品憑借其行業先行效應在推出后短期內吸引了大批全球各地用戶,隨著企業技術的不斷成熟及GAI對用戶行為數據的持續積累,處于優勢地位的產品將可能通過打造排他性數字生態體系逐漸形成行業壟斷,進而形成以算法鴻溝、算力鴻溝和數據鴻溝為主要表現的智能鴻溝,進一步加劇社會不平等現象。

3. GAI濫用導致的學術倫理風險

開展科學研究與學術寫作是GAI的重要研究方向,也是GAI推出后研究者最先關注到的主要風險挑戰領域。鑒于GAI在學生課程論文、考試測驗及學術論文撰寫中的應用可能造成的巨大沖擊,許多研究者、高校、學術期刊等紛紛聲明禁止或限制GAI在學術領域的應用。Science期刊主編Thorp在 Science發表社論:“ChatGPT 很好玩,但不是作者。” [18]Nature雜志在投稿指南中指出,ChatGPT等大語言模型不能成為論文作者[19]。雖然GAI在剛推出后受到了抵制和批判,但研究人員已經使用GAI來輔助文獻檢索、數據分析、論文撰寫、論文翻譯和修改潤色[20]。Melnikov等人認為,未來人工智能聊天機器人可能會生成假設、開發方法、創建實驗[21]。同時,GAI也暴露出其輸出存在不準確、錯誤、偏見甚至種族歧視等問題。Van Dis等在Nature上發文指出,科學研究正面臨著一場由GAI引發的對其原來珍視的價值觀、實踐準則和標準的清算,解決這個問題的重點應該是抓住其所帶來的機遇并管控可能的風險,我們相信科學界將找到一種既能從GAI中受益,又不至于使科學工作失去其作為一項使人深刻而令人滿意的事業的許多重要方面:好奇心、想象力和發現探索[20]。

4. GAI過度依賴導致的認知惰性

教育工作者最為擔心的是GAI教育應用對學生認知能力的影響。首先,從知識學習的角度看,學生利用GAI生成答案,簡化了知識獲取的過程,降低了對科學探索的內在興趣,加大了學習惰性[22],成為“逃避學習”的工具[23]。其次,從認知能力的角度,學習者會因長期過度依賴GAI生成的內容而缺乏深入理解、深度思考和批判分析思維等高階認識能力。上海大學轉化醫學研究院白龍等人研究認為,過度依賴GAI系統可能會導致批判性思維受損和記憶保持能力改變[24-25]。再次,從腦科學和認知心理學的角度來看,長期使用GAI可能會形成技術依賴,進而對學生神經系統產生實質影響,形成成癮記憶神經通路[26]。加拿大研究者的一項研究已經表明,長期使用GPS導航會對人的空間記憶能力及海馬體結構產生負面影響[27]。最后,從人類主體性的視角看,GAI可能會導致使用者思維的庸化和道德的鈍化,逐漸封閉自我意識,放棄自由意志,造成人的主體性自我消解[28]。

5. GAI數字污染導致的模型崩潰

由于GAI大模型自身的原理性局限疊加用戶不清晰的使用命令,將導致大量不準確、歪曲事實甚至機器編造的虛假信息在網絡空間迅速傳播,重塑網絡空間生態,進而導致的“信息扭曲”“數據污染”“數據貧困”“優質數據枯竭”等問題將日益嚴重。這些被污染的數據將不可避免地滲入下一代大模型訓練的數據集,進而會導致新的大模型用自己產生的“毒數據”訓練自己的“自激”現象,最終導致“模型崩潰”(Model Collapse)。英國和加拿大的研究人員的研究證實,使用大模型生成的數據對大模型進行持續訓練會導致不可逆的缺陷,使大模型原始數據分布的尾部消失,模型性能逐漸下降并最終導致“模型崩潰” [29]。算力、優質數據和大模型作為人工智能時代的基礎資源和數字基礎設施,不僅關系到國家數字經濟生產效率的提升,更關系國家數字安全與長遠發展。因此,在全力投入大模型訓練與應用的同時,應更加重視數據資源的“環保”與治理。

五、技術道德化理論視域下GAI教育應用

風險應對展望

GAI的快速發展為教育應用帶來巨大潛能,也給全球教育生態造成巨大沖擊,GAI應用規范與風險挑戰全球治理體系亟須建立。為此,我國先后發布了《生成式人工智能服務管理暫行辦法》《全球人工智能治理倡議》,烏鎮世界互聯網大會發布了《發展負責任的生成式人工智能研究報告及共識文件》,首屆全球人工智能安全峰會簽署了旨在加強國際合作建立人工智能監管體系的“布萊切利宣言”,聯合國教科文組織發布了專門針對教育領域的《教育與研究領域生成式人工智能指南》等共識性文件。這些初步探索為GAI教育應用風險治理帶來重要指導,但現有治理視角更多的是基于道德倫理應用的外在式范式。維貝克解決技術倫理問題的內在式路徑,不但敏銳地認識到了技術人工物對人類道德行為的調節作用,更重要的是認識到技術人工物的設計過程本身是負載價值的“道德物化”活動。據此,他提出有效溝通技術人工物設計情境與使用情境,最大限度優化技術人工設計以對沖“設計者謬誤”的依賴設計者的充分道德想象、拓展建構性技術評估和情境模擬法三大方法。沿循維貝克的技術倫理問題治理方法論,基于“人—技雜合”的思想從“設計者”和“使用者”兩種視角構建“雙向奔赴”的全球GAI治理體系,將成為未來重要的探索方向,這方面的相關思考將另文詳細闡述。

[參考文獻]

[1] DILLON S. The Eliza effect and its dangers: from demystification to gender critique[J]. Journal for cultural research,2020,24(1):1-15.

[2] 生成式人工智能服務管理暫行辦法[EB/OL].(2023-07-10) [2023-12-16]. https://www.gov.cn/zhengce/ zhengceku/202307/content_6891752.htm.

[3] 翟尤,郭曉靜,曾宣瑋.AIGC未來已來:邁向通用人工智能時代[M].北京:人民郵電出版社,2023:17.

[4] 北京大學哲學系.西方哲學原著選讀(上卷)[M].北京:商務印書館,1981:40.

[5] 張一兵.斯蒂格勒:西方技術哲學的評論——《技術與時間》解讀[J].理論探討,2017(4):57-63.

[6] 舒紅躍. 現象學技術哲學及其發展趨勢[J].自然辯證法研究,2008 (1):46-50.

[7] 彼得·保羅·維貝克.將技術道德化:理解與設計物的道德[M].閆宏秀,楊慶峰,譯.上海:上海交通大學出版社,2016:3-15,51-82.

[8] 衛羚. 蘭登·溫納技術哲學思想的解讀——技術決定論與社會決定論的橋梁[J].福建論壇(人文社會科學版),2009(9):72-74.

[9] 史晨.技術哲學的第三次轉向——維貝克道德物化思想的三重特征[J].科學技術哲學研究,2020,37(5):67-73.

[10] GRANT N, METZ C. A new Chat Bot is a 'Code Red' for google's search business[N]. International New York times, 2022-12-21(1).

[11] ROZO H, REAL M. Pedagogical guidelines for the creation of adaptive digital educational resources:? a review of the literature[J]. Journal of technology and science education,2019,9(3):308-325.

[12] 羅江華,張玉柳.基于跨模態理解與重構的適應性數字教育資源:模型構建與實踐框架[J].現代遠程教育研究,2023,35(6):91-101.

[13] 張絨.生成式人工智能技術對教育領域的影響——關于ChatGPT的專訪[J].電化教育研究,2023,44(2):5-14.

[14] 楊彥軍,羅吳淑婷,童慧.基于“人性結構”理論的AI助教系統模型研究[J].電化教育研究, 2019,40(11):12-20.

[15] RUDIN C. Stop explaining black box machine learning models for high stakes decisions and use Interpretable models instead[J]. Nature machine intelligence, 2019,1(5):206-215.

[16] 代金平,覃楊楊. ChatGPT等生成式人工智能的意識形態風險及其應對 [J]. 重慶大學學報(社會科學版),2023,29(5):101-110.

[17] 鐘祥銘,方興東.數字鴻溝演進歷程與智能鴻溝的興起——基于50年來互聯網驅動人類社會信息傳播機制變革與演進的視角[J].新聞記者,2022(8):34-46.

[18] THORP H H. ChatGPT is fun, but not an author[J]. Science, 2023,379(6630):313.

[19] Nature. Initial Submission [EB/OL]. (2023-01-24) [2023-12-27]. https://www.nature.com/nature/for-authors/ initial- submission.

[20] VAN DIS E A M, BOLLEN J, ZUIDEMA W, et al. ChatGPT: five priorities for research[J]. Nature, 2023,614(7947):224-226.

[21] MELNIKOV A A, NAUTRUP H P, KRENN M, et al. Active learning machine learns to create new quantum experiments[J]. Proceedings of the national academy of sciences, 2018,115(6):1221-1226.

[22] BAIDOO-ANU D, ANSAH L O. Education in the era of generative artificial intelligence (AI): understanding the potential benefits of ChatGPT in promoting teaching and learning[J]. Journal of AI, 2023,7(1):52-62.

[23] 周洪宇,李宇陽.ChatGPT對教育生態的沖擊及應對策略[J].新疆師范大學學報(哲學社會科學版),2023,44(4):134-143.

[24] BAI L, LIU X, SU J . ChatGPT: the cognitive effects on learning and memory[J]. Brain-X,2023,1(3):1-9.

[25] DENG X, YU Z. A meta-analysis and systematic review of the effect of chatbot technology use in sustainable education[J]. Sustainability,2023,15(4):2940-2959.

[26] 楊彥軍,張佳慧,童慧.數字媒介技術依賴的多學科析因及整合性闡釋[J].電化教育研究,2020,41(8):26-32.

[27] DAHMANI L, BOHBOT V D. Habitual use of GPS negatively impacts spatial memory during self-guided navigation[J]. Scientific reports, 2020,10(1):6310-6324.

[28] 雷磊.ChatGPT對法律人主體性的挑戰[J].法學,2023(9):3-15.

[29] SHUMAILOV I, SHUMAYLOV Z, ZHAO Y, et al. Model dementia: generated data makes models forget[J]. arXiv e-prints,2023(5):17493-17511.

Study on the Potential and Risk of Educational Application of Generative Artificial Intelligence Based on Moralizing Technology Theory

TONG Hui1,? YANG Yanjun2

(1.Department of Education, Jiangxi Science and Technology Normal University, Nanchang Jiangxi 330038; 2.Institute of Education Development, Nanchang University, Nanchang Jiangxi 330031)

[Abstract] With the rapid development of Generative Artificial Intelligence(GAI) and its wide application in the field of education, researchers at home and abroad have launched a heated discussion about it and the educational application of large language model behind it. However, the Eliza effect exists in most studies because of the lack of understanding of the principle of GAI technology. This study firstly analyzes the essence of GAI from the perspective of Verbeke's "human-technology hybrid" on the basis of an in-depth analysis of the principle of GAI technology, and then elaborates four major potentials and five major risks and challenges faced by the application of GAI in education. Finally, based on the idea of "human-technology hybrid", a global AI governance system is proposed from the two perspectives of "designer" and "user" , which will become an important direction for future exploration.

[Keywords] Generative Artificial Intelligence; Moralizing Technology; Large Model; Human-Technology Hybrid; Application Risk