基于改進YOLOv5s的木刻雕版元素檢測方法研究

摘 "要: 針對傳統目標檢測算法在處理具有復雜紋理木刻雕版圖像時存在漏檢、參數量大、檢測和推理速度慢等問題,通過改進YOLOv5s模型,提出一種輕量化目標檢測算法。首先,采用FasterNet作為特征提取模塊,解決原始YOLOv5s參數量大、運行時間長以及算法要求高等問題;其次,在特征提取網絡后添加坐標注意力機制以提高模型對木刻雕版元素特征的提取能力;最后,引入輕量化上采樣CARAFE,減少上采樣過程中特征信息的損失并提升模型的檢測精度。為了驗證方法的有效性,文中在自己收集的數據上進行測試,與初始YOLOv5s模型相比,改進后的模型平均精度提升了2.2%,檢測速度提升了46.53%。實驗結果表明,改進后的模型可以快速定位和識別木刻雕版元素,實現對初始模型的輕量化,可以有效部署于嵌入式設備和移動設備。

關鍵詞: YOLOv5s; 木刻雕版; FasterNet; 注意力機制; CARAFE; 輕量化目標檢測

中圖分類號: TN911.73?34; TP391 " " " " " " " " " 文獻標識碼: A " " " " " " " " "文章編號: 1004?373X(2024)21?0067?08

Research on woodcut engraving element detection method based on improved YOLOv5s

YANG Xin1, 2, CAIRANG Xianmu1, GAO Dingguo1, 2, XIA Jianjun1, 2, PUBU Danzeng1, ZHAO Qijun1, 2, 3

(1. School of Information Science and Technology, Tibet University, Lhasa 850000, China;

2. Tibetan Information Technology Innovative Talent Training Demonstration Base, Lhasa 850000, China;

3. School of Computer Science, Sichuan University, Chengdu 610065, China)

Abstract: The traditional object detection algorithms have the disadvantages of missing detection, a large quantity of parameters and slow detection and reasoning speed when processing images of woodcut engraving plates with complex textures. Therefore, a lightweight object detection algorithm is proposed by improving the YOLOv5s model. The FasterNet is taken as the feature extraction module to reduce the quantity of parameters, shorten the operation time and lower the algorithm requirements of the original YOLOv5s. The coordinate attention (CA) mechanism is added after the feature extraction network to improve the model′s ability to extract the features of woodcut engraving elements. The CARAFE (content?aware reassembly of features) is introduced to reduce the loss of feature information in the process of up?sampling and improve the detection accuracy of the model. The proposed method is tested with the data collected by the author himself to verify the effectiveness. In comparison with the initial YOLOv5s model, the average accuracy of the improved model is improved by 2.2% and its detection speed is increased by 46.53%. The experimental results show that the improved model can locate and identify the elements of woodcut engravings rapidly. The improved model is the lightweight of the initial model, and can be deployed in embedded and mobile devices effectively.

Keywords: YOLOv5s; woodcut engraving; FasterNet; attention mechanism; CARAFE; lightweight object detection

0 "引 "言

藏族木刻雕版是藏文化的活化石,承載了藏族人民的智慧,研究藏族木刻雕版可以更好地了解和尊重藏族文化,為非物質文化遺產的保護和傳承做出貢獻[1]。木刻雕版因年代久遠、儲存方式不當等原因,出現了磨損或自然老化的情況,以致后續研究學者和文化愛好者在理解木刻雕版元素等內容時遇到了一定的阻礙。深度學習和計算機視覺的發展為木刻雕版技藝的數字化保護和傳承提供了有效的解決方案。

目標檢測作為計算機視覺領域的重要研究方向,采用深度學習算法對圖像和視頻內容自動識別和定位[2]。目標檢測算法因為高效和快速等優點已經被廣泛應用于自動駕駛[3]、生物特征識別[4]和醫學影像分析[5]等多種領域。目標檢測算法可以被劃分為兩大類:一類是依賴于傳統技術的算法;另一類則是利用深度學習技術的算法。傳統的目標檢測方法主要基于手工設計的特征提取器和分類器,如方向梯度直方圖(Histogram of Gradient, HOG)特征[6]和支持向量機(Support Vector Machine, SVM)[7]等。傳統的方法在一些簡單場景下表現良好,但在復雜背景情況下效果較差。近年來,深度學習技術的興起極大地推動了目標檢測的發展,特別是隨著卷積神經網絡(Convolutional Neural Network, CNN)的興起,目標檢測技術獲得了顯著的突破和進展。深度學習目標檢測算法包括一次性完成檢測的單階段方法和分兩步走的兩階段方法。兩階段方法先生成候選框,再對候選框進行分類和定位,典型算法有SPPnet(Spatial Pyramid Pooling Network)[8]和R?CNN[9]系列,其算法都采用一個區域生成網絡(Region Proposal Network, RPN)來生成候選框,并使用一個分類器來判斷候選框是否包含目標。以上目標檢測算法的主要缺點是速度較慢,無法滿足實時目標檢測的需求。與兩階段目標檢測算法不同,SSD[10](Single Shot MultiBox Detector)算法是一種基于單階段檢測器的目標檢測算法,其主要思想是調整卷積網絡的最后一層,將每個位置上的特征圖解釋為包含一組邊界框的概率分布。YOLO[11](You Only Look Once)系列算法是基于單階段檢測器的另一種目標檢測算法,這些算法將目標檢測問題簡化為一個回歸問題,使用單個神經網絡自底向上地預測邊界框和類別概率。相較于R?CNN系列和SSD算法,YOLO系列算法的檢測速度更快,且檢測效果更好。

綜上所述,如何有效、便捷地實現木刻雕版圖像元素自動識別和定位已成為亟待研究的課題。然而,目前鮮有對木刻雕版元素方面的研究。為此,本文將單階段目標檢測算法中綜合性能較好的YOLOv5模型應用于木刻雕版數據,但仍然存在參數量大、檢測和推理速度慢以及檢測精度低等問題。為了解決上述問題,本文在YOLOv5s的基礎上進行了創新,設計出了一種優化的算法。首先,采用FasterNet[12]作為特征提取模塊;其次,在特征提取網絡后添加坐標注意力機制[13];最后,引入輕量化上采樣CARAFE(Content?aware Reassembly of Feature)[14]。有效實現木刻雕版元素的精準定位和檢測,有助于社會大眾以及藏文化愛好者深入理解藏族木刻雕版的版面元素,推動藏文化的傳播與交流。

1 "方法概述

1.1 "YOLOv5s模型概述

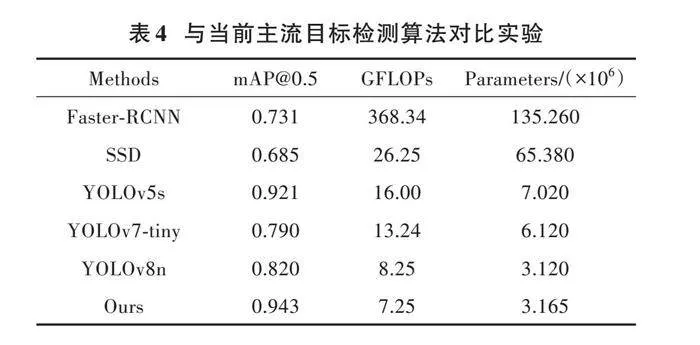

YOLOv5s是一種單階段目標檢測算法,與傳統的目標檢測算法相比,YOLOv5s具有較高的檢測速度和精度。YOLOv5系列包含五個版本,按照規模從小到大排序為:YOLOv5n、YOLOv5s、YOLOv5m、YOLOv5l和YOLOv5x,這些網絡在結構上僅在網絡深度和通道數上有所區別。隨著網絡深度和寬度的遞增,雖然檢測精度逐漸提升,但處理速度卻相應下降。由于木刻雕版檢測系統對實時性能的要求,本文選擇在速度和精度上均表現較優的YOLOv5s作為基礎網絡模型。YOLOv5s的網絡結構清晰明了,由輸入端(Input)、骨干網絡(Backbone)、特征融合模塊(Neck)以及預測層(Prediction)四個主要部分組成。YOLOv5s模型的網絡結構如圖1所示。

Input通常包含一個圖像預處理階段,其主要任務是對輸入的圖像進行尺寸調整,以滿足網絡所需的輸入大小,并執行歸一化等相關操作,從而確保圖像數據的規范性和一致性。

Backbone采用CSPDarknet53框架[15]。CSPDarknet53由一系列卷積層和殘差塊組成,通過多層的卷積操作,可以在深層網絡提取出圖像的高級語義特征。

Neck網絡采用FPN[16]+PAN[17]的結構。FPN是一種簡化的金字塔網絡,用于提取和融合多尺度的特征信息,能夠在不同尺度上提取和融合特征信息。

Prediction包含了一系列的卷積和全連接層,用于將特征圖轉換為目標的位置和類別信息。預測層輸出的結果包括目標的邊界框坐標、置信度分數和類別概率。通過設置適當的閾值和非極大值抑制(NMS)操作,得到最終的目標檢測結果。

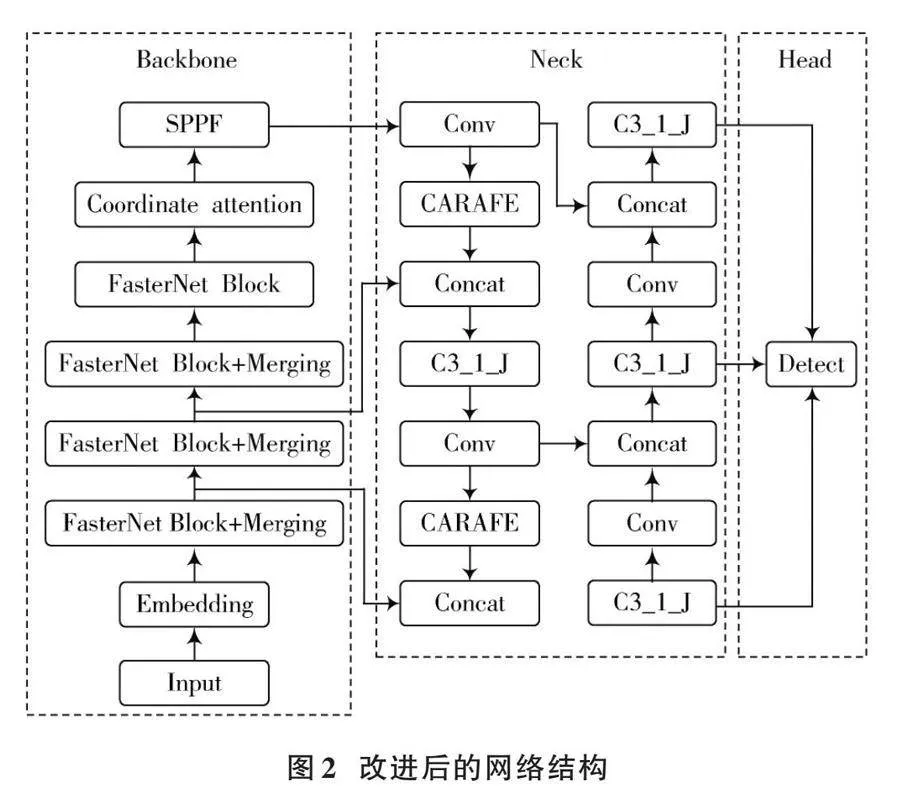

1.2 "模型改進

本文提出的改進算法主要體現在以下三個方面。

1) 特征提取模塊采用FasterNet代替原有的模塊,解決了原始YOLOv5s參數量大、運行時間長等問題,使檢測模型更加輕量化。

2) 在特征提取網絡后添加坐標注意力(Coordinate Attention, CA)機制,可以更好地利用高層次的特征表示,并在全局池化前捕捉重要的特征信息,針對于木刻雕版的邊緣部分和小目標可以得到更好的檢測。

3) 引入輕量化上采樣CARAFE代替最近鄰插值上采樣,可以使得模型能夠獲取更大的感受野、保留更多的信息。

改進后的算法在提升模型檢測精度的同時可以提高檢測速度。改進后的網絡結構如圖2所示。

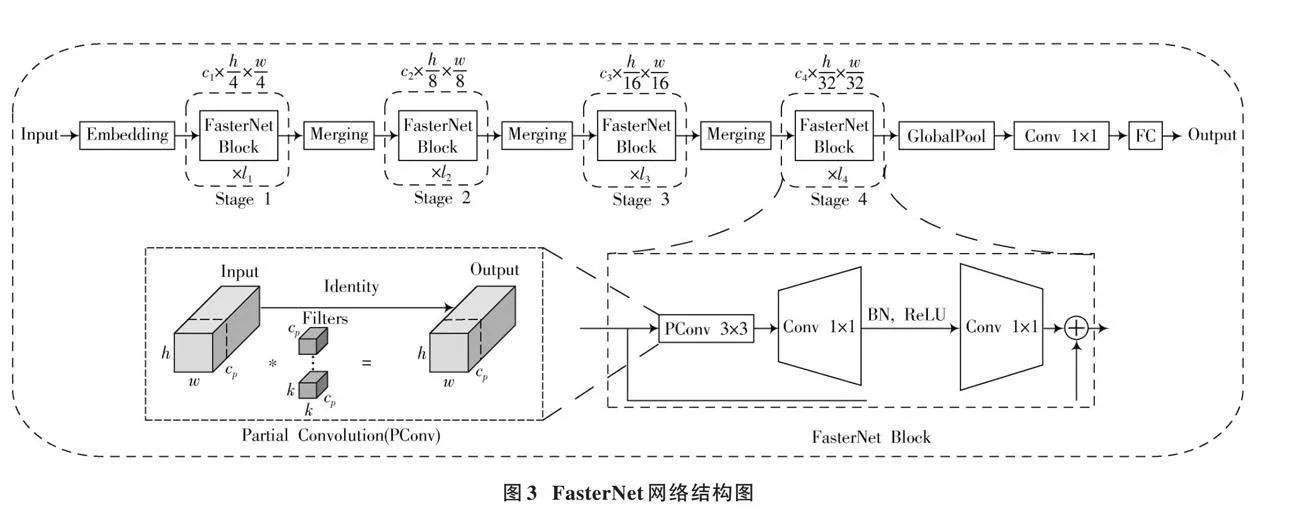

1.3 "FasterNet網絡

YOLOv5s網絡模型在木刻雕版目標檢測任務中憑借出色的特征提取能力展現出了優越的性能,但由于其參數量大,導致模型的計算效率相對較低。特別是在處理木刻雕版這類復雜且精細的圖像數據時,龐大的參數量不僅增加了計算負擔,還會影響實時檢測的速度和性能。相比之下,FasterNet憑借較少的參數設計,展現出了更高的計算效率。它在保持輕量級和高速度的同時,顯著提升了特征表達能力和感受野的覆蓋范圍,從而更好地適應了木刻雕版目標檢測任務的需求。

具體來說,FasterNet的網絡結構由四個級別組成,每個級別包含多個FasterNet塊。這些FasterNet塊通過結合部分卷積操作(PConv層)和1×1卷積操作(PWConv層),實現了高效的特征提取和轉換。在每個級別的開始,嵌入層或合并層通過常規的卷積操作降低空間分辨率并增加通道數,進一步豐富了特征的層次性。而在最后一個級別之后,通過三個分類層對特征進行精細分類。此外,每個層之后的標準化層和激活層不僅增加了特征的多樣性,還有助于降低網絡延遲,提升整體性能。FasterNet的網絡結構如圖3所示。

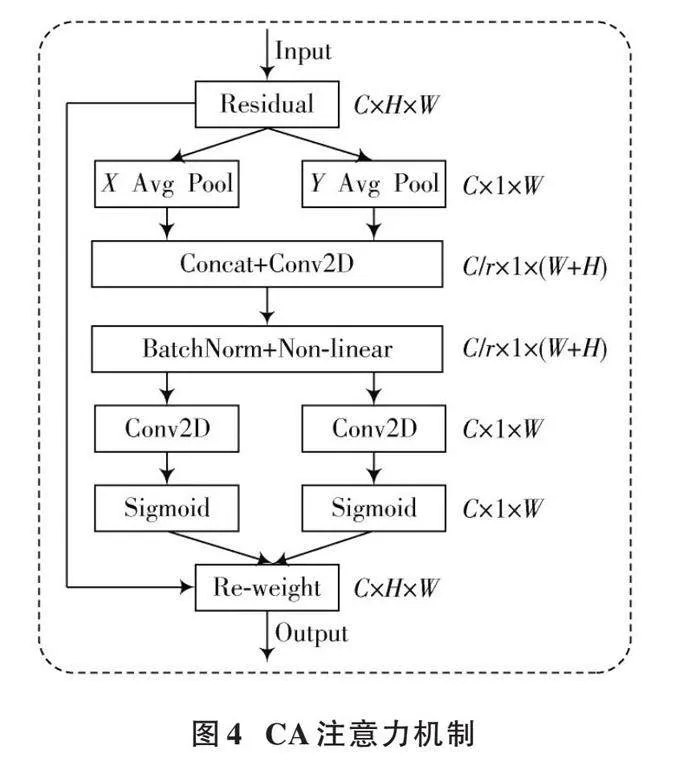

1.4 "融合CA注意力機制

為了提高模型對木刻雕版關鍵元素的注意能力,在特征提取網絡后添加坐標注意力機制。如圖4所示,坐標注意力(CA)機制通過對通道之間的關系建模,使網絡能夠更加集中地關注重要特征,有助于模型能夠更準確地定位和識別感興趣的對象[18]。經過大量實驗證明,相比于其他注意力機制,CA注意力機制不僅關注了通道信息還考慮了方向和位置的有關信息。另外,CA注意力機制足夠的靈活和輕量,能夠簡單地插入到FasterNet網絡中,在保持較快訓練速度的同時,不會導致過擬合的問題。

1.5 "上采樣方式改進

YOLOv5s中常用的上采樣方式是最近鄰插值上采樣,盡管簡單高效,但其感受野較小,容易導致細節信息的丟失和模糊等。這些問題在處理復雜且精細的木刻雕版圖像時尤為突出,嚴重影響了目標檢測的準確性和穩定性。

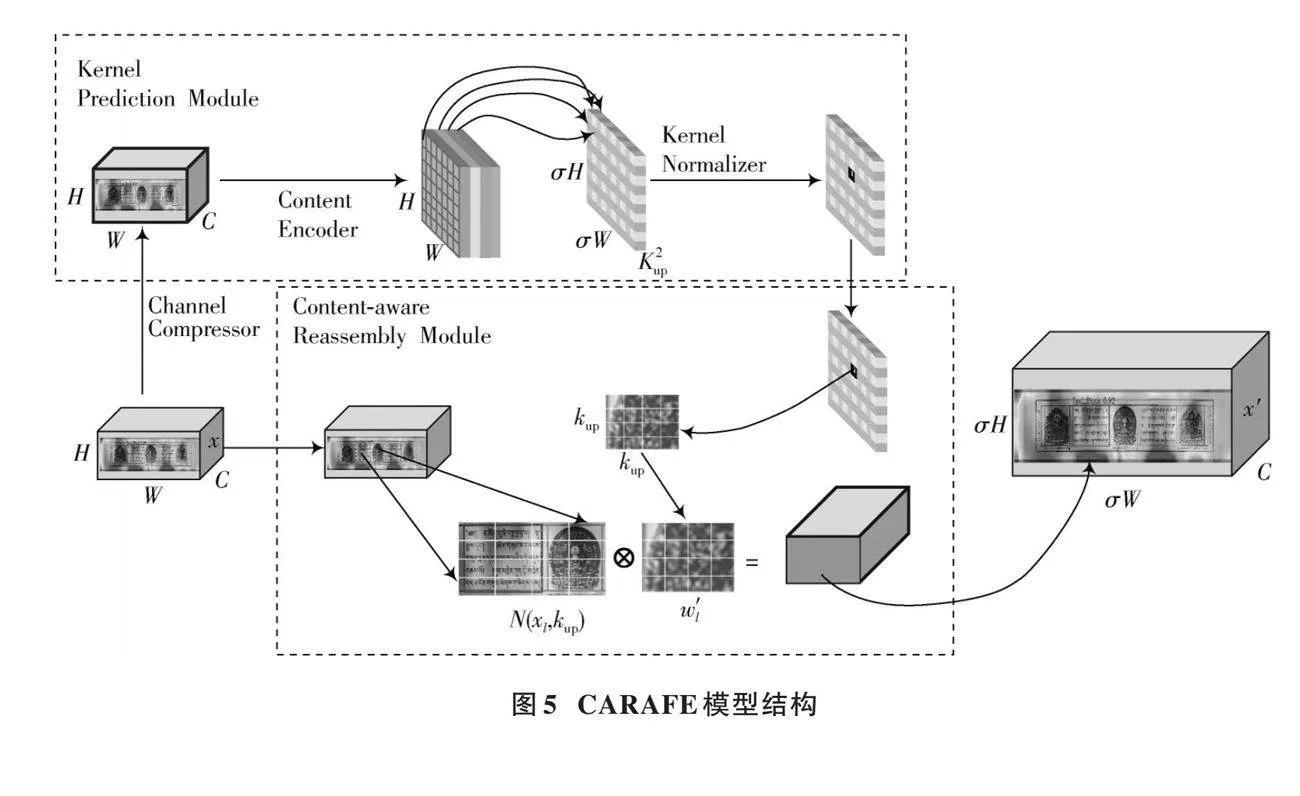

針對最近鄰插值存在的不足,可以用一種計算量小并且語義相關性高的模型來代替。CARAFE是一種輕量級的上采樣算子,相較于初始的最近鄰插值方法,感受野更寬,能大范圍聚合上下文信息,如圖5所示,主要由上采樣核預測和特征重組兩個步驟組成。假設上采樣倍率為[σ],對于一個初始形狀為[H×W×C]的輸入特征圖,首先利用上采樣核預測模塊來預測所需的上采樣核;接著,通過特征重組模塊對上采樣進行處理,最終得到形狀為[σH×σW×C]的輸入特征圖。

2 "實 "驗

2.1 "數據集構建

本研究通過與多地印經院和相關領域專家合作共采集2 070張風格多樣的藏族木刻雕版圖像。

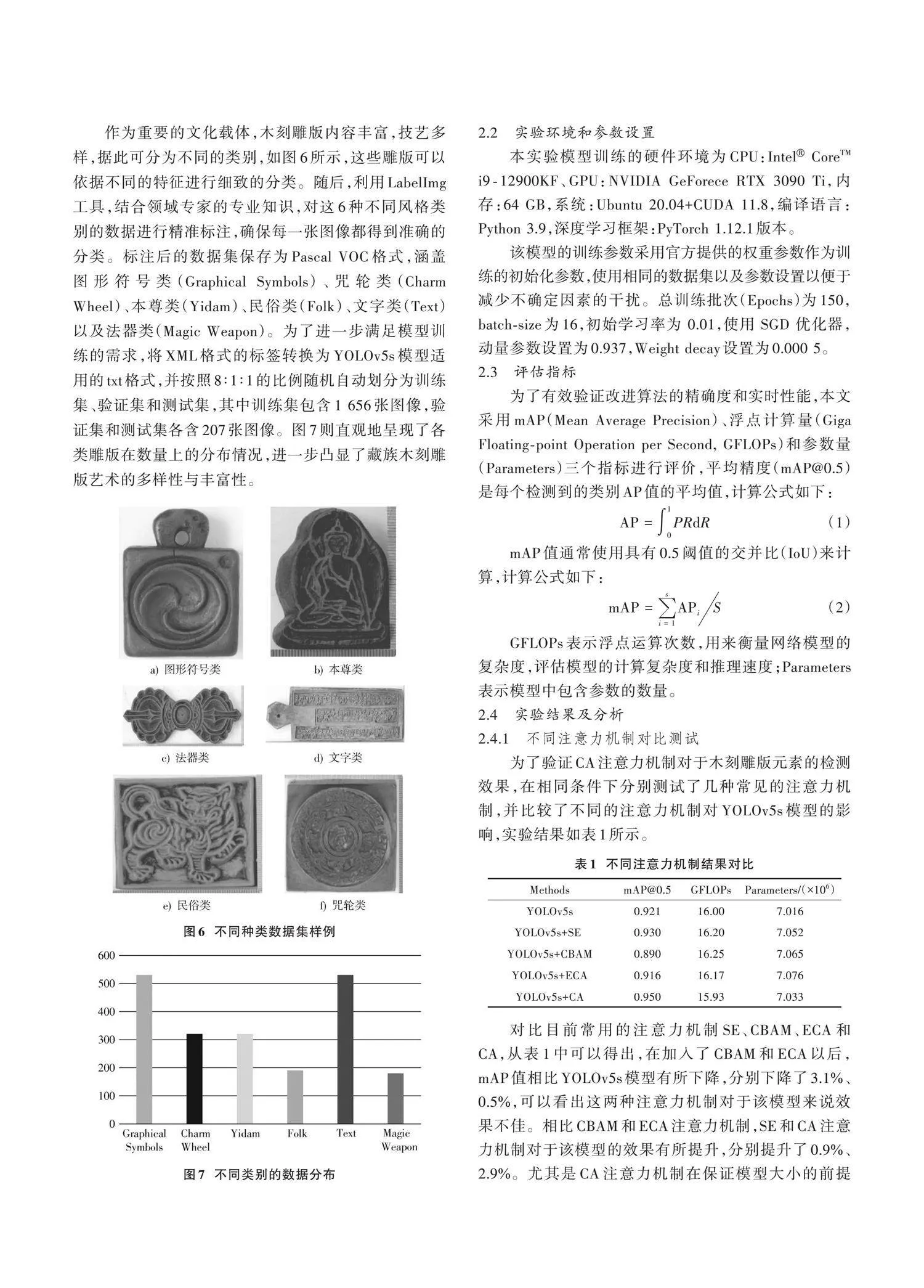

作為重要的文化載體,木刻雕版內容豐富,技藝多樣,據此可分為不同的類別,如圖6所示,這些雕版可以依據不同的特征進行細致的分類。隨后,利用LabelImg工具,結合領域專家的專業知識,對這6種不同風格類別的數據進行精準標注,確保每一張圖像都得到準確的分類。標注后的數據集保存為Pascal VOC格式,涵蓋圖形符號類(Graphical Symbols)、咒輪類(Charm Wheel)、本尊類(Yidam)、民俗類(Folk)、文字類(Text)以及法器類(Magic Weapon)。為了進一步滿足模型訓練的需求,將XML格式的標簽轉換為YOLOv5s模型適用的txt格式,并按照8∶1∶1的比例隨機自動劃分為訓練集、驗證集和測試集,其中訓練集包含1 656張圖像,驗證集和測試集各含207張圖像。圖7則直觀地呈現了各類雕版在數量上的分布情況,進一步凸顯了藏族木刻雕版藝術的多樣性與豐富性。

2.2 "實驗環境和參數設置

本實驗模型訓練的硬件環境為CPU:Intel? CoreTM i9?12900KF、GPU:NVIDIA GeForece RTX 3090 Ti,內存:64 GB,系統:Ubuntu 20.04+CUDA 11.8,編譯語言:Python 3.9,深度學習框架:PyTorch 1.12.1版本。

該模型的訓練參數采用官方提供的權重參數作為訓練的初始化參數,使用相同的數據集以及參數設置以便于減少不確定因素的干擾。總訓練批次(Epochs)為150,batch?size為16,初始學習率為 0.01,使用 SGD 優化器,動量參數設置為0.937,Weight decay設置為0.000 5。

2.3 "評估指標

為了有效驗證改進算法的精確度和實時性能,本文采用mAP(Mean Average Precision)、浮點計算量(Giga Floating?point Operation per Second, GFLOPs)和參數量(Parameters)三個指標進行評價,平均精度(mAP@0.5)是每個檢測到的類別AP值的平均值,計算公式如下:

[AP=01PRdR] (1)

mAP值通常使用具有0.5閾值的交并比(IoU)來計算,計算公式如下:

[mAP=i=1sAPiS] (2)

GFLOPs表示浮點運算次數,用來衡量網絡模型的復雜度,評估模型的計算復雜度和推理速度;Parameters表示模型中包含參數的數量。

2.4 "實驗結果及分析

2.4.1 "不同注意力機制對比測試

為了驗證CA注意力機制對于木刻雕版元素的檢測效果,在相同條件下分別測試了幾種常見的注意力機制,并比較了不同的注意力機制對YOLOv5s模型的影響,實驗結果如表1所示。

對比目前常用的注意力機制SE、CBAM、ECA和CA,從表1中可以得出,在加入了CBAM和ECA以后,mAP值相比YOLOv5s模型有所下降,分別下降了3.1%、0.5%,可以看出這兩種注意力機制對于該模型來說效果不佳。相比CBAM和ECA注意力機制,SE和CA注意力機制對于該模型的效果有所提升,分別提升了0.9%、2.9%。尤其是CA注意力機制在保證模型大小的前提下﹐可以有效提升mAP值。因此經過綜合考慮,添加CA注意力機制來提升模型檢測的性能。

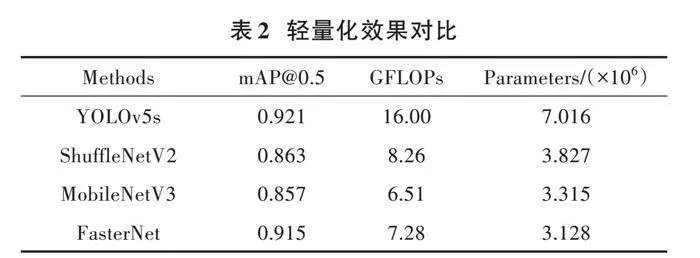

2.4.2 "輕量化模塊的消融實驗

為了驗證FasterNet模塊對木刻雕版元素檢測的影響,將常用的輕量化模塊進行了對比實驗,比較它們對YOLOv5s模型性能的影響,在保證其余條件不變的情況下,分別驗證了常見的ShuffleNetV2和MobileNetV3輕量化主干網絡以及FasterNet網絡,結果如表2所示。

從表2中可以看出,在YOLOv5s模型中引入ShuffleNetV2和MobileNetV3兩種輕量化模型雖然FLOPs和Parameters都出現了大幅度的降低,但是以犧牲較多的mAP值作為代價,因此檢測精度會降低。相比較而言,FasterNet在降低GFLOPs和Parameters的同時,只損失了較少的mAP值,在精度和速度之間達到了平衡。FasterNet相比MobileNetV3,雖然GFLOPs較高,但是其結構中的PConv相比于DWConv極大地降低了內存訪問數量,對空間特征的提取更為有效。所以,本文在輕量化主干網絡的選擇上選取多方面都優于ShuffleNetV2和MobileNetV3的FasterNet模型。

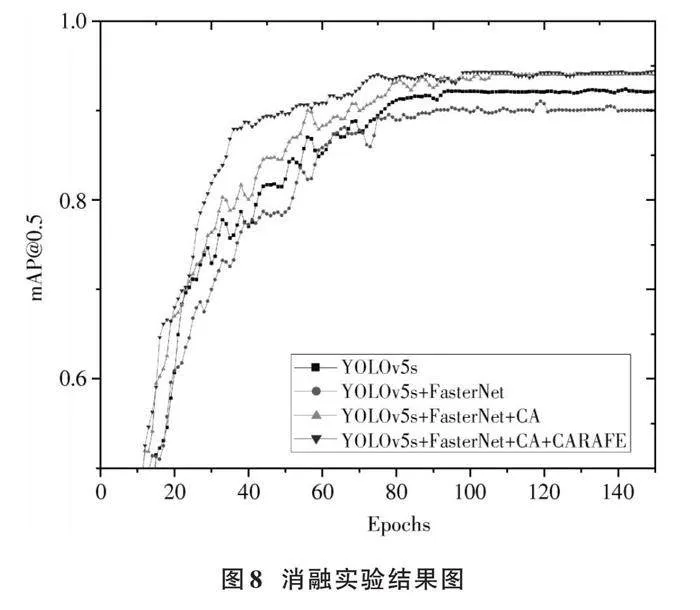

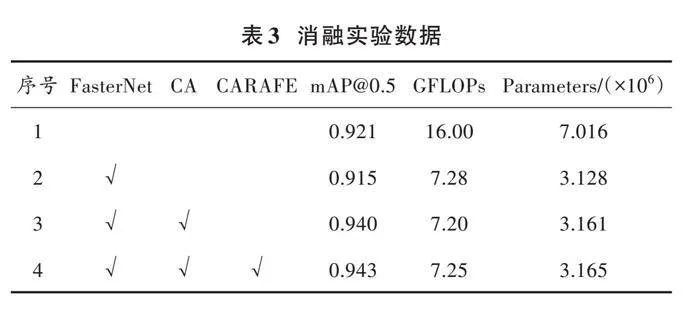

2.4.3 "消融實驗

為了驗證每個新增模塊對于初始算法的有效性,本文進行了一系列消融實驗。首先用輕量化模塊FasterNet替換初始YOLOv5s的特征提取網絡,接著,在FasterNet模塊后添加坐標注意力機制,最后將YOLOv5s的最近鄰插值上采樣替換成CARAFE上采樣。實驗結果如表3所示,這些實驗結果驗證了改進策略的有效性。

從表3中實驗結果可以得出,與初始的YOLOv5s算法相比,加入FasterNet對特征提取網絡進行輕量化后,模型的參數量和復雜度都有顯著減少。雖然對主干網絡進行輕量化改進后,模型的檢測精度略微下降,但隨后引入CA注意力機制,在保持較少參數量的情況下,使檢測精度相較于初始YOLOv5s提升了1.9%。將這兩項改進融合在一起,不僅可以顯著減小模型的參數量和復雜度,還可以確保檢測精度高于初始YOLOv5s算法。最后,通過采用輕量化上采樣CARAFE替代YOLOv5s的最近鄰插值上采樣,模型的檢測精度在改進后的基礎上進一步提高了0.3%。從消融實驗的結果可以得出,本文改進算法模型相比于初始的YOLOv5s模型在保證輕量化的同時可以提升模型的檢測精度。

根據每一輪的訓練數據結果繪制平均精度的變化曲線,如圖8所示,每個模型的mAP分別使用不同的曲線來表示。從圖中可以看出,相較于初始的YOLOv5s算法,經過改進的算法mAP提高了2.2%,同時速度也提高了46.53%,具有良好的效果。

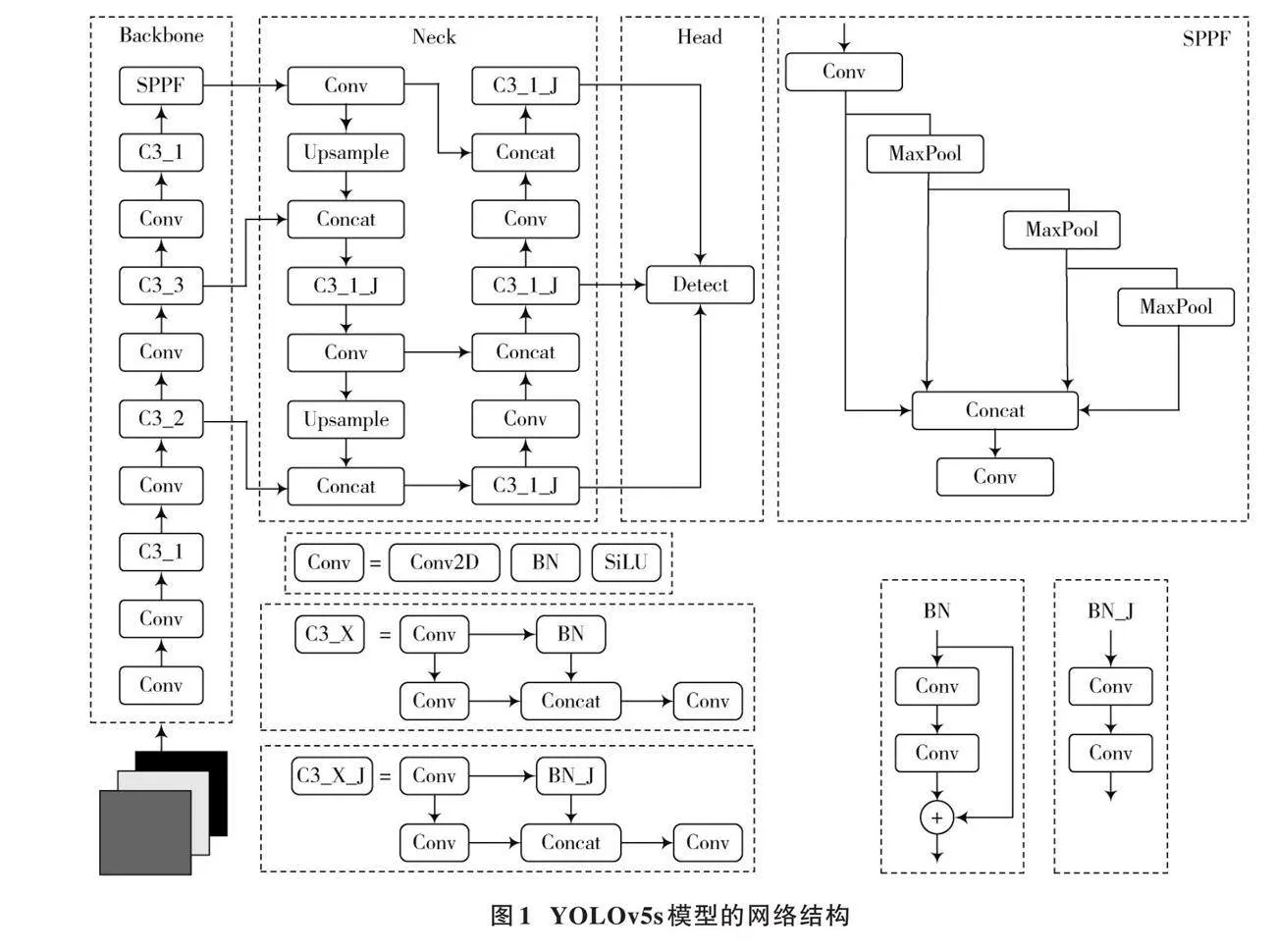

2.5 "與其他算法對比分析

為了進一步驗證改進算法的魯棒性,將本文方法與Faster?RCNN、SSD、YOLOv5s、YOLOv7?tiny、YOLOv8n等主流方法進行比較,在實驗過程中保持相同的參數和條件,分別從mAP@0.5、GFLOPs和Parameters進行比較,證明改進后算法的優越性。對比結果如表4所示。

從表4中可以得出,相比于其他的主流算法,Faster?RCNN的參數量較大,檢測速度較慢,無法滿足實時性的要求。SSD相比于Faster?RCNN在參數量和檢測速度等方面都得到了大幅度的提升,但在檢測精度方面仍然存在欠缺。相比于Faster?RCNN和SSD算法,YOLO系列算法具有更快的檢測速度和更高的檢測精度。本文在YOLO系列算法中選擇綜合性能較好的YOLOv5、YOLOv7和YOLOv8進行對比實驗。從實驗數據可以得出,YOLOv5模型可以更好地擬合木刻雕版的數據,在保證模型參數量和檢測速度的同時具有較高的檢測精度。本文以YOLOv5s為基準模型,改進后的模型可以在提高檢測速度的同時繼續提高檢測精度,具有較好的實時性和魯棒性。

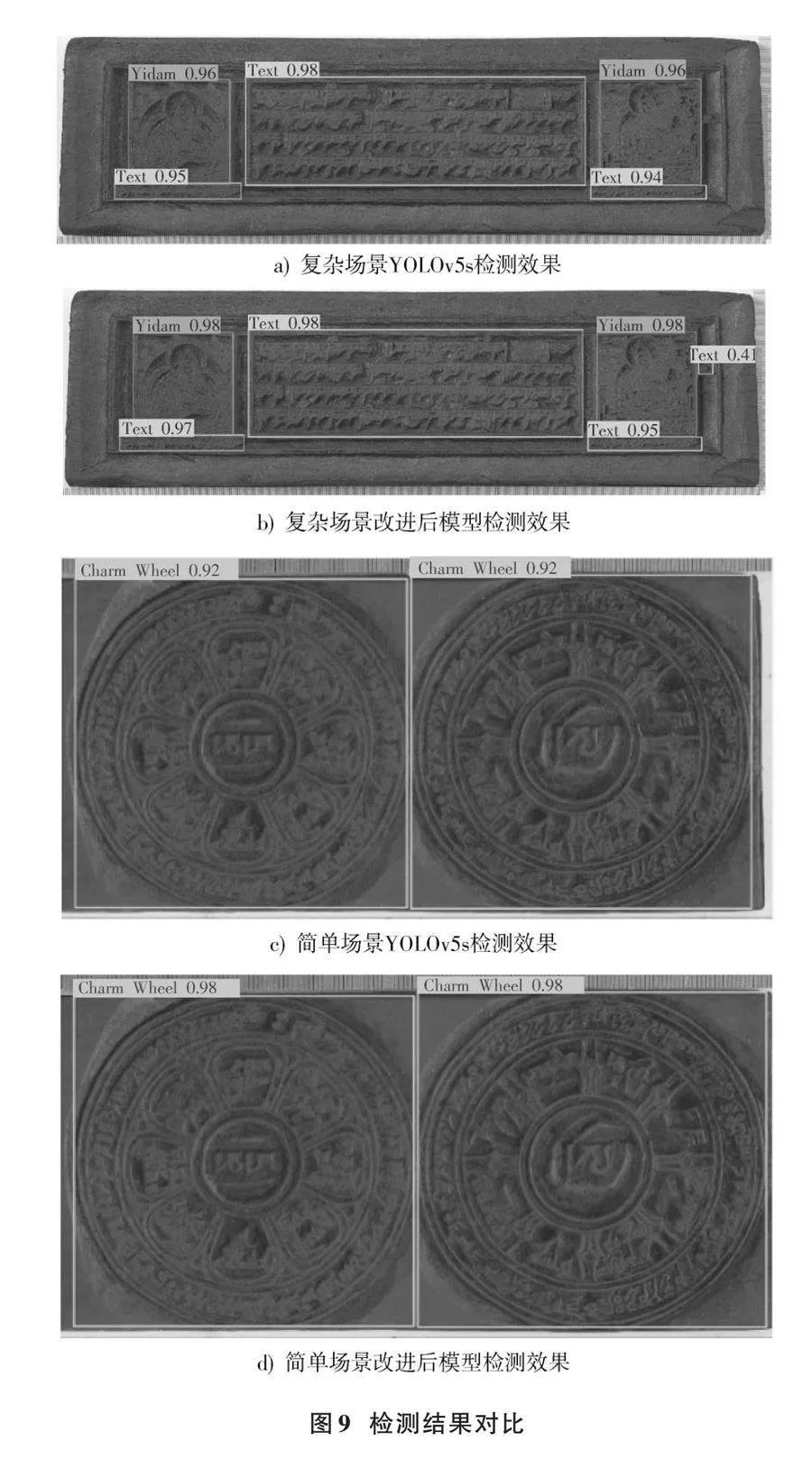

2.6 "檢測結果

為了更直觀地感受改進后模型的效果,實驗選取光線相對灰暗且色澤比較重的不同場景下的圖片進行驗證效果對比,如圖9所示。

改進后的模型在真實木刻雕版測試數據上取得了良好的檢測性能,不僅在精度上有所提升,且能解決初始模型存在小目標漏檢的情況。從圖9a)和圖9b)可以看出,在復雜場景中引入注意力機制和上采樣后,改進后的模型可以檢測出木刻雕版圖像中的小藏文字符目標,同時能夠提高檢測精度。此外,從圖9c)和圖9d)可以看出,在簡單場景中,通過對初始模型的改進可以提高目標檢測的精準度。總的來說,對于初始YOLOv5s可能存在漏檢和不準確定位的情況,改進后的模型可以有效定位和檢測漏檢的部分,且模型的檢測精度提升顯著,有效驗證了改進模型的可行性。

3 "結 "語

研究藏族木刻雕版不僅有助于深入了解藏族文化和藝術,還能推動藏族文化與其他文化的交流與融合。本文針對初始YOLOv5s算法在木刻雕版中存在漏檢、檢測精度低以及檢測速度慢等問題,提出了一種改進算法,改進后的模型在復雜度、檢測精度和檢測速度等多方面均優于原模型。本文不僅為木刻雕版元素的自動檢測提供了一種有效的解決方案,還為其他具有類似復雜紋理和邊緣的圖像檢測任務提供了新的思路和啟示。

總的來說,本文證明了改進后的輕量級模型在保證實時性檢測的要求下可以提高木刻雕版的檢測精度,該模型可以很好地部署到嵌入式設備和移動設備中。在后期的研究中,將進一步擴大數據集規模并優化網絡結構,繼續提升木刻雕版元素的檢測精度和檢測速度。

注:本文通訊作者為趙啟軍。

參考文獻

[1] 蘇發祥.論木刻雕版印刷術在西藏的發展及其影響[J].中央民族大學學報(哲學社會科學版),2017,44(4):115?122.

[2] 黃騰騰,李英娜,王路路,等.基于改進YOLOv7?tiny的變電站多分類缺陷檢測方法[J/OL].控制工程:1?9[2024?03?29].https://doi.org/10.14107/j.cnki.kzgc.20231014.

[3] 貫懷光,郭蓬,夏海鵬,等.基于InfluxDB的自動駕駛智慧貨運平臺的構建及應用[J].現代電子技術,2023,46(9):131?135.

[4] 伍倩,崔煒榮,汪超,等.基于多模態生物特征識別的高校門禁系統設計與實現[J].現代電子技術,2024,47(2):37?43.

[5] 張波,蘭艷亭,李大威,等.基于卷積網絡通道注意力的人臉表情識別[J].無線電工程,2022,52(1):148?153.

[6] DALAL N, TRIGGS B. Histograms of oriented gradients for human detection [C]// 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2005: 886?893.

[7] SáNCHEZ A V D. Advanced support vector machines and kernel methods [J]. Neurocomputing, 2003, 55(1/2): 5?20.

[8] HE K M, ZHANG X Y, REN S Q, et al. Spatial pyramid pooling in deep convolutional networks for visual recognition [J]. IEEE transactions on pattern analysis and machine intelligence, 2015, 37(9): 1904?1916.

[9] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2014: 580?587.

[10] LIU W, ANGUELOV D, ERHAN D, et al. SSD: Single shot MultiBox detector [EB/OL]. [2020?02?12]. http://arxiv.org/abs/1512.02325.

[11] REDMON J, DIVVALA S K, GIRSHICK R B, et al. You only look once: Unified, real?time object detection [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2016: 779?788.

[12] CHEN J, KAO S, HE H, et al. Run, don′t walk: Chasing higher FLOPS for faster neural networks [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2023: 12021?12031.

[13] HOU Q B, ZHOU D Q, FENG J S. Coordinate attention for efficient mobile network design [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2021: 13713?13722.

[14] WANG J, CHEN K, XU R, et al. CARAFE: Content?aware reassembly of features [C]// Proceedings of the IEEE/CVF International Conference on Computer Vision. New York: IEEE, 2019: 3007?3016.

[15] WANG C Y, LIAO H Y M, WU Y H, et al. CSPNet: A new backbone that can enhance learning capability of CNN [C]// Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops. New York: IEEE, 2020: 1571?1580.

[16] LIN T Y, DOLLáR P, GIRSHICK R B, et al. Feature pyramid networks for object detection [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2017: 936?944.

[17] LIU S, QI L, QIN H F, et al. Path aggregation network for instance segmentation [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2018: 8759?8768.

[18] 張新偉,陳東,閆昊,等.基于改進YOLOv5算法的密集遮擋零件檢測[J].工具技術,2023,57(10):150?155.

[19] 鄧佳麗,龔海剛,劉明.基于目標檢測的醫學影像分割算法[J].電子科技大學學報,2023,52(2):254?262.

作者簡介:楊 "欣(1998—),男,陜西眉縣人,碩士研究生,主要研究方向為計算機視覺。

才讓先木(1996—),男,甘肅甘南人,碩士研究生,講師,主要研究方向為計算機視覺。

高定國(1972—),男,四川阿壩人,碩士研究生,教授,主要研究方向為藏文自然語言處理、計算機算法。

夏建軍(1989—),男,湖南邵陽人,博士研究生,主要研究方向為多模態機器學習。

普布旦增(1982—),男,西藏白朗人,碩士研究生,高級實驗師,主要研究方向為自然語言處理、模式識別。

趙啟軍(1980—),男,江蘇鹽城人,博士研究生,教授,主要研究方向為圖像處理、模式識別、計算機視覺和生物特征識別。