一種基于YOLOv5的木板材表面缺陷檢測方法

【摘 要】 針對木板材表面缺陷檢測精度低、缺陷類型不全面和小目標缺陷檢測能力不足等問題,提出一種基于YOLOv5算法的木板材表面缺陷檢測方法。首先在原始YOLOv5算法中使用EfficientViT網絡代替原始的骨干網絡,能更加有效地利用上下文信息,同時具有更快的推理速度,并提供更強的特征增強能力;其次,在head部分添加ECANet注意力機制增強對全局重要特征的提取,同時抑制無關的特征信息;再次,使用Focal-EIoU損失函數代替原有的CIoU,提高預測缺陷邊界框的回歸預測精度,加快回歸損失函數的收斂速度。實驗結果表明:將改進后的算法用于木板材缺陷的檢測,在精度上比原始算法提升了4.3%;改進后模型大小為6.3MB,為原模型大小的一半,提高了缺陷檢測的速度。算法在缺陷檢測任務中具有很高的實用性和效率。

【關鍵詞】 缺陷檢測;YOLOv5;EfficientViT;注意力機制;損失函數

A Method of Wood Surface Defect Detection Based on YOLOv5

Sun Jiangshan, Zhu Qiyue, Sun Xiaonan

(Anhui University of Science and Technology, Huainan 232001, China)

【Abstract】 A wood board surface defect detection method is proposed based on YOLOv5 algorithm to solve the problems of low detection accuracy, incomplete defect types and insufficient detection ability of small target defects in wood board surface defect detection. Firstly, in the original YOLOv5 algorithm, the original backbone network is replaced by EfficientViT network, which more effectively utilizes contextual information, has faster inference speed, and provides stronger feature enhancement ability; secondly, the ECANet attention mechanism is added to the head part to enhance the extraction of globally important features, while suppressing the irrelevant feature information; thirdly, the Focal-EIoU loss function is used to replace the original CIoU, which improves the regression prediction accuracy of the prediction defect bounding box and accelerates the convergence speed of the regression loss function. The experimental results show that the accuracy of the improved algorithm is 4. 3% higher than that of the original algorithm.The size of the improved model is 6. 3MB, which is half of the size of the original model, and the speed of defect detection is improved. The algorithm has high practicability and efficiency in the task of defect detection.

【Key words】 defect detection; YOLOv5; Efficient Vit; attention mechanism; loss function

〔中圖分類號〕 TP391 〔文獻標識碼〕 A 〔文章編號〕 1674 - 3229(2024)03 - 0053 - 07

0 引言

在木材加工和生產過程中,檢測木材中的缺陷(如裂紋、孔洞、疤痕等)對確保產品質量和安全非常重要。木材的缺陷檢測分為人工檢測和自動檢測兩種方法。人工檢測通常需要經驗豐富的工人來檢查木材表面的缺陷,如裂紋、疤痕、色差等,需要花費大量的時間和人力成本。自動檢測則是利用圖像處理技術和機器學習算法來識別和分析木材表面的缺陷,可以實現快速、準確的檢測,并且可以大大節省人力成本。因此,自動檢測在工業生產中越來越受到重視,能夠提高生產效率和產品質量。

對木材缺陷的自動檢測是目標檢測的一個應用方向。深度學習在目標檢測中的應用主要體現在使用深度神經網絡來提取圖像特征,傳統方法通常需要使用手動設計的特征提取器,而深度學習可以自動地從數據中學習到更具有判別性的特征表示,從而提高目標檢測的準確性和魯棒性。在基于深度神經網絡的目標檢測中,最主流的兩個方法是一階段(one-step)和二階段(two-step)檢測方法。一階段目標檢測方法將目標檢測任務視為一個單一的端到端問題,而現今最主流的算法依然是YOLO和SSD。二階段目標檢測方法將目標檢測任務分為兩個階段,先生成候選物體位置,再對這些候選位置進行分類,其中最主流的是R-CNN、Fast R-CNN、Faster R-CNN等算法。

隨著深度神經網絡的發展,工業缺陷檢測近年來取得了極大的進展。Che等[1]將骨干網絡ResNet-101替換為VGG16,利用深度可分離卷積和Soft-NMS對Faster R-CNN算法進行優化,降低瓷磚缺陷的漏檢率。鄧光偉等[2]將C3C2F(全局注意模塊)引入網絡的主干層后,采用CARAFE算子,把特征圖中的小目標信息充分保留了下來。Yang等[3]設計了監督空間注意模塊(SSAM)與YOLOv5算法相結合的方法,抑制鋼表面沒有缺陷的區域,使算法更關注有缺陷的區域。Liu等[4]將新的卷積算子集成到擴展高效層聚合網絡中,結合動態非單調聚焦機制的Wise-IoU v3損失函數,提出了PRC-Light YOLO模型,顯著提升了對7種織物缺陷檢測的準確性。Xiao等[5]將transformer 與 Bi-FPN相結合,提出了YOLOv5-TB模型,能夠準確、快速地檢測出鍍鋅鋼表面的帶狀缺陷。Tu等[6]采用CIoU損失代替原有的IoU損失,提出GC-YOLOv3模型,提升了檢測橡膠木和松木缺陷的精度。Fan等[7]首先使用ResNet V2結構對獲取的實木板材缺陷圖像進行特征提取,接著應用Faster R-CNN算法進行實木缺陷的檢測,可有效檢測各種缺陷。Ding等[8]引入DenseNet121網絡取代傳統SSD算法中的VGG16網絡,并采用殘差學習的思想,在增加網絡深度的同時避免特征圖信息的丟失。朱豪等[9]將CA注意力機制引入Backbone中,結合HSPPF和GSConv,能有效識別出木材的4種表面缺陷。

為解決小目標缺陷漏檢和缺陷檢測精度較低等問題,需要對模型進行改進。本文以YOLOv5網絡為基準網絡,在其算法上進行改進,提出一種快速檢測木板材缺陷的方法YOLO-WDD。

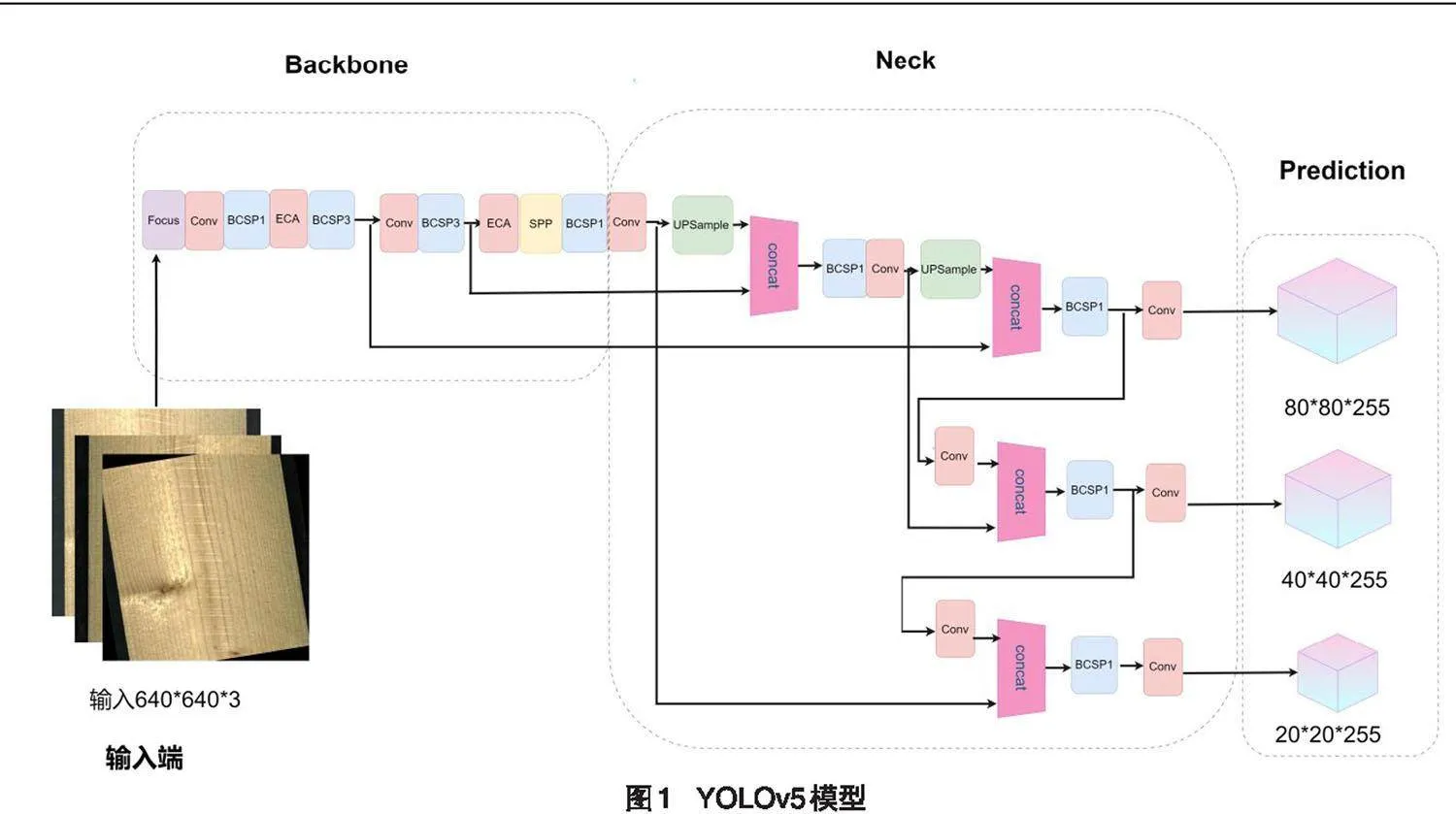

1 YOLOv5算法模型

YOLOv5是由Ultralytics 軟件開發團隊開發的基于pytorch版本的輕量且高性能的單階段目標檢測算法。根據不同的輸入大小和性能要求,劃分為4個版本:YOLOv5s、YOLOv5m、YOLOv5l、YOLOv5x。這4個版本的模型隨著規模的增大,其深度參考值(depth_multiple)和寬度參考值(width_multiple)逐漸增大。該目標檢測的模型主要由輸入端、骨干網絡、Neck和輸出層這4個模塊構成。Input端負責接收原始的圖像數據,對圖像數據進行尺寸調整、通道處理、歸一化和批處理等相關操作;骨干網絡采用了CSPDarknet53結構,該網絡的主要作用是從輸入的圖像數據中獲取多種尺度和層次的特征表示,使得模型能夠有效地檢測不同大小和不同類別的目標;Neck層是指網絡結構中位于骨干網絡(backbone)和檢測頭(detection head)之間的部分,通常用于進一步處理主干網絡提取的特征圖并準備將其傳遞給檢測頭,由PANet(Path Aggregation Network)+特征金字塔+卷積層構成;輸出端由一系列卷積層和操作組成,從特征圖中提取和解碼目標檢測的信息。其網絡結構如圖1所示。

2 改進的YOLOv5

2.1 主干網絡的改進

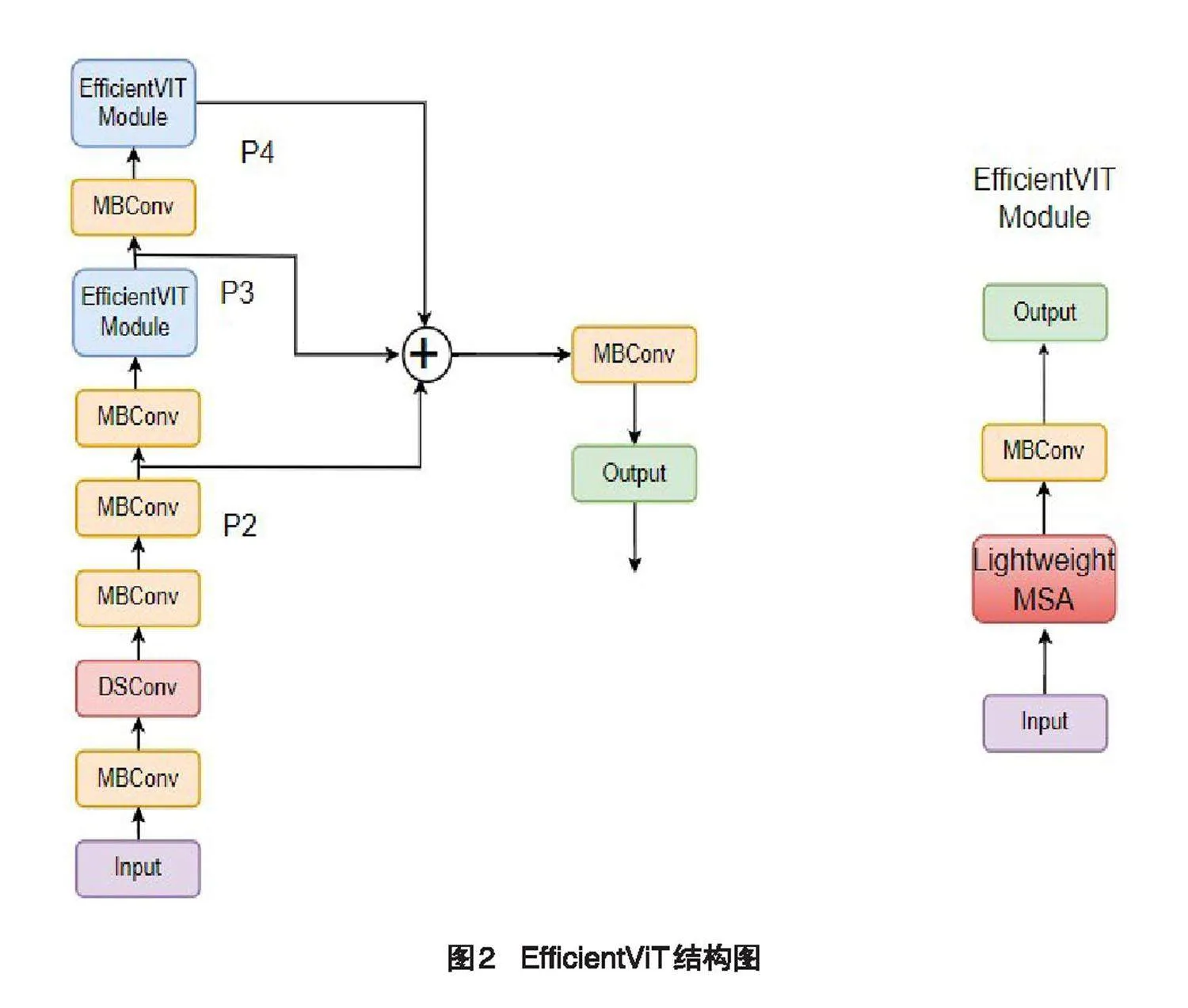

原始的YOLOv5算法采用的骨干網絡是深度神經網絡CSPDarknet53,基于Darknet架構,通過引入CSPNet(Cross Stage Partial Network)結構來提升特征的傳遞和融合能力,從而提高網絡的性能和效率,然而其結構網絡包含大量的卷積層和參數,導致其計算的復雜性高,內存占用量大,并且在嵌入式設備或資源受限的環境中難以適應。因此,為了滿足算法輕量化的要求,在原算法骨干網絡中使用EfficientViT(Efficient Vision Transformer)代替CSPDarknet53,減少模型的復雜性和計算資源的需求。

EfficientViT是MIT-IBM Watson AI Lab在傳統的ViT模型上進行改進得到的,結合了深度學習和自然語言處理技術的圖像處理方法,它將圖像分割成不同的塊,然后將這些塊嵌入到Transformer模型中進行處理,使模型能夠更好地捕捉圖像中的上下文信息。EfficientViT的核心組件是一個輕量級MSA(Lightweight MSA)模塊和MBConv模塊,讓模型有效地捕捉不同層次和尺度的信息,從而提高模型在處理圖像樣本數據時的效率和性能。EfficientViT的結構如圖2所示。

其中MBConv(Mobile Inverted Residual Block)模塊負責捕捉局部信息,采用了深度可分離卷積DSC和反向殘差連接IRC技術來提高網絡的效率,深度卷積和逐點卷積是DSC將卷積操作分解成的兩個階段,旨在降低參數數量和計算負擔,提高模型的效率。IRC提高網絡的表示能力,緩解梯度消失問題,并加速訓練過程。MBConv模塊結合了這些技術,使在移動設備上構建高效神經網絡變得更加容易,可用于各種應用。

Lightweight MSA是一種多頭自注意力機制,由自注意力、多頭注意力、線性變換和信息融合組成,它們協同工作以捕獲圖像的重要信息。該模塊負責捕捉上下文的信息,處理輸入數據中特征之間的關系。具有較少的注意頭(attention heads)和較低的維度,以便在保持性能的同時降低計算成本。這使得EfficientViT在保持較高性能的同時,具有較小的模型尺寸,更適合在嵌入式設備和資源受限的環境中使用。在EfficientViT中,Lightweight MSA被用來處理輸入圖像的不同部分,以便模型理解圖像中的不同特征和關系。Lightweight MSA結構如圖3所示。

輕量級的MSA結構先通過線性投影層獲得Q、K、V標記,然后通過輕量級的小核卷積聚合附近的標記生成多尺度的標記,這些多尺度的標記通過輕量級的基于ReLU的全局注意力進行處理,并將結果串聯輸出送入到最后的線性投影層進行一系列的特征融合。

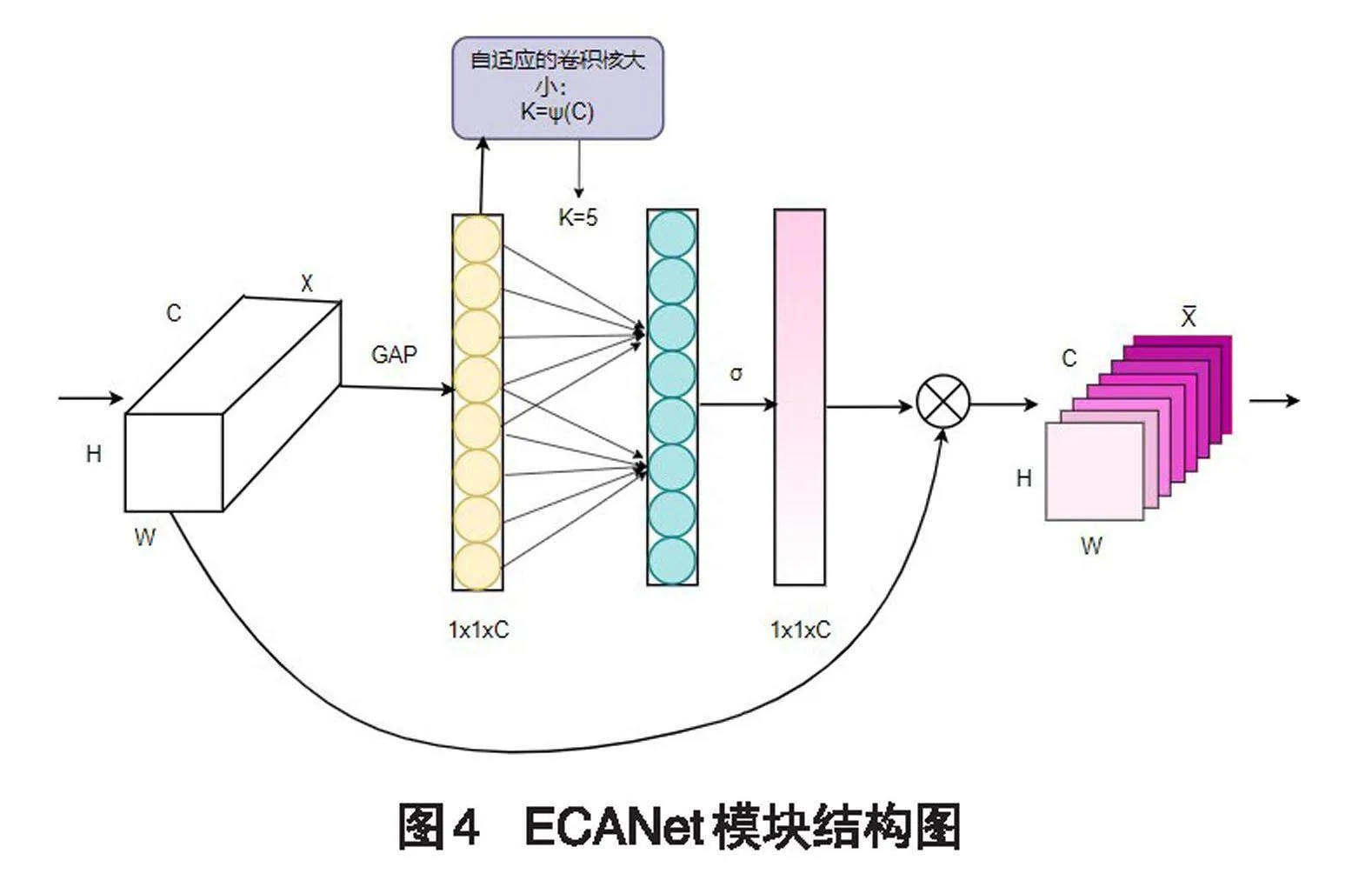

2.2 注意力模塊的添加

在神經網絡中添加注意力模塊是為了幫助網絡更好地捕捉目標對象的關鍵特征,提高檢測的精度和魯棒性,提高實際應用中的目標檢測性能。ECANet(Efficient Channel Attention Network)是一種基于SE-Net(Squeeze-and-Excitation Network)注意力機制的改進型注意力網絡。SE-Net中attention模塊的兩個非線性全連接層(FC)涉及到了復雜的降維操作,在通道的注意預測中帶來了一定的副作用且效率低,而ECANet注意力機制在卷積操作中引入通道注意力機制,在沒有降維的情況下對通道進行了全局的平均池化,減少了計算的負擔,同時通過一維卷積實現跨通道的交互,ECANet注意力模塊的結構示意圖如圖4所示。

在圖4中全局平均池化層是GAP,ECANet首先通過通道維度非線性地自適應確定卷積核大小K,接著執行卷積核大小為K的快速一維卷積,最后通過Sigmoid函數來學習通道注意力。

決定交互作用覆蓋率的關鍵參數K(卷積核大小)與濾波器數量有關,通常被設置為2的整數次方。兩者之間映射函數如下:

[W=Φ(K)=2(γ*k-b)] (1)

給定濾波器的數量W(即通道數),自適應的卷積核大小K計算如下:

[K=ψ(W)=log2(W)γ+bγodd] (2)

2.3 損失函數的優化

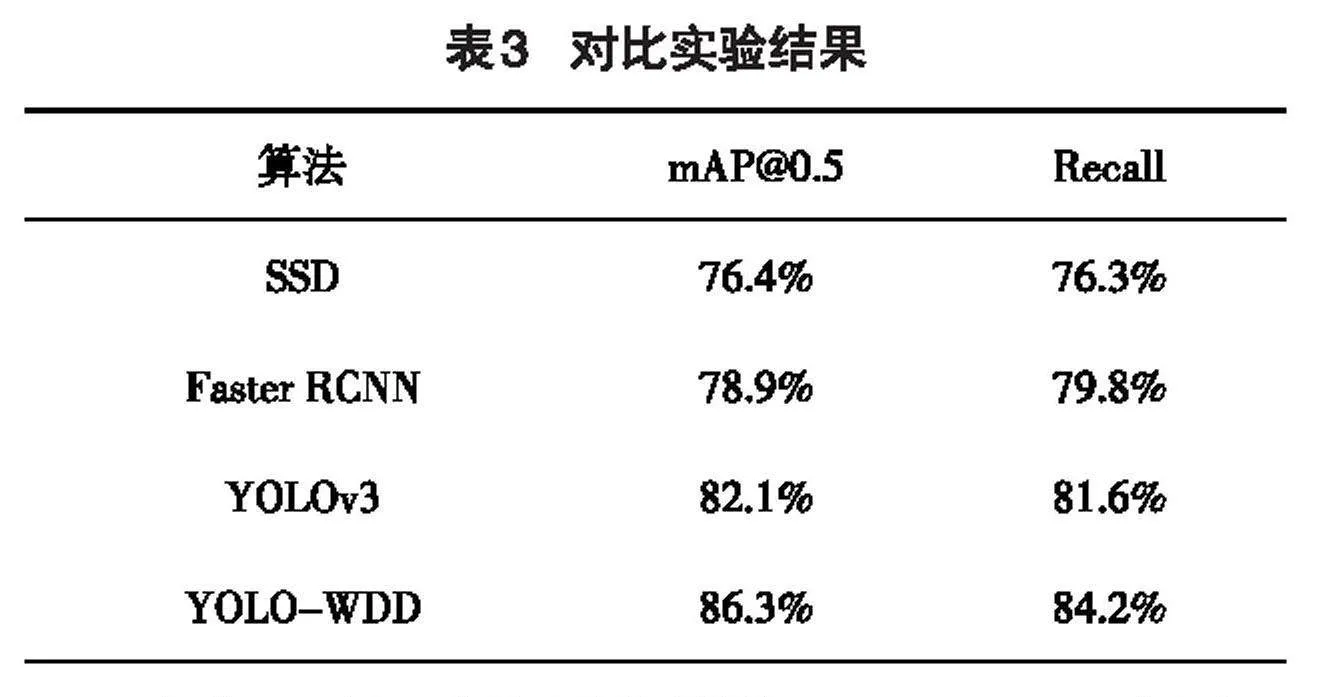

YOLOv5的總損失函數包括分類損失、定位損失和置信度損失三部分,原始算法采用了二元交叉熵來計算類別概率和目標置信度分數的損失。主要采用CIoU Loss作為邊界框回歸的損失函數,其定義如下:

[LCIoU=1-U+ρ2(b,bgt)C2+αv] (3)

其中:[U=A?BA?B],C是能夠同時覆蓋預測框和真實框的最小包圍框的對角線長度,[ρ2(b,bgt)]代表了預測框的中心點和真實框的中心點之間的歐式距離。[α]和[v]通過比較預測框和真實邊界框之間寬度和高度的比值來評估它們的差異。

CIoU在進行收斂時可能會導致預測框回歸時的寬和高不能同時增大或者減少,無法進行回歸優化。在計算框高的差異值時,EIoU以CIoU的懲罰項為基礎進行計算,以替代縱橫比。EIoU寬高損失直接使預測框與真實框的寬度和高度之差達到最小,使得模型收斂速度更快,準確性更高。EIoU損失函數定義如公式(4):

[LEIoU=LU+Ldis+Lasp=1-U+ρ2(b,bgt)(wc)2+(hc)2+ρ2(w,wgt)(wc)2+ρ2(h,hgt)(hc)2] (4)

該公式包括三個部分:預測邊界框和真實邊界框的U重疊損失([LU])、預測邊界框和真實邊界框的中心距離損失([Ldis])、預測邊界框和真實邊界框的寬和高損失([Lasp])。[wc]和[hc]是覆蓋預測框和真實邊界框的最小包圍框的寬度和高度。

由于數據集存在著訓練數據樣本不平衡的問題,使圖像中回歸誤差小的高質量預測框的數量遠低于低質量預測框的數量,質量差的數據在訓練過程中會產生過大的梯度,影響訓練的過程,因此Focal-EIoU Loss被提出用來提高EIoU損失的準確性。通過整合EIoU Loss和FocalL1 Loss,本模型大大提高了融合的速度和定位的精確度,Focal-EIoU Loss損失函數如公式(5):

[LFocal-EIoU=UγLEIoU] (5)

超參數[γ]用來控制對異常值的抑制程度。

3 仿真實驗與結果分析

3.1 實驗環境及其配置

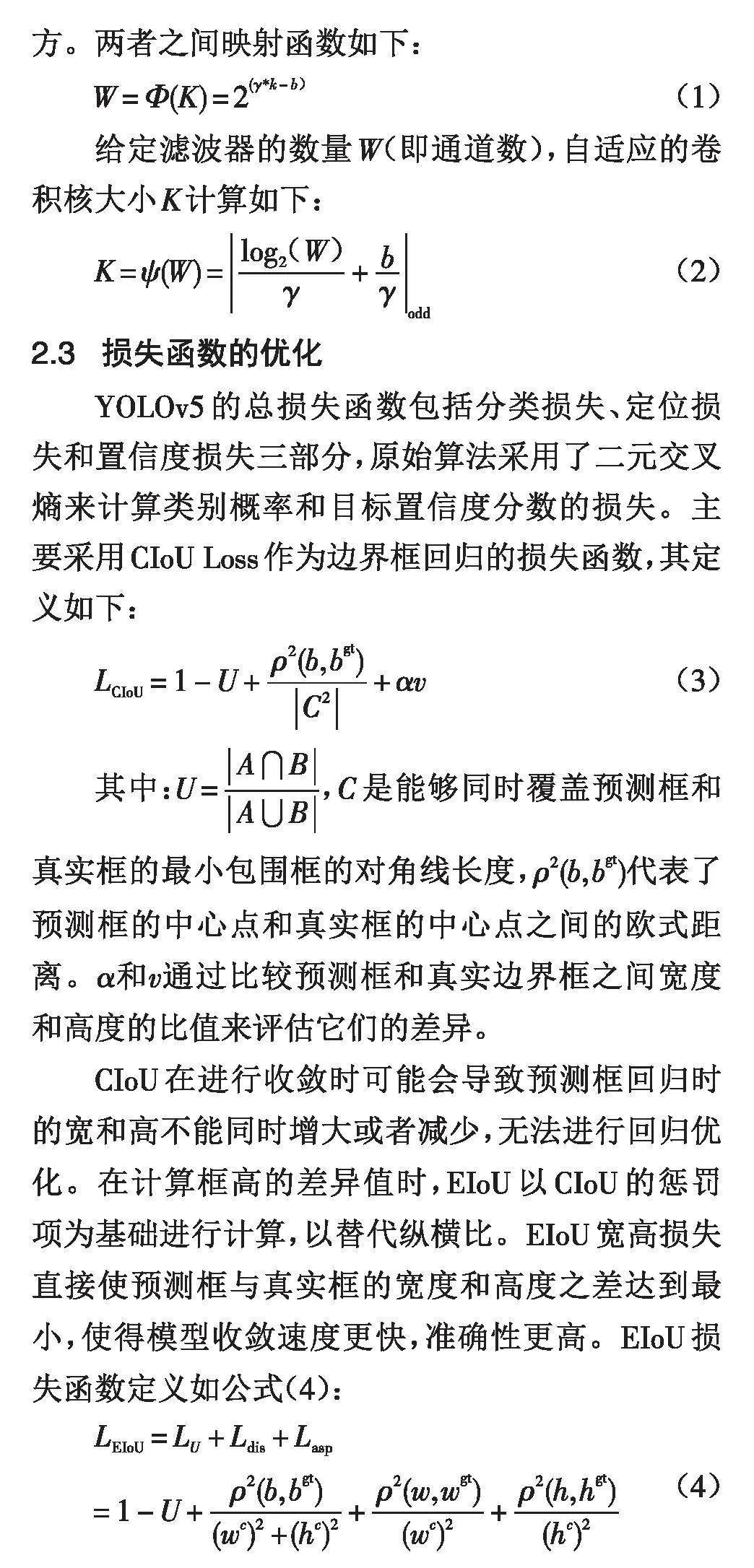

本研究使用的算法模型采用SGD優化器進行訓練,設置訓練輸入圖像尺寸為640×640,bath-size為16,其他配置如表1所示。

3.2 數據采集與處理

3.2.1 實驗數據

本研究采用的樣本數據集來自于roboflow網站中的木材缺陷圖片和在網絡上搜集到的圖片,并使用該網站對木材缺陷進行標注,共7種缺陷,包含活節(Live Knot)、死節(Dead Knot)、有裂縫的節(Knot With Crack)、缺節(Knot Missing)、樹脂(Resin)、樹髓(Marrow)和裂縫(Crack)。該數據集共有769張圖片。

3.2.2 數據增強

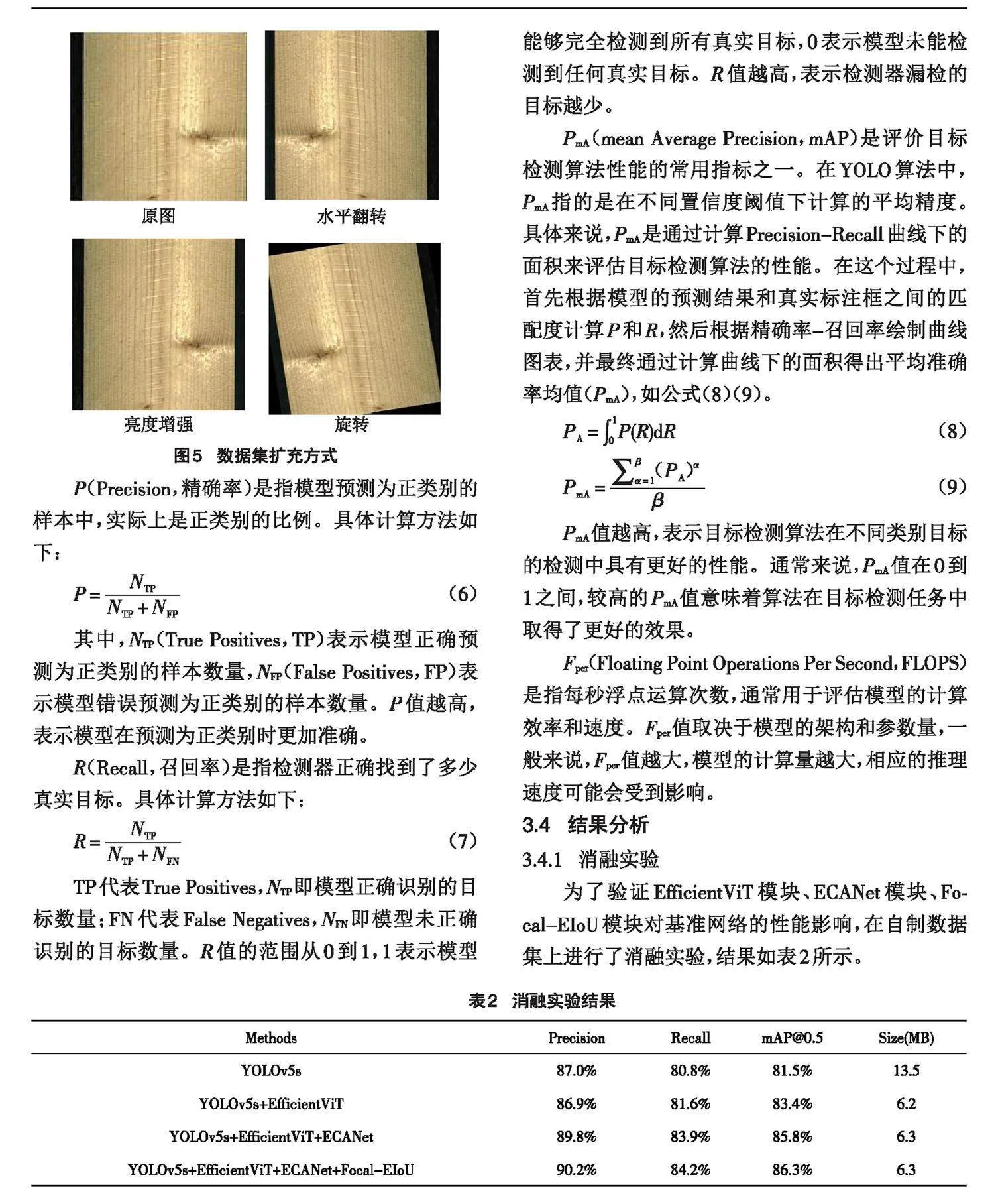

為了避免因樣本數據不夠造成的過擬合問題,使用翻轉、旋轉、亮度增強等方法對數據集進行了擴充,如圖5所示。經過擴充后的數據集共有1826張圖片,按8:1:1的比例劃分為訓練集、測試集和驗證集。

3.3 評價指標

在目標檢測算法中,常用的評價指標有P(Precision)、R(Recall)、PA(Average Precision,AP)、PmA(mean Average Precision,mAP)以及Fper(Floating Point Operations Per Second,FLOPS)。

P(Precision,精確率)是指模型預測為正類別的樣本中,實際上是正類別的比例。具體計算方法如下:

[P=NTPNTP+NFP] (6)

其中,NTP(True Positives,TP)表示模型正確預測為正類別的樣本數量,NFP(False Positives,FP)表示模型錯誤預測為正類別的樣本數量。P值越高,表示模型在預測為正類別時更加準確。

R(Recall,召回率)是指檢測器正確找到了多少真實目標。具體計算方法如下:

[R=NTPNTP+NFN] (7)

TP代表True Positives,NTP即模型正確識別的目標數量;FN代表False Negatives,NFN即模型未正確識別的目標數量。R值的范圍從0到1,1表示模型能夠完全檢測到所有真實目標,0表示模型未能檢測到任何真實目標。R值越高,表示檢測器漏檢的目標越少。

PmA(mean Average Precision,mAP)是評價目標檢測算法性能的常用指標之一。在YOLO算法中,PmA指的是在不同置信度閾值下計算的平均精度。具體來說,PmA是通過計算Precision-Recall曲線下的面積來評估目標檢測算法的性能。在這個過程中,首先根據模型的預測結果和真實標注框之間的匹配度計算P和R,然后根據精確率-召回率繪制曲線圖表,并最終通過計算曲線下的面積得出平均準確率均值(PmA),如公式(8)(9)。

[PA=01P(R)dR] (8)

[PmA=α=1β(PA)αβ] (9)

PmA值越高,表示目標檢測算法在不同類別目標的檢測中具有更好的性能。通常來說,PmA值在0到1之間,較高的PmA值意味著算法在目標檢測任務中取得了更好的效果。

Fper(Floating Point Operations Per Second,FLOPS)是指每秒浮點運算次數,通常用于評估模型的計算效率和速度。Fper值取決于模型的架構和參數量,一般來說,Fper值越大,模型的計算量越大,相應的推理速度可能會受到影響。

3.4 結果分析

3.4.1 消融實驗

為了驗證EfficientViT模塊、ECANet模塊、Focal-EIoU模塊對基準網絡的性能影響,在自制數據集上進行了消融實驗,結果如表2所示。

對該表進行分析,用輕量級EfficientViT網絡替換原始的骨干網絡后,模型大小直接變為原來的一半,其精度也有所下降。接著在網絡的頸部和backbone嵌入注意力機制ECANet,在模型大小基本保持不變的基礎上,精度有了明顯的提升。最后在改進模型中添加Focal-EIoU損失函數,提高模型的性能并加快訓練時的收斂速度。從表中可知經過改進的算法在多個評估指標上均表現出優勢。

3.4.2 對比實驗

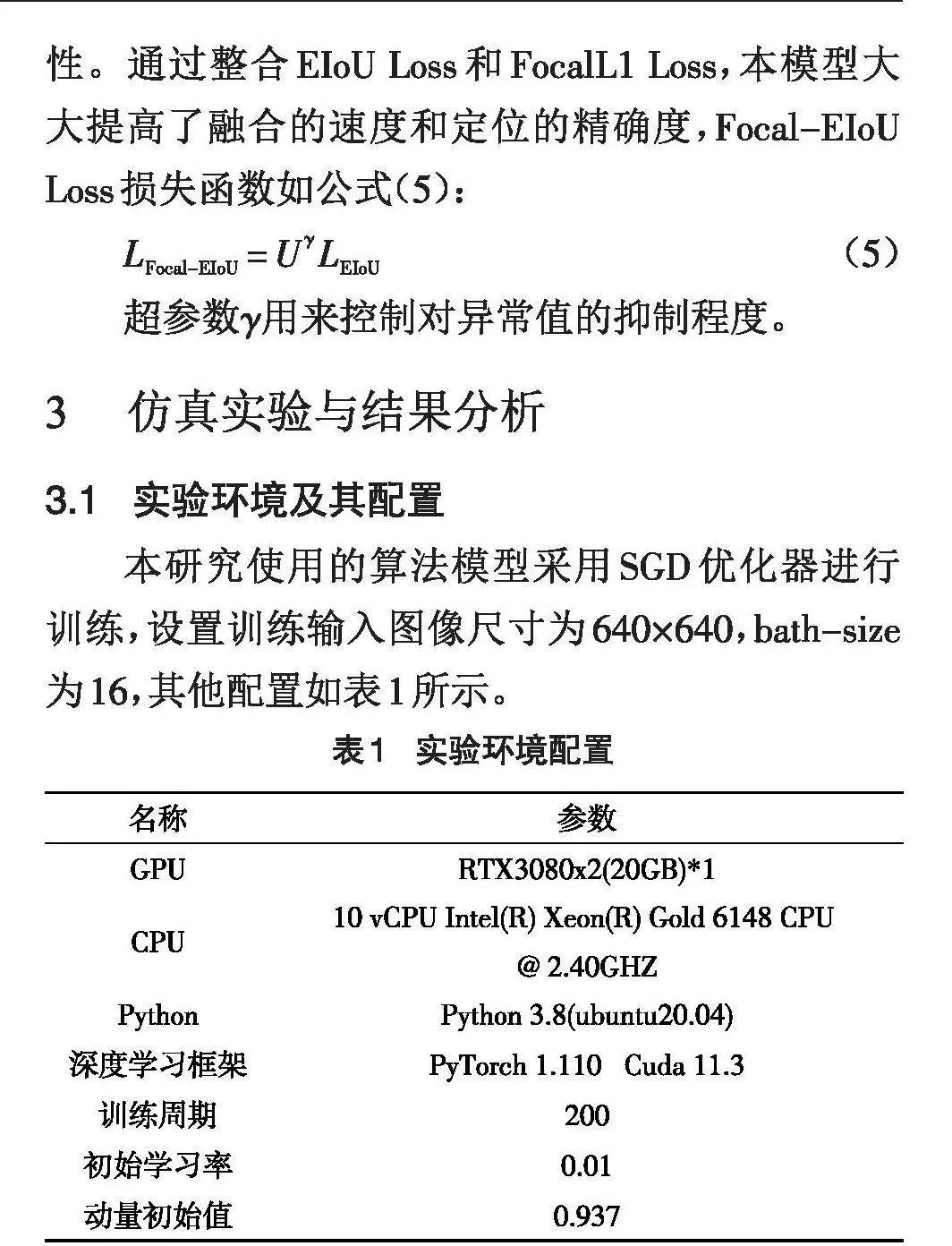

為了驗證所提方法YOLO-WDD(即YOLOv5s+EfficientViT+ECANet+Focal-EIoU模型)的性能,在自制數據集上進行實驗,并且與一些主流算法進行比較,結果如表3所示。

由表3可知改進后的算法YOLO-WDD在平均精度和召回率上明顯高于其他主流的目標檢測算法,對木材缺陷檢測具有更好的效果。

4 結論

為了滿足工業中對木材缺陷檢測的需求,提出了一種對木材缺陷進行快速檢測的模型YOLO-WDD。本研究基于YOLOv5s算法,用輕量級網絡EfficientViT代替原本的特征提取網絡,在保持高準確率的同時減少模型的參數數量和計算復雜度;然后在該模型算法中引入ECANet注意力機制,該注意力機制增強了網絡對重要區域的關注,減少了對噪聲的敏感性,并提高了對小目標的檢測能力;最后在算法中引入的損失函數Focal-EIoU,解決了木材缺陷類別不平衡問題,提升了對木材缺陷定位的準確性。YOLO-WDD模型在各項指標評估中都優于原始模型,可用于工業生產中對木材缺陷的快速檢測。

[參考文獻]

[1]Che X, Zhu W. Tile surface defect detection based on improved faster R-CNN[J]. Academic Journal of Science and Technology, 2023, 7(1): 184-190.

[2] 鄧光偉, 尤紅權, 朱志松. 基于KCC-YOLOv5的鋁型材表面缺陷檢測[J]. 激光與光電子學進展, 2024, 61(4):231-239.

[3]Yang T, Li J. Steel surface defect detection based on SSAM-YOLO[J]. International Journal of Information Technologies and Systems Approach (IJITSA), 2023, 16(3): 1-13.

[4] Liu B, Wang H, Cao Z, et al. PRC-Light YOLO: An efficient lightweight model for fabric defect detection[J]. Applied Sciences, 2024, 14(2): 938.

[5] Xiao D, Xie F T, Gao Y, et al. A detection method of spangle defects on zinc-coated steel surfaces based on improved YOLOv5[J]. The International Journal of Advanced Manufacturing Technology, 2023, 128(1-2): 937-951.

[6] Tu Y, Ling Z, Guo S, et al. An accurate and real-time surface defects detection method for sawn lumber[J]. IEEE Transactions on Instrumentation and Measurement, 2020, 70: 1-11.

[7] Fan J, Liu Y, Hu Z K, et al. Solid wood panel defect detection and recognition system based on faster R-CNN[J]. Journal of Forestry Engineering,2019,4(3): 112-117.

[8]Ding F, Zhuang Z, Liu Y, et al. Detecting defects on solid wood panels based on an improved SSD algorithm[J]. Sensors,2020,20(18): 5315.

[9]朱豪,周順勇,曾雅蘭,等.基于改進YOLOv5s的木材表面缺陷檢測模型[J].木材科學與技術,2023,37(2):8-15.

責任編輯 孫 澗

[收稿日期] 2024-04-11

[基金項目] 國家自然基金項目(51274011);安徽省自然科學基金(2308085MF218);安徽省高等學校科學研究項目(2022AH040113)

[作者簡介] 孫姜珊(1997- ),女,安徽理工大學計算機科學與工程學院碩士研究生,研究方向:目標檢測。