基于改進YOLOv3樹上板栗栗蓬目標檢測方法

摘要:板栗人工采收效率低、勞動強度大、易傷人,基于機器視覺的無人機采摘板栗栗蓬既高效又安全、為了快速識別和準確定位自然環境下板栗栗蓬目標,提出一種改進YOLOv3網絡結構的YOLOvc栗蓬目標檢測方法。通過在網絡YOLOv3層前端添加融合通道注意力與空間注意力機制的CBAM注意力機制模塊,提高深度學習網絡模型對小栗蓬目標特征提取能力。在YOLOv3原有損失函數基礎上添加焦點損失函數,提高對栗蓬遮擋等難分樣本的檢測識別能力。試驗結果表明,YOLOvc算法能夠有效檢測板栗栗蓬,其查準率和平均精度分別達到89.35%、89.37%。消融試驗對比結果顯示,改進YOLOv3卷積神經網絡對板栗樹上栗蓬的檢測識別精度比YOLOv3提高2.21%。研究結果表明,對YOLOv3添加注意力機制和焦點損失函數的深度學習算法YOLOvc可有效實現板栗樹上栗蓬檢測定位,為無人機采收板栗提供有效技術支持。

關鍵詞:板栗栗蓬;YOLOv3;目標檢測;CBAM;焦點損失

中圖分類號:S225; TS736+.4 文獻標識碼:A 文章編號:2095?5553 (2024) 11?0209?06

Object detection method for chestnut peng in the tree based on improved YOLOv3

Li Zhichen, Ling Xiujun, Li Hongqiu, Luo Weiping

(School of Mechanical & Electrical Engineering, Jinling Institute of Technology, Nanjing, 211169, China)

Abstract: The artificial harvesting of Chinese chestnut is low efficiency, high labor intensity and easy to hurt people. Chestnut positioning and picking by unmanned aerial vehicle (UAV) based on machine vision are both efficient and safe. To quickly identify and accurately locate chestnut targets in natural environment, a YOLOvc chestnut target detection method with improved YOLOv3 network structure is proposed. By adding the CBAM attention mechanism module integrating channel attention and spatial attenti47b5abdeb02d5c27ccdd86c653218d3bon mechanism to the front end of the network YOLOv3 layer, the extracting little target features ability of deep learning network model 0d19dc94f693f5d5c46eae06bd149a8bis improved. Secondly, the focal loss function is added on the basis of the original loss function of YOLOv3 to improve the detection and identification ability of difficult samples such as chestnut occlusion. The results show that YOLOvc algorithm can effectively detect chestnut, its accuracy rate and average accuracy are 89.35% and 89.37% respectively.The results of the ablation experiments showed that the precision of improved YOLOv3 convolutional neural network was 2.21% higher than the YOLOv3. The research results show that the deep learning algorithm YOLOvc by adding attention mechanism and focus loss function to YOLOv3 can effectively realize chestnut detection and localization on trees and provide effective technical support for chestnut harvesting by UAV.

Keywords: chestnut peng; YOLOv3; object detection; CBAM; focal loss

0 引言

板栗營養豐富、香甜可口,是人們喜愛的干果零食,經常食用具有益氣健脾、補腎強筋等保健作用,我國板栗種植面積居于世界首位。板栗采收主要有兩種方法:人工撿拾完全成熟后自然掉落板栗果和用長桿敲打板栗蓬再收集打落栗蓬,這兩種板栗采收方法效率較低。在山東省五蓮縣,大多采用第二種方法采收板栗,每年都有敲打高空栗蓬脫落傷到人頭部甚至是眼睛的事件發生。隨著農村壯勞力外出務工,老人已經沒有能力爬到丘陵的山腰及山頂,從而放棄采收成熟板栗,浪費掉自然贈與的綠色食品。

針對板栗采收人工成本髙、采收難問題,板栗采收機能降低板栗種植成本和提高農民收入。華中農業大學研制完成拍打式板栗采收機,該機不僅能夠適合平地和低丘陵山地板栗采收,而且隨動式板栗收集車能自動跟隨并收集掉落板栗,使采收效率大大提高,為板栗收獲機械進一步研制提供有力方案[1]。但該機對海拔高坡度陡的山腰和山頂板栗采收顯得無能為力,無人機采收不失為一個更好方案。采摘無人機通過自身末端采摘器,可對陡坡山地果樹高空采摘作業,實現對高處果實采摘,能夠提高效率、降低成本和安全風險。國內外已經開展對采摘無人機研究,以色列在2020年推出果園采摘無人機,該機采用視覺識別和定位果實,通過前身機械臂包住果實旋轉,從而收獲果實[2]。張桃桃利用改進可拓設計方法設計無人機水果采摘機,運用雙目視覺對采摘仿真結果顯示,視覺能夠準確獲取果實目標三維信息[3]。雒鷹初步設計紅松果采摘無人機,該機實現視覺對松果識別與定位,通過遙控無人機機械手完成對松果剪切采摘[4]。

視覺識別系統是采摘無人機或機器人系統的組成部分,對目標檢測識別定位具有重要作用。隨著深度學習在農作物檢測中興起,深度學習目標檢測方法逐步取代傳統機器視覺方法,YOLO就是一種基于深度學習的物體目標檢測算法,該算法運算時間短、速度快、成本低,適合農產品目標檢測。許多研究學者利用YOLO系列算法實現了果實目標高效檢測識別。劉小剛等[5]利用改進YOLOv3識別方法在復雜環境中對草莓連續識別檢測,成熟草莓識別準確率為97.14%,并且對復雜環境具有良好魯棒性。宋懷波等[6?7]利用YOLOv5s卷積神經網絡模型檢測識別油茶果,對遮擋和弱光線環境下油茶果實現了高精度識別與定位,并提出一種融合高效通道注意力機制的改進YOLOv7模型實現了蘋果幼果快速準確檢測。陳仁凡等[8]提出一種基于改進輕量化YOLOv5s模型用于溫室草莓成熟度檢測,速度快、準確率高,能夠實現草莓生長狀態監測。劉莫塵等[9]借鑒人體姿態檢測算法改進YOLOv8-Pose模型識別紅熟期草莓與果柄關鍵點檢測,識別與檢測的精度高且對遮擋、光線和拍攝角度等影響均具有較好的魯棒性。張伏等[10]提出一種基于改進YOLOv4-LITE神經網絡的圣女果識別定位方法,該方法具有識別速度快、識別準確率高、輕量化特點。李天華等[11]提出一種基于YOLOv4與HSV相結合的識別成熟期番茄方法,該方法通過HSV處理,對自然環境下成熟期番茄識別的正確率達到94.77%。黃麗明等[12]利用深度可分離卷積和倒殘差結構改進YOLOv4算法,提高識別無人機遙感影像上松材線蟲病異常變色木的精度和效率。鮑文霞等[13]通過添加坐標注意力機制和轉換預測頭為Transformer方法,設計一種麥穗檢測模型,提高了無人機圖像麥穗計數精度。汪斌斌等[14]使用無人機采集試驗田玉米雄穗影像,分析了不同YOLO模型對不同品種和不同種植密度玉米雄穗的識別檢測效果。

上述文獻雖然實現了某些農產品的識別檢測,但如何實現栗蓬準確識別與定位以及栗蓬成熟度判別是板栗無人機采摘必須首先解決的問題。雖然YOLO已經發展到v8版本,但YOLOv3在目標檢測領域算法成熟、能夠高效率地高速運行、目標檢測識別速度和精度高,可實現端到端的目標識別檢測,所以應用仍然非常廣泛。板栗栗蓬體積不大,在板栗樹上分布密集。栗蓬鄰接和遮擋現象很多,在自然場景下受光照變化影響較難識別,所以鮮有板栗栗蓬檢測的文獻。本研究通過增加焦點損失函數(Focal Loss)和在卷積模塊中添加注意力機制對YOLOv3算法改進,利用改進YOLOv3模型對板栗樹上栗蓬自動檢測識別,為今后無人機采摘板栗打下理論基礎。

1 材料與方法

1.1 圖像采集及數據集制作

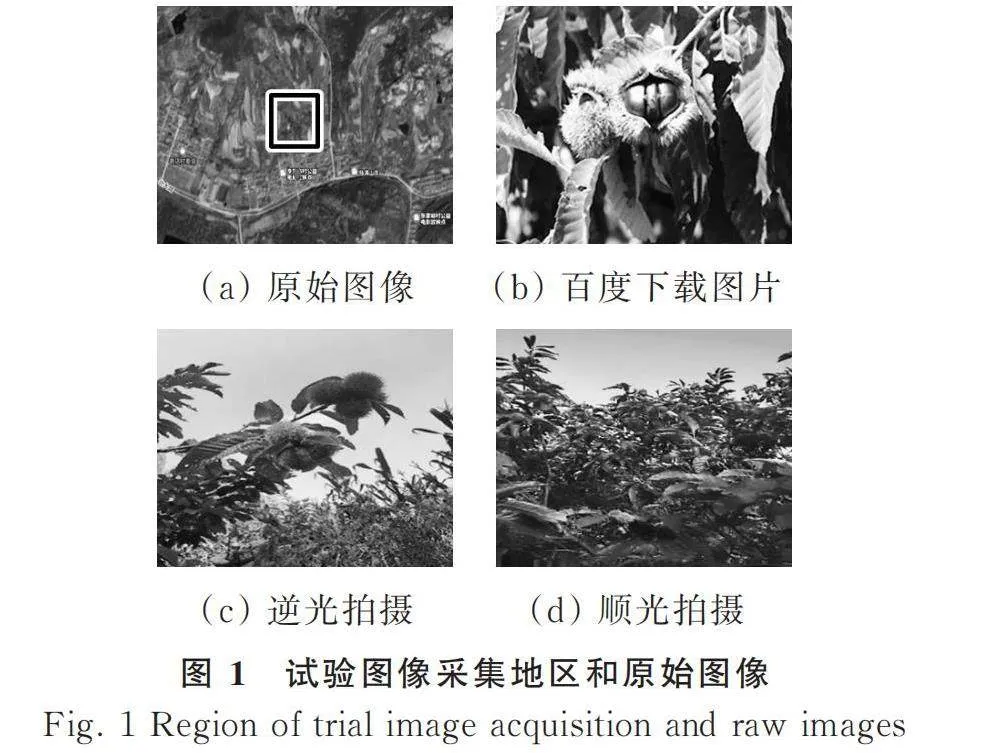

試驗數據采集于山東省五蓮縣松柏鎮李家峪村后山板栗林,如圖1(a)所示。五蓮縣地處黃海之濱的魯東南低山丘陵區,海拔高度在18~706 m之間,地理坐標為東經118°55′~119°32′,北緯35°32′~35°59′,五蓮縣屬溫帶季風氣候,一年四季周期性變化明顯,季節性降水明顯,日照充足,熱能豐富。年平均氣溫13.2 ℃,歷年平均降雨量747 mm。五蓮的地理位置和氣候特點適合板栗生長并且品質優良,但由于地處丘陵導致采摘困難。

板栗成熟果實為暗紅色呈開口狀態,但栗農為防止板栗果脫落,在板栗栗蓬還沒有開口的時候就收獲回去再脫蓬,因此大部分栗蓬在收獲時還呈綠色狀態,與板栗樹葉顏色一致,增加檢測識別難度,用小米手機拍攝于2023年9月29日—10月3日,相機分辨率為2 976像素×3 968像素,為保證板栗樹樣本多樣性,分別在不同時間段、不同天氣狀況下和不同遮擋條件下拍攝板栗樹栗蓬圖像,既有順光拍攝圖像又有逆光拍攝圖像。為增加圖像地域適應性,還有小部分圖像來自于百度圖片。原始圖像如圖1(a)所示,圖1(b)是百度下載圖片,圖1(c)是逆太陽光拍攝板栗樹上栗蓬圖片,圖1(d)是順太陽光拍攝板栗樹上密集分布栗蓬圖像。共獲取942幅影像,將所有圖像分為訓練和驗證2組,其中訓練組有844幅圖像,驗證組圖像數量為98幅。

采用Labelme工具手工標注包圍板栗栗蓬矩形框,生成json標簽文件。研究者編寫一個由json轉換成txt文件的腳本,利用這個腳本把人工標注json標簽文件轉換成txt文件,板栗栗蓬識別目的是僅僅識別栗蓬這一類目標,因此圖像被分為栗蓬目標與背景兩類。

1.2 試驗設備及參數設置

研究模型訓練和測試均在同一環境下運行,軟件環境為64位Windows10專業版系統,處理器為AMD Ryzen5 3550,主板版本為SDK0 L77769 WIN,16 GB運行內存,PyTorch深度學習框架。根據以往對卷積神經網絡應用于農產品檢的測研究,自適應矩估計(Adaptive moment estimation,Adam)優化器是最優優化函數[15],動量因子設置為0.9,學習率參數數值設置為0.001,由于訓練用計算機內存較小,模型超參數設置批樣本(batch size)數量為8。

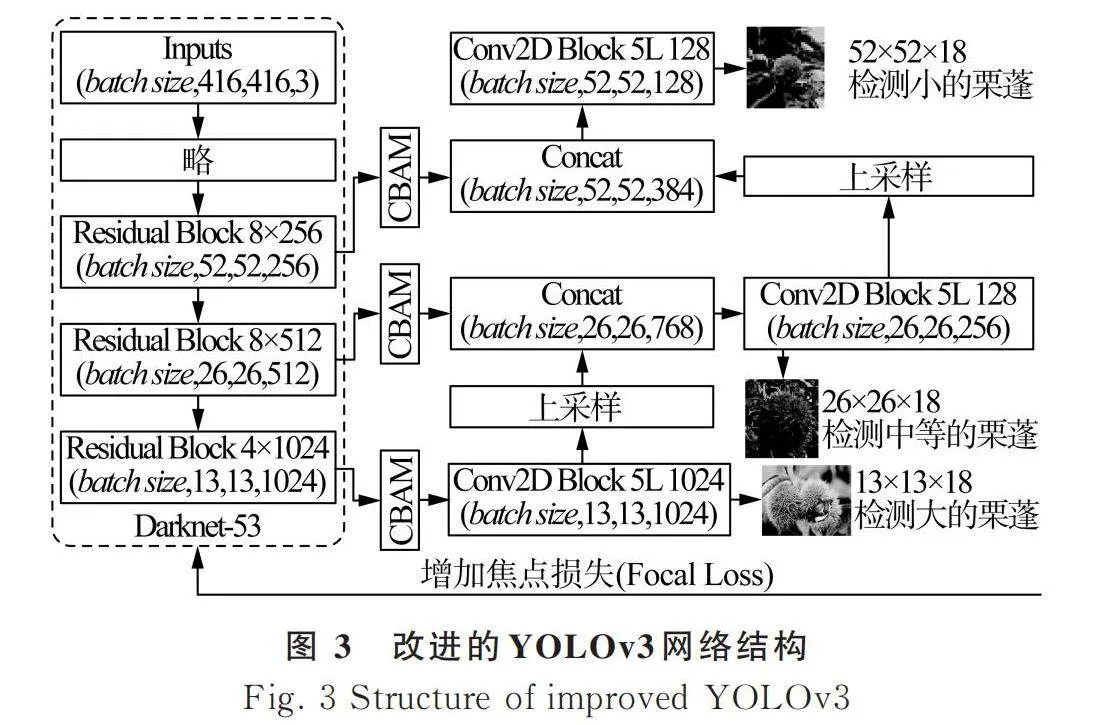

1.3 基于改進YOLOv3的栗蓬識別模型

You Only Look Once(YOLO)通過CNN網絡模型把圖像分成多個網格,再預測每個網格內存在目標的邊框位置和類別概率,從而實現端到端目標檢測。YOLOv3網絡結構主要有輸入層(Input)、主干網絡層(DarkNet53)和預測識別層(YOLO)3個部分組成。與YOLOv1和YOLOv2相比,YOLOv3加入更多特征提取層,并改進損失函數,準確率和速度得以提高。針對YOLOv3損失函數反向傳播沒有關注難分樣本問題,改進的YOLOv3增加焦點損失函數。同時對YOLOv3存在的特征提取不足問題,在DarkNet53尾部卷積中加入注意力機制。

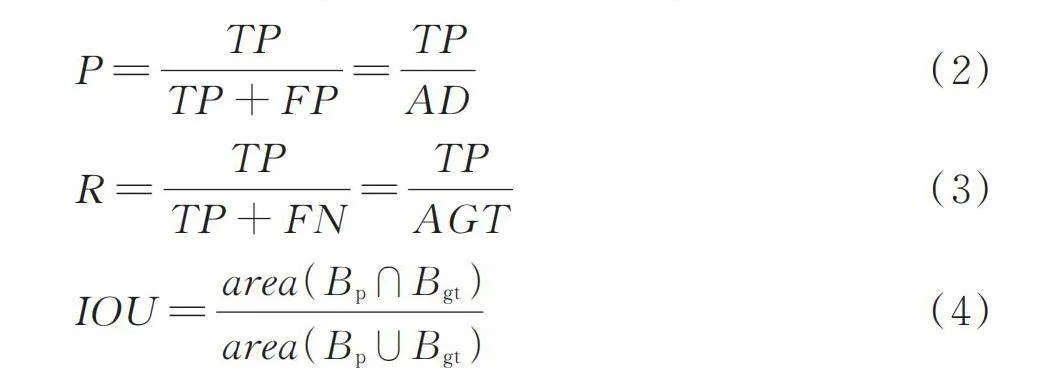

1.3.1 增加損失函數

通過對比板栗栗蓬圖像發現,有些圖像是在逆光條件下拍攝,有些圖像有很多個栗蓬(栗蓬密集),還有部分圖像栗蓬很小,這些圖像屬于難以檢測樣本,對模型影響很大,而易分樣本本身就容易被檢測識別,其訓練損失主導YOLOv3模型整體損失,從而導致在訓練過程中損失反向傳播對權重參數更新沒有更多地關注難分樣本,使得神經網絡模型對難分樣本檢測識別能力依舊很低。焦點損失函數還能解決正負樣本不平衡問題,黃鍵等[16]通過對YOLOX-S模型引入焦點損失函數,在訓練過程中緩解正負樣本不平衡的影響和更加關注難分樣本,平均目標檢測精度提高3.88%。龍燕等[17]提出一種融合聯合交并比和焦點損失的損失函數,檢測性能提高,同時正負樣本比例失衡帶來的誤差降低,樹上蘋果檢測準確率為96.0%,檢測精度均值為96.3%。馬馳等[18]通過引入焦點損失函數對YOLO算法改進,對穴盤甘藍炭疽病、細菌性黑斑病、褐斑病、黑腐病檢測精度得到提高。為了提高YOLOv3模型對難分栗蓬樣本檢測識別能力,在原有3個損失函數基礎上,增加焦點損失函數(Focal Loss),如式(1)所示,其中[pt]是檢測到某個物體的置信度,[αt]用來平衡正負樣本數量,[γ]取值為2,[(1-pt)γ]可更加關注難分樣本。

[FL(pt)=-αt(1-pt)γlog(pt)] (1)

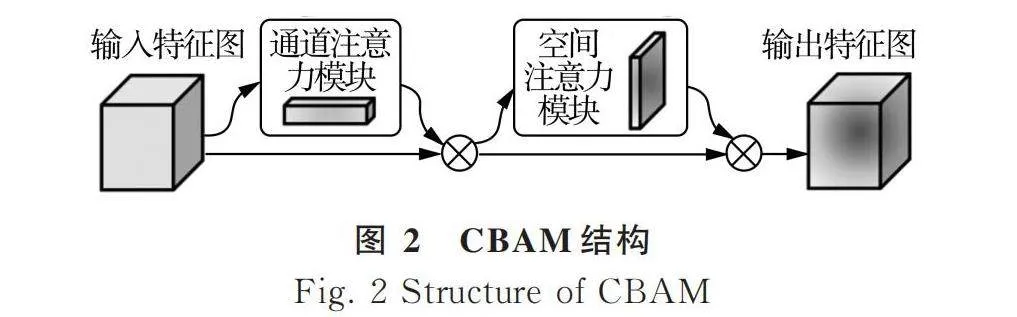

1.3.2 注意力機制

通道注意力機制在深度學習網絡模型中可對不同特征通道加權平均,通道注意力機制算法:(1)計算每個通道特征圖的全局最大特征和平均特征;(2)輸入多層感知機,得到每個通道重要程度;(3)通道重要程度權重與原特征圖相乘;(4)運用Sigmoid激活函數進行非線性變換,得到最終輸出特征圖。

空間注意力機制能夠定位到圖像中與任務相關區域,并抑制無用信息,空間注意力機制算法:(1)將每個特征點在通道方向平均池化和最大池化,堆疊生成特征描述符;(2)用通道數為1的卷積將特征描述符連接和卷積操作;(3)運用Sigmoid激活函數非線性變換后得到輸入特征圖每個特征點權重值;(4)將權重值與原特征圖相乘得到最終輸出特征圖。

將通道注意力和空間注意力結合起來的CBAM(Convolutional Block Attention Module)注意力機制模塊可以提高深度學習網絡模型感知能力,從而在不增加網絡復雜性的情況下改善卷積網絡檢測性能,其結構如圖2所示。陳思卓等[19]在網絡底端過渡區域引入注意力模塊CBAM實現了胸水腫瘤細胞團塊的有效分割。任治洲等[20]在卷積神經網絡Mobile Net V2上加入CBAM注意力機制對四種小麥籽粒(赤霉病粒、腥黑穗病粒、破損粒和正常粒)分類,準確率、精準率、召回率分別得到提升。

1.4 網絡結構

深度學習網絡結構在沿用YOLOv3整體布局基礎上,在已有置信度損失函數、類別損失、回歸損失(檢測框四個偏移量)的基礎上增加焦點損失函數,在Darknet-53最后三個模塊和YOLO檢測層之間添加CBAM注意力機制,綜合這兩個方面改進YOLO網絡結構,如圖3所示,將該網絡命名為YOLOvc,改進的栗蓬檢測網絡既能夠檢測大的栗蓬目標,也能夠檢測小的栗蓬目標,每個YOLO層各有3個錨(anchor),檢測框有1個類別、4個框偏移量和1個置信度共6個數據。為方便栗蓬識別效果比較,將僅僅增加焦點損失函數的網絡命名為YOLOvf,把僅僅添加注意力機制的深度學習網絡稱作YOLOva。

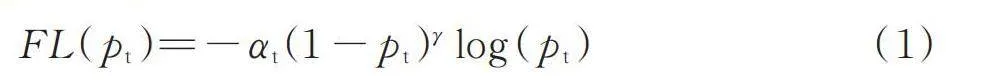

1.5 評價指標

板栗樹上栗蓬檢測只有栗蓬一個類,利用查準率P、平均精度AP來評估改進YOLOv3模型對栗蓬檢測識別性能,計算AP需要先計算查準率和查全率R以及重疊度IOU,如式(2)~式(4)所示。

[P=TPTP+FP=TPAD] (2)

[R=TPTP+FN=TPAGT] (3)

[IOU=area(Bp∩Bgt)area(Bp∪Bgt)] (4)

式中: TP——正確預測為正樣本數量,在栗蓬檢測中就是[IOU>IOUT]栗蓬檢測框數量,在栗蓬檢測過程中,[IOUT]值設置為0.5;

[IOU]——檢測框與栗蓬真實框的交并比;

FP——錯誤預測為正樣本數量,在栗蓬檢測中就是[IOU≤IOUT]的栗蓬檢測框數量或者是檢測到同一個栗蓬的多余檢測框數量;

FN——錯誤預測為負樣本數量,在栗蓬檢測中就是實際是栗蓬而未檢測到的栗蓬數量;

[AD]——檢測到所有栗蓬框數量;

[AGT]——圖像中所有栗蓬數量;

[Bp]——栗蓬檢測框;

[Bgt]——栗蓬真實框。

理論上計算AP的方法:首先計算栗蓬檢測識別的[P]和[R]值,其次繪制[P]-[R]曲線,最后計算曲線包圍面積,AP就等于該面積。栗蓬檢測識別的AP算法步驟:(1)對檢測到每個栗蓬框標上序號,計算每個栗蓬檢測框的[TP]、[FP]和[FN];(2)對檢測到的所有栗蓬框按置信度從大到小有序排列,根據累積的[TP]、[FP]和[FN]計算每一個檢測框[P]和[R]值。(3)根據[P]和[R]值對畫出[P-R]曲線,用插值法計算曲線下面積,該面積就是AP值。

2 結果與討論

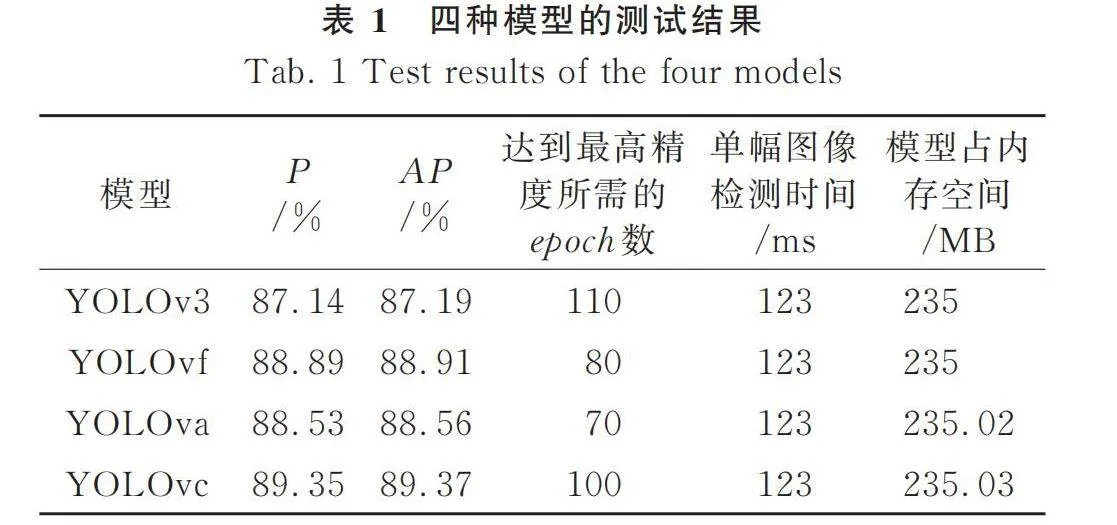

2.1 訓練策略和消融試驗

利用844幅栗蓬圖像對YOLOv3、YOLOvf 、YOLOva和YOLOvc網絡迭代訓練200個epoch,每10個epoch保存一次網絡權重模型,用驗證栗蓬圖像測試這20個權重模型,選取最優權重模型評價4個卷積神經網絡,具體指標如表1所示。

無論是添加焦點函數還是注意力機制,可以使網絡性能迅速達到最佳值,添加焦點函數的YOLOvf網絡在訓練80個epoch就能使栗蓬查準率達到最高值,添加注意力機制的YOLOva網絡在訓練70個epoch就能使栗蓬檢測查準率達到最高值,同時添加焦點函數和注意力機制的YOLOvc也比YOLOv3能以少的時間達到最佳值。

分別對YOLOv3、YOLOvf、YOLOva和YOLOvc四種深度學習網絡模型實施測試消融試驗,每個模型測試評估指標如表1所示。四個網絡模型所占內存空間基本一致,添加焦點損失不增加權重參數,僅僅影響訓練速度,增加注意力機制后增加參數也有限,四個網絡模型對單幅板栗栗蓬圖像檢測時間都是123 ms。

YOLOvf、YOLOva網絡對樹上栗蓬檢測性能比YOLOv3略高一些,從試驗的結果看,在損失函數中添加焦點損失函數,有效改善板栗栗蓬的識別檢測性能,通過加入CBAM注意力機制,也可改善板栗栗蓬的識別檢測性能。改進的卷積神經網絡YOLOvc對栗蓬檢測查準率和平均精度比YOLOv3高出2.21個百分點和2.16個百分點。通過數據對比可以得出,通過增加焦點損失函數和注意力機制改進YOLOv3神經網絡提升了對板栗栗蓬果實信息挖掘能力,進一步提高栗蓬果實特征提取能力。綜合比較這些評估指標,改進的YOLOv3模型對栗蓬檢測具有更好性能。

2.2 影響精度的因素分析

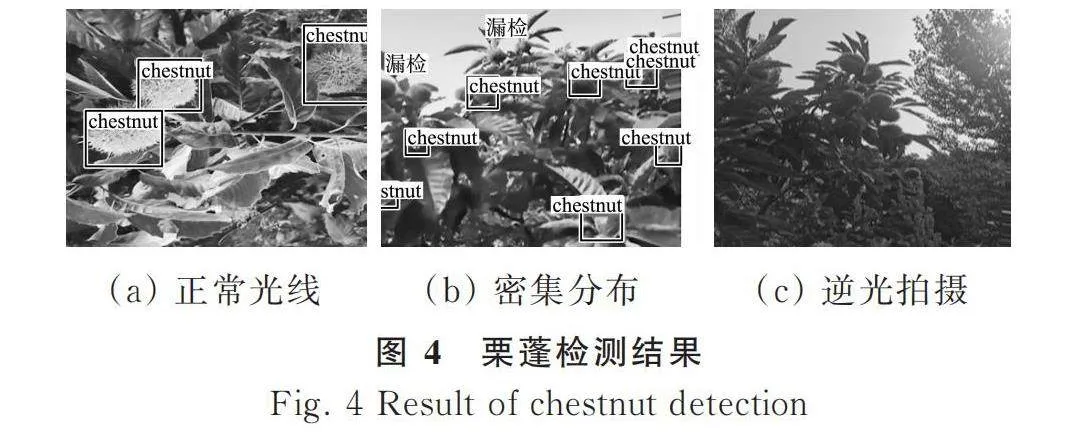

通過YOLOvc神經網絡模型對栗蓬檢測識別結果分析,對于在不強也不弱光線下的圖像,YOLOvc能夠全部正確地檢測到栗蓬目標,如圖4(a)所示。盡管添加注意力機制,小目標栗蓬識別還比較困難,對于密集分布栗蓬圖像,其栗蓬目標往往比較小,栗蓬顏色與樹葉顏色一致,難以檢測識別,在識別栗蓬密集小目標果實圖像時,存在個別漏檢情況,如圖4(b)所示。對于光照條件不好的情況,如逆光拍攝圖像,往往栗蓬目標模糊,難以識別,如圖4(c)所示,這幅圖像中肉眼也難以檢測栗蓬目標,所以YOLOvc也未能檢測到栗蓬目標。由于增加焦點損失函數,YOLOvc對板栗樹葉遮擋栗蓬不敏感,通過比照分析,對于樹葉遮擋栗蓬面積不超過80%的遮擋栗蓬目標都能正確地識別。圖像分辨率也影響栗蓬檢測,分辨率高的栗蓬目標清晰,分辨率低的栗蓬目標特征不明顯,容易產生漏檢。

3 結論

1) 無人機板栗采摘靈活性高、適應性強和效率高,是解決山區板栗收獲難題的良好途徑。無人機板栗采摘關鍵點是利用視覺檢測識別板栗樹上栗蓬。在研究中通過增加焦點損失函數和添加注意力機制改進YOLOv3,改進算法自動識別板栗栗蓬的平均精度、查準率分別達到89.37% 和89.35%,與YOLOv3相比分別提高2.21%和2.16%,說明改進YOLOv3網絡模型用于樹上栗蓬目標識別是可行的。

2) 針對板栗栗蓬無人機采摘視覺目標檢測識別問題,改進YOLOv3模型算法降低其特征冗余度,滿足識別程序對硬件設備的要求,模型檢測速度快,檢測單幅板栗圖像的耗時僅為123 ms,對樹上栗蓬識別效率和實時性高,完全能夠滿足無人機采摘板栗的需要,模型體積小,具備更好的移植潛力。

在今后研究中需要將改進的網絡模型YOLOvc部署到無人機設備,從而完成板栗采摘場景下的板栗樹上栗蓬檢測,且需要進一步研究栗蓬相對無人機的位置,為無人機機械手采摘提供三維坐標。

參 考 文 獻

[ 1 ] 宗望遠, 黃木昌, 肖洋軼, 等. 板栗收獲拍打式落果裝置設計與試驗[J]. 農業工程學報, 2022, 37(18): 1-10.

Zong Wangyuan, Huang Muchang, Xiao Yangyi, et al. Design and experiment of the fruit?beating dropping device for chestnut harvesters [J]. Transactions of the Chinese Society of Agricultural Engineering, 2022, 37(18): 1-10.

[ 2 ] Yaniv M. System and method for mapping and building database for harvesting?dilution tasks using aerial drones [P]. EP Patent: 3500877B1, 2021-09-29.

[ 3 ] 張桃桃. 基于可拓設計的無人機水果采摘的結構設計[D]. 廣州: 廣東工業大學, 2016.

Zhang Taotao. The design of the structure about UAV fruit picker based on the extension design [D]. Guangzhou: Guangdong University of Technology, 2016.

[ 4 ] 雒鷹, 程鴻遠, 孟黎鵬, 等. 利用無人機采摘紅松球果初探[J]. 林業機械與木工設備, 2022, 50(1): 64-66.

Luo Ying, Cheng Hongyuan, Meng Lipeng, et al. Preliminary study on picking pinus koraiensis cones using unmanned aerial vehicles [J]. Forestry Machinery and Wood Working Equipment, 2022, 50(1): 64-66.

[ 5 ] 劉小剛, 范誠, 李加念, 等. 基于卷積神經網絡的草莓識別方法[J]. 農業機械學報, 2020, 51(2): 237-244.

Liu Xiaogang, Fan Cheng, Li Jianian, et al. Identification method of strawberry based on convolutional neural network [J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(2): 237-244.

[ 6 ] 宋懷波, 王亞男, 王云飛, 等. 基于YOLOv5s的自然場景油茶果識別方法[J]. 農業機械學報, 2022, 53(7): 234-242.

Song Huaibo, Wang Yanan, Wang Yunfei, et al. Camellia fruit detection in natural scene based on YOLOv5s [J]. Transactions of the Chinese Society for Agricultural Machinery, 2022, 53(7): 234-242.

[ 7 ] 宋懷波, 馬寶玲, 尚鈺瑩, 等. 基于YOLOv7 ECA模型的蘋果幼果檢測[J]. 農業機械學報, 2023, 54(6): 233-242.

Song Huaibo, Ma Baoling, Shang Yuying, et al. Detection of young apple fruits based on YOLOv7 ECA model [J]. Transactions of the Chinese Society for Agricultural Machinery, 2023, 54(6): 233-242.

[ 8 ] 陳仁凡, 謝知, 林晨. 基于YOLO-ODM的溫室草莓成熟度的快速檢測[J]. 華中農業大學學報, 2023, 42(4): 262-269.

Chen Renfan, Xie Zhi, Lin Chen. YOLO-ODM based rapid detection of strawberry [J]. Journal of Huazhong Agricultural University, 2023, 42(4): 262-269.

[ 9 ] 劉莫塵, 褚鎮源, 崔明詩, 等. 基于改進YOLO v8-Pose的紅熟期草莓識別和果柄關鍵點檢測[J]. 農業機械學報, 2023(S2): 244-251.

Liu Mochen, Chu Zhenyuan, Cui Mingshi, et al. Red ripe strawberry recognition and stem key point detection based on improved YOLO v8-Pose [J]. Transactions of the Chinese Society for Agricultural Machinery, 2023(S2): 244-251.

[10] 張伏, 陳自均, 鮑若飛, 等. 基于改進型YOLOv4-LITE輕量級神經網絡的密集圣女果識別[J]. 農業工程學報, 2021, 37(16): 270-278.

Zhang Fu, Chen Zijun, Bao Ruofei, et al. Recognition of dense cherry tomatoes based on improved YOLOv4-LITE lightweight neural network [J]. Transactions of the Chinese Society of Agricultural Engineering, 2021, 37(16): 270-278.

[11] 李天華, 孫萌, 丁小明, 等. 基于YOLO v4+HSV的成熟期番茄識別方法[J]. 農業工程學報, 2021, 37(21): 183-190.

Li Tianhua, Sun Meng, Ding Xiaoming, et al. Tomato recognition method at the ripening stage based on YOLO v4 and HSV [J]. Transactions of the Chinese Society of Agricultural Engineering, 2021, 37(21): 183-190.

[12] 黃麗明, 王懿祥, 徐琪, 等. 采用YOLO算法和無人機影像的松材線蟲病異常變色木識別[J]. 農業工程學報, 2021, 37(14): 197-203.

Huang Liming, Wang Yixiang, Xu Qi, et al. Recognition of abnormally discolored trees caused by pine wilt disease using YOLO algorithm and UAV images [J]. Transactions of the Chinese Society of Agricultural Engineering, 2021, 37(14): 197-203.

[13] 鮑文霞, 謝文杰, 胡根生, 等. 基于TPH-YOLO的無人機圖像麥穗計數方法[J]. 農業工程學報, 2023, 39(1): 155-161.

Bao Wenxia, Xie Wenjie, Hu Gensheng, et al. Wheat ear counting method in UAV images based on TPH-YOLO [J]. Transactions of the Chinese Society of Agricultural Engineering, 2023, 39(1): 155-161.

[14] 汪斌斌, 楊貴軍, 楊浩, 等. 基于YOLO_X和遷移學習的無人機影像玉米雄穗檢測[J]. 農業工程學報, 2022, 38(15): 53-62.

Wang Binbin, Yang Guijun, Yang Hao, et al. UAV images for detecting maize tassel based on YOLO_X and transfer learning [J]. Transactions of the Chinese Society of Agricultural Engineering, 2022, 38(15): 53-62.

[15] 李志臣, 凌秀軍, 李鴻秋, 等. 基于改進ShuffleNet的板栗分級方法[J]. 山東農業大學學報(自然科學版), 2023, 54(2): 299-307.

Li Zhichen, Ling Xiujun, Li Hongqiu, et al. Chestnut grading method based on improved shuffleNet [J]. Journal of Shandong Agricultural University (Natural Science Edition), 2023, 54(2): 299-307.

[16] 黃鍵, 徐偉峰, 蘇攀, 等. 基于YOLOX-S的車窗狀態識別算法[J]. 吉林大學學報(理學版), 2023, 61(4): 875-882.

Huang Jian, Xu Weifeng, Su Pan, et al. Car window state recognition algorithm based on YOLOX-S [J]. Journal of Jilin University(Science Edition), 2023, 61(4): 875-882.

[17] 龍燕, 李南南, 高研, 等. 基于改進FCOS網絡的自然環境下蘋果檢測[J]. 農業工程學報, 2021, 37(12): 307-313.

Long Yan, Li Nannan, Gao Yan, et al. Apple fruit detection under natural condition using improved FCOS network [J]. Transactions of the Chinese Society of Agricultural Engineering, 2021, 37(12): 307-313.

[18] 馬馳, 吳華瑞, 于會山. 基于YOLOX的穴盤甘藍病害檢測方法[J]. 江蘇農業科學, 2023, 51(8): 193-202.

[19] 陳思卓, 趙萌, 石凡, 等. 過參數卷積與CBAM融合的胸腔積液腫瘤細胞團塊分割網絡[J]. 中國圖象圖形學報, 2023, 28(10): 3243-3254.

Chen Sizhuo, Zhao Meng, Shi Fan, et al. Over?parametric convolution and attention mechanism fused pleural effusion tumor cell clump segmentation network [J]. Journal of Image and Graphics, 2023, 28(10): 3243-3254.

[20] 任治洲, 梁琨, 王澤宇, 等. 結合改進CBAM和MobileNet V2算法對小麥病斑粒分類[J]. 南京農業大學學報, 2024, 47(3): 583-591.

Ren Zhizhou, Liang Kun, Wang Zeyu, et al. Combining improved CBAM and MobileNet V2 algorithms for classifying diseased wheat kernels [J]. Journal of Nanjing Agricultural University, 2024, 47(3): 583-591.