基于多尺度卷積的褲子腘窩平整度客觀評價

孫思晴 劉成霞 鄭曉萍

摘要:針對目前缺乏實際著裝起皺的客觀評價方法,文章選取35塊機織試樣,根據中間體型繪制合體褲裝樣板并縫制,模擬日常活動中褲子腘窩處的起皺過程,獲取折皺圖像并進行主觀評價,制作圖像標簽。利用SURF提取圖像特征并對不同等級的圖像兩兩組合進行K-means聚類,校正圖像標簽。設計一種基于多尺度卷積的著裝平整度客觀評價模型,利用多尺度卷積操作對輸入的折皺圖像進行不同范圍的特征提取并進行特征融合,輸出著裝平整度的等級預測結果。研究結果表明:該模型的預測準確率達92.69%,優于CNN、BP方法的分類效果。

關鍵詞:著裝平整度;主觀評價;客觀評價;深度學習;多尺度卷積

中圖分類號:TS941.2

文獻標志碼:A

文章編號:10017003(2021)04004305

Abstract:Inviewofthelackofobjectiveevaluationmethodforactualwearingwrinkle,35wovensampleswereselectedandfittedpantsamplesweredrawnandsewn,accordingtoaveragephysique.Thewrinklingprocessofpoplitealspaceofpantsindailyactivitieswassimulated,wrinklingimageswereobtained,subjectiveevaluationwasconductedandimagetagsweremade.SURFwasemployedtoextractimagefeatures,imagesofdifferentgradeswerecombinedpairwiseforK-meansclusteringandimagelabelswerecorrected.Anobjectiveevaluationmodelontheflatnessofpoplitealspacebasedonmulti-scaleconvolutionwasdesigned,whichextractedfeaturesfromdifferentrangesofwrinkleimagesthatwereinputusingmulti-scaleconvolution,featureswerefused,andthenpredictionresultsoftheflatnessofwearingwereoutput.Theresearchresultsindicatedthatthepredictionaccuracyofthemodelwas92.69%,whichwasbetterthantheclassificationeffectofCNNandBPmethods.

Keywords:wearingwrinkle;subjectiveevaluation;objectiveevaluation;deeplearning;multi-scaleconvolution

作者簡介:孫思晴(1995),女,碩士研究生,研究方向為紡織服裝檢測技術。通信作者:劉成霞,教授,glorior_liu@163.com。

服裝外觀性能如縫紉平整度、洗后平整度、服裝褶裥等的客觀評級一直是紡織品檢測領域的研究熱點。目前,主要采用標樣對照法對織物平整度進行等級評價,但該方法對環境要求高,且實時性差、易受心理因素影響,有諸多不確定性。因此,眾多國內外學者致力于研究客觀有效的織物平整度評估方法。

隨著計算機技術的發展,針對織物平整度等級的客觀評價方法研究主要集中在圖像處理技術、三維掃描、三維建模等。基于二維圖像的評價主要利用圖像灰度信息,如描述性統計[1]、傅里葉變換[2]、小波變換[3]、灰度共生矩陣[4]、分形維數[5]等來描述織物的平整程度。但該方法要求特定的圖像采集環境,且無法對復雜圖案的織物進行評價。基于三維圖像的評價主要通過三維掃描技術[6]、光度立體視覺法[7]、陰影恢復重建算法[8]等方法獲得織物三維表面形態或三維點云坐標,提取能反映織物平整程度的特征指標。但該方法成本高、實時性差、部分三維重建技術易受織物圖案影響,且對圖像采集環境要求較高。

然而,目前對織物平整度的研究主要針對洗護后的起皺程度,對著裝起皺研究較少。劉成霞[9]構建了一模擬實際著裝起皺的裝置,并利用數字圖像處理技術建立了服裝關節部位抗皺性的評價方法;陳麗麗[10]以實際著裝起皺圖像為研究對象,探究了用灰度共生矩陣客觀評價著裝平整度的可行性。眾所周知,著裝起皺更影響服裝的美觀性,且著裝起皺更能反映織物整體抗皺性的強弱,因此對其研究更加重要。本文以實際著裝過程中的折皺為研究對象,基于多尺度卷積建立評價模型,以期實現著裝平整度的客觀評定。

1 折皺圖像數據集的建立

1.1 試樣的選取

收集了市面上常見的35種純色機織褲裝面料,織物厚度、顏色、抗皺性和組織結構均不相同,原料包含棉、麻、絲、毛及化纖等。市場上的面料千差萬別,層出不窮。本文也很難在有限的篇幅和研究時間內,窮盡所有的面料,只能管中窺豹,通過有限的面料探索一種評價方法。

1.2 實驗樣褲制作及圖像采集

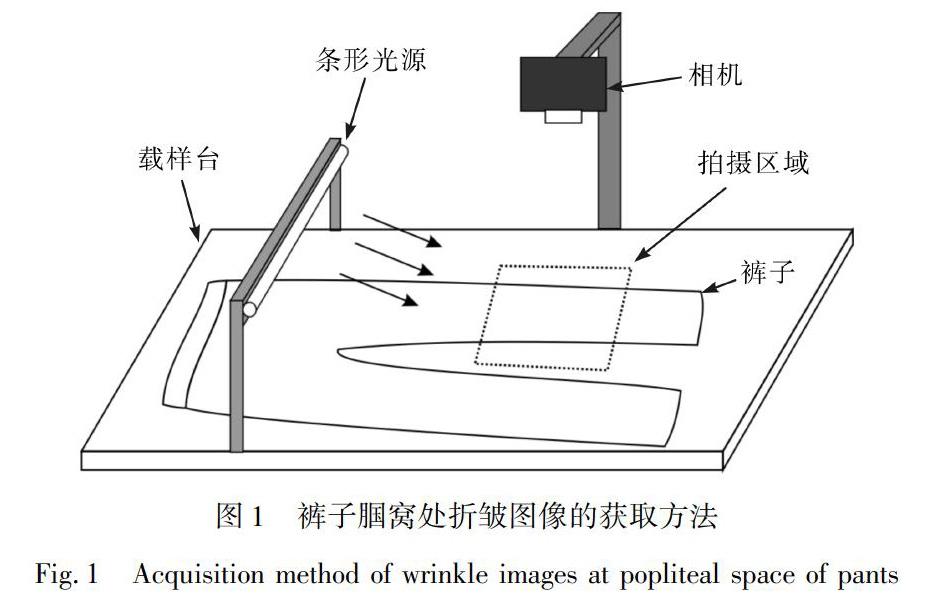

褲子由于膝蓋的頻繁彎曲,易在穿著過程中出現大量折皺,因此本文選擇褲子腘窩處的折皺為研究對象,實驗環境為溫度(20±2)℃、相對濕度(65±3)%。選擇一名中間體型的女性作為被試者,身高160cm、腰圍70cm,根據被試者體型繪制合體褲裝樣板并縫制實驗樣褲,所有工藝均由同一人在同一機器上完成。

樣褲熨燙平整后由被試者進行穿著起皺。穿著動作包括靜坐5min(膝彎屈成直角)、勻速爬樓5min(膝彎屈成鈍角)、下蹲5min(膝彎屈成銳角)。之后將褲子小心脫下,利用圖1中的裝置對腘窩處的折皺進行圖像采集,該裝置由佳能700D相機(日本佳能),條形光源、支架、載樣臺(實驗室自備)等組成。由于褲子折皺多為橫向或斜向折痕,因此采用單側條形斜向光源對其照射,使光線與織物表面形成一定的入射角度,經織物凹凸不平的表面形成漫反射,使圖像呈現明暗變化。為防止其他光線的干擾,圖像采集過程在暗室中進行。因考慮折皺多集中在中襠線下部,因此選取兩褲腿中襠線向上5cm至向下15cm為折皺獲取部位并作標記。在載樣臺上標記20cm×20cm的正方形區域為拍攝區域,獲取圖像時使褲腿的標記線和正方形的兩邊重合,后用Photoshop軟件截取區域內折皺圖像。

由于卷積神經網絡所需樣本量較大,加上褲子起皺部位因面料差異具有不同的折皺表現,因此為增加數據集,對35條樣褲12h內的折皺變化過程進行圖像采集。考慮到一般

情況下折皺回復過程由快變緩后趨于穩定的實際情況,因此在35條樣褲起皺實驗后的15min、30min、45min、1h、1.5h、2h、2.5h、3h、3.5h、4h、5h、6h、7h、8h、9h、10h、11h、12h共18個時刻對褲子起皺部位進行拍攝,每條樣褲有左右2條褲腿,因此35條樣褲共得到1260張折皺圖像。

1.3 主觀評價

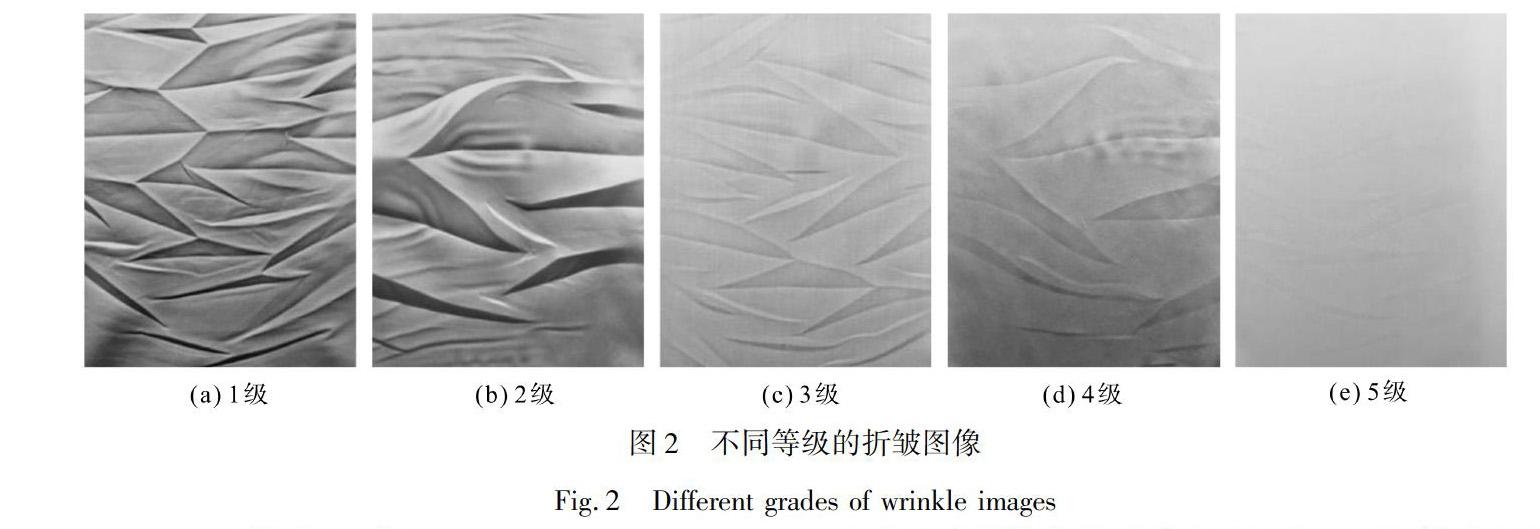

如前所述,現有的平整度評級標樣主要針對洗后平整度,不適用于著裝平整度,即目前尚未有直接用于評價實際著裝起皺的標樣,因此采用專家評價法對褲子的起皺程度進行評定。請10位紡織行業專家對1260張折皺圖像進行等級評定,將其分為5個等級:1級折皺數量多且折痕深;2級折皺數量較少、折痕較深;3級折皺數量較多但折痕較淺;4級折皺數量較少、折痕較淺;5級幾乎無折皺,如圖2所示。評價步驟為:專家提前15min進入實驗室,熟悉環境和評判規則,對所有折皺圖像進行總體了解。雖然折皺圖像較多,但樣褲最初的70張折皺圖像反映了不同織物的折皺數量,隨后的圖片則反映了同一織物隨時間的推移,折皺深淺的變化情況。因此,將每一條褲子的折皺圖像單獨列入一個文件夾,請專家先對35條樣褲最初的折皺圖像進行排序,粗分為折皺數量較多和較少兩類,再根據折皺深淺程度對其進行等級劃分。初步等級評定后,再進行仔細對比和調整,確定折皺等級,最后取10名專家評級結果的平均值作為該織物的最終等級,并根據評級結果制作樣本標簽。

1.4 基于K-means的數據集校正

由于主觀評價具有一定的不確定性和不穩定性,專家可能對同一張折皺圖像存在爭議,求取平均值的方式不適合用于存在爭議的折皺圖像,因此采用無監督的方法對評級結果進行校正。

選擇K-means算法對數據集的標簽進行校正,其主要通過設定初始聚類數目和聚類中心,根據特定的距離公式進行相似性度量,不斷迭代重新得到數據聚類中心,并對數據集進行劃分,得到聚類結果。

SURF算法使用圖像金字塔構造不同的尺度空間,具有尺度不變性、旋轉不變性,還具有良好的抗光照及抗噪能力,因此本文通過SURF算法對折皺圖像進行特征提取和特征描述,將折皺圖像劃分為5個等級,即分為5類。將這5類分別兩兩組合,即將五分類問題轉化為若干個二分類問題,每二類利用K-means算法根據折皺圖像的SURF特征進行聚類,去除兩類中有偏差的圖片,最終從1260張篩選出1120張等級明確的圖片。

2 深度神經網絡模型設計

2.1 卷積神經網絡(CNN)

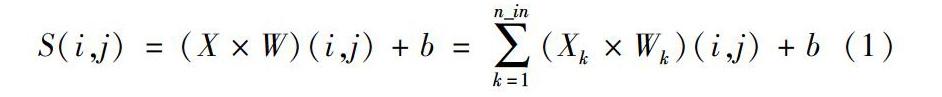

卷積神經網絡由卷積層、池化層和全連接層組成[11],本質是一個多層感知器,其優點在于稀疏連接和權值共享,能有效減少網絡的參數個數并緩解模型過擬合的問題。卷積層使用卷積核對圖像特征進行不同尺寸的過濾,以獲取整體的局部特征。池化層通過對數據進行降維,減少提取的特征數據,防止過擬合。例如,卷積輸入一個圖像數據的矩陣和卷積核之間逐點乘積,然后是線性的整流ReLU,使卷積的輸出稀疏,即對數據進行標準化。最后池化操作通過選擇窗口上的最大值來減小維度。卷積的公式如下:

2.2 基于多尺度卷積的模型設計

由于著裝平整度的評價既要考慮折皺數量又要考慮折皺深淺,因此本文設計一種多尺度卷積神經網絡模型來提取折皺圖像不同尺度的局部特征,以更全面地預測折皺等級。

本文設計的網絡模型先使用不同的卷積核,使用40個不同大小的過濾器(2×2、3×3、4×4和5×5各10個)提取不同尺度的折皺特征。以上卷積核的大小和個數都是經過重復實驗得出的最優參數,且保持了提取信息的完整性,因此每種卷積核給出了100×100×10的特征圖。然后是批處理規范化層,目的是減少神經網絡中的內部協變量偏移,同時加快收斂過程,降低初始化要求,方便調參,提高分類效果。此外,用ReLU激活每個神經元。接下來用全局最大池化來降維,減少訓練參數量。對卷積之后的特征圖進行連接,輸出為50×50×40的特征圖,并將特征圖展成一維向量依次輸入到兩個全連接層中,大小分別為128和64。在最后一個全連接層上使用一個dropout函數來隨機丟棄訓練過程中全連接層的一些節點,以免過擬合。對于第i個神經元,使用dropout后的輸出公式如下:

最終的輸出層由對應于五個等級結果的五個神經元組成,由全連接層輸出的結果得到。本文設計的網絡模型整體框架如圖3所示。

3 實 驗

3.1 環境與參數

采用篩選后的1120個實驗樣本,每次隨機抽取20%的樣本用來測試,其余的用于訓練。訓練時每批的大小為32,學習率為0.0001,dropout函數設置為0.2。模型的訓練環境為IntelCorei7-10510UCPU,8GB內存,編譯環境使用了python3.6和TensorFlow1.2。

3.2 結果與分析

本文設計的模型在原有CNN的基礎上,進一步利用不同卷積核在提取多尺度特征上的優勢,將不同層級產生的特征拼接展平為多尺度特征并提供給分類器,多維度提高平整度的預測準確率及底層信息的利用率。實驗中,為了克服不同卷積核卷積后的尺寸不同,造成后續提取的特征無法融合的問題,將Padding的方式設置為samepadding,損失函數為softmax的交叉熵,采用亞當優化算法最小化損失函數。通過不斷迭代來優化模型的參數,使訓練精度和損失函數值都趨于平穩,訓練過程如圖4所示,隨機選取了224個樣本用來驗證模型的效果。選擇準確率(ACC)作為預測評價指標,計算公式如下:

ACC/%=正確預測的樣本數量測試樣本總數量×100(4)

此外,表1列出了2×2、3×3、4×4、5×5、6×6的卷積核疊加組合后對等級預測結果的影響。由表1可見,顯示預測準確率并不是隨多尺度卷積核的增加而增加,當同時應用這5種卷積核時,由于模型復雜度變高,出現過擬合現象,導致了預測準確率下降。因此,最終選用預測準確率較高的2×2、3×3、4×4、5×5四個卷積核,但實驗中調參卷積核的大小不僅限于表1中的尺度。

為了驗證多尺度卷積是否能有效提高著裝平整度的預測準確率,本文采用誤差反向傳播(BP)和卷積神經網絡(CNN)進行對比分析。圖5為不同算法時每個等級的預測準確率,可以看出Multi-CNN(多尺度卷積神經網絡)的預測準確率都高于其他兩種算法。表2為不同算法的整體準確率,可以看出多尺Multi-CNN的準確率為92.69%,比CNN提高3.31%,比BP神經網絡提高約10%,且損失最小。這說明多尺度卷積核通過提取不同尺度的折皺特征并進行特征拼接融合,保留了更多的圖像信息,利于提高分類正確率。因此,利用本文設計的模型可有效實現著裝平整度的客觀評定,且對輸入圖像的要求較低。

4 結 論

以實際著裝過程中褲子腘窩處的折皺為研究對象,選取35種常見純色機織物進行樣褲制作和著裝起皺,通過拍照記錄折皺變化獲取折皺圖像,根據主觀評價和K-means聚類制作圖像標簽,以896張折皺圖像作為訓練樣本、224張作為測試樣本,對構建的多尺度卷積神經網絡模型進行訓練和測試,經過分析可以得到以下結論。

1)該模型能保留更完整的信息,提取圖像多維度特征,有效實現著裝平整度的預測,準確率為92.69%,比CNN提高331%,比BP神經網絡提高約10%,且損失最小。

2)相比其他利用圖像特征進行神經網絡預測的方法,深度神經網絡能提取更多利于圖像分類的抽象特征,在圖像學習及預測方面更具優勢。

目前關于織物平整度的研究,研究對象大多圍繞AATCC起皺器產生的折皺,或者用洗衣機洗滌之后的平整度展開,這些折皺與穿著過程中引起的服裝折皺在形態上有極大差異。

本文以服裝實際穿著過程中的平整度為研究對象,具有更強的現實意義和實際應用價值。另外,本文構建的基于多尺度卷積的深度神經網絡模型,不僅為客觀評價著裝平整度提供了新手段,而且可用于縫紉平整度、織物洗后平整度等的客觀評定,還能為紡織品外觀質量的在線檢測提供參考。

參考文獻:

[1]汪黎明,陳健敏,杜鳳霞.利用圖像的統計分析方法評價織物免燙等級[J].青島大學學報,2002,17(1):41-43.

WANGLiming,CHENJianmin,DUFengxia.Evaluationoffabricwrinkingwithstatisticmethodofimageanalysis[J].JournalofQingdaoUniversity,2002,17(1):41-43.

[2]吳嘉斌,徐增波.基于傅利葉譜分析技術的織物起皺特征提取和分析[J].上海毛麻科技,2001(1):34-36.

WUJiabin,XUZengbo.Extractionandanalysisoffabricwrinklecharacteristicsbasedonfourierspectrumanalysistechnology[J].ShanghaiWoolandJuteJournal,2001(1):34-36.

[3]楊曉波,黃秀寶.織物表面折皺的小波分析與自組織神經網絡等級評定[J].中國圖象圖形學報,2005(4):473-478.

YANGXiaobo,HUANGXiubao.Waveletanalysisoffabricsurfacewrinkleandself-organizedneuralnetworkgradeassessment[J].JournalofImageandGraphics,2005(4):473-478.

[4]石康君,王靜安,高衛東.織物褶皺多尺度灰度共生矩陣分析[J].絲綢,2020,57(2):35-40.

SHIKangjun,WANGJingan,GAOWeidong.Multi-scaleGLCManalysisoffabricwrinkles[J].JournalofSilk,2020,57(2):35-40.

[5]楊艷,錢坤,李鴻順.基于縐織物表面圖像分形特征分析的縐效應評價[J].絲綢,2007(10):40-41.

YANGYan,QIANKun,LIHongshun.Crepeeffectevaluationbasedonfractalcharacterizationanalysisforsurfaceimageofcrepefabrics[J].JournalofSilk,2007(10):40-41.

[6]劉成霞,甘敏,鄭文梅.織物平整度的特征提取方法對比研究[J].絲綢,2018,55(3):45-49.

LIUChengxia,GANMin,ZHENGWenmei.Comparativestudyoffeatureextractionforfabricsmoothness[J].JournalofSilk,2018,55(3):45-49.

[7]徐建明.織物平整度等級客觀評估系統的研究[D].上海:東華大學,2006.

XUJianming.StudyonObjectiveAssessmentSystemofFabricSmoothnessGrade[D].Shanghai:DonghuaUniversity,2006.

[8]楊曉波.織物平整度等級的計算機視覺評估[D].上海:東華大學,2003.

YANGXiaobo.ComputerVisionAssessmentofFabricWrinkleGrade[D].Shanghai:DonghuaUniversity,2003.

[9]劉成霞.模擬實際著裝的織物折皺測試及等級評價方法研究[D].杭州:浙江理工大學,2015.

LIUChengxia.InvestigationintoMeasurementandGradeEvaluationofFabricWrinklingSimulatingActualWear[D].Hangzhou:ZhejiangSci-TechUniversity,2015.

[10]陳麗麗.基于灰度共生矩陣的毛料褲子穿著平整度特征提取[J].毛紡科技,2017,45(5):50-54.

CHENLili.EigenvalueextractiononwearingsmoothnessofwoolpantsbasedonGray-levelco-occurrencematrix[J].WoolTextileJournal,2017,45(5):50-54.

[11]LECUNY,BENGIOY,HINTONG.Deeplearning[J].Nature,2015,521(7553):436-444.