可穿戴計算設備中振動表情的設計與應用

陳 實,鄭楷洪,孫凌云,李 彥

(浙江大學 現(xiàn)代工業(yè)設計研究所,浙江 杭州310027)

進入21世紀以來,可穿戴計算[1]的研究和應用取得了顯著進步,并開始進入普通人的生活.以智能頭盔[2]、智能眼鏡[3]、智能手表[4]和智能腕帶[5]等為代表的可穿戴計算設備改變了人與計算機的交互方式,為改進人們的生活水平、提高工作效率等提供了新的可能.

可穿戴計算設備是一種新概念的便攜移動式計算[6],不具備傳統(tǒng)的輸入輸出界面,語音交互、觸摸輸入、微成像、動作感應等是目前主要的交互方式.Matthies等[7]將陀螺儀傳感器集成到耳機上,通過陀螺儀識別出用戶點頭、搖頭等姿勢,從而進行交互.Harrison等[8]開發(fā)了一個可穿戴多點觸控投影系統(tǒng),通過激光投影將圖形界面投射于物體表面,并配合深度傳感器捕捉用戶手勢,從而將任意表面變?yōu)椤翱啥帱c觸控”的界面.Seehra等[9]設計了一個能感應手勢動作的手套,通過手勢動作與計算機進行交互.Mistry等[10]開發(fā)了一款基于手勢輸入和增強現(xiàn)實技術的可穿戴計算設備 WUW(wear Ur world),用戶可以通過該設備使用不同的手勢直接和投影在環(huán)境中的物體交互.

21世紀是觸覺的時代,各種與日常生活相關的服務設備紛紛開始了“觸覺革命”,人類的感知模式正在經(jīng)歷著繼“視覺轉向”之后的“觸覺轉向”[11].對于個體而言,觸覺是人類獲取外界信息的重要手段之一.根據(jù)信息本身的特點,在信息與觸覺信號之間建立映射關系,對人體施加相應觸覺刺激,能夠實現(xiàn)通過觸覺傳遞信息的目的.

本文針對由振動產生的觸覺刺激,研究在可穿戴計算設備中利用振動信號表達情感的可能性.本文在分析觸覺刺激、觸覺表達、振動參數(shù)等內容的基礎上,通過改變振動的強度、節(jié)奏與時長,設計6種能夠表達人類基本情感狀態(tài)的振動模式,稱之為振動表情.將振動表情作用于人體4個不同部位,比較振動表情在各部位的識別率.設計振動表情的應用場景,研究振動表情對于情感表達的作用.

1 相關研究

1.1 觸覺刺激

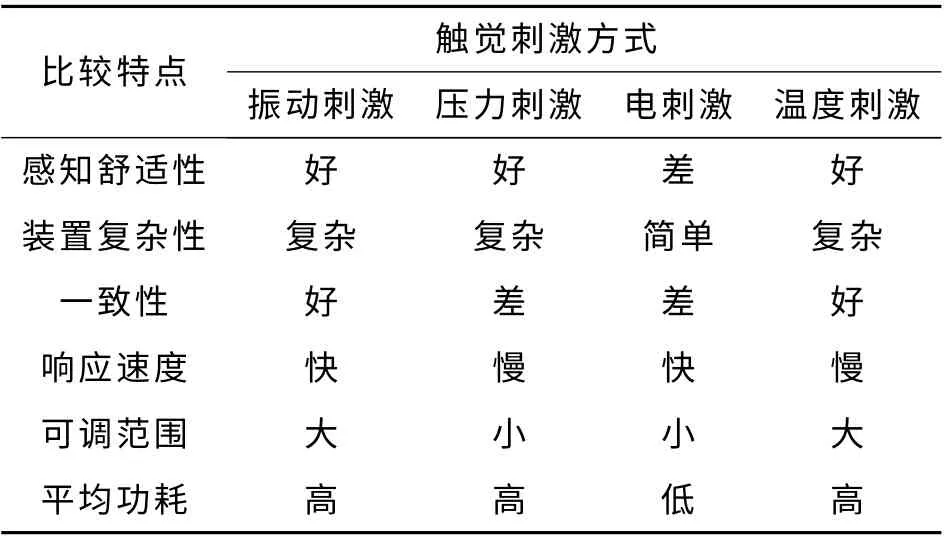

按照觸覺刺激方式的不同,觸覺刺激可以分成振動刺激式、壓力刺激式、電刺激式和溫度刺激式等方式[12].這幾種方式通過觸覺刺激裝置與人體皮膚直接接觸,進而產生相應的觸覺刺激.表1比較了幾種不同的觸覺刺激方式.在這些刺激方式中,與其他刺激方式相比,振動刺激具有感知舒適性好、響應速度快和可調范圍大等優(yōu)點[13].

表1 觸覺刺激方式比較Tab.1 Comparison of tactile stimulation ways

1.2 情感信息的觸覺表達

情感表達在人類社交活動中扮演著重要角色.研究表明,人們交往過程中會通過將撫、摸、抓、撓等觸覺刺激作用于對方來表達自身的情感信息[14].

情感信息觸覺表達理論、方法和技術研究是交互設計領域中的新方向.Bailenson 等[15]發(fā)現(xiàn)可以通過一個觸覺操縱桿進行情感的表達與識別.Smith等[16]使用一個觸覺反饋裝置調查人們在進行多人游戲過程中情感信息的表達.Nakatsuma等[17]通過在文本通訊過程中引入振動刺激,從而提高情感信息的表達效率.

可穿戴計算技術的發(fā)展,為情感信息的觸覺表達提供了非常好的研究平臺.可穿戴計算設備與人體皮膚緊密接觸,觸覺信號能夠直接傳遞到皮膚.將情感信息以觸覺方式呈現(xiàn),有望提高人們對情感的感知能力.Huisman等[18]開發(fā)了一個可穿戴觸覺手腕TaSST(tactile sleeve for social touch),被試通過該觸覺手腕能夠有效地利用振動信號進行情感表達.類似地,Arafsha等[19]設計了一款可穿戴觸覺夾克用來提高用戶的情感沉浸體驗.

2 振動參數(shù)設置

基于觸覺的信息傳遞多采用振動方式,即將信息轉化為特定強度、節(jié)奏、時長的振動信號并作用于人體,使人感知信息.不同的振動模式可以讓人感受到不同的情感,如持續(xù)高強度的振動可能讓人感受到憤怒,而規(guī)則間斷的中等強度振動則會讓人驚訝[20].振動強度、持續(xù)時間、節(jié)奏和作用位置是目前振動刺激裝置中的主要可控參數(shù).

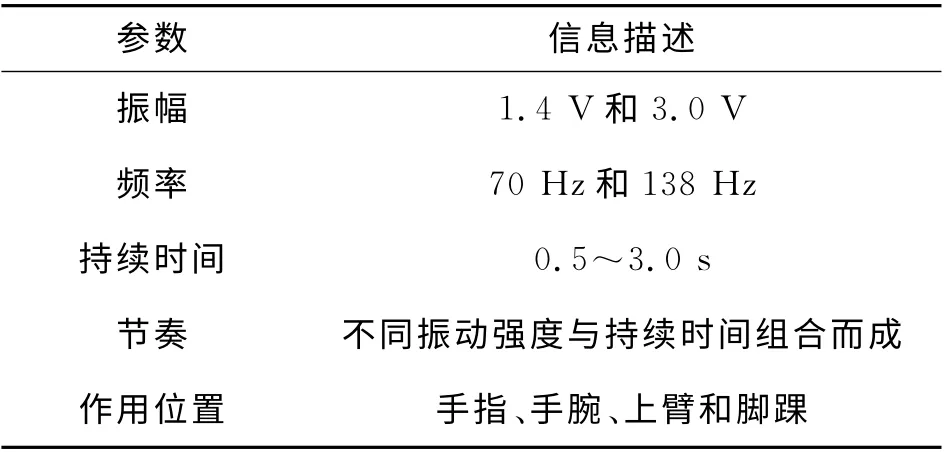

1)振動強度.

本研究采用扁平振動電機作為振動刺激源.隨著電壓的增加,扁平振動電機的振動頻率與電壓為指數(shù)關系,當電壓達到某個中間值后,振動頻率與電壓為線性關系,且驅動電壓越大,振幅越大[21].振動強度的設置采用2 種振動強度:低強度(1.4V,70 Hz)和高強度(3.0V,138Hz).

2)持續(xù)時間與節(jié)奏.

不同持續(xù)時間的振動能刺激人體產生不同的感受.Seifi等[22]調查發(fā)現(xiàn)被試對長持續(xù)時間(1s)的振動表現(xiàn)出較高的接受度,對于短持續(xù)時間(0.1~0.3s)的振動則表現(xiàn)出較低的接受度.

不同節(jié)奏的振動可以傳遞不同的信息,如可以用不同節(jié)奏的振動來區(qū)分來自不同人的來電振動提醒.

3)作用位置.

不同部位的皮膚擁有不同的敏感度,振動位置的選擇直接決定能夠傳遞的最大信息量和傳遞的效率.振動刺激裝置不宜放置在頭部附近,以防止振動干擾聽力,產生不期望的噪聲[23].

在振動位置參數(shù)的設置上,本研究參考了弗雷斯特研究公司(Forrester Research,Inc.)于2013針對北美科技類消費者的調研數(shù)據(jù).對于“假如你信任的公司提供了吸引你的可穿戴傳感器設備,你愿意如何穿戴?”這一問題,大部分用戶選擇了手指、手腕、上臂和腳踝這4個部位.因此,本次研究將振動位置設置在手指、手腕、上臂和腳踝.本次研究的振動參數(shù)設置如表2所示.

表2 振動參數(shù)設置Tab.2 Vibration parameter settings

3 實驗過程

本實驗分3步進行:1)設計振動表情;2)比較振動表情的識別率;3)評估振動表情的有效性.

3.1 實驗一:設計振動表情

憤怒、害怕、高興、悲傷、厭惡和驚奇是美國心理學家Ekman提出的6類基本情感.這一情感分類方法得到了研究領域的廣泛認可.本文采用這一情感分類方法,旨在設計出能夠代表這6種基本情感的振動模式,即振動表情.

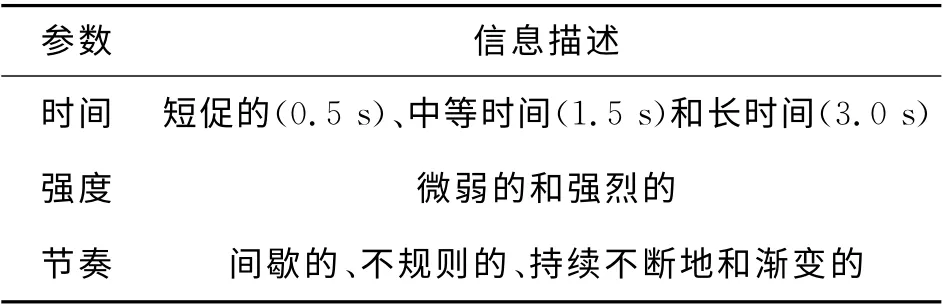

實驗要求被試從時間、強度和節(jié)奏3個參數(shù)填寫問卷,進行振動表情的設計.共有40名被試,其中有17名女性和23名男性.被試年齡在19~27歲,平均年齡為22.9歲,標準差為2.02.問卷包含引導語、年齡信息、性別信息以及6組關于基本情感的振動模式設計信息.如表3 所示,實驗要求被試從時間、強度和節(jié)奏這3個參數(shù)進行振動模式的設計,設計出與6種基本情感相對應的振動模式.若被試對某種振動模式?jīng)]有設計思路可以留空白.

實驗結束后,首先統(tǒng)計被試是否能夠對每種基本情感進行振動模式的設計.實驗發(fā)現(xiàn):有97.5%的被試能設計出代表“憤怒”,95.0%被試能設計出代表“高興”的振動模式;此外,87.5%的被試能夠設計出代表“害怕”和“驚奇”的振動模式,90.0%的被試能夠設計出代表“悲傷”的振動模式,只有77.5%的被試能夠設計出代表“厭惡”的振動模式.

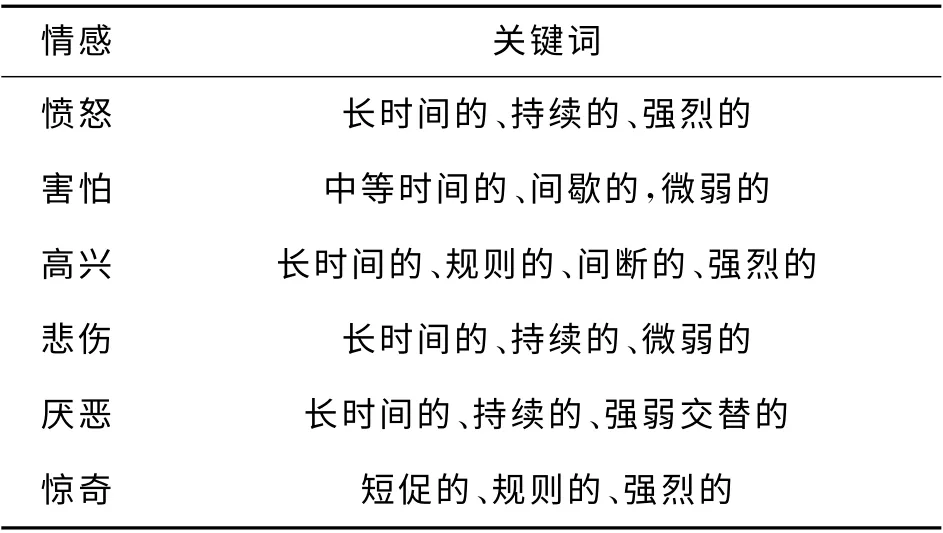

針對每一種基本情感,提取被試設計相對應的振動模式時使用到的關鍵詞,并統(tǒng)計其頻次.各種振動模式設計時出現(xiàn)頻率最高的關鍵詞如表4所示.

表3 振動模式設計參數(shù)描述Tab.3 Description of vibration pattern design parameters

表4 振動模式設計關鍵詞Tab.4 Keywords of vibration pattern design

調查發(fā)現(xiàn),被試在設計振動模式時,主要是從聽覺和視覺這2個感官進行聯(lián)想.比如,有被試覺得代表“高興”的振動模式應該是:“長時間的,3 個為1組的,強度一定的振動,參考‘啦啦啦,啦啦啦,啦啦啦’給人一種表示高興的感覺”;而有被試認為代表“驚奇”的振動模式是:“短促且高強度的連續(xù)振動兩下,這種振動模式就好像是一顆燈閃了兩下,能給人驚奇的感覺”.

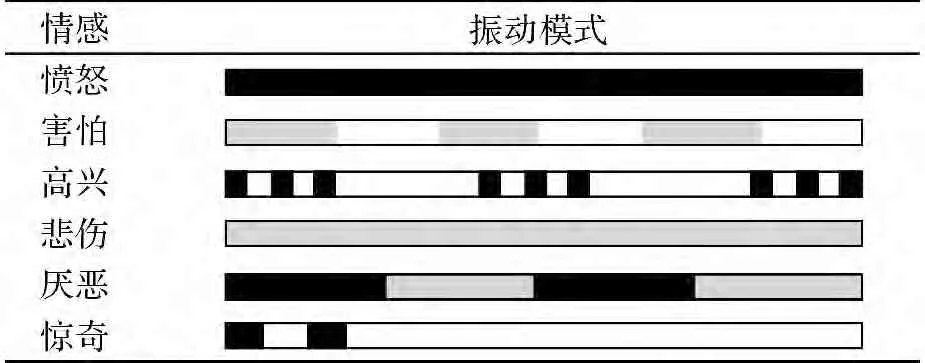

根據(jù)問卷的分析結果并結合Ternes等[24]提供的振動模式設計思路,設計出6種振動模式,分別對應6種基本情感,并將這6種振動模式稱為“振動表情”,如表5所示.其中,黑色代表高強度振動,灰色代表低強度振動,白色代表無振動;每種振動模式的振動時長介于0.5~3.0s.

表5 振動表情所對應的振動模式Tab.5 Vibration patterns corresponding to vibration emoticons

3.2 實驗二:比較振動表情的識別率

本次實驗將上述設計的振動表情應用于可穿戴計算設備常作用的4個部位上,比較振動表情在各部位的識別率,即:驗證被試能否在各部位準確識別出每一種振動模式所代表的情感.

本次實驗使用的硬件裝置由1塊Arduino控制板、1個藍牙模塊和4 個振動電機構成,如圖1 所示.4個振動器和1個藍牙模塊分別連接在Arduino控制器的不同端口上.藍牙模塊用于將手機發(fā)出的信息傳送給Arduino控制器.當Arduino控制器接收到手機發(fā)送出的特定信號,就會給特定的振動器通電,產生相應的振動刺激.

本次實驗共有30名被試,包括14名女性和16名男性.被試年齡在20~26 歲,平均年齡為23.3歲,標準差為1.77.所有被試都沒有參加過第一階段的實驗.

被試單獨進行實驗,實驗過程中被試需要戴上播放著白噪聲的耳機,避免外界環(huán)境及振動器的噪音對實驗結果產生影響.4個振動器分別固定在被試的手指、手腕、上臂和腳踝,并確保振動器與被試肌膚接觸的緊密程度基本保持一致,如圖2所示.

圖1 振動表情識別實驗硬件設備Fig.1 Hardware equipment for vibration emoticons recognition experiment

圖2 實驗二:振動器固定在4個不同部位Fig.2 Vibrations fixed on four different parts in experiment 2

實驗指導語通過被試面前的顯示器呈現(xiàn),指導語說明了本次實驗的目的與實驗流程.一旦被試清楚了實驗中需要做什么,且沒有其他問題,實驗正式開始.實驗過程如下:

1)實驗者通過手機向Arduino控制器發(fā)送指令,控制指定振動器產生某種與基本情感相對應的振動效果;

2)被試首先仔細感受振動,然后在6種基本情感(憤怒、害怕、高興、悲傷、厭惡和驚奇)中選擇自己認為最匹配的情感.

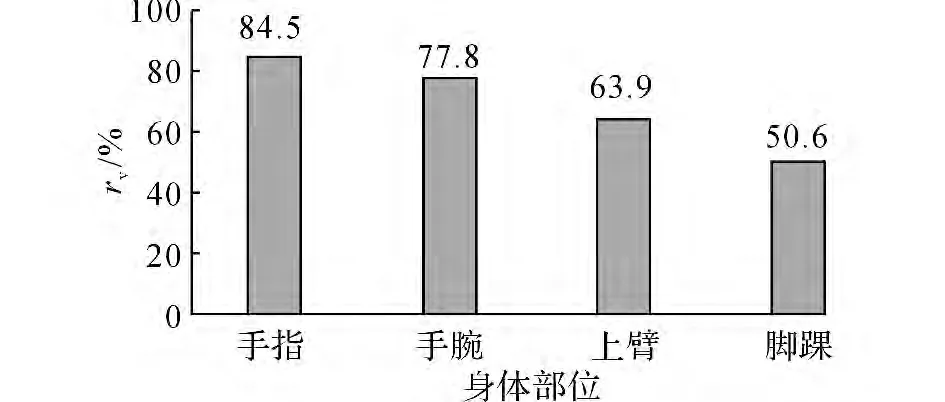

上述過程重復24次,從而覆蓋6種振動表情分別作用于人體4個部位的情況.實驗結束后,對4個部位分別進行統(tǒng)計,得到各部位的平均識別率,如圖3所示.其中,rv為振動表情識別率.實驗結果表明:手指和手腕部位振動表情的識別率都比較高,而腳踝部位的識別率最低.這與人的生理結構相符合,與其他部位相比,手指的敏感度最高.大多數(shù)被試不習慣將振動設備安置于腳踝部位,振動設備振動時會有不適感,容易引發(fā)負情感,從而影響情感識別結果.這也導致腳踝部位的識別率明顯低于其他3個部位.

圖3 各部位振動表情識別率Fig.3 Recognition rates of vibration emoticons on each body parts

3.3 實驗三:評估振動表情的有效性

本實驗將上述6種振動表情應用于可穿戴計算設備中,并探討遠程通信場景下振動表情對于情感表達的作用,以評估振動表情的有效性.

本實驗分為3個階段進行:1)探討無噪聲語音通信場景下對應情感振動表情對情感傳遞的影響;2)探討無噪聲語音通信場景下非對應情感振動表情對情感傳遞的影響;3)探討有噪聲語音通信場景下對應情感振動表情對情感傳遞的影響.

3.3.1 實驗裝置 實驗裝置包括1塊Arduino控制板、1塊VS1053 MP3模塊、1枚振動指環(huán)和1個耳機,如圖4所示.實驗時,被試須戴上耳機及振動指環(huán).MP3模塊播放音頻信息,模擬語音通信場景.Arduino控制振動指環(huán)產生相應的振動模式.

圖4 實驗三:被試進行語音情感識別Fig.4 Subject recognizing emotions of voice materials in experiment 3

3.3.2 實驗材料 實驗的語音材料取自CASIA漢語情感語料庫,CASIA 庫共包含1 200 句語句,包含憤怒、害怕、高興、悲傷、驚訝、中性6類情感.從CASIA 漢語情感語料庫取出18句語句,分為3組,每組包含憤怒、害怕、高興、悲傷、驚訝、中性6類情感各1句.從中取出第1、2 組,加入信噪比為-16 dB的白噪聲,模擬有噪聲環(huán)境下的語音信息.因此,共有5組語音樣本信息,其中第1、2、3組為無噪聲語音信息,第4、5組為第1、2組加噪處理后產生的有噪聲語音信息.

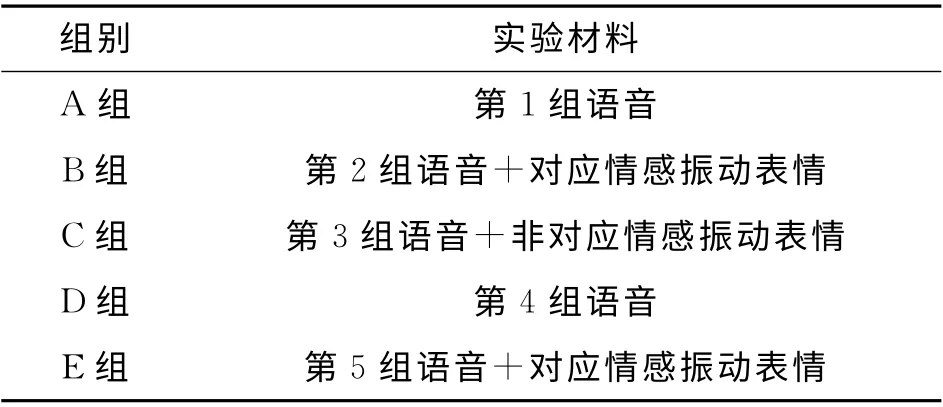

實驗分5組(A~E)進行,每組均包含有6句語音樣本.其中,B、E 組在呈現(xiàn)語音信息時,同時呈現(xiàn)對應情感的振動表情;C組在呈現(xiàn)語音信息時,同時呈現(xiàn)非對應情感振動表情.每組包含的具體信息如表6所示.

表6 情感識別實驗材料分組情況Tab.6 Group of materials in emotion recognition experiment

3.3.3 被試 本次實驗共有20名被試,其中有8名女性和12名男性.被試年齡為22~28歲,平均年齡為24.2歲,標準差為1.59.每個人都具有良好的聽覺與觸覺,在實驗前均沒有接觸過本次實驗材料.

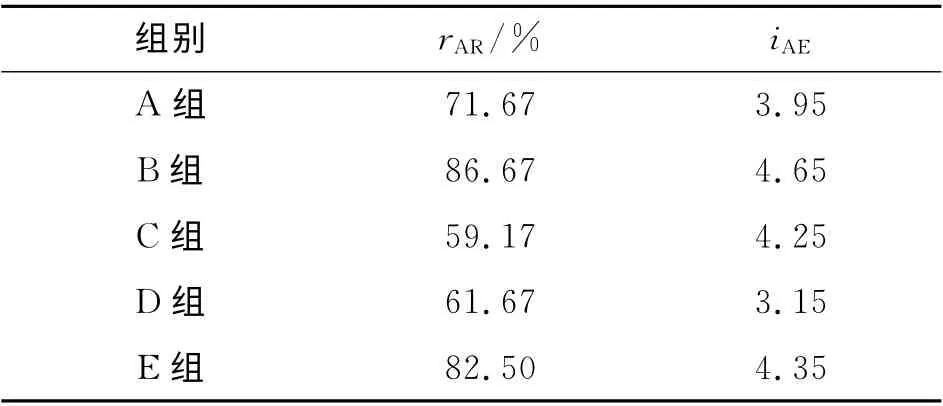

3.3.4 實驗過程 首先,被試戴上耳機及振動指環(huán),通過耳機收聽MP3模塊隨機播放的語音信息,并通過指環(huán)感受對應的振動效果.被試需要收聽30條不同的語音信息,并感受與之相對應的振動效果.其次,每條語音播放完畢后,被試需要填寫情感傳遞信息問卷.問卷內容包括識別該段語音所對應的情感,并對情感強度進行打分.情感強度采用7 分量表,其中1 表示情感強度最弱,7 表示情感強度最強.實驗結果表7所示,其中,rAR為平均識別率;iAE為平均情感強度,只統(tǒng)計準確識別情感的實驗樣本.對實驗結果的分析情況如下.

1)比較A、B 兩組,在無噪聲語音的通訊場景下,使用交叉分析檢驗對無振動表情和有對應情感振動表情2種情況下的情感識別率進行分析,發(fā)現(xiàn)兩者之間存在顯著差異(χ2=8.185,p=0.004),其中,p 為結果可信程度的一個遞減指標,p 值越大,越不能認為樣本中變量的關聯(lián)是總體中各變量關聯(lián)的可靠指標.其中,對應情感振動表情可以提高被試者對語音信息的情感識別率,平均識別率從71.67%提高到了86.67%,提高了15.00%.使用獨立樣本T檢驗對無振動表情和有對應情感振動表情2種情況下的情感感知強度進行分析,發(fā)現(xiàn)兩者之間存在顯著差異(t=-3.035,p=0.003),對應情感振動表情情況下的平均情感強度(4.65)高于無振動表情情況下的平均情感強度(3.95).

表7 情感識別結果Tab.7 Results of emotion recognition

2)比較A、C 兩組,在無噪聲語音通訊場景下,使用交叉分析檢驗對無振動表情和有非對應情感振動表情2種情況下的情感識別率進行分析,發(fā)現(xiàn)兩者之間不存在顯著差異(χ2=3.149,p=0.076);使用獨立樣本T 檢驗對無振動表情和有非對應情感振動表情兩種情況下的情感感知強度進行分析,發(fā)現(xiàn)兩者之間不存在顯著差異(t=-1.141,p=0.256).

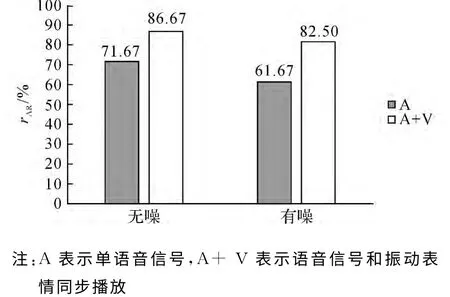

3)比較D、E 兩組,在有噪聲語音通訊場景下,使用交叉分析檢驗對無振動表情和有對應情感振動表情兩種情況下的情感識別率進行分析,發(fā)現(xiàn)兩者之間存在顯著差異(χ2=8.821,p=0.003),對應情感振動表情也可以提高被試者對語音信息的情感識別率,而且效果更顯著,平均識別率從61.67%提高到了82.50%,提高了20.83%,如圖6所示.使用獨立樣本T 檢驗對無振動表情和有對應情感振動表情兩種情況下的情感感知強度進行分析,發(fā)現(xiàn)兩者之間存在顯著差異(t=-5.271,p<0.001),對應情感振動表情情況下的平均情感強度(4.35)高于無振動表情情況下的平均情感強度(3.15).

圖6 2種場景下的平均識別率比較Fig.6 Comparison of average recognition rates in two scenarios

4)除此之外,比較A、D 組和B、E 組還可以發(fā)現(xiàn),相對于無噪聲場景,在有噪聲場景下,平均識別率均有明顯的下降.單語音信號時,平均識別率下降了10%,而語音信號結合振動信號時,平均識別率只下降了4.17%,即在有噪聲場景下,振動表情的輔助作用更為顯著.

由此可見,對于語音信息的情感表達,結合對應情感振動表情后,情感識別率和情感感知強度均有所提高,其中在有噪聲場景下,振動表情的輔助作用更加顯著.對于特定情感語音信息,結合非對應情感觸覺信息后,雖然平均情感強度與平均識別率有變化,但檢驗結果并不存在顯著差異,說明非對應振動表情對于情感的識別率并未產生顯著成效.這證明在語音通信過程中,對應情感觸覺信息對情感傳遞具有輔助作用,在提高情感識別率的同時還能增強情感感知強度.因此,可考慮在可穿戴計算設備中引入振動表情,將情感特征以振動的形式表現(xiàn)出來,從而提高情感傳遞的效率.在語音通訊過程中,將振動表情與語音信息相結合,共同對情感進行表達,將有助于提高情感的識別率,增強感受到的情感強度.

4 結 語

本文將振動表情應用在識別率相對較高的手指上,實驗發(fā)現(xiàn)在可穿戴計算設備中引入振動表情,以振動表達情感信息,可以有效提高情感的識別率,增強感受到的情感強度.后續(xù)研究將綜合考慮被試者的習慣、觸覺的敏感度和識辨率、振動模塊的功耗、信息表達等的不同組合開展不同實驗,選擇最優(yōu)組合以設計更具代表性的振動表情.此外,本文的實驗主要是在實驗室中進行,但可穿戴計算設備的使用情境較為廣泛,后續(xù)研究會將振動表情應用于移動情境下,以提高振動表情的實用性與可操作性.

(

):

[1]ROGGEN D,MAGNENAT S,WAIBEL M,et al.Wearable computing [J].Robotics and Automation Magazine,2011,18(2):83-95.

[2]MANN S,HUANG J,JANZEN R,et al.Blind navigation with a wearable range camera and vibrotactile helmet[C]∥Proceedings of the 19th ACM International Conference on Multimedia.Scottsdale:ACM,2011:1325-1328.

[3]WAHL F,AMFT O,F(xiàn)REUND M.Using smart eyeglasses as a wearable game controller[C]∥Proceedings of the 2015ACM International Joint Conference on Per-vasive and Ubiquitous Computing and Proceedings of the 2015ACM International Symposium on Wearable Computers.Osaka:ACM,2015:377-380.

[4]BIEBER G,KIRSTE T,URBAN B.Ambient interaction by smart watches[C]∥Proceedings of the 5th International Conference on PErvasive Technologies Related to Assistive Environments.Heraklion:ACM,2012:39.

[5]ZUBAIR M,YOON C,Kim H,et al.Smart wearable band for stress detection[C]∥2015 5th International Conference on IT Convergence and Security(ICITCS).Kuala Lumpur:IEEE,2015:1-4.

[6]陳東義.可穿戴式計算機的發(fā)展與趨勢(Ⅰ)[J].重慶大學學報:自然科學版,2000(3):119-124.CHEN Dong-yi.The evolution and trend of wearable computer[J].Journal of Chongqing University:Natural Science Edition,2000(3):119-124.

[7]MATTHIES D J C.InEar BioFeedController:a headset for hands-free and eyes-free interaction with mobile devices[C]∥CHI′13Extended Abstracts on Human Factors in Computing Systems.Paris:ACM,2013:1293-1298.

[8]HARRISON C,BENKO H,WILSON A D.Omni-Touch:wearable multitouch interaction everywhere[C]∥Proceedings of the 24th annual ACM symposium on User interface software and technology.Santa Barbara:ACM,2011:441-450.

[9]SEEHRA J S,VERMA A,RAMANI K.ChiroBot:modularrobotic manipulation via spatial hand gestures[C]∥Proceedings of the 2014Conference on Interaction Design and Children.Aarhus:ACM,2014:209-212.

[10]MISTRY P,MAES P,CHANG L.WUW-wear Ur world:a wearable gestural interface[C]∥CHI′09 Extended Abstracts on Human Factors in Computing Systems.Boston:ACM,2009:4111-4116.

[11]王妍,吳斯一.觸覺傳感:從觸覺意象到虛擬觸覺[J].哈爾濱工業(yè)大學學報:社會科學版,2011,13(5):93-98.WANG Yan,WU Si-yi.Haptic sensing technology:from haptic images to the haptics[J].Journal of Harbin Institute of Technology:Social Sciences Edition,2011,13(5):93-98.

[12]TIWANA M I,REDMOND S J,LOVELL N H.A review of tactile sensing technologies with applications in biomedical engineering[J].Sensors and Actuators A:physical.2012,179:17-31.

[13]郝飛,盧偉,宋愛國,等.信息觸覺表達技術的研究現(xiàn)狀與應用[J].測控技術,2011,30(1):6-9.HAO Fei,LU Wei,SONG Ai-guo,et al.Recent developments and applications of tactile information display technology[J].Measurement and Control Technol-ogy,2011,30(1):6-9.

[14]WEIGEL M,MEHTA V,STEIMLE J.More than touch:understanding how people use skin as an input surface for mobile computing[C]∥Proceedings of the 32nd Annual ACM Conference on Human Factors in Computing Systems.Toronto:ACM,2014:179-188.

[15]BAILENSON J N,YEE N,BRAVE S,et al.Virtual interpersonal touch:expressing and recognizing emotions through haptic devices[J].Human-Computer Interaction,2007,22(3):325-353.

[16]SMITH J,MACLEAN K.Communicating emotion through a haptic link:design space and methodology[J].International Journal of Human-Computer Studies,2007,65(4):376-387.

[17]NAKATSUMA K,HOSHI T,TORIGOE I.Hapticemoticon:haptic content creation and sharing system to enhancing text-based communication[J].Proceedings of SICE 2013,2013:218-222.

[18]HUISMAN G,DARRIBA FREDERIKS A.Towards tactile expressions of emotion through mediated touch[C]∥CHI′13Extended Abstracts on Human Factors in Computing Systems.Paris:ACM,2013:1575-1580.

[19]ARAFSHA F,ALAM K M,El SADDIK A.Emo-Jacket:Consumer centric wearable affective jacket to enhance emotional immersion[C]∥2012International Conference on Innovations in Information Technology(IIT).AbuDhabi:IEEE,2012:350-355.

[20]SHIN H,LEE J,PARK J,et al.A tactile emotional interface for instant messenger chat[J].Human Interface and the Management of Information.Interacting in Information Environments,Berlin Heidelberg:Springer,2007:166-175.

[21]蘇波,張桔,韓雪.基于微振動馬達的無閥微泵的研究[J].傳感器與微系統(tǒng),2010(9):12-14.SU Bo,ZHANG Ju,HAN Xue.Study on valveless micropump based on micro-vibration motor[J].Transducer and Microsystem Technologies,2010(9):12-14.

[22]SEIFI H,MACLEAN K E.A first look at individuals’affective ratings of vibrations[C]∥2013International Conference on World Haptics Conference(WHC).Daejeon:IEEE,2013:605-610.

[23]GUNTHER E, O’MODHRAIN S. Cutaneous grooves:composing for the sense of touch[J].Journal of New Music Research,2003,32(4):369-381.

[24]TERNES D,MACLEAN K E.Designing large sets of haptic icons with rhythm[M]∥Haptics:Perception,Devices and Scenarios.Berlin Heidelberg:Springer,2008:199-208.