融合統計學和TextRank的生物醫學文獻關鍵短語抽取

魏 赟 孫先朋

(上海理工大學光電信息與計算機工程學院 上海 200093)

融合統計學和TextRank的生物醫學文獻關鍵短語抽取

魏 赟 孫先朋

(上海理工大學光電信息與計算機工程學院 上海 200093)

關鍵短語的抽取在文本聚類、分類、檢索等方面有著重要的作用。利用經典的TF-IDF算法來提高文本關鍵短語抽取的質量。通過對TF-IDF算法的研究,發現TF-IDF可以綜合利用單個文本信息和文本集合信息抽取文本關鍵詞。在此基礎上,提出一種綜合TF-IDF、TextRank、統計學知識抽取關鍵短語的方法和利用候選關鍵短語逆向文檔頻率排序的方法。該方法在TextRank基礎上,通過TF-IDF引入詞的文本集合信息計算詞之間權重得到詞的得分。然后利用統計學知識從上一步選出詞組成的短語篩選出候選關鍵短語。最后利用逆向文檔頻率的思想對候選關鍵短語排序。實驗證明,該模型相比于經典TextRank模型準確率提高了2%,召回率提高了4.5%,F-measure提高了3.4%。

TextRank 關鍵短語抽取 TF-IDF 逆向文檔頻率

0 引 言

關鍵詞抽取技術是信息處理領域的核心技術。對于生物醫學文獻,由于人工標記關鍵詞的隨機性、專業詞匯較多、語言結構復雜、數據量大等原因,需要一種基于全文的自動化抽取生物醫學文獻關鍵詞的方法來建立更加科學的文本分類方法。

目前常用的無監督關鍵詞抽取方法主要是LDA[1]、TF-IDF[2]、TextRank[3]。從三者的算法原理上看,LDA和TF-IDF均沒有考慮詞在文本中的順序,因此不適合直接抽取文本關鍵短語。而TextRank算法,Rada Mihalcea等已經證明了其抽取關鍵短語短語的可行性。針對TextRank算法的改進模型有很多,一種是TextRank結合主題模型的方法[4-5],但是該種方法需要事先選定高質量的訓練集。一種是對TextRank加權的方法[6-7],文獻[6]將窗口中共現詞的頻率作為二元共現詞之間的權重,該方法更加偏好高頻詞。文獻[7]將時間表達式加入到TextRank權重計算中,但該方法會增強不相連接詞間的關系。在使用TextRank抽取出候選關鍵短語后,接下來短語緊密程度的判定和候選短語排序。目前常用的判定方法主要是頻率、互信息、信息熵、邊界多樣性以及 統計等[8-10]方法。使用統計學方法可以去掉緊密程度不高的短語,從而增強抽取關鍵短語的準確率。常用的候選短語排序方法是用候選短語包含關鍵字的得分之和代表候選短語得分,文獻[6]修正了上述方法對候選短語中包含一個分值更高而錯誤排序的情況,但是該排序方法更加偏好短語而降低了一元短語的重要性。

綜上所述,本文基于生物醫學文獻全文使用TF-IDF優化的TextRank算法抽取候選關鍵短語,并使用頻率、互信息、邊界多樣性對候選關鍵短語篩選,然后提出了將逆向文檔頻率引入候選關鍵短語排序方法,從而達到優化抽取生物醫學文獻短語關鍵詞的目的。

1 基于TextRank的關鍵短語抽取模型

本文模型主要包括三個核心步驟:(1) 一元短語抽取,利用TF-IDF優化的TextRank算法抽取一元短語;(2) 二三元短語抽取,遍歷生物醫學文獻全文找出相連的一元短語和一元短語中夾有停用詞的短語,然后利用從統計學知識對其中二三元短語篩選;(3) 候選關鍵短語排序,將(2)中得到的二三元短語和其不包含的一元短語使用本文提出的排序方法排序取排名靠前作為關鍵短語。圖1為本文模型關鍵短語抽取流程圖。

圖1 關鍵短語抽取流程圖

1.1 一元短語抽取

TF-IDF是面向多文檔的關鍵詞抽取方法,他通過詞的頻率信息和詞在文本集合中的信息得到詞在文本中的重要性。TF-IDF公式為:

(1)

TextRank是衍生于PageRank的基于圖結構的以推薦形式抽取文本關鍵詞的算法。Rada Mihalcea等首先將TextRank算法引入到文本挖掘領域,證明了其抽取文本關鍵短語的可行性。TextRank將文本看作是G(V,E)的形式,V表示文本中的詞,E為詞語之間的邊。通過設定窗口的大小,窗口內建立圖結構迭代計算直至收斂后得到詞的得分。TextRank公式如下:

(2)

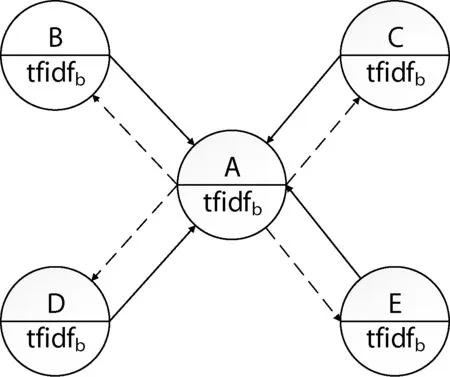

Textrank強調兩個詞之間的聯系,而且傳統TextRank算法人為設定詞之間都賦予相同的初始權重,并僅利用了文本本身的信息。經過以上考慮,本文提出了一種新的TF-IDF對TextRank加權的方法,該方法將詞的推薦能力和文本集合的信息加入到TextRank算法中。例如,圖2由{A,B,C,D,E}五個詞組成的候選關鍵詞圖,圓圈上部分為詞,下部分為詞的TF-IDF值。

圖2 候選關鍵詞圖示例

在圖2中,傳統TextRank算法會賦給與相連的詞之間相同的權重,默認為1。而本文方法則考慮到詞的推薦能力不同,如A、B之間,計算詞A的得分時和計算詞B的得分時它們之間的權重是不同的。計算A指向B的權重時,首先計算與A相連的詞(包含B)的TF-IDF值之和,然后計算B的TF-IDF值占與A相連詞的TF-IDF值之和的比例值,將該值作為A指向B的權重,同理可得B指向A的權重。權重計算公式如下:

(3)

式中:wij表示詞j指向詞i的權重,tfidfi表示詞i的TF-IDF值,Inj表示與詞j相連的詞集合。

1.2 二三元短語抽取

抽取出候選關鍵詞后,在全文找出相連的候選關鍵詞組成候選短語。但是此時的候選短語存在許多問題,比如緊密程度不夠、重要性低等,需要相應的方法對此時的候選短語篩選。本文使用短語頻率、互信息和邊界多樣性判定短語。公式分別如下:

tfp≥times

(4)

式中:其中tfp是短語p出現的次數,times是人工設定的短語出現最低次數。

(5)

式中:MIxy為短語xy的互信息,p(xy)為短語xy出現的概率,p(x)、p(y)分別為詞x、y出現的概率。

(6)

為了使選出的關鍵短語更能體現文本的內容,需要對短語頻率、互信息、邊界多樣性設定相應的閾值,去掉頻率低和緊密程度不高的短語,判斷條件如下:

MIxy≥MI

(7)

式中:MI為短語的互信息閾值。

Ap≥A

(8)

式中:A為短語的邊界多樣性閾值。

1.3 候選關鍵短語排序

生物醫學文獻中的關鍵詞主要是短語和單個詞,本文的目標是抽取出包含一元短語的文本關鍵短語。對候選關鍵詞排序是非常重要的部分,因為選擇出來的候選關鍵詞往往數量比較多,而我們必須從其中選擇10~15個[11]作為文本的關鍵詞。而使用Abdelghani Bellaachia提出的排序方法不能滿足本文的要求。生物醫學文獻中關鍵短語的長度一般小于四個詞(四元以上的短語一般會以簡寫表示),因此本文只統計三元之內(包含三元)的短語。TF-IDF算法中,IDF的思想是若一個詞在一篇文本中出現的次數多但在文本集合中其他文本中出現的次數少則證明此詞對該文本越重要,同理本文將該思想用于短語排序。但是由于短語越長頻率越低,本文對短語頻率取對數降低頻率的影響力,然后對不同長度的短語賦予不同的權重的方法對短語排序。公式如下:

scorep=α×logtfp×idfp

(9)

式中:scorep為短語p的得分,tfp為短語p的頻率,idfp為短語的逆向文檔頻率,α∈(0,1)為短語權重,α參數經過實驗得來。

2 仿真實驗

2.1 實驗數據和相關工具

本文所用的數據為英文生物醫學文獻,從PubMed數據庫中隨機下載574篇文獻。開發語言Java,分詞工具Lucene 5.5.0,句法分析工具Opennlp。

2.2 評價標準

本文使用常用的準確率(P)、召回率(R)、F-measure作為判定標準。公式分別如下:

(10)

(11)

(12)

2.3 實驗結果及分析

本文通過研究100篇生物醫學文獻數據在參數α取不同的值時P、R、F-measure的變化,得出不同長度的短語的參數取值,如表1所示。

表1 短語參數取值

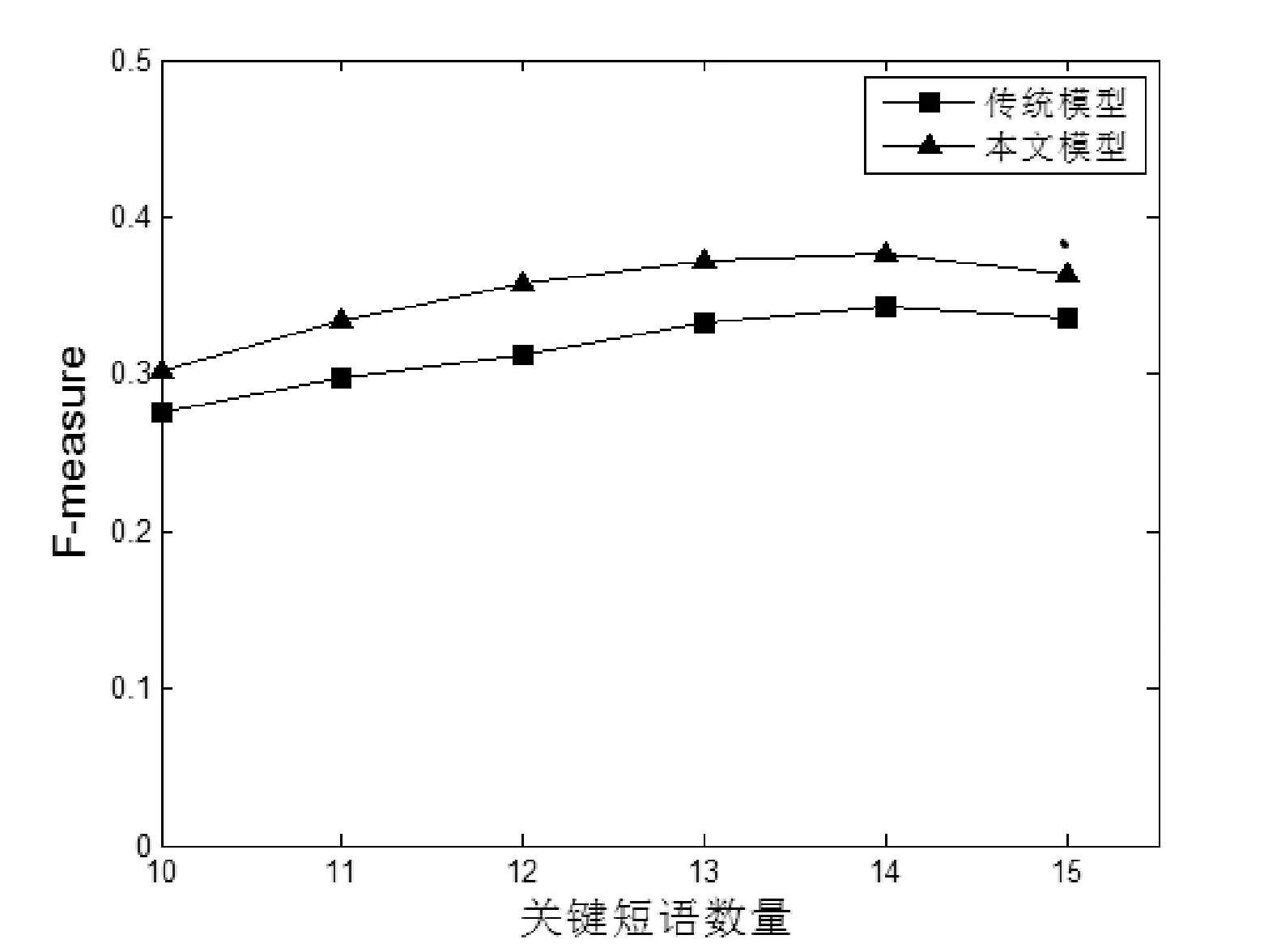

本文將傳統TextRank算法和TF-IDF加權的TextRank算法對比分析,同樣適用P、R、F-measure作為判定標準。對兩種方法選擇同樣的參數,分別如下:一元短語數量N1=60,短語頻率times=3,互信息閾值MI=7,邊界多樣性閾值A=0。對比兩種方法取不同數量的關鍵短語時的P、R、F-measure圖像,如圖3-圖5所示。

圖3 準確率對比

圖4 召回率對比

圖5 F-measure對比

通過觀察圖3-圖5可以發現,在取相同數量的關鍵詞時,本文方法相比于傳統的Textrank算法在準確率、召回率、F-measure上均有提高。而且可以發現當候選關鍵短語數量N2=14時,P、R、F-measure值最大,因此本文選擇候選關鍵短語數量為N2=14。候選關鍵短語數量確定后,兩種方法在P、R、F-measure的結果如表2所示。

表2 傳統模型和本文模型的結果對比

從表2可以看出,本文優化的Textrank方法在準確率上提高了2%,召回率提高了4.5%,F-measure提高了3.4%

3 結 語

本文針對生物醫學文獻數據的特點,提出了使用TextRank算法抽取生物醫學文獻關鍵詞的方法。并針對TextRank算法只依靠文檔自身信息和詞之間的推薦能力沒有差異性的特點,提出了使用TF-IDF對TextRank優化的方法。并結合統計學方法達到抽取生物醫學文獻關鍵詞目的。但是本文對短語權重的賦值還存在缺點。下一步的主要工作修正短語權重和進一步對文本聚類研究。

[1] Blei D M,Ng A Y,Jordan M.Latent dirichlet allocation[J].Journal of Machine Learning Research,2003,3:993-1022.

[2] Gerard Salton.Developments in automatic text tretrieval[J].Science,1991,253:974-980.

[3] Mihalcea R,Tarau P.TextRank:Bringing Order into Texts[C]//Conference on Empirical Methods in Natural Language Processing,EMNLP 2004,A Meeting of Sigdat,A Special Interest Group of the Acl,Held in Conjunction with ACL 2004,25-26 July 2004,Barcelona,Spain.DBLP,2004:404-411.

[4] 田長波,林民,斯日古楞.融合PAM和主題偏好TextRank 的歷史沿革信息抽取[J].計算機應用研究,2017(1):129-133.

[5] Bellaachia A,Aldhelaan M.NE-Rank:A Novel Graph-Based Keyphrase Extraction in Twitter[C]//IEEE/WIC/ACM International Joint Conferences on Web Intelligence.ACM,2012:372-379.

[6] Zhu Z,Li M,Chen L,et al.Combination of Unsupervised Keyphrase Extraction Algorithms[C]//International Conference on Asian Language Processing,2013:33-36.

[7] 趙佳鵬,林民.基于維基百科的領域歷史沿革信息抽取[J].計算機應用,2015,35(4):1021-1025.

[8] 劉海峰,姚澤清,蘇展.基于詞頻的優化互信息文本特征選擇方法[J].計算機工程,2014,40(7):179-182.

[9] Magerman D M,Marcus M P.Parsing a natural language using mutual information statistics[C]//Eighth National Conference on Artificial Intelligence.AAAI Press,1990:984-989.

[10] 劉榮,王奕凱.利用統計量和語言學規則抽取多字詞表達[J].太原理工大學學報,2011,42(2):133-137.

[11] Popova S,Danilova V.Keyphrase Extraction Abstracts Instead of Full Papers[C]//International Workshop on Database and Expert Systems Applications.IEEE,2014:241-245.

FUSION OF STATISTICS AND TEXTRANK FOR KEYPHRASE EXTRACTION IN BIOMEDICAL LITERATURE

Wei Yun Sun Xianpeng

(SchoolofOptical-electricalandComputerEngineering,UniversityofShanghaiforScienceandTechnology,Shanghai200093,China)

Keyphrase extraction plays a significant role in text clustering, classification, retrieval and so on. This paper uses the classic TF-IDF algorithm to improve the quality of text keyphrase extraction. By studying the TF-IDF algorithm, it is found that the TF-IDF can extract the text keywords by using the single text information and the text collection information. On this basis, this paper proposes a keyphrase extraction method by combining TF-IDF, TextRank, statistical knowledge and inverse document frequency sorting by candidate keyphrase. Based on the TextRank, this method calculates the weight of the words by TF-IDF to get the word score. And then use the statistical knowledge from the previous step to select the phrases of the phrase selected candidate keyphrases. Finally, the candidate keyphrases are sorted by the idea of inverse document frequency. Experiments show that the accuracy of this model is 2% higher than that of classical TextRank model, and the recall rate increased by 4.5% and F-measure increased by 3.4%.

TextRank Keyphrase extraction TF-IDF Inverse document frequency

2016-06-30。國家自然科學基金項目(61170277);上海市教委科研創新基金項目(12YZ094)。魏赟,副教授,主研領域:智能交通,對等網絡,分布式系統。孫先朋,碩士生。

TP311

A

10.3969/j.issn.1000-386x.2017.06.006