網(wǎng)絡虛擬展示中的服裝模擬方法綜述

張 惠,郭瑞良

(北京服裝學院,北京 100029)

1 引言

近年隨著電子商務的蓬勃興起,網(wǎng)絡購物已走進千家萬戶。服裝通過網(wǎng)絡平臺銷售,使消費者購物的便捷性和選擇性提高。據(jù)統(tǒng)計,2017年我國網(wǎng)絡購物人數(shù)已達到5.33億,其中服裝類商品消費占比最大。服裝在購物平臺上的展示方式雖然有平鋪、懸掛、真人試穿等多種展示方式,但都基于傳統(tǒng)的真實服裝圖片,有一定不足,例如平鋪等方式不能很好地展現(xiàn)服裝的穿著效果;真人試穿雖可多角度全方位地展現(xiàn)服裝穿著效果,但真人模特每次拍攝的費用相對昂貴,如服裝不受市場歡迎則會使商家得不償失[1]。

針對目前網(wǎng)絡服裝展示的窘境,一種新的服裝展示方式應運而生,即3D服裝虛擬展示技術(shù)。該技術(shù)適應市場需求,也是目前服裝數(shù)字化發(fā)展的趨勢所在。用戶只需通過一件虛擬的服裝即可從各個角度了解服裝的款式細節(jié),這種展示方式可以讓商家節(jié)省一定的成本。目前一些有實力的企業(yè)已將3D服裝虛擬展示技術(shù)應用到網(wǎng)絡平臺的個性定制、3D虛擬試衣、設計平臺等熱門領(lǐng)域[2]。本文主要針對靜態(tài)3D服裝的模擬方法展開論述,希望為網(wǎng)絡服裝的靜態(tài)展示研究提供一定參考。

2 物理模擬方法

服裝虛擬展示技術(shù)的難點在于對布料的精確模擬。盡管處于靜態(tài),但不同的展示姿態(tài)會使服裝在不同區(qū)域產(chǎn)生各種不確定性褶皺。如何更逼真地表現(xiàn)這些褶皺,一直是研究的重點。現(xiàn)有的布料模擬方法主要有幾何模擬、物理模擬和幾何-物理結(jié)合的混合模擬法。幾何模擬的優(yōu)點在于其模擬的高效性,但由于幾何模擬只是通過數(shù)學公式表示布料表面的凹凸效果而沒有考慮布料的不同材質(zhì),導致所有面料看起來效果是一樣的[3]。混合模擬方面,有研究者嘗試了兩種方法[4],一種是先用物理模擬生成服裝的總體運動趨勢,再由幾何方法刻畫褶皺等細節(jié)部位。另一種是根據(jù)服裝與人體的距離,距離近的使用幾何法驅(qū)動,距離遠的使用物理方法驅(qū)動。

因此目前使用較多的布料模擬方法是物理模擬。質(zhì)點-彈簧模型是物理模擬常用的模型[5],該模型的思想在于使用質(zhì)點構(gòu)成布料,其間用無質(zhì)量的彈簧連接,并賦予質(zhì)點以質(zhì)量,這樣質(zhì)點由于受重力場的作用就會形成類似于真實布料的懸垂狀態(tài)。該模擬方法的優(yōu)點在于模擬效果好,由質(zhì)點構(gòu)成的粒子距離的數(shù)值越小,服裝的模擬效果越真實。以韓國的一款服裝模擬軟件CLO 3D為例,該軟件采用物理模擬,粒子距離從20到10的變化過程中,模擬效果逐漸變得接近真實布料的效果,如圖1所示。其缺點在于隨著模擬真實度的增加和粒子距離的變小,后臺需要進行大量的數(shù)學運算,因此模擬過程中對計算機的配置要求較高。另外,以普通的一件女士襯衫為例,在CLO 3D中的粒子距離降低到5時,衣服的模擬效果比較真實,衣服的項目文件大小為20M,雖然現(xiàn)在網(wǎng)絡帶寬已經(jīng)達到較高的傳輸速度,但模型在網(wǎng)絡平臺上的瀏覽效果仍然不佳。在靜態(tài)3D服裝網(wǎng)絡展示中,為了給用戶提供良好的網(wǎng)頁瀏覽體驗,需要做到模型在網(wǎng)絡中流暢傳輸,這種基于物理的模擬方法在3D網(wǎng)絡虛擬展示中受到一定限制。因此,急需找到可以對服裝模型進行優(yōu)化,或者尋找完全有別于物理模擬的實現(xiàn)服裝高效實時模擬的方法。

圖1 CLO 3D中布料粒子距離變化

2.1 物理模擬下的服裝模型優(yōu)化方法 網(wǎng)格聚類

服裝模型的模擬效率低、網(wǎng)絡傳輸速度慢、占用內(nèi)存大,是因為高精度服裝是由大量密集的網(wǎng)格構(gòu)成的,如果能夠在保證模擬效果的前提下降低網(wǎng)格密度,以上難題就能得到很好的解決。針對這一點,不少研究者在虛擬服裝模型網(wǎng)格優(yōu)化方面做了大量的研究,提出了高精度網(wǎng)格劃分服裝的網(wǎng)格聚類的服裝建模方法。

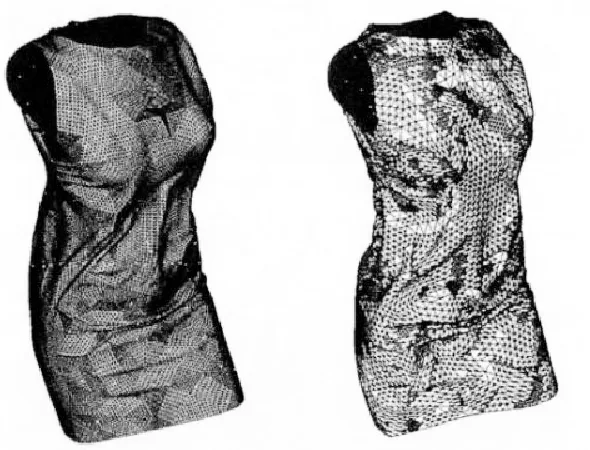

該方法的思想在于服裝的表面雖然有各種復雜的褶皺,這些褶皺需要更多的網(wǎng)格劃分才能更逼真的表現(xiàn),但是并不是整件服裝都會布滿褶皺,褶皺大多出現(xiàn)在關(guān)節(jié)處或者布料堆積處,比如腋下、肘部、膝蓋等位置的褶皺較多,而在大臂外側(cè)、背部、胸前、臀部等身體部位,布料并沒有太大的起伏,褶皺分布較少。根據(jù)這一規(guī)律,布料較平坦的區(qū)域就算使用較少的網(wǎng)格進行劃分也能達到和高密度網(wǎng)格劃分一樣的模擬效果。這樣一來,對于關(guān)節(jié)等位置的密集褶皺使用精細網(wǎng)格劃分,可以很好地表現(xiàn)褶皺效果,對于較平坦位置使用較少的網(wǎng)格劃分,不僅保證了整件衣服的模擬效果,還在一定程度上降低了模型的文件大小,如圖2所示[6]。

圖2 網(wǎng)格聚類的模型優(yōu)化方法

2.2 物理模擬下的服裝模型優(yōu)化方法 法線貼圖

另一種可以有效優(yōu)化模型的方法是制作模型的法線貼圖,然后進行烘焙和渲染。這種方法應用起來比較方便,在企業(yè)中使用較多。本文對多種法線貼圖優(yōu)化方法進行了對比研究,從中總結(jié)并優(yōu)化出模擬效果較好且有效降低模型網(wǎng)格精度的方法,具體的實現(xiàn)過程包括以下三點。

2.2.1獲得高模服裝

首先是制作服裝模型的高模,即較細網(wǎng)格劃分的模型。具體獲得高模的方法可以是由3D建模軟件進行二維板片到三維服裝的縫合。常用的服裝模擬軟件有韓國的CLO 3D虛擬試衣軟件,以色列的V-stitcher虛擬試衣軟件,以及近幾年興起的美國的TOKATUCH虛擬試衣。經(jīng)過試衣軟件縫合調(diào)整后,衣服能夠達到較好的外觀模擬效果。導出服裝的高模以及高模對應UV下的低精度網(wǎng)格劃分的服裝板片。值得注意的是:低精度網(wǎng)格劃分的板片的劃分精度(CLO 3D中的粒子距離)設置為多少比較合適。粒子距離越大,服裝網(wǎng)格密度越小,其優(yōu)點是得到的服裝底模占存儲空間越小,缺點是服裝模型表面以及袖口、下擺等位置由于網(wǎng)格過大會出現(xiàn)明顯棱角,從而降低了服裝模擬真實度,故而粒子距離的大小要視不同服裝款式多次嘗試,一般簡單款式的劃分精度為15,較復雜服裝(如古代服飾)的劃分精度設置為20。

2.2.2獲得底模服裝及細節(jié)處理

此時的底模板片是由雜亂不規(guī)則的四方網(wǎng)格組成的,這樣得到的底模服裝表面不平整,不利于后期的服裝細節(jié)處理,因而需要進行規(guī)則四方網(wǎng)格轉(zhuǎn)化。只需通過ZBrush軟件的ZRemesher功能進行轉(zhuǎn)化即可。

將轉(zhuǎn)化后的底模板片與高模的服裝模型進行UV傳遞,獲得底模服裝模型。可使用具有UV傳遞功能的三維軟件Maya進行操作。服裝的UV可以簡單理解為服裝的板片在空間中的坐標,必須保證服裝和板片的UV一致才能使底模板片完全吻合地傳遞到高模服裝模型上。接下來是通過3dsMax軟件對底模服裝進行邊緣、接縫處厚度的折邊、擠出等處理,從而增強服裝的立體效果。

2.2.3創(chuàng)建法線貼圖及紋理渲染

經(jīng)細節(jié)處理后的底模已實現(xiàn)較好的模擬效果,但是由于網(wǎng)格精度的降低,底模服裝的褶皺效果有所下降。因此,需要在ZBrush軟件中對底模進行層級劃分,同時在各層級對褶皺進行雕刻,以達到高層級劃分下的逼真模擬效果。這樣,就可以在ZBrush中導出高層級劃分下的法線貼圖。在3dsMax中進行法線貼圖的紋理渲染,通過光影的調(diào)整以及烘焙便能夠獲得真實感較強的三維虛擬服裝。法線貼圖的方式可以降低模型所占存儲空間大小,同時也能保證模擬的真實性。但這種方法需結(jié)合多個3D軟件平臺,且涉及到模型UV的一致性,建模過程相對復雜。

3 數(shù)據(jù)驅(qū)動的模擬方法

3.1 數(shù)據(jù)驅(qū)動現(xiàn)狀

在信息科技不斷發(fā)展過程中,各個企業(yè)都沉淀了大量數(shù)據(jù),這些數(shù)據(jù)中蘊含著重要的潛在價值。如何更好地利用這些數(shù)據(jù)促進企業(yè)發(fā)展,提升企業(yè)創(chuàng)新力和競爭力一直是企業(yè)的發(fā)展重點[7]。近幾年,數(shù)據(jù)驅(qū)動的人工智能方法成為熱點,該方法直接從數(shù)據(jù)中獲取深層次知識,并有了突破性進展。例如,谷歌公司利用網(wǎng)絡搜索引擎得到的大數(shù)據(jù)來預測疾病流行[8]。再如,各大手機品牌一方面將面部識別技術(shù)應用于手機,使得用戶只需刷臉即可解鎖屏幕。另一方面,開發(fā)團隊搜集上千個攝影師作品,尋找其中的構(gòu)圖規(guī)律和場景虛化規(guī)律,將其通過強大的AI智能技術(shù)應用于攝像頭,手機攝像頭便可識別多種標簽和拍攝場景,并對畫面智能虛化,達到類似單反的藝術(shù)效果。在這種人工智能的背后,是對基于數(shù)據(jù)驅(qū)動的機器學習的應用[9]。數(shù)據(jù)驅(qū)動就是通過對已有數(shù)據(jù)的分類、提取、總結(jié)并找到這類數(shù)據(jù)的內(nèi)部關(guān)系,從而掌握它們的規(guī)律,進而預測未來的發(fā)展趨勢。當然這些已有數(shù)據(jù)必須是足夠大量的數(shù)據(jù),才能找到它們的內(nèi)部規(guī)律并減小預測誤差。而使用各種算法尋找數(shù)據(jù)規(guī)律的過程就是機器學習的過程。總之,數(shù)據(jù)驅(qū)動的應用浪潮正在迎面撲來,只有掌握并應用這一趨勢才能走在智能科技的前端。

3.2 數(shù)據(jù)驅(qū)動在三維虛擬服裝中的研究現(xiàn)狀及問題

數(shù)據(jù)驅(qū)動技術(shù)已經(jīng)在很多領(lǐng)域成功應用。在虛擬服裝領(lǐng)域,數(shù)據(jù)驅(qū)動也具備重要的研究意義。相比前面介紹的基于物理的模擬方法,數(shù)據(jù)驅(qū)動則是另外一種完全不同的思路。該方法不再將重點放在服裝的物理屬性上,而是對服裝形變信息進行量化,獲取量化數(shù)據(jù),對量化數(shù)據(jù)進行機器學習,得到服裝形變的預測模型,從而預測新的服裝形變信息。由于預測模型在進行預測時運算快速,因而在實現(xiàn)服裝模型的實時模擬中具有非常好的前景。

最早的數(shù)據(jù)驅(qū)動并不是應用在虛擬服裝中,而是驅(qū)動人體的局部變形。早期研究者提出骨骼子空間變形方法[10]( SSD ),該方法是將人體骨骼子空間作為低層次空間,將皮膚作為復雜的高層次空間,建立從高層次空間到低層次空間的映射關(guān)系,即建立人體皮膚到骨骼的映射模型,從而通過骨骼的變形得到皮膚附著骨骼后的變形。基于這種思想,Kim等人[11]提出以人體骨骼為低層次空間,服裝作為高層次空間,將服裝映射到骨骼空間的數(shù)據(jù)驅(qū)動模擬方法。

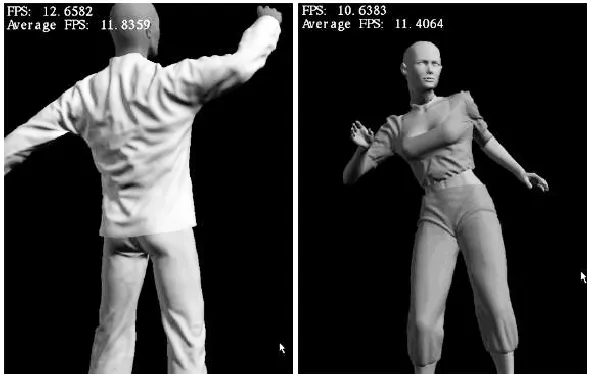

Wang[12]提出了一個基于實例的褶皺合成技術(shù),通過人體運動骨架驅(qū)動服裝產(chǎn)生褶皺,使用細網(wǎng)格和粗網(wǎng)格兩種不同分辨率模擬布料動態(tài)效果,在線模擬時使用粗網(wǎng)格表示,離線時添加彎曲、褶皺等細節(jié),從而提高模擬效率。這種方法只適用于貼近皮膚表面的衣服如褲子、T恤等,如圖3所示,對于寬松的衣服或斗篷這些持續(xù)性碰撞和細小褶皺的衣服來說,其模擬起來比傳統(tǒng)的物理模擬方法復雜。

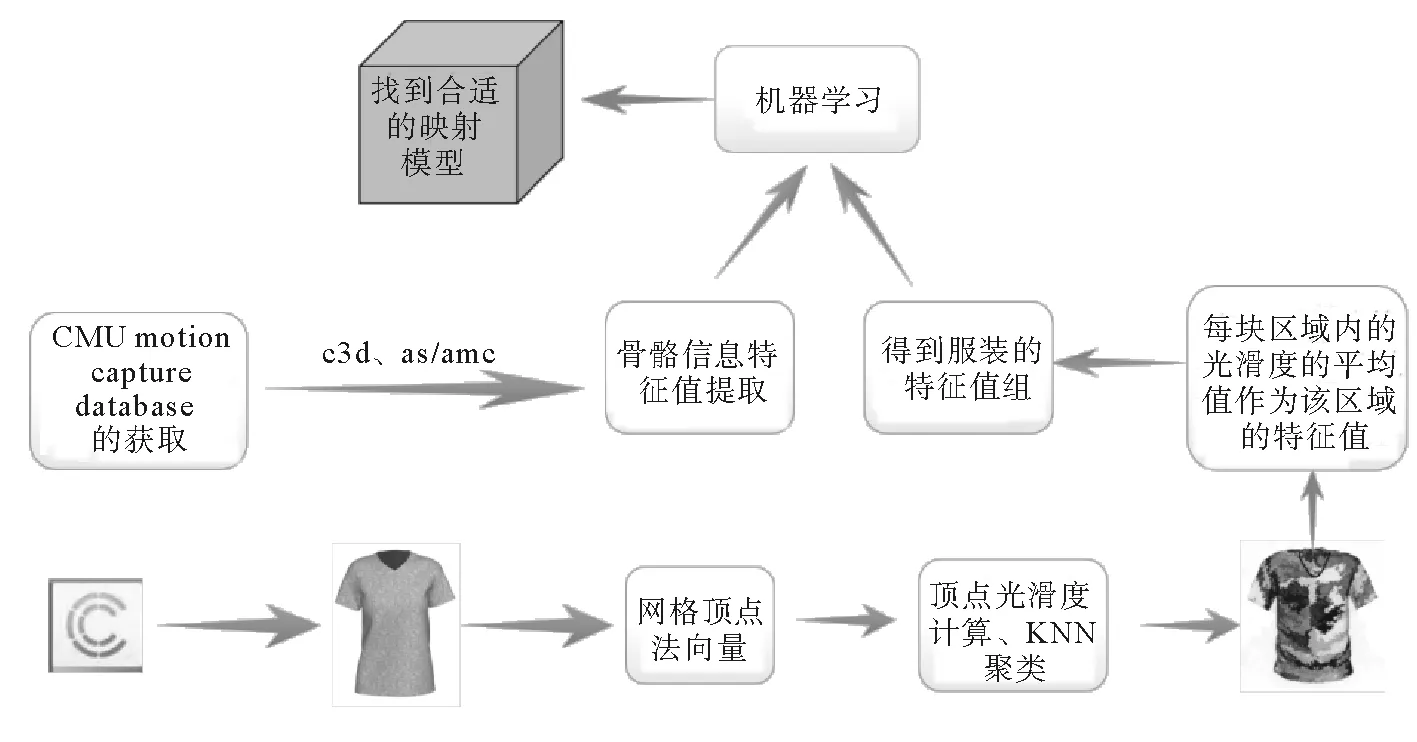

國內(nèi)對于數(shù)據(jù)驅(qū)動在三維虛擬服裝的模擬研究也有一定的進展。其中,華北電力大學控制與計算機工程學院[13]通過CLO 3D試衣軟件加載卡內(nèi)基梅隆大學motion capture database提供的人體骨骼運動信息獲得高精度網(wǎng)格劃分的服裝模型,用服裝網(wǎng)格頂點法向量的夾角表示頂點光滑度,并用KNN聚類算法將頂點光滑度在某一范圍內(nèi)的頂點劃分到同一塊區(qū)域。將每塊區(qū)域內(nèi)的各頂點光滑度的平均值視為該區(qū)域的特征值,從而得到整件服裝的特征值組作為機器學習的輸出值,以骨骼變形信息為機器學習中的輸入值。通過這種大量的訓練集數(shù)據(jù)進行多種算法模型的學習,最終得到誤差值最小的映射模型。研究流程如圖4所示。

圖3 人體骨架驅(qū)動服裝產(chǎn)生褶皺

圖4 人體骨骼形變驅(qū)動服裝形變研究流程

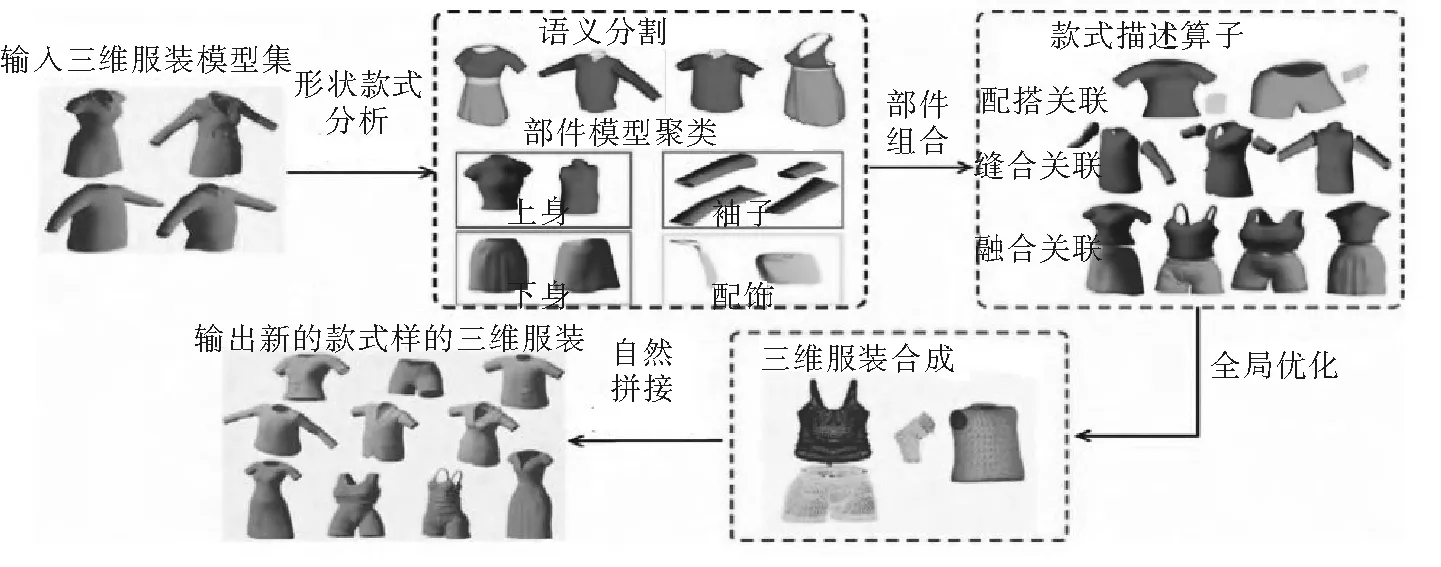

劉驪等人[14]提出了一種基于數(shù)據(jù)驅(qū)動的服裝模型快速生成的方法。該方法指出一組服裝模型之間具有比較明顯的幾何特征(如服裝模型都是由領(lǐng)子、袖子、衣身等組成的)。因此可首先對已有的服裝模型集進行形狀款式分析,通過語義分割算法將具有一致款式結(jié)構(gòu)的服裝分割出來。然后進行相同部件模型的聚類,建立三維服裝部件庫。接著給部件庫每個款式賦予描述其款式特征的標示屬性,建立款式描述算子,優(yōu)化匹配三維服裝部件的空間位置,最后通過自適應的服裝部件自然拼接算法實現(xiàn)服裝各部件的重新自然組合,得到新的服裝模型,方法流程圖如圖5所示。

圖5 基于數(shù)據(jù)驅(qū)動的服裝模型快速生成的方法流程圖

國內(nèi)對于三維服裝網(wǎng)絡虛擬展示的數(shù)據(jù)驅(qū)動模擬方法的研究較少見,主要應用領(lǐng)域是游戲角色和三維動畫,且研究中的實例數(shù)據(jù)庫大多來自于三維軟件建立的虛擬服裝模型,模型褶皺形態(tài)、數(shù)量等是否達到同一面料真實服裝的褶皺效果是沒有經(jīng)過驗證的。因此,有必要從真實服裝中獲取服裝形變信息作為實例數(shù)據(jù)庫。

4 結(jié)語

從1990年Miralab實驗室的第一個三維服裝虛擬展示案例至今,三維服裝虛擬展示技術(shù)已經(jīng)發(fā)展了將近30年,從最初的毫無褶皺的包裹人體到如今的真假難辨,虛擬服裝的發(fā)展速度驚人。在保證模擬效果的同時尋找更快速的模擬方法,甚至另辟蹊徑打破傳統(tǒng)的物理模擬方法,將數(shù)據(jù)驅(qū)動應用到虛擬服裝展示中是研究的熱點。相信在不斷地探索中,三維虛擬服裝展示技術(shù)會有更多突破。