自適應上下文感知相關濾波跟蹤

劉 波,許廷發(fā),李相民,史國凱,黃 博

(北京理工大學 光電學院 光電成像技術實驗室,北京 海淀 100081)

1 引 言

人工智能是計算機學科的一個分支,被稱為世界三大尖端技術之一[1-3],近年來,它飛速發(fā)展,在其他學科領域也獲得廣泛應用,并取得了豐碩的成果。人工智能主要是使計算機可以模擬人的某些思維過程和智能行為,如:思考、學習、推理等。作為人工智能領域的重要的基礎組成部分的計算機視覺也受到越來越多國內外研究者的重視。而基于視頻的目標跟蹤是計算機視覺領域的核心問題之一,也是當前最熱門的研究方向之一[4-5]。

近年來,相關濾波跟蹤算法由于其優(yōu)異的性能,受到廣大研究者的關注。2010年,Blome[6]等人提出了MOSSE(Minimum Output Sum of Squared Error Filter)算法,該算法首次將相關濾波引入目標跟蹤領域,并在計算目標和待測樣本集之間相關性時,運用了傅立葉變換,將運算直接轉到頻域中,大大降低了運算量。隨后,Henriques[7]等人在MOSSE的基礎上提出了采用循環(huán)矩陣結構和核空間映射的CSK(Exploiting the Crculant Structure of Tracking-by-detection with Kernels)方法。這種方法只需要在目標位置提取一次待測樣本,然后對該樣本進行循環(huán)偏移,構成循壞矩陣,即樣本集。但其只用到了較為簡單的灰度特征。 Danelljan[8]等人提出了基于顏色屬性的相關濾波跟蹤(CN),該方法是在CSK 的基礎上將灰度特征改為了顏色屬性。2014年,Henriques[7]等人在CSK的基礎上引入了核方法,并采用了HOG(Histogram of Oriented Gradients)多維特征對目標外觀進行描述(KCF)。雖然基于核相關濾波改進的相關濾波目標跟蹤算法很多,但對于背景感知這方面的相關濾波目標跟蹤算法卻相對較少。Kiani[10]等人提出了BACF(Learning Background-Aware Correlation Filters for Visual Tracking)目標跟蹤算法。是在核相關濾波框架上,擴大了循壞采樣的區(qū)域(整幅圖片),這樣就增加了樣本的數(shù)量,并且在每個樣本上裁剪出有用區(qū)域。較之前KCF的循環(huán)采樣方法,樣本的信息更加多樣化,訓練出來的濾波器也更加穩(wěn)定。Mueller[11]等人在2017年的CVPR(Conference on Computer Vision and Pattern Recongnition)上提出了一種新的相關濾波框架,即聯(lián)合全局上下文進行背景訓練的CA-CF(Context-Aware Correlation Filter Tracking)算法。該算法既能夠合理增加更多信息,又沒帶來其他較大負面的影響,在速度上的影響也比較小。此外其跟蹤魯棒性和準確性也有所提高。該算法在目標外觀表示上增加了背景約束信息,即在目標位置的上下左右方向各取了一塊背景區(qū)域,加到跟蹤濾波器中,對它們進行背景監(jiān)督訓練,使得目標跟蹤更加魯棒。此框架也適合其他相關濾波算法,事實證明,加了背景約束的其他算法,如:DCF[9]、SAMF[12]、STPALE[13],在精準度和成功率上,都有了一定的提高,尤其是STAPLE[13]算法提升的最為明顯。

目前,在目標跟蹤系統(tǒng)中,除了目標外觀表示的特征選擇問題和模型更新問題之外。還需應對跟蹤過程中的各種干擾因素。如:目標遮擋、尺度變化、光照變化、運動模糊、形變及背景雜亂等。因此,在這么多的因素干擾下,設計一個魯棒的目標跟蹤算法仍然是當今跟蹤領域的難點問題[1]。

針對這一問題,本文提出了一種基于卡爾曼濾波的自適應上下文感知相關濾波跟蹤算法。該方法利用卡爾曼濾波對目標做運動估計,預測目標的運動方向,并提取目標運動方向上的背景區(qū)域樣本學習到濾波器中,同時,為了應對目標形變,提取其他非目標運動方向上的背景樣本也學習到濾波器中,其中,分配給運動方向上的背景樣本訓練權重高于其他方向上的權重。從而提高了跟蹤器對目標及背景的辨別性。為了解決目標遮擋問題,引入了一種新的遮擋判據APCE(Average Peak-to Correlation Energy),只有當前的響應峰值和APCE數(shù)值同時大于各自的歷史均值時,才對目標模型進行更新,從而防止目標被遮擋后,濾波器被污染,使得跟蹤器無法再檢測到目標,有效解決了目標遮擋的問題。

2 相關濾波跟蹤算法原理

2.1 線性回歸

設有訓練樣本集(xi,yi),則線性回歸函數(shù)可以表示為f(xi)=wTxi,w是權重系數(shù),嶺回歸函數(shù)可以表示為:

(1)

對式(1)求導,并令其導數(shù)為0,求解得:

w=(XTX+λI)-1XTy,

(2)

其中,X、y分別是樣本矩陣和標簽矩陣,I表示一個單位矩陣,λ對應著正則化系數(shù),是個常數(shù)。由于在后面的變換中會用到傅立葉變換,所以將式(2)轉換到復數(shù)域下,其解析解為:

w=(X*X+λI)-1X*Y,

(3)

其中,X*=(XH)T,XH是X的復共軛。

2.2 循環(huán)矩陣

相關濾波算法中,只需要對目標基礎樣本進行一次采樣,其他樣本都是由基礎樣本循環(huán)偏移產生的虛擬樣本(如圖1所示),這樣可以大大提高算法的運算速度。

圖1 循環(huán)采樣Fig.1 Cyclic sampling

假設一個向量n=[n1,n2,…,nm],那么由該向量循環(huán)偏移后的m×m的循環(huán)矩陣C(n)表示為:

(4)

循環(huán)矩陣經傅立葉變換可相似對角化,故可以將樣本循環(huán)矩陣N進行如下轉換:

(5)

用循環(huán)矩陣的特性來化簡公式(3)得:

(6)

2.3 非線性嶺回歸

非線性嶺回歸較線性嶺回歸,在變量上有所變化,且非線性方程f(z)的求解方程會隨著樣本數(shù)量的增加而變得越來越復雜。為了克服這一缺點,引入了內核方法,使用內核方法,即采用將線性問題映射到非線性特征空間的映射函數(shù)φ(x),可以將相關濾波器用樣本的線性組合來表示:

(7)

由核函數(shù)的特點知,將低維空間線性不可分的樣本通過映射函數(shù)φ(x)轉換到高維空間后將變得線性可分。可將公式(7)代入式(1)式中,求得α的閉環(huán)解的表達式為:

α=(K+λI)-1y,

(8)

其中,K是核矩陣,且是個循環(huán)矩陣。根據循環(huán)矩陣經傅立葉變換可相似對角化這一特性,把式(8)轉化為:

(9)

2.4 上下文感知濾波器

Mueller[11]等人在2017年的CVPR會議上提出了一種新的相關濾波的框架CA-CF。與傳統(tǒng)的CF算法相比,CA-CF將目標框的上下左右4塊背景信息也加到了相關濾波器中去學習,從而提高了跟蹤器對目標及背景的辨別性,可將式(1)改為:

(10)

從式(10)可以看出,它對所有的上下文背景樣本集都加了約束,并使他們回歸到零。對式(10)求解為:

(11)

3 改進的上下文感知相關濾波跟蹤

3.1 自適應上下文感知相關濾波跟蹤方法

本文提出的自適應上下文感知相關濾波跟蹤是基于卡爾曼濾波對目標做運動估計。

將需要估計的元素用列向量表示:

e=[x,y,vx,vy]T,

(12)

其中,x,y表示目標的中心坐標,vx,vy表示目標平面內水平速度和垂直速度,兩初始值都是0。下一幀的預測位置為:

ek=Aek-1+G(σ) ,

(13)

其中,G(σ)是高斯白噪聲,A是狀態(tài)轉移矩陣,其為:

(14)

結合式(13)運用卡爾曼濾波的其余4個迭代公式對其做狀態(tài)估計,公式為:

(15)

其中,觀測矩陣H、以及矩陣Q矩陣R的初始矩陣為:

(16)

由于只從估計的變量元素中取運動矢量,并不估計目標的位置,故目標的定位仍為響應峰值對應的圖像位置。

V=[vx,vy]T,

(17)

當速度不為0時,單位矢量為:

V=[vx/abs(vx),vy/abs(vy)]T.

(18)

由于時空一致性,將目標運動方向上的背景信息作為先驗信息,賦予其較其他背景區(qū)域塊多的權重,加到濾波器學習中,有利于提高跟蹤器對目標及背景樣本的辨別性。由此可將式(10)轉化為:

(19)

對其求解為:

(20)

其中,Aj(j∈[1,k])為上下文背景信息運動方向上的背景樣本。在目標跟蹤過程中,是一個自適應項。k表示所取背景區(qū)域的數(shù)量,在本文中,圍繞目標的上下左右選取了4塊背景區(qū)域樣本。

3.2 模板更新策略

本文引入了Wang等人在文獻[14]提出的遮擋判據APCE:

(21)

其中,F(xiàn)max、Fmin、Fw,h分別表示響應圖中的峰值,谷值以及位置(w,h)對應的響應值。這個APCE判據可以反映出響應圖的振蕩程度,當APCE突然減少時,就是出現(xiàn)了目標被遮擋或者目標丟失的情況。只有當響應值峰值和APCE同時都一定比例γ1,γ2大于它們各自的歷史均值時,才認為此時刻的跟蹤結果是準確的,并對模型進行更新,反之,只要其中有一個低于歷史均值,就不更新目標模型。這樣既可以減少模型漂移的情況,也可以減少模型的更新次數(shù),達到了加速的效果,從而可以有效解決目標遮擋的問題。

4 實驗與結果分析

為了驗證本文算法的可行性,本文將本算法與當前主流的跟蹤算法在CVPR2013 Benchmark[15]中進行對比實驗。

4.1 實驗環(huán)境配置

本文的仿真實驗都是基于MATLAB R2016a平臺進行的,使用的臺式電腦配置為:intel(R)core(TM)i5-4590 CPU@3.30GHz處理器、8G系統(tǒng)內存以及64位的Windows10專業(yè)版系統(tǒng)。本論文仿真實驗選取的視頻集為CVPR2013數(shù)據集的全部的50個視頻序列(實際是51個視頻序列),同時為了更加直觀地對本文提出算法的整體性能進行評估,還將本文算法與當前多個主流目標跟蹤算法做了大量的對比仿真實驗。選取的主流算法為:CSK[7]、DCF_CA[11]、DCF[9]、Struck[16]、MOSSE_CA[11]、TLD[17]、VTD[18]、CXT[19]、OAB[20]等9個目標跟蹤算法。本文算法的參數(shù)如下:正則化系數(shù)λ1=10-4,λ2=25,λ3=5,學習率η=0.015,搜索框padding=2,γ1=0.5,γ2=0.35。

4.2 跟蹤算法評價指標

(1)中心位置誤差

中心位置誤差就是指計算每一幀中跟蹤目標的中心位置與手工標記的真值之間的歐氏距離,也可以叫精準率。通過歐式距離的大小評估跟蹤的精確度。那么精準率可以表示為:

(22)

(2)成功率

成功率是在重疊率的基礎上提出的新的評價標準,其反映了目標丟失后在后續(xù)跟蹤過程中還可以重新檢測到目標的真實性能。它是通過統(tǒng)計所有視頻序列中重疊度超過一定閾值tθ的幀數(shù)Hx獲得的,成功率的表達式為:

(23)

其中,N表示視頻序列的總幀數(shù)。在Benchmark中設定的閾值為0.5。

4.3 對比實驗

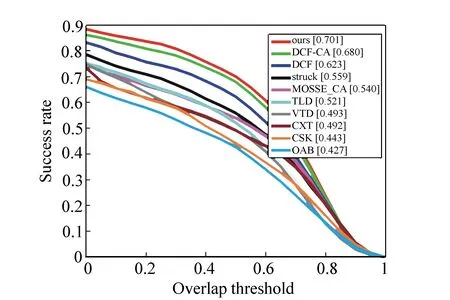

本文算法與當前主流算法在CVPR 2013Benchmark進行對比實驗,得到實驗結果如圖2、圖3所示,圖2為精準率圖,圖3為成功率圖。

圖2 精準率圖Fig.2 Precision rate map

由圖2可知,本文提出算法的得分為0.810,排名第一位,比排名第二名的DCF_CA(得分為0.784)高出了0.026,同時比基準算法DCF(得分為0.740)高出了0.070。如圖3所示,本文算法在成功率上也是排名第一,得分為0.701,比第二名的DCF_CA(得分為0.680)高出了0.021,比基準算法DCF(得分為0.623)高出了0.078。

圖3 成功率圖Fig.3 Success rate map

圖4(彩圖見期刊電子版)顯示了遮擋情況下的對比實驗結果,從圖中可以看出,本文提出的算法在目標被遮擋的情況下,仍可以很好地跟蹤目標。表明了本文算法在目標遮擋的情況下進行跟蹤的可行性。

圖4 不同算法有遮擋情況的對比實驗Fig.4 Contrast experiment of different algorithms under occlusion

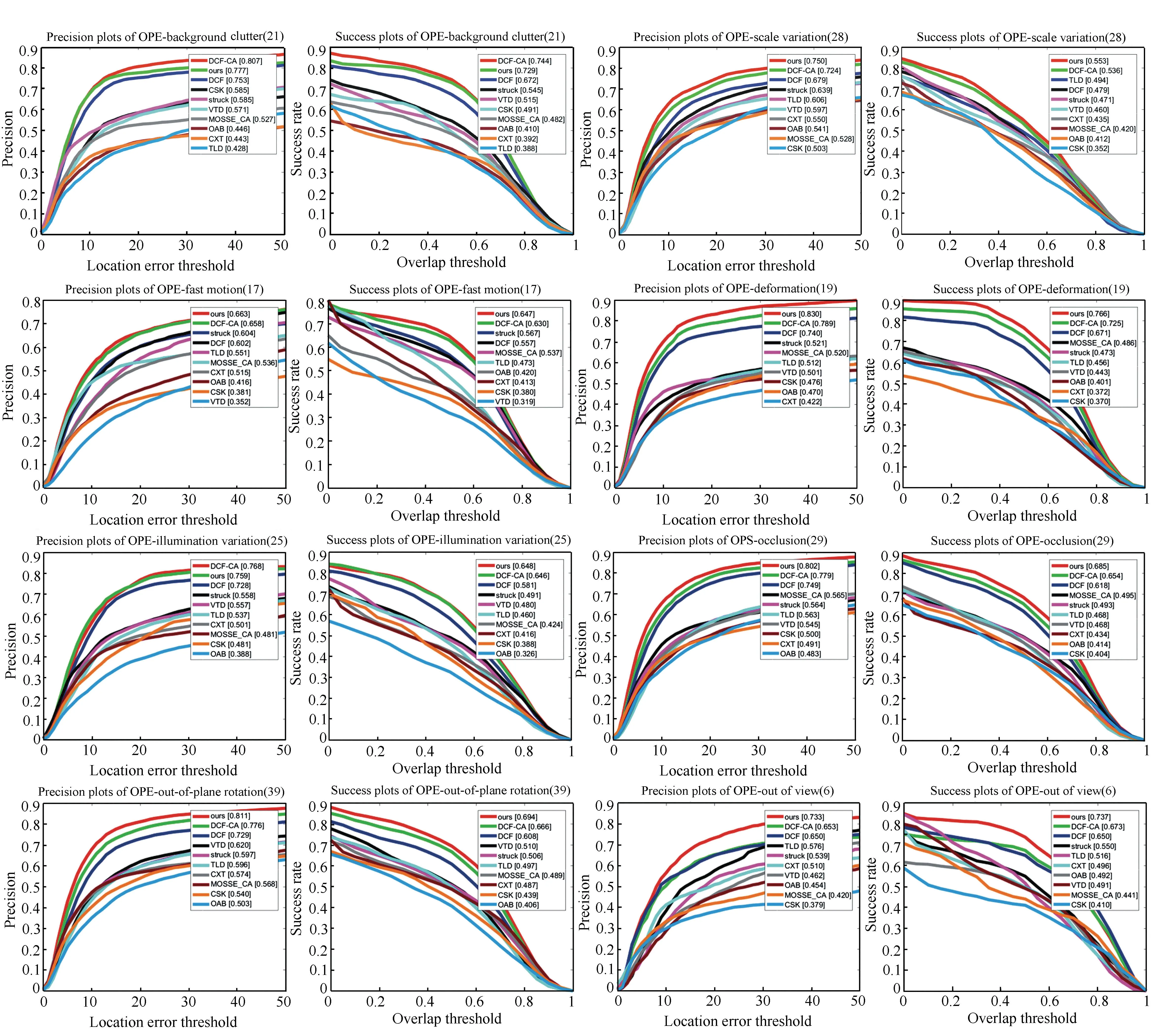

圖5為算法在其他屬性視頻的跟蹤性能,從圖中可以看出,本文提出的算法性能總體優(yōu)于其他對比算法,充分體驗了本文提出算法的魯棒性。達到了預期設計效果。

圖5 其他屬性下對比實驗Fig.5 Comparative experiments under other attributes

5 結 論

本文提出了一種自適應上下文感知相關濾波跟蹤方法。通過利用卡爾曼濾波器對目標進行運動估計,預測目標的運動方向。在濾波器訓練時,對目標運動方向上的背景樣本訓練時賦予較多的權重,同時為了解決遮擋的問題,在模型更新時引入了一個新的遮擋判定指標APCE,只有當響應峰值和APCE數(shù)值分別以一定比例大于各自的歷史均值時,才對目標模型進行更新。將本文算法與當前一些主流的跟蹤算法在CVPR 2013 Benchmark進行對比實驗。仿真實驗結果表明,本文提出的算法,精準率和成功率分別為0.810和0.701,均優(yōu)于其他對比算法,充分體現(xiàn)出了本文算法的魯棒性。