基于精調(diào)的膨脹編組-交叉CNN的PolSAR地物分類

肖東凌 劉 暢

(中國(guó)科學(xué)院電子學(xué)研究所 北京 100190)

(中國(guó)科學(xué)院大學(xué) 北京 100049)

1 引言

極化合成孔徑雷達(dá)(Polarimetric Synthetic Aperture Radar, PolSAR)憑借全天時(shí)、全天候和高分辨率成像的能力以及豐富的地物目標(biāo)散射信息和通道相位信息,被廣泛運(yùn)用于地物分類、目標(biāo)檢測(cè)和相干變化檢測(cè)等領(lǐng)域。在地物分類研究中,表面平滑的地物紋理特征區(qū)分度不高,而PolSAR豐富的通道相位信息則能有效地區(qū)分紋理差異不大的地物,因此PolSAR數(shù)據(jù)在該領(lǐng)域受到了極大的關(guān)注。

傳統(tǒng)的PolSAR圖像處理算法按照特征提取、訓(xùn)練分類器兩個(gè)基本步驟獨(dú)立展開[1-4],特征和分類器之間的交互較弱,模型連貫性較差。相較于傳統(tǒng)的圖像算法,卷積神經(jīng)網(wǎng)絡(luò)(Convolution Neural Network, CNN)能根據(jù)具體的任務(wù)來自適應(yīng)地捕獲特征,并聯(lián)合特征網(wǎng)絡(luò)訓(xùn)練分類器,具有更好的靈活性和連貫性,因此能夠得到更加準(zhǔn)確的分類結(jié)果。目前,CNN已被廣泛運(yùn)用到PolSAR圖像處理領(lǐng)域,例如Zhang等人[5]用復(fù)元素CNN來實(shí)現(xiàn)PolSAR地物分類;Xu等人[6]利用CNN實(shí)現(xiàn)PolSAR圖像相干變化的檢測(cè);Bi等人[7]用基于圖的CNN以及Chen等人[8,9]采用極化特征驅(qū)動(dòng)的CNN算法實(shí)現(xiàn)精確的PolSAR地物分類。

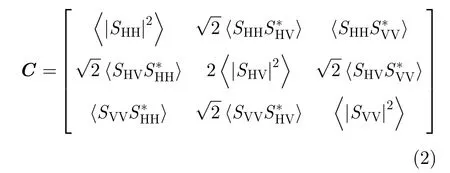

在基于PolSAR數(shù)據(jù)的地物分類研究中,深度分類網(wǎng)絡(luò)的訓(xùn)練數(shù)據(jù)一般是后向散射矩陣S以及由S變換得到的協(xié)方差矩陣C和相干矩陣T[10-13],而非實(shí)數(shù)CNN模型輸入的3通道RGB圖像。C矩陣和T矩陣的非對(duì)角元素都是復(fù)數(shù),且S,C和T矩陣都包含能有效區(qū)分不同地物的通道相位信息。其中PolSAR的后向散射矩陣S如式(1)所示。

其中,SHH和SVV項(xiàng)包含同極化通道回波功率,而SHV和SVH項(xiàng)則包含交叉極化通道回波功率。協(xié)方差矩陣C矩陣的表示見式(2)。式中為時(shí)間或空間集合平均。

為了充分利用PolSAR豐富的通道相位信息,Zhang等人[5]將CNN網(wǎng)絡(luò)底層實(shí)現(xiàn)中的變量修改為復(fù)數(shù);然而該算法在實(shí)現(xiàn)上較為繁瑣,并且模型的遷移推廣性不強(qiáng),如推廣到膨脹卷積神經(jīng)網(wǎng)絡(luò)(Dilated CNN)[14]、全卷積神經(jīng)網(wǎng)絡(luò)(FCN)[15]等復(fù)雜的CNN模型。因此本文基于一種編組-交叉卷積神經(jīng)網(wǎng)絡(luò)(Group-Cross CNN, GC-CNN)來模擬復(fù)數(shù)乘法運(yùn)算并支持復(fù)數(shù)信號(hào)的輸入和傳遞。該結(jié)構(gòu)實(shí)質(zhì)上是兩組并行的交叉且交互的實(shí)數(shù)CNN網(wǎng)絡(luò),因此更容易實(shí)現(xiàn)和遷移推廣到復(fù)雜的網(wǎng)絡(luò)中。

在算法效率方面,逐像素點(diǎn)(pixel-by-pixel)分類的算法[5-9]在提取相鄰像素特征時(shí)存在大量的重復(fù)運(yùn)算,因此分類較大尺寸圖像的時(shí)間開銷很大。而像素到像素(pixel-to-pixel)映射的算法[14,15],如FCN和Dilated CNN則能有效地剔除冗余計(jì)算,實(shí)現(xiàn)端到端的高效預(yù)測(cè)。其中基于FCN的算法[15-17]由于在解碼網(wǎng)絡(luò)上采樣的過程中丟失了大量的邊緣細(xì)節(jié)信息,導(dǎo)致分類結(jié)果邊緣粗糙;而基于Dilated CNN的算法[14]通過帶孔洞的卷積核實(shí)現(xiàn)尺寸不變的輸出特征圖,這樣既能實(shí)現(xiàn)快速的端到端分類又能保持目標(biāo)的細(xì)節(jié)信息,因此本文采用基于Dilated CNN的膨脹編組-交叉卷積網(wǎng)絡(luò)(Dilated Group-Cross CNN, DGC-CNN)來提升分類效率。

在DGC-CNN的訓(xùn)練中,需要和輸入圖像尺寸相同的標(biāo)注圖,這對(duì)于PolSAR圖像來說是困難的,因?yàn)閹?biāo)注的PolSAR圖像較少,且大部分帶標(biāo)注的PolSAR數(shù)據(jù)都存在未標(biāo)注的區(qū)域。因此,本文用總采樣率小于1.5%的標(biāo)注像素預(yù)訓(xùn)練GC-CNN,并將其參數(shù)直接遷移到匹配的DGC-CNN中來實(shí)現(xiàn)效率提升。考慮到參數(shù)的直接遷移會(huì)導(dǎo)致DGC-CNN分類精度的損耗,本文沿用訓(xùn)練GC-CNN時(shí)的訓(xùn)練像素對(duì)遷移后的DGC-CNN進(jìn)行精調(diào),來捕獲更多空間上下文語義特征,恢復(fù)并進(jìn)一步提升GC-CNN模型的分類精度,文中稱該算法為精調(diào)的膨脹編組-交叉卷積神經(jīng)網(wǎng)絡(luò)(Fine-tuned Dilated Group-Cross CNN, FDGC-CNN)。

綜上,本文的結(jié)構(gòu)安排如下:第2節(jié)介紹卷積和編組-交叉卷積單元;第3節(jié)詳細(xì)介紹編組-交叉卷積神經(jīng)網(wǎng)絡(luò)(GC-CNN)和精調(diào)的膨脹編組-交叉卷積網(wǎng)絡(luò)(FDGC-CNN);第4節(jié)為實(shí)驗(yàn)部分,基于AIRSAR平臺(tái)的16類規(guī)則地物數(shù)據(jù)和E-SAR平臺(tái)4類不規(guī)則地物數(shù)據(jù),驗(yàn)證了本文采用的網(wǎng)絡(luò)和算法的準(zhǔn)確性和高效性。

2 編組-交叉卷積單元

2.1 CNN原理

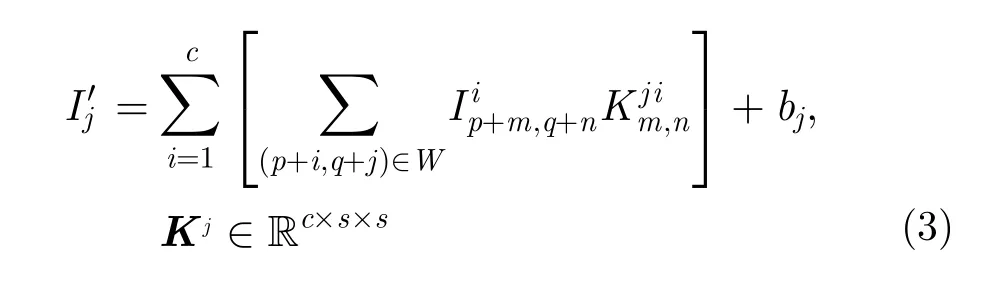

CNN啟發(fā)于視覺成像原理的研究,它通過使用不同的卷積核來模擬可視皮層細(xì)胞對(duì)邊緣和方向的感知,隨后連接非線性激活函數(shù)得到圖像一系列復(fù)雜的特征表達(dá)[18]。CNN模型包含卷積層、池化層和激活層,其中卷積層由多組卷積核組成;第j組卷積核的輸出的數(shù)學(xué)表達(dá)式如下

其中,c和s分別為輸入圖像通道數(shù)和卷積核窗口尺寸;表示輸入圖像的第i通道、坐標(biāo)為(m,n)的值;表示第j組卷積核Kj的第i個(gè)通道、坐標(biāo)為(m,n)的值;bj為第j組卷積核的偏置項(xiàng);W為卷積在圖像上滑動(dòng)的區(qū)域,(p,q)為滑動(dòng)窗口的左上角坐標(biāo);之后將輸入激活層進(jìn)行非線性表示,增加特征的非線性可分性,常見的激活函數(shù)有Sigmoid,tanh和ReLU[19]以及其它相關(guān)變種如CReLU[20],PReLU[21]等;最后,池化層對(duì)激活后的輸出進(jìn)行降采樣,增加了每個(gè)像素的感受野,使空間形狀灰度特征匯聚到更抽象的特征空間,并且減少了下一層卷積的計(jì)算量。

在多層CNN模型中,淺層卷積捕獲局部的邊緣、角點(diǎn)特征,深層卷積捕獲更抽象且強(qiáng)語義的高維特征。常見的多層CNN特征模型如VGG[22],GoogLeNet[23], ResNet[24], DenseNet[25]等已用于目標(biāo)檢測(cè)、分類和分割等諸多研究領(lǐng)域。

2.2 編組-交叉卷積原理

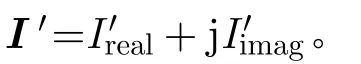

PolSAR通道之間的相位信息反映散射地物的回波時(shí)延,攜帶著地物的空間結(jié)構(gòu)信息,對(duì)提升地物分類精度起著重要的作用。為了不丟失PolSAR的通道相位信息,本文采用編組-交叉卷積神經(jīng)網(wǎng)絡(luò)(GC-CNN)來實(shí)現(xiàn)復(fù)數(shù)信號(hào)的輸入、傳輸和輸出。該網(wǎng)絡(luò)將輸入信號(hào)的實(shí)部通道和虛部通道編組,并分別輸入兩組并行且交叉交互的實(shí)數(shù)CNN網(wǎng)絡(luò),將實(shí)數(shù)模型推廣到復(fù)數(shù)域,GC-CNN結(jié)構(gòu)如圖1所示。

復(fù)數(shù)域下的輸入圖像I由實(shí)部和虛部組成,因此本文將其編組為兩組相同通道數(shù)的實(shí)數(shù)圖像組,分別表示實(shí)部和虛部。設(shè)復(fù)數(shù)輸入圖像I的表達(dá)式如下

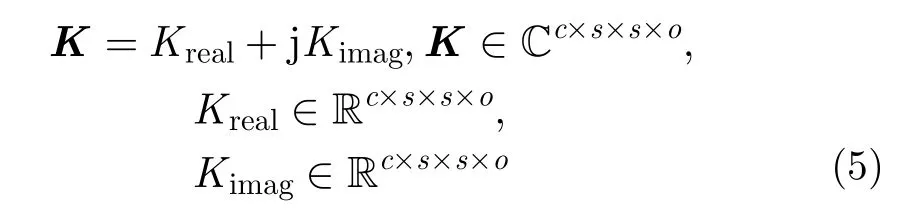

其中,c為I的通道數(shù),Ireal和Iimag分別表示實(shí)部和虛部的圖像組。同樣,編組-交叉卷積核也被劃分為兩組實(shí)數(shù)信號(hào),分別表示實(shí)部和虛部;窗口尺寸為s×s的編組-交叉卷積層如式(5)所示。

其中,c,o分別是卷積層的輸入和輸出維度,Kreal,Kimag分別是實(shí)部卷積核和虛部卷積核。

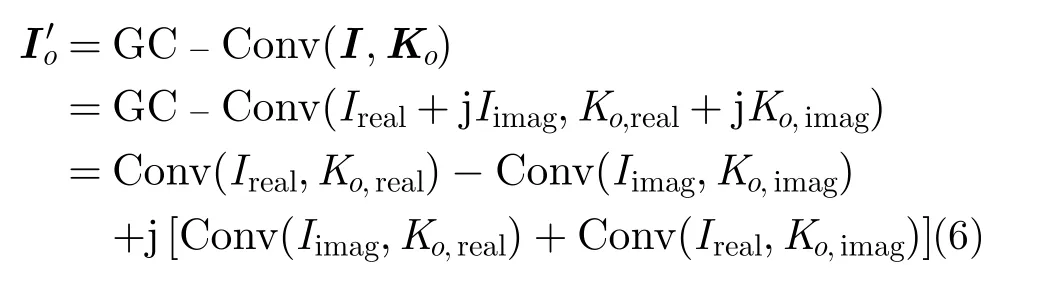

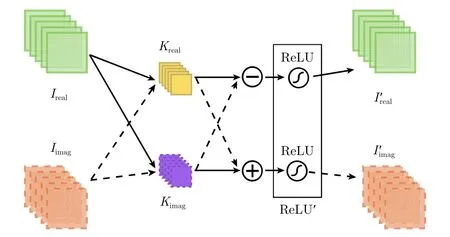

實(shí)數(shù)卷積運(yùn)算實(shí)質(zhì)上是多組3維卷積核和圖像的內(nèi)積,本文記該運(yùn)算為Conv(?);同時(shí)編組-交叉卷積GC-Conv(?)是2組實(shí)數(shù)卷積的交叉結(jié)合。第o組編組-交叉的輸出Io′可表示為

圖1 編組-交叉卷積神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)示意圖Fig. 1 Structure of group-cross convolution neural network

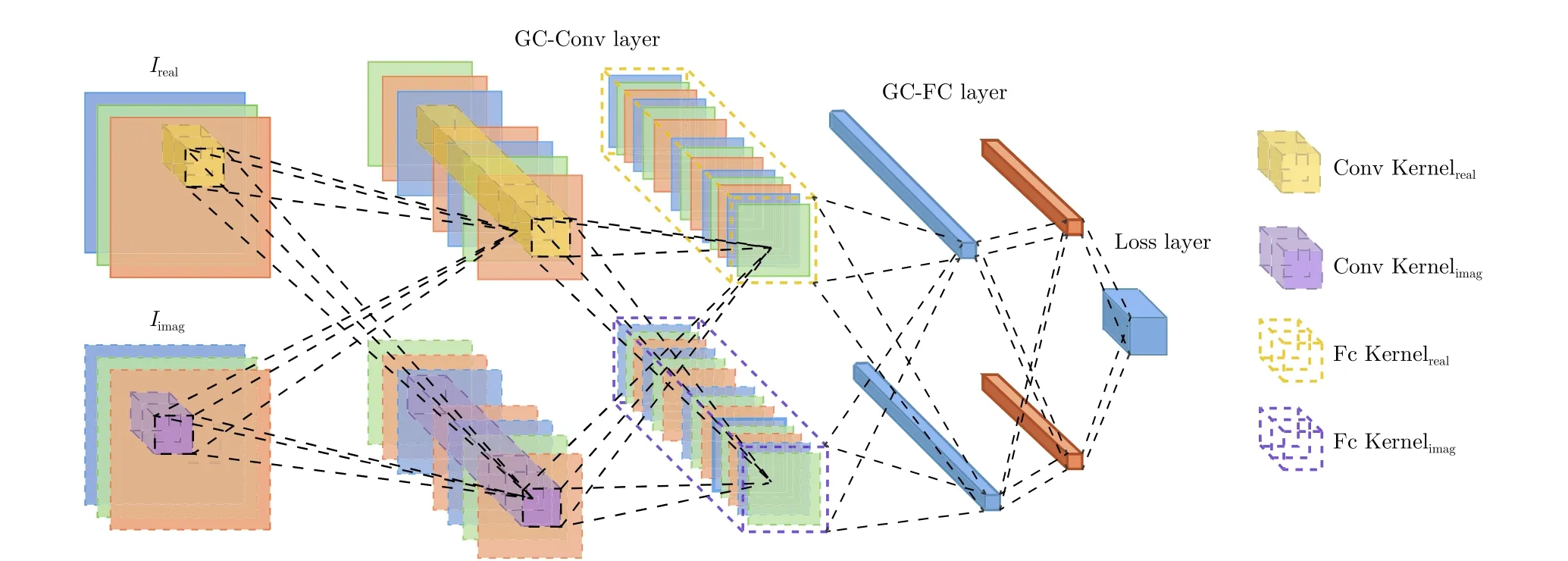

值得注意的是,ReLU激活函數(shù)也應(yīng)推廣到復(fù)數(shù)域,記作ReLU′(見圖2)。具體形式如下所示。

圖2 編組-交叉卷積層結(jié)構(gòu)示意圖Fig. 2 Structure of group-cross convolution layer

3 精調(diào)的膨脹編組-交叉卷積神經(jīng)網(wǎng)絡(luò)

本節(jié)將詳細(xì)地介紹編組-交叉卷積神經(jīng)網(wǎng)絡(luò)(GC-CNN)和精調(diào)的膨脹編組-交叉卷積神經(jīng)網(wǎng)絡(luò)(DGC-CNN)。

3.1 編組-交叉卷積神經(jīng)網(wǎng)絡(luò)

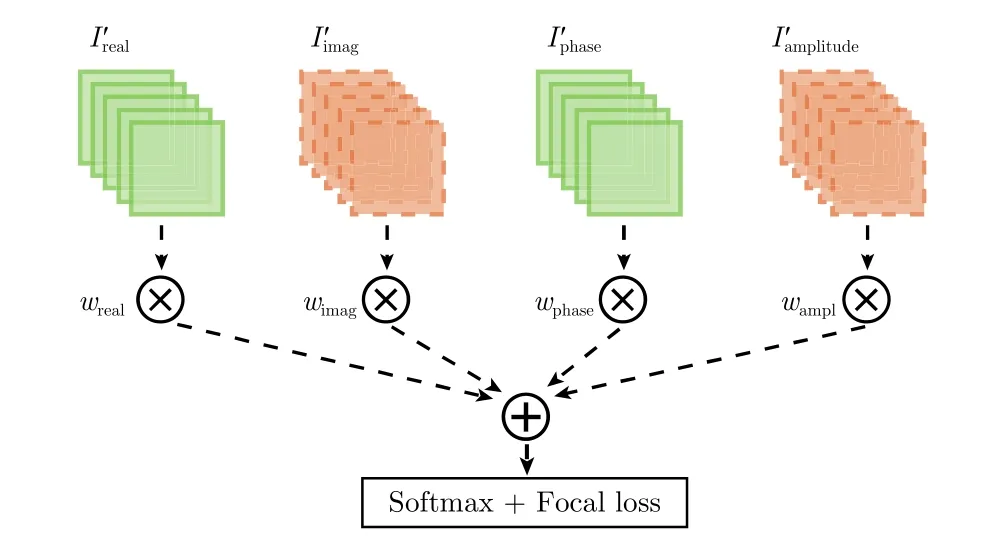

算法首先以低采樣率(<2%)在PolSAR圖像中隨機(jī)采樣,并取10×10的像素窗作為中心像素的特征區(qū)域,輸入3層的GC-CNN。GC-CNN的參數(shù)集中在全連接層,在訓(xùn)練樣本不足的情況下,模型容易過擬合,因此,采用dropout和L2正則來泛化模型。為了使該網(wǎng)絡(luò)參數(shù)能夠很好地遷移到下一節(jié)介紹的DGC-CNN中,采用無邊緣填充(Padding)的卷積方式進(jìn)行特征提取,從而使得在每層3×3卷積層后,輸入圖像尺寸都將減少2個(gè)像素,如圖3(a1)所示。因此,10×10的特征像素窗通過2層3×3編組-交叉卷積層后,可以得到尺寸為1×1的復(fù)數(shù)特征圖。最后將復(fù)數(shù)特征圖輸入1×1編組-交叉卷積層以提取高維復(fù)數(shù)特征向量,用于中心像素點(diǎn)的分類。GC-CNN的具體結(jié)構(gòu)如圖3(b)所示。為將復(fù)數(shù)特征圖轉(zhuǎn)換為實(shí)數(shù)的分類結(jié)果,模型采用圖4所示的結(jié)構(gòu)將復(fù)數(shù)特征圖及其相位和幅度轉(zhuǎn)換為實(shí)數(shù)輸出。

該結(jié)構(gòu)將復(fù)數(shù)輸出特征圖的實(shí)部和虛部及其對(duì)應(yīng)的幅度和相位在通道上拼接,并輸入4×1的全連接層來獲得各類別的分類概率。最后計(jì)算分類損失,更新GC-CNN參數(shù)。

其中,I表示當(dāng)前樣本的真實(shí)標(biāo)注,pI(I′)為輸出類別I的預(yù)測(cè)概率。

3.2 精調(diào)的膨脹編組-交叉卷積神經(jīng)網(wǎng)絡(luò)

GC-CNN在提取相鄰像素特征時(shí)存在大量的冗余計(jì)算,且分類效率較低。為了提升GC-CNN的分類速度,本文將GC-CNN的參數(shù)遷移到相同參數(shù)規(guī)模的膨脹編組-交叉卷積網(wǎng)絡(luò)(DGC-CNN)中,如圖3(c)所示,實(shí)現(xiàn)輸入輸出像素的直映射,從而大幅度減少冗余計(jì)算,提升分類效率。

圖3 膨脹編組-交叉卷積神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)示意圖Fig. 3 Structure of Dilate Group-Cross CNN (DGC-CNN)

圖4 GC-CNN模型損失計(jì)算結(jié)構(gòu)Fig. 4 Loss calculation of GC-CNN

在GC-CNN中,為了捕獲上下文語義特征,需要將輸入圖像進(jìn)行池化降采樣,使特征圖中每個(gè)像素點(diǎn)都具有比降采樣前大4倍的上下文感受野和更強(qiáng)的空間語義表達(dá)能力,但與此同時(shí)圖像局部的邊緣細(xì)節(jié)信息丟失嚴(yán)重。膨脹卷積可以解決這一問題,它通過對(duì)普通卷積窗進(jìn)行空洞填充(hole padding),使卷積輸出的特征圖能在尺寸不變的情況下和普通卷積池化后的特征圖具備相同的感受野,即稠密的的特征圖(dense map),如圖3(a2)所示。因此本文將GC-CNN的第2層卷積參數(shù)遷移到孔洞維度為1的DGC-CNN中。為了和GC-CNN中的池化層對(duì)應(yīng),DGC-CNN中的池化核步長(zhǎng)和邊緣填充尺寸設(shè)置為1個(gè)像素,且第2層池化核的空洞維度為1,從而實(shí)現(xiàn)如圖3(c)所示的端到端的映射分類。圖3(b)、圖3(c)中紅色虛線為GC-CNN的第1,2層卷積核參數(shù)遷移至DGC-CNN對(duì)應(yīng)位置的示意圖。

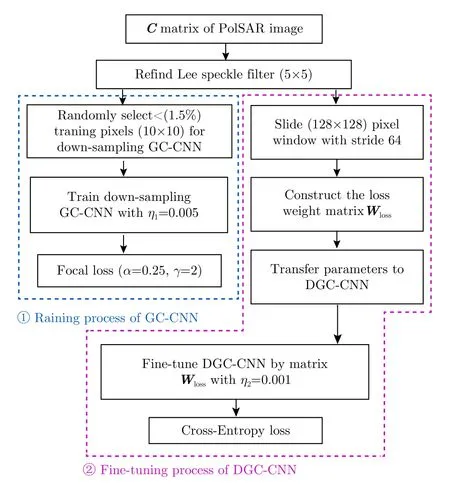

由于DGC-CNN模型直接由GC-CNN參數(shù)遷移激活,分類精度上較GC-CNN會(huì)有所降低。因此,本文使用精調(diào)的膨脹交叉卷積神經(jīng)網(wǎng)絡(luò)(FDGC-CNN)來捕獲更多上下文語義特征,進(jìn)一步提升分類精度,其中精調(diào)算法流程圖如圖5所示。FDGC-CNN和全卷積神經(jīng)網(wǎng)絡(luò)FCN相同,在訓(xùn)練中都需要和輸入圖像尺寸一致的先驗(yàn)標(biāo)注圖,這對(duì)于先驗(yàn)標(biāo)注較為稀缺的PolSAR數(shù)據(jù)來說是不可行的。為解決這一問題,本文沿用預(yù)訓(xùn)練GC-CNN時(shí)采樣的像素點(diǎn)來實(shí)現(xiàn)FDGC-CNN的訓(xùn)練。在FDGC-CNN的訓(xùn)練過程中,只計(jì)算訓(xùn)練圖像塊中采樣像素點(diǎn)的損失,并用于微調(diào)網(wǎng)絡(luò)參數(shù)。具體的精調(diào)訓(xùn)練步驟為:用128×128的滑窗在輸入復(fù)數(shù)圖像上以步長(zhǎng)為64進(jìn)行滑動(dòng)采樣,作為DGC-CNN的輸入數(shù)據(jù);之后在訓(xùn)練過程中生成損失權(quán)重矩陣Wloss,用于剔除圖像塊中非采樣像素點(diǎn)的損失,其中Wloss矩陣的采樣像素點(diǎn)權(quán)重為1,其余像素點(diǎn)權(quán)重為0;最后將Wloss和訓(xùn)練預(yù)測(cè)結(jié)果加權(quán),得到采樣像素點(diǎn)的平均分類損失,并精調(diào)網(wǎng)絡(luò)參數(shù)。

圖5 DGC-CNN 精調(diào)流程圖Fig. 5 Flowchart of DGC-CNN fine-tuning process

4 實(shí)驗(yàn)結(jié)果和分析

為了驗(yàn)證FDGC-CNN模型的分類能力,本節(jié)選擇參數(shù)規(guī)模相當(dāng)?shù)腃NN, GC-CNN, Dilated CNN, DGC-CNN與FDGC-CNN進(jìn)行對(duì)比試驗(yàn);實(shí)驗(yàn)的輸入是PolSAR數(shù)據(jù)的協(xié)方差矩陣C,根據(jù)互易原理,單波段C矩陣可以轉(zhuǎn)化為9維的實(shí)數(shù)特征向量Inputreal,如式(10)所示。其中C11,C22,C33分別為協(xié)方差矩陣C的對(duì)角元素,C12,C13,C23分別為C的非對(duì)角復(fù)數(shù)元素。

為了讓實(shí)數(shù)和復(fù)數(shù)域模型的網(wǎng)絡(luò)參數(shù)規(guī)模相近,本文設(shè)置GC-CNN的第1層卷積通道數(shù)為12,參數(shù)自由度(Degree of Freedom, DoF)為8788;設(shè)置CNN的第1層卷積通道數(shù)為17,參數(shù)自由度為8891。GC-CNN和CNN的參數(shù)自由度如圖6所示。CNN和GC-CNN的參數(shù)DoF差異很小,利于實(shí)驗(yàn)說明被推廣到復(fù)數(shù)域下的網(wǎng)絡(luò)的性能優(yōu)勢(shì)。

圖6 CNN和GC-CNN參數(shù)自由度結(jié)構(gòu)圖Fig. 6 The DoF of CNN and GC-CNN

實(shí)驗(yàn)采用像素分類準(zhǔn)確率(Overall Accuracy,OA)、度量分類區(qū)域和真實(shí)地物重合程度的頻權(quán)交并比(Frequency Weighted Intersection over Union, FWIoU)以及一致性檢驗(yàn)指標(biāo)Kappa系數(shù)3個(gè)評(píng)價(jià)指標(biāo)對(duì)試驗(yàn)中各個(gè)網(wǎng)絡(luò)算法進(jìn)行評(píng)估,記N為分類混淆矩陣,Nij為地物i被分為地物j的像素點(diǎn)數(shù)量。OA如式(11)所示

FWIoU如式(12)所示

Kappa系數(shù)的計(jì)算如式(13)所示

4.1 基于AIRSAR平臺(tái)的Flevoland-Netherlands地區(qū)PolSAR數(shù)據(jù)實(shí)驗(yàn)

實(shí)驗(yàn)采用美國(guó)NASA/JPL實(shí)驗(yàn)室基于AIRSAR平臺(tái)的Flevoland-Netherlands地區(qū)L, P, C全波段PolSAR數(shù)據(jù)。該數(shù)據(jù)廣泛地用于PolSAR地物分類研究,總共包含了14類農(nóng)作物和2類人造目標(biāo)。其中,數(shù)據(jù)L波段部分的Pauli偽彩圖如圖7(a)所示,圖像尺寸為1279×1024; 16類真實(shí)地物[27]和對(duì)應(yīng)的標(biāo)簽圖例見圖7(b)和圖7(c),圖7(b)中的黑色區(qū)域不參與模型的訓(xùn)練和評(píng)估。

圖7 Flevoland-Netherlands地區(qū)L, P, C波段PolSAR數(shù)據(jù)Fig. 7 L, P, C-band PolSAR image data over the Flevoland-Netherlands region

16類地物包括potato, beans, wheat, fruit等14類莊稼以及道路和少量建筑。在預(yù)訓(xùn)練CNN和GC-CNN時(shí),由于不同地物類別的樣本數(shù)差異很大,小樣本地物類別的學(xué)習(xí)更加困難。因此,實(shí)驗(yàn)為每類地物采樣數(shù)目相近的樣本用于訓(xùn)練,每類地物采樣樣本數(shù)詳見表1第2行,各地物的采樣率如表1第1行括號(hào)中數(shù)值所示,除Peas外,每類地物的采樣率都低于6%,訓(xùn)練樣本總采樣率為1.5%。在Zhang等人[5]的實(shí)驗(yàn)中,分類精度隨采樣率升高而提升,并推薦在實(shí)際運(yùn)用中將總采樣率設(shè)置為5%~10%。Hou[28]和Guo[29]分別采用5%和10%的采樣率實(shí)現(xiàn)精度相當(dāng)?shù)牡匚锓诸悺1疚脑O(shè)置總采樣率為1.5%,旨在更低的總采樣率下驗(yàn)證所提出模型的學(xué)習(xí)能力和泛化能力。

參考Chen等人[8]的實(shí)驗(yàn)過程,本文對(duì)表1中每組實(shí)驗(yàn)隨機(jī)進(jìn)行了10次采樣和訓(xùn)練,每次訓(xùn)練的超參數(shù)相同,表1的評(píng)估結(jié)果取10次實(shí)驗(yàn)的平均值。由于輸入數(shù)據(jù)為L(zhǎng), P, C全波段極化SAR圖像,因此CNN網(wǎng)絡(luò)的輸入為27維實(shí)數(shù)特征矢量,GC-CCN網(wǎng)絡(luò)的輸入為18維復(fù)數(shù)特征矢量。CNN和GC-CNN各迭代60輪后的收斂曲線如圖8所示。

可見,由于編組-交叉卷積能夠充分利用PolSAR數(shù)據(jù)豐富的相位信息,GC-CNN能更快和更穩(wěn)定地收斂,并且能得到更好的分類效果;從表1中的CNN和GC-CNN兩行可以看出,GC-CNN在OA,Kappa和FWIoU 3項(xiàng)指標(biāo)上都高過CNN大約0.6%,并且在Maize, Peas, Beans和Onion等樣本數(shù)較少的類別上具有更好的分類結(jié)果。然而在參數(shù)規(guī)模相當(dāng)?shù)那闆r下,GC-CNN的卷積乘法運(yùn)算量是CNN的2倍,因此,在預(yù)測(cè)過程中GC-CNN的分類速度較CNN變慢了約2倍。

表1 Flevoland-Netherlands地區(qū)PolSAR圖像分類結(jié)果表Tab. 1 Classification results of Flevoland-Netherlands region

圖8 GC-CNN和CNN訓(xùn)練loss收斂圖Fig. 8 Training loss convergence curves of GC-CNN and CNN

CNN和GC-CNN訓(xùn)練結(jié)束后,將具參數(shù)分別遷移至Dilated CNN和DGC-CNN中,從表1中CNN和Dilated CNN兩行可以看出,Dilated CNN的分類速度較CNN加速了大約55倍,但由于直接遷移CNN的參數(shù),分類精度有0.56%的損耗。DGC-CNN和GC-CNN相比,以損失0.3%分類精度為代價(jià),大幅度提升了分類速度,且分類精度較Dilated CNN有1.1%的提升。

在精調(diào)過程中,由于像素到像素(pixel-to-pixel)映射方式的訓(xùn)練使輸入圖像塊內(nèi)的采樣像素被固定在一個(gè)批次(batch)中計(jì)算損失并更新網(wǎng)絡(luò)參數(shù),引入了先驗(yàn)的空間信息。因此,F(xiàn)DGC-CNN能夠捕獲更多的上下文語意特征,進(jìn)一步提升分類精度。表1最后一行顯示,F(xiàn)DGC-CNN相較于其他算法能夠大幅度提升道路的分類精度,并且對(duì)于一些小樣本地物如Onion, Peas, Beans和Beet等能夠?qū)崿F(xiàn)更加準(zhǔn)確的分類。在AIRSAR平臺(tái)的Flevoland-Netherlands地區(qū)實(shí)驗(yàn)中,F(xiàn)DGC-CNN實(shí)現(xiàn)了最精確和相對(duì)高效的地物分類。

圖9列出了各網(wǎng)絡(luò)的分類結(jié)果圖。從圖9中可見,每個(gè)網(wǎng)絡(luò)都能實(shí)現(xiàn)邊緣保持良好的連貫分類。圖中的白框指出,編組-交叉卷積能在小類別上實(shí)現(xiàn)更加準(zhǔn)確的分類,從而提升整體分類精度。另外,F(xiàn)DGC-CNN能夠彌補(bǔ)DGC-CNN的精度損耗,并且在Road, Beans, Beet上分類結(jié)果更加連貫。綜上,本文采用的FDGC-CNN模型在Flevoland-Netherlands極化數(shù)據(jù)上兼顧了準(zhǔn)確率和分類效率,得到了最優(yōu)的地物分類結(jié)果。

圖9 Flevoland-Netherlands地區(qū)分類結(jié)果圖Fig. 9 Classification images of the Flevoland-Netherlands region

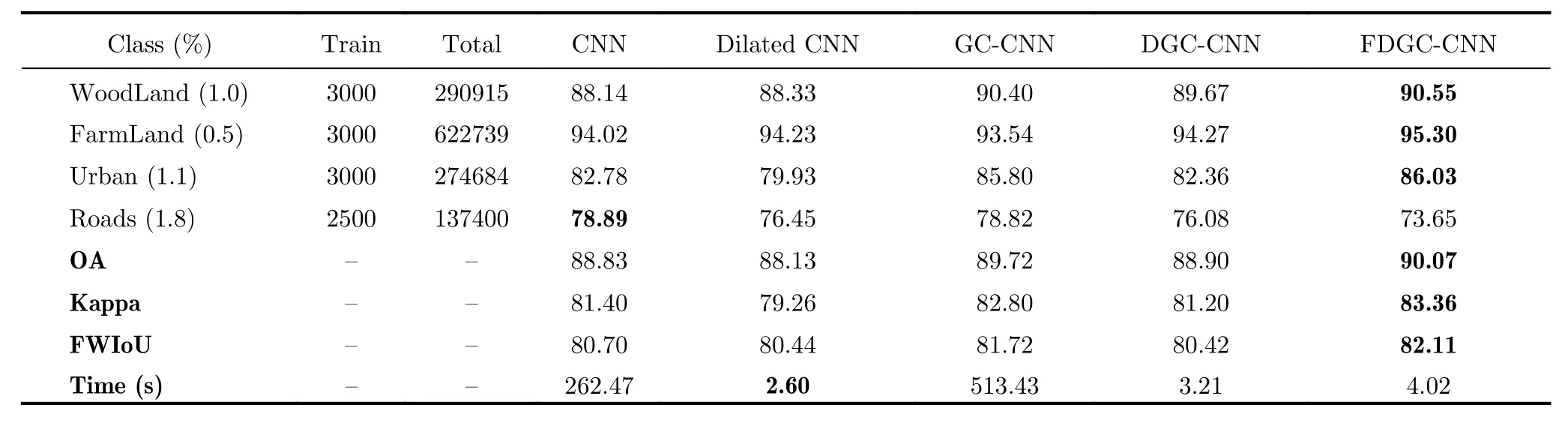

4.2 基于E-SAR平臺(tái)的Oberpfaffenhofen地區(qū)L波段PolSAR數(shù)據(jù)實(shí)驗(yàn)

為驗(yàn)證FDGC-CNN在表面不規(guī)則地物上的分類性能,本文采用德國(guó)E-SAR平臺(tái)的L波段PolSAR數(shù)據(jù)進(jìn)行實(shí)驗(yàn)。該數(shù)據(jù)包含表面粗糙的城區(qū)(Urban)和灌木(WoodLand)以及平滑的耕地(FarmLand)和道路(Road),總共4類地物。數(shù)據(jù)尺寸為1300×1200,其Pauli偽彩圖如10(a)所示,真實(shí)地物和標(biāo)注圖例分別如圖10(b)、圖10(c)所示,其中真實(shí)地物根據(jù)Google Earth光學(xué)圖像通過人工標(biāo)注得到。4類地物的采樣樣本數(shù)和實(shí)驗(yàn)總樣本數(shù)如表2第1、第2列所示,單類采樣率詳見表2第1列括號(hào)中的數(shù)值,實(shí)驗(yàn)總采樣率為0.94%。

圖10 Oberpfaffenhofen地區(qū)L波段PolSAR數(shù)據(jù)Fig. 10 L-band PolSAR image data over the Oberpfaffenhofen region

表2 Oberpfaffenhofen地區(qū)PolSAR圖像分類結(jié)果表Tab. 2 Classification results of oberpfaffenhofen region

表2第4,第6列指出,GC-CNN在表面不規(guī)則的WoodLand和Urban地物上的分類精度相較CNN模型有較大提升,這主要因?yàn)镻olSAR通道相位表征的是回波時(shí)延,GC-CNN通過充分學(xué)習(xí)通道相位信息來提取不規(guī)則地物的空間幾何特征,因此能進(jìn)一步提升不規(guī)則地物的分類精度。Dilated CNN和DGC-CNN在參數(shù)遷移后都損失了大約0.7%的總分類精度,但分類耗時(shí)縮短了大約100倍。精調(diào)后的FDGC-CNN模型在OA、Kappa和FWIoU指標(biāo)上都優(yōu)于DGC-CNN和GC-CNN,兼顧了分類準(zhǔn)確率和效率。

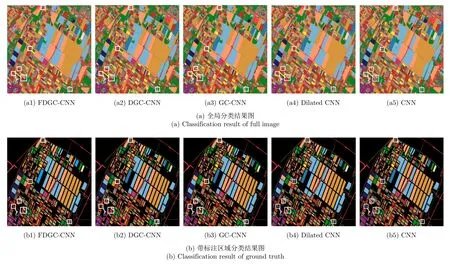

圖11為Oberpfaffenhofen地區(qū)實(shí)驗(yàn)分類結(jié)果圖。GC-CNN在白框區(qū)域較CNN能夠?qū)崿F(xiàn)更連貫的分類,空洞區(qū)域較少。FDGC-CNN相較于GC-CNN在FarmLand上的離散區(qū)域更少,說明精調(diào)過程能夠結(jié)合訓(xùn)練圖像塊中像素的空間信息來約束平滑地物中的離散區(qū)域,進(jìn)而提升分類精度。

圖11 Oberpfaffenhofen地區(qū)分類結(jié)果圖Fig. 11 Classification images of the Oberpfaffenhofen

4.3 實(shí)驗(yàn)分析

從2組實(shí)驗(yàn)的分類精度評(píng)估指標(biāo)曲線(如圖12所示)可以看出,基于編組-交叉卷積的模型能夠利用相位信息有效地提升網(wǎng)絡(luò)的分類精度。將CNN和GC-CNN的參數(shù)遷移到Dilated CNN和DGC-CNN后,分類精度輕微下降,但分類速度大幅度提升。精調(diào)的FDGC-CNN能學(xué)習(xí)更多的上下文語義特征,從而修正一些樣本數(shù)較少或具有較強(qiáng)結(jié)構(gòu)特征地物的錯(cuò)分像素,并能根據(jù)像素的空間關(guān)聯(lián)信息剔除規(guī)則地物區(qū)域中的離散點(diǎn)和空洞點(diǎn),最終在GCCNN和DGC-CNN的總體分類精度上實(shí)現(xiàn)了進(jìn)一步的提升。綜上,兩組實(shí)驗(yàn)驗(yàn)證了FDGC-CNN模型能夠在少量先驗(yàn)標(biāo)注下實(shí)現(xiàn)高精度高效率的極化SAR地物分類。

5 結(jié)論

本文通過FDGC-CNN算法實(shí)現(xiàn)了在低采樣率下精確且高效的PolSAR地物分類。該算法首先用低采樣率采樣得到的像素點(diǎn)預(yù)訓(xùn)練GC-CNN,隨后將網(wǎng)絡(luò)參數(shù)遷移到DGC-CNN中,在分類精度降低的代價(jià)下實(shí)現(xiàn)像素到像素(pixel-to-pixel)直接映射的快速分類。最后通過精調(diào)參數(shù)遷移后的DGC-CNN以捕獲更多上下文強(qiáng)語義特征,進(jìn)而修正錯(cuò)分樣本,提升分類精度。基于AIRSAR平臺(tái)以及E-SAR平臺(tái)的PolSAR數(shù)據(jù)的實(shí)驗(yàn)表明,在低采樣率下,F(xiàn)DGC-CNN相較于SVM分類器和CNN模型取得了精度和效率上的大幅度提升,兼顧了分類精度和效率,具有很強(qiáng)的實(shí)用性和部署性。

圖12 Flevoland-Netherlands和Oberpfaffenhofen地區(qū)實(shí)驗(yàn)各模型評(píng)估結(jié)果曲線Fig. 12 Evaluate results curve of models on Flevoland-Netherlands and Oberpfaffenhofen